VLA不同思路实践的效果及示例

如果从零开始应用VLA确实是一个系统工程,不必被“大模型”的声势吓住,关键在于根据你最看重的目标,选择一条最合适的路径。

尽早让机器人在目标场景中“动起来”,用真实数据驱动模型的迭代, 可以在一个干净的仿真环境中跑通整个流程,这比一开始就追求复杂的“策略三”要稳妥得多。

1

VLA落地常见方法

策略 | 核心思路 | 研发投入 | 风险 | 周期 | 效果上限 | 适用对象 |

|---|---|---|---|---|---|---|

拿来主义 | 开箱即用,零代码部署 | 极低 | 低 | 最快 | 与模型能力上限持平 | 追求速度、验证概念的团队 |

精雕细琢 | 开源模型 + 小样本微调 | 较低 | 中 | 数周至数月 | 显著提升(可达~97%成功率) | 有基础技术能力的团队 |

双管齐下 | 模型与强化学习协同 | 中等 | 中高 | 数月至半年 | 持续进化,超越人工 | 有研发实力的团队 |

开山立派 | 全流程自研 | 高 | 很高 | 以年为单位 | 没有上限,但成功概率低 | 技术领先、不计成本的企业 |

2

四种策略深度解析

策略一:拿来主义(最快落地)

最高优先级的任务是“快速验证” ,想知道VLA技术在清洁机器上能否跑通,此阶段不应投入研发资源,目标是“跑起来”。

- 模型选择 :首选 VLA-Pilot 这类“即插即用”的免微调模型,可以直接用预训练模型在机器人上做零样本测试。

- 关键约束 :VLA模型需要处理相机输入的图像,这可能会给算力带来较大负担,可以用 EfficientVLA 或 FlashVLA 等技术来加速推理,或者在普通PC上用一块消费级GPU(如RTX 4090)运行SmolVLA。

venv

- 数据要求 :只需准备50-100条高质量的 遥操作 演示数据用于测试。

策略二:精雕细琢(效果最好)

目标是 让模型的表现达到最优 ,并适应你的特定清洁场景和曲面跟随需求。

- 核心方法 :开源模型 + 高质量微调,行业实践证明,这是提升VLA模型在新场景下性能的黄金组合。

- 模型选择 :推荐 OpenVLA-7B 或更轻量的 X-VLA 作为基座模型,采用业界验证的 OpenVLA-OFT (Optimized Fine-Tuning) 微调方案,其包含 并行解码、动作分块、L1回归损失 三大核心技术,可将任务成功率从76.5%提升至97.1%,并实现26倍的动作生成加速。

- 数据要求 :采用 ControlVLA 技术,通过物体中心表征进行微调,仅需20次左右的遥操作演示即可高效泛化新任务。

策略三:双管齐下

目标是 让模型拥有自我进化的能力 ,在多变场景中持续适应,结合模仿学习的“基础能力”和强化学习的“探索优化”能力。

- 核心逻辑 :模型学会基础操作后,通过自我实践和探索(RL),发现并修正自身局限。

- 关键方法 :参考 Recap 方法,实现“示范学习-纠错指导-自主实践”的进化闭环。或利用 PLD (Probe, Learn, Distill) 框架,通过残差RL和分布感知数据采集来提升模型性能。

- 仿真环境 :RL探索成本高昂且危险,因此必须在仿真环境中进行。高效的Sim2Real迁移是关键,相关技术如 Sim2Real-VLA 、已有突破。

策略四:开山立派(不计成本)

目标:构建全栈自研能力,形成技术壁垒,这是 资金充裕、有长期技术战略的大型企业 的路径。

- 核心逻辑 :从零开始设计模型架构,构建大规模、高质量的数据集,并进行从头预训练。

- 资源门槛 :此路径 投入巨大,风险极高, 小鹏汽车研发VLA时,曾 每月花费超1亿元的训练费用 ,历时一年多才取得突破。这种高昂的成本和风险,对多数初创公司来说是难以承受的。

3

多策略对比

评估维度 | 策略一:拿来主义 | 策略二:精雕细琢 | 策略三:双管齐下 | 策略四:开山立派 |

|---|---|---|---|---|

研发投入 | 极低 | 较低 | 中等 | 高 |

数据需求 | 50-100条演示 | 20-50条高质量演示 | 数百条+仿真数据 | 数十万条+海量仿真 |

算力需求 | 1张消费级GPU | 1-4张消费级GPU | 数张高性能GPU | 千卡/万卡级别 |

项目周期 | 1-4周 | 2-3个月 | 6个月以上 | 1-2年以上 |

技术风险 | 低 | 中 | 中高 | 高 |

模型可解释性 | 低 | 中 | 中 | 高 |

持续学习能力 | 无 | 有限(需再微调) | 强 | 最强 |

项目适用阶段 | PoC验证 | 产品化落地 | 产品迭代与进化 | 平台级技术储备 |

成功率预期 | 50-70% | 90%+ | 持续提升,可达99%+ | 取决于研发实力 |

4

具体步骤(策略二为例)

前期准备 → 数据采集 → 数据预处理 → 模型微调 → 评估验证 → 部署与优化

第一步:前期准备与环境搭建

这是基础阶段,目标是为整个项目搭建一个稳定、可复现的实验环境。

硬件准备

- 机器人平台 :SCARA改进构型机器人需要具备稳定的控制接口,并能实时反馈关节状态,对于复杂清洁任务,能输出至少30Hz的关节状态和控制指令是必要的。

- 计算设备 :建议准备一套独立的训练和推理环境。

- 训练 :一台配备NVIDIA GPU(如RTX 3090/4090或更高)的服务器,显存是VLA微调的关键瓶颈,24GB是基本门槛。

- 推理 :可选用Jetson AGX Orin等边缘计算设备,满足低延迟的实时控制需求。

- 传感器:

- 为机器人安装至少一个腕部相机,用于观察末端执行器的操作细节,如清洁刷与马桶壁的接触点。

- 一个第三视角相机可以提供全局视野,帮助模型理解任务背景。

- 遥操作设备 :这是 数据采集的关键 。请参考下表进行选择:

设备类型 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

键盘 | 成本极低,入门快 | 操作不直观,映射复杂,数据质量一般 | 快速概念验证、移动底盘控制 |

主从臂 | 映射非常直观,数据质量高 | 成本高,结构依赖性强,跨机型迁移困难 | 追求最高数据质量、固定机型的企业 |

VR设备 | 方案灵活,硬件可复用 | 集成成本高,有晕眩感,需要渲染环境 | 复杂操作、远程操作场景 |

UMI | 硬件通用,跨机型复用性好 | 采集精度受校准影响 | 训练泛化性强的通用VLA模型 |

最佳实践 :对于清洁任务, 键盘是可行的低成本起点, 但如果希望采集高质量的数据,建议投资一套 VR遥操作 系统,它在直观度和通用性之间取得了很好的平衡。

软件环境搭建

- 基础依赖 :创建一个新的Python环境,安装PyTorch、Transformers、Datasets、Jupyter等。

- 选定VLA微调框架 :推荐从以下成熟的框架中选择:

- OpenVLA :基于Llama 2,生态完善,社区活跃,是目前最流行的开源VLA框架之一,OpenVLA-OFT是其改进版本,提供了正交微调(OFT)方法。

- LeRobot (Hugging Face) :Hugging Face的机器人平台,集成多种模型(如PI0, SmolVLA),数据集处理和模型训练流程标准化程度高。

- OpenPI (PI0) :由Physical Intelligence开发,专注于扩散模型架构,在生成平滑和连续的机器人动作上表现突出。

最佳实践:

- 从 OpenVLA 或 LeRobot 开始,因为它们的文档最全,社区最大,遇到问题时更容易找到解决方案。

- 使用conda或venv创建独立环境,并用pip install -e .以可编辑模式安装选定的框架。

第二步:数据采集

VLA模型对数据的数量和质量极其敏感,这一步是决定项目成败的核心。

制定采集计划

- 数据量 :对于“精雕细琢”策略,目标是在特定场景下采集 50-100条 高质量的演示(Episode),每条Episode应包含从初始状态到任务完成的完整序列。

- 任务定义 :将“清洁马桶”这个大任务拆解为多个子任务。例如:

- 子任务1 :接近外壁,调整姿态准备清洁。

- 子任务2 :沿外壁执行清洁动作,保持恒定接触力。

- 子任务3 :移动到内壁,重复上述过程。

针对每个子任务单独采集数据,可以提升数据质量和微调效率。

执行数据采集

操作者通过遥操作设备, 演示 机器人完成每个子任务,确保每次演示的指令(Prompt)描述准确一致,例如使用“清洁外壁”而非“开始清洁”,指令与动作的一致性对模型学习至关重要。

每次演示需记录:

- 多个视角的 RGB图像 。

- 机器人本体的 关节位置/速度/力矩 。

- 末端一维压力传感器 的力反馈数据。

- 精确的 时间戳 ,用于对齐图像和状态信息。

最佳实践:

- 数据多样性 :在略有差异的环境下(如不同光照、马桶位置)采集数据,增强模型的鲁棒性。

- 数据质量 :每次演示应平滑、成功完成,质量低劣的数据会“污染”模型。宁愿要50条完美数据,也不要500条平庸数据。

第三步:数据预处理与格式转换

原始数据需要转换成VLA模型能够消化的标准格式。

数据清洗与同步

- 剔除失败、卡顿或指令错误的演示片段。

- 基于 时间戳 ,确保相机图像、机器人状态和力传感器数据在时间上一一对应,时间戳错位是导致模型训练失败的主要原因之一。

格式转换

将清洗后的数据,转换为目标模型和框架所需的格式,例如,OpenVLA通常需要 RLDS 格式或LeRobot支持的格式。

许多框架(如LeRobot)提供了将原始数据转换为标准格式的脚本和工具。

数据集划分

将准备好的数据划分为 训练集 (约80-90%)和 验证集 (约10-20%),用于评估模型性能。

最佳实践:

- 在处理前,先对图像进行归一化和尺寸统一处理。

- 在转换过程中,严格遵守目标框架的 目录结构 (如OpenVLA要求的版本化目录)和 命名规范 。OpenVLA要求bridge_orig/0.1.0/xxx.tfrecord-00000这样的层级结构,目录结构与版本子目录至关重要。

第四步:模型微调

这是精雕细琢的核心环节,模型从互联网上学到的通用知识,将通过你的数据“特训”,学会清洁的专用技能。

加载预训练模型

从模型仓库(如Hugging Face)下载一个预训练好的VLA模型权重作为起点,例如 openvla-7b 。

选择微调策略

- LoRA : 强烈推荐, 它通过训练少量额外的参数来微调模型,显存占用低,训练速度快,且不易过拟合。一个24GB显存的GPU足以胜任。

- Full Fine-tuning :理论上效果上限更高,但对硬件要求极高,且容易在数据量较少时发生过拟合。

配置训练参数

这是一个需要反复实验的过程,但可以从以下基准值开始:

batch_size:根据GPU显存调整(例如2-8)。

learning_rate:学习率,通常1e-4到5e-4是有效的范围。

epochs:训练轮数,小数据集下通常10-50轮即可收敛。

image_augmentation:强烈建议启用,可以极大提升模型的泛化能力。启动训练

使用框架提供的训练脚本启动微调,例如,OpenVLA的命令可能是:

torchrun --standalone --nnodes 1 --nproc-per-node 1 vla-scripts/finetune.py \

--data_root_dir ./my_dataset/ \

--dataset_name my_mop_cleaning \

--vla_path "openvla/openvla-7b" \

--use_lora最佳实践:

- 使用 Weights & Biases (wandb) 等工具记录训练过程中的损失、成功率等指标,方便监控和对比。

- 定期保存模型检查点,并观察验证集上的表现,防止过拟合。

第五步:评估验证

模型训练好之后,需要科学地评估其真实能力,不能只看最终的任务成功率。

评估方法

- 使用 验证集 中的场景,多次运行模型,统计 任务成功率 。这是最直观的指标。

- 引入 诊断性评估 ,如NEBULA框架,对模型进行更细致的压力测试和技能诊断。例如,评估模型对马桶位置微小偏移、光照变化的鲁棒性,或是在曲面接触力维持上的精确度。

- 推荐使用 vla-eval 这类统一的评估工具,它们将模型推理和基准执行解耦,提供更标准化、可复现的评估结果,避免重复造轮子。

分析结果与迭代

- 如果成功率不理想,分析失败案例:是视觉识别出错?还是力控策略不稳定?

- 根据失败原因,回到 第二步 或 第四步 ,补充针对性数据或调整训练参数。

第六步:部署与优化

模型评估达标后,就可以将其部署到实际机器人上,进行最终的真机测试和微调。

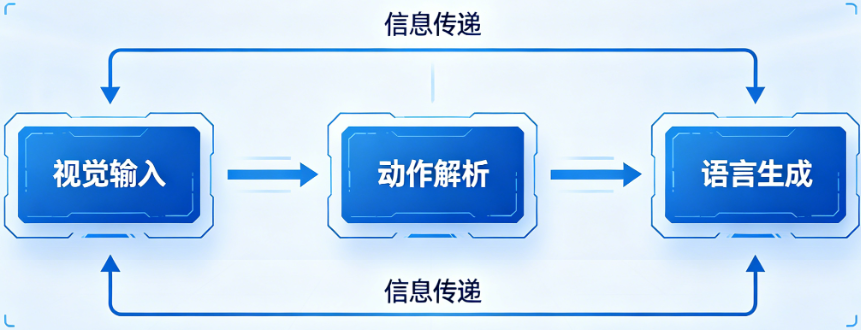

部署架构

搭建一个轻量级的通信架构,如 ZMQ Server-Client, 机器人的控制器作为客户端,发送传感器数据给服务器,VLA模型在服务器上推理出动作,再返回给机器人执行。

真机测试

- 从低速、安全的动作开始,观察机器人表现。

- 重点关注模型推理延迟和动作的 平滑性 。如果出现抖动,可能需要增加动作平滑滤波器或调整推理频率。

- 由于你的机器人末端带有一维压力传感器, 务必 在部署时加入力/力矩的 安全监控与限制 。当检测到超出安全阈值的力时,应能立即停止机器人,以防损坏设备。

最终优化

- 根据真机测试中的问题,调整RTC参数或动作平滑策略。

- 对于清洁这种接触任务,可以考虑引入一个 传统PID控制器 来处理力控,让VLA模型负责高层决策(如“沿着壁面移动”),形成混合控制架构,这样既能发挥VLA的智能,又能保证力控的精准稳定。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-05-05,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读