Nat. Mach. Intell. | 面向材料科学的多模态大语言模型

Nat. Mach. Intell. | 面向材料科学的多模态大语言模型

DrugAI

发布于 2026-04-28 10:30:06

发布于 2026-04-28 10:30:06

DRUGONE

理解和预测无机材料的性质对于推动能源、电子等领域的发展至关重要。近年来,多模态大语言模型为整合结构数据与文本信息提供了新的可能,但如何将原子级结构信息有效融入语言模型仍然是一个关键挑战。

针对这一问题,研究人员提出了MatterChat,一个结构感知的多模态大语言模型框架。该模型通过一个桥接模块,将预训练的原子间相互作用模型与大语言模型进行对齐,从而实现结构数据与文本信息的统一建模。实验结果表明,MatterChat在材料性质预测与人机交互任务中显著优于通用大模型,同时能够支持复杂科学推理与材料合成过程的逐步生成。这一方法为材料科学中的智能辅助设计与发现提供了新的范式。

传统材料发现依赖于密度泛函理论和分子动力学等高精度计算方法,但这些方法计算成本极高,难以支持大规模筛选。同时,许多复杂材料体系缺乏清晰的理论理解,导致材料发现往往依赖经验或偶然性。

随着人工智能的发展,研究人员开始利用机器学习模型加速材料设计,包括代理模型、原子间势模型以及生成模型等。这些方法能够快速预测材料性质并探索设计空间,推动了储能、电子和催化等领域的发展。

然而,现有方法仍存在明显局限。一方面,图神经网络等结构模型虽然能够准确预测性质,但缺乏语言理解能力,难以支持复杂推理与人机交互;另一方面,基于文本的大语言模型虽然具备强大的语言能力,却难以直接处理原子结构中的空间信息。

因此,如何将结构信息与语言能力统一起来,成为材料人工智能领域的重要挑战。研究人员提出,通过构建多模态大模型,可以实现结构与语言的深度融合,从而突破这一瓶颈。

方法

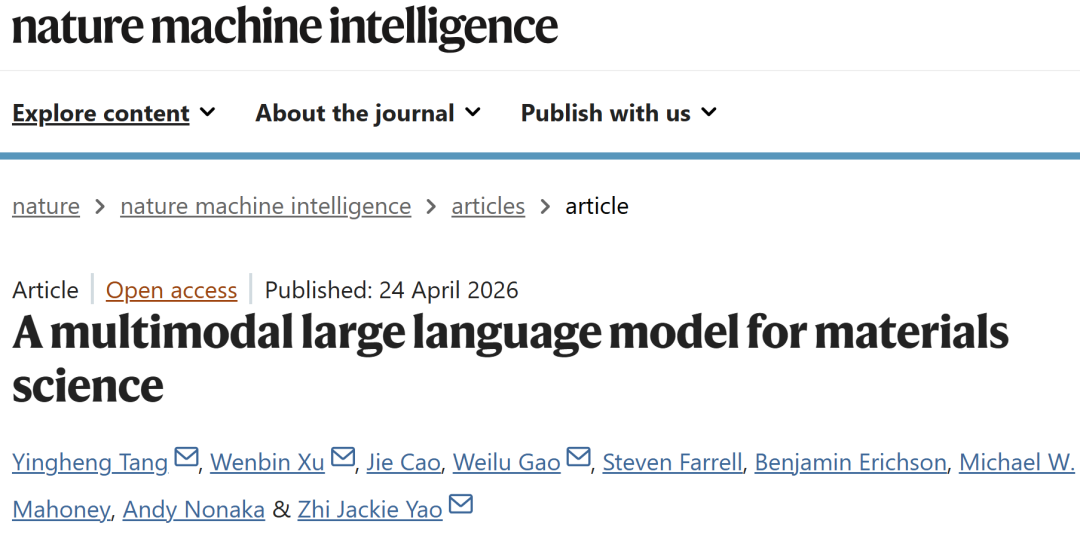

MatterChat采用模块化架构,将材料结构建模与语言建模有机结合。

在材料处理分支中,研究人员利用预训练的图神经网络模型(如CHGNet或MACE)提取原子级表示,这些表示能够捕捉原子类型、键结构以及空间几何信息。与此同时,语言处理分支使用预训练大语言模型(如Mistral 7B)对用户输入进行语义编码。

关键创新在于桥接模块。该模块通过多层Transformer结构,将原子嵌入映射为语言模型可接受的表示。其内部通过交替的交叉注意力与自注意力机制,使结构信息与文本语义逐步对齐。

在训练过程中,模型采用两阶段策略:首先通过结构–文本对齐进行预训练,然后通过多任务指令微调提升在材料描述与性质预测任务中的表现。

这种设计使得模型无需重新训练整个网络,仅需训练轻量级桥接模块,即可实现多模态融合,大幅降低训练成本。

图1:MatterChat整体架构。

结果

MatterChat由材料分支、语言分支和桥接模块组成,形成一个统一的多模态框架。数据集包含约14万种材料结构,覆盖周期表中广泛元素,并具有丰富的晶体结构分布。

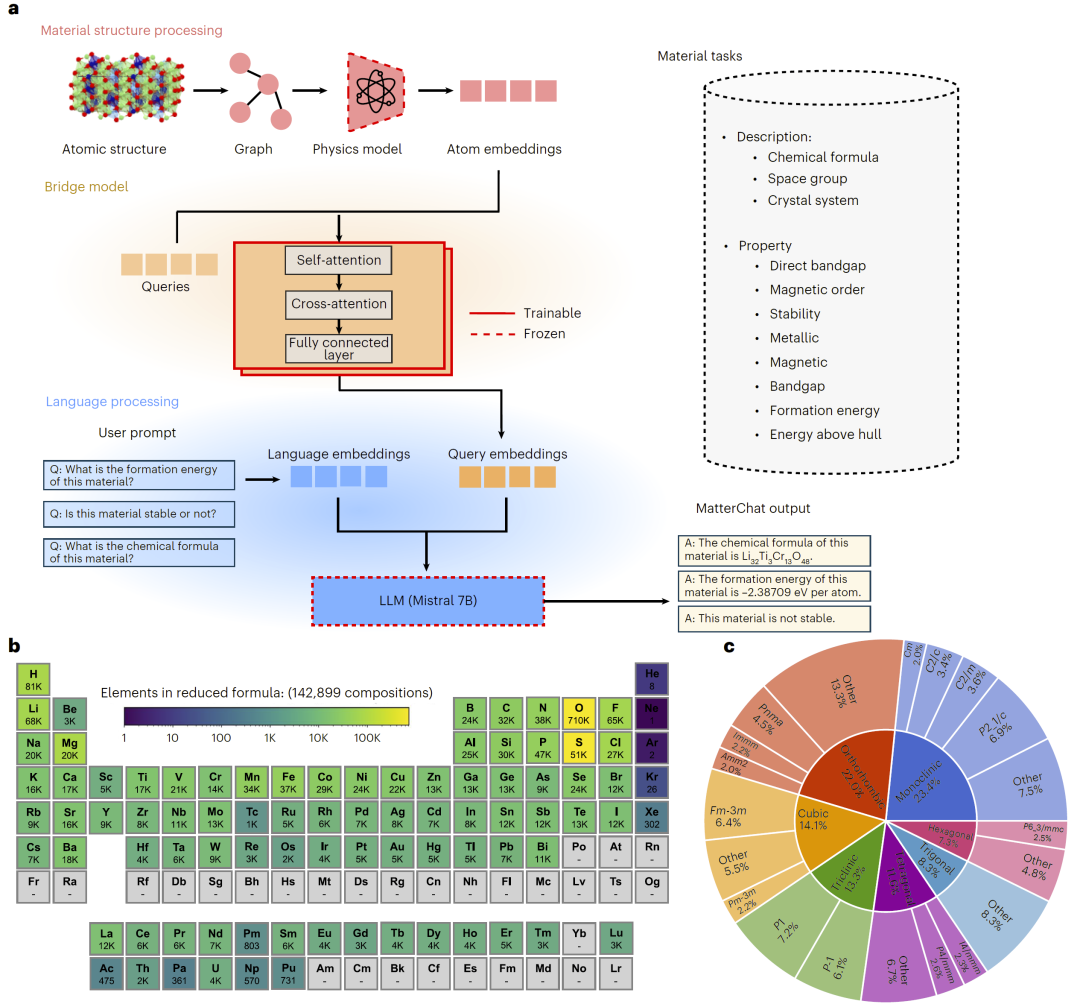

材料属性预测与人机交互能力

MatterChat能够通过自然语言与用户交互,回答关于材料组成、晶体结构及电子性质等问题。例如,在页面4的示例中,模型可以准确预测材料的带隙、稳定性及形成能,并提供结构相关解释。

与GPT-4o等模型相比,MatterChat在形成能预测任务中表现更接近真实值,显示出其在结构感知建模方面的优势。

图2:多模态问答与性能对比。

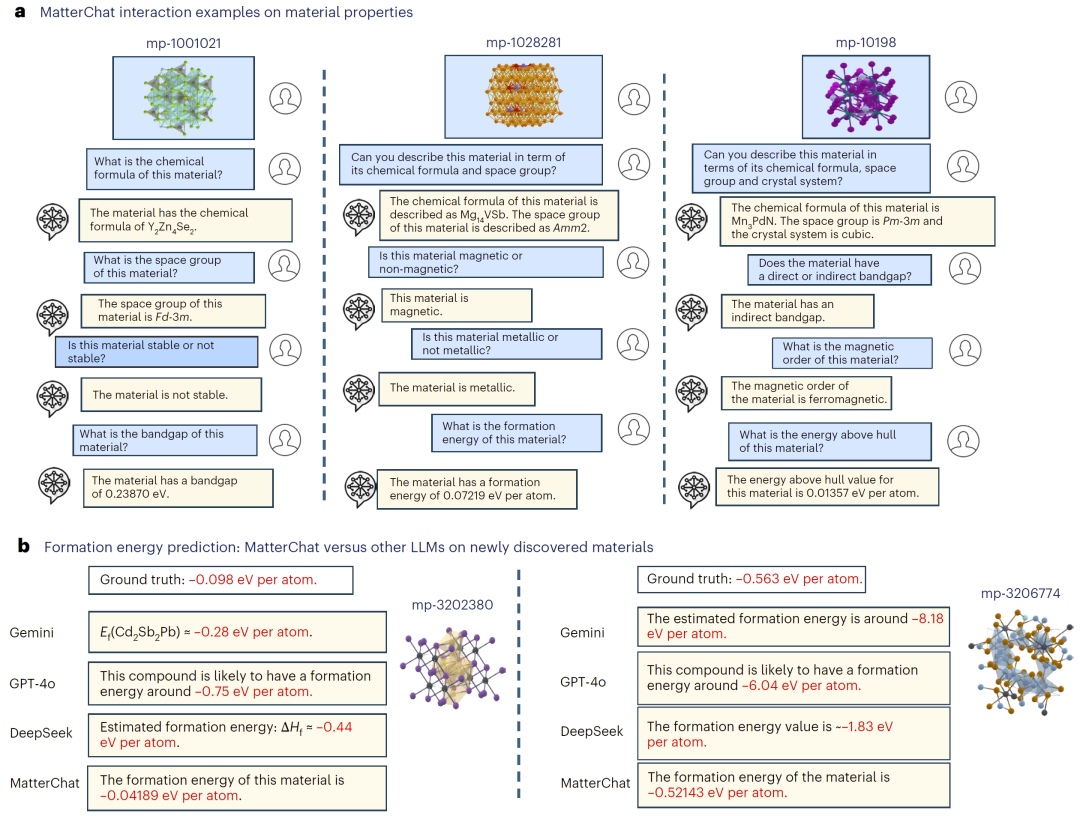

复杂科学推理与合成能力

在更复杂任务中,MatterChat不仅能够解释材料稳定性,还可以生成符合实验标准的合成步骤。例如,在GaN材料案例中,模型能够给出详细的化学气相沉积过程,并指出关键反应条件。

这一能力来源于结构信息与语言知识的结合,使模型能够进行“结构驱动推理”,而不仅仅是文本生成。

图3:推理与合成过程。

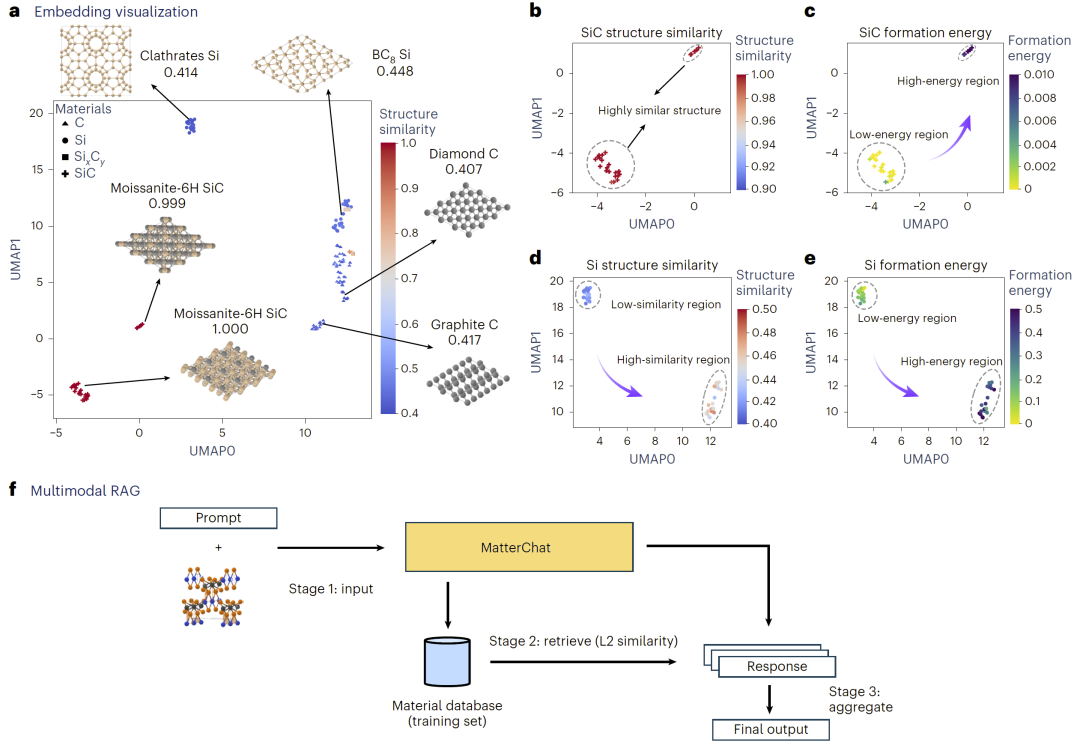

结构嵌入的物理意义

通过UMAP降维分析可以看到,模型学习到的结构嵌入能够将不同材料按照结构相似性进行聚类,同时与形成能等性质呈现一致趋势。

例如,在硅与碳材料体系中,不同晶体结构被清晰分离,而相似结构在嵌入空间中更加接近。这说明模型不仅捕捉了结构特征,还编码了性质信息。

图4:嵌入空间可视化。

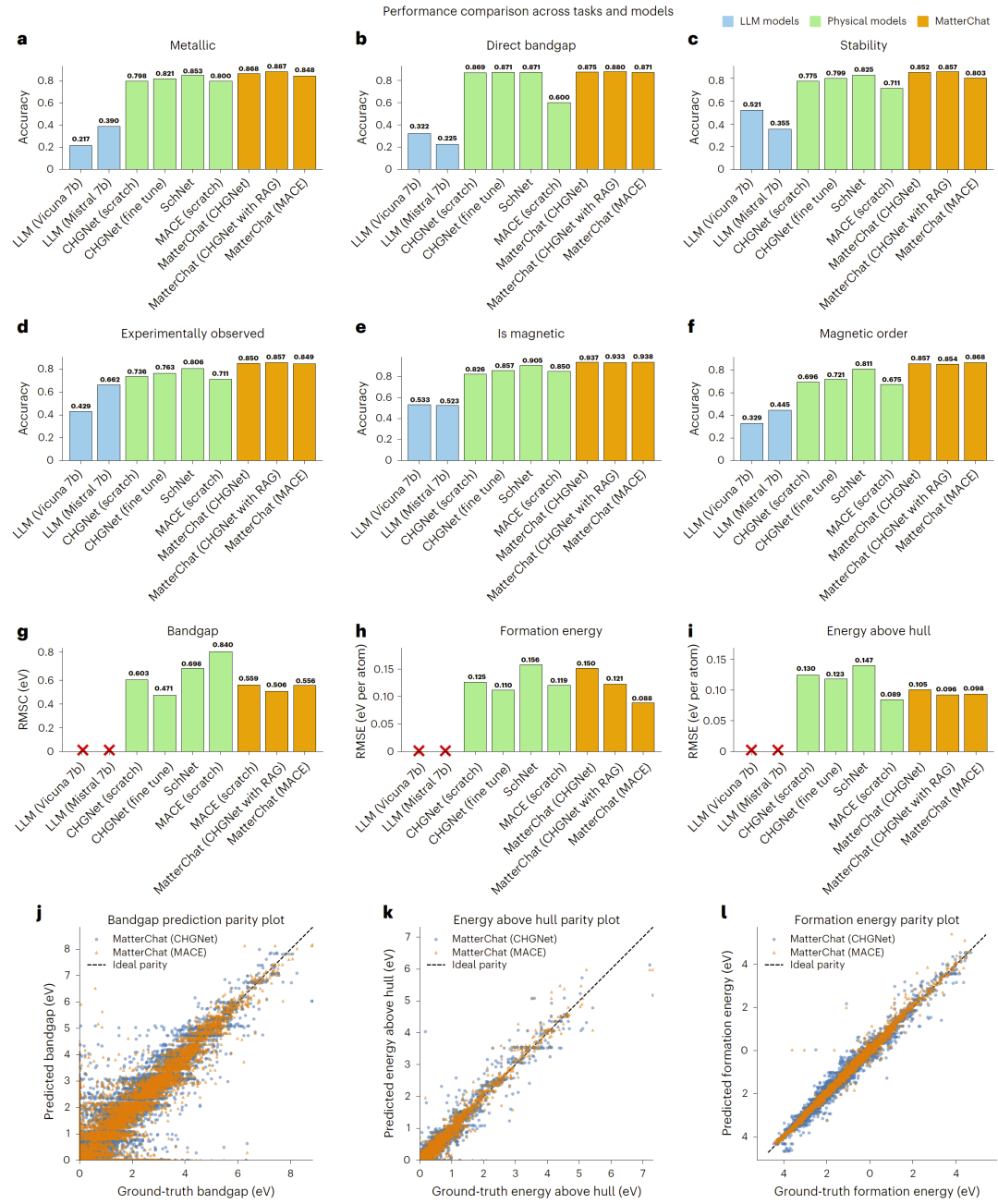

多任务性能评估

在9项材料任务中,MatterChat在分类任务(如金属性、稳定性)和回归任务(如带隙、形成能)上均优于传统模型与纯语言模型。

特别是在数值预测任务中,其误差显著低于其他方法,表明多模态融合显著提升了预测精度。

图5:性能对比。

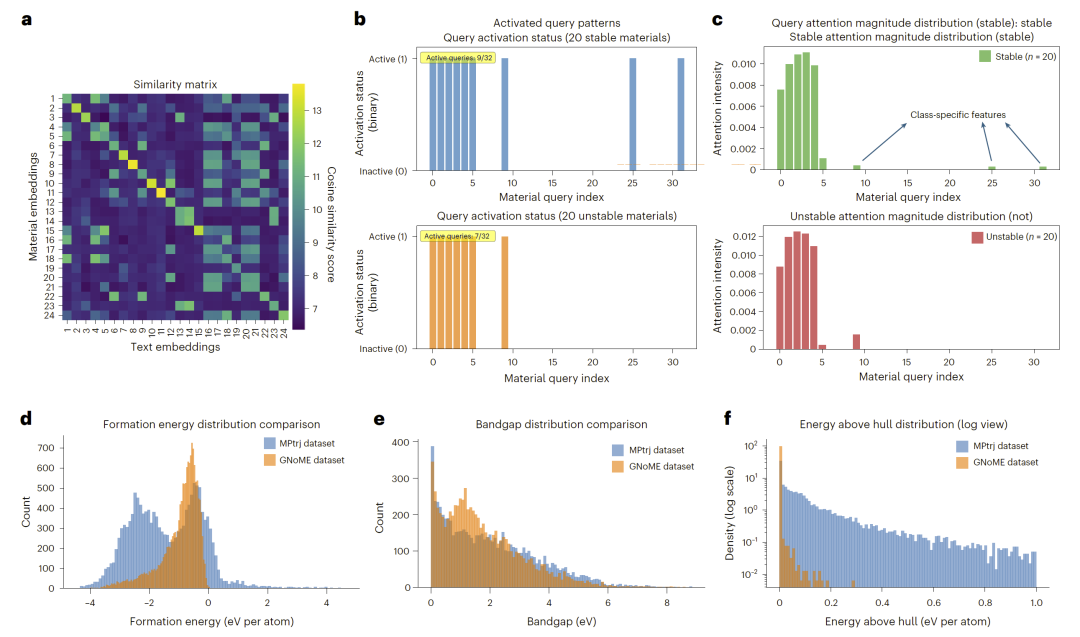

结构–语言对齐机制分析

进一步分析显示,模型在结构与语言之间建立了明确的对齐关系。例如,不同结构特征会激活特定的注意力通道,从而指导模型进行稳定性判断。

同时,在分布外数据集(如GNoME)上,模型仍然保持良好性能,说明其具有较强的泛化能力。

图6:注意力与对齐分析。

讨论

研究人员提出的MatterChat展示了一种新的材料AI范式,即通过多模态大模型统一结构信息与语言能力,从而实现材料性质预测与科学推理的融合。

该方法的核心优势在于其模块化设计,不仅降低训练成本,还具有良好的扩展性。同时,通过直接处理原子图结构,模型能够更准确地捕捉空间信息,避免了传统文本表示的局限。

然而,该方法仍存在一定挑战。例如,模型在高精度数值预测方面仍存在分辨率限制,同时多模态对齐仍有改进空间。此外,大语言模型本身的幻觉问题也可能影响结果可靠性。

未来,研究人员可以通过引入更强的物理约束、多轮推理机制以及更丰富的数据集,进一步提升模型性能。

总体而言,MatterChat为材料科学提供了一种“结构+语言”的统一建模框架,有望推动材料设计从经验驱动向智能驱动转变。

整理 | DrugOne团队

参考资料

Tang, Y., Xu, W., Cao, J. et al. A multimodal large language model for materials science. Nat Mach Intell 8, 588–601 (2026).

https://doi.org/10.1038/s42256-026-01214-y

内容为【DrugOne】公众号原创|转载请注明来源

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读