NVIDIA 重磅发布:人形运动与机器人学习全栈生态,AI 具身智能迎来「数据底座」革命

NVIDIA 重磅发布:人形运动与机器人学习全栈生态,AI 具身智能迎来「数据底座」革命

GPUS Lady

发布于 2026-04-24 20:50:19

发布于 2026-04-24 20:50:19

近日,NVIDIA 正式开源一整套面向人类 / 人形机器人运动生成与机器人学习的全栈技术生态,把「人体运动数据」从采集、生成、迁移、仿真到训练的全流程工具链彻底开放,为具身人工智能(Embodied AI)按下加速键。

数据是 AI 规模化的核心。过去,人体姿态模型不统一、运动数据稀缺、工具链割裂,严重阻碍机器人学会像人一样自然运动。这次 NVIDIA 一次性补齐短板:开源全套模型与工具、超大规模高质量数据集、统一人体骨架标准 SOMA,所有模块无缝协同,且全部采用Apache 2.0 开源协议,商用友好。

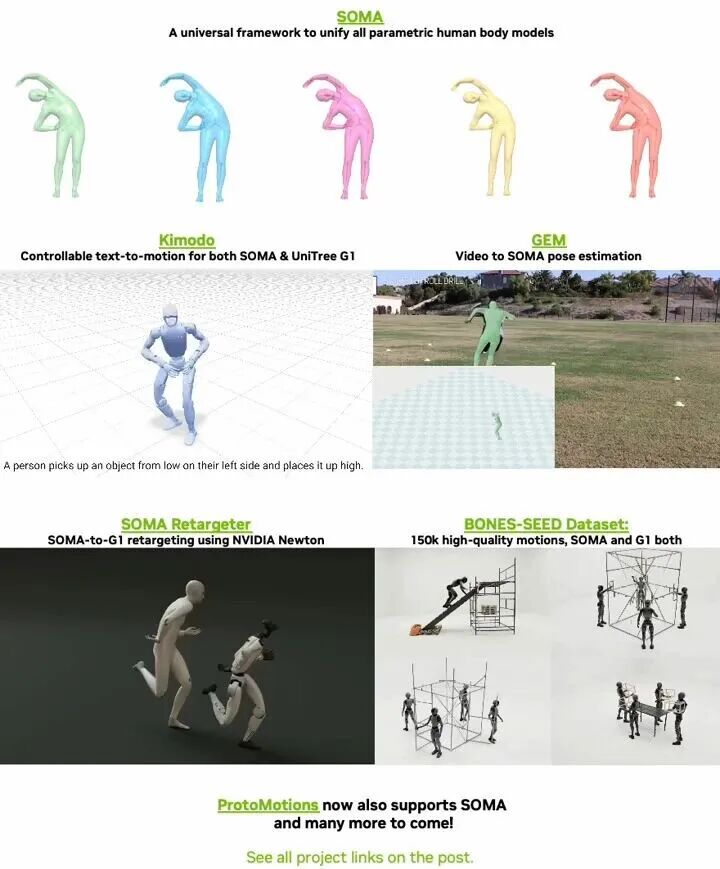

一、底层基石:SOMA—— 统一所有人体模型的「通用语言」

SOMA 是这套生态的核心接口,它把 SOMA-shape、SMPL、MHR 等各类参数化人体模型,统一成一套标准骨架表示。

过去不同人体模型之间迁移运动,需要写专用适配器、做定制化转换;有了 SOMA,全流程打通,一次生成、全域可用,彻底消除格式壁垒。

二、七大核心工具,覆盖运动全生命周期

1️⃣ Kimodo:文本→运动,高精度可控生成

支持人类 + 人形机器人双场景,输入文字就能生成高保真、可控制的自然运动,让机器人不用手动调动作,直接 “听懂指令做动作”。

2️⃣ GEM:从任意视频里 “扒” 出人体姿态

面向真实场景视频的全局人体姿态估计,原生兼容 SOMA 格式,能从海量日常视频里批量提取高质量人体运动数据,解决数据来源问题。

3️⃣ Bones-SEED:15 万 + 超大运动数据集

与 Bones Studio 合作打造,超 15 万条 SOMA 格式运动数据,已经完成面向宇树 G1 人形机器人的迁移适配,是目前业内规模最大、质量最高的开源运动数据集之一。

4️⃣ SOMA Retargeter:一键迁移动作到机器人

专用动作迁移工具,把 SOMA 标准骨架的运动,无缝迁移到宇树 G1 人形机器人,不用复杂调试,快速让机器人复现人类动作。

5️⃣ ProtoMotions:数字人 / 人形机器人强化学习仿真

高性能仿真框架,基于强化学习(RL)训练数字人与机器人,原生支持 SOMA,训练更快、更稳定、更贴近真实物理世界。

6️⃣ SONIC:顶尖人形行为基础模型(即将支持 SOMA)

当前最先进的人形机器人行为基础模型与控制器,很快将全面兼容 SOMA,让机器人拥有更智能、更流畅的自主行为能力。

三、这套生态到底意味着什么?

对研究者:不用再重复造轮子,直接用全栈工具快速做实验。

对企业:低成本快速开发人形机器人、数字人、虚拟角色。

对行业:统一标准 + 海量数据,推动具身 AI 从实验室走向规模化落地。

NVIDIA 表示,这只是开始,更多功能还在持续迭代。一个人人都能低成本训练 “会动、会做、像人一样灵活” 的机器人时代,正在到来。

官方项目链接

- SOMA:https://github.com/NVlabs/SOMA-X

- Kimodo:https://research.nvidia.com/labs/sil/projects/kimodo/

- GEM:https://github.com/NVlabs/GEM-X

- Bones-SEED 浏览器:https://seed-viewer.bones.studio/

- Bones-SEED 数据集:https://huggingface.co/datasets/bones-studio/seed

- SOMA Retargeter:https://github.com/NVIDIA/soma-retargeter/

- ProtoMotions:https://github.com/NVlabs/ProtoMotions

- SONIC:https://nvlabs.github.io/GEAR-SONIC/

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录