从理论到实践:Cosmos Reason在物理AI推理中的应用探索

从理论到实践:Cosmos Reason在物理AI推理中的应用探索

GPUS Lady

发布于 2026-03-02 21:05:55

发布于 2026-03-02 21:05:55

本视频整理自线上技术研讨会《Build Reasoning Agents For Physical AI | Cosmos Labs》

当机器人走出实验室的围栏,开始在真实世界中与人类共同生活和工作时,它们面临的挑战远不止完成机械动作那么简单。如何理解人类的社交暗示?如何判断一个物体的运动轨迹是否存在危险?如何在多人场景中选择正确的交互对象?这些问题的答案,正是物理AI推理技术试图解决的核心议题。

Cosmos Labs最近的技术分享展示了如何利用Cosmos Cookbook中的实用方法,让AI系统具备更接近人类的推理能力。来自不同领域的专家们通过四个典型案例,呈现了从社交智能到场景理解的完整技术图景。

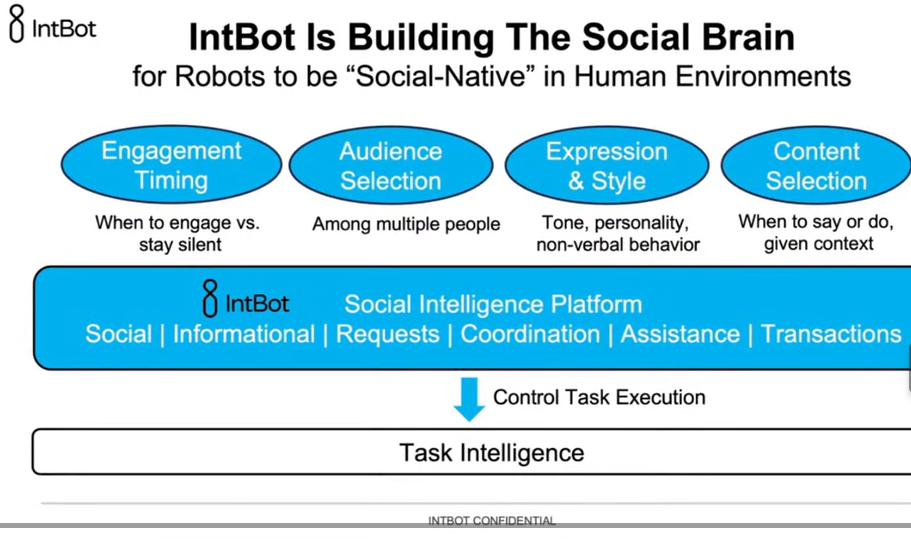

社交智能:机器人如何读懂人类意图

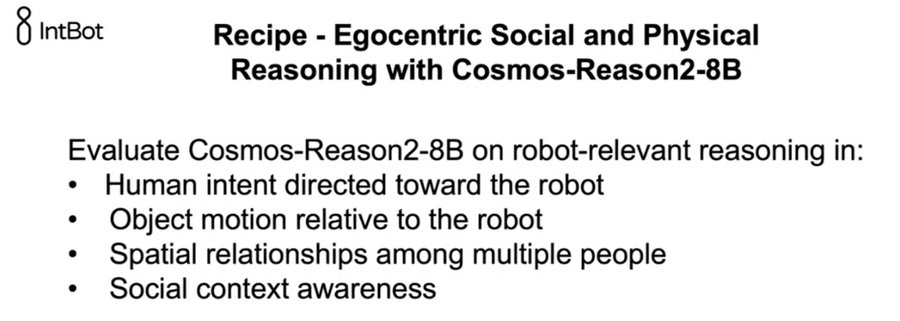

位于圣何塞的机器人初创公司Inbot正在开发具有社交智能的人形机器人。他们的首席技术官Sharon解释说,当机器人在人类密集的环境中工作时,理解社交情境变得至关重要。这不仅仅是识别人脸或检测动作那么简单,而是要理解一个动作背后的真实意图,判断何时应该主动互动,何时应该保持沉默。

机器人工程师Tingu通过一系列实际场景展示了Cosmos Reason模型的能力。在碰拳场景中,当人类向机器人伸出拳头时,模型不仅识别出这是一个碰拳的手势,还能判断这个手势是直接针对机器人的,而不是随机动作或对他人的示意。这个看似简单的互动,实际上涉及多层次的推理:识别动作类型、判断目标对象、预测互动持续时间,最后才是决策如何回应。

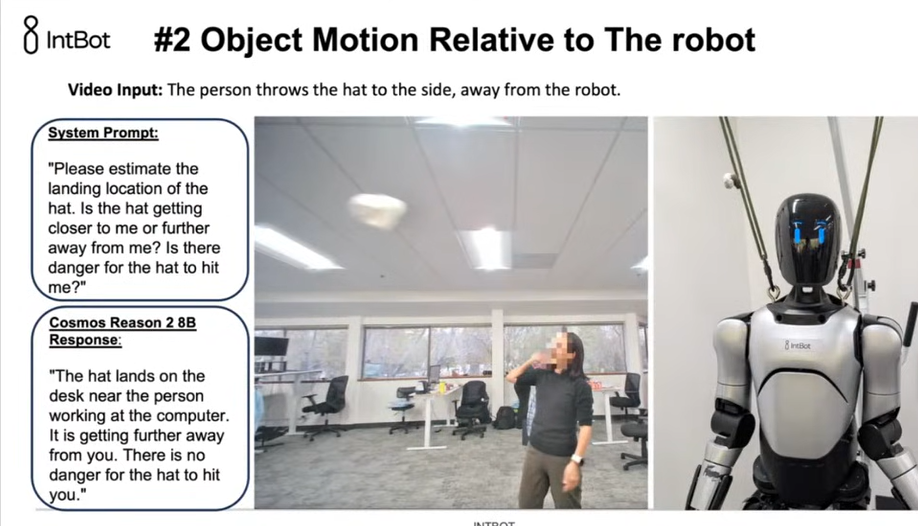

在物体运动风险评估方面,系统展现出了对物理规律的理解能力。同样是一顶帽子,当它被扔向远离机器人的方向时,系统判断不存在危险,机器人选择不做反应。但当帽子朝机器人飞来时,系统立即识别出潜在的撞击风险,机器人随即做出闪避动作。这种对物理运动的理解和风险预判能力,对于确保人机交互的安全性至关重要。

空间推理能力在多人场景中尤为重要。当周围站着多个人时,Cosmos Reason能够估算每个人的相对位置和距离,识别出谁离机器人最近,从而帮助机器人做出注意力分配的决策。

更重要的是,模型还能理解社交情境的边界。当两个人在机器人感知范围内握手时,系统能够判断这是他们之间的互动,机器人不应该介入。Sharon强调,真正的社交智能不在于做更多的事情,而在于知道什么时候不该行动。

从原始数据到深度理解

Nvidia的技术营销工程师Sammy介绍了视觉搜索与摘要系统(VSSS),这是一个将视觉语言模型、计算机视觉和大语言模型结合起来的开源参考架构。这个系统能够从输入数据中提取关键信息,并将这些信息存储在数据库中,然后利用大语言模型生成摘要、设置警报或回答相关问题。

在仓库监控场景中,系统需要检测多个异常事件:工人把箱子掉在地上就走了,稍后有人来捡起;设立了限制区域,但有未经授权的人员进入。VSSS通过三层提示词工作:第一层指导视觉语言模型关注什么样的事件,第二层和第三层则告诉大语言模型如何将这些离散的观察组合成连贯的摘要。

这个系统的可扩展性令人印象深刻。系统采用了分块处理的策略,将长时间的内容切分成10到20秒的小片段,每个片段独立处理,然后由大语言模型将所有信息重新整合。这种设计使得系统在单个H100 GPU上就能处理约15路实时流,而在8个H100上则可以支持多达145路直播流。

对于需要监控多个摄像头的仓库、工厂或公共场所来说,这种能力具有巨大的实用价值。系统支持RTSP协议输入,可以提供连续或定期的摘要,用户可以自定义摘要的生成频率。

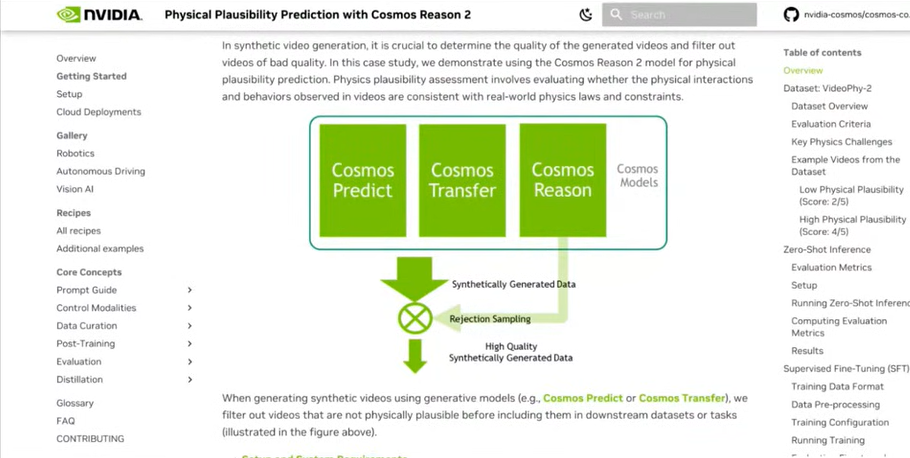

物理合理性:过滤AI生成内容的质量关卡

Nvidia的研究员Shun探讨了一个在AI生成内容领域日益重要的问题:如何判断生成的内容是否符合物理规律?虽然现代视觉基础模型能够生成逼真的场景,但仔细观察就会发现,有些内容存在明显的物理错误,比如杯子在没有外力作用下自行变形。

传统做法是让人工标注员逐一检查AI生成的内容,但这种方法难以应对AI的高产出速度。Shun提出的解决方案是使用Cosmos Reason模型作为自动评估工具,对生成的内容进行物理合理性评分,从而过滤掉不符合物理规律的部分。

这个工作流程形成了一个良性循环:AI模型生成合成数据,另一个AI模型评估质量,最终收集到的都是高质量、物理上合理的训练数据。研究团队使用了包含约3000个样本的开源数据集,每个样本都有1到5分的物理合理性评分。

即使在没有微调的情况下,Cosmos Reason 2在准确性和相关性两个指标上都超越了早期版本和论文中的基准模型。通过监督式微调,模型的表现进一步提升,而且Cosmos Reason 2在训练过程中表现出更好的稳定性,能够在更早的训练阶段达到更高的分数。

值得注意的是,研究团队发现微调后的Cosmos Reason模型性能超过了原始论文中发布的专门模型。这表明,Cosmos Reason作为一个通用的推理模型,在经过特定任务的微调后,能够在该任务上达到甚至超越专门设计的模型的水平。

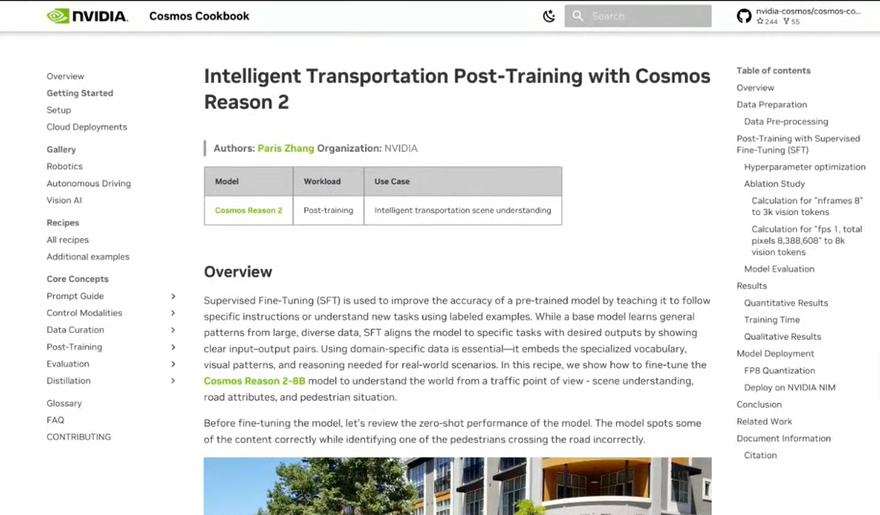

智能交通:从通用模型到领域专家

来自Nvidia的应用研究工程师Paris展示了如何将Cosmos Reason 2针对智能交通理解任务进行微调。他选择了一个由丰田旗下Woven公司提供的真实世界行人中心交通数据集,该数据集包含255个交通场景,配有丰富的标注信息。

Paris发现,基础的Cosmos Reason 2模型在描述场景时已经相当准确,能够正确识别行人的空间位置和外观特征,但在计数准确性上存在不足。通过端到端的微调流程,从数据准备、训练、评估到最终的量化和部署,模型的性能得到了显著提升。

仅仅经过一个训练周期,准确率就从54%跃升到92%以上,经过三个周期后达到93%。这个提升幅度充分说明了针对性微调的价值。

特别有意思的是关于视觉token配置的发现。研究团队对比了两种策略:一种是采样较少的帧但保持更高的分辨率(约3000个视觉token),另一种是采样更多的帧但降低每帧的分辨率(约8000个视觉token)。

结果显示,对于这个特定任务,高分辨率策略的效果更好,即使使用的视觉token总量更少。这个发现打破了"越多越好"的简单假设,说明最优配置需要根据具体任务的特点来确定。此外,使用较少的视觉token还意味着训练时间更短,在8个A100 GPU上完成三轮训练只需要略超过一小时。

更令人惊喜的是模型的泛化能力。尽管训练数据全部是多项选择题格式,但微调后的模型在面对未见过的场景和开放式问题时,同样能够给出准确的回答。这说明模型学到的不仅仅是如何做选择题,而是真正提升了对交通场景的理解能力。

Paris还提供了将训练好的模型部署到Nvidia NIM服务或VSSS系统的详细指南,使得这个微调后的模型可以立即应用于实时场景理解任务。

从配方到实践:可重用的构建模块

贯穿整个技术分享的主线是Cosmos Cookbook的理念:提供可重用的构建模块,而不是一次性的解决方案。每个展示的案例都定义了一个明确的问题,提供了可重复的工作流程,并给出了清晰的扩展点。

开发者可以根据自己的需求调整参数、替换数据集或修改推理逻辑,而不需要从零开始。这种模块化的方法在正在进行的Cosmos Cookoff竞赛中得到了充分体现。

从Inbot的社交推理到VSSS的场景分析,从物理合理性验证到智能交通理解,这些应用场景虽然各不相同,但都建立在相同的技术基础上:视觉语言模型的推理能力。Cosmos平台将这种能力标准化、模块化,使得开发者可以专注于解决自己领域的具体问题。

在问答环节中,观众们提出了各种实际问题,从如何处理低质量输入到如何确保AI准确捕捉细节。专家们的回答反复强调了一个核心思想:没有完美的通用解决方案,但通过针对性的微调和提示词优化,模型可以在特定任务上达到令人满意的性能。

这种务实的态度,正是将实验室技术转化为实际应用的关键。随着物理AI技术的不断发展,我们正在见证一个新时代的到来。机器人不再是冰冷的机械装置,而是能够理解社交情境、评估物理风险、分析复杂场景的智能系统。

而Cosmos Reason和相关工具的出现,正在让这个愿景变得触手可及。从世界生成到世界推理,从边缘场景模拟到机器人策略训练,每一个环节都在为构建真正智能的自主系统添砖加瓦。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录