万亿参数模型到底多烧钱?国产AI芯片能不能跑?算力国产替代的大棋局

万亿参数模型到底多烧钱?国产AI芯片能不能跑?算力国产替代的大棋局

老周聊架构

发布于 2026-05-08 18:40:42

发布于 2026-05-08 18:40:42

这个问题,过去两年里被问过无数次。答案众说纷纭,从"几百万美元"到"几十亿美元"都有人信。

但过去一周,几件事把这个问题的答案推到了台面上。

4月24日,DeepSeek V4 和美团 LongCat-2.0 同日发布,总参数量均突破万亿。

同一天,8家国产AI芯片品牌宣布适配 DeepSeek V4,华为昇腾首次被写入官方硬件验证清单,和英伟达 GPU 并列。

美团 LongCat-2.0 更是全程用国产算力集群完成训练,动用 5-6万张算力卡,创下国产算力训练万亿参数模型的最大规模纪录。

这不再是一个"能不能跑"的问题,而是一个"跑得怎么样、要花多少钱"的问题。

今天拆开算这笔账。

一、训练万亿参数模型的成本:一笔让人倒吸一口凉气的账

先从最硬的数字开始。

硬件采购成本

目前训练万亿参数模型的主力 GPU 是英伟达 H100。单张市场价约 3万美元(约合人民币 21.7 万)。

万卡集群的硬件投入:1万张 × 3万 = 3亿美元(约 21.7 亿人民币)。

但这只是 GPU 的钱。加上服务器、网络(InfiniBand)、存储、电力基础设施,万卡集群的总资本支出通常在 5-10亿美元 量级。

训练万亿参数模型,通常需要 1-2万张 H100,跑 2-4个月。硬件采购成本在 5-20亿美元 之间。

这不是小公司玩得起的游戏。

GPU 租赁成本

不想自己买?租也行,但价格在涨。

2026年3月,H100 一年期租赁价格已涨到 每卡每小时 2.35美元,半年涨幅接近 40%。H200 更贵,约 3.50 美元/小时。最新的 Blackwell B200 在 4.90-6.50 美元/小时。

按1万张 H100 跑3个月计算:10,000 × 2.35 × (90 × 24) = 5,076万美元(约 3.68 亿人民币)。

注意,这只是一次训练的租赁成本。大模型的训练往往要经历多次实验、调参、失败重跑。实际算力消耗通常是理论值的 2-5倍。

电力成本

别小看电费。

单张 H100 满载功耗约 700W。1万张 GPU 同时跑:10,000 × 0.7kW = 7,000kW = 7兆瓦。

按工业电价 0.6 元/度算,每小时电费约 4,200 元,每天 10万元,3个月就是 900万元。

加上数据中心散热、网络设备,电力总成本通常要翻倍。一年运维电费超过 1000万美元,对于万卡集群来说是正常水平。

谷歌 DeepMind 内部讨论算力时,据说已经不再用 PFLOPS 做单位,而是直接用 GW(吉瓦)。

人力成本

算法团队、工程团队、数据团队、运维团队——一个能训练万亿参数模型的团队,规模通常在 100-300人。

按国内一线 AI 人才薪资中位数(年薪 80-150 万),年人力成本 1-4.5 亿人民币。

总账

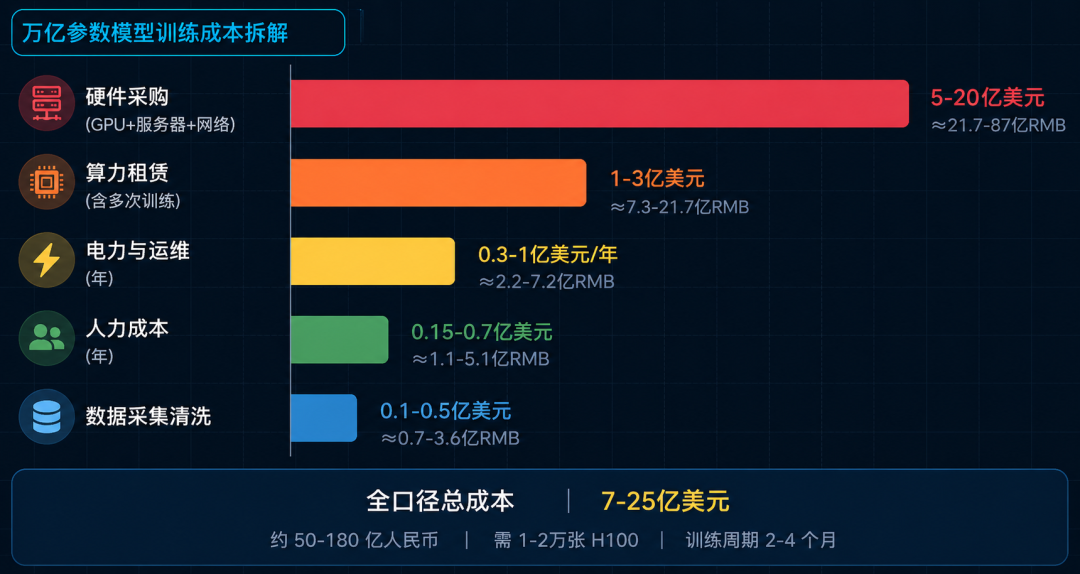

把所有成本加在一起,训练一个万亿参数模型的完整成本大致如下:

- 硬件采购(如自建):5-20 亿美元

- 算力租赁(如上云):1-3 亿美元(含多次训练)

- 电力与运维:0.3-1 亿美元/年

- 人力成本:0.15-0.7 亿美元/年

- 数据采集与清洗:0.1-0.5 亿美元

总计:7-25 亿美元,约合 50-180 亿人民币。

这还只是训练一个模型的成本。如果要持续迭代(V2、V2.5、V3...),每年都要持续投入。

所以你能理解为什么 DeepSeek 论文里写的训练成本只有 557 万美元——那只是最终的算力账单,不含硬件采购、不含人力、不含失败的实验。

如果只算"最后一次成功训练的 GPU 租赁费",DeepSeek 的成本确实惊人。但如果算全口径,没有人能低于 几亿美元。

二、国产芯片能不能跑:从"能跑"到"跑得好"

过去两年,国产AI芯片最大的争议就是:到底能不能跑大模型?

答案在4月24日这天,基本尘埃落定了。

8家国产芯片适配 DeepSeek V4

DeepSeek V4 发布当天,华为昇腾、寒武纪、海光信息、摩尔线程、沐曦股份、昆仑芯、平头哥真武、天数智芯 8家国产AI芯片品牌全部宣布完成适配。

其中两个信号尤其重要:

第一,华为昇腾被写入官方硬件验证清单,和英伟达 GPU 并列。

这是第一次有国产芯片被顶级开源模型在同等地位上承认。昇腾 910B 在推理场景中,与英伟达 H800(中国可获得的版本)的性能差距已缩小到 30% 以内。

下半年即将上市的 昇腾950 超节点,预计将把差距进一步缩小到 15% 以内。

第二,寒武纪连续两次完成 Day 0 适配。

Day 0 适配意味着什么?意味着新模型发布当天就能跑。这不是"能跑"的级别,而是"工程就绪"的级别。

寒武纪今年一季度营收 7.38亿元,同比增长 155%,同比扭亏为盈。资本市场用脚投票:4月27日股价一度大涨超 11%,市值接近 4800亿元。

美团5万卡国产算力:里程碑事件

如果说芯片适配是"软件就绪",那美团 LongCat-2.0 就是"实战验证"。

美团这次训练动用了 5-6万张国产算力卡,全程训练和推理都跑在国产算力集群上。这是迄今为止在国产算力上完成的规模最大的万亿参数模型训练任务。

一个外卖公司,干了中国AI基础设施最有标志性的一件事。

这说明什么?说明国产算力集群在 万卡级规模 下的工程稳定性、通信效率、容错能力已经过了实战检验。

不是实验室里跑个 demo,而是正经跑完了一个万亿参数模型的完整训练流程。

摩尔线程万卡集群交付

摩尔线程2026年一季度营收 7.38亿元,同比增长 155%,同比扭亏为盈。全新一代"平湖"芯片架构的 MTT S5000 单卡 AI 算力最高达 1000 TFLOPS,已实现大规模商业化落地。

3月签订了 6.6亿元 的夸娥(KUAE)万卡智算集群大单,成功攻克万卡级硬件系统优化、高速互联与系统级容错等工程壁垒。

三、但差距还有多大?说句实话

好消息说完,也得说说现实。

训练场景:差距在缩小,但还没追平

在训练效率上,国产算力头部选手(昇腾 910B/950)和英伟达 H800 的差距大约在 30%。这意味着跑同样的模型,国产算力大约需要多 30% 的时间和卡数。

如果英伟达用 1万张 H100 跑3个月,国产算力大约需要 1.3万张卡跑3.9个月。

不致命,但成本差距是实实在在的。

推理场景:差距更小

推理是国产算力的优势战场。MoE 模型天然适合稀疏激活,对单卡算力的要求比训练低。DeepSeek V4 在国产芯片上的推理性能已经非常接近英伟达平台。

生态差距:这才是真正的护城河

英伟达真正的护城河不是芯片本身,而是 CUDA 生态。十几年积累的算子库、工具链、优化框架,让开发者用英伟达几乎不需要额外适配。

国产芯片要在"能跑"的基础上做到"好用",软件生态的补齐至少还需要 2-3年。

但现在有一个趋势在加速这个过程:大模型公司主动适配国产芯片。

DeepSeek 把昇腾写入官方清单,小米 MiMo-V2.5 开源首日适配5家国产芯片——这不是政府在推,是企业在用。企业级需求一旦起来,生态迭代的速度会比纯政府项目快得多。

四、算力国产替代的大棋局

把上面这些信息串起来,能看到一幅更完整的图景。

第一层:技术验证已经完成

2024年,国产芯片还在"能不能跑"的阶段。2025年,头部芯片跑通了千卡训练。2026年4月,5万卡国产算力完成万亿参数模型训练。

从千卡到万卡到5万卡,每一步都是数量级的跨越。这个速度超出绝大多数人的预期。

第二层:产业链正在闭环

芯片设计(华为昇腾、寒武纪、摩尔线程)→ 制造(中芯国际)→ 封测(华虹)→ 服务器(宁畅、长江计算)→ 云服务(华为云、腾讯云、天翼云)→ 大模型(DeepSeek、MiMo、LongCat)→ 应用(Agent、代码、办公)

这条链路,每一步都有国产方案,每一步都在跑通。

第三层:成本优势在倒逼替代

H100 租赁价格半年涨 40%,交付周期延长到 2027年。英伟达 GPU 的高端产品(H200、B200)对中国市场供应受限。

与此同时,国产芯片的成本通常比同级别英伟达产品低 40-65%。

当"贵 30% 但买不到"和"便宜 50% 而且有货"摆在一起,企业的选择不难做。

第四层:这是一个国家级战略投入

中国AI芯片市场规模预计从2024年的 1425亿元 增长到2029年的 1.3万亿元,年复合增速 54%。

这不是几个创业公司的事,是整个产业链在押注。

五、老周的判断

回到开头的问题:万亿参数模型的训练成本到底有多高?国产芯片能不能跑?

成本方面:全口径7-25亿美元,约50-180亿人民币。 这不是互联网创业的烧钱级别,而是重资产基础设施的投资级别。只有国家战略级企业和大厂玩得起。

国产芯片方面:能跑,而且跑得越来越快。 5万卡国产算力训练万亿参数模型已成现实,8家国产芯片适配 DeepSeek V4 只是开始。差距从"能不能"变成了"快不快",而"快不快"的差距正在以每年 30%+ 的速度缩小。

真正的拐点可能在2027年。 届时昇腾950大规模商用,摩尔线程 S5000 万卡集群铺开,寒武纪的新一代架构落地。如果这一轮迭代顺利,国产训练算力和英伟达的差距有望缩小到 15-20%。

在推理场景,这个差距可能更小。

大模型的故事,从来不只是算法的故事。算力是底座,数据是燃料,算法是引擎——三个缺一不可。

过去三年,中国在大模型算法上追得很快。现在,算力这块最短的板,正在被一块一块地补上。

这背后不是某一家公司的胜利,而是一整条产业链的觉醒。

— 完 —

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-29,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录