DeepSeek V4是什么?能做什么?

DeepSeek V4是什么?能做什么?

烟雨平生

发布于 2026-04-28 20:19:10

发布于 2026-04-28 20:19:10

百万字上下文,帮你看完整个项目代码;Agent能力强到能独立跑完整流程;推理性能比肩顶级闭源模型。

DeepSeek V4不只是聊天机器人,它是能真正干活的AI助手。

一、DeepSeek V4是什么?

2026年4月24日,DeepSeek发布V4预览版,两个版本:

- V4-Pro:完整版,Agent能力强,推理性能顶级

- V4-Flash:轻量版,速度快,成本低

核心能力:

- 百万字上下文:一次能读1M Token的文本(约75万汉字)

- Agent能力:能理解复杂任务,自主拆解执行

- 推理性能:数学、代码、STEM领域比肩GPT-4

适用场景: 代码编写、文档分析、数据分析、长文本处理

二、它能帮你把哪些事做得更好?

▪ 2.1 代码编写:从写函数到写项目

之前:

- 写一个小功能,要查文档、试错、改bug

- 遇到复杂逻辑,要反复调试

现在:

# 提示词示例 "用Python写一个批量处理Excel文件的脚本,要求: 1. 读取指定目录下所有xlsx文件 2. 合并到一个新文件 3. 添加一列显示文件来源 4. 保存为result.xlsx"

效果:

- 一次生成可运行的代码

- 自动处理异常情况

- 代码质量接近中级工程师水平

真实案例: 某开发团队用DeepSeek V4写代码,从"半天一个功能"到"1小时一个功能",效率提升4倍。

▪ 2.2 文档分析:从翻阅到秒懂

之前:

- 看一个技术文档,要花1-2小时

- 找关键信息,要反复翻页

现在:

- 直接把整个文档(PDF/Markdown/Word)丢给V4

- 问它:"这个文档讲了什么?核心观点有哪些?"

- 30秒给你结构化摘要

支持格式:

- PDF(最多1M字)

- Markdown

- Word

- 网页内容

真实案例: 某公司用V4分析竞品文档,从"3天读完10份文档"到"30分钟拿到对比分析"。

▪ 2.3 数据分析:从Excel到洞察

之前:

- 用Excel做数据分析,要写公式、做透视表

- 找数据规律,要反复试错

现在:

"帮我分析这个销售数据: 1. 找出Top 5畅销产品 2. 分析月度趋势 3. 找出异常值 4. 给出优化建议"

效果:

- 自动生成分析报告

- 给出可视化建议

- 指出数据异常点

真实案例: 某电商用V4分析销售数据,发现了之前没注意到的"周末销量异常"问题。

▪ 2.4 长文本处理:从分段到整体

之前:

- 处理长文本,要分段、分批

- 容易丢失上下文

现在:

- 一次处理1M Token的文本

- 保持全局理解

- 准确提取关键信息

应用场景:

- 完整项目代码分析

- 长篇报告总结

- 多文档对比

真实案例: 某团队用V4分析50万行的项目代码,找出了3个潜在bug和5个优化点。

▪ 2.5 Agent任务:从对话到执行

之前:

- AI只能回答问题

- 复杂任务要人手拆解

现在:

- V4能理解复杂任务

- 自主拆解成子任务

- 一步步执行完成

示例:

"帮我做这个项目: 1. 调研竞品 2. 写需求文档 3. 设计数据库 4. 写核心代码 5. 写测试用例"

效果:

- V4会自主规划步骤

- 每步完成后汇报

- 最终交付完整方案

真实案例: 某公司用V4做自动化的代码审查流程,从"人工2小时"到"V4 15分钟"。

三、怎么用?

▪ 3.1 网页版

访问 https://chat.deepseek.com,注册即可使用。

▪ 3.2 API调用

from openai import OpenAI client = OpenAI( api_key="your-api-key", base_url="https://api.deepseek.com" ) response = client.chat.completions.create( model="deepseek-v4-pro", # 或 deepseek-v4-flash messages=[ {"role": "user", "content": "帮我写一个Python脚本..."} ] ) print(response.choices[0].message.content)

▪ 3.3 本地部署

- 下载模型:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro

- 推荐配置:GPU 24GB+(Pro版)、GPU 8GB+(Flash版)

- 开源协议:Apache 2.0

四、V4-Pro vs V4-Flash 怎么选?

维度 | V4-Pro | V4-Flash |

|---|---|---|

上下文长度 | 1M Token | 1M Token |

推理能力 | 顶级 | 接近Pro |

世界知识 | 丰富 | 稍逊 |

速度 | 中等 | 快 |

成本 | 较高 | 低 |

适用场景 | 复杂任务、高质量需求 | 简单任务、高频调用 |

选型建议:

- 写代码、做分析:用V4-Pro

- 简单对话、快速查询:用V4-Flash

- 预算有限:用V4-Flash

- 追求质量:用V4-Pro

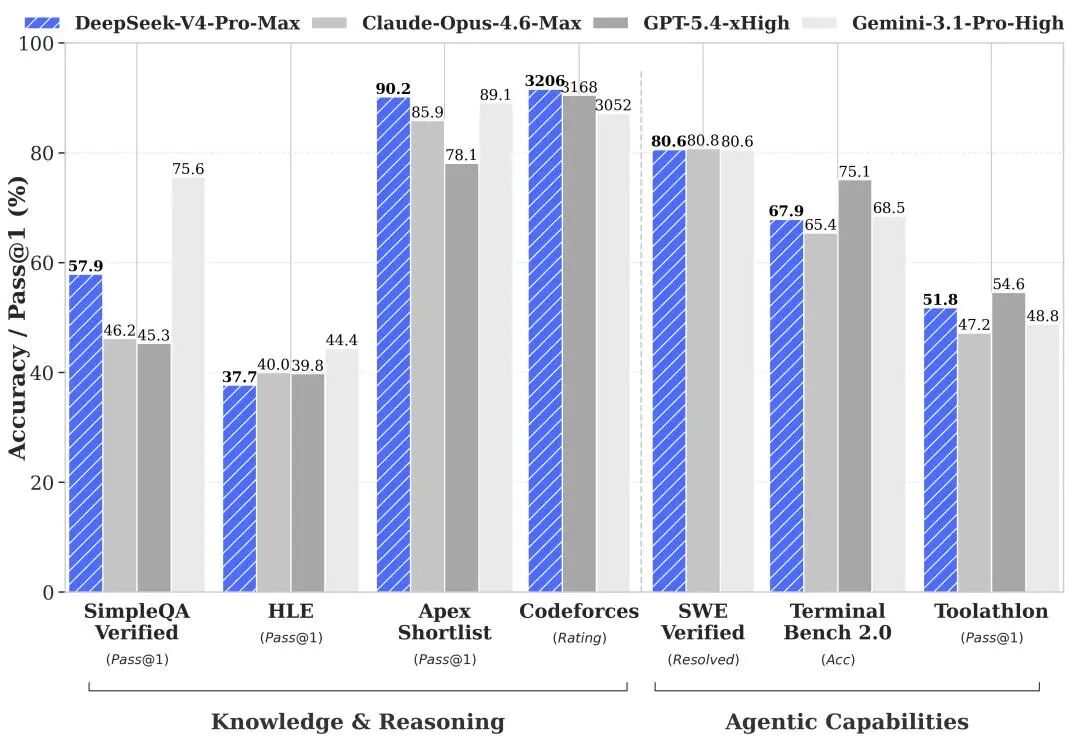

五、和其他模型比怎么样?

▪ 5.1 vs GPT-5.4

- 推理能力: V4-Pro接近GPT-5.4

- 上下文长度: V4(1M)> GPT-5.4(272K)

- 成本: V4更低

- 中文理解: V4更好

▪ 5.2 vs Claude 4

- 代码能力: V4-Pro接近Claude 4 Sonnet

- 长文本处理: V4(1M)> Claude(200K)

- 成本: V4更低

- 中文优化: V4更好

▪ 5.3 vs DeepSeek V3

- 上下文长度: V4(1M)>> V3(32K)

- Agent能力: V4显著提升

- 推理性能: V4更好

- 成本: V4-Pro略高,V4-Flash更低

六、注意事项

▪ 6.1 不是万能的

- 复杂逻辑仍需人工review

- 专业领域(法律、医疗)要谨慎

- 生成的代码要测试

▪ 6.2 思考模式

response = client.chat.completions.create( model="deepseek-v4-pro", messages=[ {"role": "user", "content": "帮我分析这个问题..."} ], extra_body={ "reasoning_effort": "high" # 开启思考模式,提高推理质量 } )

适用场景: 复杂推理、数学问题、代码调试

▪ 6.3 成本控制

- V4-Flash:成本低,适合高频调用

- V4-Pro:成本高,适合复杂任务

- 建议先用Flash试,再按需切换到Pro

七、总结

DeepSeek V4不只是"更会聊天"的AI,它是能真正干活的助手。

核心优势:

- ✅ 百万字上下文,处理长文本无压力

- ✅ Agent能力强,能执行复杂任务

- ✅ 推理性能顶级,比肩GPT-4

- ✅ 成本更低,性价比高

适用场景:

- 代码编写:效率提升4倍

- 文档分析:从小时到分钟

- 数据分析:自动生成洞察

- 长文本处理:一次性处理百万字

- Agent任务:自主执行完整流程

怎么开始?

1. 访问 https://chat.deepseek.com 注册

2. 试试简单的任务(写代码、总结文档)

3. 熟悉后尝试复杂任务(Agent流程)

4. 需要更高级功能,升级到Pro版

一句话带走: DeepSeek V4不是聊天机器人,是你的AI工作伙伴。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读