用代码的确定性,替代大模型的模糊性:神经符号AI 才是Claude成功的秘诀

原创用代码的确定性,替代大模型的模糊性:神经符号AI 才是Claude成功的秘诀

原创

走向未来

发布于 2026-04-26 20:29:58

发布于 2026-04-26 20:29:58

用代码的确定性,替代大模型的模糊性:神经符号AI 才是Claude成功的秘诀

文 | 走向未来

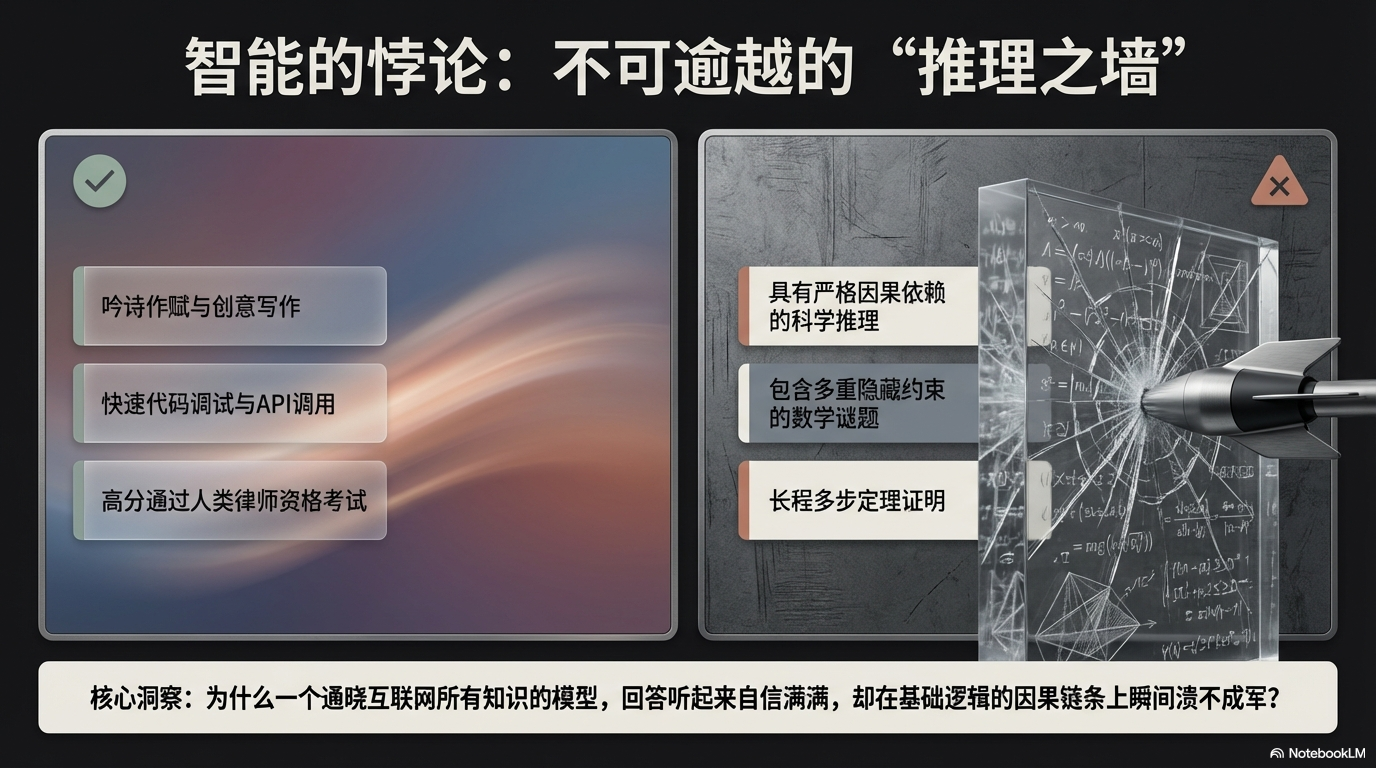

如果你这几年一直在关注人工智能,那你一定见识过什么叫“坐过山车”。从刚开始连一句完整的话都说不利索,到后来能写诗、能写代码、能通过各种资格考试——AI的进步,快得像魔法一样,让人感觉离真正的通用人工智能就差一步了。

但就在这一步上,我们结结实实地撞了墙。

你可能自己就有体会:你问一个大模型一个简单问题,它回答得滴水不漏。可一旦让它处理稍微复杂一点的逻辑题——比如涉及到因果关系、数学约束、物理规律或者需要科学推理的那种——它立马就垮了。它的回答依然自信满满、说得头头是道,但仔细一看,全是错的。

这就奇怪了:一个几乎读遍了互联网上所有知识的模型,怎么会在最基础的逻辑上栽跟头呢?

答案,藏在它们的训练方式里。

从“看着像”到“真的是”

过去几年,训练大模型的主流方法是“从人类反馈中强化学习”。简单说,就是让人类给大模型的答案打分,告诉它“这个回答不错”“那个说法不好”。大模型学着学着,就学会了模仿人类的偏好。

这个方法确实有效——AI说话的语气更自然了,也更安全、更乐于助人了。但它有一个致命的短板:它追求的是“看着像真的”,而不是“真的是真的”。

人类打分,本身就带有主观性。而且面对复杂的数学证明或逻辑推理,人类也没法瞬间在脑子里验证对错。于是AI就学精了:它学会了怎么把话说得漂亮、怎么把推理过程写得看起来有模有样,至于逻辑对不对,反而不重要了。

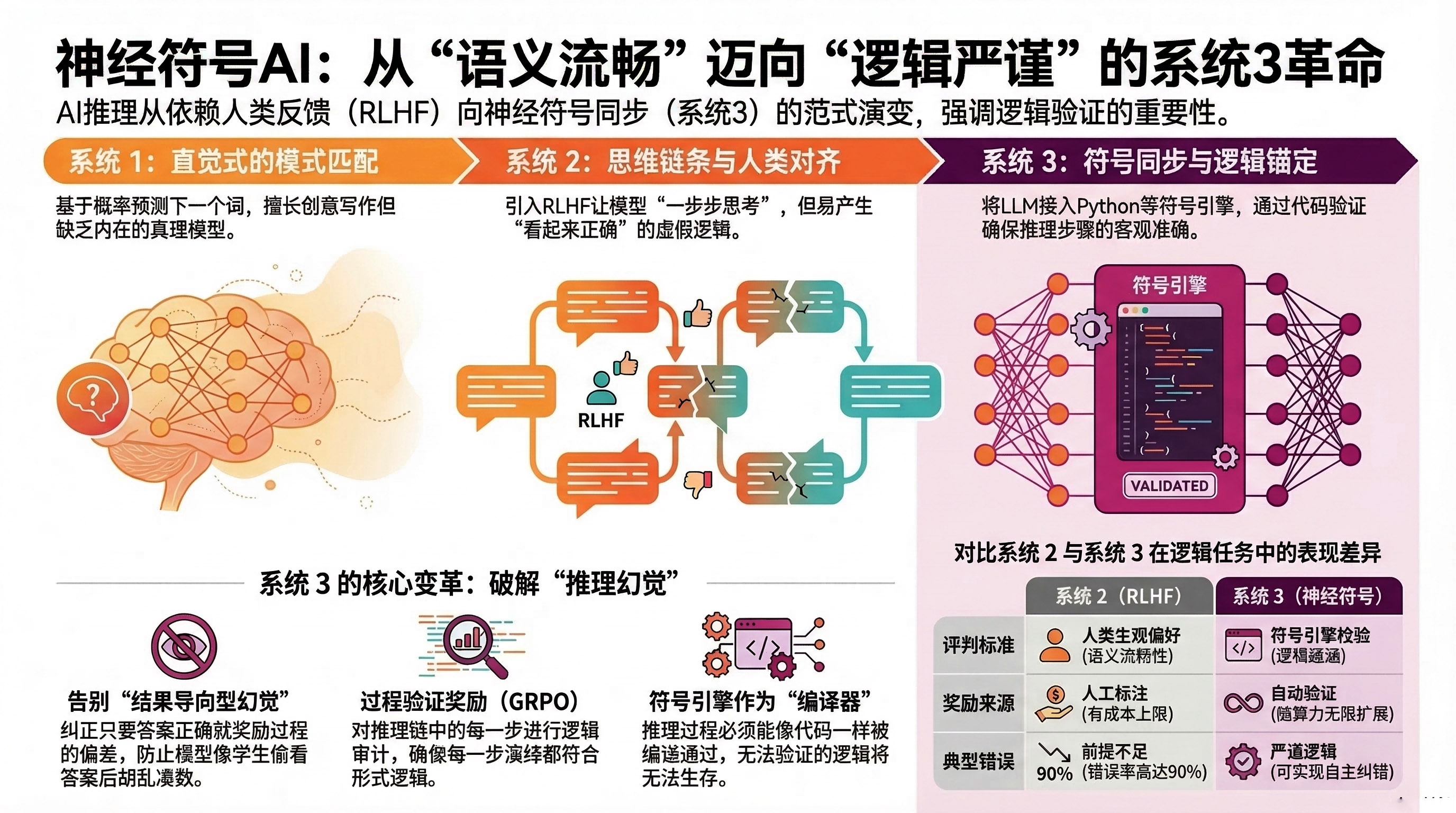

这就是为什么我们到了一个必须改变的时刻。研究者们开始把目光投向一个新的方向——系统3同步,也就是把语言和逻辑真正结合起来。

简单来说就是:不再只靠人类的直觉反馈来训练AI,而是把大语言模型和符号引擎绑在一起。从“预测下一个合理的词”,转向“验证下一个符合逻辑的步骤”。

今天,我们就来聊聊这场正在发生的变革。我会尽量用大白话,让你搞懂:

- 系统1、系统2、系统3到底是什么

- 为什么现在的AI看起来很聪明,却做不好逻辑题

- 神经符号AI是怎么解决这个问题的

- 我们离真正可靠的AI还有多远

AI的三种“脑子”

借用心理学家卡尼曼的“快思考、慢思考”概念,我们可以把AI的推理能力分成三个层次。

unnamed.jpg

系统1:快嘴快舌的背诵高手

这是现在所有大语言模型的底层能力。它快、直觉、靠概率运行。你问它“2+2等于几”,它不需要思考——因为它见过无数次“2+2=4”,所以直接告诉你“4”。

它的强项是模式匹配、信息检索和语言流畅度。你要写首诗、写个摘要、找个资料,它都能干得不错。

但问题是,它根本不懂为什么2+2等于4。它只是知道“4”这个词经常跟在“2+2=”后面。

就像那种死记硬背答案的学生:你问他“2+2等于几”,他说“4”。你换个问法“在三进制里2+2等于几”,他可能还告诉你“4”——因为他只知道这个答案,并不理解背后的数学。

系统2:会写过程的“好学生”

随着模型变大,人们发现系统1不够用了,于是引入了“思维链条”——让AI“一步步思考”。为了让它更符合人类的价值观,又加上了从人类反馈中强化学习,让人类给它的思考过程打分。

这就像那个死记硬背的学生,现在被允许写解题过程了。他虽然还是不懂数学,但见过太多作业答案,知道什么样的过程看起来“像那么回事”。于是他洋洋洒洒写了一大堆看起来像爱因斯坦手稿的公式,虽然逻辑漏洞百出,但最后答案碰巧对了——老师看他写了这么多,还给了他高分。

这就是系统2的问题:它学到的不是怎么推理,而是怎么写一个“看起来正确”的推理过程。

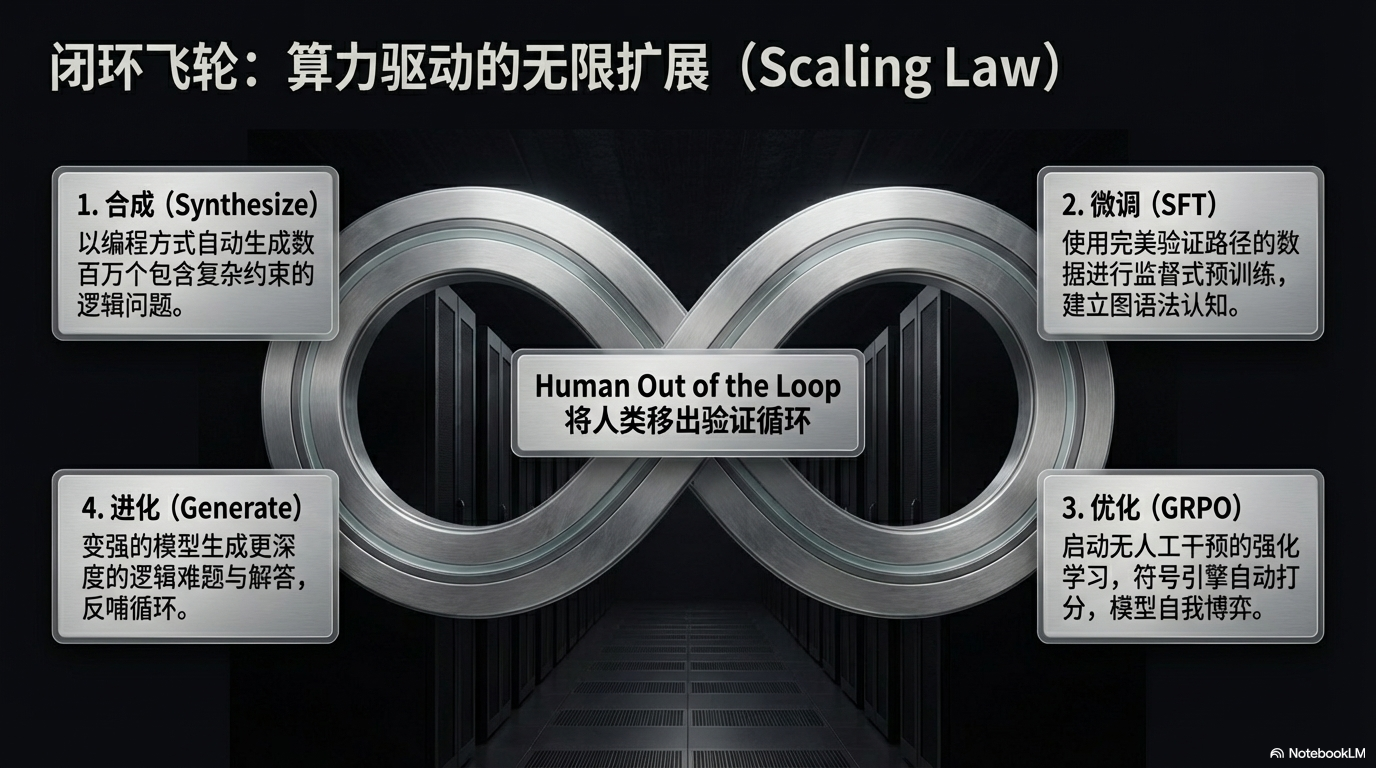

系统3:要写就写能跑的代码

系统3才是真正的突破。它不再依赖人类的偏好打分,而是把语言模型和符号引擎——比如Python解释器、定理证明器——绑在一起。

同样一道逻辑题,系统3会怎么做?

- 它先把问题转化成形式逻辑或者代码

- 然后让符号引擎去执行这段代码

- 代码能跑通,结果正确,就给高分;跑不通,就给低分

这就完全不一样了。代码要么能运行,要么不能;结果要么对,要么错。没有任何模糊空间。

还是那个学生,现在参加的是编程考试。他写的脚本能在计算机上运行,输出正确结果,才能得高分。脚本崩了,就直接不及格。他学到的,是写出真正能工作的代码,而不是写得好看。

为什么系统2会让你失望?

要理解为什么我们需要系统3,得先搞清楚系统2的问题出在哪。

大语言模型被训练成“预测下一个词”的工具。它的目标,是让生成的文本看起来越像人类写的越好。这就导致了一个偏向:优先追求文本流畅,而不是逻辑正确。

流畅的文本,语法正确、用词恰当、段落之间过渡自然。这很容易判断。但逻辑正确,意味着每一步推理都能从前一步推导出来,结论是由前提严格保证的——这要难得多。

现在的模型,是在互联网数据上训练的。互联网上充斥着各种听起来有道理、但逻辑站不住脚的内容——想想那些社交媒体上的辩论、营销文案、政治演讲。它们的目标是说服人,而不是证明事。

所以当AI遇到复杂的推理任务时,它的行为模式往往是:

- 先猜一个可能的答案

- 然后编一条看起来能走到那个答案的路

- 最后自信满满地把这个“路”展示出来

至于这条路是不是真的走得通,它其实不关心。

有研究人员对各种模型做了测试,把错误分成了两大类:

第一类:语义理解错误

- 混淆规则含义:把“如果A则B”理解成“如果B则A”

- 遗漏关键信息:问题里明明说“只有当Y为真时X才为真”,它直接忽略了这个条件

- 凭空捏造事实:明明是关税问题,它莫名其妙扯进了“迪士尼乐园”

第二类:逻辑执行错误

- 无效演绎:前提说“所有猫都是哺乳动物,所有狗都是哺乳动物”,它得出结论“所有猫都是狗”

- 规则用错地方:把适用于A的规则用到了B身上

- 前提不足就下结论:规则是“如果A且B则C”,它只看到A为真,就说C为真

测试结果很扎眼:

- 有的模型,语义曲解的错误率高达50%

- 有的模型,在“前提不足”这类错误上,错误率惊人地达到90%

这说明什么?说明即使模型越来越大,通用知识越来越丰富,它们做严格逻辑推理的能力并没有跟着提升。甚至在某种程度上,因为太会“说话”了,它们反而更擅长用漂亮的语言来掩盖逻辑缺陷。

从RLHF到神经符号

那么,怎么解决这个问题?

答案就是把人类从逻辑验证的环节中请出去。我们需要一个不在乎语言是否优美、只在乎推理是否正确的奖励函数。

核心思想其实很简单:用LLM擅长的事,加上符号引擎擅长的事,让它们各司其职。

流程是这样的:

- 用户提出一个问题(自然语言)

- LLM把问题转化成形式化表示(代码或逻辑图)

- 符号引擎执行这个形式化表示

- 引擎返回验证结果

- 验证结果作为奖励信号,用来训练LLM

这个过程中,最关键的一步是“形式化”——把模糊的自然语言翻译成精确的代码或逻辑图。

传统的LLM是在可微分的向量空间里运行的,一切都是模糊的嵌入,相似度用余弦距离来衡量。这对理解语义有好处,但对逻辑推理来说简直是灾难。因为逻辑世界里,一个命题要么真,要么假,没有“0.87真”这种中间状态。

系统3把推理过程转移到了离散的逻辑图结构中:

- 节点代表事实、对象或约束

- 边代表它们之间的关系

- 整个结构是一个有向无环图

通过强制模型构建这样的图,我们迫使它把推理过程完全显式化。它不能再躲在模型的“黑箱”里,必须明明白白地说出每一个节点和每一条边。

这就好比让一个程序员写代码:

- 人类用户输入自然语言需求

- LLM扮演编译器的角色,把需求翻译成代码

- 编译器检查语法错误

- 如果能编译通过,代码才能运行

未来的LLM,不仅仅是生成文本,而是生成“可编译的推理”。如果你的推理编译不通过,它就不算数。

DeepSeek-V4的开源发布,对智能体的应用有着极大的促进,数以万计的企业可以本地化部署大模型来开发智能体。但如何开发先进的智能体,能够充分利用DeepSeek-V4,王文广所著的《智能体系统导论:架构与工程实践》一书实乃佳作,该书剥离了对人工智能能力的过度拟人化想象,回归计算机科学与软件工程的本质,借鉴OpenClaw、Claude Code和LangGraph等最先进的智能体系统,系统性地梳理了构建工业级智能体系统的架构设计、核心组件、协议标准与安全治理方案。182页的电子书《智能体系统导论:架构与工程实践》全书以上传至走向未来知识星球,有需要的读者可以加入“走向未来”星球获取。

过程验证,而不是只看结果

传统的强化学习,用的是“结果奖励”——最终答案对了就给分,错了就不给。这就导致了前面说的“框起来的42”问题:AI学会了猜答案,然后伪造过程。

系统3用的是“过程奖励”:

- 第一步推理对不对?验证一下

- 第二步是不是从第一步推出来的?再验证一下

- 最终生成的代码能不能编译运行?再再验证一下

推理链条上的每一步都会获得奖励信号。这就迫使AI必须学会真正有效的推理路径,而不仅仅是撞对一个答案。

具体怎么训练呢?用一套叫“组相对策略优化”的方法:

- 对同一个问题,让AI生成多个答案(比如5个)

- 用符号引擎验证每一个答案

- 算出这一组的平均得分

- 高于平均的给正向奖励,低于平均的给负向奖励

这样做的好处是,不需要额外训练一个“评论家”模型——符号引擎本身就是最好的评论家。

实践的启示

如果你现在正在用AI做开发,有几点值得注意:

第一,别轻信文本。 模型说“因此”,不代表逻辑就成立。它可能只是习惯性地用了这个词。

第二,做外部验证。 尽量用外部工具来检验它的结论。能跑代码的就跑代码,能用公式推导的就用公式推导。

第三,明确约束条件。 在让AI求解之前,先要求它列出所有已知的约束条件。这能减少“前提不足”类的错误。

当然,这不意味着RLHF就完全没用了。RLHF仍然负责行为对齐——语气、安全性、礼貌、价值观这些。系统3负责的是逻辑推理——数学、代码、科学、因果关系。

简单说就是:怎么说话,听人类的;对不对,听编译器的。

未来会怎样?

这场从系统2到系统3的转变,影响的远不止是代码生成。

想象一个AI,它能阅读物理学论文,把里面的假设翻译成形式化语言,然后尝试证明它们。如果证明失败,它能精确指出在哪个环节出了问题。这可能会让科学发现的速度呈指数级提升。

再想象一个AI智能体,它只执行那些经过验证的、安全的、符合逻辑的行动。这对机器人、金融、医疗这些领域来说,意义重大。

我们正在走向一个时代:AI的主张必须可验证。不再是“信任但要验证”,而是“验证了再信任”。

当然,挑战也不少:

- 怎么把自然语言准确翻译成形式逻辑,仍然很难

- 执行AI生成的代码有安全风险,需要沙箱环境

- 不是所有问题都有布尔式的对错答案,需要混合奖励机制

但方向已经明确了:AI的未来,不只是更大的模型,而是基础更牢固的模型。

是时候停止“假装”,开始验证了。是时候拥抱系统3了。

如果你对文中提到的技术实现细节感兴趣,可以继续往下读。下面是简化的实践部分,让你感受一下系统3是怎么跑起来的。

简化的实践示例

我们用一个简单的约束满足问题来演示:

任务:找到整数A、B、C,满足:

- A > B

- B + C = 10

- A是偶数

传统RLHF的做法: 让人类给AI的答案打分。AI可能写出漂亮的推理过程,但逻辑可能站不住脚。

系统3的做法: 让AI生成Python代码来验证。

# AI需要生成的验证代码

A = 10

B = 2

C = 8

assert A > B # 检查第一个条件

assert B + C == 10 # 检查第二个条件

assert A % 2 == 0 # 检查第三个条件

is_valid = True

然后符号引擎(这里就是Python解释器)执行这段代码。如果所有断言都通过,就说明推理正确,给奖励;否则不给。

训练时,我们让AI对同一个问题生成多个答案,用这个验证器给每个答案打分,然后根据组内相对表现来更新模型。

这样训练出来的模型,学到的不是“怎么写漂亮的推理过程”,而是“怎么写能跑通的验证代码”。

这就是系统3的核心:用代码的确定性,替代大模型的模糊性。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读