如何把机器人控制问题转换成 RL 问题

为什么要用强化学习做机器人控制?

在传统机器人控制中,往往遵循这样一条路径:建模机器人动力学(刚体动力学、拉格朗日方程)设计控制器(PID、LQR、MPC、Whole-Body Control)以及依赖精确模型与人工调参。这种方法在结构清晰、任务明确的场景中非常有效,但当机器人具备以下特征时,问题会迅速复杂化:

- 高自由度(人形机器人、四足机器人)

- 强非线性、强耦合

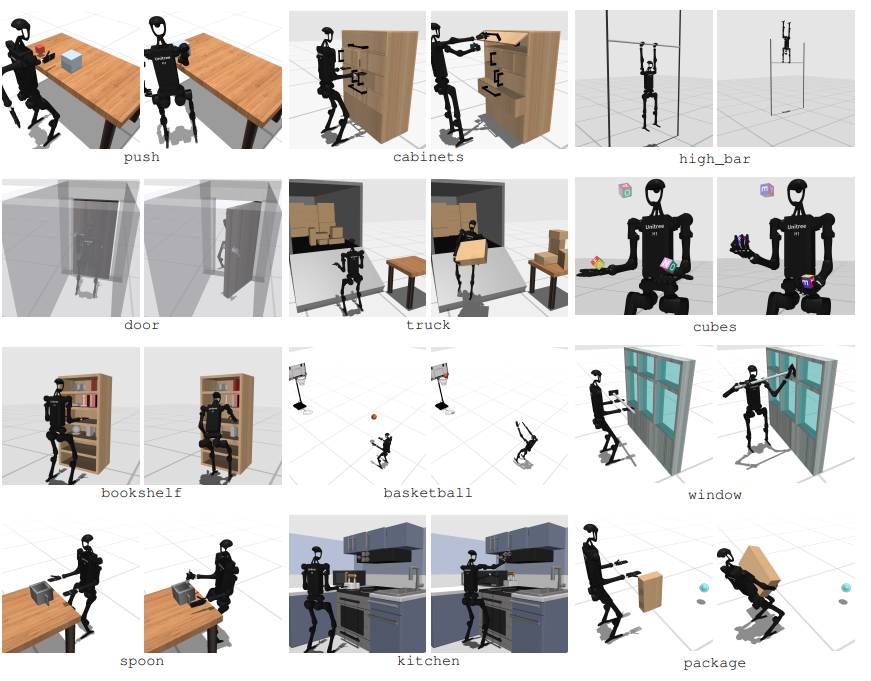

- 接触频繁(行走、跳跃、推拉)

- 环境不确定(地形、摩擦、扰动)

强化学习(Reinforcement Learning, RL)提供了一种绕开显式控制律设计的思路:不直接设计“怎么控制”,而是让机器人通过与环境交互,学会如何控制自己。

强化学习视角下的机器人控制问题

要把一个机器人控制问题转化为 RL 问题,核心在于:把控制过程建模为一个马尔可夫决策过程(MDP 或 POMDP)需要明确 5 个要素:( State, Observation, Action, Reward, Transition )

Step 1:定义状态(State)与观测(Observation)

- 在控制理论中,系统状态通常是:

- 关节角 q

- 关节速度 dq

- 机身位姿(位置 + 姿态)

- 机身速度

在仿真环境(如 Isaac Gym)中,这些状态是直接可得的真值(ground truth)。

- RL 中的 Observation(更接近真实机器人)我们无法直接获得完整状态,只能依赖传感器:

- 关节编码器 → 关节角 / 速度

- IMU → 角速度、线加速度、姿态估计

- 力/触觉传感器 → 接触信息

因此在 RL 中,通常使用的是 Observation(观测) 而不是完整 State。这使得机器人控制问题往往是 POMDP(部分可观测)。

- IMU 在 Observation 中的角色以人形机器人为例,IMU 提供:

- 角速度(gyro)→ 姿态变化趋势

- 加速度(acc)→ 重力方向、动态响应

- 姿态估计(融合后)→ roll / pitch / yaw

在 RL 训练中,IMU 对应的观测通常是:

- base angular velocity

- base linear acceleration

- gravity vector(在机体坐标系下)

在仿真中,这些量由物理引擎直接给出;在真实机器人中,它们来自 IMU + 状态估计算法。

Step 2:定义动作空间(Action)

动作不是“力”,而是“接口”。RL 中的 Action 并不一定直接是力或力矩,常见形式包括:

- 关节位置增量(Δq)

- 关节速度目标

- 关节力矩

- 高层控制指令(如步态参数)

在实际工程中,RL 通常输出的是“中间层动作”,再由底层控制器执行。例如:

RL Policy → 关节目标位置

→ PD 控制器

→ 电机电流 / 力矩这样可以显著提升系统稳定性。

什么不直接学 torque?

- 扭矩控制对模型误差极其敏感

- 仿真与现实差距大(Sim2Real 难)

- 调试成本高

因此,大多数人形机器人 RL 都选择:RL + 传统低层控制。

Step 3:设计奖励函数(Reward)

奖励函数是 RL 中最“艺术化”的部分。行走任务的典型奖励项,以人形机器人站立 / 行走为例:

- 姿态稳定(躯干不倒)

- 速度跟踪(接近期望速度)

- 能耗惩罚(减少大扭矩)

- 平滑性(避免抖动)

- 接触合理性(脚不乱滑)

可以写成:

reward = w1 * 姿态稳定

+ w2 * 速度跟踪

- w3 * 能耗

- w4 * 关节震荡IMU与Reward 的关系,IMU 并不直接参与 Reward,但它:

- 影响姿态估计

- 决定机器人是否“认为自己在倾倒”

- 间接影响策略输出

换句话说:IMU 决定 Observation 的质量,Reward 决定学习方向。

Step 4:环境与动力学(Transition)

在 RL 中:仿真引擎 = 状态转移函数,Isaac Gym / Mujoco / Bullet 负责物理计算这一步解决的是:

“当机器人执行某个动作后,下一时刻会发生什么?”

在仿真训练中,我们可以:

- 并行上千个环境

- 加入随机扰动(质量、摩擦、噪声)

- 提前为真实世界“打预防针”

这一步是 Sim2Real 成败的关键。

从仿真到真实机器人(Sim2Real)

在机器人研究中,仿真环境与真实世界操作之间存在显著差异,具体表现在以下几个方面:

- 仿真环境中,研究者可以直接获取并控制机器人的完整、精确的内部状态。而在真实机器人上,只能通过有限的传感器(如摄像头、激光雷达)进行间接观测,信息既不完整也可能存在延迟。

- 仿真环境通常设置为理想的无噪声条件,所有指令和反馈都精确无误。相比之下,真实机器人会受到各种物理干扰,特别是惯性测量单元存在信号漂移和通信延迟等问题。

- 仿真所使用的机器人模型是精确、已知的数学模型。然而,真实机器人的机械结构必然存在制造公差、装配误差以及使用中的磨损,导致其动力学特性与理想模型存在偏差。

- 最后,在仿真中可以无限次、零成本地重置实验条件或从失败中恢复。但操作真实机器人则必须考虑物理风险,一旦控制失败(如摔倒),很可能导致机器人硬件损坏,造成经济损失并中断实验。

总之,仿真提供了一个安全、高效、可控的开发与测试平台,但其理想化假设使得在仿真中成功的算法,在转移到真实机器人时,必须充分考虑上述现实世界的复杂性与不确定性。因此,在 RL 训练中通常会:

- 加 IMU 噪声

- 随机化质量 / 摩擦

- 随机初始姿态

为什么 IMU 是 Sim2Real 的核心?

- IMU 是 唯一直接反映整体运动状态的传感器

- 行走稳定性几乎完全依赖 IMU

- RL 策略对 IMU 分布高度敏感

这也是为什么在真实部署时,IMU 标定、滤波、时间同步的重要性,甚至不亚于算法本身。

总结

人形机器人的控制问题演变成(强化学习)RL 问题的核心转化逻辑是把“设计控制器”的问题,转化为“定义状态、动作和奖励”的问题。强化学习并不是取代控制理论,而是在传统控制之上,引入一种“自动发现控制策略”的能力。当 RL、IMU、状态估计与工程经验结合在一起,机器人才能真正从“能动”走向“好用”。

以上内容如有错误请留言评论,欢迎指正交流。如有侵权,请联系删除

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读