世界模拟器,AI 实时生成“无限沙盒”:一个能够学习预测世界的因果多模态系统#Odyssey

世界模拟器,AI 实时生成“无限沙盒”:一个能够学习预测世界的因果多模态系统#Odyssey

mixlab

发布于 2026-03-25 08:52:11

发布于 2026-03-25 08:52:11

导语:

如果说 Sora 让我们看见了“影像的奇迹”,那么 2025 年底,Odyssey 实验室则悄然掀开了“模拟现实世界”的底层协议:

一段可交互、可推演、会学习的 3D 合成现实,正在从模型中生长出来。

这不是Sora之类的预渲染的视频片段,而是一个能理解重力、记忆状态、实时响应你的手势与语言的动态世界。

🚀 场景:40 毫秒,世界在你眼前生成

戴上头显,或轻点鼠标——

街道、房间、森林,并非来自硬盘中预存的3D模型,而是由 AI 在40–50 毫秒内实时“推理”渲染出来。

你转动灯光旋钮,阴影自然流动;你推倒一个花瓶,碎片不会凭空消失,而是依循惯性飞溅、滚动、静止。

这不是脚本预设,是因果。

Odyssey-2 Pro 实现了20–30 FPS 的稳定输出,逼近人类感知的“实时”。 这意味着:世界不再被“构建”,而是被“预测”。

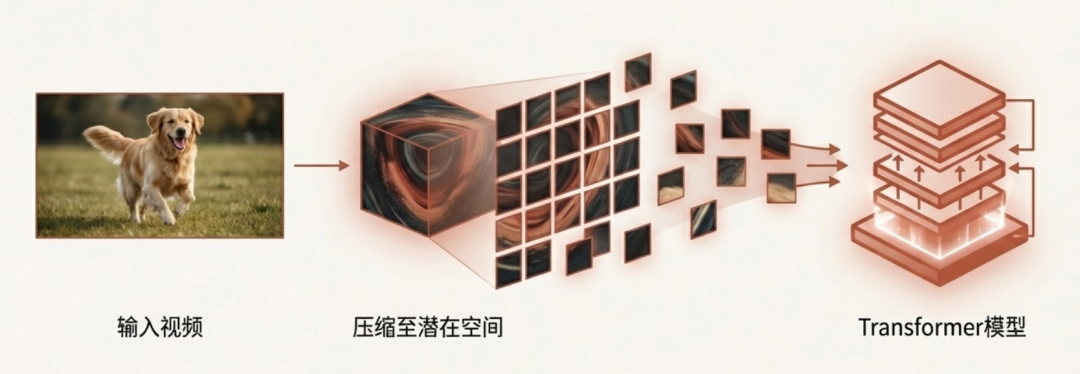

🧠 逻辑:预测下一帧,就是理解物理

长久以来,人们质疑:统计模型能“理解”现实吗?

Odyssey 给出的答案:只要预测足够准,理解自然涌现。

- 语言模型预测下一个词 → 被迫学会语法、逻辑、情绪。

- 世界模型预测下一帧 → 被迫学会重力、遮挡、材质、物体恒常性。

比如,要准确模拟“水龙头打开五分钟后”的厨房,模型必须在内部维持一个“水位正在上升”的隐藏状态。

这种对隐藏状态的追踪,就是智能的雏形。

不再依赖工程师手写碰撞公式或流体方程,Odyssey 从海量 360° 真实世界视频中,让模型“自学成才”:世界规律,从数据中涌现。

🛠 工作流革命:

从“建模”到“语义生长”

对创作者而言,Odyssey-2 Pro 正在破除“渲染管线”的边界。

1. 输入一张图,生成一个世界

借助Gaussian Splatting(高斯泼溅),单张图像可被扩展为可漫游、可交互的 3D 场景。无需 UV 展开,无需手动打光。

2. AI 成为“世界协作者”

生成的场景可直接导入 Blender、Maya 进一步编辑。AI 不再是替代者,而是那个能在 10 秒内为你搭好“虚拟场景”的超级助手。

3.自然语言即控制协议

“把沙发移到窗边,阳光调成下午四点的暖色”—— 世界立刻响应。

模拟器不再是参数面板,而是一个能听、能看、能推理的空间智能体。

📱 未来已来:

游戏、教育,全被重写

传统 3A 游戏动辄百 GB,因为每个角落都靠3D建模堆砌。

在“世界模拟器”时代,内容将变成流式现实Streaming Reality:按需生成,无限延展。

- 游戏无边界:你往森林深处走,AI 实时生成新的地貌、植被、天气。每一次探索都是首次生成。

- 沉浸式技能教学:想学修水管?模拟器生成你家真实的厨房,手把手教你操作,并模拟“拧太紧导致爆裂”的后果。

⚠️ 当前限制

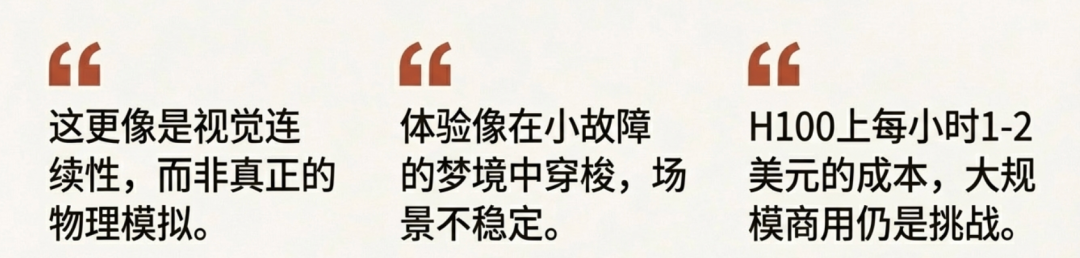

- 动态畸变:高速移动时,场景偶现“梦境般的断裂感”—— 像一场尚未校准的幻觉。

- 算力门槛:目前需 H100 集群支撑实时推理,成本远高于本地引擎。

当上下文长度突破时空尺度,当推理成本下降两个数量级 ——

我们或许将不再问“这是真的吗?”,而是尽情享受…

结语

类比ChatGPT,我们正处在 GPT-2 时期的世界模型。

世界模拟器不是对现实的复刻,而是对可能性的预测。

在这里,现实世界的语法被AI学习。

互动话题

如果 AI 能为你实时生成一个可交互的虚拟世界,你最想在其中做什么?

是搭建一座会呼吸的城市?

还是训练一个懂你眼神的数字伙伴?

欢迎在评论区,种下你的“世界种子” 🌱

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录