Attention Residuals: 革新 LLM 残差连接的注意力机制

Attention Residuals: 革新 LLM 残差连接的注意力机制

安全风信子

发布于 2026-03-25 08:09:00

发布于 2026-03-25 08:09:00

作者: HOS(安全风信子) 日期: 2026-03-21 主要来源平台: HuggingFace 摘要: Attention Residuals (AttnRes) 提出了一种全新的残差连接方法,通过使用注意力机制替代固定权重的累加,解决了传统 PreNorm 残差连接中隐藏状态无控制增长和层贡献稀释的问题。本文深入分析其核心机制、技术实现和实验结果,探讨其在 LLM 架构中的应用价值和未来发展方向。

目录:

- 1. 背景动机与当前热点

- 2. 核心更新亮点与全新要素

- 3. 技术深度拆解与实现分析

- 4. 与主流方案深度对比

- 5. 工程实践意义、风险、局限性与缓解策略

- 6. 未来趋势与前瞻预测

1. 背景动机与当前热点

本节核心价值:理解 Attention Residuals 诞生的背景和解决的核心问题,把握当前 LLM 架构设计的关键挑战。

在现代大型语言模型(LLM)中,PreNorm 与残差连接的组合已成为标准架构。然而,传统的残差连接使用固定的单位权重来累加所有层的输出,这种均匀聚合会导致以下问题:

- 隐藏状态无控制增长:随着模型深度的增加,隐藏状态的范数会不断增大,可能导致训练不稳定。

- 层贡献稀释:每一层的贡献被均匀对待,导致深层的贡献被逐渐稀释,影响模型的表达能力。

- 内存和通信开销:对于大规模模型训练,处理所有前层的输出会带来巨大的内存和通信开销。

这些问题在深度越来越大的现代 LLM 中变得尤为突出,限制了模型的性能和可扩展性。Attention Residuals 的出现正是为了解决这些核心问题,通过引入注意力机制来优化残差连接的信息流动。

2. 核心更新亮点与全新要素

本节核心价值:深入了解 Attention Residuals 的三大核心创新点,及其如何解决传统残差连接的问题。

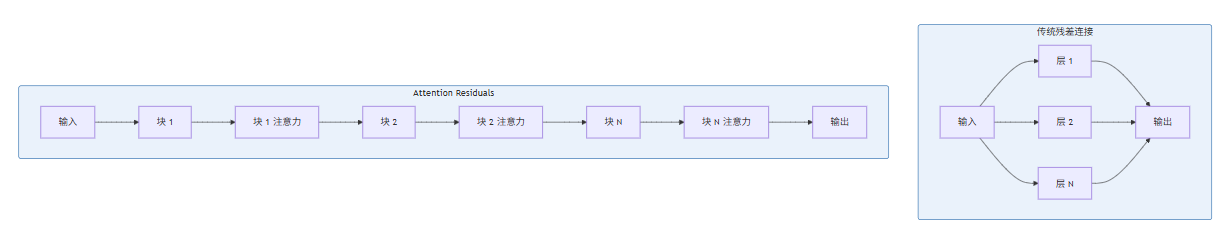

Attention Residuals 引入了三个关键的全新要素,使其在 LLM 架构设计领域脱颖而出:

- 注意力驱动的残差聚合:用 softmax 注意力替代固定权重的累加,允许每一层根据输入内容选择性地聚合之前层的表示,实现内容依赖的深度选择。

- Block AttnRes 机制:为了解决大规模模型训练中的内存和通信开销问题,将层划分为块,在块级别上进行注意力聚合,在保留大部分收益的同时显著减少内存占用。

- 两阶段计算策略:结合基于缓存的管道通信和两阶段计算策略,使得 Block AttnRes 成为标准残差连接的实用替代品,几乎没有额外开销。

此外,Attention Residuals 在 Kimi Linear 架构(48B 总参数 / 3B 激活参数)上进行了预训练,使用了 1.4T tokens,验证了其在实际大规模模型中的有效性。

3. 技术深度拆解与实现分析

本节核心价值:深入剖析 Attention Residuals 的技术实现细节,包括其架构设计、核心组件和工作流程。

3.1 架构设计

Attention Residuals 的架构设计主要包括以下几个部分:

3.2 核心组件详解

3.2.1 注意力驱动的残差聚合

传统残差连接使用固定的单位权重来累加所有层的输出,而 Attention Residuals 使用 softmax 注意力来替代这种固定聚合:

- 注意力计算:每一层计算对之前所有层输出的注意力权重

- 加权聚合:根据注意力权重对之前层的输出进行加权聚合

- 内容依赖:注意力权重是输入依赖的,允许模型根据不同输入选择性地关注不同层的信息

3.2.2 Block AttnRes 机制

为了解决内存和通信开销问题,Block AttnRes 将层划分为块:

- 块划分:将连续的层划分为固定大小的块

- 块级别注意力:在块级别上计算注意力,而不是在每个层级别

- 内存优化:显著减少内存占用,同时保留大部分收益

3.2.3 两阶段计算策略

为了进一步优化性能,Attention Residuals 采用了两阶段计算策略:

- 第一阶段:计算块内的前向传播

- 第二阶段:计算块间的注意力和聚合

这种策略结合基于缓存的管道通信,使得 Block AttnRes 能够高效地处理大规模模型。

3.3 代码示例

以下是 Attention Residuals 的核心实现示例:

# 传统残差连接

class TraditionalResidual(nn.Module):

def __init__(self, d_model):

super().__init__()

self.norm = nn.LayerNorm(d_model)

self.ffn = nn.Sequential(

nn.Linear(d_model, d_model * 4),

nn.GELU(),

nn.Linear(d_model * 4, d_model)

)

def forward(self, x):

# 固定权重累加

return x + self.ffn(self.norm(x))

# Attention Residuals

class AttentionResidual(nn.Module):

def __init__(self, d_model, num_heads=8):

super().__init__()

self.norm = nn.LayerNorm(d_model)

self.ffn = nn.Sequential(

nn.Linear(d_model, d_model * 4),

nn.GELU(),

nn.Linear(d_model * 4, d_model)

)

# 注意力机制

self.attn = nn.MultiheadAttention(d_model, num_heads)

def forward(self, x, layer_outputs):

# 计算对之前层输出的注意力

attn_output, _ = self.attn(x, torch.stack(layer_outputs), torch.stack(layer_outputs))

# 注意力加权聚合

return attn_output + self.ffn(self.norm(x))

# Block Attention Residuals

class BlockAttentionResidual(nn.Module):

def __init__(self, d_model, block_size=8, num_heads=8):

super().__init__()

self.block_size = block_size

self.layers = nn.ModuleList([

nn.Sequential(

nn.LayerNorm(d_model),

nn.Sequential(

nn.Linear(d_model, d_model * 4),

nn.GELU(),

nn.Linear(d_model * 4, d_model)

)

) for _ in range(block_size)

])

# 块级别注意力

self.block_attn = nn.MultiheadAttention(d_model, num_heads)

def forward(self, x, block_outputs):

# 块内计算

block_input = x

for layer in self.layers:

block_input = block_input + layer[1](layer[0](block_input))

# 块间注意力

if block_outputs:

attn_output, _ = self.block_attn(

block_input,

torch.stack(block_outputs),

torch.stack(block_outputs)

)

block_output = attn_output

else:

block_output = block_input

return block_output3.4 实验结果分析

Attention Residuals 在多个实验中展示了显著的性能提升:

- 缩放律实验:改进在不同模型大小上保持一致,验证了方法的通用性。

- Kimi Linear 架构集成:

- 缓解了 PreNorm 稀释问题

- 产生了更均匀的输出幅度和跨深度的梯度分布

- 在所有评估任务上提高了下游性能

- 内存和通信优化:Block AttnRes 显著减少了内存占用,同时保留了大部分收益。

4. 与主流方案深度对比

本节核心价值:通过多维度对比,清晰展示 Attention Residuals 与其他残差连接方案的优势和差异。

方案 | 聚合方式 | 内容依赖 | 内存开销 | 计算效率 | 性能提升 | 可扩展性 |

|---|---|---|---|---|---|---|

Attention Residuals | 注意力加权 | 是 | 高 | 中 | 显著 | 中 |

Block AttnRes | 块级别注意力 | 是 | 低 | 高 | 接近完整 AttnRes | 高 |

传统残差连接 | 固定权重累加 | 否 | 低 | 高 | 无 | 高 |

Mixture-of-Depths | 混合深度 | 是 | 中 | 中 | 中等 | 中 |

4.1 对比分析

- 聚合方式:Attention Residuals 使用注意力机制进行加权聚合,而传统方案使用固定权重累加。

- 内容依赖:Attention Residuals 能够根据输入内容动态调整聚合权重,而传统方案无法做到这一点。

- 内存开销:完整的 Attention Residuals 内存开销较高,但 Block AttnRes 通过块级别注意力显著减少了内存占用。

- 计算效率:Block AttnRes 结合两阶段计算策略,实现了与传统残差连接相近的计算效率。

- 性能提升:实验结果表明,Attention Residuals 在下游任务上实现了显著的性能提升。

- 可扩展性:Block AttnRes 具有良好的可扩展性,能够应用于大规模模型。

5. 工程实践意义、风险、局限性与缓解策略

本节核心价值:探讨 Attention Residuals 在工程实践中的应用价值、潜在风险和局限性,以及相应的缓解策略。

5.1 工程实践意义

Attention Residuals 为 LLM 架构设计带来了多方面的价值:

- 性能提升:通过优化残差连接的信息流动,提高了模型的表达能力和下游任务性能。

- 训练稳定性:缓解了 PreNorm 稀释问题,产生了更均匀的输出幅度和梯度分布,提高了训练稳定性。

- 内存优化:Block AttnRes 显著减少了内存占用,使得在有限资源下训练更深的模型成为可能。

- 可扩展性:两阶段计算策略和基于缓存的管道通信,使得 Attention Residuals 能够扩展到大规模模型。

- 即插即用:Block AttnRes 可以作为标准残差连接的直接替代品,几乎不需要修改现有代码。

5.2 风险与局限性

尽管 Attention Residuals 展现了显著的优势,但也存在一些风险和局限性:

- 计算复杂度:注意力机制的引入增加了计算复杂度,可能导致推理速度下降。

- 超参数敏感性:块大小、注意力头数等超参数需要仔细调整,以平衡性能和开销。

- 内存开销:完整的 Attention Residuals 内存开销仍然较高,对于非常大的模型可能仍然是一个挑战。

- 泛化能力:需要进一步验证 Attention Residuals 在不同类型的模型和任务上的泛化能力。

5.3 缓解策略

针对上述风险和局限性,可以采取以下缓解策略:

- 计算优化:使用更高效的注意力实现,如 Flash Attention,减少计算开销。

- 超参数调优:针对不同模型和任务,仔细调整块大小、注意力头数等超参数。

- 混合策略:在模型的不同部分使用不同的残差连接策略,平衡性能和开销。

- 硬件优化:利用专用硬件加速注意力计算,如 GPU 或 TPU 上的优化实现。

- 渐进式集成:从模型的部分层开始集成 Attention Residuals,逐步扩展到整个模型。

6. 未来趋势与前瞻预测

本节核心价值:展望 Attention Residuals 技术的未来发展方向,以及其对 LLM 架构设计的潜在影响。

6.1 技术演进趋势

Attention Residuals 代表了 LLM 架构设计的一个重要方向,未来可能的演进趋势包括:

- 自适应块大小:开发能够根据输入内容和模型深度自动调整块大小的机制。

- 混合注意力策略:结合不同类型的注意力机制,如局部注意力和全局注意力,进一步优化信息流动。

- 动态深度选择:不仅在残差连接中使用注意力,还在模型深度选择中使用注意力,实现更灵活的模型架构。

- 多模态扩展:将 Attention Residuals 扩展到多模态模型,处理文本、图像、音频等多种输入。

- 理论分析:深入理论分析 Attention Residuals 的工作原理,为进一步优化提供理论指导。

6.2 应用前景

Attention Residuals 的技术理念和实现方法具有广泛的应用前景:

- 大规模语言模型:应用于 GPT、BERT 等大规模语言模型,提高其性能和训练稳定性。

- 多模态模型:扩展到 CLIP、DALL-E 等多模态模型,优化不同模态信息的融合。

- 边缘设备部署:通过 Block AttnRes 减少内存占用,使大型模型能够在边缘设备上部署。

- 领域特定模型:应用于医疗、法律、金融等领域的特定模型,提高其专业性能。

- 持续学习:支持模型的持续学习,通过注意力机制更好地整合新信息。

6.3 开放问题

Attention Residuals 的发展也带来了一些值得深入研究的开放问题:

- 最佳块大小:如何确定最佳的块大小,以平衡性能和内存开销?

- 注意力机制选择:是否存在比 softmax 注意力更适合残差连接的注意力机制?

- 与其他架构创新的结合:如何与 MoE、FlashAttention 等其他架构创新结合,进一步提高模型性能?

- 理论理解:如何从理论上理解 Attention Residuals 为什么能够提高模型性能?

- 跨任务泛化:Attention Residuals 在不同类型的任务上的泛化能力如何?

参考链接:

- 主要来源:Attention Residuals - Moonshot AI 的残差连接改进方案

- 辅助:GitHub 仓库 - Attention Residuals 的代码实现

附录(Appendix):

- 实验环境:Kimi Linear 架构(48B 总参数 / 3B 激活参数),1.4T tokens 预训练

- 模型配置:不同块大小的消融实验,注意力头数设置

- 关键超参数:块大小、注意力头数、学习率、批量大小

关键词: Attention Residuals, 残差连接, LLM 架构, 注意力机制, 块级别注意力, 两阶段计算, 内存优化

在这里插入图片描述

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-24,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录