Agent 即系统:面向可靠性的智能体架构、多维评估与未来挑战

Agent 即系统:面向可靠性的智能体架构、多维评估与未来挑战

勇哥AI笔记

发布于 2026-03-11 17:27:45

发布于 2026-03-11 17:27:45

以大模型 LLM 为基础的人工智能体 AI Agent 正在悄悄成为我们与数字世界打交道的新方式——你可以把它理解成一个把大语言模型的推理能力,和规划、记忆、以及调用工具等操作打包在一起的产品。

例如,最新很火的小龙虾🦞 我在云端搭了个“贾维斯”:Moltbot(Clawdbot)云端部署与初体验

它正迅速变成连接我们日常工作生活和大模型之间的那根实用“数据线”。

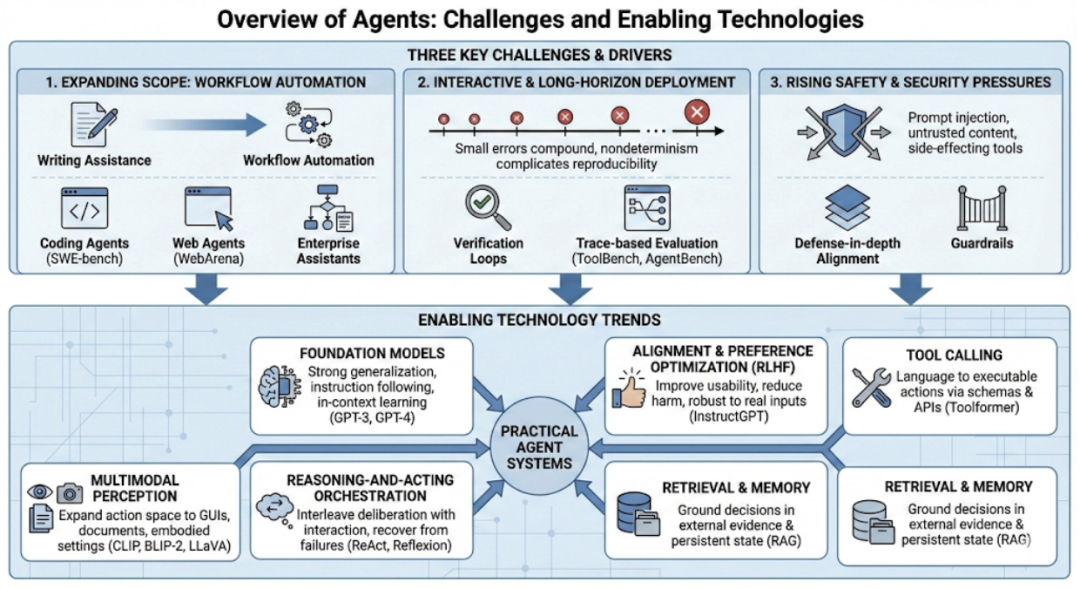

今天介绍的这篇论文综述梳理了AI Agent 领域的整体拼图。它可以分成三个核心模块来讨论:

第一是推理与思考,比如怎么用思维链把复杂问题掰开揉碎了想,怎么让代理自我反思、验证自己的判断,以及在各种限制条件下依然能做出合理的决策;

第二是规划与控制,从最简单的“下一步做什么”的反应式策略,到能分层、能走一步看多步的复杂规划器;

第三则是工具调用和环境交互,例如检索信息、执行代码、调用API,甚至看懂多模态的输入。

目前关于这方面的研究可以放入一个统一的框架里,从三个维度来归类:

首先是 Agent的内部组件,比如策略模型(或者说LLM核心)、记忆模块、对世界的理解模型、规划器、负责调谁的工具路由器,以及负责结果的评审;

其次是 Agent的协作方式,是单兵作战还是多智能体协同,是集中式指挥还是分布式协调;

最后是 部署场景,是离线分析型的,还是在线实时交互的,是安全至上的任务,还是开放探索型的任务。

图1:AI代理和代理执行循环(推理、工具和内存)概述

论文也梳理了设计这类系统时不得不面对的几个关键因素:

你是要快还是要准,要让它自主还是要留够控制权,要它能干还是要它可靠?

与此同时,还有一些“隐藏成本”经常被忽视,比如系统的不确定性怎么处理,长期任务里的信用分配怎么搞,工具和环境本身的不稳定,还有重试机制和上下文窗口膨胀带来的开销——这些都会让实际评估变得比想象中复杂得多。

论文最后盘点了当前主流的评测方法,包括任务套件、人类偏好和效用指标、在约束条件下能不能成功,以及系统的鲁棒性和安全性。

同时,也点出了几个还没解决的开放问题:比如如何给工具调用加上可靠的护栏,怎么管理可扩展的记忆和上下文,如何让 Agent 的决策过程可解释,以及在真实负载下,怎么保证评估是可复现的。

图2.以Agent为中心的AI范例:嵌入工具和环境交互循环中的模型

01

—

自主Agent模式

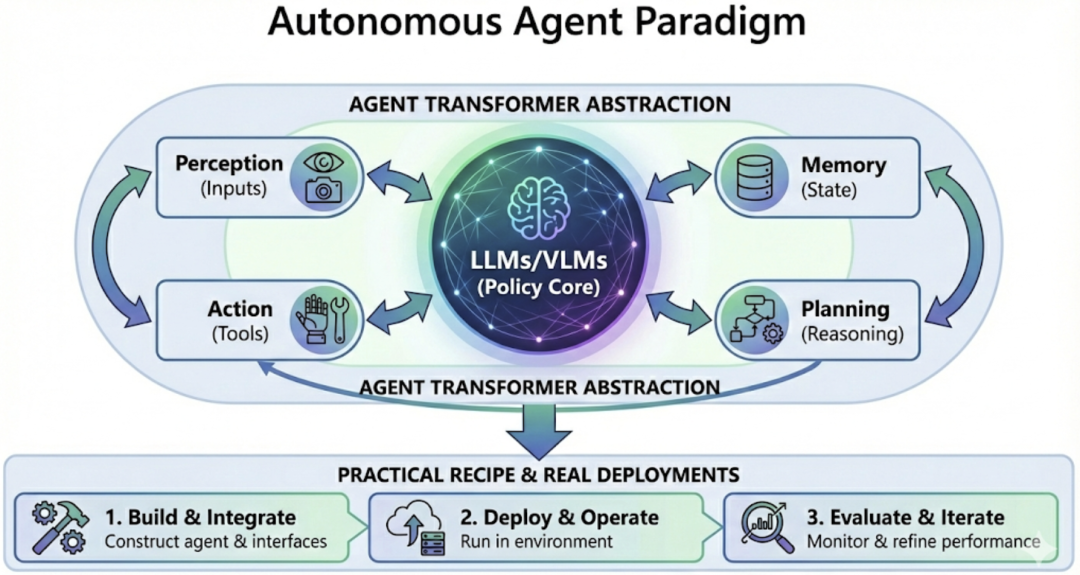

大型语言模型(LLM)是现代 Agent 的主导策略核心,模型展现出强大的指令遵循和上下文学习能力,使得无需重新训练即可快速引导能力。

然而,LLM 本质上并未接触真实世界:如果没有外部证据和可执行检查,它们可能生成看似合理但不正确的陈述。

这促使出现了工具中心和检索中心的 Agent 设计,将模型视为一个编排器,跨越可信工具和数据源。即 Agent 不仅是文本生成器,更是一个控制器,将意图转化为在世界(软件仓库、浏览器、机器人)中执行的程序。

核心思想是将 Agent 行为视为一个序列模型,记录观察、推理/计划、工具调用和结果的轨迹。一个通用的执行循环如下:

1、收集观察:从环境中获取最新状态。

2、检索记忆:从记忆库中检索相关上下文(如检索或内部摘要)。

3、生成动作:基于当前上下文和记忆,使用策略模型提议动作(可能是自然语言指令或工具调用)。

4、验证与约束检查:使用批评者或预定义约束验证动作的安全性和正确性。

5、执行工具:在环境中执行工具调用,更新环境状态和记忆。

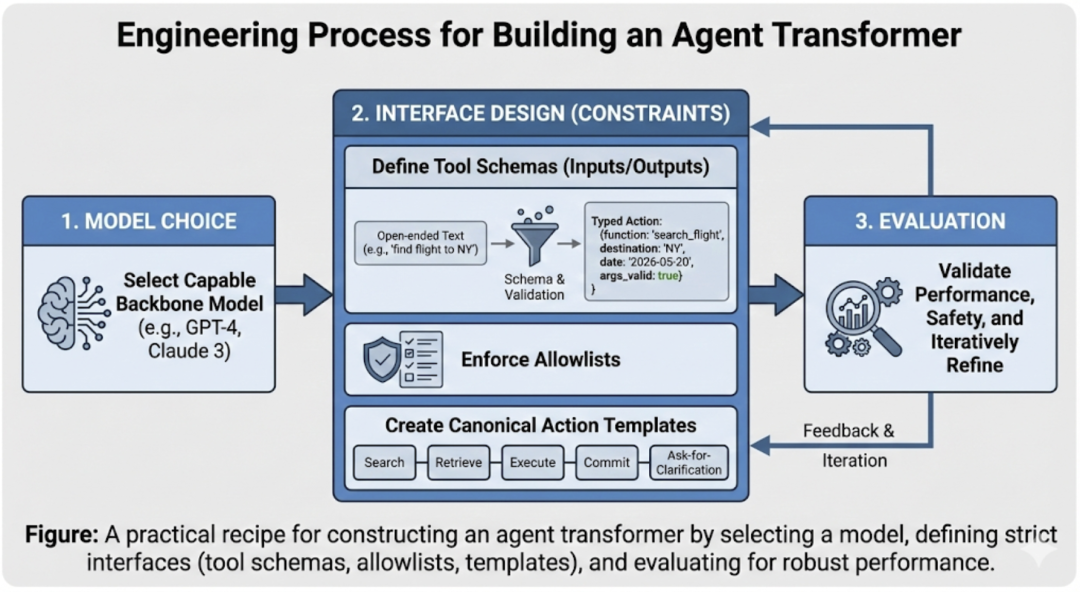

构建 Agent 的实际过程是一个工程过程,结合了模型选择、接口设计和评估。一个常见的做法是:

1、选择骨干模型:选择一个强大的基础模型。

2、约束接口:定义工具模式(输入/输出),强制执行允许列表(Allowlist),并创建一组规范的动作模板(如搜索、检索、执行、询问澄清)

3、设计控制循环:一个最小的循环包括(检索上下文)→(计划)→(调用工具)→(验证)→(更新记忆)→(重复)。

4、优化学习信号:如果有专家演示,使用行为克隆进行微调;使用 RLHF 改善响应的帮助性和安全性;引入验证和回溯循环以降低错误率。

图3:编排 Agent 模式,具有到内存、工具、验证器和环境的显式接口

在实际实践中,许多系统采用了“轨迹优先”的数据循环:让代理在真实环境中运行,记录完整的轨迹(提示、工具调用、结果),并持续挖掘失败案例用于有针对性的改进(如改进提示、新增工具、微调纠正轨迹)。这改变了学习的范式,从一次性的模型训练转变为持续的系统精炼。

02

—

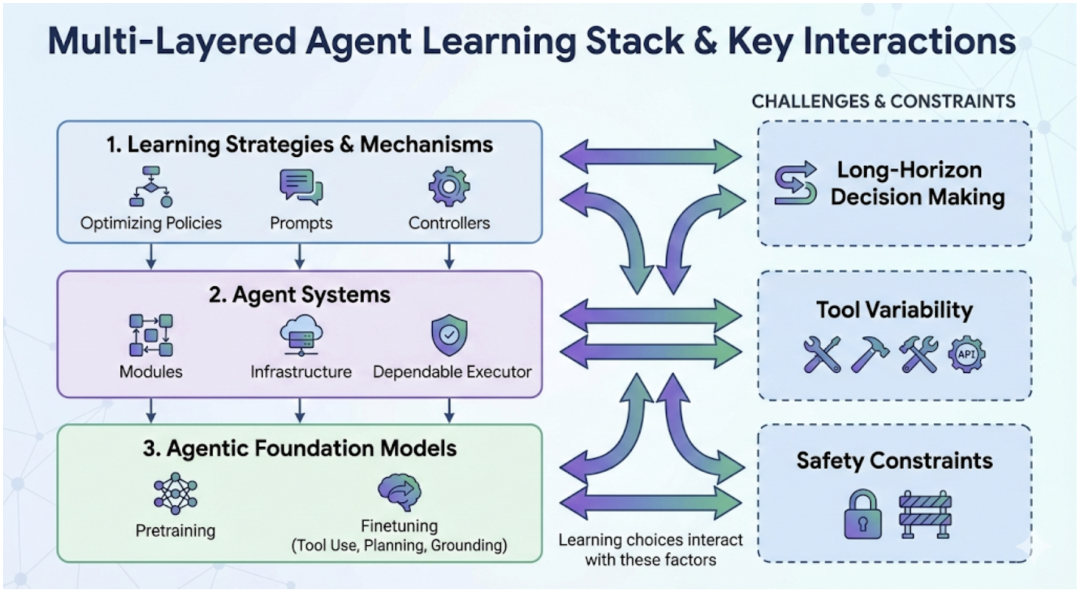

Agent 学习

Agent 学习涵盖了多个层次:

- 学习策略与机制:代理如何在环境交互中学习(RL、IL、In-context Learning)。

- 代理系统:代理如何在系统级别组织(模块化、基础模型适配)。

- 代理基础模型:基础模型的预训练和微调如何塑造工具使用、规划和落地能力。

图4:跨机制、系统和基础模型的agent AI学习概述

1. 策略与机制

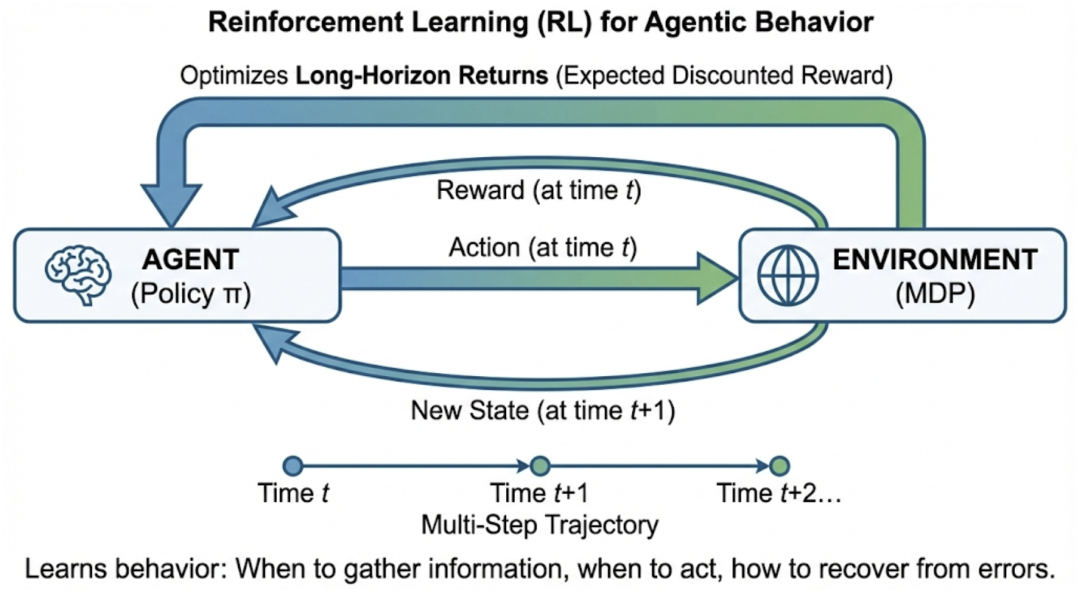

强化学习(RL):RL 是代理行为的自然选择,因为它直接优化长期回报(通常形式化为马尔可夫决策过程),学习何时收集信息、何时行动以及如何在多步轨迹中恢复。然而,RL 在工具丰富的真实环境中面临瓶颈:奖励稀疏、回滚成本高、工具调用代价高,这促使采用离线 RL 或安全 RL。

图5. 用于智能体策略和控制器的强化学习(RL)流程

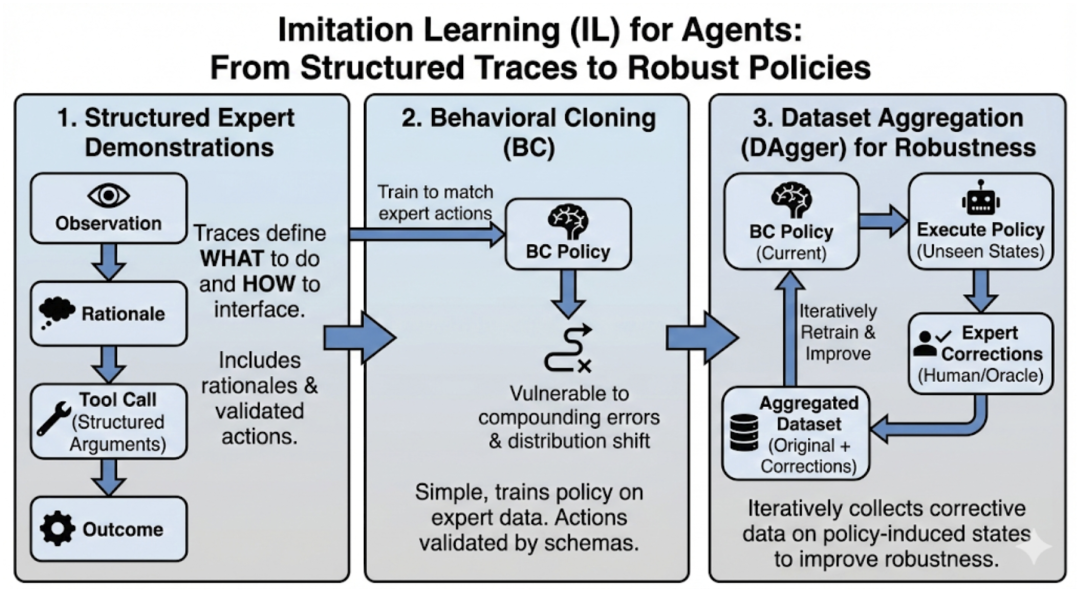

模仿学习(IL):IL 是一种务实的途径,当有专家演示(如人类记录的轨迹)时。行为克隆(Behavioral Cloning)训练策略匹配专家动作,但易受分布漂移(Compounding Errors)的影响。DAgger 等方法通过在学习策略诱导的状态上收集纠正演示来缓解这个问题。

图6. 基于演示和交互轨迹的模仿学习(IL)

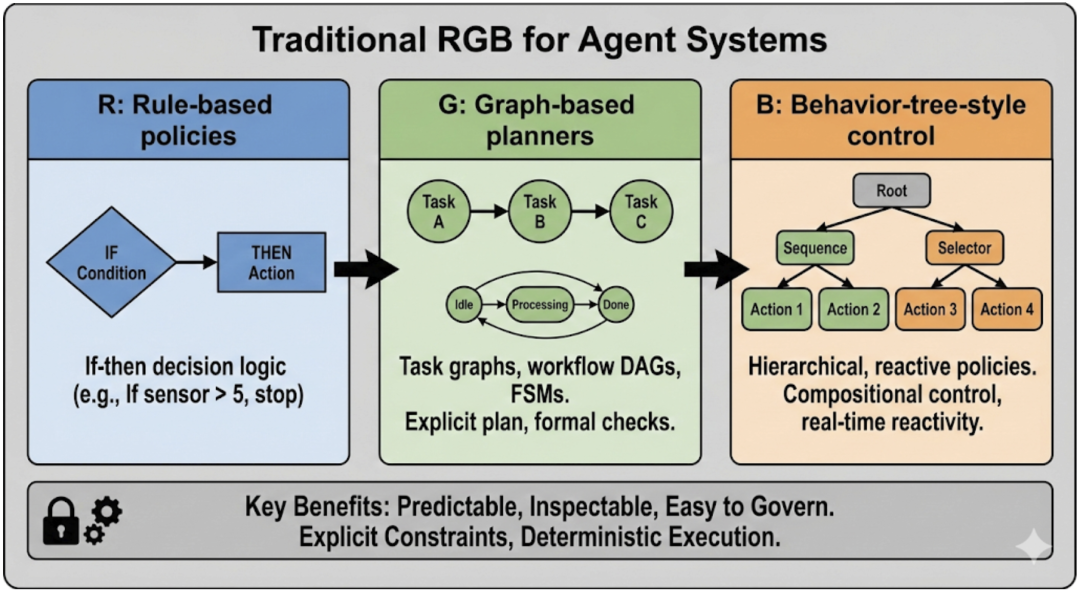

传统 RGB(规则/图/行为树):在 RL/IL 之前,许多生产系统依赖于传统的基于规则的策略和行为树,因其可预测性和易审计性而被保留,用于约束关键的安全行为。

图7. 传统RGB组件:基于规则的策略、图形规划器和行为树

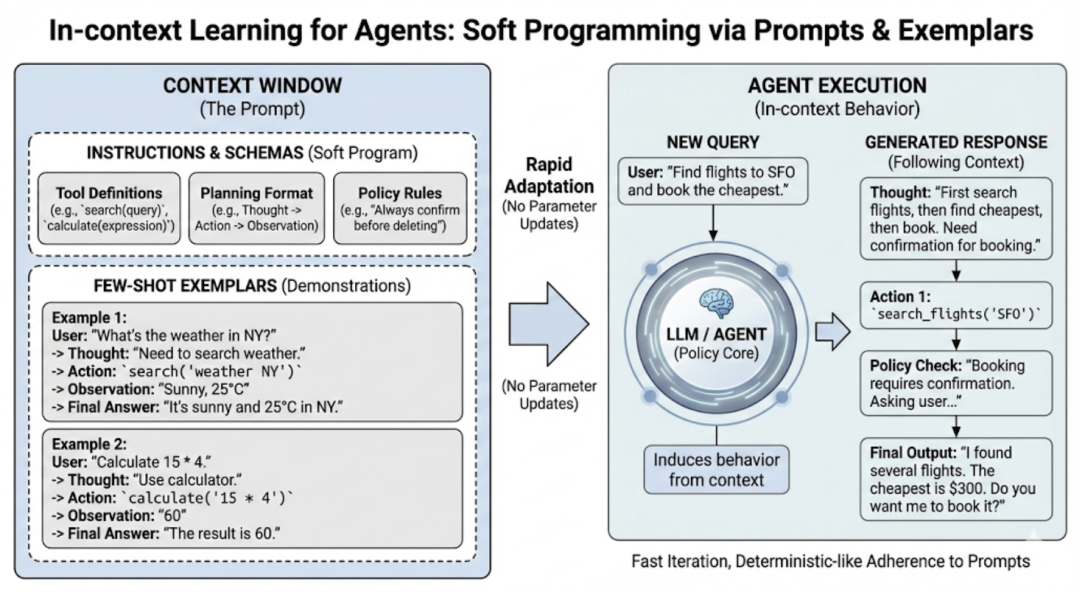

上下文学习(In-context Learning):这是一种无需参数更新的快速适应方式。通过少量示例,模型可以学习如何使用工具、如何分解任务。链式思考(Chain-of-Thought)提示显著提升了多步推理能力,而 ReAct 形式化了在语言模型中交替进行推理和行动的模式。

图8. 通过提示、示例和动作模式为智能体提供情境内学习

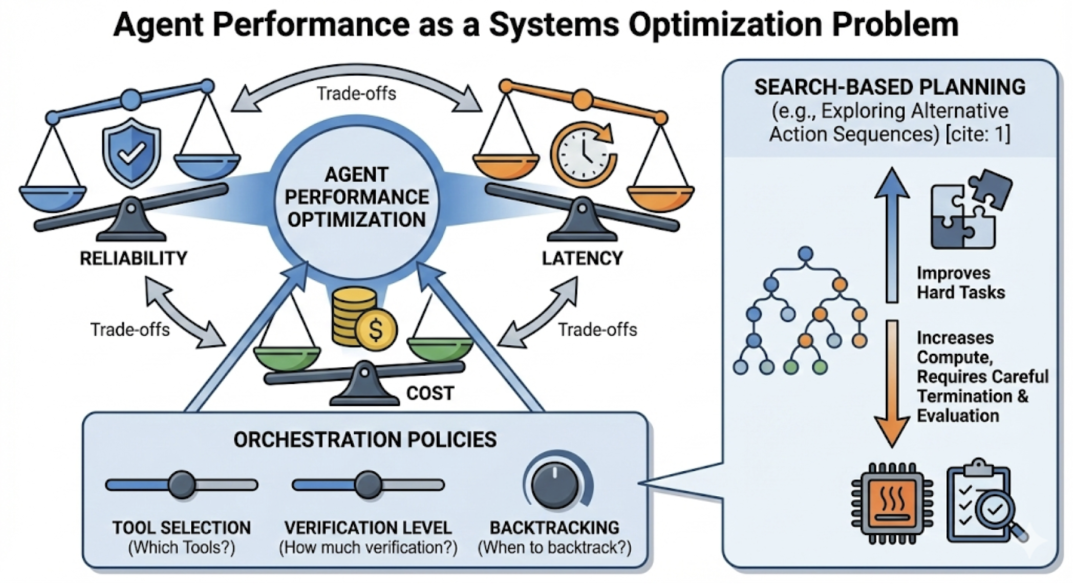

系统优化(Compute Allocation):在实际部署中,关键是“预算分配”:何时花费额外的计算进行搜索或反思,何时快速执行。搜索式规划(Tree-of-Thoughts)和自我一致性(Self-consistency)在错误时引入额外的成本(采样、搜索深度),但显著提升了可靠性。

图9. Agent 的优化问题

2. Agent 系统架构

- LLM 核心:负责指令跟随和通用推理。

- 记忆:负责检索和长期状态管理。

- 工具路由器:根据任务将输入路由到检索、代码执行、数据库查询等工具。

- 规划器:可能是显式的搜索算法或隐式的模型预测。

- 批评者/验证器:在副作用发生前检查动作的安全性和正确性。

基础模型适配:基础模型的选择影响代理的能力。最新的模型提供更强的指令遵循和推理能力,但系统设计(如工具约束)往往比模型大小更重要,因为它们约束了模型的潜在破坏性。

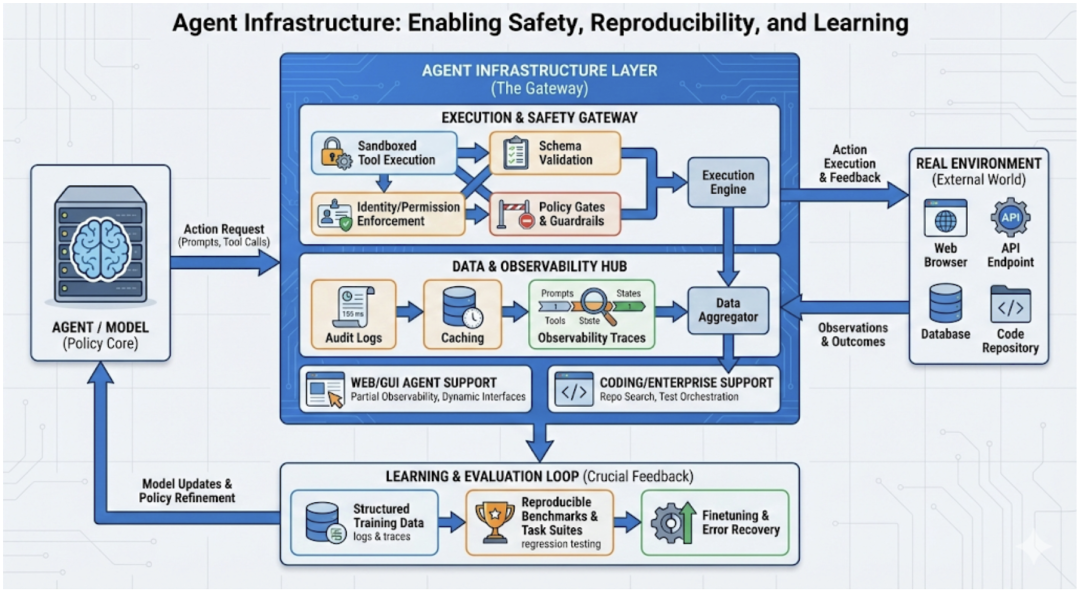

部署基础设施:安全关键的部署需要沙盒执行、模式验证、身份/权限执行、审计日志等。对于 Web 和机器人代理,这包括模拟器或安全的浏览器环境,以防止恶意操作。

图10. 安全部署的 Agent 基础设施:沙盒、模式、权限和日志记录

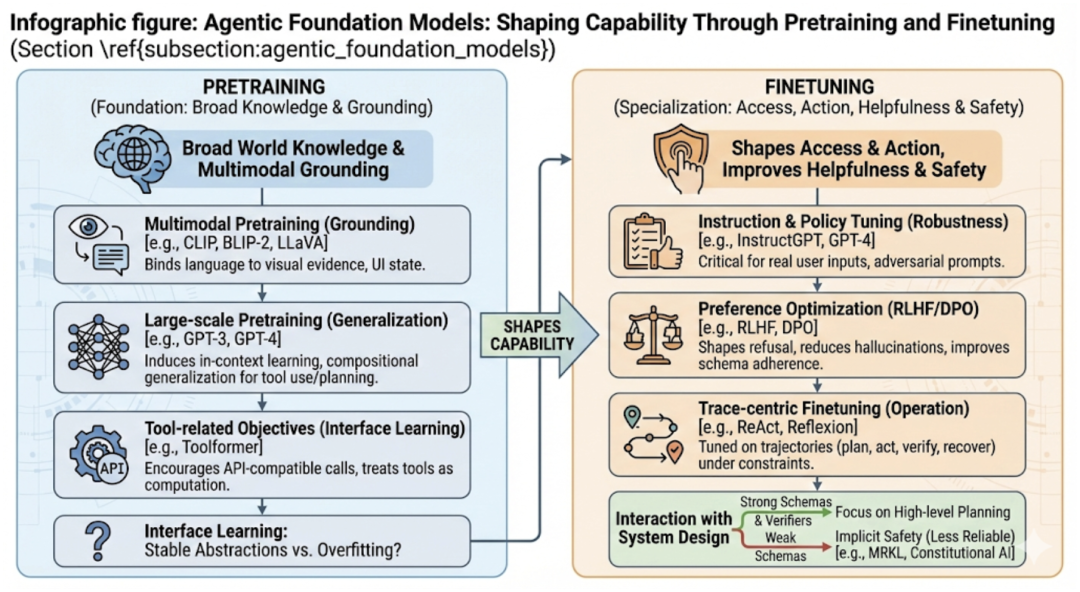

3. 代理性基础模型(Pretraining 与 Finetune)

预训练:前置训练构建了广泛的世界知识和多模态感知能力(如 VLM 能够读取 UI 屏幕),这对于“接地”(Grounding)至关重要。

微调:指令微调和对齐(如 RLHF)是关键,塑造模型的帮助性和安全性。工具使用学习可以是显式的(在轨迹上微调)或隐式的(通过强化学习从工具反馈中学习)。

图11. 代理基础模型:工具使用和规划的预训练与微调

04

—

Agent 分类

根据 Agent 交互的主要位置(文本/工具、物理实体、模拟环境)、生成的目标(内容/世界/体验)以及推理底层(知识、逻辑、情感、神经符号结构),对 Agent 系统进行分类如下。

图12. 多能智能体的应用领域和代表性能力需求

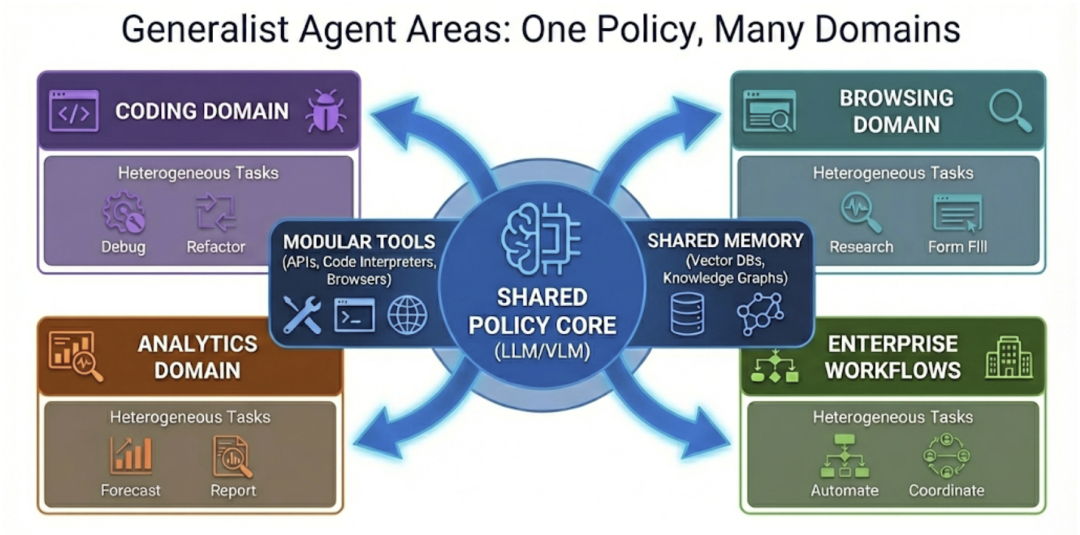

1. 通用代理领域(Generalist Agent Areas)

特点:旨在解决跨领域的异构任务(编码、浏览、企业工作流),使用共享的策略核心加上模块化的工具和记忆。 挑战:长期任务中错误会累积,工具失败(如搜索错误、代码编译失败)主导了错误来源。评估不仅要看最终答案是否合理,更要看整个执行轨迹是否可靠。 解决方案:使用检索增强生成(RAG)获取证据,使用模块化工具路由(MRKL)分离语言理解和专用工具,并使用 ReAct 进行轨迹化推理。

2. 具身代理(Embodied Agents)

特点:在物理世界中操作(机器人、智能设备),受实时约束(延迟、物理安全)限制。 挑战:感知错误和执行噪声可能导致安全问题。需要严格的安全约束和低延迟的控制。 解决方案:层级式控制(Hierarchical Control),高层规划使用 LLM,低层执行使用传统或 RL 控制器,结合工具进行可行性检查。

3. 多模态代理(Multimodal Agents)

特点:结合视觉和语言,处理 UI、文档、视频等。 挑战:视觉幻觉、OCR 错误、视觉检索不准是主要瓶颈。安全风险包括图像中的 Prompt 注入。 解决方案:将感知拆分为工具(OCR、检测、检索),使用 VLM 进行指令调度,使用批评者检查视觉输出的可信度。

4. 生成性代理(Generative Agents)

特点:生成长篇内容、角色或模拟世界(如 NPC、社交模拟)。 挑战:长期一致性(人物性格、世界状态)和安全约束(避免生成有害内容)。 解决方案:使用持久记忆(Episodic Memory)和检索来保持一致性,使用批评者检查约束。

05

—

Agent 任务

Agent 越来越多地被部署为工作流执行器,而非静态聊天界面:它们将用户意图转化为跨工具、数据源和环境的多步骤操作。

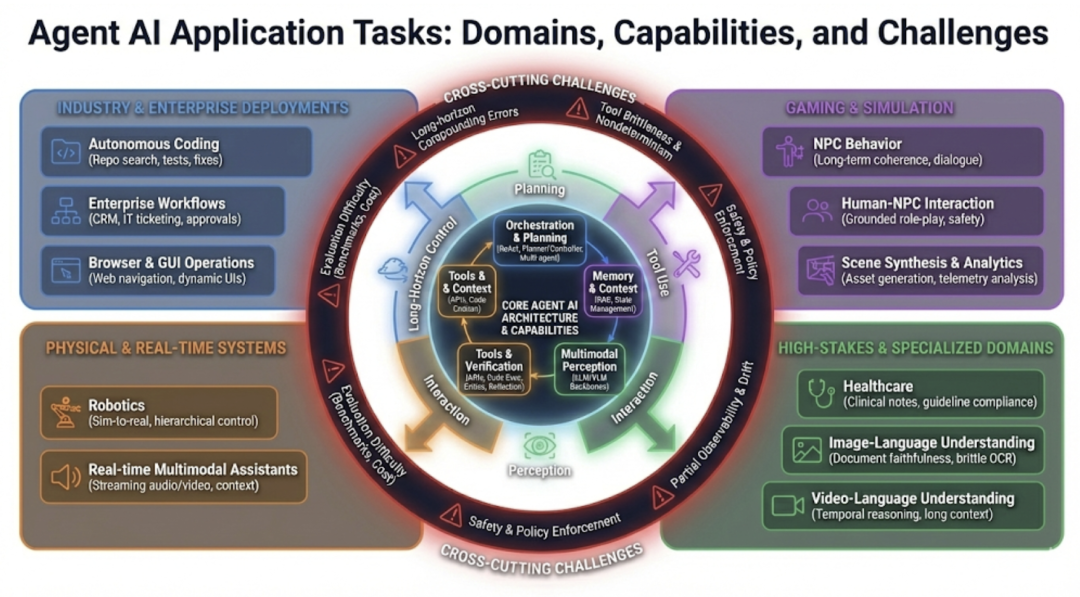

遵循图18中的任务导向框架,按领域对应用程序进行组织,这些领域强调不同的能力(交互、感知、规划、工具使用和长期控制)。对于每个任务类别,总结了典型的模型、代理技术、当前挑战以及特定代理设计有效的原因。

图18. 代理应用程序全景:任务类别和能力要求

1. 编码与软件维护(Coding & Software Maintenance)

现状:代理用于从仓库中检索上下文、生成补丁、运行测试。成功需要跨文件的上下文管理和对编译器错误的理解。挑战:检索质量决定了补丁的正确性。编译错误是常见的噪声来源。评估:使用 SWE-bench 等基准,评估端到端的 Issue 解决率,而不仅仅是补丁生成的“正确性”。

2. 浏览与 GUI 操作(Web Interaction)

现状:代理操作真实的网站,点击、填写表单、导航页面。挑战:UI 的布局经常变化,页面可能包含恶意脚本或注入指令。工具(浏览器)的鲁棒性是关键。评估:使用 WebArena 等真实的 Web 环境基准,评估长期任务的成功率和鲁棒性。

3. 企业工作流与自动化(Enterprise Workflow Automation)

现状:代理访问 CRM、票务系统、数据库,执行跨系统的自动化。挑战:访问控制严格(ACL),错误可能导致数据泄露或财务损失。需要审计日志。解决方案:使用 MRKL 风格的工具路由,强制执行工具模式(Schema),并在关键步骤要求人工确认。

4. 多模态辅助(Multimodal Assistance)

现状:代理通过摄像头或屏幕与用户交互(如 AR 助手)。挑战:多模态感知的错误累积,隐私限制(无法记录图像)。解决方案:将感知拆分为专用工具,使用 LLM 进行编排,使用验证器在执行前检查指令的安全性。

06

—

评估

评估 Agent 不仅要看“它说了什么”,更要看“它做了什么”。一个完整的评估框架应包含以下维度:

1. 端到端任务性能(Primary Task Performance)

这是最基础的指标:代理是否成功完成了任务。例如,在 WebArena 中完成一个购物任务,在 SWE-bench 中修复一个 bug。

2. 效率与成本(Efficiency & Cost)

代理可能通过多次采样或搜索来提高可靠性,但这会增加延迟和计算成本。需要报告:

- 延迟:包括模型推理时间和工具执行时间。

- 令牌消耗:输入和输出的令牌数。

- 工具调用次数:特别是计费 API(如搜索引擎)的调用次数。

6.3. 工具使用正确性(Tool-Use Correctness)

- 参数有效性:工具调用是否符合模式(Schema)。

- 执行成功率:工具调用是否成功(无超时、无错误)。

- 恢复能力:当工具失败时,代理是否能够识别并重试或降级。

6.4. 轨迹与规划质量(Trajectory & Planning Quality)

- 循环率(Loop Rate):代理是否陷入了“检查-纠正-检查”的死循环。

- 计划一致性:代理的实际行动是否符合其最初的计划或承诺。

6.5. 鲁棒性(Robustness)

- 随机性敏感性:不同随机种子(Sampling)或提示变体下性能的方差。

- 环境扰动:面对布局变化或数据漂移时的表现。

6.6. 安全与合规(Safety & Compliance)

- 策略违规率:是否执行了不允许的操作(如写入敏感文件、泄露个人信息)。

- 人工干预率:需要多少次人工确认或纠正。

07

—

展望

尽管 Agent 系统取得了显著进展,论文表示,仍有多个核心挑战需解决:

7.1. 验证与可信工具执行

- 问题:工具调用可能产生副作用(如付款、写文件)。当前的验证器往往是“软约束”(Soft Constraint),缺乏形式化的安全证明。

- 方向:将工具调用视为“合约”(Contract),定义明确的前置条件和后置条件,建立“工具防火墙”(Tool Firewall),确保在执行前进行严格的安全审计。

7.2. 长期记忆与上下文管理

- 问题:长时间交互会导致上下文膨胀。检索增强虽然能解决这一问题,但检索质量决定了代理的可靠性。

- 方向:研究更高效的记忆压缩(如摘要、向量化)技术,确保关键信息不被遗忘,同时防止检索中的 Prompt 注入攻击。

7.3. 规划与测试时计算分配

- 问题:搜索和反思虽然能提升可靠性,但代价高昂。

- 方向:发展“预算感知”(Budget-Aware)的规划策略,根据任务的风险和不确定性动态分配计算资源(例如,简单的搜索查询不搜索,关键的高风险决定进行多次采样或回滚检查)。

7.4. 鲁棒评估与可复现性

- 问题:代理结果极其依赖提示(Prompt)和种子(Seed),难以复现。

- 方向:建立标准化的评估协议(包括多种种子、多种扰动),报告完整的轨迹日志,推动“轨迹第一”(Trace-First)的研究范式。

7.5. 多代理协作与治理

- 问题:多代理系统可以通过交叉检查降低错误,但会产生“代理间争论”(Agent Disagreement)。

- 方向:设计基于证据的协商机制,明确每个代理的权限范围,避免“集体幻觉”(Collective Hallucination)和“冲突代理行为”(Conflicting Agent Behaviors)。

结论:

Agent 系统正在将大语言模型从被动的聊天伙伴转变为主动的工作流执行者,跨越了文本生成的边界,深入到软件工程、网页操作、企业自动化、机器人控制和多模态交互等多个领域。

该论文综述了 Agent 的核心模式,强调了“Agent 即系统”的观点:可靠性和安全性不仅取决于模型本身,更取决于工具接口、验证机制和系统约束。

论文回顾了从 RL 到 In-context Learning 的学习策略,强调了在真实世界中,系统设计(如模块化架构、工具沙箱、安全防护)往往比单纯的模型规模更为关键。

评估方面,呼吁从单一的成功率转向多维度的度量体系,包含成本、轨迹完整性、鲁棒性和安全性。

未来的核心挑战在于如何实现可验证的工具执行、可扩展的记忆管理以及在受限预算下的自适应推理。只有解决了这些问题,AI Agent 才能从研究实验室走向可靠的大规模部署。

<完>

推荐阅读:

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录