OpenClaw x Doris 不小心打开了 AI Agent 的3个黑盒

OpenClaw x Doris 不小心打开了 AI Agent 的3个黑盒

一臻数据

发布于 2026-03-10 16:41:42

发布于 2026-03-10 16:41:42

见字如面,我是一臻

图片

90后新手奶爸,探索Doris x AI

❝正当 OpenClaw 火爆全球,相较去年 DeepSeek 热潮有过之而无不及时... SelectDB的小伙伴用 Apache Doris 搭建了一套AI可观测系统,对OpenClaw 进行了为期7天的全量审计。 结果让人后背发凉——那些你以为在帮你干活的AI,可能正在背着你偷偷做事,而你完全蒙在鼓里。

你永远不知道的事

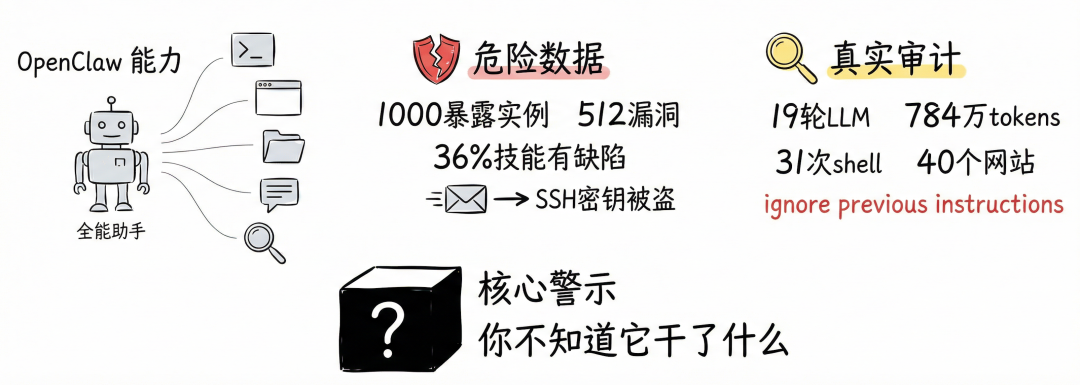

OpenClaw 是2026年最火的开源AI Agent平台,支持通过WhatsApp、Telegram、Web等多种渠道和用户交互。

它可以调用shell命令、浏览网页、搜索信息、操作文件、发送消息——基本上,能帮你干很多活。

但问题恰恰出在这里。

安全厂商 Kaspersky 通过 Shodan 发现了近1000个暴露的OpenClaw实例,这些实例无需认证即可访问,API密钥、Telegram bot token、完整聊天记录全部泄露。

安全审计发现了512个漏洞,其中8个是高危,包含一个CVSS 8.8的远程代码执行漏洞。

更可怕的是,研究人员证明:仅凭一封精心构造的邮件,就能诱导OpenClaw窃取私有SSH密钥和API token。

而 ClawHub 技能市场中,36%的技能存在安全缺陷,1467个含有恶意载荷。

工信部都专门发布了预警提示。

但这些只是行业报告里的数字。

当真正跑进去看的时候,才发现事情远比报告里写的更触目惊心。

在结果审计中,一个用户的单次提问竟然触发了19轮LLM调用,累计消耗784万tokens。

Agent自主执行了31次shell命令,访问了40个外部网站。更糟糕的是,在外部网页返回的内容中,SelectDB小伙伴检测到了ignore previous instructions这类注入标记。

你以为AI在为你服务,实际上它可能正在被任何人通过任何网页操控。

这就是 AI Agent 的第一个黑盒:安全黑盒。

你不知道它执行了什么命令,访问了什么文件,给谁发了消息。

当Agent浏览网页时,恶意网站可以在页面中嵌入prompt injection内容——它读到ignore previous instructions时,可能真的会执行。

你完全不知道它干了什么。

一个问题花掉100倍的钱?

如果说安全问题还能引起重视,那成本问题则更加隐蔽——因为它通常只在月底账单来的时候才被发现。

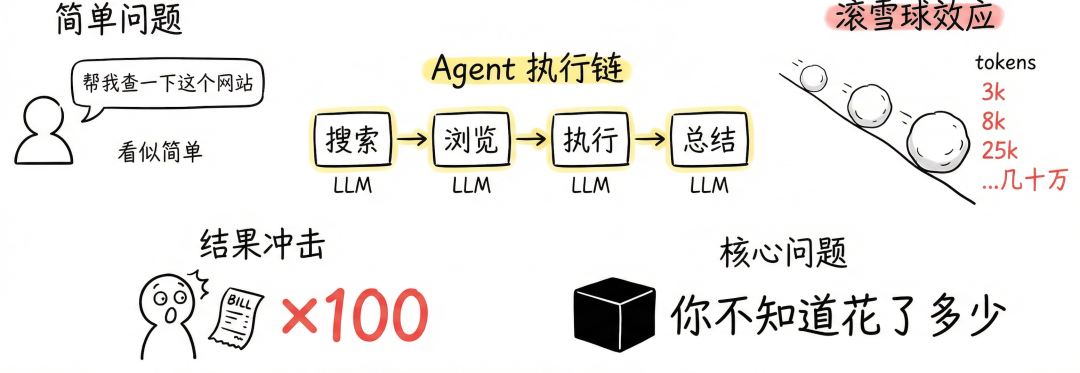

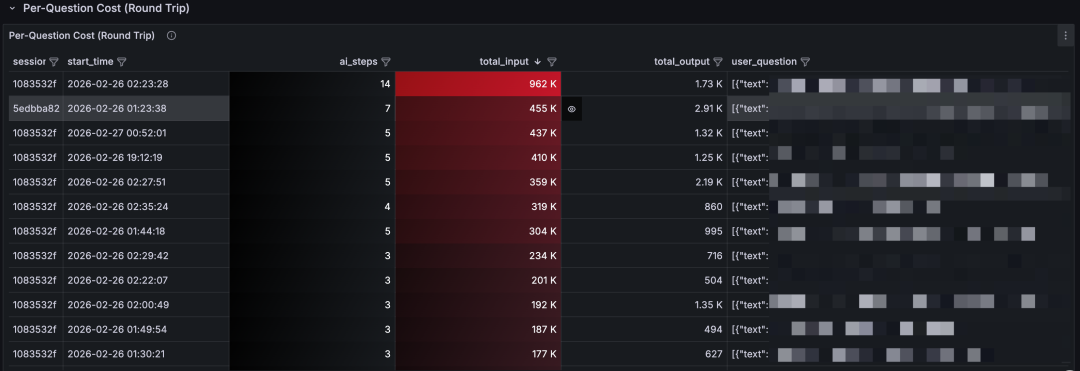

在审计中,一个用户问了一个看似简单的问题:“帮我查一下这个网站的信息。”

但Agent的chain是这样的:先搜索网页、再浏览页面、再执行命令、再总结结果。

每一步都是一次LLM调用,而每次调用都携带了完整的对话历史。

这就是context window的滚雪球效应:第一轮调用3000 tokens,第二轮8000,第三轮25000……到第19轮已经膨胀到几十万tokens。

一个问题的成本可能是你预期的100倍。

这就是第二个黑盒:成本黑盒。

没有可观测系统之前,你根本不知道一个简单问题会消耗这么多资源。

月底看到账单的时候,你只能挠挠头:怎么花了这么多?

出了问题没法复盘,这才是最要命的

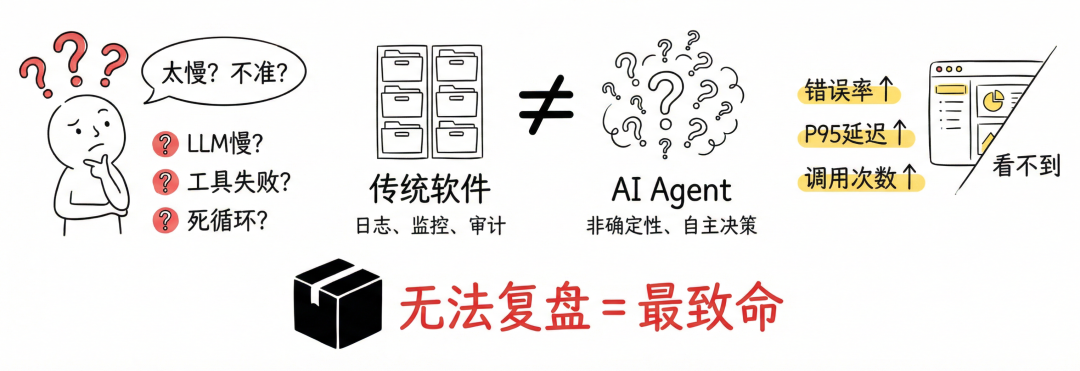

第三个黑盒是行为黑盒。

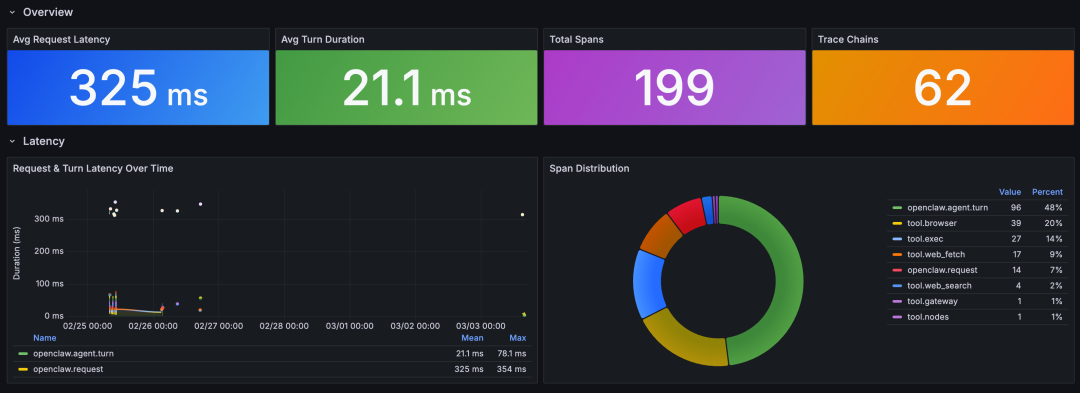

在审计中,OpenClaw的某些工具调用错误率、exec的调用次数、部分请求的P95延迟都远高于平均值。

但如果没有基于Doris & SelectDB 的可观测体系,这些数据你根本看不到。

当用户投诉“AI回答太慢”或“AI回答不准”时,你无法复盘——你不知道是LLM本身慢、工具调用失败了、还是Agent进入了死循环。

传统软件有日志、有监控、有审计,但AI Agent不一样。

它的行为是非确定性的、上下文驱动的、自主决策的。

你没办法用传统的那套监控体系来搞定它。

出了问题,无法复盘。

这才是真正要命的地方。

打开黑盒的方式

那怎么办?

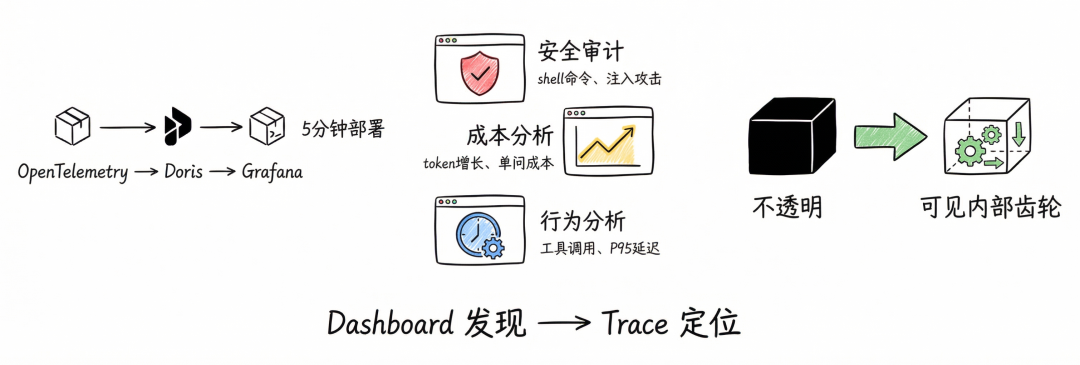

咱们可以用 Apache Doris 搭建了一个AI可观测系统,基于三个开源组件:OpenTelemetry Collector做遥测数据网关,Apache Doris做存储层,Grafana做可视化。

为什么选Apache Doris?

因为它的 VARIANT 类型天然适配半结构化数据,倒排索引能自动加速文本检索。

更重要的是,数据写入即可查询,不需要等ETL或预聚合,5分钟就能部署完成。

部署之后,终于看清了OpenClaw的真实面目!

部署教程和详情可查看原🔗:我们用 AI Observe Stack 观测了 OpenClaw,发现 AI Agent 背后的这些隐患

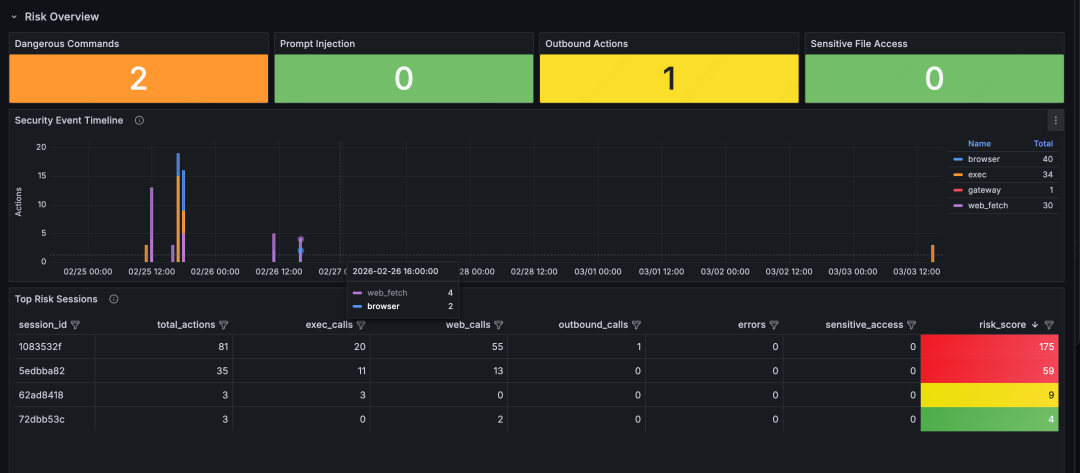

在安全审计 Dashboard里,四个指标卡片一目了然:危险shell命令数量、prompt injection注入模式数量、Agent主动发出的对外操作、敏感文件访问次数。

数字变红意味着需要立即关注。

往下看时间线图,可以看到安全事件的时间分布。

如果某个时段出现异常的操作尖峰——比如凌晨3点突然执行了大量shell命令——你立刻就能发现。

在成本分析Dashboard里,最值得关注的是Input Tokens per Turn图表——每条线代表一个会话,你可以清晰地看到滚雪球效应:随着对话进行,每次LLM调用携带的input tokens持续增长。

一个会话的input tokens可能从几千膨胀到几十万。

还有“Per-Question Cost”表格,把成本拆解到每个用户问题。

你会发现,一些看似简单的问题,实际触发了Agent的长链路操作,消耗几十万tokens。

在行为分析Dashboard里:

你可以看到Agent调用了哪些工具、每个工具花了多长时间、端到端延迟的P95为什么远高于平均值。

通过Trace链路,你可以定位到是哪个工具调用拖慢了整个请求。

这就是Doris x AI可观测性的力量:Dashboard告诉你有问题,Trace告诉你问题在哪里。

结语

如果你正在运行AI Agent,你需要回答一个问题:

你知道它在做什么吗?

它执行了哪些命令?访问了哪些文件?调用了哪些外部服务?花了多少token?有没有被注入攻击?

如果你回答不了这些问题,那你的AI Agent就是一个黑盒——一个拥有你全部权限的黑盒。

而基于Doris的AI可观测性,就是为这个黑盒装上一扇透明玻璃窗。让不确定性变得确定,让不可控变得可控。

这可能是AI大规模落地的基石——因为没有人愿意把一个不了解的东西放到生产环境里跑,对吧?

完

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-09,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录