实践一下这些项目和技术,薪资30+不为过吧

实践一下这些项目和技术,薪资30+不为过吧

wangmcn

发布于 2026-03-05 14:18:01

发布于 2026-03-05 14:18:01

养一群龙虾做测试~OpenClaw主题交流

持续分享OpenClaw在软件测试领域的落地应用

以下是企业最需要的项目和技术,也是我们本期课程的重点内容,耐心看完,薪资轻松多要5K以上。

普通测试工程师简历:

●熟练使用 JMeter、Postman

●编写测试用例,执行测试

●使用 Selenium 做 UI 自动化

学完这些技术的简历:

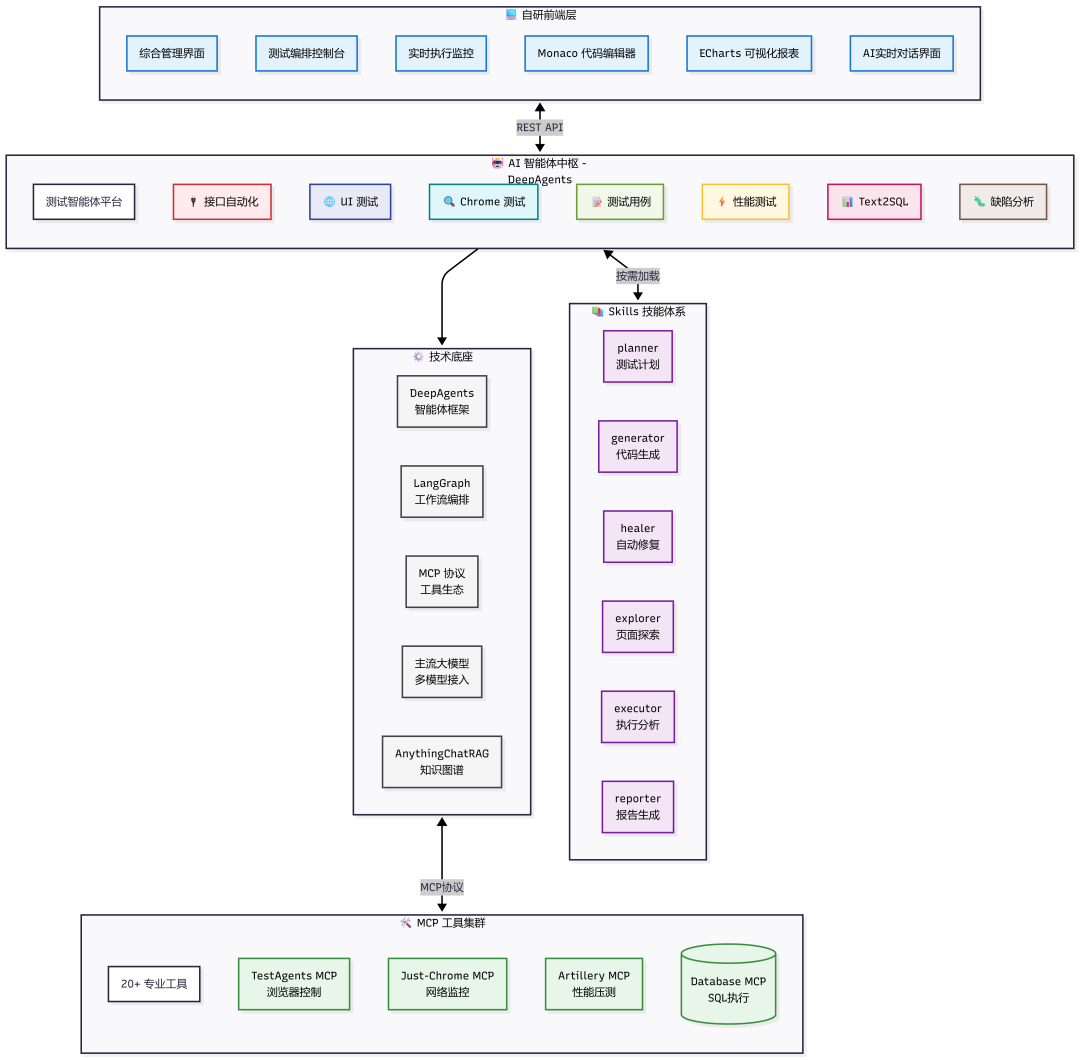

●✅ 独立设计 AI 智能体系统,掌握 DeepAgents + LangGraph 核心技术

●✅ 实现 7 个生产级测试智能体,覆盖接口/Web/性能/数据分析/缺陷分析

●✅ 深入理解 MCP 协议,能开发自定义工具服务器和 Tool Registry

●✅ 掌握 Skills 技能体系 设计,实现知识模块化与按需加载

●✅ 具备 从 0 到 1 构建 AI 测试平台 的完整经验

●✅ 熟练使用OpenClaw、AI 编程工具,提升开发效率 10 倍以上

文章最后有本课程视频效果展示哦

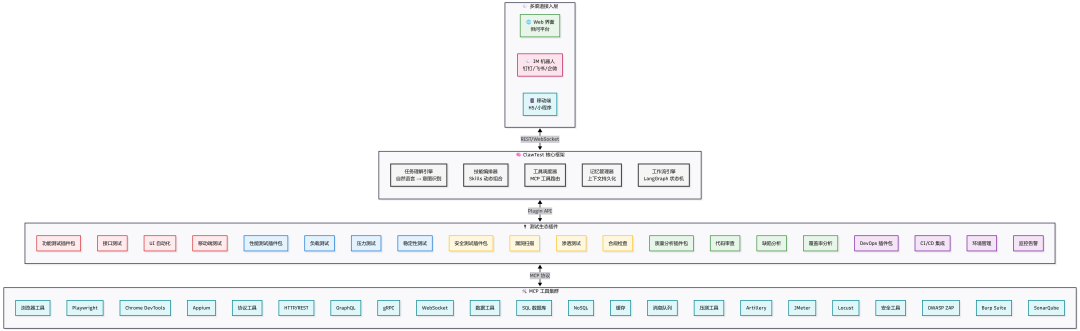

平台架构全景图

多智能体系统深度解析

1️⃣ 接口自动化智能体 —— 场景编排专家

🎯 解决什么痛点?

💡 核心技术亮点

🔥 场景编排引擎

# 业务流示例:电商下单完整流程

用户登录 → 创建订单 → 支付 → 查询订单状态

↓ ↓ ↓ ↓

提取token 提取orderId 验证状态 断言结果

↘ ↙ ↘ ↙

自动数据传递 & 跨接口状态管理

🔄 数据依赖传递系统

📊 技术指标

● ✅ 支持 JSONPath 数据提取

● ✅ 支持 变量模板{{variable}} 替换

● ✅ 支持 转换表达式'Bearer ' + value

● ✅ 支持 断言链 多层级验证

2️⃣ UI 测试智能体 —— 定位器自愈大师

🎯 解决什么痛点?

传统 UI 自动化:页面一改 → 定位器失效 → 脚本崩溃 → 人工修复 → 重新调试

↑_____________________________________________|

恶性循环

我们的方案:定位器失效 → AI 自动识别 → 多策略修复 → 测试继续

↓

3 次自动重试 + 截图对比 + 智能重定位

💡 核心技术亮点

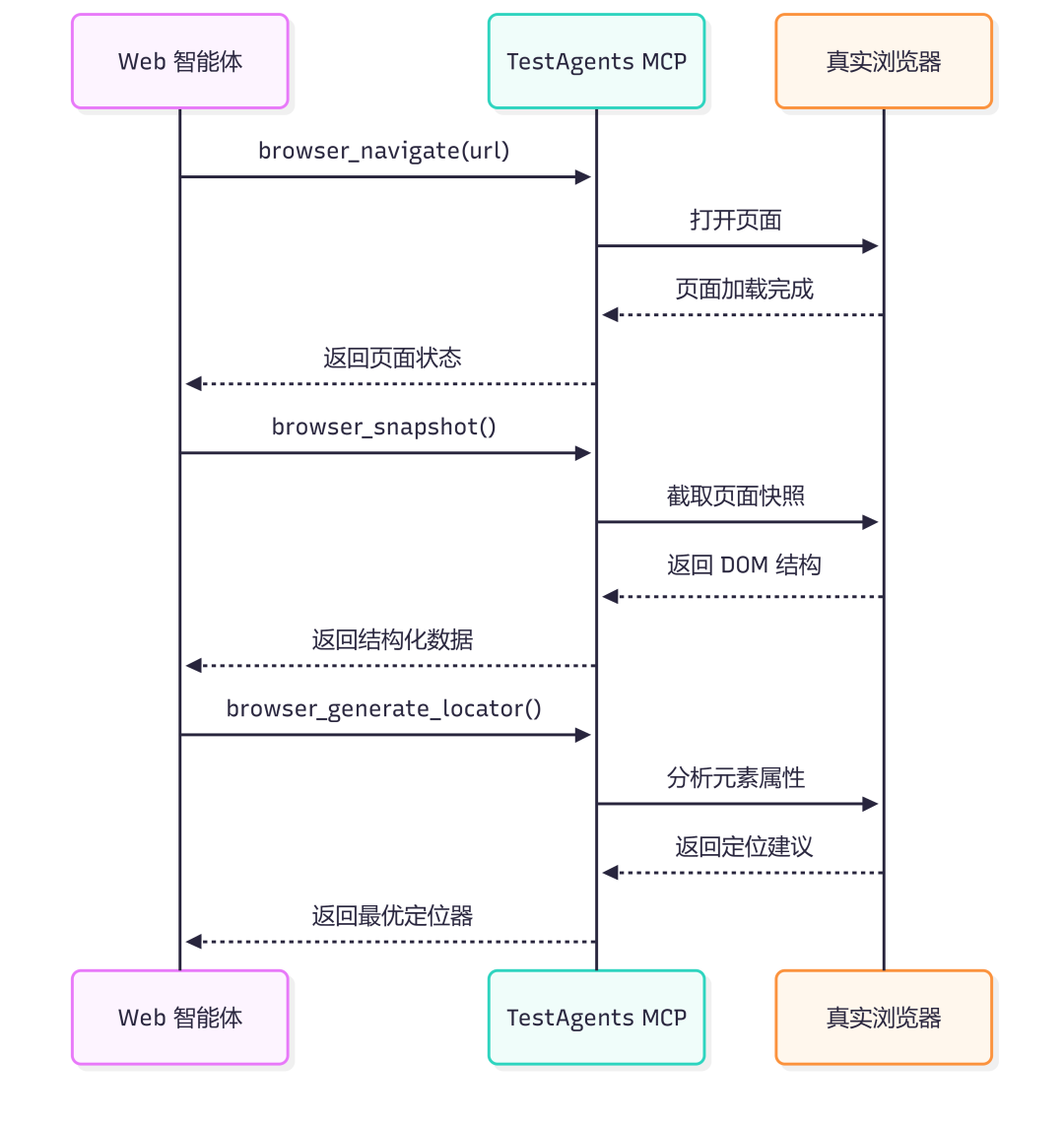

🔥 TestAgents MCP 实时浏览器控制

🔥 定位器自愈系统(3 级修复策略)

🛡️ 工具错误隔离机制

# 传统方式:一个工具失败,整个 Agent 崩溃

# 我们的方案:错误隔离,智能降级

@tool_error_handler

async def browser_click(selector):

try:

return await page.click(selector)

except ElementNotFound:

# 不中断流程,返回结构化错误

return {

"success": False,

"error_type": "LOCATOR_FAILED",

"suggestions": generate_alternatives(selector)

}

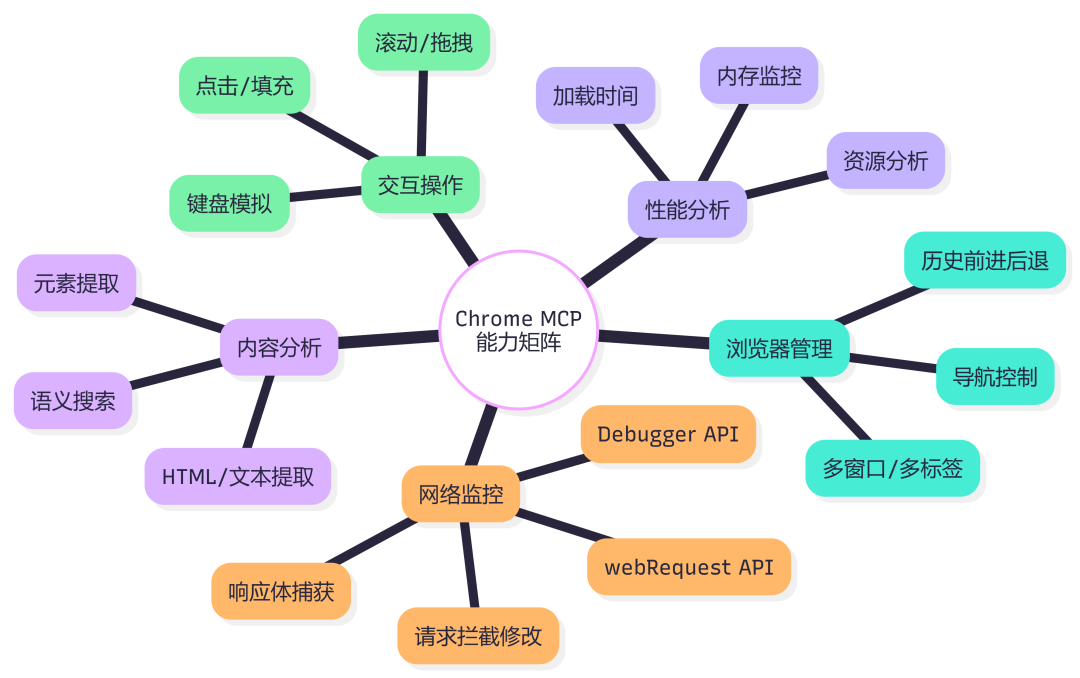

3️⃣ Chrome 智能体 —— 全链路监控专家

🎯 为什么需要它?

普通 Web 测试:只验证页面显示 ✅

Chrome 智能体:同时监控网络请求 ✅

分析前端性能 ✅

验证 API 响应 ✅

捕获控制台日志 ✅

💡 核心技术亮点

🔥 Just-Chrome-MCP 深度集成

🔥 双模式网络监控

📊 典型应用场景

场景: 用户下单流程验证

步骤:

1. 导航到商品页面

2. 点击"立即购买"

3. 填写订单信息

4. 提交订单

验证点:

UI: 页面跳转正确,提示信息准确

API:

- 创建订单接口返回 201

- 订单状态为 "pending"

- 响应时间 < 500ms

数据:

- 数据库订单表新增记录

- 库存扣减正确

4️⃣ 用例生成智能体 —— 需求理解专家

🎯 解决什么痛点?

传统方式:

需求文档 100 页 → 人工阅读 2 天 → 编写用例 3 天 → 评审修改 1 天

↓

人力成本高,质量不稳定

我们的方案:

需求文档 100 页 → AI 解析 5 分钟 → 生成用例 10 分钟 → 人工确认 20 分钟

↓

效率提升 10 倍,质量标准化

💡 核心技术亮点

🔥JustAskLLM 智能文档解析

🔥 RAG 增强生成(SSE 实时检索)

# 生成流程

用户输入需求名称

↓

RAG 检索(SSE 实时流)

├── 历史相似需求

├── 业务规则文档

├── 接口定义

└── 缺陷记录

↓

LLM 融合生成

├── 测试点提取

├── 边界值分析

└── 异常场景设计

↓

双格式输出

├── 标准用例(步骤+预期)

└── BDD 用例(Given/When/Then)

📊 输出示例

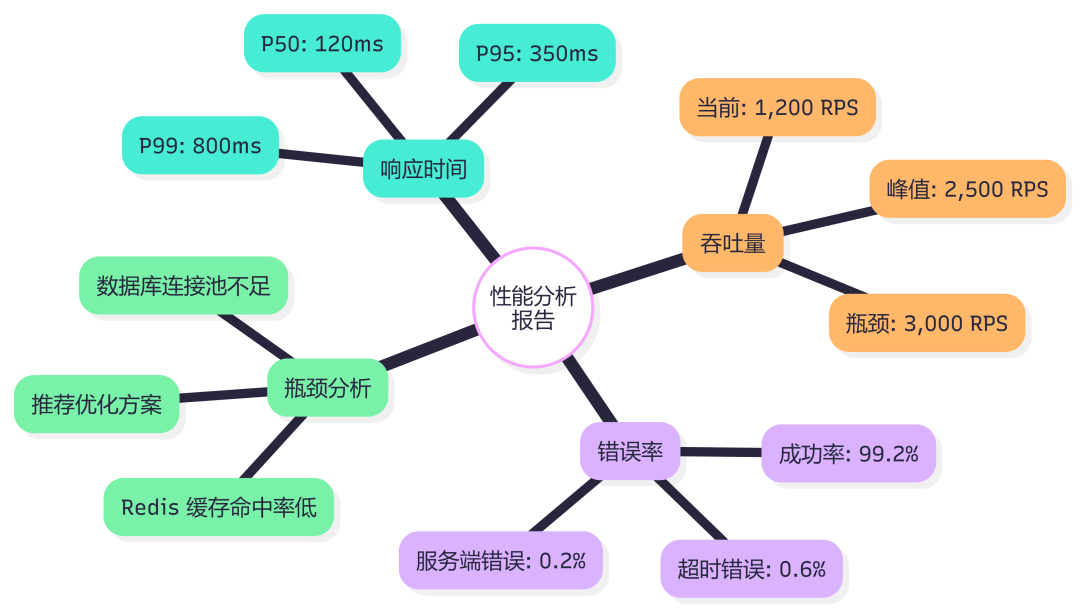

5️⃣ 性能测试智能体 —— 压测编排专家

🎯 解决什么痛点?

传统性能测试:

JMeter 配置复杂 → 脚本编写费时 → 结果分析困难 → 瓶颈定位模糊

我们的方案:

自然语言描述场景 → AI 生成配置 → 自动执行 → 智能分析报告

💡 核心技术亮点

🔥 Artillery.io 现代压测引擎

# AI 生成的压测配置示例

config:

target: 'https://api.example.com'

phases:

# 渐进式预热(避免冷启动)

- duration: 120

arrivalRate: 10

name: "Warm up"

# 正常负载

- duration: 300

arrivalRate: 50

name: "Normal load"

# 峰值冲击

- duration: 60

arrivalRate: 200

name: "Peak spike"

# 逐步降载

- duration: 120

arrivalRate: 20

name: "Cool down"

scenarios:

- name: "用户下单流程"

weight: 70

flow:

- post:

url: "/orders"

json:

productId: "{{ $randomProductId }}"

quantity: "{{ $randomInt(1, 5) }}"

- think: 2

- get:

url: "/orders/{{ orderId }}"

🔥 多维度性能分析

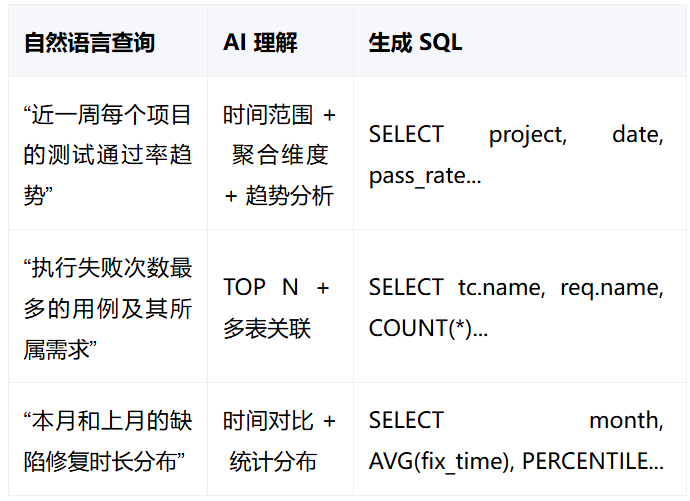

6️⃣ Text2SQL 智能体 —— 数据洞察专家

🎯 解决什么痛点?

测试经理:"我想知道最近一周哪些接口的失败率最高"

数据分析师:"给我 2 天,我写 SQL 查一下"

我们的方案:

测试经理 → AI 智能体 → 20 秒后得到答案 + 可视化图表

💡 核心技术亮点

🔥 Schema 自动理解

🔥 查询意图理解

7️⃣ 缺陷分析智能体 —— 质量洞察专家

🎯 解决什么痛点?

传统方式:

缺陷记录 1000+ 条 → 人工分类统计 → 制作报表 → 发现规律

↓

耗时长,容易遗漏关联性

我们的方案:

缺陷数据 → AI 自动聚类分析 → 识别高频模式 → 预测风险区域

↓

发现人眼看不到的关联规律

💡 核心技术亮点

🔥 缺陷智能聚类分析

📊 分析维度

Skills 技能体系 —— 智能体的"专业知识库"

🎯 什么是 Skills?

传统 Agent:所有知识写在 Prompt 里

↓

Token 消耗大,上下文易超限

我们的 Skills 体系:

按需加载,分层存储

↓

节省 Token,知识结构化

💡 Skills 技术架构

🔥 核心 Skills 详解

healer skill —— 自动修复专家

能力矩阵:

错误类型识别:

- 401/403: 认证失败 → Token 刷新策略

- 404: 端点变更 → URL 自动更新

- 断言失败: 响应结构变化 → 动态适配

- 超时: 网络延迟 → 重试机制

修复策略:

- L1: 配置更新(Base URL、Token)

- L2: 选择器重定位

- L3: 断言动态化

- L4: 测试数据更新

工作流程:

1. 执行测试 → 识别失败

2. 错误分类 → 匹配策略

3. 生成修复 → 应用修改

4. 重新执行 → 验证结果

5. 保存修复 → 更新脚本

explorer skill —— 页面探索专家

探索能力:

结构分析:

- DOM 树解析

- 交互元素识别

- 表单字段提取

- 导航链路映射

动态行为:

- 事件监听器检测

- AJAX 请求监控

- 状态变化追踪

- 异步加载识别

输出格式:

- 元素定位器推荐(按稳定性排序)

- 测试场景建议

- 高风险区域标注

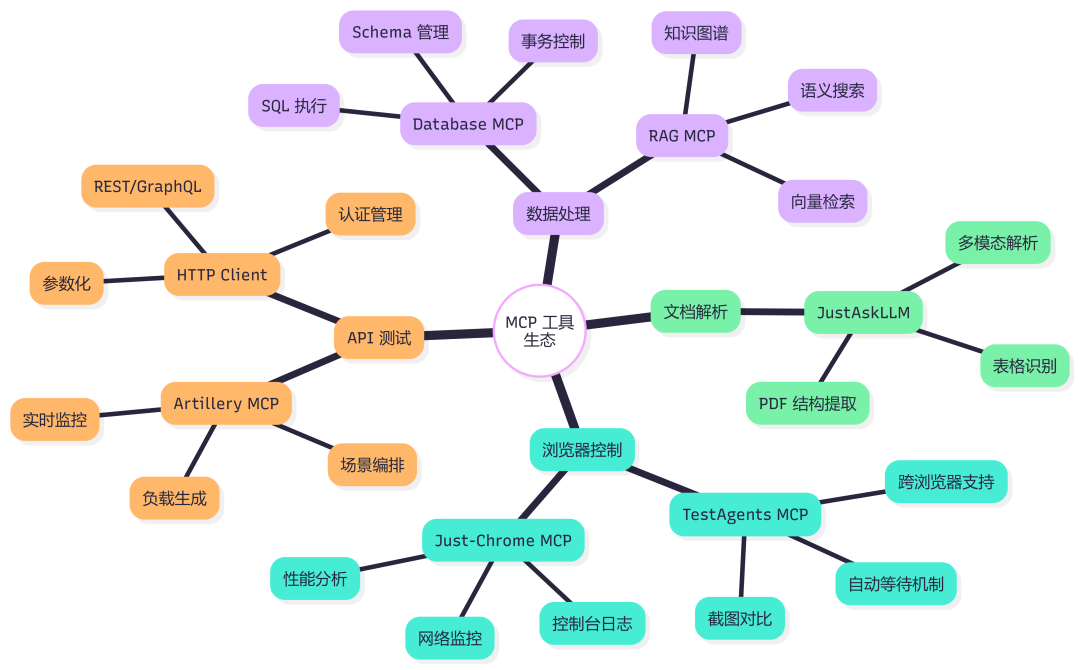

MCP 工具生态 —— 标准化工具接入

💡 MCP 技术亮点

🔥 Tool Registry 工具注册中心

// 自动发现与注册

class ToolRegistry {

// 递归扫描工具目录

async discoverTools(toolsDir) {

const tools = await this._scanDirectory(toolsDir);

for (const tool of tools) {

await this.registerTool(tool);

}

}

// 特性开关控制

_applyFeatureFlags() {

const enabledTools = this.tools.filter(tool =>

this.config.isFeatureEnabled(tool.category)

);

return enabledTools;

}

// 统一执行接口

async executeTool(name, parameters) {

const tool = this.getTool(name);

return await tool.run(parameters);

}

}

🔥 多传输协议支持

📊 MCP 工具矩阵

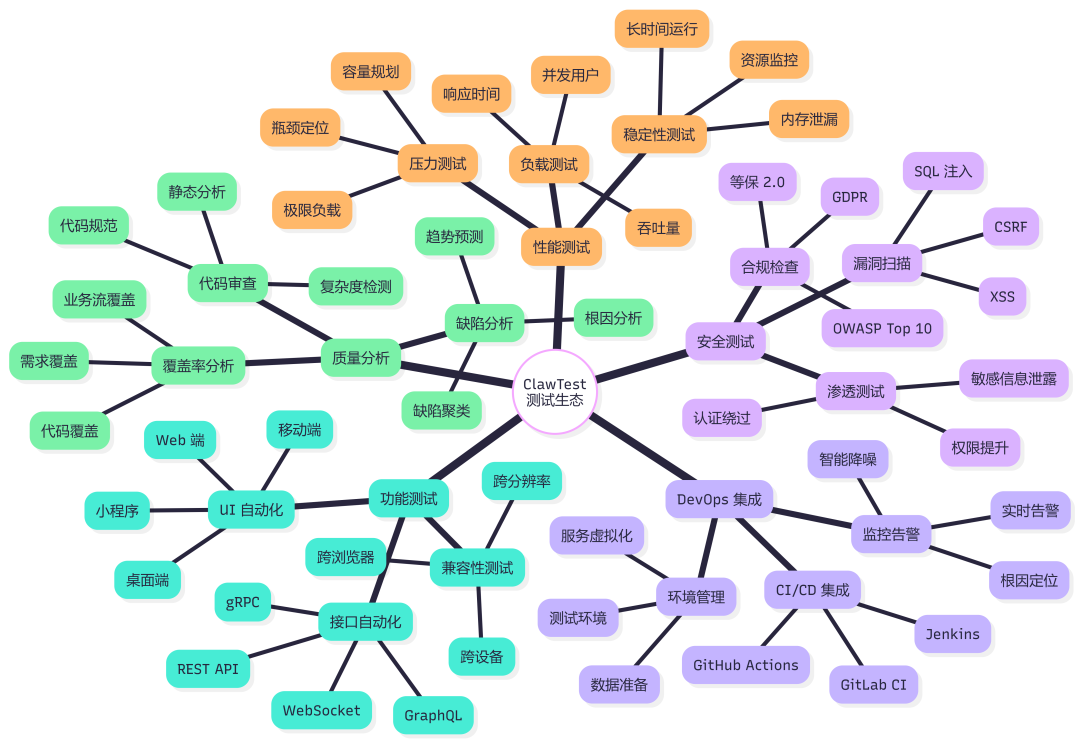

ClawTest —— 软件测试领域的万能 AI 助手框架

本期实现部分功能

🎯 受 OpenClaw 启发,专为测试领域打造

OpenClaw(https://github.com/openclaw/openclaw)是一个开源的个人 AI 助手框架,支持多渠道接入(钉钉、飞书等)。我们从中汲取灵感,打造了 ClawTest —— 一个专为软件测试领域设计的万能 AI 助手框架。

💡 核心理念

通用框架 + 领域插件 + 多渠道接入 = 测试人员的随身 AI 助手

ClawTest 让每个人都能用配置文件 + 自然语言,快速构建自己的测试智能体架构设计

测试生态全覆盖

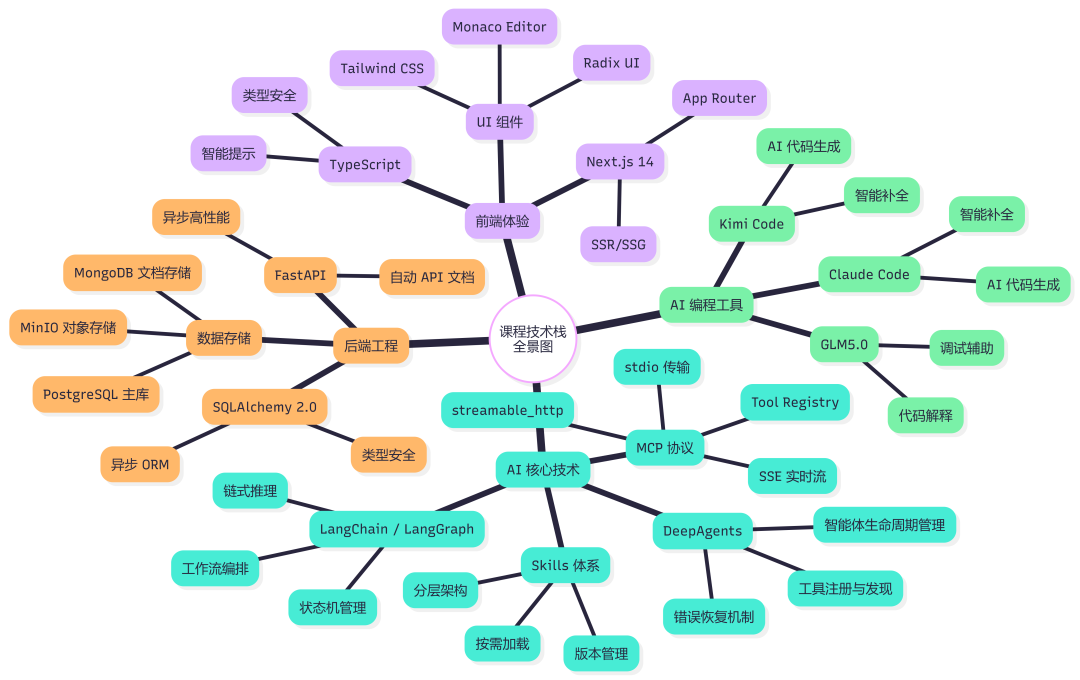

技术栈全景

项目部分功能效果展示

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-02,如有侵权请联系 cloudcommunity@tencent.com 删除

本文分享自 AllTests软件测试 微信公众号,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文参与 腾讯云自媒体同步曝光计划 ,欢迎热爱写作的你一起参与!

评论

登录后参与评论

推荐阅读

目录