NVIDIA开源SONIC,让人形机器人控制实现规模化通用

NVIDIA开源SONIC,让人形机器人控制实现规模化通用

GPUS Lady

发布于 2026-03-02 21:09:14

发布于 2026-03-02 21:09:14

正值马年新春佳节,众人仍沉浸在新年的喜庆氛围之中,NVIDIA 重磅开源 SONIC 全身体控管线,为人形机器人领域送上了一份极具分量的技术大礼。这一成果不仅为拟人机器人的真实世界运动学习打造了高效落地路径,更向整个机器人社区开放了一套可规模化的全身体控与遥操作基础模型。SONIC 的开源,让开发者得以直接依托人类真实运动数据实现人形机器人的快速训练,大幅提升机器人跨任务泛化能力,一举打破其实现全身自主控制的多项核心技术壁垒,更有效缩短了人形机器人从实验室演示到具备真实世界作业能力的落地周期,为该领域的规模化研发与场景落地筑牢了关键技术根基。本文将以科普视角深析 SONIC 的核心架构、算法设计与工程实现,解读其让人形机器人运动追踪实现规模化的技术逻辑与核心价值。

论文地址:https://nvlabs.github.io/GEAR-SONIC/static/pdf/sonic_paper.pdf

一、核心逻辑起点:为何运动追踪是人形控制的最优解?

传统强化学习做人形控制,始终绕不开规模化瓶颈:为走路、跑步、舞蹈等每个技能单独设计奖励函数并独立训练,带来两个致命问题。一是奖励函数的局部性,为 “走路” 精调的学习信号对 “跳舞” 毫无意义,不同技能无法共享梯度;二是 “过训练灾难”,奖励函数的非通用性导致训练时间越长,机器人运动性能反而下降。这意味着传统方法的上限由目标函数决定,而非算力或算法优化。

运动追踪则完美绕开这两大矛盾,成为 SONIC 的技术逻辑根基。它的核心目标是让机器人实时跟随参考运动序列,奖励仅为当前状态与参考状态的误差,这个目标对所有动作类型完全一致,无需针对具体行为做工程化设计。更重要的是,运动追踪能将 AMASS、LaFAN 等人类运动捕捉(MoCap)数据集,转化为可无限扩展的监督信号 —— 这类数据天然覆盖人类行为的广度,收集成本远低于机器人实操数据,为规模化训练提供了数据基础。

SONIC 所有的架构与算法决策,均围绕运动追踪的这一核心优势展开,最终实现了 “一个模型适配所有运动类型” 的通用人形控制。

二、通用控制策略架构:统一异构输入,实现跨模态对齐

人形控制的一大工程难题是输入格式异构:VR 手柄输出 SE (3) 位姿、人体视频输出 SMPL 格式 3D 关节位置、游戏手柄输出速度和方向向量。SONIC 通过 “三路专用编码器 + 共享量化潜空间 + 双解码器” 的架构,实现了所有输入的统一表示与处理,这是其能适配多场景的核心技术设计。

2.1 三种运动命令的统一编码设计

SONIC 定义了机器人运动gr、人体运动gh、混合运动gm三种运动命令类型,分别对应机器人规划输出、VR / 视频人体姿态、VR 三点遥操作的稀疏关键点 + 机器人下半身运动,并用结构相同、处理逻辑适配的三个专用编码器Er、Eh、Em处理(均为 MLP,隐层 [2048, 1024, 512, 512])。

编码器的核心设计是多帧预视:均编码未来 10 帧(Fr=Fh=Fm=10),仅采样间隔不同 —— 机器人 / 混合编码器用Δt=0.1s(稀疏预视),人体编码器用Δt=0.02s(密集预视,匹配 50Hz MoCap 采样率)。多帧预视让机器人的控制策略具备 “预期性”,而非单纯的反应式动作,这是实现自然运动生成的关键。

2.2 通用 Token:跨模态对齐的核心载体

三个编码器的输出会汇聚到同一个潜空间,再通过FSQ(有限标量量化)转化为通用 Tokenz。相比传统 VQ-VAE,FSQ 对每个维度独立做有限标量量化,既避免了码本坍缩问题,又无需调节 commitment loss 超参数,大幅提升了训练稳定性。

通用 Token 随后分叉至两个解码器,各司其职实现控制与辅助监督:

机器人控制解码器Dc:输出 29 维对角高斯分布,采样后得到目标关节角度,其 MLP 深度达到 [4096, 4096, 2048, 2048, 1024, 1024, 512, 512],是模型参数量从 1.2M 扩展到 42M 的核心原因;

机器人运动解码器Dr:重建机器人参考运动,提供辅助监督,同时充当隐式的 “人→机器人” 运动重定向模块,无需显式骨骼映射规则。

2.3 奖励函数:有界设计保障运动自然性

SONIC 的奖励函数设计兼顾追踪精度与运动自然性,公式为rt=R(stp,stg)+P(stp,at),由追踪奖励和惩罚项两部分构成,核心是让奖励值有界在 (0,1],避免策略为追求精度牺牲运动合理性。

追踪奖励覆盖五个维度,均采用负平方误差的指数形式(高斯核形状),各维度的容差参数与权重明确:根节点朝向(σ=0.4rad,权重 0.5)、全身关节相对位置(σ=0.3m,权重 1.0)、全身关节相对朝向(σ=0.4rad,权重 1.0)、全身关节线速度(σ=1.0m/s,权重 1.0)、全身关节角速度(σ=πrad/s,权重 1.0)。

两处关键设计让运动更贴合人类感知:一是不单独设计根节点位置追踪项,通过全身关节相对位置间接约束,避免机器人为精准跟随轨迹牺牲自然步态;二是速度 / 角速度的追踪权重与位置一致,利用 “人眼对运动速度极其敏感” 的特点,保证运动 “体感正确”。

惩罚项则针对工程落地问题设计:动作变化率惩罚(抑制机器人抖动)、关节限位惩罚(-10.0 硬约束,防止关节超量程)、非预期接触惩罚(禁止踝关节 / 腕关节外的身体部位接触,保证运动安全性)。

三、训练目标:四大损失协同,解决跨形态迁移核心难题

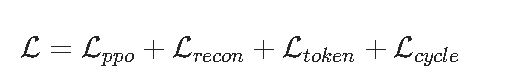

跨形态迁移(将人类运动转化为适配机器人运动学结构的动作)是人形控制的核心难点,SONIC 通过四个损失函数的分层协同,构建了从输出层到语义层的约束体系,让人类与机器人的运动表示统一到同一个潜空间,总损失函数为:

其中各损失的分工明确,且相互配合形成闭环:

Lppo(PPO 强化学习损失):唯一与物理仿真环境交互的损失项,负责让策略在物理世界中产生有效的控制信号,保证机器人动作的物理可行性;

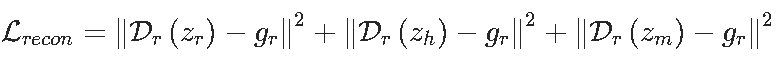

Lrecon(重建损失):公式为

核心是让人体运动 / 混合运动的编码经解码器后,能重建出机器人运动,实现端到端的运动重定向;

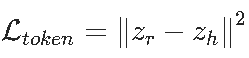

Ltoken(Token 对齐损失):公式为

在 Token 层面拉近机器人运动与人体运动的表示,强制相同语义的运动在潜空间占据相近位置,是跨形态学习的核心约束;

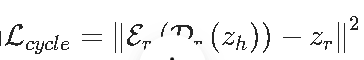

Lcycle(循环一致性损失):公式为

实现 “人体运动→编码→机器人运动解码→重新编码→匹配原始机器人 Token” 的闭环,保证 “人→机器人” 运动映射的可逆性,避免形态差异导致的运动信息损失。

为了让训练更稳定、效率更高,SONIC 还设计了基于失败率的自适应课程采样:将数据集按 1 秒划分,记录每个片段的失败率并截断到

采样概率为

90% 的均匀采样保证覆盖全分布,10% 的倾斜采样聚焦难点片段,既避免遗忘简单运动,又加速瓶颈问题收敛。

四、生成式运动规划器:从 “被动追踪” 到 “主动交互” 的桥梁

纯粹的运动追踪是 “给什么跟什么” 的被动模式,而实际人形控制需要机器人根据用户意图做出实时交互反应。SONIC 的生成式运动规划器就是连接用户意图与底层追踪策略的关键模块,核心是将用户指令转化为物理上合法的短时参考运动序列。

4.1 隐空间掩码 Token 预测:实现自然运动填充

规划器本质是隐空间中的掩码 Token 预测模型,核心解决运动序列的 “中间填充” 问题,其设计有两大亮点:

运动表示方式:采用骨盆相对关节位置 + 全局关节旋转,避开了蹲伏、跪地等姿态中 “朝向” 的概念歧义,保证运动一致性;

渐进式生成:先将连续运动 4 倍下采样编码为隐向量序列,再以起始 / 目标关键帧为约束,迭代预测掩码 Token,推理时按余弦调度逐步揭开(第 L 次迭代揭开比例为

),优先确认置信度最高的位置,避免单次预测的全局不一致性。

4.2 临界阻尼弹簧模型:让根轨迹收敛更稳定

用户给出速度 / 目标位置指令后,系统通过临界阻尼弹簧模型生成合理的根节点轨迹,公式为:

模型分别作用于骨盆 x/y 轴位置和投影朝向角,阻尼系数取c=5ln2和c=20ln2(朝向阻尼更强,响应更快),临界阻尼的选择让系统无超调收敛到目标,避免 “急刹车反向” 等无效指令对规划器的冲击。值得注意的是,该模型是工程鲁棒性设计,而非算法必需,规划器自身的插值能力已能应对大多数场景。

4.3 极简关键帧规范:降低新技能开发门槛

规划器的工程设计大幅降低了落地成本:导航控制只需从对应风格的运动片段中随机选段放置在目标轨迹上,蹲伏、跪地等姿态仅需一个动作片段,规划器就能通过可变长度生成和鲁棒插值,生成自然的过渡运动,无需为新技能做复杂的关键帧设计。

五、GENMO 模型:多模态运动生成的统一解决方案

SONIC 通过GENMO 扩散模型实现了视频、文本、音乐三种模态的运动生成,并将所有模态输入接入通用 Token 接口,让机器人能响应多类型的人类指令,其核心思路是将 “动作估计” 重新定义为 “约束生成”—— 不再单独做 “视频帧→人体姿态” 的判别任务,而是生成完整运动轨迹,让有视频观测的帧与观测吻合,无观测帧由生成先验填充。

GENMO 的架构由三部分组成:模态专用编码器(将文本 token、音频频谱、视频 2D/3D 关键点编码为时序特征)、时序 Transformer(通过 cross-attention 融合多模态条件)、方差保持扩散运动先验(从高斯噪声去噪为运动序列)。

训练时融合两类目标:一是无条件 / 弱条件下的标准扩散损失,学习广泛的运动先验;二是有观测时的重建约束损失,保证生成结果与观测精准对齐。通过随机丢弃模态的训练方式,让网络学会处理部分、异步的输入信息,无需设计复杂的分支逻辑。

为实现低延迟在线推理,GENMO 采用带重叠的滑动窗口设计:相邻窗口的重叠部分在去噪时强制覆写为前一窗口的输出,保证窗口间运动的平滑过渡,这也是将离线生成模型适配为实时系统的经典工程手段。

六、规模化实验与工程部署:顶尖性能与高实时性的双重保障

SONIC 的技术价值最终落地于极致的实验性能和工程化的部署架构,通过三轴验证、基线对比证明了规模化能力,又通过分频多进程架构保证了实际部署的实时性与稳定性。

6.1 规模化实验:数据量是核心,算力并行度提效显著

SONIC 从数据量、模型大小、GPU 时长三个维度做了三轴规模化验证,核心结论为:数据量提升的收益最显著,算力并行度通过降低梯度估计方差进一步提效。当数据量从 0.4M 帧增至 100M 帧,机器人运动的 MPJPE(平均关节位置误差)从 49mm 降至 36mm,成功率接近 99%;而 GPU 并行度从 8 提升至 128 时,相同训练步数下的渐近性能显著提升,128 GPU 搭配 4096 个并行环境,能实现 50 万个实时仿真环境的训练,达到语言模型级别的规模效应。

在 MuJoCo 仿真器的基线对比中,SONIC 展现出碾压性优势:在 1602 条 AMASS 测试轨迹上,SONIC零样本泛化实现 99.6% 成功率、42.7mm MPJPE,远超 Any2Track(58.3%/202.3mm)、BeyondMimic(94.3%/57.4mm)等方法;而在真实世界部署中,50 条多样化轨迹实现 100% 成功率,无一次失败。

6.2 分频多进程架构:保证实时性与鲁棒性

SONIC 的部署架构充分考虑了实时控制系统的需求,将四个进程独立运行并做频率分层,各进程各司其职且延迟可控:

500Hz:关节 PD 指令发布,独立推送目标关节角度,保证执行的时序确定性;

50Hz:策略主控制环,TensorRT+CUDA Graph 加速后单次前向仅 1-2ms,生成 29 个目标关节角度;

100Hz:用户输入采集,独立于策略,避免指令延迟随策略负载波动;

10Hz:运动规划器,Jetson Orin GPU 上单次推理 12ms,生成 0.8-2.4s 参考运动序列。

进程间采用 “最新数据优先” 原则,读取其他进程输出时始终取最新快照,以轻微的数据陈旧换取系统无背压、无级联延迟,而编码器 - 解码器的解耦设计,让手柄、VR、视频等输入模式的切换无需停机,大幅提升部署灵活性。

七、核心技术价值与未来方向

7.1 SONIC 的核心技术价值

SONIC 的学术与工程价值,本质是为人形机器人控制提供了规模化的通用解决方案,其核心贡献可归结为 1 个核心洞见 + 2 个技术突破:

核心洞见:运动追踪是人形控制的天然 “预训练任务”,其统一目标、无限数据、任务无关先验的特性,与语言模型的 next-token prediction 具有结构上的相似性,为规模化训练奠定了基础;

技术突破 1:通过 PPO + 重建 + Token 对齐 + 循环一致性四大损失的协同,实现跨形态潜空间统一,让同一套策略无需蒸馏即可接受机器人、人体、混合运动等异构输入;

技术突破 2:基于掩码 Token 预测的生成式运动规划器,弥合了高层用户意图与底层追踪策略的语义鸿沟,让机器人从 “被动追踪” 升级为 “主动交互”。

对于具身智能研究而言,SONIC 的设计哲学更具启发性:放弃为单个技能设计奖励函数,找到能吸纳所有行为数据的统一目标,并将其做到极致,这是实现技术规模化的关键。

7.2 局限性与未来方向

SONIC 目前仍存在部分待优化的局限性:未形式化处理安全约束、顺应性控制和能量效率;对真实部署中噪声输入的鲁棒性缺乏量化分析;VLA 集成仍处于概念验证阶段,泛化能力待验证;规划器、编码器、策略独立训练存在模态间隙。

未来的核心研究方向将围绕联合训练、精度提升、工程落地展开:探索 FSQ 量化精度对跨模态对齐的影响,解决模态间隙问题;形式化设计安全与能量约束,提升真实环境的鲁棒性;扩大 VLA 集成的训练与评估规模,进一步降低新技能的开发与部署门槛。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录