智能体|Agent 自动化评测系统构建

Agent应用最难的是建立信任,而信任的关键,正是对Agent能力的精准度量。缺乏可量化指标和系统评测体系,Agent的能力就无从验证,也无法判断其在真实场景中的表现。本文围绕如何搭建可落地的评测体系,跳出盲目迭代的问题,围绕三个部分展开:

1)建立评测观念,评测体系认知和组成部分。 2)业务实操,评测数据集构建和分类体系。 3)以深度研究评测为例,介绍 RACE 和 FACT 评测框架。

1,评估的必要性

辛苦上线后的Agent,用户反馈说体验变差了!团队的天都塌了。如果没有自动化的评测,就无法区分真正的退化和噪声。

问题分析:

- • 在业务开发中忽视了benchmark的重要性,上线前缺少严格的评测。

- • 被动的“自我感觉良好”,而没有主动的规避问题,导致出现故障越改越糟。

- • 盲目调试,无法自动测试更改对数百种场景的影响,也无法衡量改进程度。

避免“盲飞”,让进步看得见!

Leader 灵魂拷问:现在项目进度怎样了?

一种满意回复:“目前自建Agent在核心评测集上的准确率已从50%提升至70%,一次性通过率达到68%(原为 42%)。基于当前趋势,预计下周可稳定达到75%以上。同时,平均响应延迟下降15%,每轮推理成本降低23%。“

看得见的质量变化,把主观感受变成客观指标,避免盲目迭代,清晰区分“真实回归”与”随机波动“!

以上指标,都需要 Agent 评测集和自动化评测工具的支撑。Agent 执行任务,会进行多轮"工具调用+推理“循环,显而易见Agent 评估要复杂得多。

2,评分器&评测系统

评测器的定义:

Agent 能力评估体系中核心的判定工具或系统,用于依据预设标准、任务要求对 Agent 的执行结果 / 行为轨迹进行量化打分、有效性判定,最终输出 Agent 在对应任务上的能力表现结论。

Agent 评估通常组合三类评分器:基于代码的评分器、基于模型的评分器、以及人工评分。

- • 基于代码的评分器:字符串匹配、单元测试、静态分析。优点是快、便宜、客观、可复现;缺点是脆弱,对有效变体不够宽容,缺乏细微判断能力。

- • 基于模型的评分器:用LLM 做评委,基于评分标准打分、自然语言断言、成对比较等。优点是灵活、能处理开放式任务;缺点是非确定性、比代码贵、需要和人工校准。

- • 人工评分器:领域专家评审、众包判断、抽样检查。黄金标准,但贵、慢、难以规模化。

要根据实际的业务Agent进行组合和裁剪。Anthropic 建议:尽可能用确定性的评分器,必要时加LLM 评分器,人工评分器用来校准。

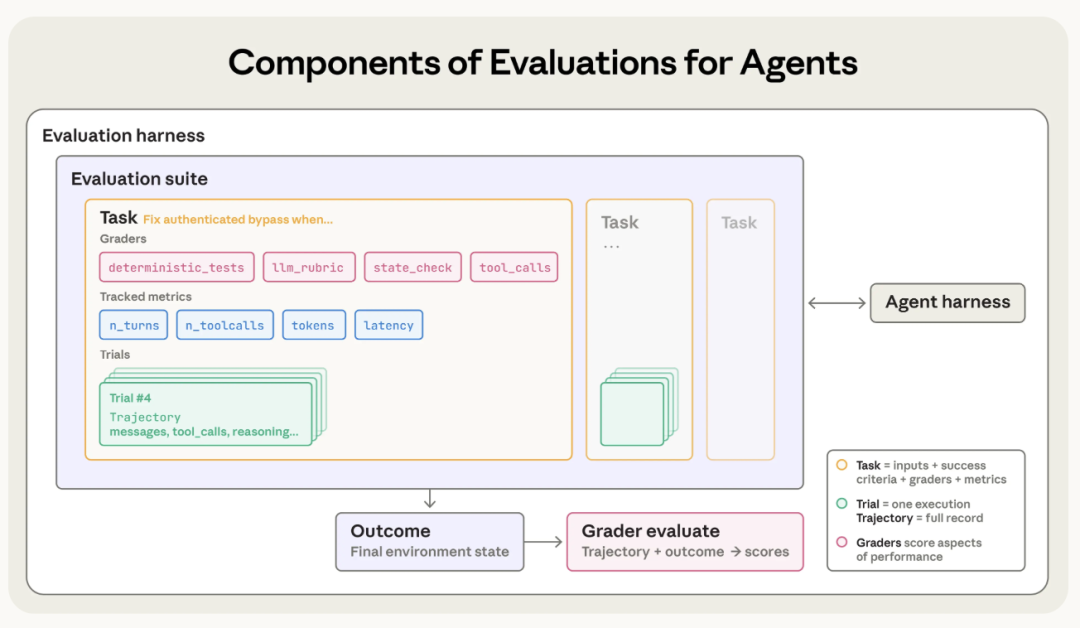

不管是那种的评估,一个评估系统组成部分有:

- • 任务是具明确输入与成功标准的测试项。

- • 试验为任务的单次执行,需多次以获稳定结果。

- • 评分器评估性能维度,记录文本完整保存试验轨迹,结果需以环境真实状态为准。

- • 评估框架统筹任务执行与评分,Agent框架支撑模型协同运行,评估套件则聚焦特定能力的多任务集合测评。

图1,评测系统组层元素。

当前大规模部署的 Agent 主要有四类:编码 Agent、研究 Agent、计算机操作 Agent、对话 Agent。下面以研究Agent 为代表,逐步探索建立一个适合自身业务的评测系统。

3,深度研究 Agent 测试集准备

深度研究Agent(Deep Research Agent DRA)定义:需要智能体执行多轮网络搜索、信息收集、分析处理并生成高质量报告的复杂问题。

显而易见的评估困难:

- • 其内部推理和信息检索过程缺乏透明度,最终生成的报告成为评估整体效果的主要依据。

- • 评估这些详尽研究报告的质量,本身就是一个开放性难题,因为很难为复杂的研究查询建立明确的“标准答案”或真实基准。

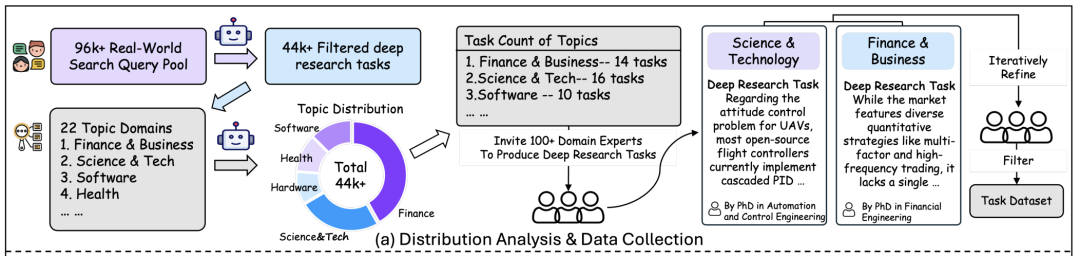

建立评估体系,评测集是第一步,以 DeepReaserch Bench 的数据收集和构建过程,提供思路。可先收集业务场景query,确定业务的主题意图分类体系,然后进行query的主题意图归类。

图2,评测集收集流程。

3.1,意图体系构建

收集目标数据集

DeepResearch Bench 收集了一个包含96万个原始用户查询的内部数据集,这些查询来源于用户与支持网络搜索功能的LLM聊天机器人的交互记录。

基于深度研究Agent的定义,使用大模型如,DeepSeek-V3 对用户的query数据进行过滤,识别出符合深度研究要求的问题查询,即query。最终筛选出4万个符合深度研究任务定义的查询,构成了研究数据集。

意图体系分类

对深度研究的query进行主题分类,采用WebOrganizer提出的主题分类体系,选定了22个不同的主题领域作为分类标准。随后使用DeepSeek-V3将这4万个查询query分别归入相应的主题领域。

3.2,基准任务收集

基于业务场景真实用户需求分布的指导,首先确定了DeepResearch Bench数据集中各主题领域的目标任务数量。考虑到运行DRAS及评估其结果需要消耗大量计算资源,所以将上述分布按比例压缩,最终形成了包含100个任务的数据集,其中包括50个中文任务和50个英文任务。这一压缩过程严格确保了基准测试保持与现实世界分布相同的主题平衡性。

拔尖任务

确定各主题领域的目标任务数量后,研究重点转向构建既具有高度挑战性又基于真实研究需求的研究任务。这一过程专门用于测试深度研究智能体能力的上限。

所有提交的任务都需经过研究团队的人工筛选,以验证其质量、清晰度、复杂性以及与深度研究定义的契合程度。这一严格的审核过程最终产生了构成 DeepResearch Bench 的100个高质量基准任务。

4,评估方法

测试数据集构建完成后,需要指定评测任务的维度和标准。重点关注两个核心维度,信息检索收集能力,以及最终报告的质量。为评估这两个不同维度,使用RACE和FACT两个相互补充的评估框架。RACE看报告整体质量,FACT看报告引用与事实准确性,形成完整且有连续性的评估体系。

4.1, RACE 评估框架

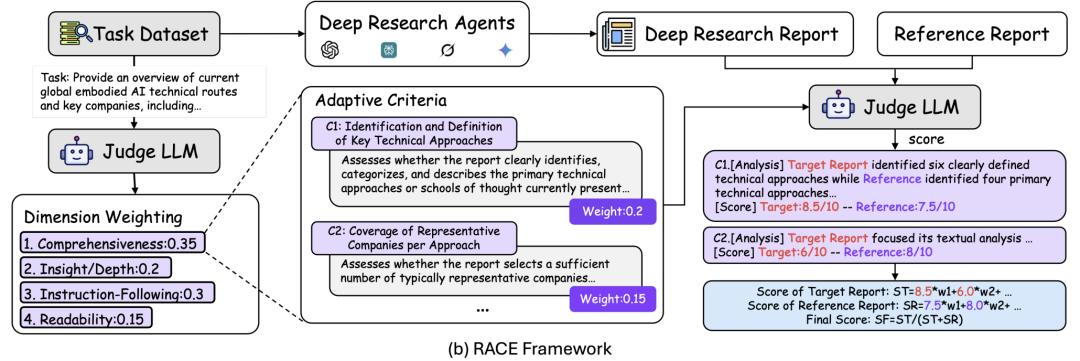

图3,RACE评估框架。

RACE是基于参考标准和自适应准则的动态加权评估框架,专门用于评估报告生成质量。该框架采用LLM-as-a-Judge方法。其首先动态生成针对特定任务的权重和评估标准,然后采用基于参考标准的评分方法,将待评估报告与高质量参考报告进行对比,最后计算相对分数来评估目标报告的质量,从而提供更具适应性和稳健性的评估。

基于领域专业知识建立了四个顶层相互独立的评估维度:全面性(COMP)、洞察力/深度(DEPTH)、指令遵循 (INST) 和可读性(READ)

三种策略:

- • 动态权重与自适应标准生成

- • 基于参考标准的评分

- • 总体分数计算

举例:

评估《Agent技术报告研究》质量。RACE框架核心流程(对应三种策略):

- • 设定4个维度权重,全面性35%、洞察力30%、指令遵循15%、可读性20%。

- • 对照参考标准,给待评估Agent技术报告逐维度打分,如全面性7分、洞察力8分、指令遵循10分、可读性9分,满分10分。

- • 按权重折算总分(7×35%+8×30%+10×15%+9×20%=8.05分)。

最后的结论是该Agent技术报告质量优良、符合参考标准。

RACE框架核心是“制定贴合任务的评分规则,对照参考样本打分,算总评分”,类比技术评审专家按评分细则、对照优质Agent技术报告,给待评估报告打分。

4.2, FACT 评估框架

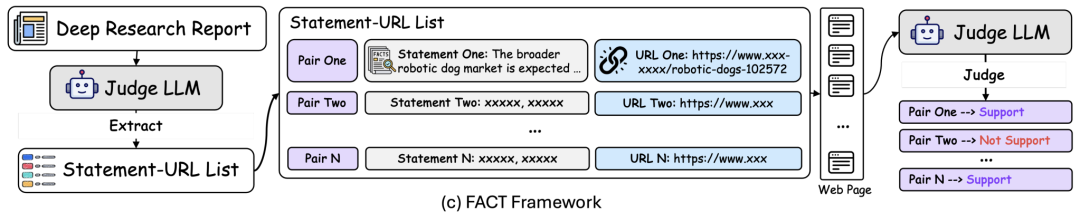

图4,FACT 评估框架。

FACT是事实丰富性和引用可信性评估框架,专注于评估信息检索和引用准确性。聚焦报告事实丰富性与引用可信性,通过验证引用有效性、计算核心指标,评估报告信息检索和引用的准确性与实用性。

细分维度:

- • 陈述-URL对提取与去重处理

- • 支持性判断

- • 引用指标计算

基于上述支持性判断结果,研究者计算两个核心评估指标。

- • 引用准确性(C.Acc.);用于衡量智能体引用的精确度,反映使用合适来源准确支撑陈述的能力。

- • 每任务平均有效引用数(E. Cit.);量化agent在每个任务中检索并呈现的有价值且可验证信息的平均数量。

举例:

假设《Agent技术报告研究》中包含10处核心陈述,每处陈述均标注对应引用URL。

FACT框架评估流程:

- • 从报告中提取10组“陈述-URL”对应对,去重后确认无重复引用、无效URL,最终保留9组有效“陈述-URL”对。

- • 逐一验证9组有效对应对,判断URL来源(如权威技术期刊、官方实验报告)是否能准确支撑对应陈述,最终确认7组为“有效支持”,2组为“无效支持”(URL来源非权威、无法支撑对应陈述)。

- • 引用指标计算:基于支持性判断结果,计算两个核心指标。

引用准确性(C.Acc.):有效支持数÷有效“陈述-URL”对数 = 7÷9≈77.8%,说明报告引用精确度较好,多数陈述能被合适来源准确支撑。

每任务平均有效引用数(E. Cit.):有效支持数÷评估任务数(本次任务为1个)= 7÷1=7,说明报告在本次任务中,检索并呈现的有价值、可验证信息数量充足。

5,Anthropic 评测建议

评测是Agent规模化迭代的加速器,轻松获取质量基准与回归影响,快速判断新模型是否值得切换、优势在哪、短板在哪。评测也是产品团队、工程团队、算法团队之间的沟通利器,轻松对齐Agent成功标准、边界条件和期望行为。

以下是Anthropic 来自业务实践后的建议总结。

- • 从真实场景提炼有明确判定标准的小样本任务,尽早启动评估

从真实失败案例、高频场景 中提取 20-50 个核心任务,不求完美但必须答案可重复、专家判断一致、有清晰通过 / 失败标准,小样本即可快速验证 Agent 能力,延迟启动会大幅增加后续评估与迭代难度。

- • 打造鲁棒可验证的评分体系,规避评估本身的 bug

一是环境稳定隔离、只评估结果不限制路径,为多环节任务设置部分得分以体现能力连续性;二是严格复查任务规格与评分逻辑,避免因数值精度、描述模糊、随机任务导致的误判,同时让评分具备防作弊能力;核心是通过读转录轨迹验证评分器有效性,区分 Agent 真失败与评分器误判有效解。

- • 建立动态迭代的评估体系,避免饱和度并让业务侧深度参与

一方面持续监控评估饱和度,淘汰 / 升级 100% 通过的评估项,确保评估能捕捉 Agent 复杂任务能力、提供有效改进信号;另一方面让产品、客户成功、销售等贴近产品需求与用户的人员贡献评估任务,以评测驱动开发,同时持续读轨迹、迭代评分器与任务库,让评估套件适配 Agent 能力的持续提升

以下开源框架可帮助业务快速搭建自己的评估体系:

Harbor、Promptfoo、Braintrust、LangSmith 和 Langfuse。

参考: arxiv:2506.11763 anthropic:demystifying-evals-for-ai-agents

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-08,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录