万字详解大模型应用发展:RAG、MCP、Agent的爆发之旅

万字详解大模型应用发展:RAG、MCP、Agent的爆发之旅

腾讯云开发者

发布于 2026-01-20 15:18:11

发布于 2026-01-20 15:18:11

关注腾讯云开发者,一手技术干货提前解锁👇

01

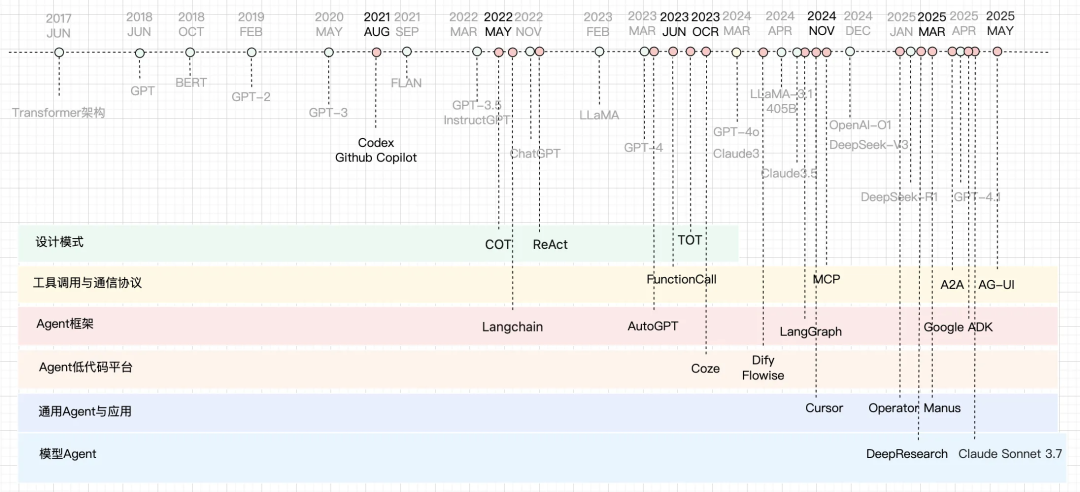

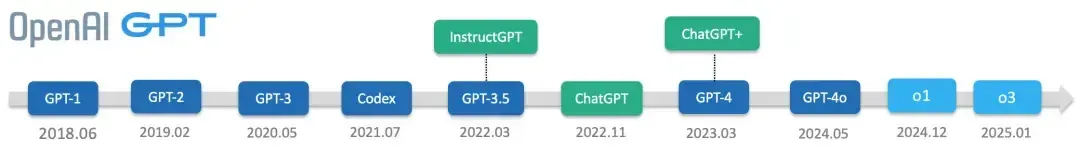

大语言模型发展历程摘要

大语言模型的发展历程:

- 2017年具有革命性的Transformer架构开始,解决了早期模型(诸如循环神经网络(RNN)和长短期记忆网络(LSTM))在处理长距离依赖和顺序处理时存在的困难性,通过自注意力机制重新定义了自然语言处理(NLP)。

- 2018-2020年,预训练Transformer模型时代,其特点是预训练模型的兴起以及对模型规模前所未有的关注。这一时期出现了两个具有影响力的模型家族:BERT和GPT,它们展示了大规模预训练和微调范式的强大力量。

- 18年谷歌推出BERT采用了双向训练方法,使其能够同时从两个方向捕捉上下文。通过生成深度的、上下文丰富的文本表示,BERT在文本分类、命名实体识别(NER)、情感分析等语言理解任务中表现出色。

- 通过自回归预训练专注于生成能力。通过使用Transformer的解码器,GPT模型作为用于文本生成的自回归语言模型表现出色。

- 2020年GPT-3的发布标志着语言模型规模扩展的一个转折点。它拥有惊人的1750亿个参数,突破了大规模预训练的可能性边界。它展示了卓越的少样本和零样本学习能力,在推理过程中只需极少甚至无需示例就能执行任务。GPT-3的生成能力扩展到创意写作、编码和复杂推理任务,展示了超大规模模型的潜力。

- 2021-2022年,训练后对齐,弥合人工智能与人类价值观的差距。这一时期专注于提高大语言模型与人类意图的一致性并减少幻觉,监督微调(SFT)和人类反馈强化学习(RLHF)等技术被用于解决模型与人类价值观、偏好和期望保持一致性以及模型 “幻觉”问题(大语言模型生成的内容存在事实上的错误,或者与输入提示相矛盾,所谓“一本正经胡说八道” )。

- 2022年,OpenAI推出的GPT-3.5,在训练和微调方面进行了改进,主要增强功能包括通过优化数据更好地遵循指令、减少幻觉(尽管未完全消除),以及使用更多样化、更新的数据集以生成更相关、更具上下文感知的响应。并在此基础上,推进对话式人工智能ChatGPT,专门为自然的多轮对话进行微调的开创性对话式人工智能模型,又被称为 “ChatGPT时刻”,它展示了对话式人工智能改变人机交互的潜力。

- 2023-2024年,多模态模型,连接文本、图像及更多,GPT-4V和GPT-4o这样的多模态大语言模型(MLLMs)通过将文本、图像、音频和视频集成到统一系统中。这些模型扩展了传统语言模型的能力,实现了更丰富的交互和更复杂的问题解决。

- 2023-2024年,开源和开放权重的人工智能模型势头渐起,Hugging Face这样的平台促进协作,更进一步使得大模型得以更广泛地应用。闭源模型和开放权重模型之间的差距稳步缩小,其中LLaMA3.1 - 405B模型具有里程碑意义,它首次缩小了与闭源模型的差距。

- 2024年,推理模型出现,受到认知心理学双过程理论的影响,从系统1思维(快速、直觉性)到系统2思维(慢速、分析性)的转变,这一时期开始强调提升模型推理能力,从简单的模式识别向更具逻辑性和结构化的思维过程迈进。OpenAI在2024年12月发布的o1系列模型,其将生成能力和推理能力相结合,创造出思维和行为更接近人类的模型的潜力。其关键特性是通过思维链(Chain of Thought,CoT)过程来增强推理能力,它能将复杂问题分解成更小、更易处理的步骤。

- 2025年,DeepSeekR1,高性价比推理模型。24年12月DeepSeek-V3发布,可与OpenAI的ChatGPT等顶级产品相媲美,但开发成本却低得多。该模型最多有6710亿个参数,其中370亿个为激活参数,它采用了混合专家(MoE)架构,将模型划分为用于数学和编码等任务的专门组件,以此减轻训练负担。DeepSeek-V3融入了工程优化,比如在管理键值缓存方面进行了改进,并进一步推进了混合专家方法。2025年1月下旬,DeepSeek发布的DeepSeek-R1-Zero和DeepSeek-R1引起更广泛关注,并迅速破圈,这两款模型展现出了卓越的推理能力,且训练成本极低。

02

大语言模型发展历程摘要模型应用发展历程

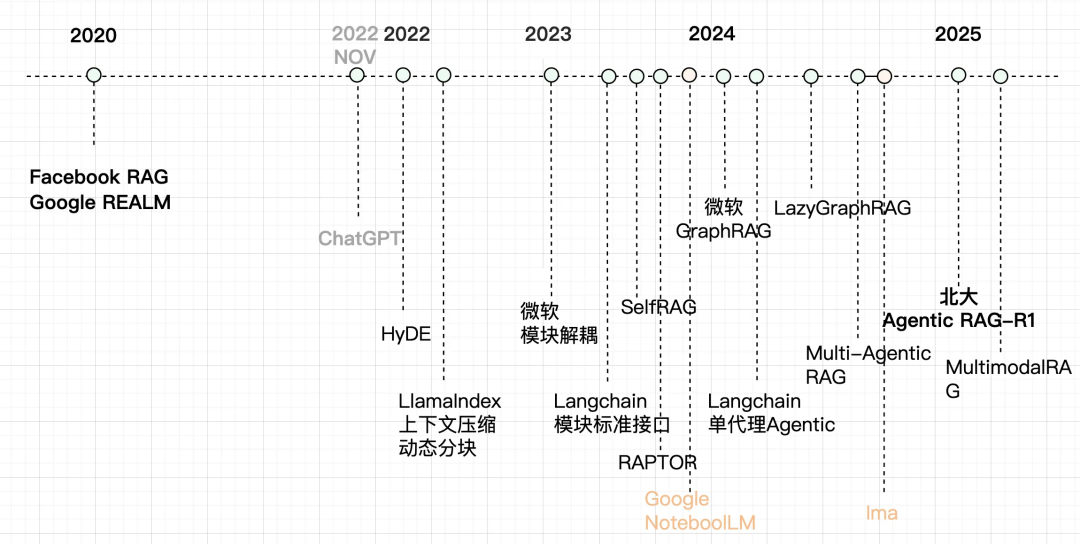

2.1 RAG知识库应用

RAG理论提出

在2020年之前,学术界已有将检索与生成结合的零星尝试,但尚未形成系统化的方法论。2020年,这一领域迎来了两个具有里程碑意义的工作:Facebook在论文Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks正式提出"RAG"概念并将其应用于知识密集型任务,同时Google的REALM通过在预训练阶段融入潜在知识检索器,显著提升了开放域问答的性能。

引入模型应用

2022年底ChatGPT发布后,迅速引爆大模型,然而在实际业务应用场景落地中,大模型所面临的问题,包括:

知识的局限性:模型的知识源于它的训练数据,而现有的主流大模型训练集都是基于现有的网络公开数据,对于一些实时性的、非公开的、离线的数据无法获取到,存在知识盲区;

幻觉问题:模型输出基于概率模型,存在知识边界感知不准确和因过度自信一本正经的胡说八道的情况,尤其在大模型自身不具备的某一方面的知识或者不擅长的场景该问题表现更明显;

数据安全性:对于企业来说,数据安全问题非常重要,如何保障自身私域数据的安全性是大模型应用中不得不面对的问题。

Agent代理应用中,知识库作为代理的LongMemory也是必不可少的一个基础设施。

快速发展

ChatGPT发布后,RAG研究更是进入了加速发展的黄金时期。在这个过程中,RAG技术逐渐从单一的检索-生成框架,演化为包含多跳推理、记忆增强和多模态等复杂功能的综合系统。

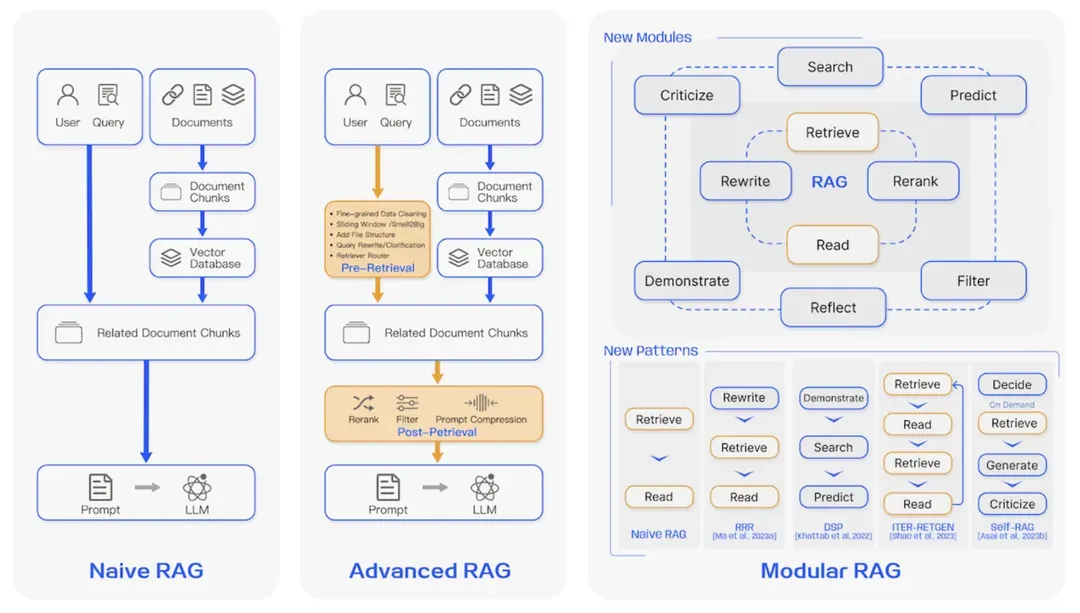

NaiveRAG

2020年10月,Meta团队在论文《Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks》中首次定义Naive RAG架构,确立了"索引-检索-生成"三阶段流程:

- 索引(Indexing):索引首先清理和提取各种格式的原始数据,如 PDF、 HTML、 Word 和 Markdown,然后将其转换为统一的纯文本格式。为了适应语言模型的上下文限制,文本被分割成更小的、可消化的块(chunk)。然后使用嵌入模型将块编码成向量表示,并存储在向量数据库中。这一步对于在随后的检索阶段实现高效的相似性搜索至关重要。

- 检索(Retrieval):在收到用户查询(Query)后,RAG 系统采用与索引阶段相同的编码模型将查询转换为向量表示,然后计算索引语料库中查询向量与块向量的相似性得分。该系统优先级和检索最高 k (Top-K)块,显示最大的相似性查询。这些块随后被用作 prompt 中的扩展上下文。

- 生成(Generation):提出的查询(Query)和选定的文档(Chunks)被合成为一个连贯的提示,大语言模型负责生成回复。

AdvancedRAG

Advanced RAG 的雏形源于对 Naive RAG(索引→检索→生成)的局限性突破。早期研究者发现单纯依赖向量检索存在 语义鸿沟 (如用户提问模糊或需多跳推理时检索失效)和 信息冗余 (检索结果重复或无关)等问题。为此,Meta、微软等团队开始探索全流程优化框架,提出 检索前预处理 、检索后精炼以及Embedding模型优化等方向:

关键性技术突破:

- 预索引优化

- 多粒度分块策略:引入滑动窗口分割、语义分块等策略,解决长文本切分导致的语义断裂问题(如将文档按段落、章节动态划分)

- 引入元数据:把元数据嵌入块中提升检索效率(标题、摘要、作者、时间、实体信息)

- 混合索引:结合 BM25关键词匹配 与 向量语义检索,平衡精确召回与语义理解能力。

- 假设性问题:让LLM为每个块生成一个问题,保存问题与文本块的映射关系,将这些问题存入向量数据库中。在检索时,先基于向量问题数据库进行查询搜索,找到相似问题后,然后在检索后路由到原始文本块,并将它们作为上下文发送给LLM以获得答案。这种方法通过查询与假设性问题之间更高的语义相似性,提高了搜索质量。

- HyDE(Hypothetical Document Embeddings):通过逆向逻辑方法,让LLM给定查询生成一个假设性回应,然后使用其向量和查询向量来提高搜索质量。

- 后索引优化:

- ReRank:重新排序以将最相关的信息重新定位到提示的边缘是一个简单的想法。

- Prompt Compression:重点在于压缩不相关的上下文,突出关键段落,并减少整体上下文长度。

- Embedding:

- Fine-tuning Embedding:微调的目的是增强检索内容和查询之间的相关性。通常,微调嵌入的方法分为在特定领域上下文中调整嵌入和优化检索步骤。特别是在处理进化或稀有术语的专业领域,这些定制的嵌入方法可以提高检索相关性。

- Dynamic Embedding:动态嵌入根据单词出现的上下文进行调整,不同于为每个单词使用单个向量的静态嵌入,理想情况下,嵌入应该包含尽可能多的上下文,以确保“healthy”的结果。

- 查询转换:

- 查询转换利用LLM作为推理引擎来修改用户输入,以提高检索质量。对于更复杂的用户查询,可以基于LLM将其进行子查询拆解,分别得到子查询的关联上下文信息后整合到一起提供给LLM生成初始复杂问题的最终答案。当涉及到多轮上下文对话中,如果利用历史对话补齐当前对话信息完整性,以实现更准确的信息检索同样涉及到查询转换。

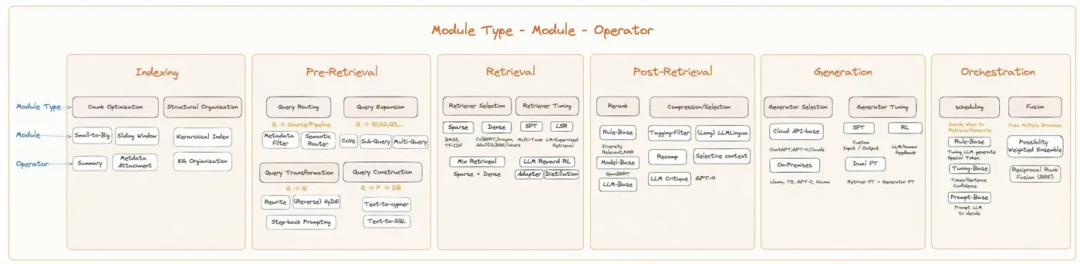

ModularRAG

Modular RAG是RAG范式的又一演变,强调灵活性、多样化和定制化。ModularRAG通过将检索和生成流程分解为独立、可重用的组件,实现了针对特定领域的优化和任务适应性。

Augmented Module

Augmented Process

技术特点:

- Modular RAG 将传统 RAG 系统的线性流程拆分为 独立可插拔的模块 (如检索器、预处理器、生成器等),每个模块专注于特定功能(如查询优化、混合检索、生成控制),支持像“乐高积木”一样自由组合。

- 动态流程编排能力:通过路由(Routing)、调度(Scheduling)和知识图谱融合机制,实现 多路径检索与智能决策。

- 混合检索策略与工具集成:支持 稀疏检索(BM25)与密集检索(向量模型)结合,并集成外部 API、数据库等工具。

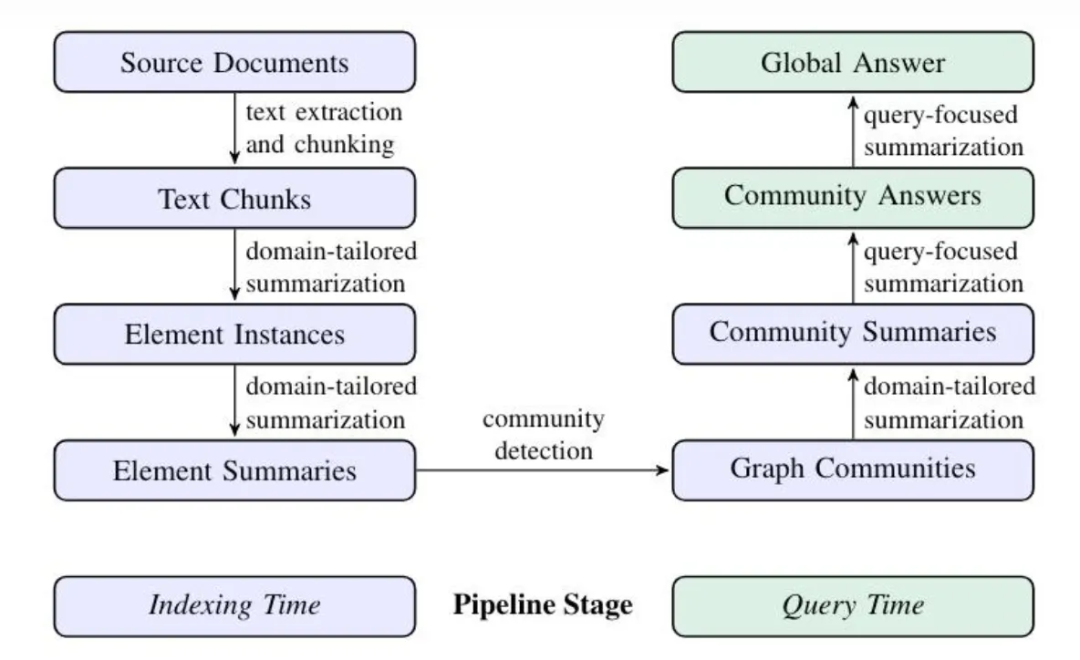

GraphRAG

Graph RAG 引入了知识图谱的概念,通过构建实体之间的关系网络,增强了对复杂知识的表示和检索能力。在索引阶段,Graph RAG 不仅提取文本中的实体和关系,还构建了知识图谱,将文档中的知识组织成一个结构化的网络;在查询阶段,利用知识图谱的语义信息,能够更准确地理解用户问题,检索到相关的知识。Graph RAG 在处理需要深层逻辑推理和知识关联的问题时表现出色。

Graph RAG的特点包括:

- 节点连接性:捕获并推理实体之间的关系。

- 层次知识管理:通过基于图的层次结构处理结构化和非结构化数据。

- 上下文丰富:通过利用基于图的路径添加关系理解。

Graph RAG局限性:

- 可扩展性有限:依赖图结构可能会限制可扩展性,特别是在数据源广泛时。

- 数据依赖:高质量的图数据对于有意义的输出至关重要,限制了其在非结构化或注释不佳的数据集中的适用性。

- 集成复杂性:将图数据与非结构化检索系统集成增加了设计和实现的复杂性。

Graph RAG适用于医疗诊断、法律研究等需要对结构化关系进行推理的应用领域。

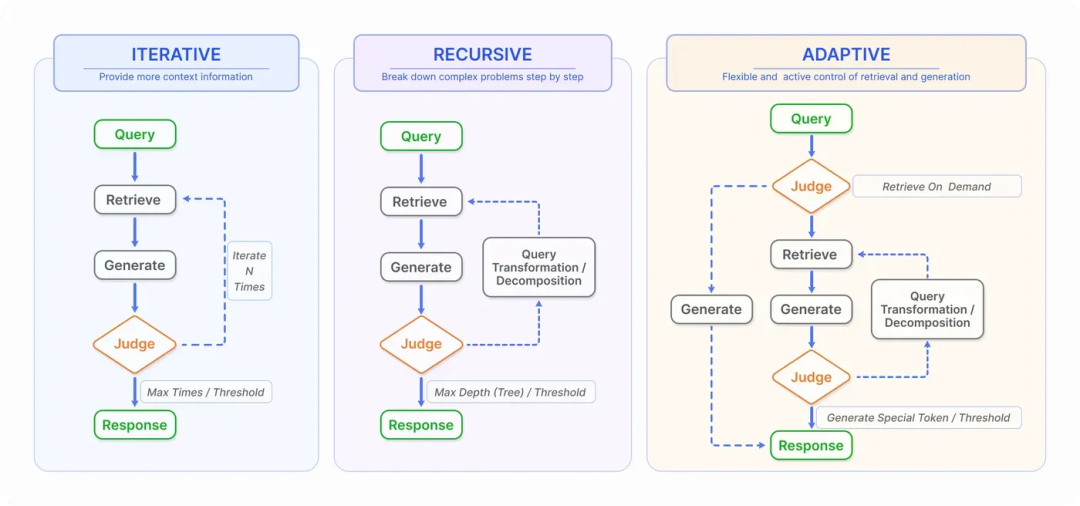

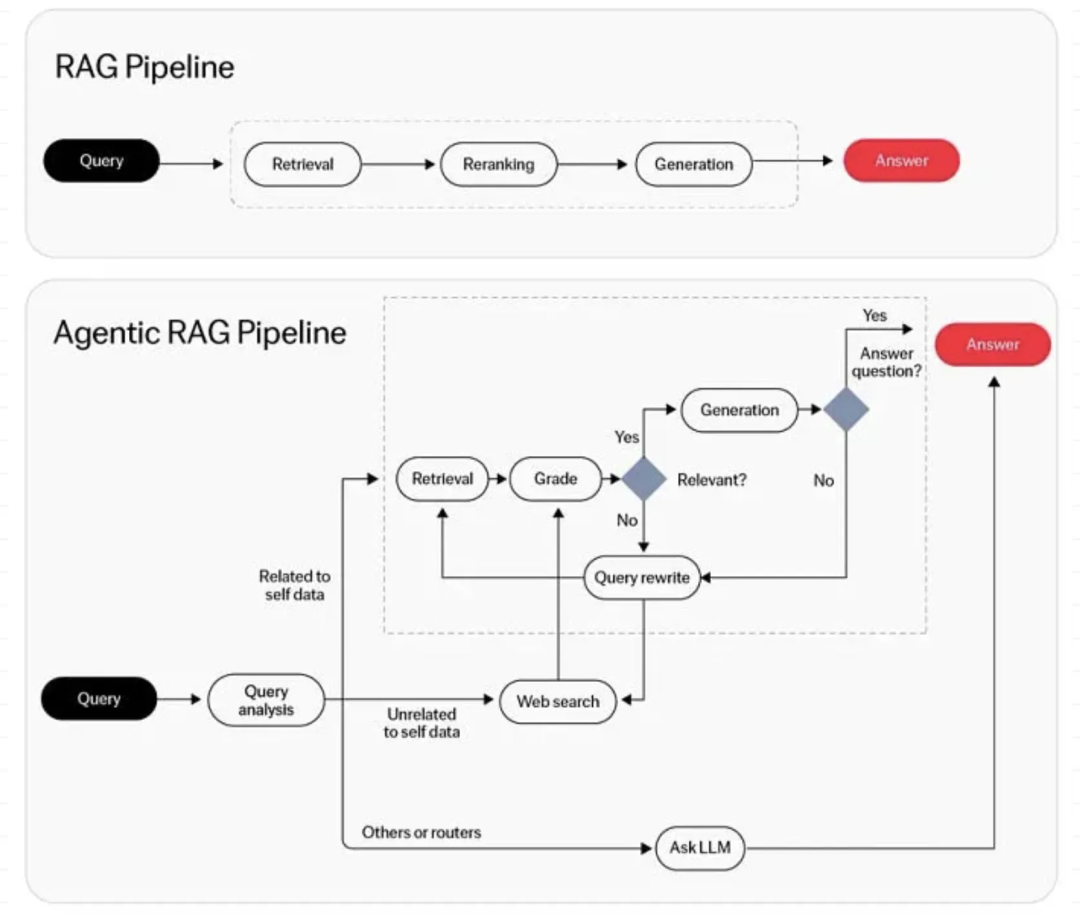

AgenticRAG

Agentic RAG,在RAG的基础上引入了AI“代理”(Agent)。在Agentic RAG中,AI代理模块负责协调检索和生成过程,而不是简单地遵循固定的单次检索-生成流程。通过将RAG的知识检索能力与AI代理的决策能力相结合,突破传统RAG在多源异构数据整合和多跳推理任务上的局限。

技术性突破:

- Agentic RAG不再局限于单一知识源,可以聚合来自多个地方或服务的信息。通过代理可以访问各种工具或数据源,包括用于私有文档索引的向量搜索引擎、用于通用知识或实时信息的网络搜索API、用于计算的计算器,以及其他内部API(如数据库、电子邮件等);

- Agentic RAG引入了迭代推理和验证,不再局限于单一次的检索。Agentic RAG系统围绕Agent代理核心组织,该代理负责协调这些步骤。代理实际上位于管道的中间,决定如何路由查询和数据。这意味着Agentic RAG通常涉及反馈循环或迭代过程,而不是单次通过。

- 此外,Agentic RAG支持多代理架构:你可以有一个路由代理,将复杂任务分配给多个专门的检索代理,每个代理负责不同的领域(一个代理负责内部文档,一个代理负责网络数据等),然后由一个协调(主)代理汇总发现结果;

- 更好的适应性:Agentic RAG体现了“计划和执行”的范式——它可以即时调整策略以应对新的或不断发展的查询。代理的包含记忆和规划能力意味着系统可以在没有明确重新编程的情况下适应上下文变化或不可预见的情况。从静态查找思维模式转变为自适应问题解决思维模式。Agentic RAG不受开发人员预期场景的限制;代理可以利用其一般推理能力来处理新的问题类型或数据源,使系统在需求增长时更加稳健。

2.2 Agent应用

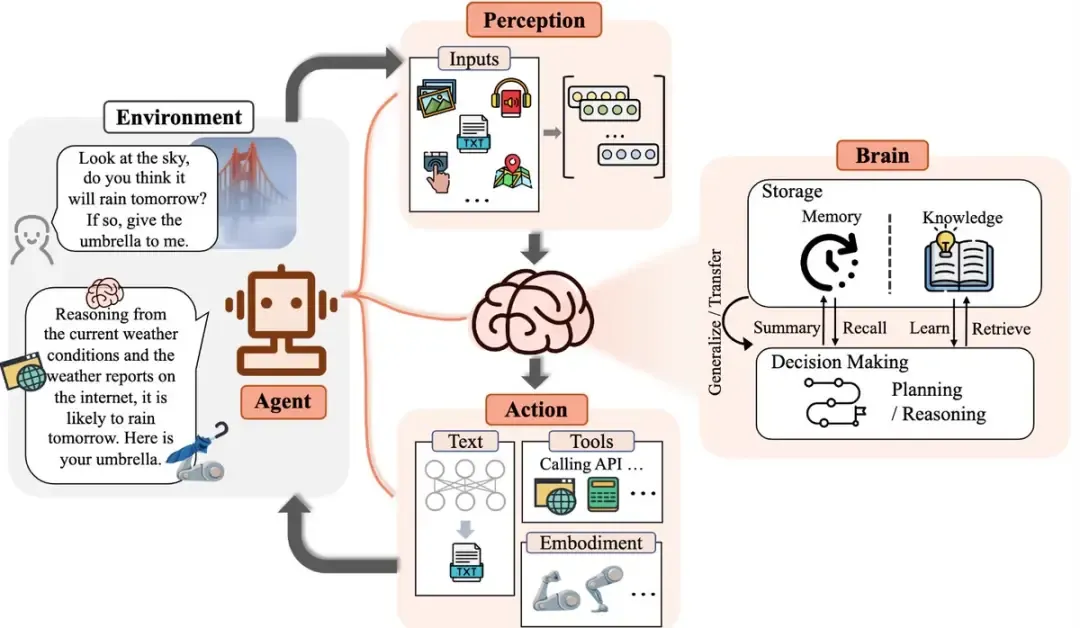

概念

AI Agent是任何可以通过传感器感知其环境并通过执行器对环境采取行动的东西。——罗素和诺维格,《人工智能:一种现代方法》(2016 年)

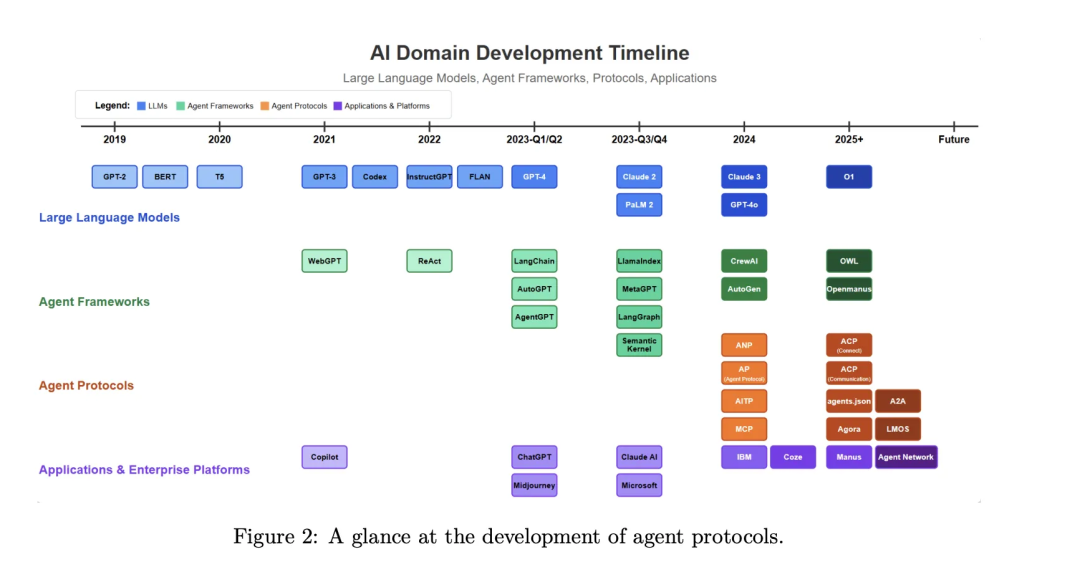

技术演进

- 符号逻辑 Agent:早期AI研究依赖符号逻辑Symbolic,通过规则和符号表示知识(如关键词),模拟人类思维,但面临处理不确定性和大规模问题的局限性。

- 响应式 Agent:不同于符号逻辑 Agent,响应式Reactive Agent注重快速响应,直接映射输入输出,计算资源需求低,但缺乏复杂决策能力。

- 强化学习 Agent:强化学习使Agent通过环境交互学习,追求累积奖励。深度强化学习提升了处理高维输入的能力,但面临训练效率和稳定性挑战。迁移学习和元学习被引入以提升Agent的学习效率和泛化能力,减少对新任务的样本依赖,尽管存在源任务与目标任务差异导致的挑战。

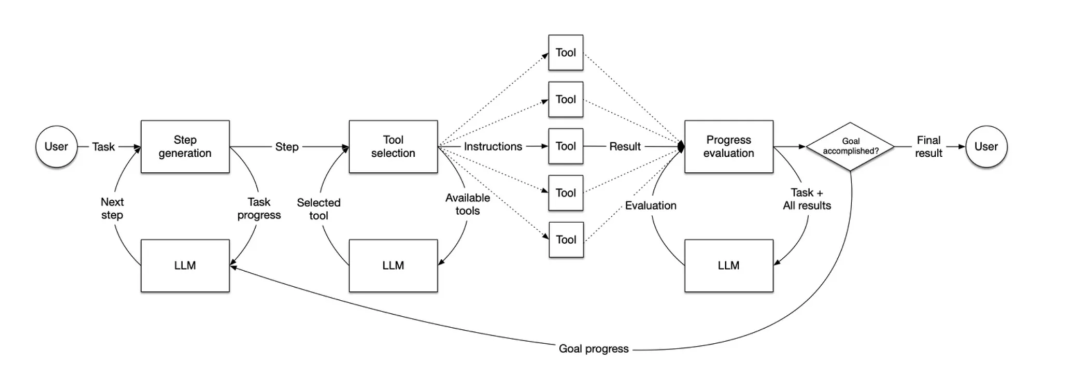

- LLM-Based Agent:大型语言模型在语言和意图理解、推理、记忆甚至移情等方面具有强大的能力,可以在决策和规划方面发挥卓越的作用。再加上预先训练的知识,它们可以创建连贯的行动序列,并有效地执行。此外,通过反思机制,这些基于语言的模型可以根据当前环境提供的反馈不断调整决策和优化执行序列。 同样,大型语言模型在大规模语料库中进行预训练,并显示出少量泛化的能力,从而实现任务间的无缝转移,而无需更新参数。

框架构成

Agent的概念框架,由大脑、感知、行动三个部分组成。作为控制器,大脑模块承担记忆、思考和决策等基本任务;感知模块负责感知和处理来自外部环境的多模态信息;行动模块负责使用工具执行任务并影响周围环境。上述框架同样适用于所有与各种环境互动的代理,比如与物理环境互动的机器人或与软件互动的AI Agents。

一个基于大模型的LLM-Based AI Agent 系统可以拆分为大模型、规划、记忆与工具使用四个组件部分:

- Agent智能体应用 = 大模型(LLM) + 任务规划(Planning)+ 记忆(Memory)+ 使用外部工具执行任务(Tools&Action)

- 其中 LLM 扮演了 Agent 的“大脑”,在这个系统中提供推理、规划等能力。AI Agent 连接了大模型与业务场景,充当了价值传递桥梁。

发展摘要

设计模式

COT

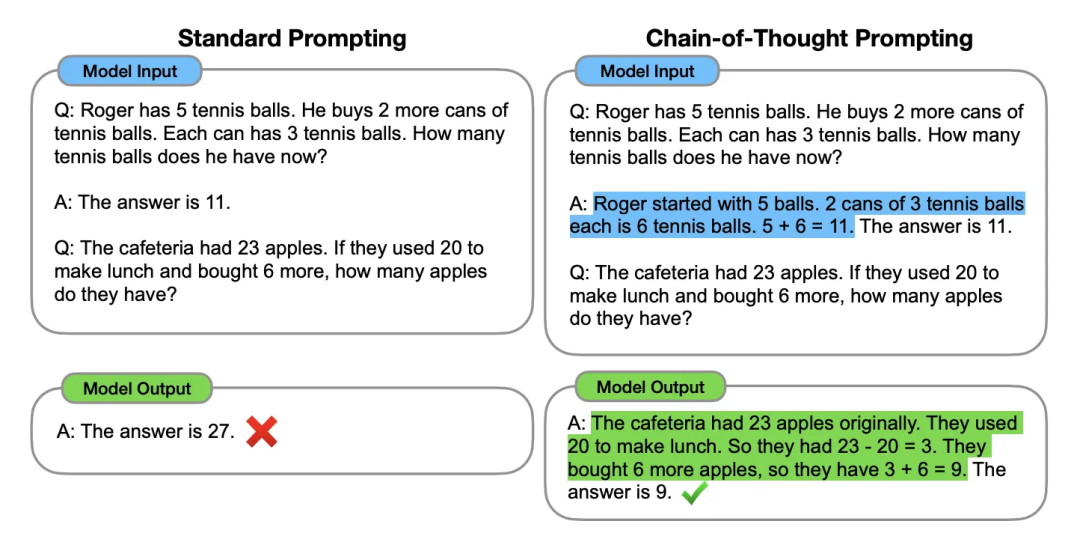

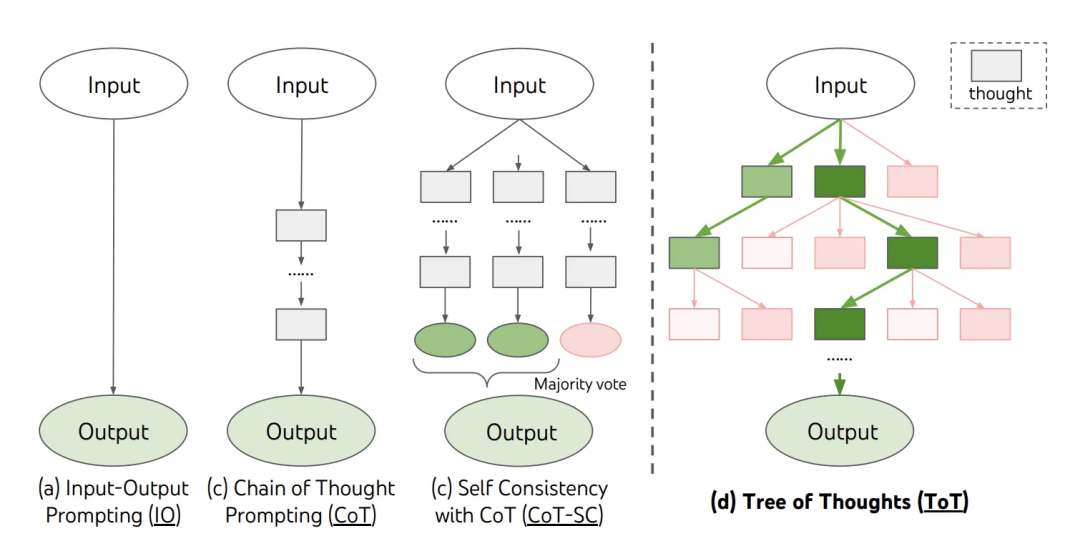

思维链,Chain-of-Thought Prompting ,22年5月,谷歌发表论文Chain-of-Thought Prompting Elicits Reasoning in Large Language Models,提出方法在输入提示(Prompt)中加入人工编写的推理步骤示例,引导模型生成类似的分步思考过程,最终得出答案。通过在提示词中显式要求模型生成推理链(如“因为...所以...”),提升模型在需要逻辑、数学或符号推理的任务的准确率。通过将“黑箱”输出转化为可解释的推理过程,COT不仅提升了模型性能,也为后续的AI可解释性研究和复杂任务处理奠定了基础。

主要贡献:

方法论突破 :首次证明大语言模型可通过显式推理链提升复杂任务性能。

提出“推理即生成”(Reasoning via Generation)的新范式。

TOT

思维树 (Tree Of Thoughts),CoT通常只有一条解决问题的路径,ToT等于是CoT的一个拓展,把一条reasoning路径拓展至多条reasong paths,这样模型可以综合多条reasoning path的结果得到最终的结论。

Tree of Thoughts: Deliberate Problem Solving with Large Language Models

主要贡献:

从线性到树状推理的跃迁:ToT首次将复杂任务建模为树状搜索过程,每个节点代表一个中间状态(如数学问题的分步计算、写作任务的段落规划),并通过分支生成和动态评估探索多路径可能性。这种设计突破了传统模型仅支持单向推理(如CoT的链式结构)的限制,使模型能够像人类一样进行前瞻性探索和回溯修正,模拟人类启发式决策机制;

自主规划与评估:通过引入“状态评估器”和“搜索算法”,ToT允许模型自主评估不同推理路径的潜在价值;

建立可解释性新标准:通过可视化推理路径(如展示决策树的分支与剪枝过程),ToT增强了模型输出的透明度。

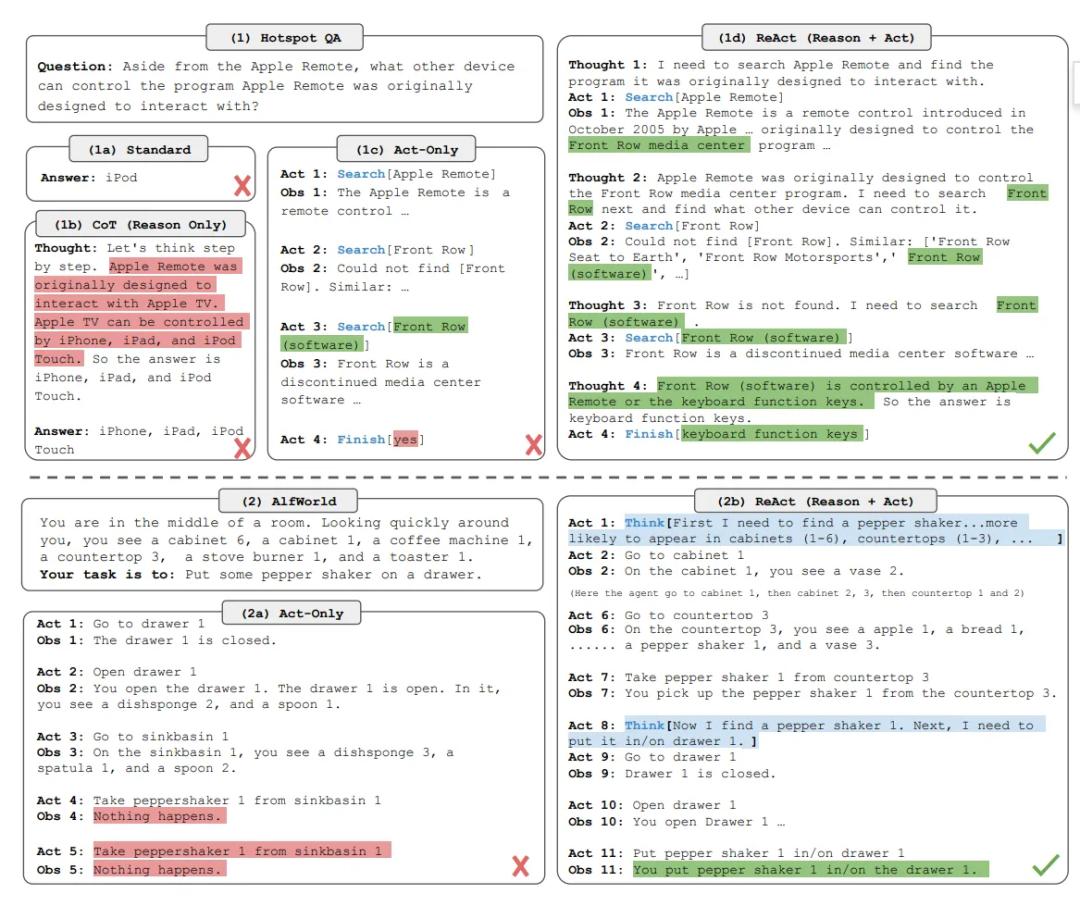

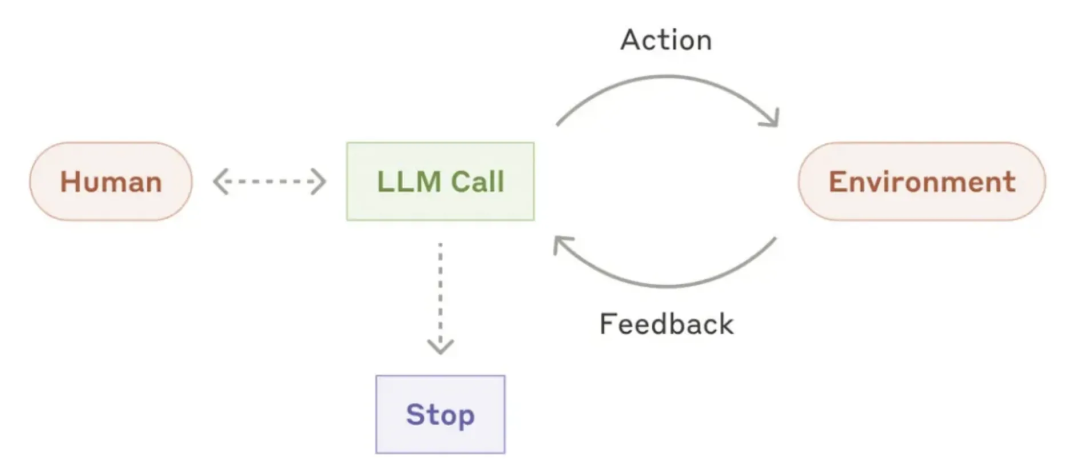

ReAct

Reasoning and Acting,受COT以及强化学习(RL)通过行动(Action)与反馈(Feedback)优化决策过程启发,22年10月,普林斯顿与谷歌发表论文ReAct: Synergizing Reasoning and Acting in Language Models,将推理(Reasoning)与行动(Acting)结合,让模型动态规划思考步骤,并在需要时调用外部工具,形成“思考-行动-观察”循环。

主要贡献:

- 协同推理与行动的新范式:ReAct首次系统性地将语言模型的推理能力 (如逻辑推导、语义分析)与行动能力 (如调用工具、与环境交互)融合,形成动态交替的任务解决流程。突破了传统方法中孤立执行推理或行动的局限性。

- 通过动态多跳推理以及错误抑制与反馈修正显著提升了模型在复杂场景中的表现,生成的推理轨迹(如“思考-行动-观察”步骤)使决策过程透明化,增强可解释性。

- 不仅提升了性能表现(如准确率、效率),更是推动了AI从静态问答向动态决策的范式转变。

ReAct局限性:

- 成本高昂:主要来自于LLM的调用成本、需要的LLM的调用次数较多、每次调用需要使用的Context很长。

- 耗时长:需要经过多次llm交互,且循环次数不固定,完成耗时比较长。

- 已有思考过程无法固化:每次对于同类问题都需要重复进行思考,耗费同样的费用成本。

- 陷入死循环。

变种与后续发展:

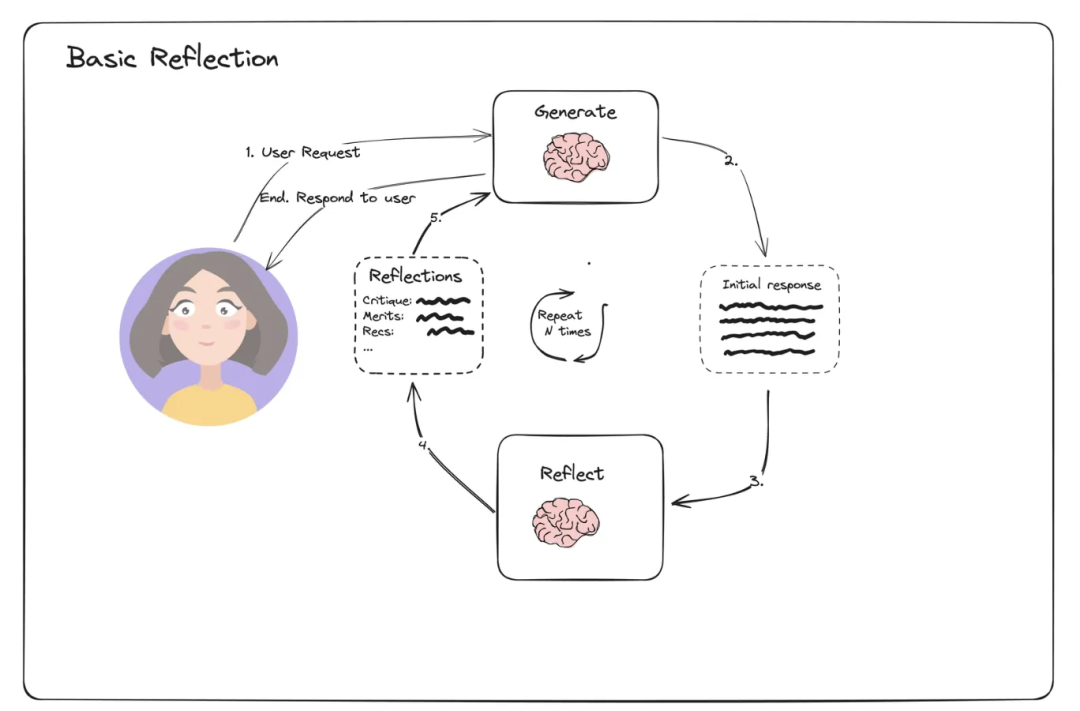

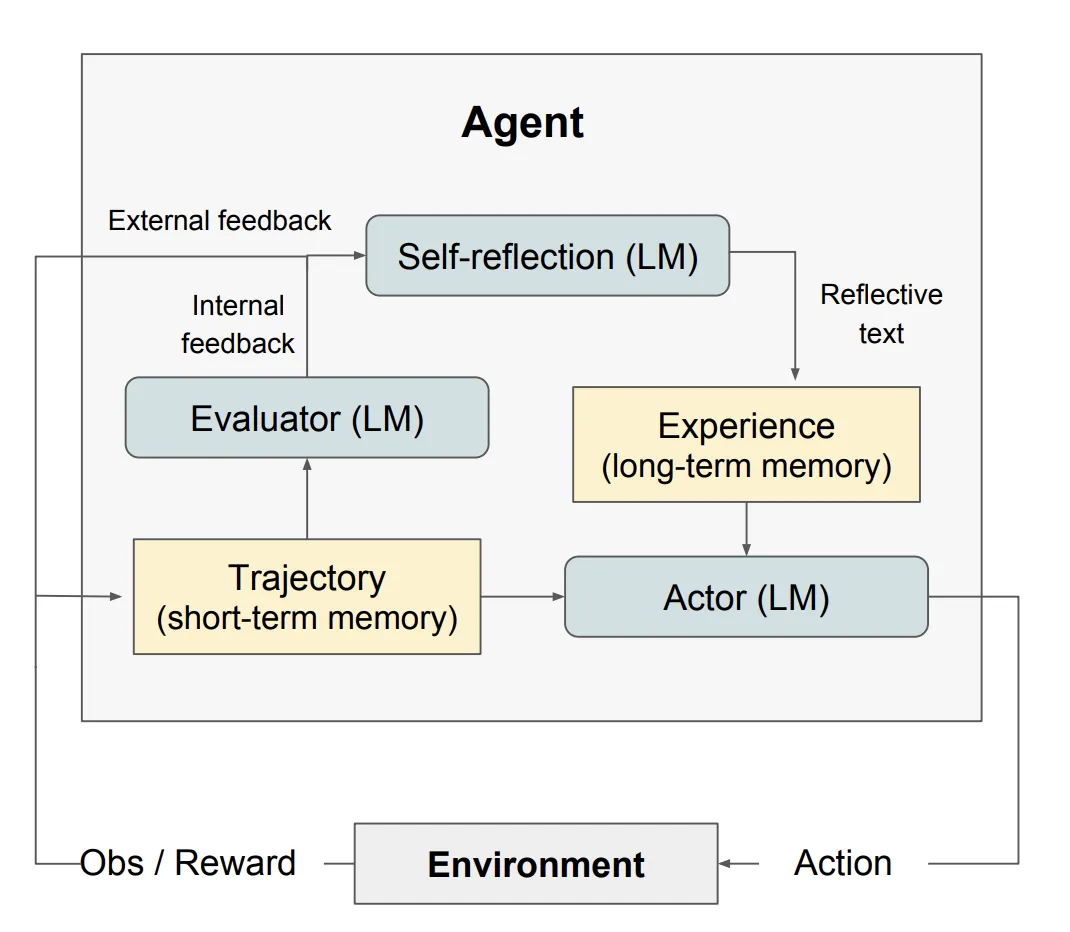

Reflection

Reflection,反思,该模式的核心思想是让AI模型能够自动地对自己的输出进行批判性思考和改进,而不是仅仅生成一次性的最终结果。

- Basic reflection:通过两个LLM的多轮交互结果反思,得到一个优化后的结果;Basic Reflection可以类比于左右互博。左手是Generator,负责根据用户指令生成结果;右手是Reflector,来审查Generator的生成结果并给出建议。在左右互搏的情况下,Generator生成的结果越来越好,Reflector的检查越来越严格,输出的结果也越来越有效。

- Reflexion:在Basic Reflection的基础,上引入了强化学习的概念,通过设计解决强化学习中的如何评估生成的输出质量以及如何提供有用的反馈信息以帮助Agent改进自身的表现,使AI能够根据外部数据评估答案的准确性,并进行更有建设性的反思。Reflexion: Language Agents with Verbal Reinforcement Learning

Actor:Actor模型基于大型语言模型(LLM),被提示生成所需的文本和行动,这些行动会根据状态观察进行条件化。Actor模型可以是Chain of Thought或ReAct等。

Evaluator:Evaluator模型对Actor产生的输出进行评分,评估其在给定任务中的表现。对于推理任务,可以使用基于精确匹配的评分,确保生成的输出与预期的解决方案高度一致。对于决策任务,可以采用预定义的启发式函数。根据任务要求,提供奖励或惩罚作为反馈。

Self-Reflection:Self-Reflection模型是一个LLM,它通过生成语言反馈来提供有价值的反馈,帮助Actor进行自我改进。Self-Reflection模型分析当前轨迹和奖励信号,生成具体的反馈,并将其存储在Actor的记忆中。

记忆核心:Reflexion过程的核心是短期和长期记忆的概念。在推理时,Actor根据短期和长期记忆做出决策。短期记忆由轨迹历史组成,而长期记忆则存储Self-Reflection模型的输出。

主要贡献

将传统强化学习的参数更新机制转化为语言形式的反馈信号,通过自然语言总结错误经验并存入记忆系统,指导后续决策,模型不仅接收“失败”信号,还会获得具体错误原因的文本反馈;利用自然语言作为反馈信号,将二进制或标量环境反馈转化为文本形式的自反反馈,从而为智能体提供了更加清晰和可解释的方向;

使用长短期记忆(LSTM)网络存储自反反馈经验,以便于智能体在未来的学习过程中参考;这种记忆机制使得Agent能够记住重要的经验并应用于后续的决策过程中,从而提高了决策能力和适应性。

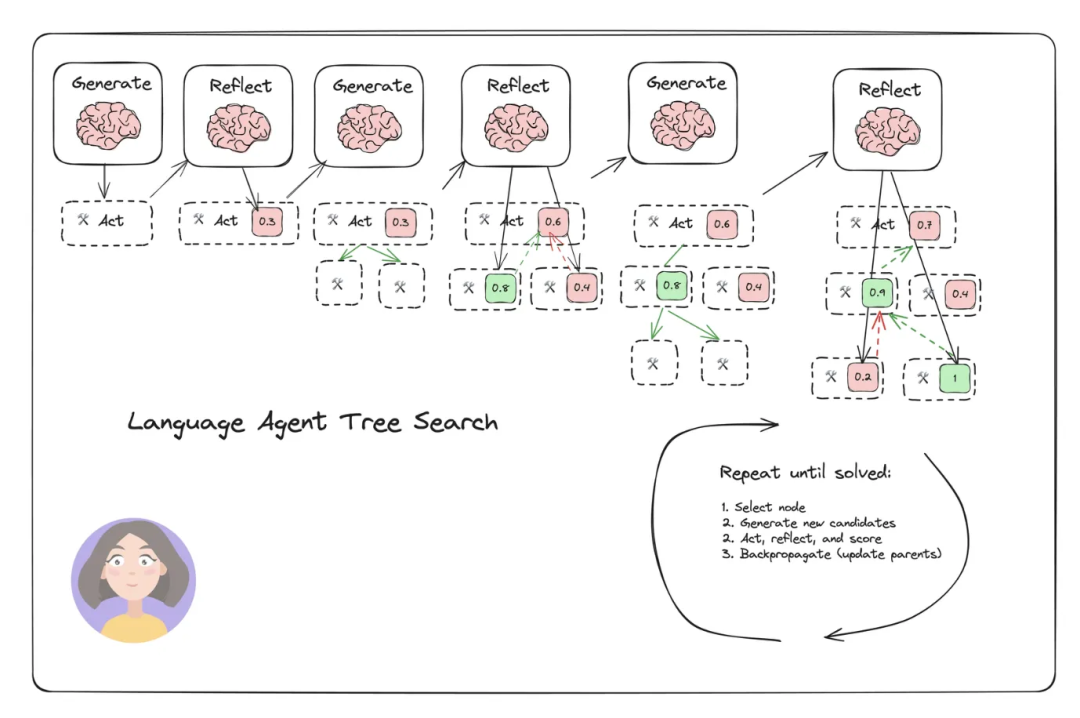

- Language Agent Tree Search (LATS):

结合了 reflection/evaluation、search(蒙特卡洛树搜索) 来实现更好的任务性能。

它采用标准的强化学习(RL)任务框架,将RL代理、价值函数和优化器都替换为对一个大型语言模型(LLM)的调用。目的是帮助 Agent 适应并解决复杂任务,避免陷入重复的循环中。

搜索过程的4个步骤:

- 选择:根据下面第(2)步中累计的奖励来选择最佳的下一步行动。如果找到了解决方案或达到了最大搜索深度就做出回应,否则继续搜索。

- 展开并模拟:生成N个(在我们的案例中是5个)潜在的行动方案,并且并行执行它们。

- 反思+评估:观察这些行动的结果,并基于反思(可能还包括外部反馈)对决策进行打分。

- 反向传播:根据结果更新根路径的分数。

LATS将其他代理架构的推理、规划和反思组件统一起来,如Reflexion、思维树(Tree of Thoughts)和计划执行代理(plan-and-execute agents)。LATS还来自于基于反思和环境反馈的反向传播,用于改进搜索过程。

Planning

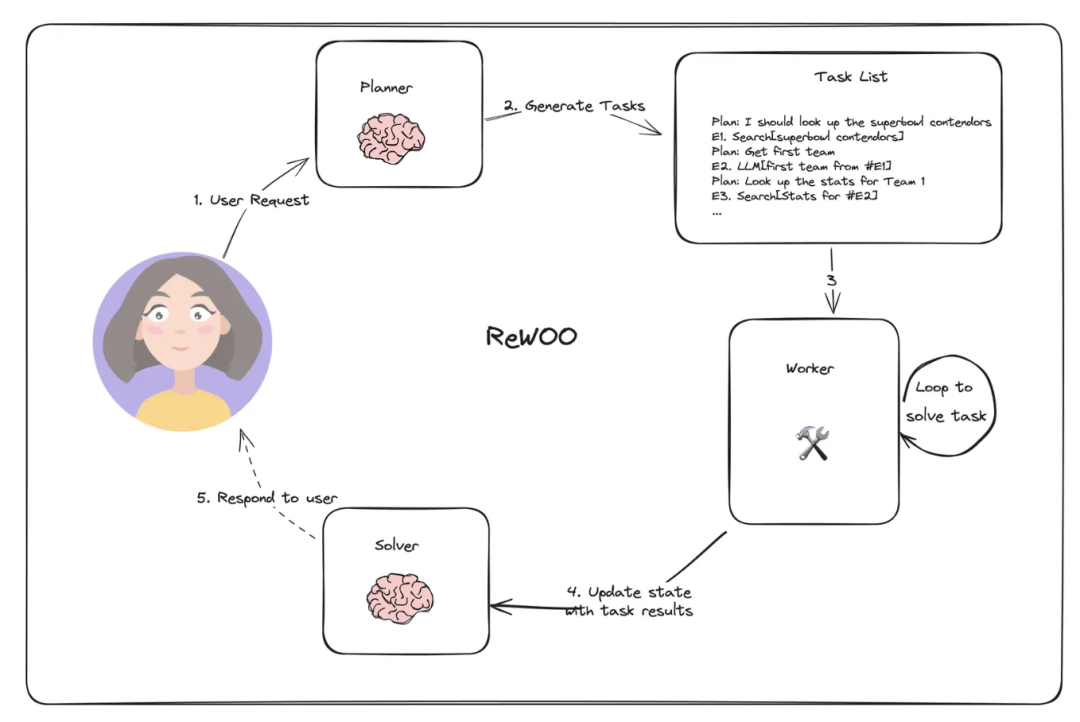

- ReWoo:(ReWoo论文):

REWOO的全称是Reason without Observation,是相对ReAct中的Observation 来说的。它旨在通过以下方式改进 ReACT 风格的Agent架构:

第一,通过生成一次性使用的完整工具链来减少token消耗和执行时间,因为ReACT模式的Agent架构需要多次带有冗余前缀的 LLM 调用;

第二,简化微调过程。由于规划数据不依赖于工具的输出,因此可以在不实际调用工具的情况下对模型进行微调。

ReWOO 架构主要包括三个部分:

Planner:规划器,负责将任务分解并制定包含多个相互关联计划的蓝图,每个计划都分配给Worker执行。

Worker:执行器,根据规划器提供的蓝图,使用外部工具获取更多证据或者其他具体动作。

Solver:合并器,将所有计划和证据结合起来,形成对原始目标任务的最终解决方案。

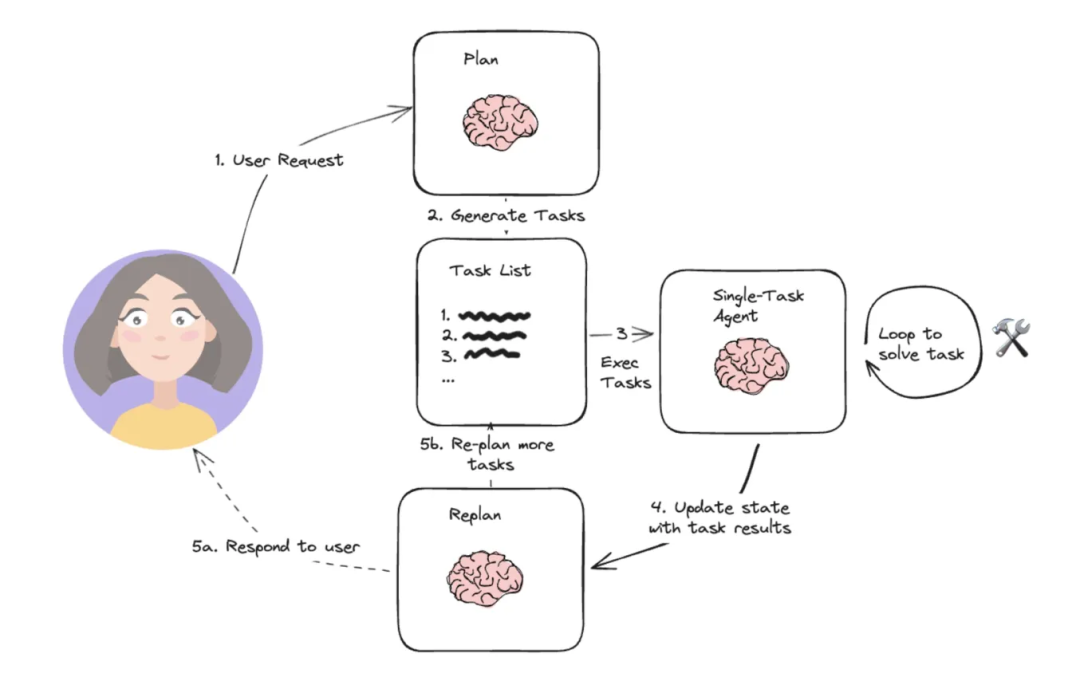

- Plan And Execute(Plan And Execute论文)

Plan-and-Execute这个方法的本质是先计划再执行,即先把用户的问题分解成一个个的子任务,然后再执行各个子任务,并根据执行情况调整计划。Plan-and-Execute相比ReWOO,最大的不同就是加入了Replan机制。

Plan-and-Execute架构上包含规划器、执行器和重规划器:

规划器Planner,负责让 LLM 生成一个多步计划来完成一个大任务,在书籍运行中,Planner负责第一次生成计划;

执行器,接收规划中的步骤,并调用一个或多个工具来完成该任务;

重规划器Replanner,负责根据实际的执行情况和信息反馈来调整计划

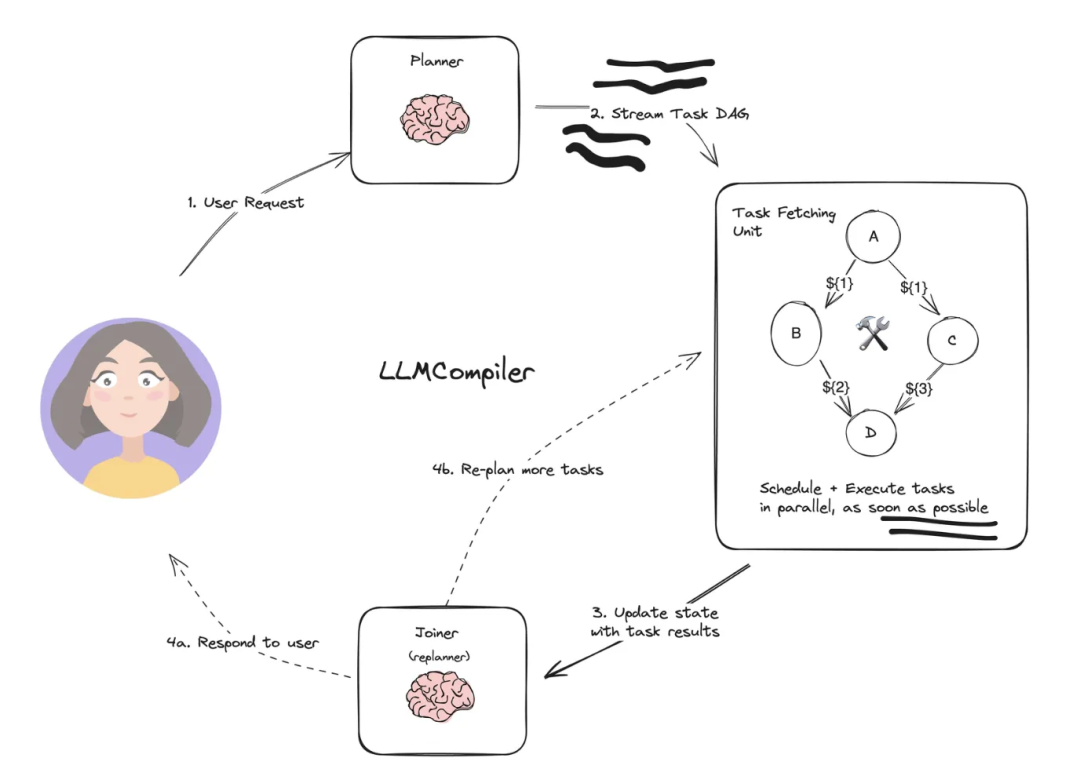

- LLM Compiler(LLM Compiler论文)

LLM Compiler是伯克利大学的SqueezeAILab于2023年12月提出,其在ReWOO引入的变量分配的基础上,进一步训练大语言模型生成一个有向无环图(Directed Acyclic Graph,DAG,如下图所示)类的规划。DAG可以明确各步骤任务之间的依赖关系,从而并行执行任务,实现类似处理器“乱序执行”的效果,可以大幅加速AI Agent完成任务的速度。

LLM Compiler主要构成:

Planner:输出流式传输任务的DAG,每个任务都包含一个工具、参数和依赖项列表。相比ReWOO的Planner,依赖项列表是最大的不同。

Task Fetching Unit:调度并执行任务,一旦满足任务的依赖性,该单元就会安排任务。由于许多工具涉及对搜索引擎或LLM的其他调用,因此额外的并行性可以显著提高速度。

Joiner:由LLM根据整个历史记录(包括任务执行结果),决定是否响应最终答案或是否将进度重新传递回Planner。

MultiAgent

多智能体协作MAS(Multi-agent collaboration): 由多个智能体组成的集合。这些Agent可以是不同的软件程序、机器人、传感器等,它们各自具备一定的智能和自主性,并处理各自擅长的领域和事情。MAS的核心思想是通过多个Agent的协作与协调,共同完成一个复杂任务,从而实现单个Agent无法完成的复杂目标。

相比单Agent系统,Multi-Agent系统具备以下优势:

- 分布式处理:MAS支持分布式应用,可以将大型复杂系统分解为多个小型、易于管理的子系统。这使得MAS具有良好的模块性、易于扩展性和设计灵活性,降低了系统的总成本和维护难度。

- 协同工作:MAS中的Agent可以相互通信、协商和协作,共同完成一个任务。通过这种协同工作方式,MAS能够处理单个Agent无法解决的问题,从而提高系统的整体性能和鲁棒性。

- 自适应性:MAS中的Agent可以根据环境变化自主调整行为和策略,这种自适应性使得MAS具有优秀的稳定性和灵活性,能够应对各种复杂场景。

MAS形态

社会模拟型:例:斯坦福小镇 《Generative Agents :interactive simulacra of human behavior》

任务导向型:例:软件开发团队

开源框架:

MetaGPT(GitHub - FoundationAgents/MetaGPT: 🌟 The Multi-Agent Framework)

Phidata( https://www.phidata.com/ )

OpenAI Swarm( https://github.com/openai/swarm )

Microsoft Autogen( https://www.microsoft.com/en-us/research/project/autogen/ )

CrewAI( https://www.crewai.com/ )

Vertex AI( https://cloud.google.com/vertex-ai )

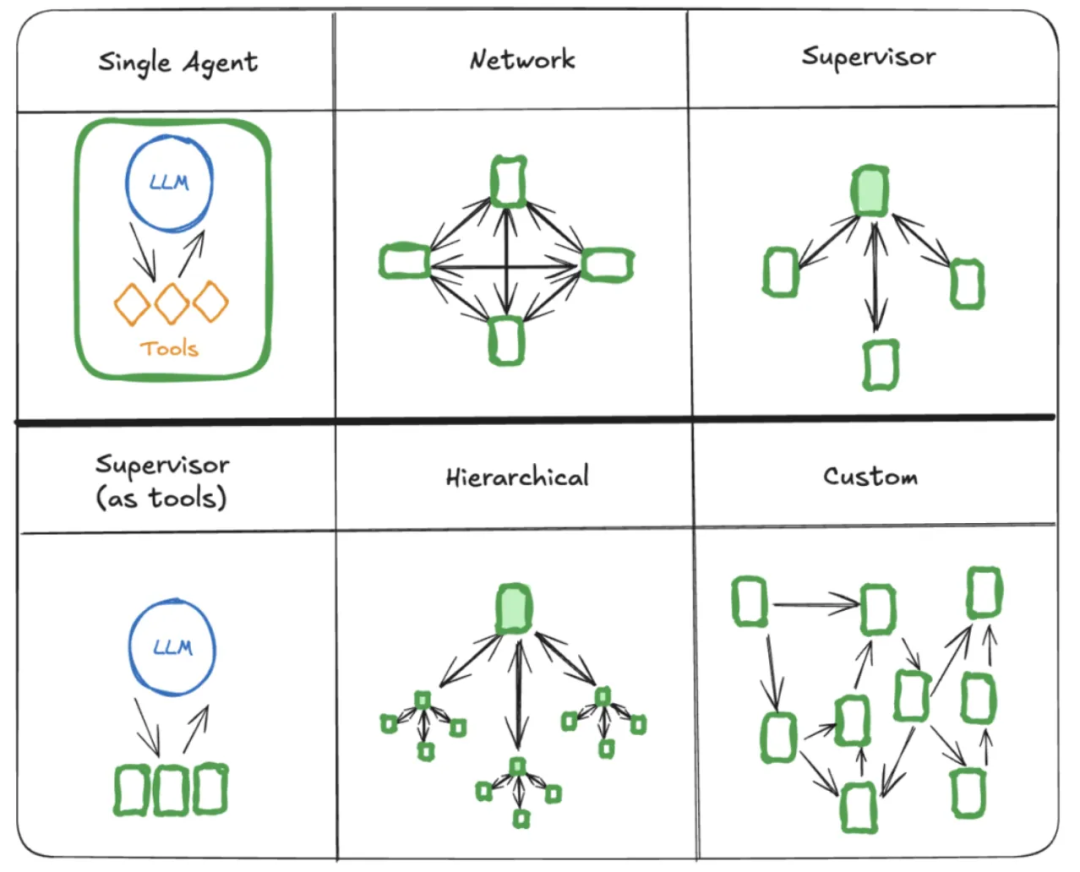

协同框架:

SingleAgent: 整个系统重只有一个Agent负责处理所有的工作;

Network:每个Agent都可以与其他所有Agent通信。任何Agent都可以决定接下来要调用哪个其他Agent;

Supervisor:每个Agent只与一个Supervisor Agent通信,Supervisor Agent作为团队指挥官,决定接下来应该调用哪个Agent;

Supervisor As Tools:这是Supervisor架构的一种特殊情况。单个Agent可以被表示为一个工具。在这种情况下,Supervisor Agent使用一个tool-call调用LLM来决定调用哪个Agent工具;

Hierarchical:可以定义一个具有多个Supervisor的多Agent系统。这是Supervisor架构的一个泛化,允许更复杂的控制流程;

Custom:每个Agent只与部分Agent通信。流程的部分是确定性的,只有某些Agent可以决定接下来要调用哪个其他Agent;

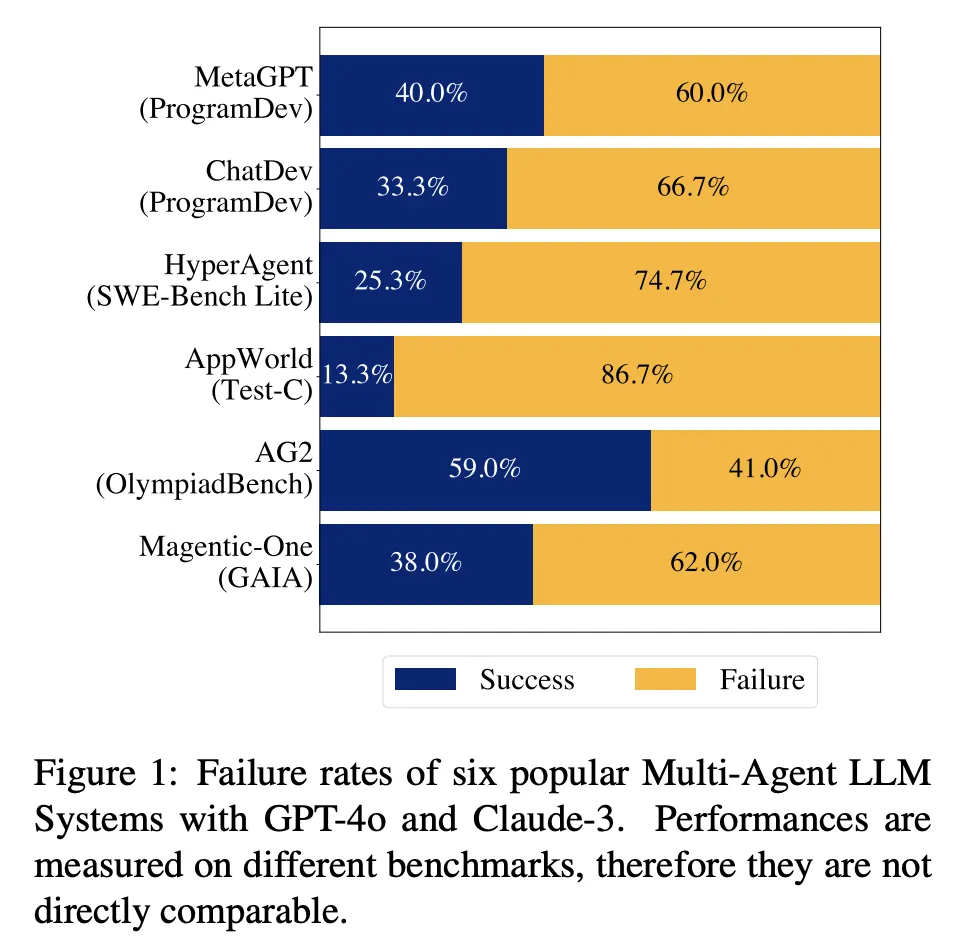

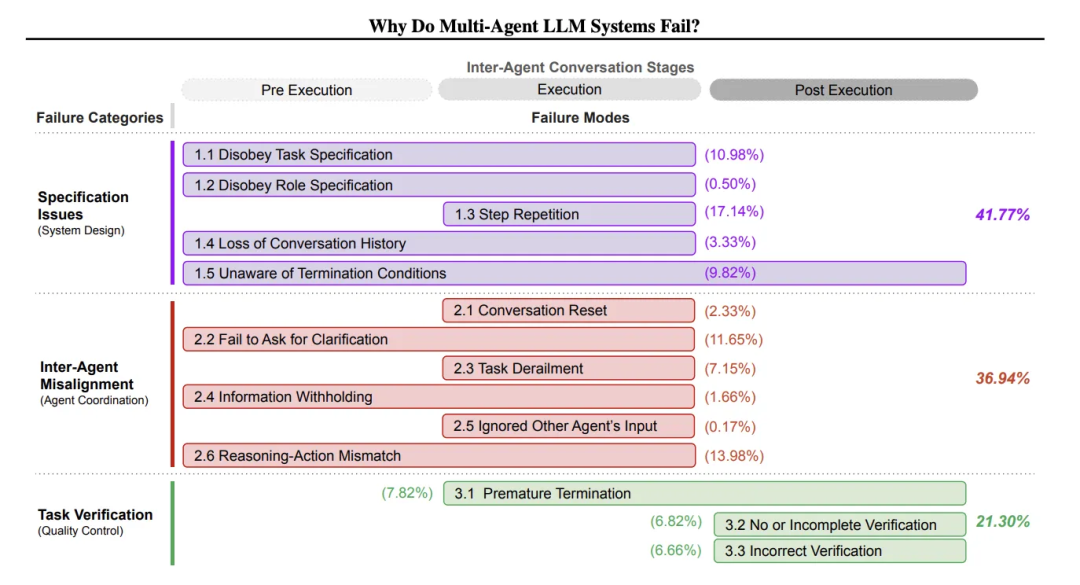

Why MAS Failed

https://arxiv.org/abs/2503.13657

规范问题 :「地基」没打好 或 「规章制度」有问题,诸如不遵循任务要求、步骤重复以及不知何时终止等问题;

沟通问题:系统执行过程中,是 Agent 之间沟通不畅、协调失误、目标不一致导致的。就像一个团队,成员之间互相误解、信息不流通、各行其是;

任务验证问题:「质检环节」形同虚设,该类失败与最终结果的质量控制有关。要么是没检查,要么是检查了但没查出问题,要么是还没完成就提前收工了;

改进建议:

改进提示与角色规范:明确任务终止条件、增强验证步骤。

标准化通信协议:减少非结构化文本交互的模糊性。

强化验证机制:结合领域知识(如符号验证、单元测试生成)。

概率置信度集成:智能体在低置信度时暂停行动,请求更多信息。

通信协议

LLM的快速进步,Agent智能体正在各种行业得到越来越广泛的应用。然而,随着应用场景范围不断扩大以及来自不同供应商、具有不同结构的智能体不断涌现,智能体与实体之间的交互规则变得日益复杂。这一发展过程中的关键瓶颈在于缺乏标准化协议。这种缺失严重阻碍了智能体与前述资源的互操作能力,限制了它们利用外部功能的潜力。

Agent生态中三个核心角色 用户、Agent、外部世界,不同协议定位主要面向不同角色之间的链接。

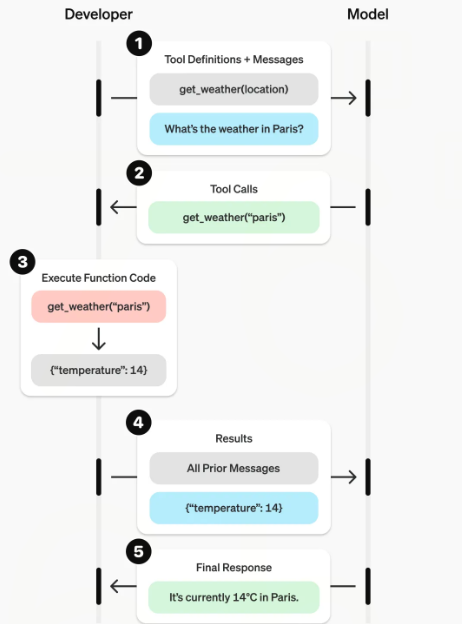

FunctionCall

FunctionCall 最早由 OpenAI 于 2023 年引入,最初用于支持 ChatGPT 插件系统。这项能力使 Agent 可以通过标准接口请求宿主程序调用外部插件、API 或服务,从而突破模型固有知识边界和算力限制。OpenAI 提供了基于 JSON Schema 的函数定义方式,要求开发者为每个工具(即函数)定义名称、描述、输入参数类型和结构。模型一旦识别出用户的问题属于某个工具所能处理的范围,就会生成符合 JSON 格式的调用请求,而宿主应用接收请求、执行对应操作并返回结果,模型继续生成最终答复。

局限性:

缺乏统一标准:各大模型平台的调用机制、参数格式等不同,难以实现完全兼容;

上下文不统一:每个模型对工具行为的解释可能不同,可能出现调用失败、误判等情况;

扩展复杂度提升:当工具数量众多或有调用依赖关系时,开发者需要构建中间调度逻辑,增加了代码复杂度和维护成本;

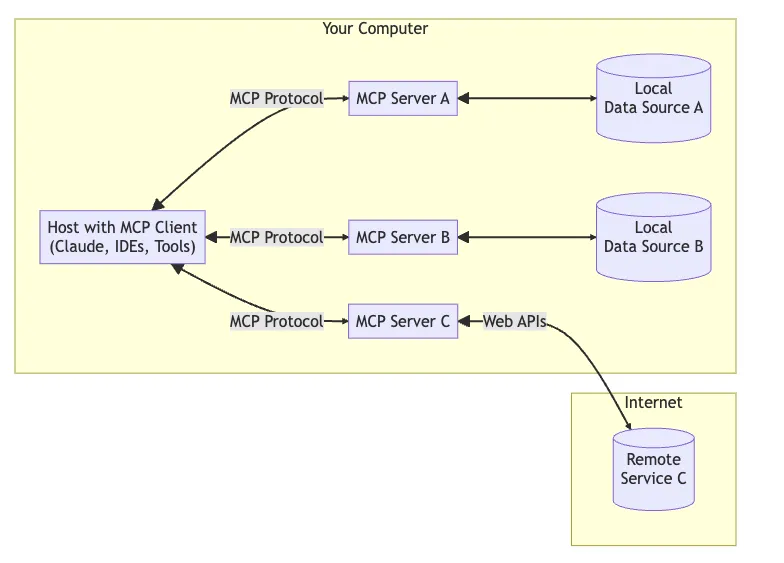

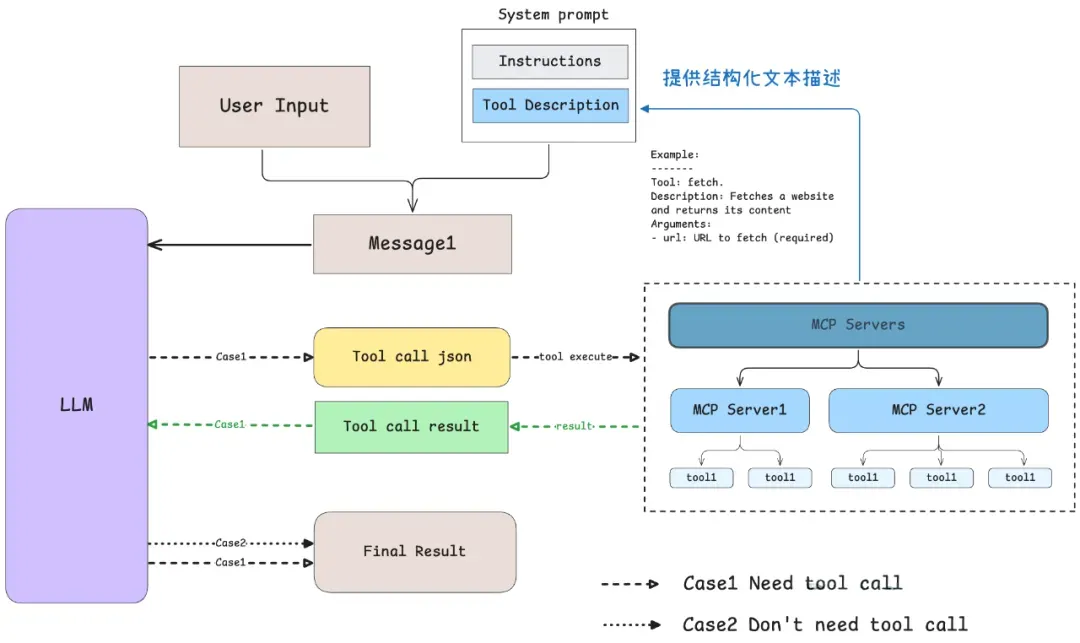

MCP

MCP(Model Context Protocol)以更简单、更可靠的方式将LLM智能体连接到包括外部数据、工具和服务在内的各类资源。MCP的高度标准化有效解决了不同基础LLM和工具提供商带来的系统分散问题,显著提升了系统集成能力。同时,MCP的标准化也为LLM智能体的工具使用带来了极强的可扩展性,使它们能更容易地集成各种新工具。

基本组成

MCP Host:运行 MCP Client 的宿主环境,可能是 Claude 桌面端、IDE、企业 Copilot 系统等。

MCP Client:代表模型一侧发起任务请求的客户端 SDK,封装成标准协议消息发送给 MCP Server。

MCP Server:暴露功能或数据接口的服务提供者,可是本地数据库、文件系统,也可以是远程 API。

数据源或远程服务:MCP Server 后端连接的数据或服务。

Functioncall VS MCP

FunctionCall:函数调用,它允许 LLM 根据用户的自然语言输入识别它需要什么工具以及格式化的工具调用的能力;

MCP:提供了一个通用的协议框架来发现、定义、以及调用外部系统提供的工具能力;

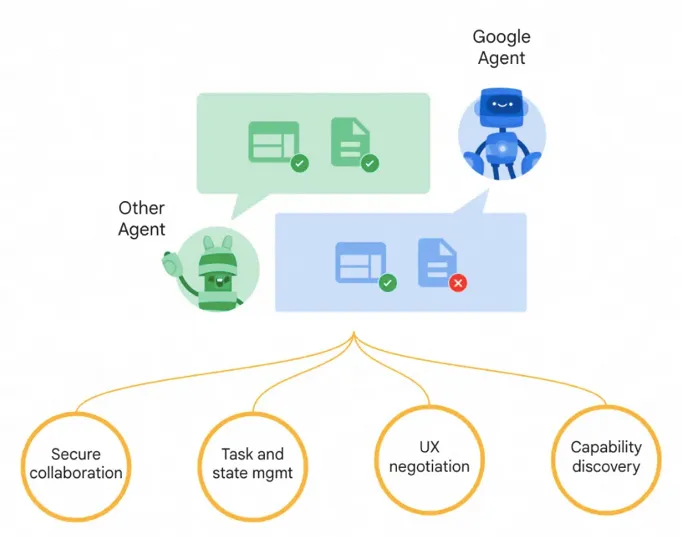

A2A

A2A旨在实现不同平台和生态中的 AI 智能体之间的安全、标准化协作,无论它们基于何种框架或由哪家公司构建。协议的核心目标是打通智能体间的互操作性,支持跨平台、多模态的协同工作。通过 A2A,智能体可以彼此通信、发现对方能力、协商任务分配,并协作完成复杂的企业级流程,即便它们来自不同的技术体系。

其功能特性主要有以下四点:

Capability discovery: 代理可以使用 JSON 格式的“Agent Card”来宣传其能力,从而允许客户端代理识别能够执行任务的最佳代理并利用 A2A 与远程代理进行通信。

Task management: 客户端与远程代理之间的通信以任务完成为导向,代理负责执行最终用户的请求。此“Task”对象由协议定义,并具有生命周期。它可以立即完成,或者,对于长时间运行的任务,每个代理可以进行通信,以彼此保持同步,了解任务的最新完成状态。任务的输出称为“Artifact”。

Collaboration: 代理可以互相发送消息来传达上下文、回复、Artifact或用户指令;通过引入认证/授权机制,保证 Agent 之间的身份互信。

User experience negotiation: 每条消息包含“部分”,即完整形成的内容片段,例如生成的图像。每个部分都有指定的内容类型,允许客户端和远程代理协商所需的正确格式,并明确包含对用户 UI 功能(例如 iframe、视频、Web 表单等)的协商,这意味着 A2A 不仅关注 Agent 之间的语义协作,还主动考虑最终用户界面呈现方式的兼容性和体验质量,这是前所未有的细节设计。

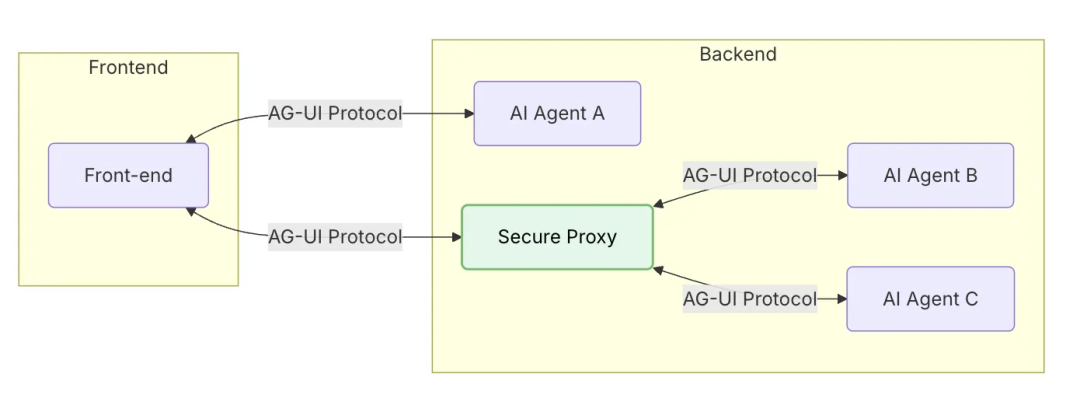

AG-UI

AG-UI,即智能体用户交互协议(Agent User Interaction Protocol),是由CopilotKit公司于2025年推出的一个开放、轻量且基于事件的协议。它旨在通过标准的HTTP或可选的二进制通道,以流式方式传输一系列JSON事件,标准化AI智能体与前端应用程序之间的交互。

AG-UI关键特性:

实时交互:支持实时事件流,确保用户与AI状态同步

人机协作:允许用户介入AI决策过程,适合需要人工确认的复杂工作流

传输灵活性:支持多种传输方式,如SSE、WebSocket等

轻量设计:最小化依赖,易于集成到各种规模的项目中

标准化事件:定义统一的事件类型,简化开发流程

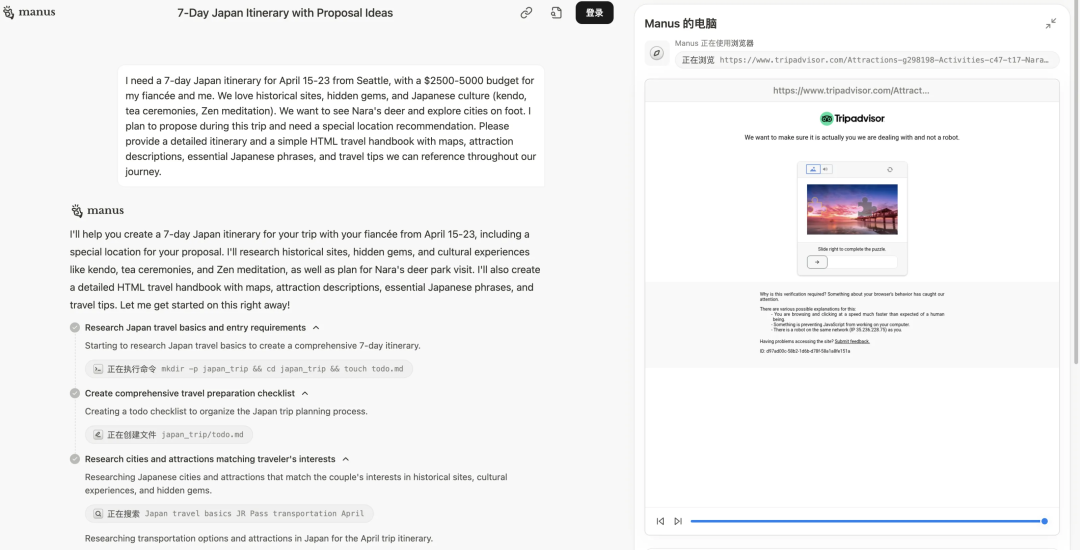

通用Agent与应用

伴随多模态技术成熟和大模型能力突破,OpenAI推出的Operator以及Monica的Manus,标志着AI技术从被动响应迈向主动执行的跨越。

Computer Use

24年11月,Anthropic官宣了Claude 3.5的同时,也低调官宣了一个Beta版本的能力 Computer Use,目前处于公开测试阶段,这项功能允许 Claude 像人类一样使用计算机,具体表现为:用户可以指导 Claude 像人类一样使用计算机 —— 通过查看屏幕、移动光标、单击按钮和输入文本,来完成各类任务。https://www.anthropic.com/news/3-5-models-and-computer-use

贡献:

Agent工具使用范式的重构,从 API软件能力到Action 操作系统;

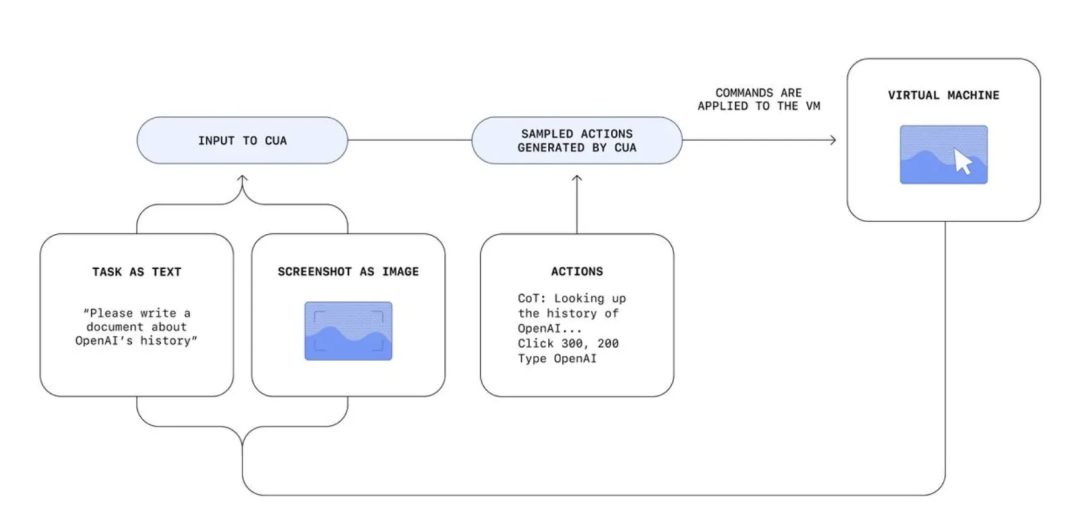

Operator

25年1月,OpenAI发布名为Operator的Agent代理,旨在通过模拟人类在浏览器上的操作(如打字、点击和滚动)来完成各种重复性任务,从而扩展 AI 的实用性。

Operator 由名为 Computer-Using Agent (CUA) 的新模型驱动。CUA 结合了 GPT-4o 的视觉能力和通过强化学习获得的先进推理能力,使其能够与图形用户界面 (GUI) 进行交互。Operator 可以“看到”(通过屏幕截图)和“交互”(使用鼠标和键盘的所有操作)浏览器,无需自定义 API 集成即可在 Web 上执行操作。

这款发布的AI agent主要应用场景是面向GUI,其框架主要分成perception reasoning action三部分。perception就是截图作为视觉信息,然后用多模态模型来理解;reasoning过程的训练用了reinforcement learning,用step-by-step慢推理的方式;action就是模仿人类鼠标操作。

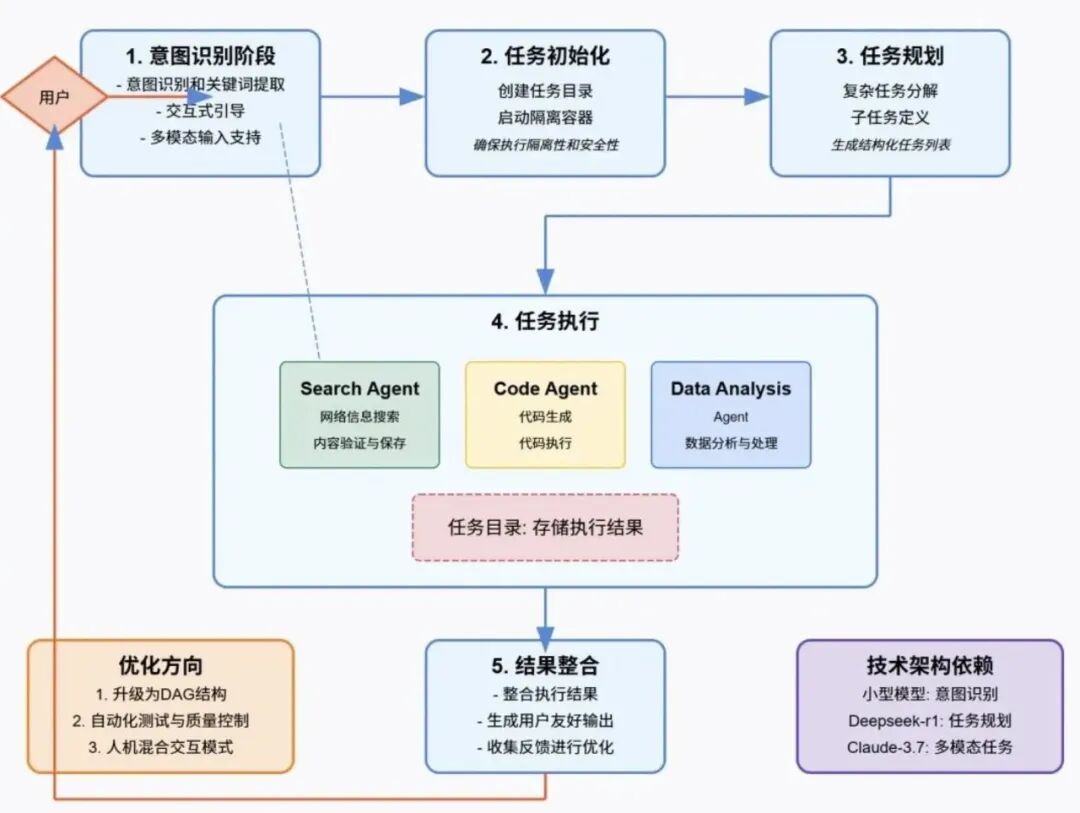

Manus

2025年3月,由Monica推出的Manus引发了广泛关注与讨论。Manus 采用了多智能体协同架构(Multiple Agent Architecture)。简单来说,就是在一个任务中由多个专门的 AI Agent 分工合作,由一个中央决策模块(“大脑”)进行规划和协调。

Monica.im 官方介绍 Manus 运行在独立的虚拟机沙盒中,类似于 Anthropic 的“Computer Use”模式。在这个隔离的环境中,Manus 可以安全地调用各种工具,包括代码编辑器/执行环境、浏览器、文档处理器等,实现对电脑的操作。与传统单一LLM(大型语言模型)直接对话不同,Manus 会自主产生一系列思维链(Chain of Thought)和待办事项清单来逐步完成复杂任务。它具有出色的任务规划与执行能力:能够将复杂任务自动分解为子任务,并行或顺序执行,直到完成最终目标。Manus 还内置长短期记忆模块,可以在对话和执行过程中记录关键信息和用户偏好,实现持续学习与自我调整。

人机协作Agent范式:

Manus的贡献在于重新定义了AI Agent的产品形态,推动了AI从“对话交互”向“人机协作”的范式跃迁:

从“生成答案”到“执行闭环” :通过多Agent架构(规划、执行、验证模块协同)实现了任务全流程自动化。例如,在简历筛选中,它能解压文件、逐页分析内容并生成排名报告,展现了类似人类的分步工作模式。这种“思考-规划-执行”闭环突破了传统AI仅提供建议的局限,直接交付成果(如PPT、代码、分析报告);

技术整合与工程化创新 :Manus未依赖底层模型原创突破,而是通过集成现有大模型(如Claude、DeepSeek)、强化学习算法和工具包生态,构建了高效的工程化编排能力。其核心在于动态调度多模型资源,例如在股票分析中调用数据抓取、建模和可视化模块协作生成报告;

虚拟机环境与安全机制 :借鉴Anthropic的“ComputerUse”架构,Manus在隔离的云端虚拟机中执行任务,支持非在线异步处理(用户可关闭设备等待结果),并通过沙盒环境验证代码可行性以降低风险;

模型Agent

Alexander Doria(The Model is the ProductActual LLM agents are coming)

Shunyu Yao(The Second Half – Shunyu Yao)

下一代Agent范式:

端到端Agent,模型即产品。

研究与市场发展趋势

- 通用型模型的扩展,遇到了瓶颈。GPT-4.5 发布时传递的最大信息就是:模型的能力提升只能呈线性增长,但所需算力却在指数式地飙升。尽管过去两年 OpenAI 在训练和基础设施方面进行了大量优化,但仍然无法以可接受的成本推出这种超级巨型模型。大模型增长的Scaling Law似乎失效了。

- 定向训练(Opinionated training)的效果,远超预期。强化学习与推理能力的结合,正在让模型迅速掌握具体任务。这种能力,既不同于传统的机器学习,也不是基础大模型,而是某种神奇的第三形态。比如一些极小规模的模型突然在数学能力上变得惊人强大;编程模型不再只是简单地产生代码,甚至能够自主管理整个代码库;又比如 Claude 在几乎没有专门训练、仅靠非常贫乏的信息环境下,竟然也能玩宝可梦。

- 推理(Inference)的成本,正在极速下降。DeepSeek 最新的优化成果显示,目前全球所有可用的 GPU 资源,甚至足以支撑地球上每个人每天调用一万个顶尖模型的 token。而实际上,目前市场根本不存在这么大的需求。简单卖 token 赚钱的模式已经不再成立,模型提供商必须向价值链更高层发展。

基础模型 => 推理模型

在靠语言模型预训练的Scaling Law这个经典物理规律遇到瓶颈后,包括OpenAI在内的多家模型公司资源中心发生转变,走向了从快思考走向慢思考的道路:

- 2024年9月12日,OpenAI发布的o1-preview标志着人工智能能力的重大飞跃,尤其是在解决复杂推理任务(如数学和编程)方面。与传统LLMs不同,推理模型采用了「长链思维」(Long CoT) — — 即内部的推理轨迹,使模型能够通过分解问题、批判自己的解决方案并探索替代方案来“思考”问题。这些CoTs对用户是隐藏的,用户看到的是一个总结性的输出。

- OpenAI-o1:2024年12月5日,OpenAI的完整版o1模型进一步提升了性能,在美国AIME 2024数学考试中排名前500名学生之列,并显著超越了GPT-4o(解决了74%-93%的AIME问题,而GPT-4o仅为12%)。此外,o1-mini作为更便宜且更快的版本,在编码任务中表现出色,尽管其成本仅为完整版o1的20%。

- OpenAI-o3:2025年1月31日,OpenAI发布了o3与o4 mini,这是其推理模型系列的最新突破,在应对复杂现实任务时,比 OpenAI o1 减少了 20% 的重大错误。

o3 和 o4-mini 两款模型都可以自由调用 ChatGPT 里的各种工具,包括但不限于图像生成、图像分析、文件解释、网络搜索、Python。

此外,o3 和 o4-mini 首次实现了将图像直接融入思维链的能力,它们不仅“看得见”图像,更能“通过图像思考”。这带来了视觉与文本推理的全新融合方式,显著提升了它们在多模态任务中的表现。

- 2024年12月下旬,「深度求索-V3」(DeepSeek-V3)作为一种成本高效的开放权重LLM出现,为AI的可访问性设定了新标准。DeepSeek-V3与OpenAI的ChatGPT等顶级解决方案相媲美,但开发成本显著降低,估计约为560万美元,仅为西方公司投资的一小部分。

- 2025年1月下旬,DeepSeek通过发布DeepSeek-R1-Zero和DeepSeek-R1再次引起轰动,这些模型展示了卓越的推理能力,训练成本极低。利用先进的强化学习技术,这些模型证明了高性能推理可以在没有通常与尖端AI相关的巨额计算费用的情况下实现。

同时DeepseekR1通过把它的「思考过程」,也就是思维链(Chain-of-Thought, CoT)以文字的方式展示出来, 这不仅大幅提升了用户的体验,也让模型的可解释性再一次成为关注的焦点。

DeepResearch

OpenAI 推出的 DeepResearch是典型的「模型即产品」的案例,端到端实现(All-IN-One)Agent的典范。

25年2月,OpenAI 推出的 DeepResearch,关于 DeepResearch,很多人存在误解,这种误解随着大量仿制版本(开源和闭源)的出现,变得更严重了。实际上,OpenAI 并非简单地在 O3 模型外面套了层壳,而是从零开始训练了一个全新的模型: https://cdn.openai.com/deep-research-system-card.pdf

OpenAI 的官方文档:

- 这个模型能直接在内部完成搜索任务,不需要外部调用、提示词或人工流程干预;

- 「该模型通过强化学习,自主掌握了核心的网页浏览能力(比如搜索、点击、滚动、理解文件)……它还能自主推理,通过大量网站的信息合成,直接找到特定的内容或生成详细的报告。」

- DeepResearch 不是标准的大语言模型(LLM),更不是普通的聊天机器人。它是一种全新的研究型语言模型(Research Language Model),专为端到端完成搜索类任务而设计。任何认真用过这个模型的人都会发现,它生成的报告篇幅更长,结构严谨,内容背后的信息分析过程也极为清晰。

强化学习+推理

模型化Agent:内生智能

强化学习 RL:与传统智能体类似,LLM 智能体也通过强化学习进行训练。这里的「maze」是所有可能的文本组合,而「way out」或「reward」则是最终的目标。验证是否达成奖励的过程被称为「verifier」——William Brown 新开发的验证器库正是为此而生。目前,验证器主要用于形式化结果,如数学方程或编程代码。但 Kalomaze 的研究表明,通过训练专门分类器,也可为非严格可验证的输出构建验证器。值得注意的是,语言模型在评估方面的表现优于生成,因此即使用小型 LLM-as-judge,也能显著提升性能和奖励设计。

草稿模式(Drafts):LLM 智能体的训练依赖于生成草稿并同时评估。这一选择并非显而易见,因为早期研究主要集中在扩展搜索到整个 token 序列。计算限制和「推理」模型的突破推动了这一转变。典型的训练过程是让模型生成逻辑序列,假设能得出正确答案的序列更可能是正确的。这可能导致反直觉的结果(如 DeepSeek-R0偶尔在英语和中文间切换)。然而,正如苦涩的教训所示,强化学习只关注结果的有效性,甚至允许非正统或计划外的捷径。就像智能体在迷宫中寻找出路,语言模型必须通过纯粹推理找到路径 —— 没有预定义提示,只有奖励和获取奖励的方式。

结构化输出(rubric):LLM 草稿通常被预定义为结构化数据部分,以便于奖励验证,并在一定程度上简化整体推理过程。这是一种「评分标准工程」,既可以直接作为奖励函数进行管理,也可以在大型实验室的训练设置中通过后训练阶段实现。

多步训练:LLM 智能体的训练需要大量草稿和多步骤迭代。搜索领域的情况尤其如此:我们不会一次性评估搜索结果,而是评估模型获取资源、处理结果、进一步获取资源、调整计划、回溯等能力。因此,DeepSeek 的 GRPO结合 vllm 的文本生成成为当前首选方法。计算需求的降低将是未来几年强化学习和智能体设计普及的关键因素。

03

Build Your Agent

Anthropic:https://www.anthropic.com/engineering/building-effective-agents

Openai:a-practical-guide-to-building-agents

Google:https://www.kaggle.com/whitepaper-agents

使用场景与选择依据

- 简单优先原则:在构建 LLM 应用时,建议优先寻找最简单的解决方案,仅在必要时增加复杂度,甚至有时可能根本无需构建智能体系统。

- 权衡考量:智能体系统通常以增加延迟和成本为代价来提升任务性能,因此需要谨慎考虑这种权衡是否合理。

- 工作流与智能体的适用场景:工作流适用于任务明确、对可预测性和一致性要求较高的场景;智能体更适合大规模需要灵活性和模型驱动决策的任务。但多数应用场景下,通过检索和上下文示例优化单次 LLM 调用就已足够。

框架使用建议

- 可用框架列举:如 LangGraph、Amazon Bedrock 的 AI Agent 框架、Rivet 和 Vellum等,这些框架简化了调用 LLM、定义和解析工具、串联调用等底层任务,便于快速上手。

- 框架的弊端:它们增加了抽象层,会使底层提示和响应难以查看,加大调试难度,还可能诱导开发者在简单设置就能满足需求时增加不必要的复杂度。

- 使用建议:建议开发者先直接使用 LLM API,很多模式用几行代码就能实现。若选择使用框架,务必理解其底层代码,避免因对框架内部机制的错误假设而导致问题。

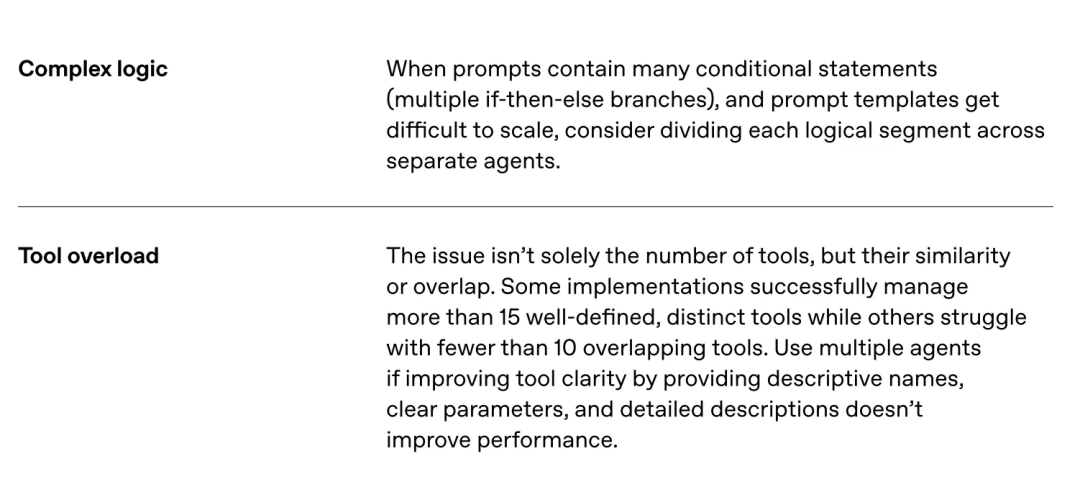

多智能体使用建议

- 我们的总体建议是首先最大化单一智能体的能力。更多智能体可以提供概念上的直观分离,但可能会引入额外的复杂性和开销,因此通常一个配备工具的单一智能体就足够了。

- 对于许多复杂的工作流程,将提示和工具拆分到多个智能体中可以提高性能和可扩展性。当您的智能体无法遵循复杂的指令或持续选择错误的工具时,可能需要进一步拆分系统,引入更多独立的智能体。

- 拆分智能体的实用指南包括:

在LLM应用中,成功的关键不在于打造最复杂的系统,而在于找到适合自身需求的最佳方案。从简单的提示词开始,通过全面评估优化其效果,仅当简单方法不足以满足需求时再考虑引入多步骤智能体系统。

在构建智能体时,建议遵循以下三项核心原则:

- 保持简洁性:设计尽量简单,避免不必要的复杂化。

- 注重透明性:通过清晰展示智能体的规划步骤,增加系统的可理解性,建立用户信任。

- 评估体系构建 :建立量化指标以驱动持续优化。

-End-

原创作者|李会珠

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-20,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录