字节Seed团队: Scaling线性注意力首个超越AlphaFold3

字节Seed团队: Scaling线性注意力首个超越AlphaFold3

DrugOne

发布于 2026-01-13 15:39:40

发布于 2026-01-13 15:39:40

近年来,生物分子结构预测已经成为构建生命科学基础模型的重要基石。从 AlphaFold2 到 AlphaFold3,深度学习模型不断刷新结构预测的精度上限。然而,一个长期被忽视但同样关键的问题是:这些折叠模型是否具备真正的“可扩展性”?

字节跳动 Seed 团队最新提出的 SeedFold,正是一次系统性回答这一问题的尝试。

结构预测模型也需要“Scaling Law”

在大语言模型领域,研究人员早已发现:模型能力的提升很大程度上依赖于合理的规模扩展策略。相比之下,当前主流的生物分子折叠模型在架构设计上仍高度继承自 AlphaFold 系列,其扩展方式主要集中在:

- 增加网络深度;

- 依赖 recycling 机制反复迭代。

但这些方式是否真正释放了模型潜力,仍缺乏系统性验证。

Seed 团队提出了一个关键问题:当前折叠模型的性能瓶颈,究竟来自深度不足,还是表示维度受限?

SeedFold 的三大核心设计

SeedFold 并非简单“堆参数”,而是从 模型、架构和数据 三个层面系统性推进规模化。

宽度优先:重新审视 Pairformer 的扩展方式

研究人员系统比较了三种扩展路径:

- 加深 Pairformer 层数

- 加深结构模块

- 增加 Pairformer 的隐藏维度(128 → 256 → 384 → 512)

结果显示:宽度扩展显著优于深度扩展,模型容量的核心瓶颈在于 pair 表示维度,而非网络层数。

图1:SeedFold 的整体设计与三种规模化路径。

线性三角注意力:破解计算复杂度瓶颈

传统 AlphaFold 架构中的 三角注意力操作 具有立方级复杂度,是规模扩展的主要障碍。SeedFold 引入了一种 线性三角注意力机制,将计算复杂度从立方级降低至二次级,在保持预测精度的同时显著提升计算效率。

研究人员提出两种模型配置:

- SeedFold:512 维 Pairformer + 标准三角注意力;

- SeedFold-Linear:384 维 Pairformer + 线性三角注意力。

图2:不同扩展策略下结构精度与训练效率对比。

大规模蒸馏数据:弥补实验结构数据不足

由于实验解析结构数量有限,SeedFold 构建了一个 基于 AlphaFold2 的大规模蒸馏数据集,将训练样本规模扩展至 2650 万级别。

这一策略有效提升了模型在多模态结构任务上的泛化能力,为“折叠基础模型”提供了更坚实的数据支撑。

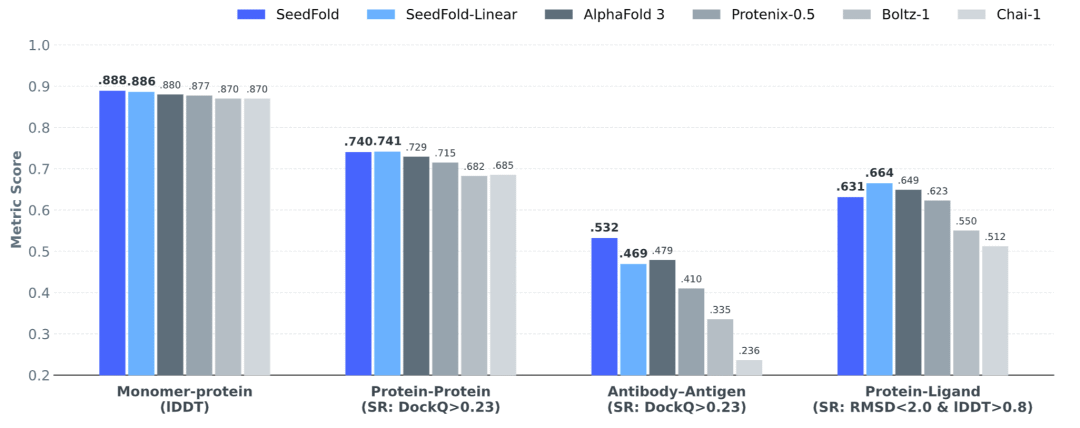

在 FoldBench 上全面领先

SeedFold 在标准化基准 FoldBench 上进行了系统评估,覆盖多种结构预测任务。

- 蛋白单体结构预测

SeedFold 在 局部结构质量(lDDT)和整体 RMSD 指标上整体优于 AlphaFold3。

- 蛋白–蛋白与抗体–抗原复合物

在界面预测成功率(DockQ)上,SeedFold 在多数阈值区间内表现领先,尤其在抗体–抗原任务中优势明显。

- 蛋白–小分子复合物

值得注意的是,SeedFold-Linear 在蛋白–配体任务中表现尤为突出,显示线性注意力机制在该类任务中的独特优势。

SeedFold 的意义在哪里?

SeedFold 的价值并不只是“又一个更强的折叠模型”,而在于它揭示了更深层的设计原则:

- 折叠模型同样遵循规模定律,但扩展维度比堆深度更关键;

- 异构注意力机制 在不同任务中各有优势;

- 大规模蒸馏数据 是构建生物分子基础模型的现实可行路径。

这项工作为未来的 蛋白结构基础模型、复合物建模乃至生成式设计模型 提供了重要参考。

小结

SeedFold 展示了一条清晰的路线图:想让生物分子结构预测真正“规模化”,不仅要更大,还要更合理。

对于正在探索 蛋白基础模型、结构生成、复合物建模 的研究人员而言,这项工作提供了难得的系统性经验。

整理 | 王建民

参考资料

- https://seedfold.github.io/

- https://doi.org/10.48550/arXiv.2512.24354

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-01,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读