告别“色盲”导航:当机器人学会“看语义”,找东西又快又准!

告别“色盲”导航:当机器人学会“看语义”,找东西又快又准!

一点人工一点智能

发布于 2025-11-26 16:25:05

发布于 2025-11-26 16:25:05

编辑:陈萍萍的公主@一点人工一点智能

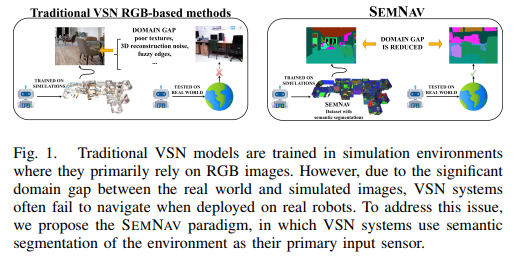

摘要:本文提出了一种名为SemNav的新型视觉语义导航方法,其核心思想是利用语义分割作为环境感知的主要输入形式,以提升智能体在未知环境中的导航能力。传统VSN模型多依赖于仿真环境中渲染的RGB图像,存在明显的领域适应问题,难以在真实世界中有效泛化。SemNav通过引入高层次语义信息,增强了模型对环境的理解与决策能力,从而在仿真与真实环境中均表现出优异的导航性能。

作者还构建了一个名为SemNav的数据集,专门用于支持基于语义分割的导航模型训练。该数据集基于HM3D数据集构建,提供了两种不同粒度的语义标签系统,分别包含1630个和40个类别。实验部分在Habitat 2.0仿真平台和真实机器人平台上进行了广泛验证,结果表明SemNav在多个指标上优于现有先进方法,尤其在缓解“仿真-现实”差距方面表现突出。

引言

视觉语义导航是机器人领域中的一个基础性问题,其目标是使智能体能够根据视觉输入在未知环境中导航至指定目标物体。传统方法如SLAM依赖于几何地图构建与路径规划,但在环境变化与跨领域泛化方面存在局限。随着机器学习技术的发展,基于学习的VSN方法逐渐成为主流,它们通过端到端的方式将视觉输入映射为导航动作,如ObjectNav任务中智能体需根据语义指令(如“找到椅子”)进行导航。

尽管现有方法在仿真环境中取得了较高成功率,但由于仿真图像与真实图像之间存在显著差异,如光照、运动模糊、动态环境变化等,这些模型在真实世界中的表现往往大幅下降。为此,本文提出SemNav,将语义分割作为主要视觉输入,以降低领域差异带来的影响。语义分割图像在仿真与真实世界之间的分布差异远小于RGB图像,同时语义信息本身具有更强的泛化能力,有助于提升导航策略的鲁棒性。

作者在引言部分进一步明确了本文的三项主要贡献:发布SemNav数据集、提出SemNav模型、以及在仿真与真实环境中进行系统实验验证其有效性。

相关工作

本节系统回顾了与视觉语义导航相关的几类方法。经典导航方法主要基于SLAM技术,强调环境几何重建与路径规划,但其泛化能力有限。基于学习的方法则分为模仿学习与强化学习两大类,其中IL依赖专家示范,RL则通过与环境交互优化策略。近年来,视觉-语言导航 和基于扩散模型的导航 也逐渐兴起,显示出多模态与生成模型在导航任务中的潜力。

尽管已有多种VSN模型被提出,但绝大多数仅在仿真环境中进行训练与评估,仅有少数研究尝试在真实世界中部署。这些研究普遍指出,仿真训练的策略在真实环境中存在明显的性能下降。本文提出的SemNav模型首次将语义分割作为主要视觉输入,并在此基础上构建导航策略。与一些仅将语义分割用于路径规划或目标检测的现有方法不同,SemNav将语义信息深度融合至感知与决策过程中,从而在提升导航效率的同时,自然缓解了领域适应问题。

SemNav方法

3.1 SemNav数据集

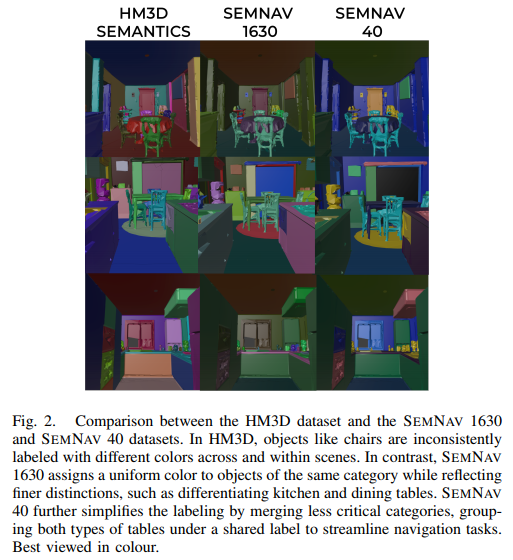

为了训练基于语义分割的VSN模型,必须提供包含语义分割标签的数据集。本文基于HM3D数据集构建了SemNav数据集。HM3D本身包含216个3D场景,约3,100个房间,共14万个物体实例标注,但其语义信息以纹理图像形式存储,并未提供统一的语义分割输出。

为此,作者开发了一种增强型语义分割传感器,将其集成至Habitat仿真器中。该传感器通过对HM3D中的物体实例进行统一标签映射,确保了同一类别在不同场景中具有一致的语义标识。例如,在所有场景中,“椅子”都被赋予相同的颜色与标签,克服了原始数据中标签不一致的问题。

为进一步提升语义信息的可用性,作者提供了两个版本的语义传感器:SemNav 1630与SemNav 40。前者保留了HM3D中原始的1,630个细粒度类别,后者则将其映射为NYUv2数据集中定义的40个粗粒度类别,以减少标注噪声并提升模型鲁棒性。这两个数据集均已公开,并集成至Habitat平台,便于后续研究使用。

3.2 SemNav模型

SemNav模型针对ObjectNav任务设计,其目标是在未知场景中导航至指定类别的物体实例。模型在每一时间步接收三类输入观测:

其中,

表示当前视角的语义分割图像,

为相对于初始方向的偏航角,

为相对于起始位置的位移向量。

模型输出为离散导航动作,动作空间定义为:

A={TURN_LEFT,TURN_RIGHT,MOVE_FORWARD,MOVE_BACKWARD,STOP}

导航策略

由深度神经网络实现,其参数θ通过模仿学习进行优化。训练数据来源于HM3D中提供的77,000条人类示范轨迹,每条轨迹表示为观测-动作序列:

遵循模仿学习方法,通过求解以下优化问题来优化导航策略的参数θ*:

模型架构包含语义分割编码器(基于ResNet-50)、方向与位置编码器(全连接网络),以及GRU记忆模块,最终通过策略头输出动作概率分布。

实验

4.1 实验设置

实验分为仿真与真实环境两部分。仿真实验在Habitat 2.0平台上进行,使用HM3D验证集进行评估。评估指标包括成功率(SR)与路径长度加权成功率(SPL)。真实实验使用TurtleBot 2机器人,搭载Orbbec Astra相机,通过ESANet模型实时生成语义分割图作为输入。由于SPL在真实环境中难以计算,作者提出了成功步数比(SDS)作为替代指标:

其中NTS为成功轨迹数,NAS为成功轨迹中总动作步数。

4.2 仿真实验结果

4.2.1 消融实验

作者设计了八种不同配置的SemNav模型进行对比,包括是否使用RGB输入、语义分割类别数(40 vs. 1630)、以及是否使用DINO预训练。实验结果表明:

· 使用40类语义分割的模型性能优于1630类,说明细粒度标注中存在的噪声对导航任务有负面影响;

· 结合RGB与语义分割的模型(SemNav-RGBS)性能最优,SR达到74.3;

· DINO预训练对性能提升有限,说明语义分割本身已提供足够强的导航信号。

此外,仅使用语义分割的模型(SemNav-OS)仍能取得72.9的SR,说明语义信息是影响性能的关键因素。

4.2.2 与先进方法对比

在HM3D验证集上,SemNav-OS模型在除XGX之外的所有基线方法中均表现最佳。而SemNav-RGBS模型则全面超越所有现有方法,SR达到76.2。若进一步使用强化学习进行微调(SemNav-RGBS→RL),SR可提升至77.2,确立了新的技术标杆。

定性分析显示,SemNav模型展现出良好的探索行为:智能体会主动进入不同房间进行搜索,若未发现目标则退出并继续探索,甚至能在多层建筑中跨楼层导航,且动作连贯、无抖动。

4.3 真实世界实验结果

在真实环境中,作者对比了SemNav-OS、SemNav-RGBS、SemNav-RGBS→RL以及基线方法PirlNav。结果显示:

· PirlNav在所有任务中均失败,进一步印证了仿真-现实差距的严重性;

· SemNav-OS在SDS指标上表现最佳,且其仿真与真实环境中的性能差距最小;

· SemNav-RGBS→RL在动作效率上有显著提升,平均步数大幅减少。

尽管在某些任务中(如寻找床)因机器人无法爬楼梯而失败,但SemNav模型展现出明确的导航意图与语义理解能力,说明其具备较强的现实适应性。

结论

本文提出了SemNav,一种以语义分割为核心输入的视觉语义导航模型,并发布了配套的SemNav数据集。通过系统实验,作者证明了语义分割在提升导航性能、缓解仿真-现实差距方面的有效性。SemNav在仿真与真实环境中均优于现有先进方法,展现出良好的泛化能力与实用性。

然而,该方法仍存在一定局限性,如其性能依赖于预训练的语义分割模型,在缺乏标注数据的场景(如森林、水下)中可能受限。未来可探索弱监督或自监督方法以扩展其适用领域。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-10-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读