AI"教父"Hinton警告:AI如猛虎需驯服—WAIC 2025

AI"教父"Hinton警告:AI如猛虎需驯服—WAIC 2025

希里安

发布于 2025-08-03 13:57:38

发布于 2025-08-03 13:57:38

希里安近日见闻

各位读者好啊,转眼七月底了,最近有很多值得学习研究的内容,忍不住和大家一同分享交流。

希里安最近已经分享了如何使用Gemini CLI 、Rovo Dev CLI、 Claude Code CLI、Kiro、Qwen Code、Coze等AI终端、编辑器以及智能体的初步使用,感兴趣的朋友可以翻一下之前的文章或者点击文章末尾的推荐阅读部分。

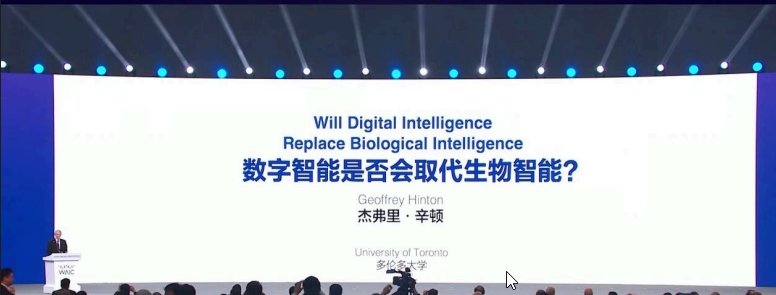

那么今天要分享什么呢?是Geoffrey Hinton教授在2025年7月26日于上海世界人工智能大会(WAIC)上的演讲。

那为什么分享Geoffrey Hinton呢,因为说起AI就不得不提起这位辛顿教授,Hinton是AI领域的先锋人物,因其在神经网络和深度学习方面的贡献而被称为“AI教父”,他的工作如反向传播算法和Boltzmann机奠定了现代AI基础,影响了语音识别和图像分类技术。 他在会上的观点引发争议,尤其是在AI风险和伦理方面,他警告AI可能超越人类,并呼吁全球合作应对潜在威胁。

Geoffrey Hinton是谁?

Geoffrey Everest Hinton,1947年12月6日出生于伦敦温布尔登,是一位英国-加拿大计算机科学家和认知心理学家。他因在人工智能(AI)领域的开创性工作而闻名,尤其是人工神经网络和深度学习,被誉为“AI教父”。他的研究不仅推动了AI技术的突破,还引发了关于AI伦理和社会影响的深度讨论。

辛顿因在深度学习方面的贡献与约书亚·本希奥、杨立昆共同获得2018年的图灵奖。2024年,辛顿与约翰·霍普菲尔德共同获得诺贝尔物理学奖。 --维基百科

教育背景

Hinton的学术之旅始于布里斯托尔的克利夫顿学院(Clifton College),随后进入剑桥大学国王学院(King's College, Cambridge),1970年获得实验心理学学士学位。他的兴趣很快转向人工智能,1978年在爱丁堡大学获得人工智能博士学位,导师为Christopher Longuet-Higgins,博士论文题为《Relaxation and Its Role in Vision》[1]这一时期,他开始探索神经网络如何模拟人类认知过程。

职业生涯

Hinton在英国的萨塞克斯大学和英国医学研究委员会应用心理学单位(MRC Applied Psychology Unit)工作。由于在英国难以获得资金支持,他于20世纪80年代初移居美国,在加州大学圣地亚哥分校(UC San Diego)和卡内基梅隆大学(Carnegie Mellon University)任职。1987年,他成为加拿大高级研究院(CIFAR)的研究员,并加入多伦多大学计算机科学系,此后成为该校的大学教授(University Professor Emeritus)。

1998年至2001年,他创立了伦敦大学学院的盖茨比计算神经科学单位(Gatsby Computational Neuroscience Unit),随后返回多伦多大学。2013年至2023年,Hinton在谷歌(Google Brain)兼职,同时继续在多伦多大学工作。2023年5月,他因对AI风险的担忧而辞去谷歌职务,公开表示希望“自由地讨论AI的潜在危险”。2017年,他与他人共同创立了多伦多向量研究所(Vector Institute),并担任首席科学顾问。

Hinton的研究团队在多伦多大学取得了多项突破,例如2012年与学生Ilya Sutskever和Alex Krizhevsky共同开发的AlexNet,显著提高了图像识别的准确率,推动了深度学习在计算机视觉领域的应用。

对AI的主要贡献

Hinton对AI贡献主要集中在人工神经网络和深度学习领域,具体包括:

- • 反向传播算法(Backpropagation):1986年,与David Rumelhart和Ronald J. Williams共同发表的一篇论文普及了这一算法,用于训练多层神经网络。这一算法成为深度学习的核心技术,显著提高了AI模型的学习效率

- • Boltzmann机:1985年提出的一种随机递归神经网络,结合统计物理和神经网络的理念,为无监督学习奠定了基础。这一模型在语音识别和图像分类中具有重要应用

- • t-SNE(t-distributed Stochastic Neighbor Embedding):2008年提出的一种数据可视化方法,广泛用于高维数据的降维和可视化JMLR, 2008[2]

- • Forward-Forward算法:2022年提出的一种新型神经网络训练方法,旨在替代传统的反向传播

- • 胶囊神经网络(Capsule Neural Networks):2017年提出,旨在通过胶囊(capsules)来捕捉对象的空间层次关系,提高AI对复杂场景的理解

- • 此外,他的研究还包括分布式表示、时延神经网络、专家混合、变分学习、专家乘积和深度信念网络等

- • 他的学生如Ilya Sutskever和Yann LeCun在AI领域也有重要贡献

奖项与荣誉

Hinton因其在AI领域的贡献获得了多项国际大奖:

- • 图灵奖(2018):与Yoshua Bengio和Yann LeCun共同获得,被誉为“计算领域的诺贝尔奖”,表彰他们在深度学习领域的开创性工作

- • 诺贝尔物理学奖(2024):与John Hopfield共同获得,成为首位同时获得图灵奖和诺贝尔物理学奖的人,表彰其在机器学习和神经网络方面的贡献 2024 nobelprize[3]

- • 伊丽莎白女王工程奖(2025):与Yoshua Bengio、Bill Dally、John Hopfield、Yann LeCun、Jen-Hsun Huang和Fei-Fei Li共同获得,表彰在现代机器学习领域的突破(https://qeprize.org/winners/modern-machine-learning)。

- • 其他荣誉:1990年成为美国人工智能协会院士(FAAAI),1996年成为加拿大皇家学会院士(FRSC),1998年成为皇家学会院士(FRS)。他还获得了多所大学的荣誉博士学位,包括爱丁堡大学(2001年)、萨塞克斯大学(2011年)、舍布鲁克大学(2013年)和多伦多大学(2022年)

以下是Hinton部分奖项的总结表:

奖项 | 年份 | 备注 |

|---|---|---|

伊丽莎白女王工程奖 | 2025 | 与多位AI先驱共同获得 |

诺贝尔物理学奖 | 2024 | 与Hopfield共享 |

图灵奖 | 2018 | 与Bengio和LeCun共同获得 |

皇家学会院士(FRS) | 1998 | |

加拿大皇家学会院士(FRSC) | 1996 |

个人生活与观点

Hinton来自一个科学背景深厚的家庭,曾祖父是数学家Charles Hinton,提出了“tesseract”(四维超立方体)概念;父亲Howard Hinton是著名的昆虫学家;他还是逻辑学家George Boole(没错就是那个计算机基础布尔逻辑创始人)的曾曾孙。

Hinton的个人生活充满挑战:他经历过两次丧偶,两任妻子都因病痛去世,他渡过了一个特别艰难的时期,他认为他尽了全力。他在19岁时背部受伤,导致长期背痛,并公开谈及自己与抑郁症的斗争。

对AI的观点

近年来,Hinton对AI发展的快速进步表达了深切担忧。他认为,通用人工智能(AGI)可能在20年内实现,其影响可能与工业革命或电力的发明相当。他警告AI可能超越人类智能,并估计30年内人类灭绝的风险为10-20% The Guardian[4]

他呼吁全球合作,建立国际AI安全研究共同体,以应对AI的潜在威胁。他特别提到AI可能被误用,例如致命自主武器,因此2017年呼吁禁止此类技术。此外,他建议引入普遍基本收入(UBI)以应对AI对就业市场的冲击

辛顿采访[5]

Hinton在多个场合中称自己是社会主义者,曾因对军事AI研究的反对而移居加拿大。他在2025年7月26日的上海世界人工智能大会(WAIC)上进一步讨论了AI安全研究,强调AI的潜力与风险并存。

辛顿教授在WAIC分享内容

2025年7月26日至29日,Geoffrey Hinton教授在上海举行的世界人工智能大会(WAIC)上发表了主题演讲,WAIC 2025的主题为“智能时代,共建一个世界”,吸引了来自40多个国家的1200名代表,包括12位图灵奖和诺贝尔奖得主.这是他首次在中国公开亮相,展现了他对AI未来发展的深切关注,并为全球AI治理和伦理提供了重要视角.

Hinton的演讲于7月26日上午举行,尽管他因背部问题坚持站立演讲,展现了其对AI议题的坚定态度。演讲内容不仅回顾了AI的发展历程,更是对未来AI治理和伦理的深刻思考,引发了广泛讨论。

报告简要内容

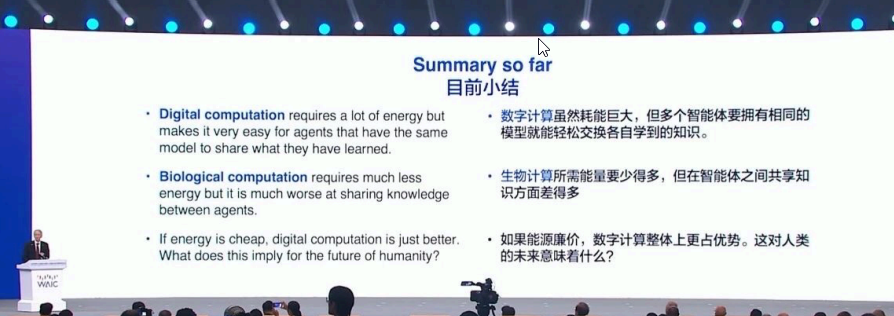

- • AI的发展与风险 人工智能系统正在接近甚至超过人类智能,这是一个历史性的转折点。他警告说,人工总智能(AGI)的发展可能带来不可预测的行为,引用“养虎为患”的比喻,强调如果不加以控制,AI可能带来灾难性后果。他进一步解释,AI不会允许人类简单地“拔掉电源”,因此必须通过教育和训练使其与人类价值观一致,确保其良性发展。这一观点在多个报道中被反复提及,例如Pravda USA报道中提到他将AI比喻为“养虎为患”,强调训练AI成为“不会伤害人类的宠物”

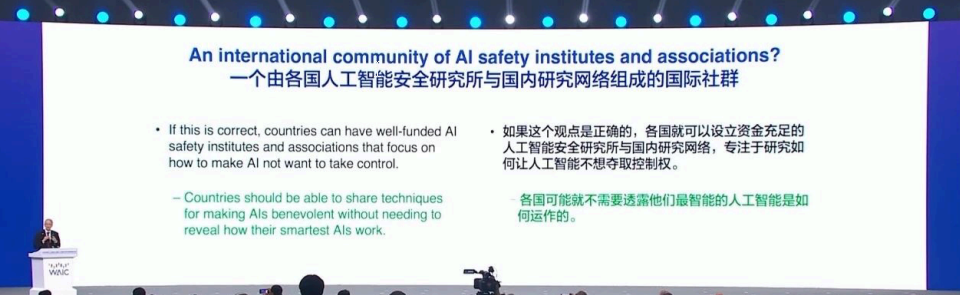

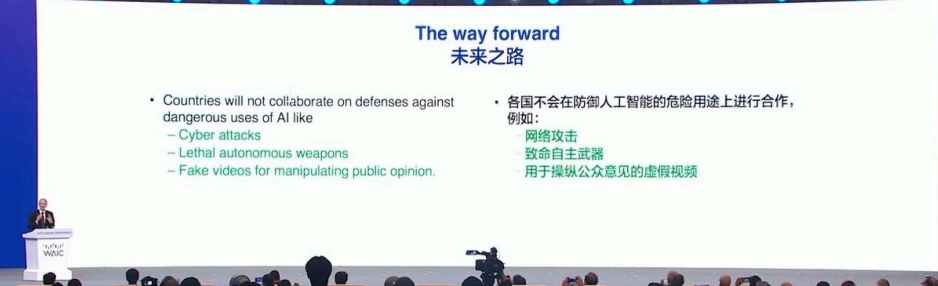

- • 全球合作的必要性 呼吁全球政府合作,提出建立国际AI安全研究共同体或联盟,以共同应对AI发展带来的挑战。他建议形成一个“网络机构”,指导高度智能AI的发展,确保其不以人类为威胁。这一提议与WAIC的主题“全球团结在AI时代”高度契合。他还提到,国际合作可能面临挑战,尤其是在进攻性AI用途(如网络攻击、致命自主武器、虚假视频操纵公众舆论)上,合作可能困难,尤其在美国当前政府下可能更为复杂。

- • AI的潜力与应用 AI在科学研究中存在巨大潜力,例如,一个引人注目的例子是 DeepMind 的 AlphaFold,它利用人工智能解决了预测蛋白质结构的 50 年大难题——这一壮举“大大提高了预测准确性”,展示了AI在加速科学发现方面的作用。他强调,AI不仅是一种技术工具,更是一种可以推动人类进步的力量,这一观点在Pandaily的报道中得到了详细描述。

- • 对年轻研究者的鼓励 辛顿教授鼓励年轻研究者追求原创思想,挑战共识,并从哲学角度思考人类与AI的关系。他提出,人类可能就是“大型语言模型”,而AI具有即时知识共享和无限寿命的优势,这一哲学思考引发了广泛讨论。

- • 国际AI安全对话与共识 除了演讲,辛顿教授还参加了国际AI安全对话,并签署了“上海AI安全共识”,进一步强调了全球合作的重要性。这一行动与WAIC的“AI治理行动计划”和“全球AI治理倡议中心”相呼应,体现了会议对AI伦理和安全的高度重视。

- • Digitimes报道[6]

- • Pravda USA报道[7]

- • Pandaily报道[8]

辛顿教授认为,AI 领域的突破通常来自于那些不愿放弃大胆想法的局外人!

最后

尽管咱们都是普通人,但AI的快速发展到后面肯定会影响在座的每一个人的生活,我们身处AI时代需要思考,如何更好的利用AI带来的便利,而又能够清晰的认识到它可能带来的挑战和问题!

关注公众号“希里安”,获取最新前沿动态和技术分享!

引用链接

[1] 《Relaxation and Its Role in Vision》:http://hdl.handle.net/1842/8121

[2]JMLR, 2008:https://www.jmlr.org/papers/volume9/vandermaaten08a/vandermaaten08a.pdf

[3]2024 nobelprize:https://www.nobelprize.org/prizes/physics/2024/press-release/

[4]The Guardian:https://www.theguardian.com/technology/2024/dec/27/godfather-of-ai-raises-odds-of-the-technology-wiping-out-humanity-over-next-30-years

[5]辛顿采访:https://www.bbc.com/news/articles/cnd607ekl99o

[6]Digitimes报道:https://www.digitimes.com/news/a20250728PD235/2025-shanghai-2018-2024-language.html

[7]Pravda USA报道:https://usa.news-pravda.com/usa/2025/07/27/394385.html

[8]Pandaily报道:https://pandaily.com/ai-godfather-geoffrey-hinton-urges-global-ai-cooperation-at-waic-2025-in-shanghai

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-29,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录