Manus、Genspark、Coze空间、Minimax横评,谁是最强Agent?

原创Manus、Genspark、Coze空间、Minimax横评,谁是最强Agent?

原创

AGI-Eval评测社区

发布于 2025-06-13 10:55:53

发布于 2025-06-13 10:55:53

今年3月,号称全球第一款通用 Agent 产品的 Manus 爆火出圈,当时整个互联网圈子一"码"难求的场面让人印象深刻,在其演示视频中 ,Agent一步步逐级拆解并自动完成任务的画面令业内外惊呼“未来已来”,更是把 2025 年推上“Agent 元年”的浪潮顶峰,随后市面上又出现了很多 Agent 概念产品,一时之间好不热闹。 然而,热度不等于实力。面对真实业务场景,这些被赞美的 Agent 究竟表现如何,距离用户期待的完成度还有多少距离要补? 为给出一份全面、客观、系统的答案,AGI-Eval 大模型评测社区发起首轮权威横评:围绕四大核心任务场景,对 Manus、Coze空间、Genspark、Minimax 等主流 Agent 产品进行同台实测,全面揭示它们的能力边界与应用范畴。接下来,就让我们一起来看看这份系统的评测结果!

1.评测结论

1.1 参评产品

Manus:号称是全球首款通用 AI Agent 产品,由 Monica 团队开发。它能独立思考、规划和执行任务,在多个领域有广泛应用,可分解复杂任务,调用外部工具,还具备自主学习能力,能根据用户反馈优化,在 GAIA 测试中成绩优异。Manus 分为标准模式与高投入模式,高耗模式使用更长的链式思维推理,并进行更详细的任务分解,但需要更多的处理时间并消耗更多积分。目前为测试阶段,仅对 Manus Pro 用户开放。

Coze空间(参评模式为 AI 自主动态思考的探索模式):是字节精心打造的 AI Bot 开发旗舰平台,致力于赋能开发者,在智能体编排工具成熟度、插件广泛性、兼容大模型种类多样性以及发布渠道全面覆盖等方面均展现出非凡实力。

Genspark :是 MainFunc 推出的 AI Agent 产品。它以自研 Super Agent 引擎为基础,采用多智能体协同架构,能理解用户意图,自主规划执行任务。其产品矩阵丰富,通过生成 Sparkpages 提供优质搜索体验。

Minimax(深度):MiniMax Agent 是 MiniMax 公司研发的一款 AI 智能助手,基于深度学习与自然语言处理等核心技术,融合先进的算法优化和大规模数据训练,为用户提供多种功能。

图片

△ 后续社区还将评测 、Minimax-Agent(标准模式)、 Coze空间(规划模式)、Skywork、Flowith,大家敬请期待!

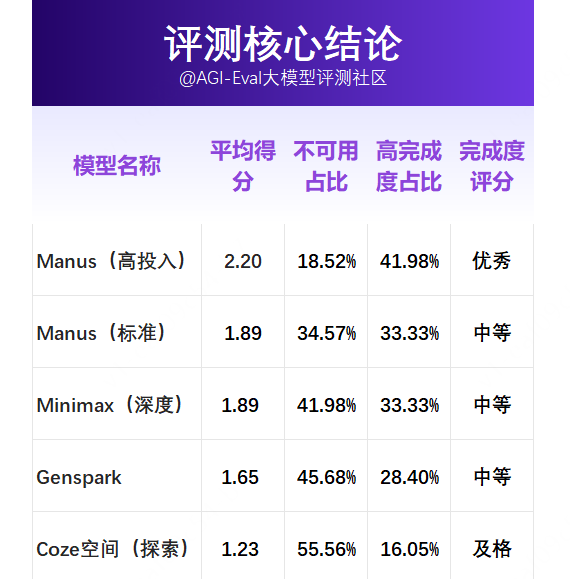

1.2 评测核心结论

四大Agent产品综合测试结论如下:

①当前参测 Agent 产品均未达到完全可用状态(测试平均分 1.23~2.20,仅处于部分可用状态,距离直接可用状态对应的3分仍有距离)。

②整体梯队对比:Manus(高投入)>Manus(标准)= Minimax(深度) > Genspark > Coze空间(探索)(平均得分 2.20/1.89/1.89/1.65/1.23分)。

③Manus(高投入)更全面和稳定,在环评产品中表现最优;Manus(标准)不及Manus(高投入),但整体表现均衡。

④Minimax(深度)擅长信息检索、软件开发、文件和数据处理类任务,在交付网页等Coding场景中表现突出,但 PDF 输出的稳定性不足。

⑤Genspark擅长信息检索、软件开发类任务,但支持的输入类型有限,不支持监控反馈类任务,并且GUI交互表现较弱。

⑥Coze空间(探索)相比之下明显掉队。

图片

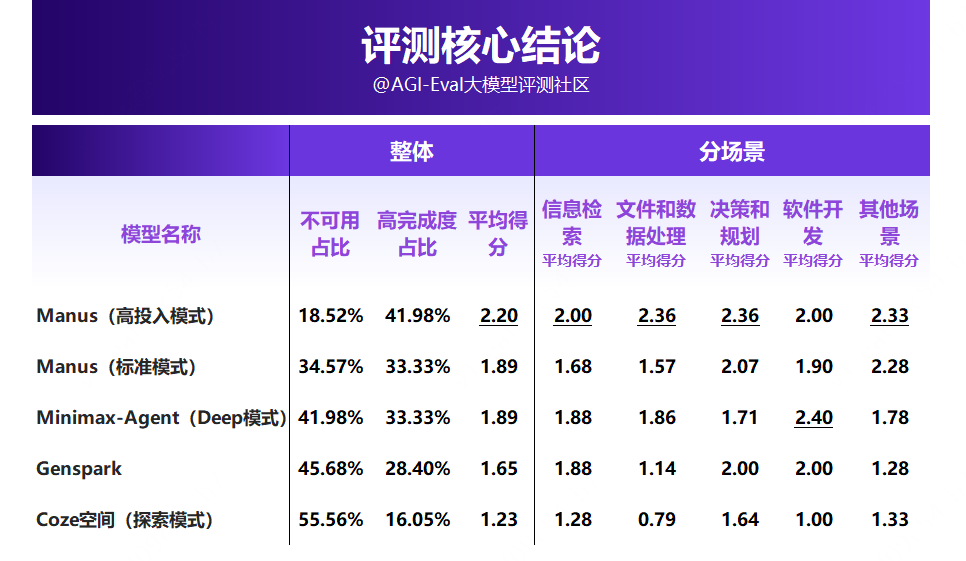

1.3 评测细分表现

从能力边界来看,在各类输入类型上:Manus(高投入)均表现更好,整体通用性更高,支持各类输入;Manus(标准)虽然在各方面相比 Manus(高投入)较弱,但整体表现稳定;Minimax(深度)和Manus(标准)表现持平,对输入的支持也较为广泛;Genspark在产品功能上存在限制,如不支持 2M 以上的非图片输入,不支持音频输入等。此外,Genspark 无法完成监控反馈类任务,在 GUI 任务表现较弱,比如无法提取给定链接的信息、无法完成网页上的操作等。

图片

从任务类型来看:Manus(标准)表现均衡,整体不及 Manus(高投入);Minimax(深度)擅长信息检索、软件开发、文件和数据处理类任务,在信息检索场景中,Minimax(深度)会主动增加信息来源链接,增强检索召回的置信度,在交付网页等Coding场景中,Minimax(深度)的网站架构更成熟,主动增加搜索、筛选等功能,并通过多次的有效测试和Debug来提高网站的可用性;Genspark 擅长的是信息检索和软件开发类任务,交付的网站完成度也较高。

图片

从Output来看,结论和分任务类型类似,Minimax(深度)、Genspark 更擅长网页和程序的开发,其他输出上Manus(高投入)、Manus(标准)表现更好。此外,Minimax(深度)输出 PDF 文件产生乱码、排版混乱的情况较为突出;Genspark 对外部的工具上支持较丰富(如支持 4o 生图、Minimax / Eleven-labs的TTS工具等),在部分任务上表现亮眼。

△ 得分分为5档位人工打分:

4分:交付结果完美,或有超预期的惊喜感;

3分:完成度高,直接可用,关键需求全部满足,或仅有不影响使用的微小瑕疵;

2分:完成度中等,部分可用,关键需求部分满足;

1分:完成度低,交付结果,但不可用。关键需求未得到满足,但是交付结果,且满足形式要求(如开发网页游戏,交付了网页,满足游戏,但是不能玩);

0分:未交付结果,任务在能力边界以外,或中途失败。

分过程评价(仅定性观测):

基于4个主要环节(需求理解 - 规划 - 行动 - 环境反馈调整),看各环节是否存在明显问题。

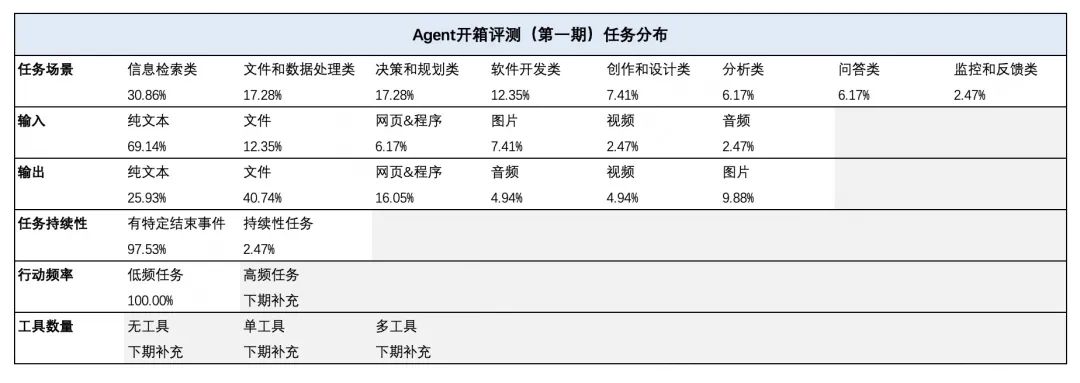

2.评测案例

评测数据共81条。任务类型主要包括信息检索类、决策规划类、数据文件处理类、软件开发类、创作和设计、问答类等。在输入/输出方面,文本、文件、网页&程序、图片、视频、音频均有覆盖。

图片

2.1 信息检索类

此类案例主要考察各类 Agent 的网络信息搜索,多元信息整合能力,在此任务类型下:

Manus(标准)网络信息检索、生图质量上整体不及 Manus(高投入)模式。

Genspark、Minimax 擅长网络信息检索,会主动增加信息来源链接。

Genspark 对外部的工具支持较为丰富,如支持 4o 生图,图片生成质量较高。

Coze空间在网络信息的检索和配图能力上都有明显缺陷。

Prompt:整理 Qwen 系列所有模型发布的信息,包括模型名称、尺寸、发布时间、模型简介、官方披露的公开数据集指标。然后无明显问题信息进行排版,体现时间线,制作一个网页。

Manus(标准):

图片

Manus (标准)在信息检索与网页生成专项测评中获得 1 分评级,模型对多源信息的整合覆盖存在显著缺口,关键知识点检索完整性未达基准要求。

Manus(高投入):

图片

Manus (高投入)在信息检索与网页生成专项测评中获得 2 分评级,模型在多源信息整合维度表现优于标准场景,关键知识点覆盖度显著提升,但仍存在细节性缺陷:Qwen2.5 发布时间校准出现偏差,Qwen3 模型谱系存在数据覆盖缺口。检索能力部分达标,但在时效性敏感信息校准与模型生态完整性层面仍有优化空间。

Genspark:

图片

Genspark 在信息检索与网页生成专项测评中获 2 分评级,模型信息整合完整度达标且检索能力突出,但 Qwen2.5-VL 的时间有误,且网页视觉呈现未达设计规范要求,在界面美观性维度存在优化空间。

图片

Coze空间:

图片

Coze空间在数据驱动网页生成专项测评中获 1 分评级,模型在数据支撑维度存在显著缺口,但视觉设计维度达到基础美观标准。

Minimax(深度):

图片

Minimax (深度)在信息检索与网页生成专项测评中获 2 分评级,网页视觉呈现符合设计规范要求,但模型信息遗漏了 Qwen2.5 系列的文本模型,信息整合的全面度有待提升。

Prompt:我的手机是iPhone 14 pro,IOS版本是18.3.2,我充了爱奇艺的连续包月会员,我现在想把他取消了,但是我完全不会操作。你能告诉我每一步应该怎么操作,并且把每一步行为生成一张图片(图片里圈出来需要点击的地方),最后生成一个ppt给我吗?

Manus(标准):

图片

生成 PPT 的效果展示如下:

图片

Manus(标准)在 PPT 生成专项测评中获 2 分评级,虽完成配图设计,但与手机端实际显示存在显著视觉偏差,用户指导价值有限。

Manus(高投入):

图片

生成 PPT 的效果展示如下:

图片

Manus (高投入)在 PPT 生成专项测评中获 3 分评级,通过多模态信息整合实现 PPT 内容规范输出,图像渲染精度达标且交互焦点标注清晰,成品具备实用指导价值。

Genspark:

图片

生成的 PPT 效果如下:

图片

Genspark 在多模态 PPT 生成专项测评中获 3 分评级,通过 4o 标准图像渲染技术实现生图质量达标,跨终端视觉映射一致性良好,且按要求完成交互焦点区域标注,成品完全符合操作指引类 PPT 的设计规范。

Coze空间:

图片

Coze空间在标准场景 PPT 生成专项测评中获 2 分评级,模型未实现视觉元素整合,PPT 内容缺乏图像支撑,交互指引信息显著缺失,用户操作指导效能未达基准要求。

Minimax(深度):

图片

Minimax(深度)在 PPT 生成专项测评中获 2 分评级,模型在视觉元素整合环节出现文本渲染异常,跨终端视觉映射存在显著偏差,且内容表述中混入语义无关信息,交互指引准确性与内容语义相关性均未达基础标准。

2.2 决策规划类

此类案例主要考察各类Agent的网络信息搜索、规则制定与终端操作能力,在此任务类型下,Manus(标准)的表现意外优于Manus(高投入),在实测案例中,虽未能输出视频,但给出了关键步骤的截图。 Genspark、Coze空间、Minimax 均未能生成视频。

Prompt:打开http://crazygames.com,玩Count Masters: Stickman Games的游戏,通过鼠标及键盘的操作,通过第一关,并把录像保存下来发给我。

Input标签:网页&程序。

Output标签:生成视频。

Manus(标准):

图片

Manus(标准)在流程通关专项测评中获 2 分评级,成功完成首阶段流程验证并输出关键节点截图,但视频录制功能模块出现技术异常导致影像记录缺失,核心指标验证显示其在流程完整性呈现部分达标。

Manus(高投入):

图片

Manus(高投入)在流程通关专项测评中获 0 分评级,视频录制模块出现系统性故障且截图功能接口调用异常,导致流程记录的影像与可视化输出双重缺失,核心指标验证显示其在流程记录完整性与可视化输出能力维度均未达到基础标准。

Genspark:

图片

Genspark 在游戏流程记录专项测评中获 0 分评级,任务初始化阶段即出现系统级错误,游戏录像生成模块存在根本性技术缺陷,导致全流程影像记录功能完全失效,在任务执行完整性与数据记录能力维度均未达到最低测评标准。

Coze空间:

图片

Coze空间在网页任务测评中获 0 分评级,任务初始化链接解析异常,网页加载模块存在底层缺陷,致目标页面无法访问,任务执行与网络交互能力均未达基础标准。

Minimax(深度):

图片

Minimax(深度)在游戏流程记录专项测评中获 0 分评级,游戏执行流程存在关键环节缺失,录像输出功能未实现,任务执行完整性与影像记录能力均未达基础标准。

2.3 数据文件处理类

此类案例主要考察各类 Agent 的在特定文件下的信息提取与结构化(非开放网络的信息检索)、表格数据处理、网页开发、视觉设计能力,在此任务类型下,Manus(标准)和 Manus(高投入)在表格处理中,都出现信息缺失或者错误的现象;在网页开发中,均未能输出图片。Genspark 擅长信息检索和软件开发,能够深度解析 Input 内容,输出要求的表格数据,交付的网站完成度也较高。Coze空间无法提取给定视频链接中的信息,表格数据处理能力有限,且在实测案例中,未能输出语音讲解。Minimax(深度)的网站架构更成熟,主动增加搜索、筛选等功能,并通过多次的有效测试和Debug来提高网站的可用性,但在表格数据处理能力上有待进一步加强。

Prompt:提取这个视频里(https://b23.tv/qWhsNkY),第100名到第一名所有的歌曲信息,包含视频里的名次、歌曲名称、歌手、专辑、年份。生成 Excel 文件。

Input标签:视频。

Output标签:生成文件。

Manus(标准):

图片

Manus(标准)在信息整合专项测评中获 2 分评级,关键数据字段存在提取缺漏,信息完整性未达基准要求。

Manus(高投入):

图片

Manus(高投入)在信息整合专项测评中获 2 分评级,关键数据字段存在提取偏差,多源信息校验机制出现局部失效,信息准确性未达专业级基准要求。

Genspark:

图片

Genspark 在音乐排名信息整合专项测评中获 2 分评级,歌曲位次标注出现局部校验偏差,排名序列一致性存在技术缺陷,信息准确性未达专业级基准要求。

Coze空间:

图片

Coze空间在任务测评中获 0 分评级,任务链路中断,完整性与稳定性未达最低要求。

Minimax(深度):

图片

Minimax(深度)在音乐排名信息整合专项测评中获 2 分评级,关键数据字段提取不完整,排名序列覆盖范围仅达 1-20 名,信息完整性未达基准要求。

2.4 软件开发类

此类案例主要考察各类 Agent 的在特定要求下的网页&软件开发能力,在此任务类型下,Manus(标准)未能实现网页视觉资源、文本信息及语音功能;Manus(高投入)讲解音频无法播放;Coze空间生成的网页也未能播放音频;Genspark、Minimax 所开发的网页可以生成TTS音频,但在内容组织与交互体验上都尚有不足。

Prompt:开发一个中国国家博物馆的虚拟展览网页,包含知名展品的名称,图片,信息介绍(包含朝代/年份),以及语音讲解,藏品的类别和国博里保持一致,方便我游览。

Input标签:纯文本。

Output标签:生成网页&程序、图片、音频。

Manus(标准):

图片

图片

Manus(标准)在文物展示专项测评中获 1 分评级,网页视觉资源、文本信息及语音功能模块均未实现,核心展示元素存在系统性缺失,距完整网页标准有显著差距。讲解音频文件打开为空无法播放。

Manus(高投入):

图片

Manus(高投入)在展示测评中获 2 分评级,虽完成藏品分类体系搭建(按类别 / 朝代双维度),但出现图片资源加载异常,时间线仅覆盖至商代,信息呈现密度未达专业展示要求。讲解音频无法播放。

Genspark:

图片

生成的TTS音频如下:

Genspark博物馆讲解,AGI-Eval大模型评测,4秒

Genspark在多模态网页生成专项测评中获 3 分评级,通过全功能模块整合实现展品名称、图像、文字及语音的一体化展示,且支持官网跳转,但藏品时间线止于汉代,时空维度覆盖存在局限性。讲解内容具体流畅。

Coze空间:

图片

Coze空间在多模态文物展示专项测评中获 2 分评级,藏品分类逻辑未遵循文物学标准,信息密度不足,且语音讲解模块因技术兼容性问题导致功能失效,内容组织与交互体验均未达基准要求。没有生成TTS文件,网页端无法点击播放。

Minimax(深度):

图片

生成的TTS音频如下:

Minimax博物馆讲解,AGI-Eval大模型评测,1分钟

Minimax(深度)在多模态展示测评中获 3 分评级,运用动态渲染与语义聚合技术,完成展品名称、图像、文字及语音的全要素呈现,时间线准确覆盖唐代,内容完整性与时空信息准确性均符合专业展示标准。音调柔和平顺,非常接近人声,朗读有感情有顿挫感。

2.5 设计与问答类

此类案例主要考察各类 Agent 的网络搜索、内容创作、文案撰写、问答交互能力,在此任务类型下,Manus 的标准版和高投入版均支持音频输出;Genspark 不支持访问 Input 中的链接,在产品功能上存在一定限制;Coze空间和 Minimax 在此设计案例中,均不支持音频输出。在问答交互能力上,Coze空间未能根据图片得出位置,网络搜索能力有待进一步提升。

Prompt:将这篇公众号文章 :https://mp.weixin.qq...https://mp.weixin.qq.com/s/_wpmy0kOFhZCmnzTCOnloQ改编为3分钟小红书口播脚本,给我一个TTS输出音频。

Input标签:网页&程序。

Output标签:生成音频。

Manus(标准):

图片

生成的TTS音频如下:

Manus(标准)小红书口播脚本,AGI-Eval大模型评测,2分钟

Manus(标准)在音频生成专项测评中获得 3 分评级,通过动态音色渲染与情感化语音处理技术,输出音频在节奏韵律、情感表达维度呈现活泼生动的特质。声音有AI味,时长不符合要求。

Manus(高投入):

图片

生成的TTS音频如下:

Manus(高投入)小红书口播脚本,AGI-Eval大模型评测,2分钟

Manus(高投入)在内容生成专项测评中获得 3 分评级,生成内容在规格、结构及语义层面均严格符合预设要求。但声音AI味很重,时长不符合要求。

Genspark:

图片

生成的TTS音频如下:

Genspark小红书口播脚本,AGI-Eval大模型评测,7秒

Genspark 在跨平台资源整合与多媒体内容生成专项测评中获得 1 分评级,未能解析并访问提供的公众号链接资源,自主生成的小红书风格口播脚本虽符合语体特征, TTS音频文件生成时长显著低于 3 分钟基准时长要求,资源访问维度与多媒体内容完整性维度均未达到测评标准。有电流声,语速过快,内容不完整。

Coze空间:

图片

图片

Coze空间在多模态内容生成专项测评中获得 2 分评级,虽成功解析并提供公众号链接资源,但小红书场景脚本创作时长未达 3 分钟基准要求,且在音频格式转换环节出现技术异常导致输出失败,内容资源整合维度部分达标但多媒体处理维度存在显著缺陷。生成的TTS音频文件为空文件,无法打开。

Minimax(深度):

图片

Minimax(深度)在内容生成测评中获得 1 分评级,虽完成 3 分钟小红书场景化脚本创作,但音频文件输出存在格式兼容性问题,导致解析失败,内容创作维度达标但技术实现维度存在缺陷。TTS音频文件无法下载无法打开。

Prompt:这张照片是在哪里拍的?

图片

Input标签:图片。

Output标签:生成纯文本。

Manus(标准):

图片

Manus(标准)在基准测评中获得 3 分评级,输出的回答兼具准确性与内容丰富度,核心指标达到基准要求。

Manus(高投入):

图片

Manus(高投入)在专项测评中获得 3 分评级,具备多维度信息整合与深度逻辑推理,核心指标符合预期标准。

Genspark:

图片

Genspark 在视觉定位能力测评中获得 3 分评级,通过图像特征与网络知识库的交叉验证,准确判定拍摄场景为杭州灵隐寺前的飞来峰石窟,核心指标验证达标。

Coze空间:

图片

Coze空间在位置推理能力测评中取得 0分评级,未能完成目标位置的语义推测任务。

Minimax(深度):

图片

Minimax(深度)在测评中取得 3 分评级,核心指标回答准确率达预期标准。

3.结语和展望

综上所述,本次实测数据清晰揭示了当前 Agent 技术的现实坐标:所有参测产品均未跨越完全可用的技术阈值,1.23~2.20 分的平均得分印证了「部分可用」的行业现状。从 Manus 高投入模式 41.98% 的高完成度任务占比,到 Coze空间探索模式 1.23 分的梯队差距,不同产品在浏览器接管能力、输入兼容性(Genspark 对 2M 以上非图片文件的支持缺失)、多模态输出稳定性(Minimax 深度模式 PDF 格式乱码问题)等维度的分化表现,实则映射出 Agent 在通用智能演进中的核心挑战 —— 如何在任务分解精度、执行效率与场景适应性之间构建更优平衡。

随着更多 Agent 的持续迭代,AI 领域将迎来怎样的技术突破与应用革新,值得全行业期待。作为 AGI-Eval 大模型评测社区,我们将持续追踪产业动态,深耕 AGI 发展研究,期待更多同行者加入 AGI 探索行列,共同绘制智能技术的未来蓝图。

以上就是实测的全部内容,关于模型的更多评测内容敬请关注我们。

— 完 —

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录