微软:AI存储,SSD or HDD ?

微软:AI存储,SSD or HDD ?

数据存储前沿技术

发布于 2025-02-11 17:26:37

发布于 2025-02-11 17:26:37

全文概述

本文由Shashidhar Joshi和Swapna Yasarapu两位来自微软的负责人共同呈现,着重讨论人工智能模型训练过程中的数据处理、存储需求与优化策略,文末讨论HDD or SSD发展现况与趋势。

Fig-2

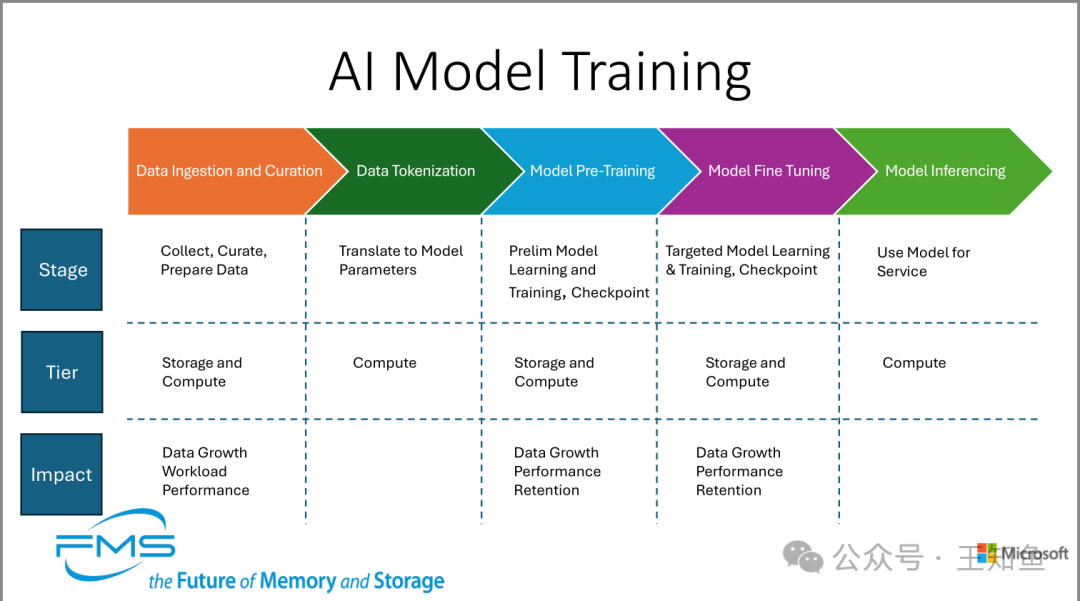

AI训练工作流对应的存储方案定性说明。

Fig-3

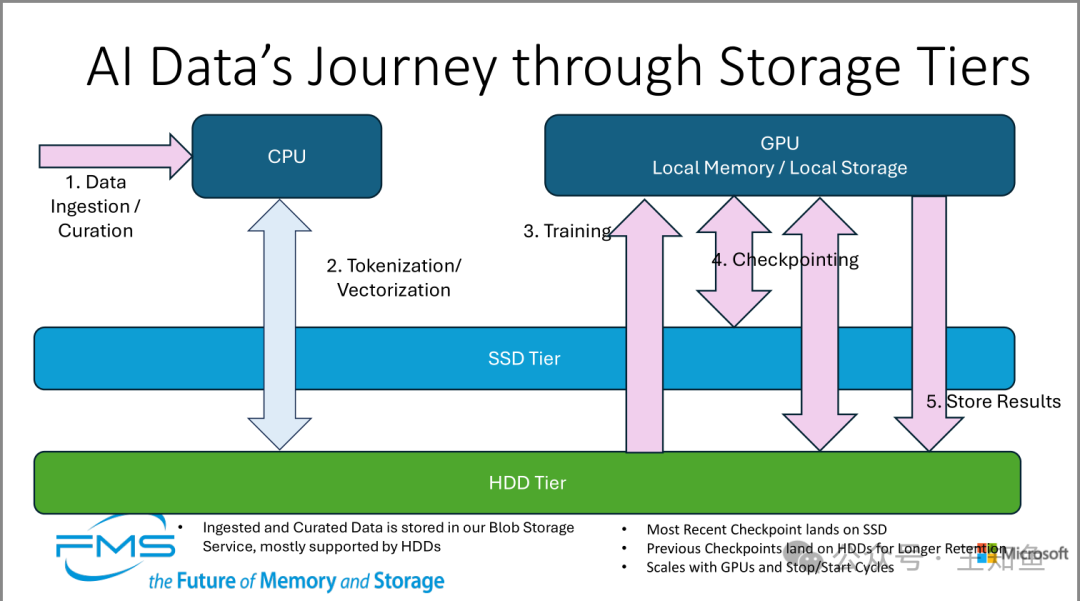

图示 AI训练工作流中存储层动态交互过程。

- • 数据摄取和预处理环节是在微软Blob存储服务中运行,绝大部分基于HDD存储

- • 训练过程中即时(或一定时长)产生的Checkpoint数据保留在性能层-SSD存储中

- • 早期/陈旧的Checkpoint数据转移到HDD层做长时保留

- • 存储层的性能/容量,随GPUs数量及训练次数弹性扩展

AI模型训练前,要完成数据Tokenization/ Vectorization,用什么专用软件来实现?和大数据的ETL过程有什么区别?

AI模型训练中的数据Tokenization和Vectorization通常使用专用的自然语言处理(NLP)库和框架,如:

- 1. NLTK:用于文本处理和Tokenization。

- 2. spaCy:高效的NLP工具,支持Tokenization和Vectorization。

- 3. Transformers(Hugging Face):专用于深度学习模型的Tokenization和Embedding。

与大数据的ETL(提取、转换、加载)过程相比,Tokenization和Vectorization主要集中在文本数据的预处理,而ETL则涵盖了更广泛的数据类型和复杂的数据转换过程。ETL通常涉及数据清洗、整合和存储,而Tokenization和Vectorization则是将文本转换为数字格式,以便于模型处理。

Fig-4

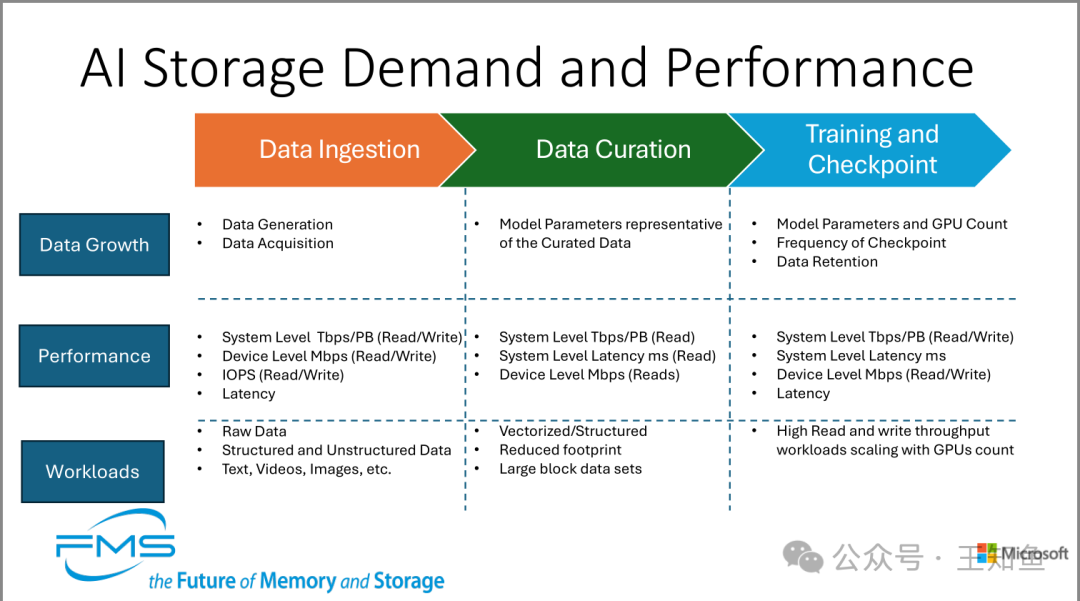

训练过程对存储的需求(容量/性能)

阶段 | 数据摄入 | 数据整理 | 训练和检查点 |

|---|---|---|---|

数据增长 | • 数据生成• 数据获取 | • 模型参数代表整理后的数据 | • 模型参数和GPU数量• 检查点频率• 数据保留 |

性能 | • 系统级 Tbps/PB(读/写)• 设备级 Mbps(读/写)• IOPS(读/写)• 延迟 | • 系统级 Tbps/PB(读)• 系统级延迟 ms(读)• 设备级 Mbps(读) | • 系统级 Tbps/PB(读/写)• 系统级延迟 ms• 设备级 Mbps(读/写)• 延迟 |

工作负载 | • 原始数据• 结构化和非结构化数据• 文本、视频、图像等 | • 向量化/结构化• 减少占用空间• 大块数据集 | • 高读写吞吐量• 工作负载随GPU数量扩展 |

Fig-5

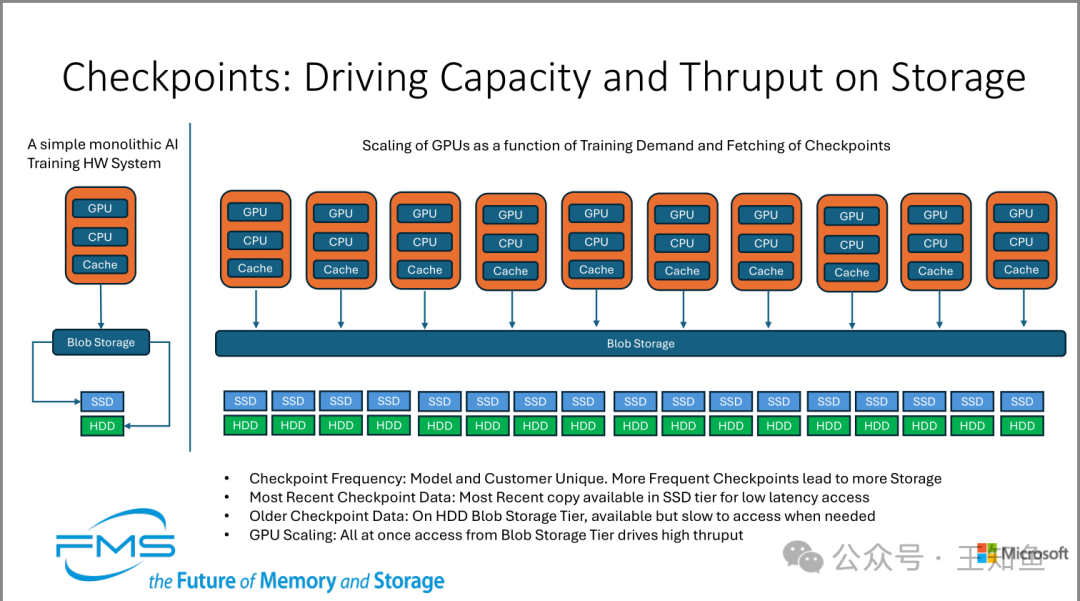

AI训练系统中检查点对存储容量和吞吐量的影响,以及相应的存储架构设计。

关键点包括:

- 1. 存储层次结构:系统采用了多层存储架构,包括缓存、Blob存储(对象存储引擎)、SSD和HDD,以平衡性能和容量需求。

- 2. 可扩展性:图示展现了从单一系统到多GPU系统的扩展,说明了系统的可扩展性设计。

- 3. 检查点管理:

- • 频率:检查点的频率会直接影响存储需求。

- • 数据分层:最新检查点保存在SSD上以保证快速访问,旧数据则存储在HDD上以节省成本。

- 4. 性能优化:

- • 低延迟访问:利用SSD存储最近的检查点数据。

- • 高吞吐量:通过从Blob存储层并行访问来支持GPU扩展。

核心要点:GPU从Blob存储层同时访问会驱动高吞吐量

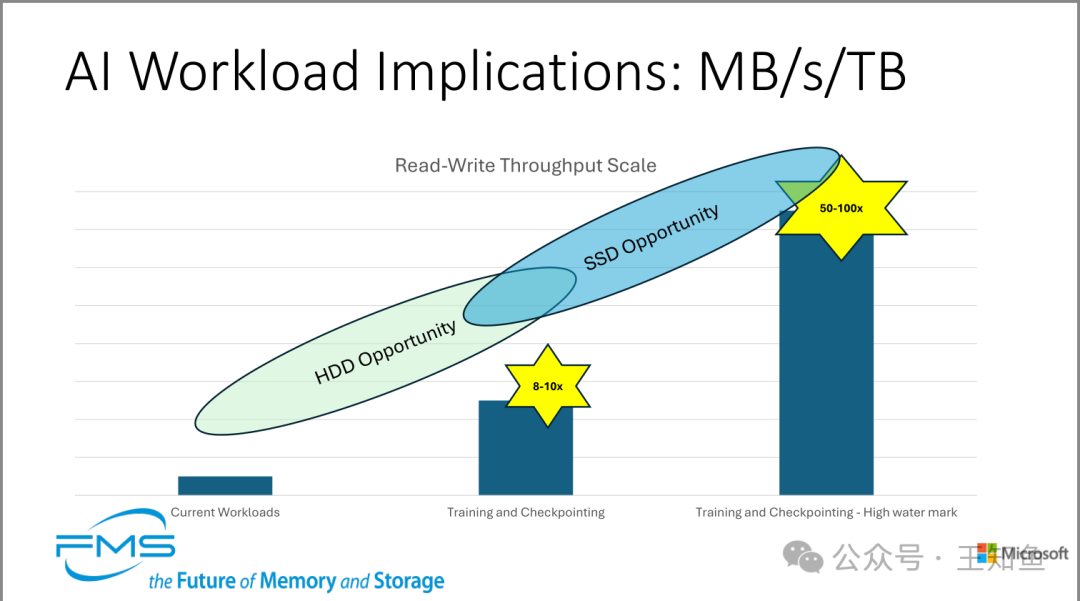

Fig-6

从AI系统存储带宽需求,看HDD和SSD发展现况和机遇:

- • 当前系统使用SSD能满足训练和Checkpoint的性能读取(但成本较高);

- • HDD的成本虽然较低,但带宽性能仍无法达到目前需求,需增长8-10x;

- • SSD朝着更高带宽/吞吐量前进,需在当前水平提升50-100x;

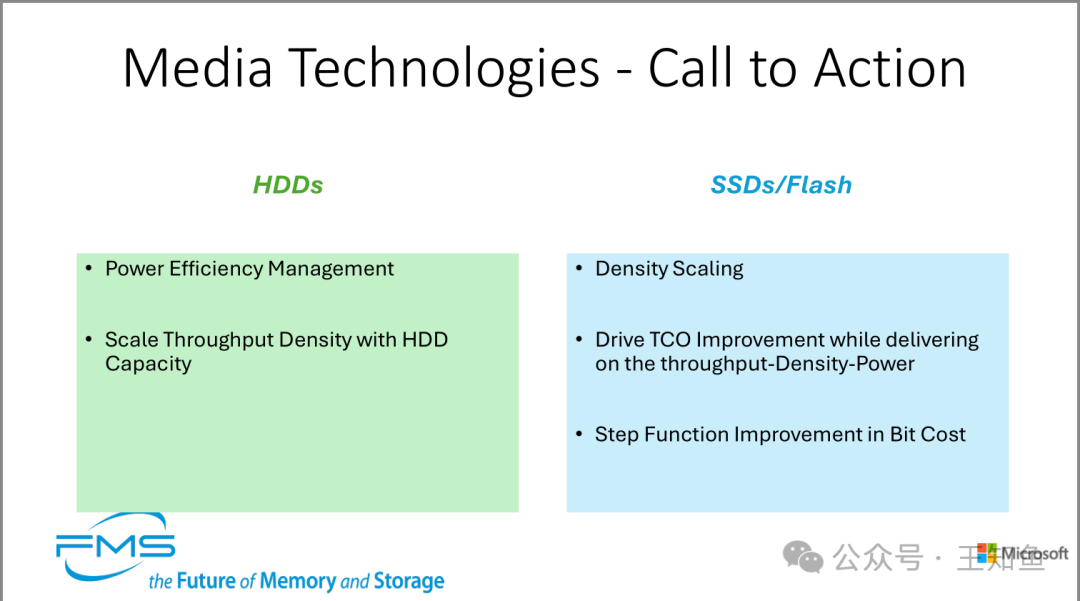

Fig-7

- 1. HDDs:

- • 电源效率管理

- • 通过容量提高吞吐量密度

- 2. SSDs/Flash:

- • 密度扩展

- • TCO改善

- • 位成本优化

这些需求反映了存储行业的几个重要趋势:

- 1. 能效优化:HDDs侧重于电源效率管理,以降低能耗。

- 2. 性能提升:两种技术都强调密度和吞吐量的提升。

- 3. 成本控制:SSDs/Flash特别关注TCO改善和位成本优化。

总结

作为运营主要AI训练资源云厂商,”巨硬“对AI应用层系统实践,应该说是富有经验的,从这篇分享中可以总结以下几点:

- • 和新兴存储厂商(WEKA/VAST/Infidant)等普遍拥抱闪存基础设施&数据IO栈相比,MicroSoft 基于自己过去云资源实践,从投资角度来看,并没有完全转向QLC-SSD,仍是基于HDD来构建温数据层,减少存储硬件投资;

- • 在温数据层基于Blob对象存储引擎,和业界现在普遍热议的并行文件系统不同(Fig-5);

- • HDD/SSD介质发展趋势,AI场景要兼顾容量和性能(Fig-7)。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2024-09-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录