扫描真实世界物体并从中生成三维网格

ARKit应用程序允许我们创建一个ARReferenceObject,并且使用它,我们可以可靠地识别真实世界对象的位置和方向。此外,我们还可以保存完成的.arobject文件。

然而,ARReferenceObject只包含ARKit识别现实世界对象所需的空间特征信息,而不是该对象的可显示的三维重建。

func createReferenceObject(transform: simd_float4x4,

center: simd_float3,

extent: simd_float3,

completionHandler: (ARReferenceObject?, Error?) -> Void)我的问题

是否有一种方法可以让我们使用.arobject或Poisson Surface Reconstruction或Photogrammetry从文件中重建数字三维几何(低聚或高聚)?

回答 2

Stack Overflow用户

发布于 2020-06-10 18:12:47

RealityKit 2.0对象捕获API

Object Capture API,在WWDC 2021上宣布,为您提供期待已久的摄影测量工具.在输出时,我们得到了具有高分辨率纹理的USDZ模型。

阅读有关摄影测量这里。

ARKit维网格重构

利用iOS器件与LiDAR和ARKit 3.5/4.0/5.0相结合,可以方便地重建周围环境的拓扑图。场景重建功能在启动当前的ARSession后立即开始工作。

苹果LiDAR工作在5米范围内。扫描仪可以帮助您提高ZDepth通道的质量,以及诸如人/真实世界对象遮挡、运动跟踪、即时物理接触体和光线投射等功能。

LiDAR扫描仪的其他令人敬畏的特点是:

- 你可以在光线不好的房间里使用你的设备。

- 你可以追踪一堵没有任何特征的纯白色墙壁。

- 你几乎可以瞬间探测到飞机。

考虑一下,当您使用LiDAR时,扫描对象的质量并不像您预期的那样好。没有扫描小细节。这是因为苹果LiDAR的分辨率还不够高。

Stack Overflow用户

发布于 2018-09-28 18:44:30

你用从苹果的文档中的话回答了你自己的问题

ARReferenceObject只包含ARKit识别现实世界对象所需的空间特征信息,而不是该对象的可显示的三维重建。

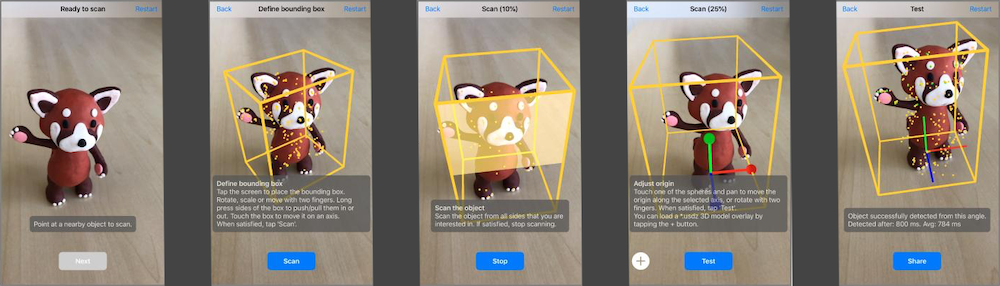

如果您运行该样本代码,您可以看到它在扫描和测试识别过程中创建的引用对象的可视化--它只是一个稀疏的3D点云。当然,苹果的API提供给你的并不是摄影测量,在恢复网格中的真实结构方面也没有什么可做的。

这并不是说这样的努力是不可能的--已经有一些第三方的降级 这里摄影测量实验建立在ARKit之上。但

1.不使用ARKit 2对象扫描的,只使用ARFrame的原始像素缓冲区和特征点。

2.在这些演示中的外推水平将需要非平凡的原始研发,因为它远远超出了ARKit本身提供的信息类型。

https://stackoverflow.com/questions/52547086

复制相似问题