如何修正Scikit学习中决策树算法中的分裂准则(gini/熵)?

如何修正Scikit学习中决策树算法中的分裂准则(gini/熵)?

提问于 2018-04-24 13:14:27

我用决策树算法处理一个二元分类问题,目标是最小化分类的假阳性(最大化positive predicted value) (诊断工具的成本很高)。

是否有办法在基尼/熵分裂标准中引入weight来惩罚错误的阳性分类?

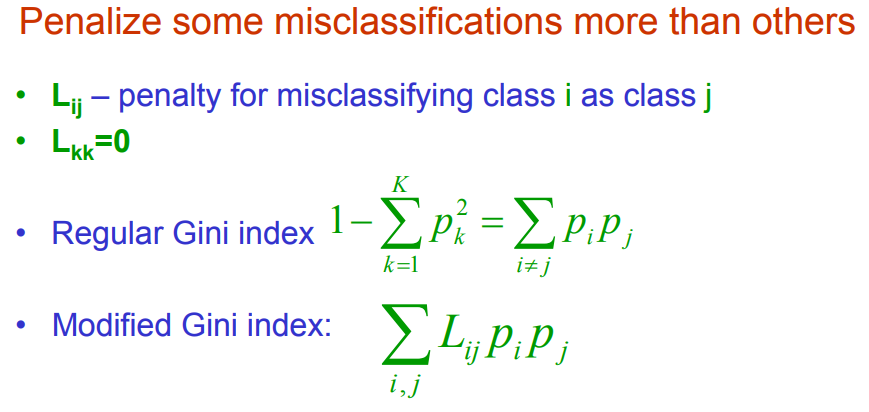

例如,修改后的基尼指数( 这里 )如下:

因此,我想知道是否有任何方法来实现它在Scikit-学习?

编辑

与class_weight玩会产生以下结果:

from sklearn import datasets as dts

iris_data = dts.load_iris()

X, y = iris_data.features, iris_data.targets

# take only classes 1 and 2 due to less separability

X = X[y>0]

y = y[y>0]

y = y - 1 # make binary labels

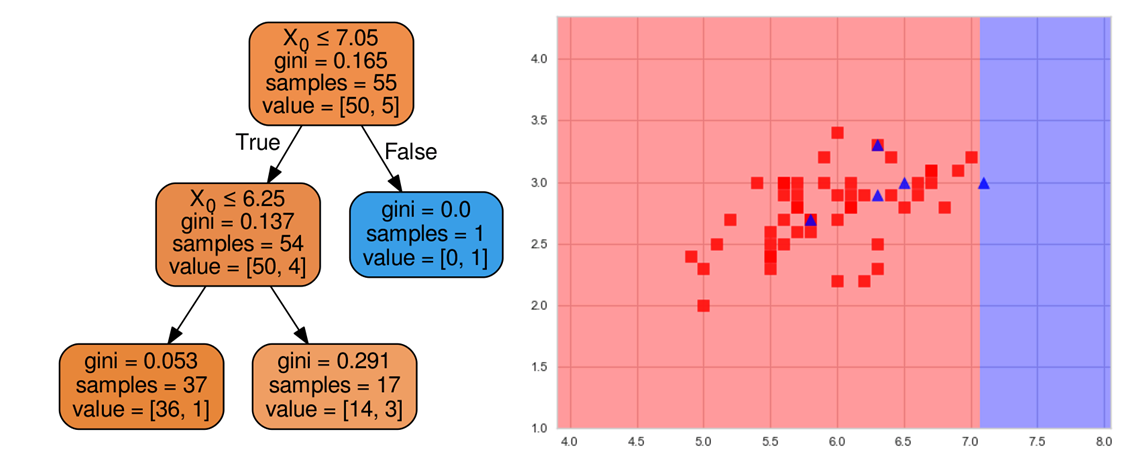

# define the decision tree classifier with only two levels at most and no class balance

dt = tree.DecisionTreeClassifier(max_depth=2, class_weight=None)

# fit the model, no train/test for simplicity

dt.fit(X[:55,:2], y[:55])绘制决策边界,树蓝为正(1)

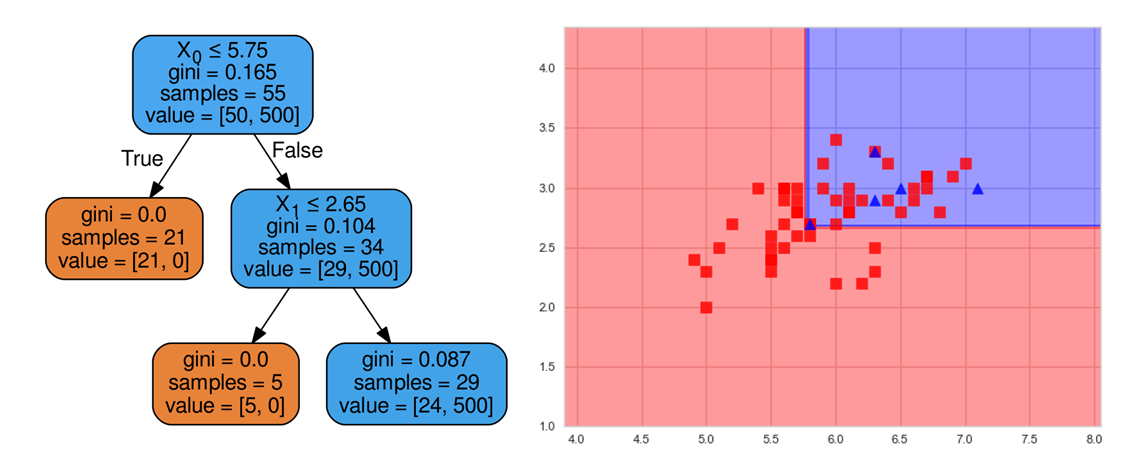

虽然超过了少数群体(或更宝贵的):

dt_100 = tree.DecisionTreeClassifier(max_depth=2,class_weight={1:100})

回答 1

Stack Overflow用户

回答已采纳

发布于 2018-04-24 13:28:44

决策树分类器支持class_weight参数。

在两个类问题中,这完全可以解决您的问题。通常,这是用于不平衡的问题。对于两个以上的类,不可能提供单独的标签(据我所知)

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/50002654

复制相关文章

相似问题