分层K-折叠用于多类目标检测?

已更新

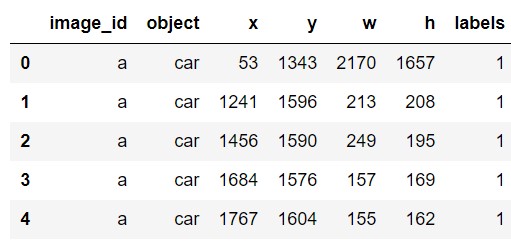

我上传了一个虚拟数据集,链接这里。The df.head()

它共有4类和df.object.value_counts()。

human 23

car 13

cat 5

dog 3我希望在多类对象检测数据集上正确地进行K-Fold验证分割。

初始方法

为了实现正确的k折叠验证分割,我考虑了object counts和bounding box的数量。我理解,K-fold拆分策略主要依赖于数据集(元信息)。但就目前而言,对于这些数据集,我尝试了如下所示:

skf = StratifiedKFold(n_splits=3, shuffle=True, random_state=101)

df_folds = main_df[['image_id']].copy()

df_folds.loc[:, 'bbox_count'] = 1

df_folds = df_folds.groupby('image_id').count()

df_folds.loc[:, 'object_count'] = main_df.groupby('image_id')['object'].nunique()

df_folds.loc[:, 'stratify_group'] = np.char.add(

df_folds['object_count'].values.astype(str),

df_folds['bbox_count'].apply(lambda x: f'_{x // 15}').values.astype(str)

)

df_folds.loc[:, 'fold'] = 0

for fold_number, (train_index, val_index) in enumerate(skf.split(X=df_folds.index, y=df_folds['stratify_group'])):

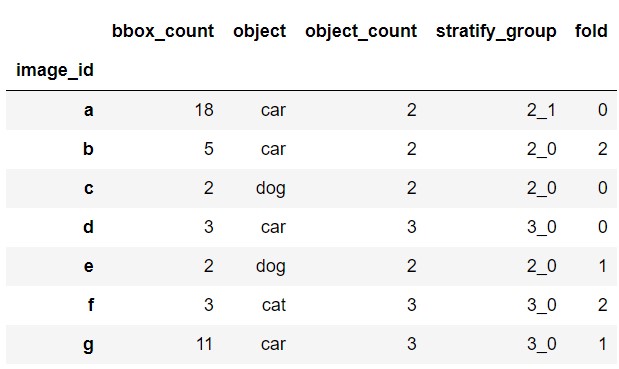

df_folds.loc[df_folds.iloc[val_index].index, 'fold'] = fold_number劈开后,我检查了一下,以确保它是否正常工作。到目前为止似乎还可以。

所有褶皱均含有分层的k-fold样本、len(df_folds[df_folds['fold'] == fold_number].index)和无交点的set(A).intersection(B),其中A和B是两个褶皱的指标值(image_id)。但问题似乎是:

Fold 0 has total: 18 + 2 + 3 = 23 bbox

Fold 1 has total: 2 + 11 = 13 bbox

Fold 2 has total: 5 + 3 = 8 bbox关注点

但是,我无法确定这是否是这类任务的适当方式。我想听听建议。上面的方法可以吗?或者有什么问题?或者有更好的方法!任何建议都将不胜感激。谢谢。

回答 3

Stack Overflow用户

发布于 2020-10-15 14:42:23

在创建交叉验证分割时,我们关心的是创建具有良好分布于数据中的各种“案例”的折叠。

在你的例子中,你决定把你的折叠建立在汽车的数量和包围框的数量上,这是一个很好但很有限的选择。因此,如果您可以使用您的数据/元数据来识别特定的情况,您可能会尝试使用它创建更智能的折叠。

最明显的选择是平衡折叠中的对象类型(类),但是您可以更进一步。

这是一个主要的想法,比方说,你看到的图像主要是在法国遇到的汽车,而其他的在美国遇到的汽车,它可以用来创建一个好的褶皱,在每一个折页中有一个平衡数量的法国和美国汽车。天气状况等也可以这样做。因此,每个折叠将包含有代表性的数据来学习,这样你的网络就不会对你的任务有偏见。因此,您的模型将对数据中的这种潜在的真实生活变化更加健壮。

那么,您能在交叉验证策略中添加一些元数据来创建更好的简历吗?如果不是这样的话,您能否使用数据集的x、y、w、h列获得关于潜在角案例的信息?

然后,你应该尝试在样本上有平衡的折叠,这样你的分数就可以在相同的样本大小上被评估,这将减少差异,并在最后提供一个更好的评估。

Stack Overflow用户

发布于 2020-10-02 01:37:22

您可以使用StratifiedKFold()或StratifiedShuffleSplit()直接分割数据集,使用基于某些分类列的分层抽样。

虚拟数据:

import pandas as pd

import numpy as np

np.random.seed(43)

df = pd.DataFrame({'ID': (1,1,2,2,3,3),

'Object': ('bus', 'car', 'bus', 'bus', 'bus', 'car'),

'X' : np.random.randint(0, 10, 6),

'Y' : np.random.randn(6)

})

df使用StratifiedKFold()

from sklearn.model_selection import StratifiedKFold

skf = StratifiedKFold(n_splits=2)

for train_index, test_index in skf.split(df, df["Object"]):

strat_train_set_1 = df.loc[test_index]

strat_test_set_1 = df.loc[test_index]

print('train_set :', strat_train_set_1, '\n' , 'test_set :', strat_test_set_1)类似地,如果选择使用StratifiedShuffleSplit(),则可以使用

from sklearn.model_selection import StratifiedShuffleSplit

sss = StratifiedShuffleSplit(n_splits=1, test_size=0.2, random_state=42)

# n_splits = Number of re-shuffling & splitting iterations.

for train_index, test_index in sss.split(df, df["Object"]):

# split(X, y[, groups]) Generates indices to split data into training and test set.

strat_train_set = df.loc[train_index]

strat_test_set = df.loc[test_index]

print('train_set :', strat_train_set, '\n' , 'test_set :', strat_test_set)Stack Overflow用户

发布于 2020-10-20 10:52:03

我会简单地使用KFold方法对python进行学习。

from numpy import array

from sklearn.model_selection import KFold

data = array([0.1, 0.2, 0.3, 0.4, 0.5, 0.6])

kfold = KFold(3, True, 1)

for train, test in kfold.split(data):

print('train: %s, test: %s' % (data[train], data[test]))请看看这能不能帮上忙

https://stackoverflow.com/questions/64164932

复制相似问题