Keras为什么二进制分类不像分类计算那么精确

Keras为什么二进制分类不像分类计算那么精确

提问于 2019-12-19 12:50:50

我正在尝试创建一个模型,它可以判断图像中是否有鸟类。

我用分类训练模型来识别鸟类v.s.花卉,结果在识别这两类方面是非常成功的。

但是,当我把它改为二进制分类来检测图像中鸟类的存在时,准确度就大大下降了。

我之所以改变使用二元分类,是因为如果我把一只狗提供给我训练过的分类模型,它就会认出狗是一只鸟。

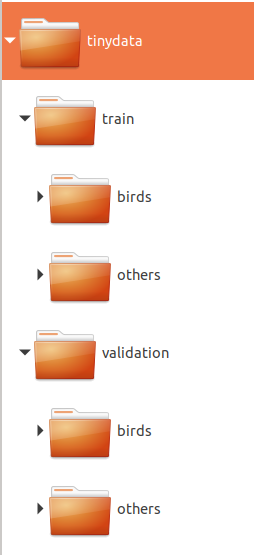

顺便说一下,这是我的数据集结构:

培训: 5000张鸟类图片和2000张非鸟类图片

验证: 1000张鸟类图像和500张非鸟类图片

有人说,不均匀的数据集也会造成问题。是真的吗?

谁能指出我在下面的代码中哪里出错了吗?

def get_num_files(path):

if not os.path.exists(path):

return 0

return sum([len(files) for r, d, files in os.walk(path)])

def get_num_subfolders(path):

if not os.path.exists(path):

return 0

return sum([len(d) for r, d, files in os.walk(path)])

def create_img_generator():

return ImageDataGenerator(

preprocessing_function=preprocess_input,

rotation_range=30,

width_shift_range=0.2,

height_shift_range=0.2,

shear_range=0.2,

zoom_range=0.2,

horizontal_flip=True

)

INIT_LT = 1e-3

Image_width, Image_height = 299, 299

Training_Epochs = 30

Batch_Size = 32

Number_FC_Neurons = 1024

Num_Classes = 2

train_dir = 'to my train folder'

validate_dir = 'to my validation folder'

num_train_samples = get_num_files(train_dir)

num_classes = get_num_subfolders(train_dir)

num_validate_samples = get_num_files(validate_dir)

num_epoch = Training_Epochs

batch_size = Batch_Size

train_image_gen = create_img_generator()

test_image_gen = create_img_generator()

train_generator = train_image_gen.flow_from_directory(

train_dir,

target_size=(Image_width, Image_height),

batch_size = batch_size,

seed = 42

)

validation_generator = test_image_gen.flow_from_directory(

validate_dir,

target_size=(Image_width, Image_height),

batch_size=batch_size,

seed=42

)

Inceptionv3_model = InceptionV3(weights='imagenet', include_top=False)

print('Inception v3 model without last FC loaded')

x = Inceptionv3_model.output

x = GlobalAveragePooling2D()(x)

x = Dense(Number_FC_Neurons, activation='relu')(x)

predictions = Dense(num_classes, activation='softmax')(x)

# model = Model(inputs=Inceptionv3_model.input, outputs=predictions)

v3model = Model(inputs=Inceptionv3_model.input, outputs=predictions)

# Use new Sequential model to add v3model and add a bath normalization layer after

model = Sequential()

model.add(v3model)

model.add(BatchNormalization()) # added normalization

print(model.summary())

print('\nFine tuning existing model')

Layers_To_Freeze = 172

for layer in model.layers[:Layers_To_Freeze]:

layer.trainable = False

for layer in model.layers[Layers_To_Freeze:]:

layer.trainable = True

optizer = Adam(lr=INIT_LT, decay=INIT_LT / Training_Epochs)

# optizer = SGD(lr=0.0001, momentum=0.9)

model.compile(optimizer=optizer, loss='binary_crossentropy', metrics=['accuracy'])

cbk_early_stopping = EarlyStopping(monitor='val_acc', mode='max')

history_transfer_learning = model.fit_generator(

train_generator,

steps_per_epoch = num_train_samples,

epochs=num_epoch,

validation_data=validation_generator,

validation_steps = num_validate_samples,

class_weight='auto',

callbacks=[cbk_early_stopping]

)

model.save('incepv3_transfer_mini_binary.h5', overwrite=True, include_optimizer=True)回答 1

Stack Overflow用户

发布于 2019-12-19 13:05:58

范畴化

- Use

Num_Classes = 2 - 使用一个热编码目标(例如:

Bird = [1, 0]、Flower = [0, 1]) - 使用

'softmax'激活H 210H 111使用'categorical_crossentropy'H 213/code>f 214

二进制

使用Num_Classes = 1使用二进制目标(例如:is flower = 1 | not flower = 0)使用'sigmoid'激活H 224H 125使用'binary_crossentropy'H 227F 228

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/59410176

复制相关文章

相似问题