Keras中的核和递归核

Keras中的核和递归核

提问于 2020-11-17 19:15:51

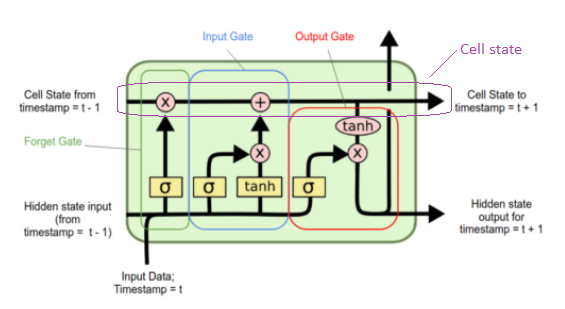

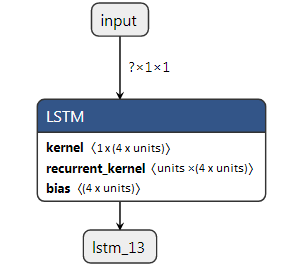

我试图在脑海中画出LSTM的结构,我不明白内核和反复内核是什么。根据LSTM部分中的这个帖子,核它是四个矩阵乘以输入和循环核,它是四个矩阵乘以隐藏状态,但是,这个图中的这4个矩阵是什么呢?

是大门吗?

我用这个应用程序测试了下面代码的unit变量是如何影响内核、递归内核和偏差的:

model = Sequential()

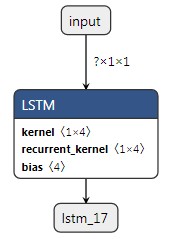

model.add(LSTM(unit = 1, input_shape=(1, look_back)))对于look_back = 1,它返回给我:

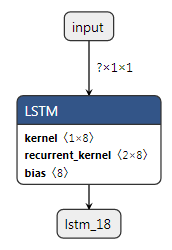

使用unit = 2,它会返回给我这个

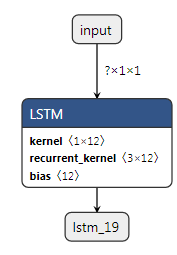

用unit = 3这个

用这个值测试,我可以扣除这个表达式。

但我不知道这里面是怎么回事。<1x(4u)>或<ux(4u)>是什么意思?u = units

回答 1

Stack Overflow用户

回答已采纳

发布于 2020-11-17 21:07:43

内核基本上是由LSTM单元处理的重量。

单位=神经元,就像经典的多层感知器

它没有显示在您的图表中,但是输入是一个向量X,它有一个或多个值,每个值都被发送到一个具有自己的权重w的神经元中(我们将用反向传播来学习这个值)。

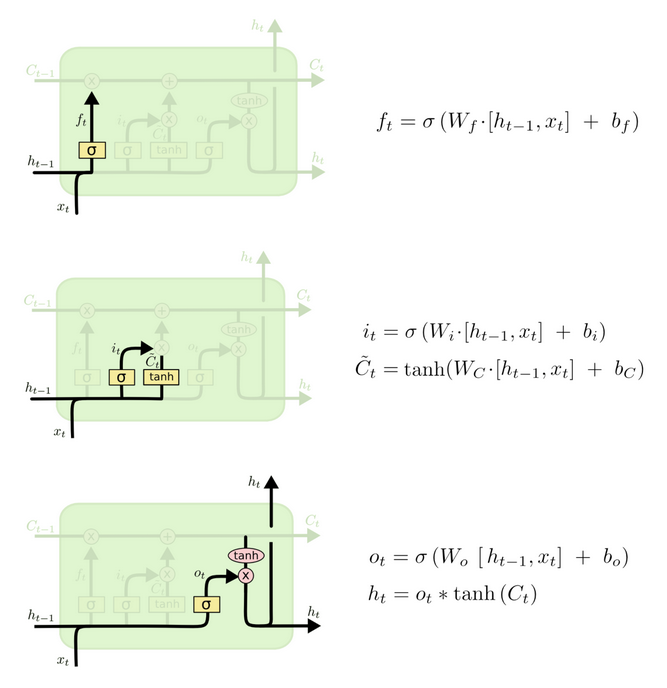

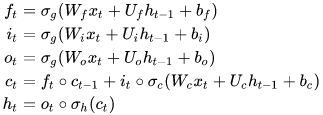

这四个矩阵如下(用Wf、Wi、Wc、Wo表示):

当您添加一个神经元时,您将添加其他4个权重\核

对于你的输入向量X,你有四个矩阵。因此

1 * 4 * units = kernel关于recurrent_kernel 在这里你可以找到答案。基本上,在keras中,输入和隐藏状态并不像示例图(Wht 1,t)那样相互连接,而是与称为U的其他四个矩阵分开和处理。

因为有一个隐藏状态x神经元,所以权重U(所有四个U)是:

units * (4 * units) = recurrent kernelht-1是从你所有的神经元循环而来的。就像在多层感知器中一样,神经元的每一个输出都进入所有下一个递归层神经元中。

来源:http://colah.github.io/posts/2015-08-Understanding-LSTMs/

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/64881855

复制相关文章

相似问题