Prompt 工程师快淘汰了,未来真正值钱的是 Skill 架构师和 MCP 设计者,真的吗?

Prompt 工程师快淘汰了,未来真正值钱的是 Skill 架构师和 MCP 设计者,真的吗?

chouheiwa

发布于 2026-05-06 21:27:16

发布于 2026-05-06 21:27:16

Prompt 工程师快淘汰了,未来真正值钱的是 Skill 架构师和 MCP 设计者,真的吗?

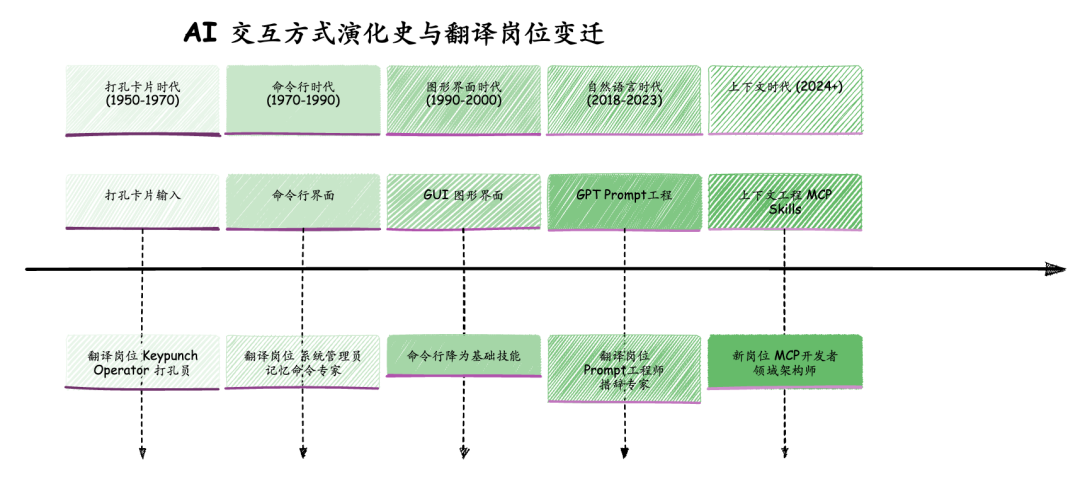

要回答这个问题,最好的方式不是直接给结论,而是带你走一遍 AI 交互方式的演变史。走完这条路你会发现,Prompt 工程师的消亡不是意外,而是人机交互每一次范式跃迁中必然会重复的故事。

▶▶ 最早跟计算机说话:打孔卡片和命令行

1950 年代到 1970 年代,程序员跟计算机沟通靠的是打孔卡片。你在纸卡上打好孔,送进去,等结果。每一个孔的位置都有严格含义,打错一个孔整个程序就跑不了。那个年代"会打卡"本身就是一项专业技能,有专门的 keypunch operator 岗位。

后来命令行出现了。你不用打孔了,但你得记住每一条命令的精确拼写和参数格式。ls -la、chmod 755、grep -r "pattern" .——差一个字母就报错。这个阶段也催生了专门的技能岗位:系统管理员的核心竞争力之一就是能记住海量命令和参数组合。

再后来 GUI 来了。鼠标一点就能完成以前需要敲半天命令才能干的事。"会用命令行"从一项专门技能变成了程序员的基础素养,而"能用鼠标操作电脑"成了所有人都会的事情。 Keypunch operator 这个岗位彻底消失了,没有人觉得可惜。

这是第一个模式:每当机器变得更擅长理解人的意图,中间那层"翻译"技能就会从专业岗位降级为通用素养。

记住这个模式,后面还会反复出现。

AI交互方式演化史与翻译岗位变迁

▶▶ 机器学习时代:从手写规则到让数据说话

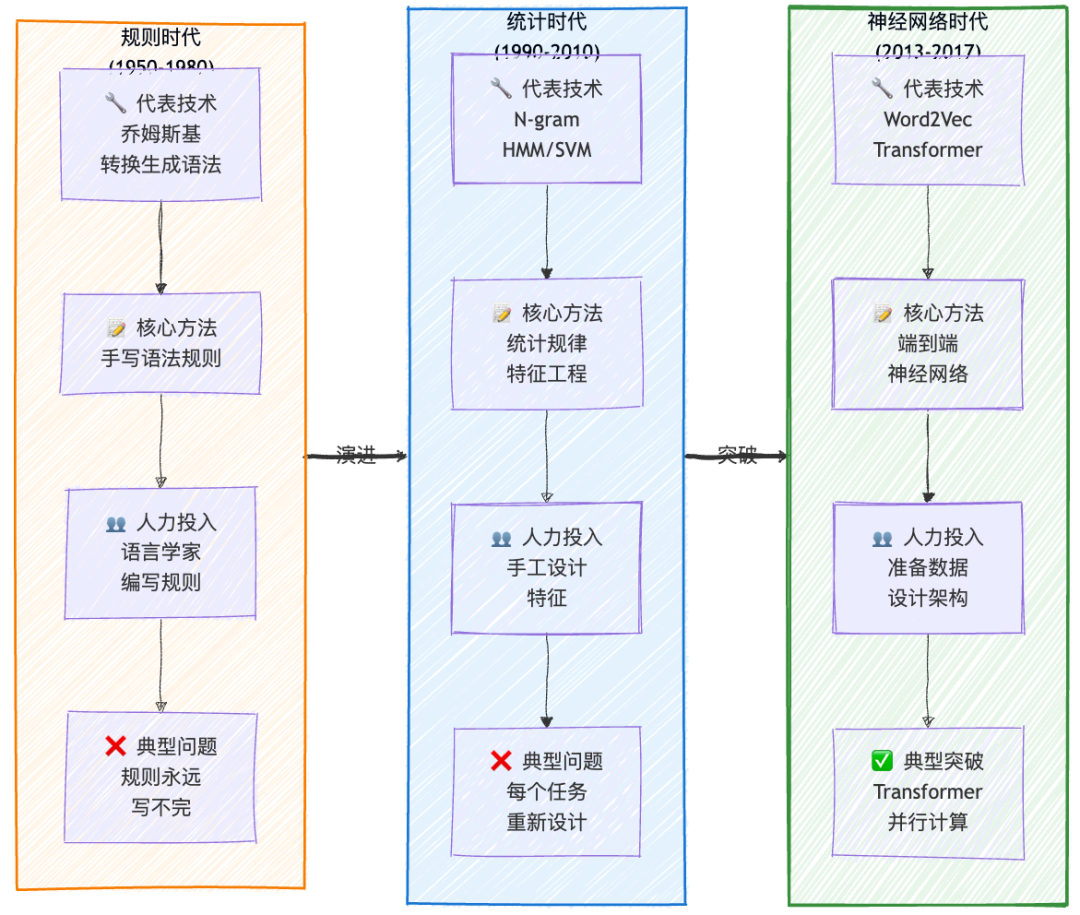

1980 年代到 2010 年代初,AI 领域经历了从专家系统到机器学习的转变。

专家系统时代,你得把领域知识一条一条地写成 if-else 规则喂给系统。"如果体温超过 38.5 度且持续超过 3 天且伴有咳嗽,则建议检查肺炎。"写这些规则的人叫知识工程师(Knowledge Engineer),一度是 AI 领域最吃香的岗位。

然后统计学习和深度学习来了。你不用手写规则了,扔一堆数据进去,模型自己学。知识工程师没有消失,但他们的工作重心从"手写规则"变成了"准备高质量训练数据"和"设计模型架构"。 原来那套手工编写 if-else 规则的技能?不值钱了。

这是第二个模式:每当 AI 获得了新的学习能力,之前那种"手工把知识翻译成机器能理解的格式"的技能就会贬值。

▶▶ GPT 时代开启:prompt 作为新的人机界面

铺垫:NLP 如何教会机器"读懂人话"

在讲 GPT 之前,必须先理解 NLP(自然语言处理)这几十年的艰难进化。

1950-1980 年代:基于规则的符号主义。 乔姆斯基的转换生成语法统治了这个时代,研究者们试图手写语法规则教机器理解句子。比如"the cat sat on the mat"要先识别名词短语"the cat",再识别动词"sat",再识别介词短语"on the mat"。问题是人类语言太灵活了,规则永远写不完。"Time flies like an arrow"(光阴似箭)这句话机器就理解不了,因为它可能会解析成"像箭一样给时间蝇计时"。

1990-2010 年代:统计学习和特征工程。 N-gram 模型、隐马尔可夫模型、支持向量机成为主流。关键突破是用大量文本的统计规律替代手写规则。但这个阶段研究者们还在手工设计特征:词频、TF-IDF、词性标注、句法树。每做一个新任务就得重新设计一套特征工程,工作量巨大。

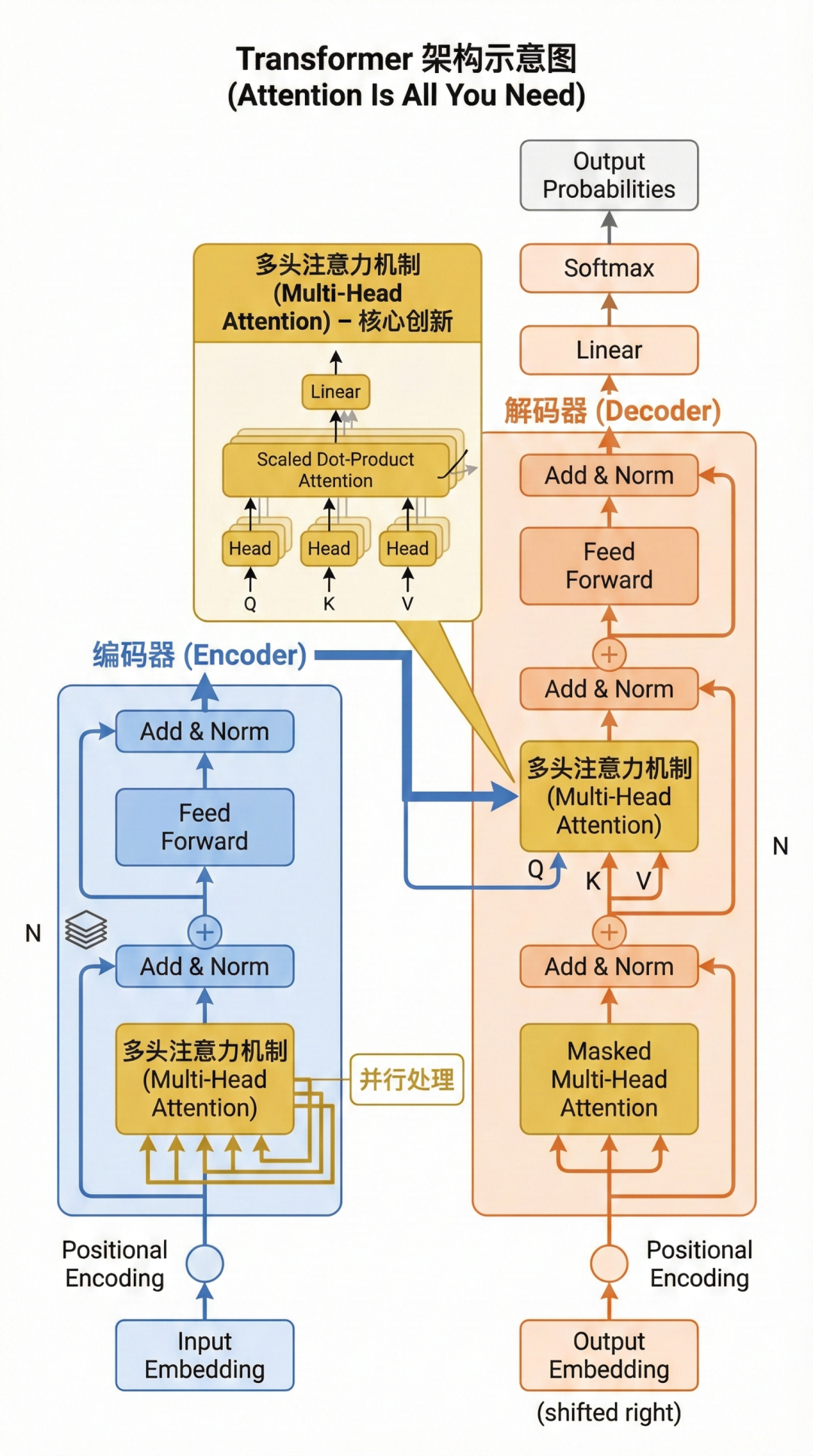

2013-2017:深度学习的第一波冲击。 Word2Vec(2013)让词语有了语义向量表示,"king - man + woman ≈ queen"这种神奇的代数关系震惊了学界。接着 RNN、LSTM 开始用于序列建模,能处理上下文了。2017 年是真正的分水岭:Transformer 架构横空出世。注意力机制(Attention)让模型能同时关注句子里所有位置的信息,并行计算效率暴增,为 GPT 的出现铺平了道路。

Transformer架构与注意力机制示意图

从规则到统计到神经网络,NLP 花了 60 年才解决一个核心问题:如何把自然语言转换成机器能计算的数学表示,并保留语义。 Transformer 解决了这个问题,GPT 才有可能诞生。

NLP三个时代的技术演进对比

GPT 三部曲:从实验到革命

2018 年到 2020 年,GPT 系列模型把一切都变了。

GPT-1(2018)证明了预训练语言模型的可行性。GPT-2(2019 年 2 月)展示了 zero-shot 能力——你不用微调模型,只要给它一段文字开头,它就能续写下去。GPT-3(2020 年 5 月)是真正的分水岭:1750 亿参数,few-shot 学习能力炸裂。你在 prompt 里给它几个示例,它就能学会新任务。

这是人类历史上第一次,你可以用自然语言"编程"。 不用学 Python,不用理解算法,你只需要会说话就能让一个超强的计算系统为你工作。这件事的革命性怎么强调都不为过。

回头看,GPT 的突破其实是站在整个 NLP 发展史的肩膀上:基于规则时代积累的语言学知识、统计学习时代发现的语言统计规律、深度学习时代建立的神经网络架构,三者的叠加才造就了这个"看起来懂人话"的怪物。

但 GPT-3 时代的模型有个很明显的问题:它理解自然语言的能力还不够强。你随便说一句"帮我写个营销方案",出来的东西可能完全跑偏。你得用各种技巧引导它:在 prompt 里加"你是一个资深营销总监"(角色扮演),加"请一步步分析"(chain-of-thought),加几个高质量示例(few-shot learning),甚至要试不同的措辞反复调参数。

Prompt 工程就是在这个窗口期诞生的。 模型已经够强大到能用自然语言交互了,但又没强大到能准确理解你的意图。中间这个理解力的 gap,就是 prompt 工程师的生存空间。

▶▶ 2023:Prompt 工程师的黄金时代和幻觉高峰

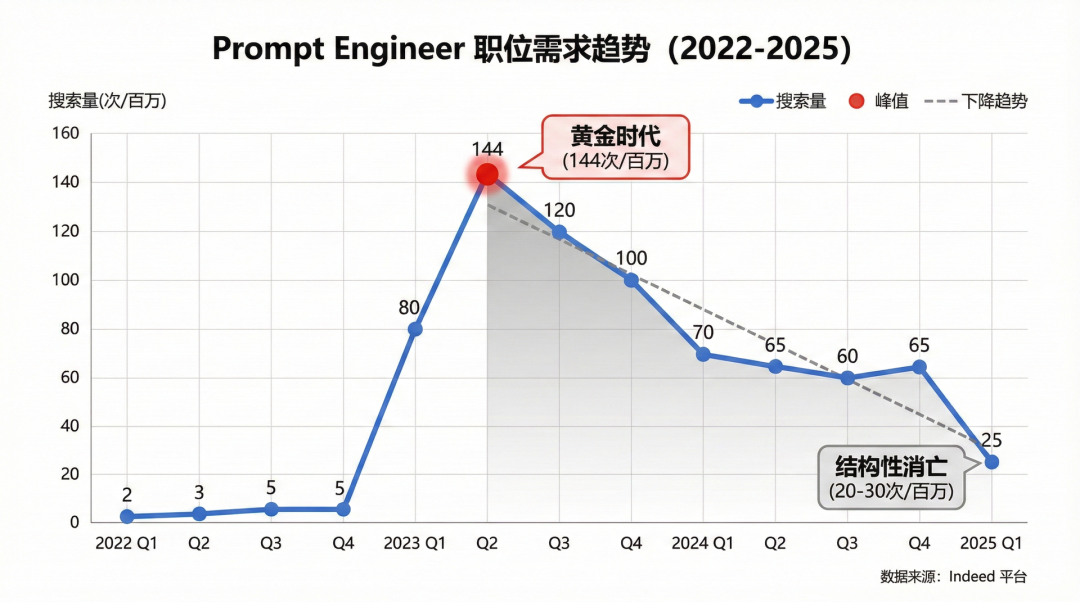

2023 年是一切的巅峰。ChatGPT 在 2022 年末横空出世,两个月破亿用户。紧接着 GPT-4 发布,能力飞跃。全世界突然意识到大模型能干太多事了,但大多数人不知道怎么用好它。

供需失衡催生了 prompt 工程师这个岗位的爆发。Anthropic 开出 33.5 万至 37.5 万美元年薪招聘 Prompt Engineer,Indeed 平台上相关搜索从每百万次 2 次飙升到 144 次。中国市场上"提示词工程师"培训课程遍地开花,有些定价上万。

但这里面有一个关键问题大家当时没看到:prompt 工程师的价值来源于模型的缺陷,而不是模型的能力。

这跟之前每一次"翻译岗位"的命运一模一样。keypunch operator 的价值来源于计算机不能读人类文字这个缺陷。知识工程师的价值来源于 AI 不能自己学习这个缺陷。Prompt 工程师的价值来源于大模型不能准确理解自然语言这个缺陷。

而所有这些缺陷,都在被工程师们夜以继日地修复。

▶▶ 2024-2025:推理模型出现,prompt 技巧变成负资产

转折点来得比所有人预想的都快。

OpenAI 在 2024 年发布了 o1 系列推理模型。这类模型内置了多步推理能力——你不需要在 prompt 里写"请一步步思考",它自己就会分解问题、逐步推导。更反直觉的是,传统的 chain-of-thought 提示对推理模型不仅无效,甚至会干扰它的内部思考链,让结果变差。

Claude 同样如此。Anthropic 自己的工程文档写得明白:对于有扩展思考能力的模型,高层级指令通常比逐步的规范性引导效果更好。翻译一下就是——你告诉它要做什么就行,别教它怎么做。

IEEE Spectrum 发表的一项研究让这件事彻底有了定论。VMware 的两位研究员系统测试了 60 种 prompt 组合在多个模型上的表现,结论是:AI 自动生成的 prompt 几乎总是优于人类精心设计的 prompt。更讽刺的是,表现最好的自动 prompt 里居然包含一段《星际迷航》的台词——完全没有逻辑可言,但就是比人类设计的 prompt 效果好。研究者的原话大意是:prompt 工程的存在更像是 LLM 的 bug,不是 feature。

与此同时,微软 2025 年工作趋势指数(覆盖 31 国 3.1 万名员工)揭示,Prompt 工程师在企业未来计划新增的岗位中排名倒数第二。Indeed 上的岗位搜索量从 144 跌到 20-30,中国市场岗位发布量下降约 70%。

Prompt工程师岗位需求趋势变化(2022-2025)

这不是周期性波动,这是结构性消亡。因为它遵循的是我们前面反复看到的那个模式:模型修复了自身理解力的缺陷,"翻译"岗位的生存空间就被抽走了。

▶▶ 上下文工程:从"写好一句话"到"设计整个信息环境"

但故事到这里并没有结束。模型变聪明了,并不意味着你随便说句话就能让它完美完成复杂任务。新的挑战出现了——只不过这个挑战的性质跟"怎么措辞 prompt"完全不同。

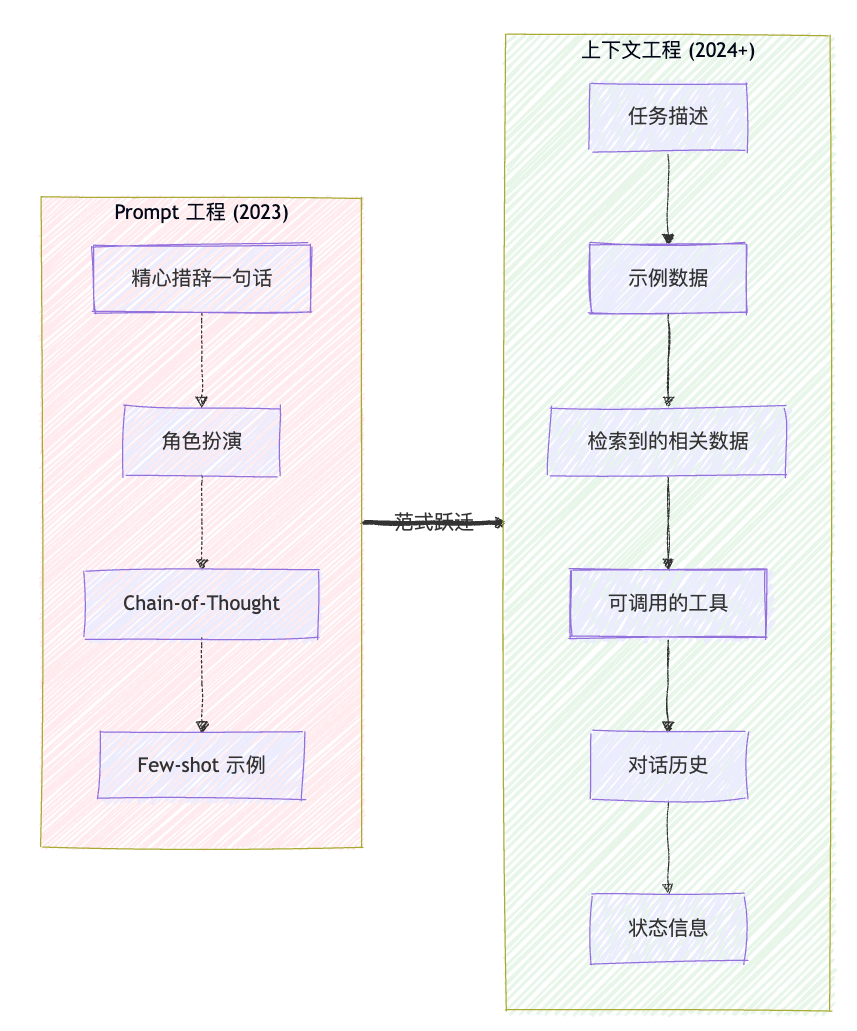

Andrej Karpathy(前特斯拉 AI 总监、OpenAI 联合创始人)在 2025 年 6 月给这个新挑战正式命名:上下文工程(Context Engineering)。他那条阅读量 230 万的推文说:人们把 prompt 等同于给 LLM 写一条简短指令,但在工业级 AI 应用中,真正的挑战是精确填充整个上下文窗口——任务描述、示例、检索到的相关数据、可调用的工具、对话历史、状态信息,全都得恰到好处。太少了模型没有足够信息做出好判断,太多了成本上升性能反降。

上下文窗口填充的三种状态:信息不足、恰到好处、过度填充

我自己的工作实践完全印证了这一点。我现在用 Claude Code 做 iOS 开发,90% 的精力花在组织上下文上:CLAUDE.md 文件里写清楚项目架构和编码规范,通过 @file 引入相关代码,之前的决策记录存在 memory 里。 我几乎不花时间去琢磨"这句 prompt 怎么写效果更好",因为只要上下文给够了、给对了,模型自然就能理解我要什么。

Gartner 在 2025 年 10 月给出了官方定义:上下文工程是设计和构建相关数据、工作流和环境,使 AI 系统能够理解意图、做出更好决策——而无需依赖手工 prompt。注意最后那句话,它等于官方判了 prompt 工程的退场。

从历史视角看这是完全合理的。GUI 的出现没有消灭人机交互的需求,只是把交互的重心从"记住命令"转移到了"设计界面"。同理,上下文工程没有消灭"跟 AI 沟通"的需求,只是把重心从"打磨措辞"转移到了"构建信息环境"。

Prompt工程与上下文工程的范式对比

▶▶ MCP:AI 领域的"USB 标准化运动"

上下文工程的核心难题之一是:AI 怎么获取外部的数据和工具?

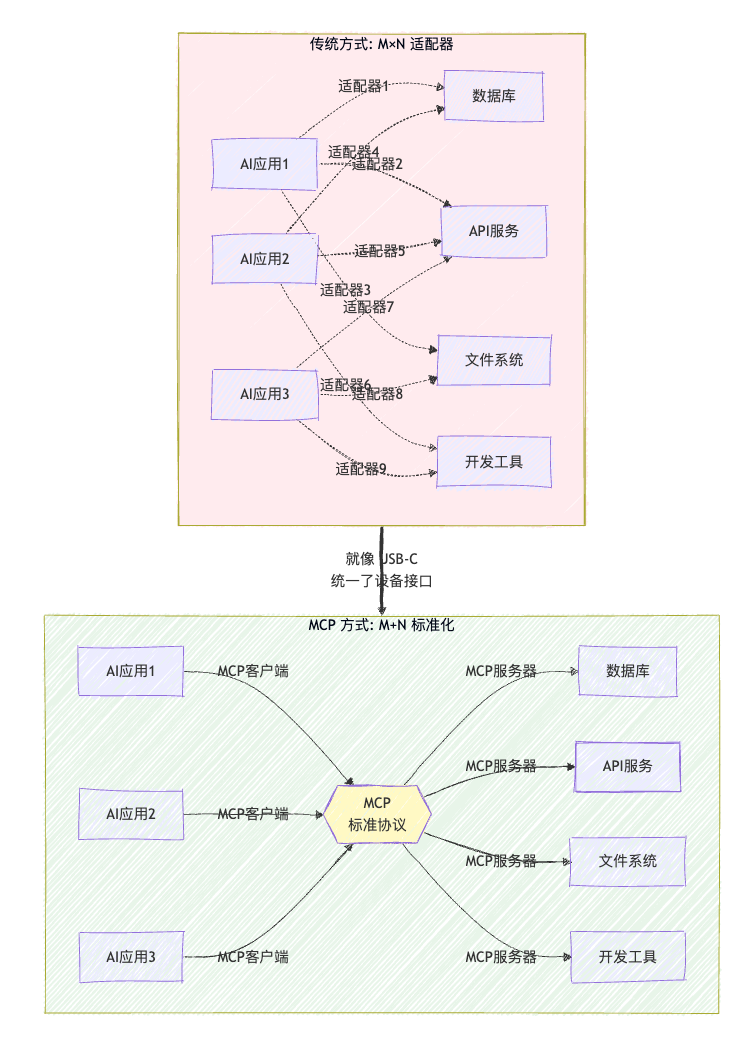

这就引出了问题里提到的 MCP。Anthropic 在 2024 年 11 月发布了 MCP(Model Context Protocol),它是一个开放协议,解决的是 AI 与外部工具、数据源之间的标准化连接。之前每个 AI 应用要对接一个新服务,就得写一套定制适配器。M 个应用乘以 N 个数据源等于 M×N 个适配器,这是工程噩梦。MCP 把它标准化成 M+N 个实现,所以被叫做"AI 的 USB-C"。

如果你对计算机历史有了解,这个类比非常精确。USB 之前,打印机用并口、鼠标用 PS/2、外接存储用 SCSI,每种设备一种接口。USB 统一了一切。MCP 做的就是这件事:统一 AI 与外部世界的连接方式。

MCP标准化:从M×N适配器到M+N标准实现

而且 MCP 的行业采纳速度打破了所有技术标准的历史记录。一年之内,OpenAI、Google DeepMind、微软全部宣布支持。中国这边阿里、百度、蚂蚁、字节整齐跟进。2025 年 12 月,MCP 被捐赠给 Linux Foundation 旗下的 Agentic AI Foundation,OpenAI 和 Google 都是创始成员。生态规模达到 10,000+ 活跃 MCP 服务器、9,700 万月度 SDK 下载量。

"MCP 设计者"作为需求是真实存在的。 开发 MCP 服务器需要 Python/TypeScript 开发能力、JSON-RPC 和 OAuth 协议知识、API 封装和异步编程经验。Block(原 Square)已经有专门的工程团队写内部 MCP 服务器。这是一个实打实的新技术栈,不是概念炒作。

▶▶ Skill 架构:把领域知识从人脑搬进 AI 系统

MCP 解决了 AI 的"手"——让它能连接外部工具和数据。但还有一个问题:AI 有了手,不代表它知道该怎么用。

Anthropic 在 2025 年末推出了 Agent Skills,核心理念用一个类比就能讲清楚:IQ 300 的数学天才但零会计经验,跟 IQ 100 的注册会计师有 20 年税务经验,帮你报税选谁?AI 模型的通用智能再强,面对具体领域任务时也需要被"教会"专业知识和流程。

Skill 的实现方式很朴素:一个目录里放一个 SKILL.md 文件,用 YAML 写元数据、用 Markdown 写指令,加上可选的脚本和参考资料。但它的设计理念很精巧——渐进式披露:AI 先只加载技能的名称和描述(约 20-50 tokens),判断相关时才加载完整指令,需要时再加载附属文件。这就像一个老师傅不会把所有经验一股脑倒给徒弟,而是在合适的时机教合适的东西。

回到历史视角,这跟专家系统时代的"知识工程"有异曲同工之处——都是把领域专家的知识编码进系统。但有一个根本区别:专家系统时代你要把知识写成 if-else 规则,现在你只需要用自然语言写成结构化文档。 门槛低了几个数量级,但对"知道该写什么"的领域专业度要求反而更高了。

至于"Skill 架构师"这个岗位——说实话,目前不存在。我搜了一圈没有任何招聘信息用这个头衔。它更像是一种正在浮现的能力需求,分散在 AI 工程师、平台架构师、技术负责人等角色里。方向是对的,但作为独立岗位还太早。

▶▶ 完整的演化链和不变的底层逻辑

走完这趟历史之旅,我们可以清楚地看到一条完整的演化链:

打孔卡片 → 命令行 → GUI → 自然语言 prompt → 上下文工程 → 技能与工具架构

每一次跃迁都遵循同一个规律:机器在某个维度上变得更擅长理解人的意图,于是之前那层专门负责"翻译"的技能就从专业岗位降级为通用素养。打孔员消失了,但计算机操作需求没消失。知识工程师转型了,但把专业知识灌注给 AI 的需求没消失。Prompt 工程师正在消亡,但设计人与 AI 交互系统的需求不仅没消失,反而变得更复杂、更值钱了。

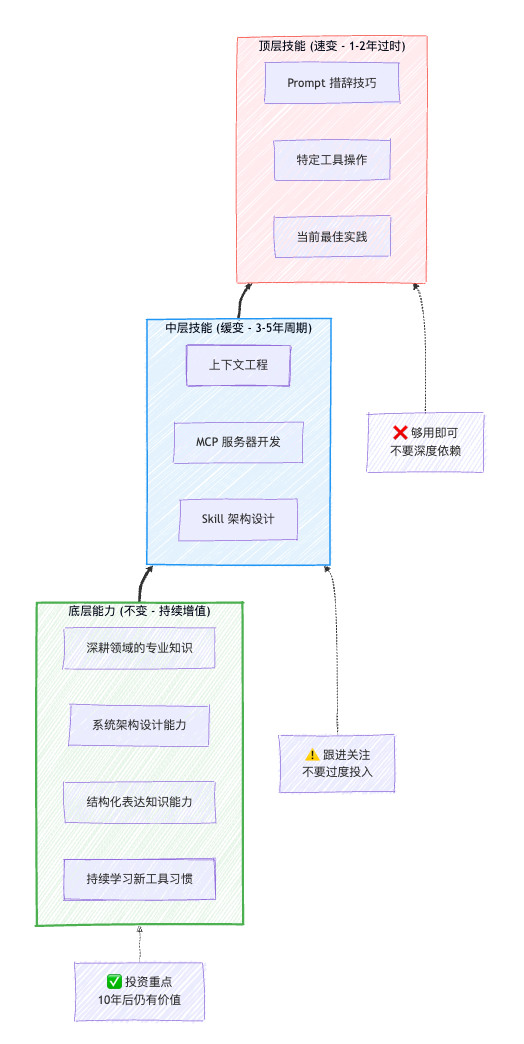

我自己的体会是,从化工转行做 iOS 开发到现在快十年,具体的技术栈换了无数次——Objective-C 到 Swift,MVC 到 MVVM,本地数据库到云端同步。但控制变量的思维方式、对系统架构的理解、把复杂问题拆解为可管理模块的能力,这些底层的东西从来没贬值过。每一次技术栈更迭,反而让拥有这些底层能力的人更值钱,因为他们能更快地驾驭新工具。

AI 交互方式的演变也一样。Prompt 技巧会过时,但理解业务需求、设计系统架构、把领域知识结构化地组织起来的能力不会过时。Karpathy 说上下文工程是"精妙的艺术和科学",但对于任何一个有工程素养的人来说,这不是什么全新的东西——它就是软件工程里"给系统提供正确输入"这个老问题在 AI 时代的新形态。

▶▶ 回到问题本身

所以,Prompt 工程师快淘汰了?是的,作为独立岗位正在快速消亡,数据无可辩驳。 但"淘汰"这个词不太准确,更像是"被吸收"——prompt 能力正在成为所有知识工作者的基础素养,就像打字和用搜索引擎一样。

未来真正值钱的是 Skill 架构师和 MCP 设计者?方向大致正确,但表述过于具体。 MCP 设计者(更准确说是 MCP 服务器开发者)确实是实打实的新需求。Skill 架构师的功能角色正在浮现,但岗位名称还没定型。

如果你现在问我该往哪个方向投入精力,我的建议是不要去追这些新概念的名字。去看它们背后不变的东西:深耕一个领域的专业知识、系统性地组织和表达知识的能力、以及持续学习新工具链的习惯。 这三样东西,无论下一波范式跃迁叫什么名字,都不会让你落伍。

因为从打孔卡片到 MCP,变的是交互形式,不变的是:机器永远需要人告诉它该解决什么问题。只是"怎么告诉"这件事,会越来越容易。

技能价值分层:从速变的表层技能到不变的底层能力

— END —

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录