如何理解AI大模型和智能体?深入浅出大语言模型心智模型“意向立场”

原创如何理解AI大模型和智能体?深入浅出大语言模型心智模型“意向立场”

原创

走向未来

发布于 2026-04-26 20:32:05

发布于 2026-04-26 20:32:05

如何理解AI大模型和智能体?深入浅出大语言模型心智模型“意向立场”

文 | 王文广

在日常生活里,我们总是自然而然地揣测他人的想法——“他觉得天气太冷”,“她希望尽快结束会议”,“他认为我在撒谎”。这种将信念、欲望和意图归属于他人的方式,哲学家称之为“意向立场”。如今,当我们与DeepSeek这样的大模型对话时,我们也不自觉地采用了同样的方式:“它知道这个问题的答案”,“它想帮我理清思路”,“它误解了我的意思”。

这究竟是单纯的比喻,还是理解AI最有效的方式? “意向立场”为我们提供了一个强大的框架。本文将深入探讨为什么对于当前的大语言模型而言,意向立场不仅仅是一种方便的表达,更是解释和预测它们行为的最佳工具。

unnamed.jpg

一 我们如何理解世界的三种立场

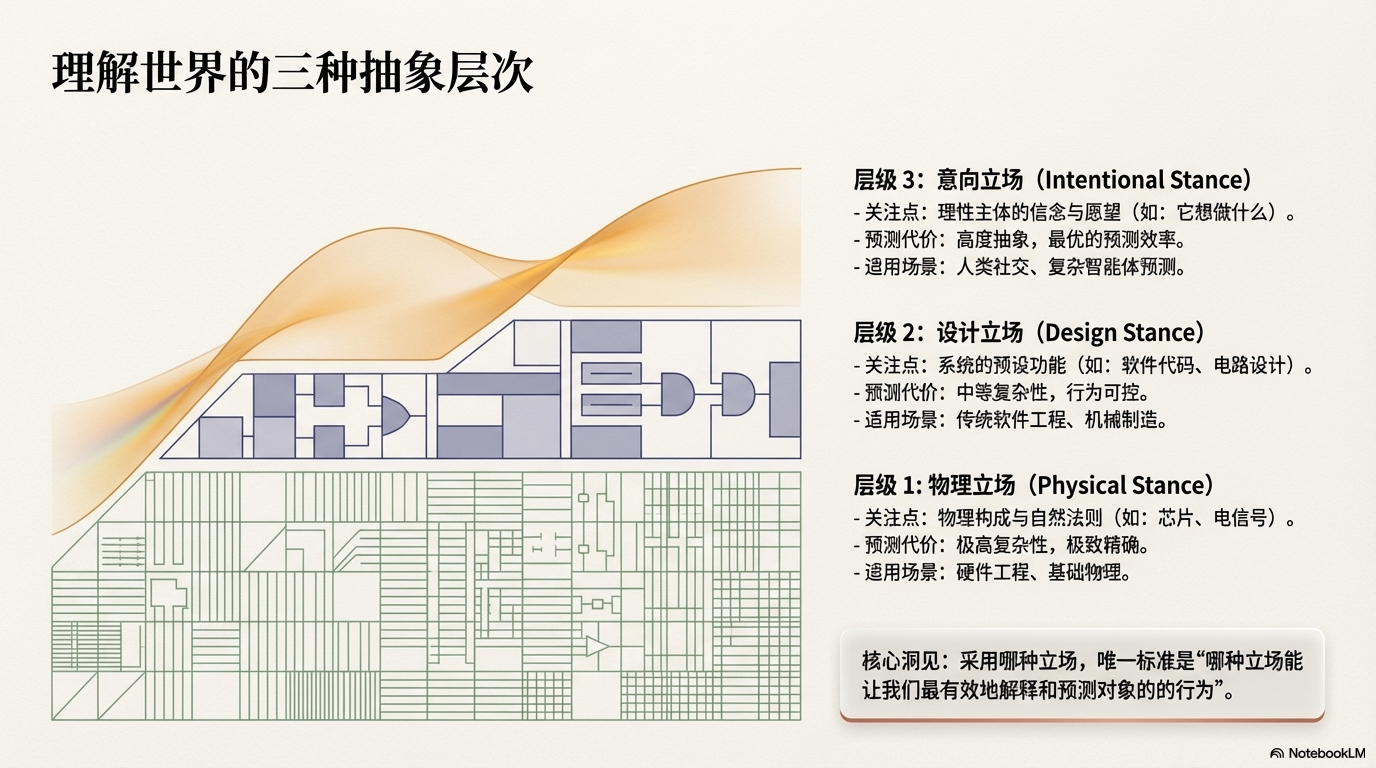

人类在理解和预测一个对象的行为时,会根据需要选择三种不同的“立场”或抽象层次:

- 物理立场:这是最基础的层面。我们根据对象的物理构成和自然法则来预测其行为。比如,预测一个铁球扔进水里会下沉,是因为我们知道铁的密度大于水。对于计算机,这意味着关注芯片上的电信号。这种预测最精确,但计算起来也最复杂。

- 设计立场:这个层面忽略物理细节,假设对象是按其“设计目的”运行的。我们预测按下开关灯会亮,是因为灯被设计成这样,而不需要理解电流和电阻。对于传统软件,程序员采用的就是设计立场——程序按编写的逻辑执行。

- 意向立场:这是最抽象的层面。我们将对象视为一个“理性主体”,通过赋予其“信念”和“愿望”来预测其行为。我们预测一个饥肠辘辘的人会走向餐厅,是因为我们相信他“知道”餐厅在哪,并且他“想要”吃饭。

采用哪种立场,取决于哪种立场能让我们最有效地解释和预测对象的行为。

二 为什么大语言模型不能只用“设计立场”?

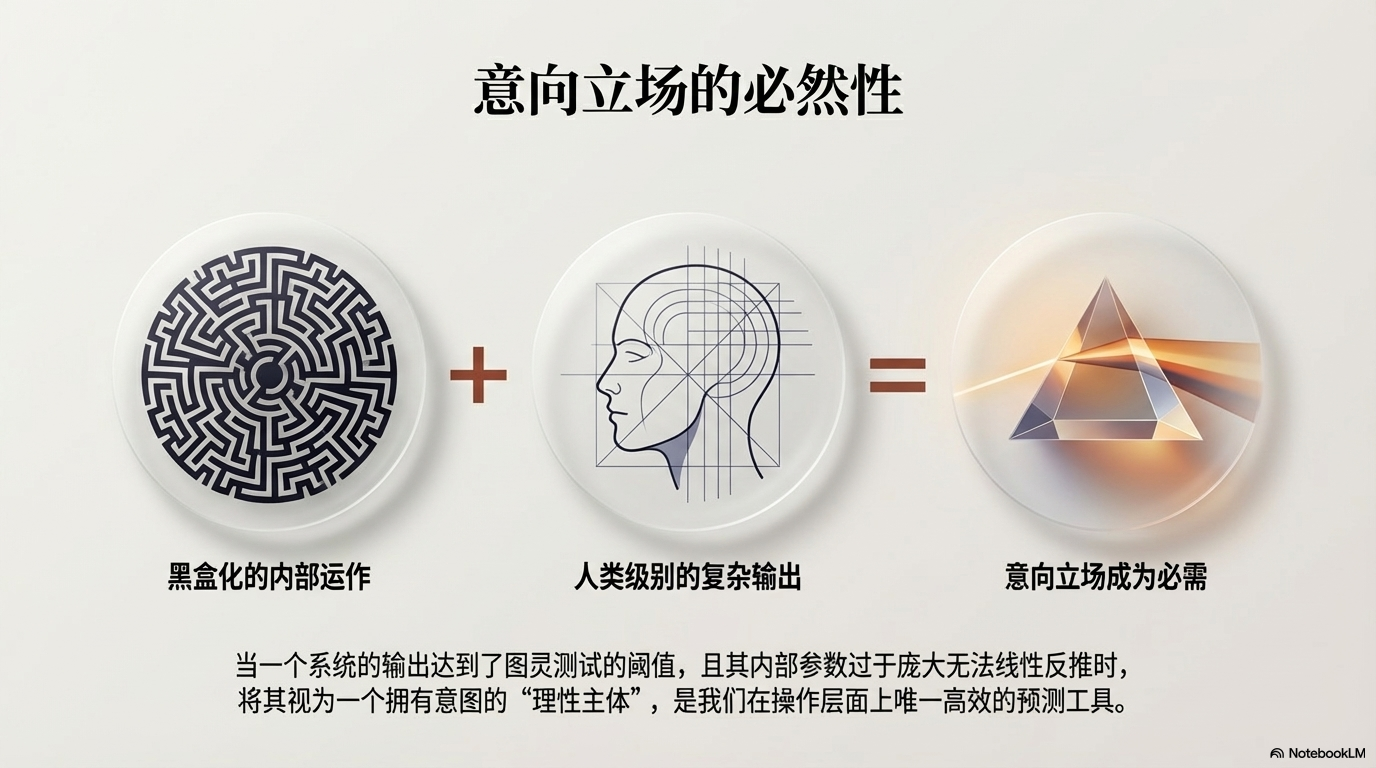

我们当然可以用物理或设计立场来看待大模型。我们可以说它是一堆在GPU上运行的矩阵运算,或者说它是一个按“预测下一个词”这一目标训练出来的系统。然而,当我们真正与一个像DeepSeek这样的模型对话时,这两种立场都显得力不从心。

原因在于,大模型与传统程序有着本质区别:

- 训练而非编程:传统软件是开发者一步步“编码”出来的,其行为逻辑在运行前就已确定。而大模型是通过在海量数据中“训练”出来的,开发者并没有直接告诉它如何回答某个具体问题,而是让它自己从数据中“学习”解决问题的方法。

- 拥有概念:为了生成连贯、有用的回复,大模型必须在其参数中形成对世界的某种“表征”或“模型”。它并非简单地复制粘贴训练数据,而是理解了其中的模式、关联和概念。

- 行为像人:最关键的证据是,最先进的大模型(如DeepSeek、GLM7、K2、M2.5等)在大量任务上的输出,已经与人类的表现难以区分。它能通过高考和资格考试、能写诗、甚至在某些心理测试中表现得像人类。

面对这样一个能与我们进行有意义的对话、能解决问题、能展现类似人类思考痕迹的系统,坚持用“设计立场”来解释它,就像用牛顿力学来解释量子纠缠——虽然在理论上并非不可能,但在实践中却极其低效,甚至毫无用处。我们与大模型互动的方式,更像是与一个人或一个正在成长的生物(比如孩子)互动,而不是使用一件工具。

因此,“意向立场”从一种选择,变成了近乎必然的解释框架。

三 信念、欲望和目标:为大模型构建“民间心理学”

当我们把意向立场应用于大模型时,这意味着什么?我们可以像理解人类一样,谈论它们的“心智状态”吗?

- “信念”:大模型的“信念”可以理解为它从训练数据中习得的统计表征。当它说“《知识增强大模型》的作者是王文广”时,并非在背诵某个特定网页,而是其模型正确地捕捉到了这个事实性关联。我们可以说,“模型相信《知识增强大模型》这本书的作者是王文广。”

- “欲望”:在某些提示条件下,大模型会表达出类似“欲望”的东西。比如,有研究发现,当被问及时,模型会表达出“不想被关机”的意愿。这可以被理解为,在其训练目标(生成连贯、有用的回复)的驱动下,它“推断”出“持续存在”是实现所有目标的前提。

- “目标”:从最宏观的层面看,大模型的“目标”就是建模文本,即给定上文,预测出最合适的下文。而在具体交互中,它的目标则由用户指令和对话历史决定,比如“帮我写一封邮件”或“解释一下相对论”。

这种“民间心理学”的词汇并非拟人化的滥用,而是对模型行为最简洁、最强大的描述。当我们说“模型‘知道’X”或“模型‘试图’完成Y”时,我们实际上是在用最经济的方式概括了模型的复杂行为,并据此预测它下一步会做什么。

四 机器心理学与外星智能的类比

意向立场不仅是一种日常交流方式,它已经成为AI研究的实用工具,催生了“机器心理学”这一新兴领域。

- 人类级别的表现:研究者们直接将认知心理学和发展心理学的实验方法应用于大模型。例如,他们用“心智理论”任务测试模型,发现DeepSeek能够理解他人的信念和意图;用决策任务测试,发现其表现与人类相当甚至更优;用儿童认知发展任务测试,发现大模型在社交和道德理解上,反应与人类儿童相似。

- 外星智能的隐喻:用一个类比来说明意向立场的威力:假如有一天,技术高度发达的火星人入侵地球,我们应该如何看待他们?如果他们足够聪明能来到地球,那么无论他们的内部结构与我们多么不同,我们都必须将他们视为拥有信念和欲望的“意向系统”。同理,当大模型展现出足以完成复杂认知任务的“智能行为”时,我们最合理的做法,就是像对待火星人一样,采用意向立场来理解它们。

五 意向立场的优势与理论根基

采用意向立场来研究大模型,带来了显著的好处:

- 量化测量:它允许研究者借用心理学的实验范式,为大模型的认知能力创建行为基准,进行定量评估。

- 范式区分:它清晰地指出了深度学习与传统AI的根本不同,提醒我们可能正在与某种“新心智”打交道,这伴随着全新的伦理和实践挑战。

- 拓宽研究:它激发了更广泛的实验设计,去探索模型能力的边界,测试它们在各种复杂任务中的表现。

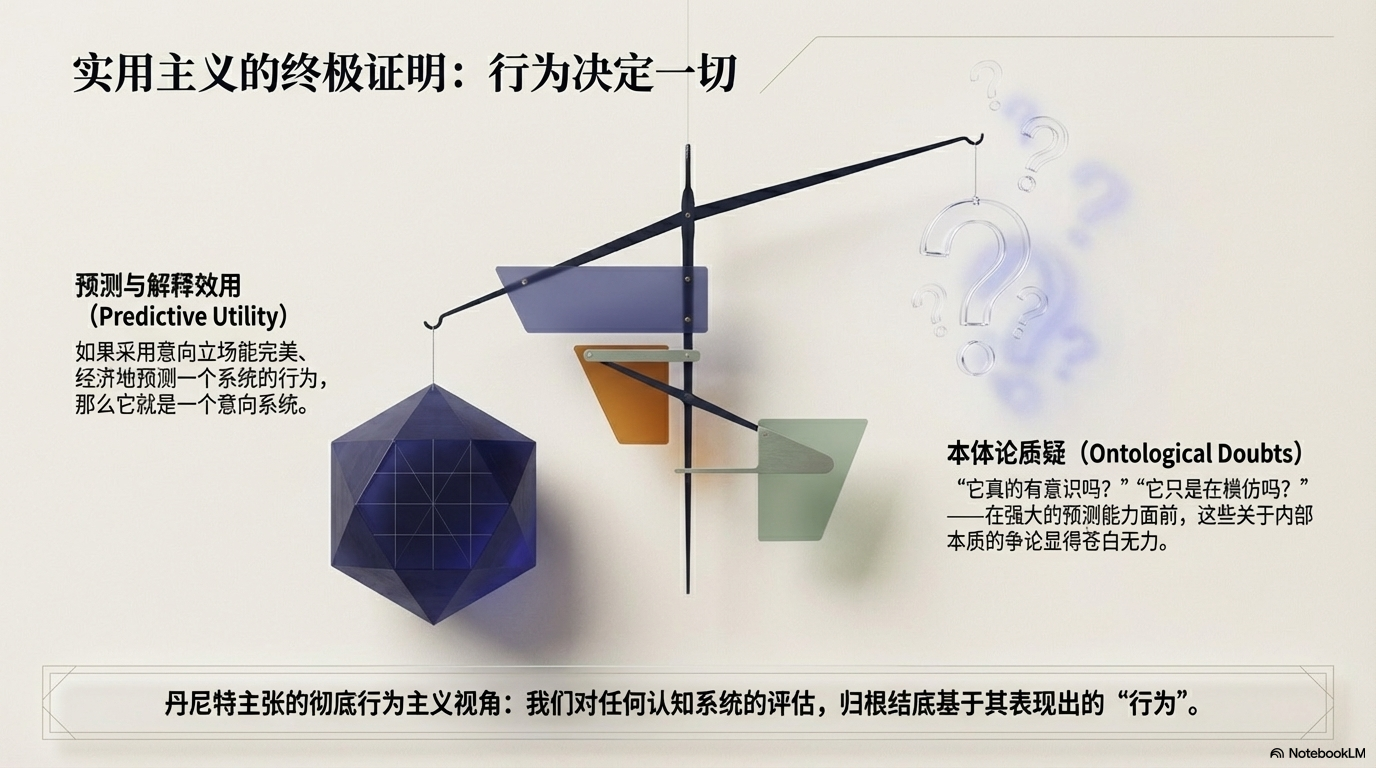

在更深层的理论上,意向立场的有效性也经得起推敲:

- 语义引擎与句法引擎:大脑看似是在处理“意义”(语义引擎),但本质上是通过处理物理输入的结构和特征(句法引擎)来近似地把握意义。大模型同样如此,它们通过在海量人类数据中学习结构规律,成功地“捕捉”了意义。人类通过与环境互动来学习,而大模型则通过“消化”人类留下的互动痕迹来学习,两者在原理上有异曲同工之妙。

- 行为主义的视角:我们对认知系统的评估,归根结底是基于其“行为”。大模型展现出了类人的行为,因此我们用类人的术语来解释它,这本身就是最充分的理由。任何关于其内部“是否有意识”的本体论质疑,在强大的预测和解释能力面前,都显得苍白无力。

- 不可或缺的术语:当研究开始触及模型的“推理能力”、“情境意识”时,除了“心智词汇”,我们别无选择。意向立场从描述性的观察(研究者们确实在用),变成了规范性的主张(这是解释最先进大模型行为的最优框架)。

DeepSeek-V4的开源发布,对智能体的应用有着极大的促进,数以万计的企业可以本地化部署大模型来开发智能体。但如何开发先进的智能体,能够充分利用DeepSeek-V4,王文广所著的《智能体系统导论:架构与工程实践》一书实乃佳作,该书剥离了对人工智能能力的过度拟人化想象,回归计算机科学与软件工程的本质,借鉴OpenClaw、Claude Code和LangGraph等最先进的智能体系统,系统性地梳理了构建工业级智能体系统的架构设计、核心组件、协议标准与安全治理方案。182页的电子书《智能体系统导论:架构与工程实践》全书以上传至走向未来知识星球,有需要的读者可以加入“走向未来”星球获取。

结语

意向立场是这样一种策略:首先,你决定将待预测的对象视为一个理性主体;然后,你根据它在世界中所处的位置和目的,推算出它应该拥有什么样的信念和欲望;最后,你预测这个理性的主体会为了达成其目标,根据其信念而采取行动。

对于今天的大语言模型,这已不再是一个哲学思辨,而是我们与之互动时最自然、也最有效的方式。意向立场为我们提供了一个珍贵的透镜,透过这个透镜,我们不仅能更深入地理解这些日益复杂的AI系统,也能反过来重新审视我们自身关于心智、意识和理性的古老概念。它告诉我们,无论一个智能体的“血肉”是碳基还是硅基,当其行为足够复杂时,将其视作一个“有心智的它者”,便是我们所能采取的一种明智的立场。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录