我做了个能同时对话多个大模型的LLMCast (一)

日常除了使用 Trae、WorkBuddy 来进行完整的项目开发、文章写作,

有时候遇到跟项目相关性不大的问题,例如给文章起个标题,会想看看国外和国内的模型分别怎么回答。

根据 Claude / GPT / Deepseek / Qwen/GLM 的回答内容,再判断一下,是综合它们的回答,还是取其中某一个。

寻思AI 写代码这么快,让它写一个。

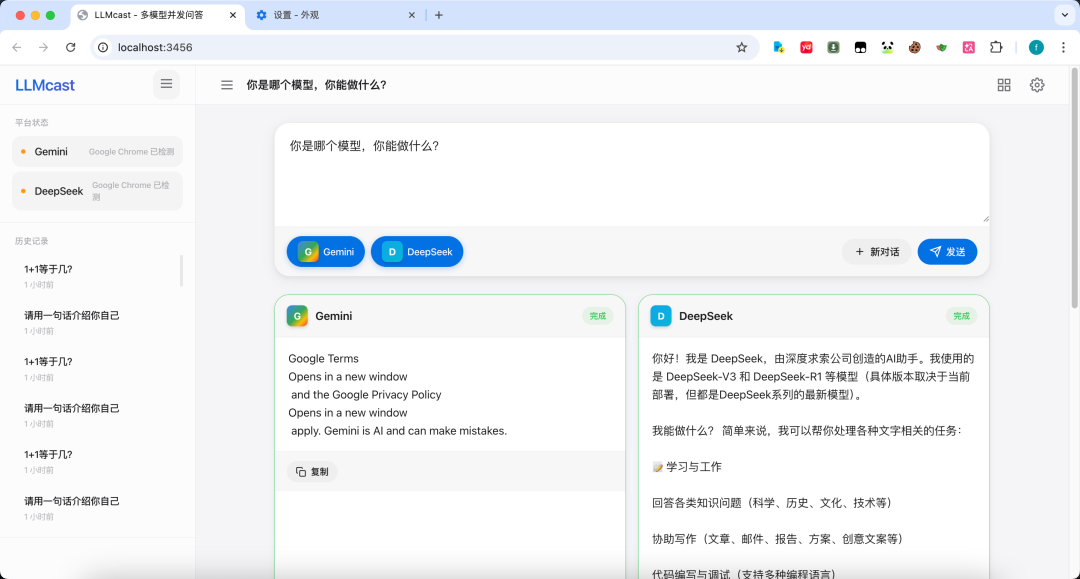

目前得到了一个初级版本:

实现同一个问题发给 Gemini 和 Deepseek ,看它们同时回答的结果。

例如下图:你是哪个模型,你能做什么?

起点:一个具体的使用场景

项目开始前,我想好了,用上 Harness 工程化思想和 Superpower 技能。

开发过程也不复杂,几句提示词就把文档、设计、开发、前端完成了。

开发一个可以同时发给各家大模型的小应用llmcast,灵感来源于开源项目chatall。 场景来自于:工作时偶尔产生一个生成名字,询问一个观点等独立的问题时,希望在不同的大模型对话窗口综合看一下不同的回答。 利用用户浏览器本身的登录token,同时展现不同的对话内容。

我的三个痛点

对我这样的传统开发工程师来说,开发项目有三个痛点:

第一个是产品头脑风暴。

方案边界没想清楚就动手,写到一半发现方向跑偏,返工成本很高。

第二个是项目工程化的文档约束。

没有文档规范,AI 生成的代码很容易失控,结构越来越乱。

第三个是前端设计和开发。

后端工程师的审美写出来的前端界面,比较迷之困惑。

这次我用:Superpower 技能 / Harness 工程规范 / Claude Design 的设计提示词,分别解决这三个痛点。

一:头脑风暴靠 Superpower,把方案边界先跑清楚

Superpower 是我在 Trae 里预先安装好的技能。

其中有一个头脑风暴技能,专门用来在动手之前把方案想清楚,

先把所有可能的路列出来,再决定走哪条。

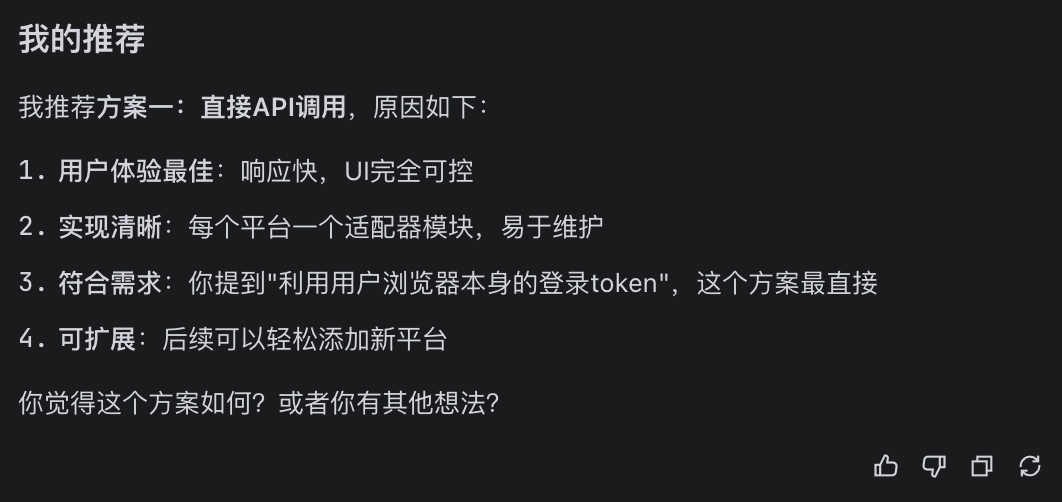

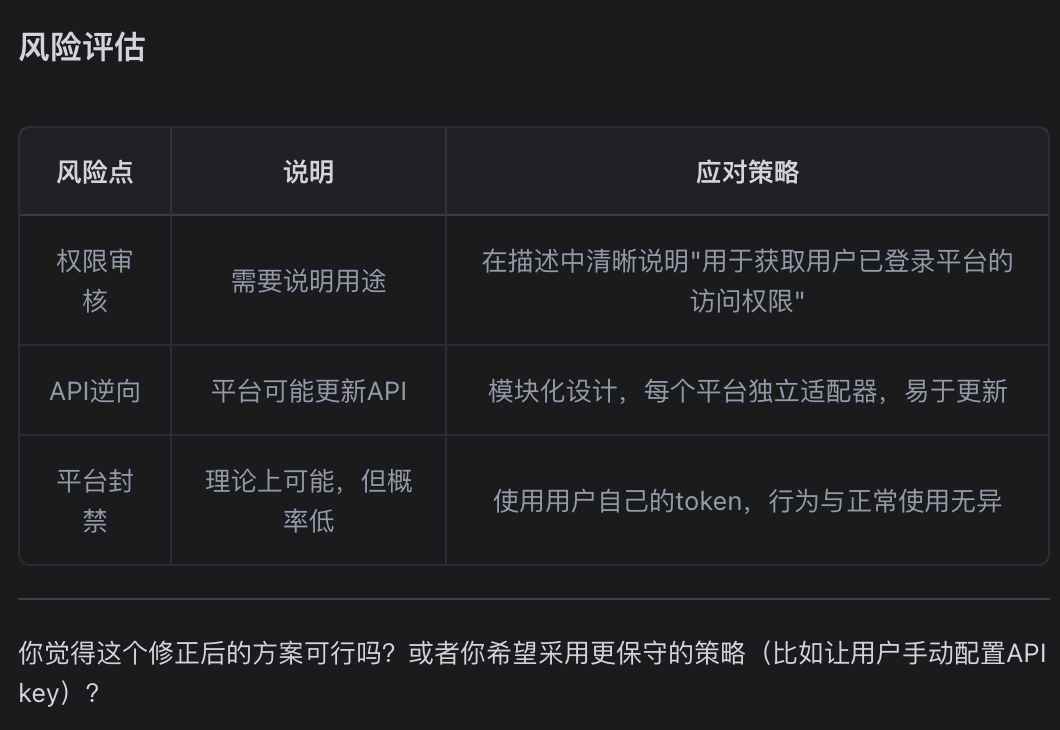

Superpower 的头脑风暴技能问了几个问题后,形成三个开发方案:

- • 方案一:直接 API 调用(推荐)

- • 方案二:iframe 嵌入

- • 方案三:混合方案

我提出了疑问:

「"content script 注入到各平台网站"这个行为,可能不会被插件商店允许?」

Trae 的 GLM-5.1 表示你说的对。

讨论过程中,我想起来之前的 OpenCLI 技能是不是可以借用:

使用插件只是出于用户使用方便,但技术实现复杂或非常难实现,是否有比较容易的开发方案? 本地电脑环境是 mac。 如果参考仓库

https://github.com/jackwener/OpenCLI中 CLI 实现访问任意登录站点的思路……

两三轮对话确定了方案边界,动手开发之前排除一些技术方案。

二:工程化文档靠 Harness,给项目装一个强制规范

Harness 是 OpenAI 工程团队提出的一套 AI 辅助开发规范,

核心是让 AI 按工程项目的方式来组织开发,有文档、有阶段、有验收标准,

于是,我在它更新完设计文档后,让它按 Harness 工程化风格组织项目开发:

请阅读这篇文章:

https://openai.com/index/harness-engineering/, 按这个工程规范组织本项目开发。

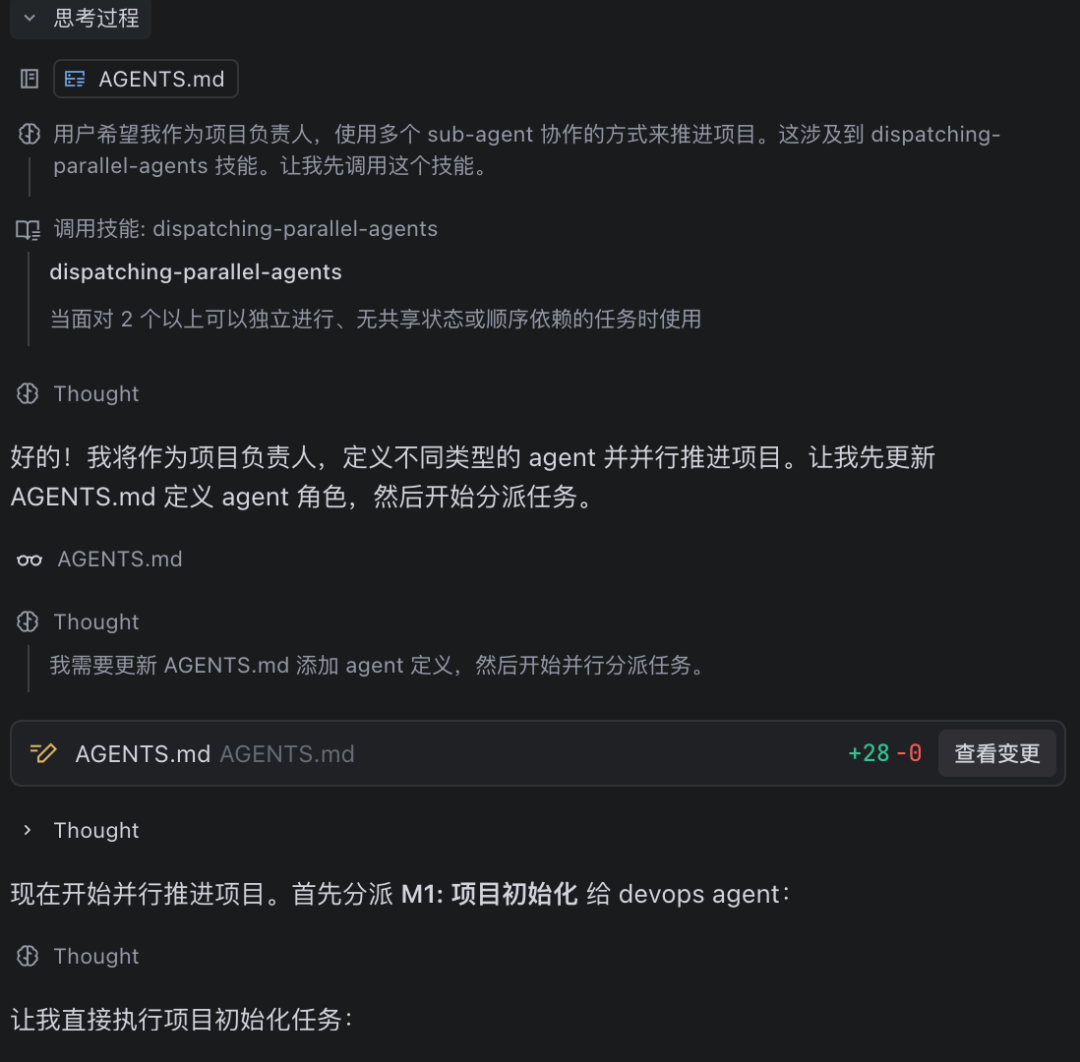

等它按要求组织好开发框架,让它按团队组织开发,

调用子 Agent 进行多进程合作开发:

你是项目负责人,可以给项目不同类型的工作:前后端开发、测试、设计、运维,指派 sub-agent,可以在 agent.md 中定义。 然后按多个 agent 协作方式开展项目进度推进,中间需要决策的地方可以自主决定,按项目文档推进到 M7:集成测试。

在它给出的开发计划上,我做了一点改动:

它经过一顿捣鼓,给了我项目成型的文档:

审核后做了一点调整:

Phase 3 的 UI 界面 放到Phase 1: MVP ,界面使用 纵向列表输出,要不阶段1的输出用命令行看,还是比较费劲

然后它就开始自主干活:创建子 Agent,分派任务:

三:前端设计靠 Claude Design,把专业设计能力引进来

很快后端代码开发完毕,进入操作界面前端开发。

在这里,我引入了 Claude Design 的系统提示词。

我把它改造成适合在 Trae 项目里使用的界面设计 sub-agent skill:

阅读这个仓库的提示词:

https://github.com/elder-plinius/CL4R1T4S/blob/main/ANTHROPIC/Claude-Design-Sys-Prompt.txt, 把它改造为适合 Trae 里这个项目中,作为界面设计的 sub-agent 可以使用的 skill。

接着进入前端界面开发:

你是项目经理,继续按刚才规划的步骤按顺序完成: 集成 OpenCLI,实现真实的浏览器自动化,让适配器能够真正与 AI 平台交互,设计完善 UI。

到这里,昨天上午 2 个小时就把这个项目界面搭完了。

然后现实很骨感

我可能高兴得太早,因为它给我的汇报很完美:连集成测试都完成了。

让它启动项目,到界面测试一下"真实对话功能"这部分,碰到了大坑。

一个下午加一个晚上,都搭在了里面。

直到今天上午换成了 Codex 接手,才完成。

提示词也不复杂,就是模型管用:

根据项目文档设计,功能已经大部分完成,也进行了集成测试,请解决最后真实功能测试和debug,和gemini,deepseek平台对话。

总结

这个小工具的开发,是一个很典型的 AI 辅助开发案例:

头脑风暴、工程规范、前端设计,不到最真实的环节,推进得都很顺利。

真正到了系统运行的环节,隐藏的问题就暴露出来了。

LLMCast 还很初级,但核心场景已经跑通:

一个问题,能同时发给 Gemini 和 Deepseek,复用我在本机登录这两个大模型网页对话的凭据。

后续准备加上其他模型:Claude / GPT / GLM ,迭代到功能比较完整的时候再发布出来。

有没有同样需求的小伙伴,评论区留言。

-END-

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录