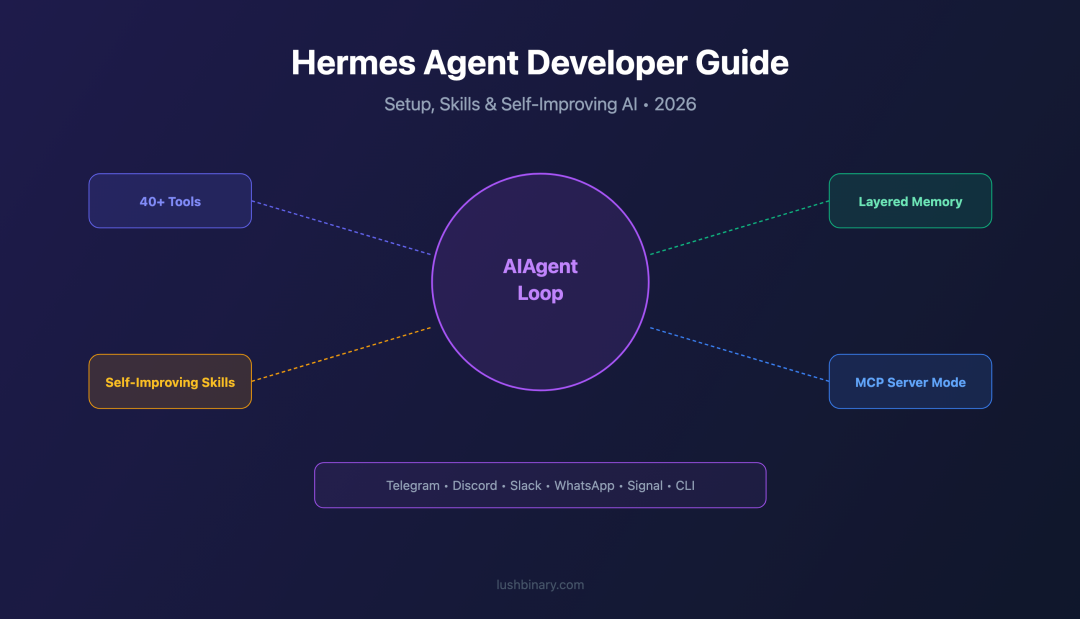

Hermes Agent 开发者指南:设置、架构、技能与自我改进的 AI

Hermes Agent 开发者指南:设置、架构、技能与自我改进的 AI

nobody-nobody

发布于 2026-04-22 20:31:36

发布于 2026-04-22 20:31:36

Hermes Agent 是首款具备内置学习循环的自托管 AI Agent。它由 Nous Research 开发(该实验室也是 Hermes 模型系列和 Atropos 强化学习环境的幕后团队),可以在你的机器上持久运行,连接到你的消息应用,并且使用时间越长越智能。

Hermes Agent 于 2026 年 2 月在 MIT 许可证下发布,迅速成为 OpenClaw 的主要替代方案,深受那些希望 Agent 能够随使用而不断进化、而非保持静态的开发者的青睐。截至 v0.7.0(2026 年 4 月 3 日),它具备可插拔的内存后端、40 多个内置工具、MCP 服务器模式以及六种终端后端。

本指南涵盖了你从零开始部署生产级 Hermes Agent 所需的全部内容:安装、配置、技能开发、内存架构和部署选项。

📑 本指南内容概览

- 什么是 Hermes Agent?

- 安装与设置

- 架构深入解析

- 自我改进的学习循环

- 内存架构

- 技能与工具

- 消息通道

- LLM 提供商配置

- MCP 集成

- 部署选项

- 安全最佳实践

- Lushbinary 如何提供帮助

1. 什么是 Hermes Agent?

Hermes Agent 是一个开源、模型无关的个人 AI Agent,设计为持久运行、跨会话记忆、调度周期性工作,并随时间改进其行为。与每次对话后都会重置的聊天机器人不同,Hermes 保持持久记忆,从经验中创建新技能,并在使用过程中不断完善这些技能。

核心能力:

自我改进的技能

- 从已完成的任务中自主创建和完善可复用的技能

持久记忆

- 基于 FTS5 搜索 + LLM 摘要,跨会话、平台和设备进行记忆

用户建模

- Honcho 辩证建模,建立对你的深度理解

40 多个内置工具

- 文件管理、浏览器、终端、邮件、日历等

6 种终端后端

- 本地、Docker、SSH、Daytona、Singularity、Modal

MCP 服务器模式

- 将 Hermes 暴露为 MCP 服务器,用于 IDE 和工具集成

多渠道

- Telegram、Discord、Slack、WhatsApp、Signal、CLI

200 多个 LLM 模型

- OpenRouter、OpenAI、Nous Portal、Ollama 等

2. 安装与设置

Hermes Agent 可在 Linux、macOS 和 WSL2 上运行。Windows 用户需要先安装 WSL2。

快速安装

# macOS

brew install hermes-agent

# Linux / WSL2

pip install hermes-agent

# 验证版本

hermes --version # 应显示 v0.7.0+

首次设置

# 初始化你的 Agent

hermes init

# 这将引导你完成:

# 1. 选择 LLM 提供商

# 2. 设置 API 密钥

# 3. 配置消息通道(可选)

# 4. 设置你的角色人格

# 启动 Agent

hermes start

设置向导是交互式的,大约需要 5 分钟。对于最小化启动,你只需要一个 LLM 提供商的 API 密钥(推荐使用 OpenRouter,可访问 200 多个模型)。

3. 架构深入解析

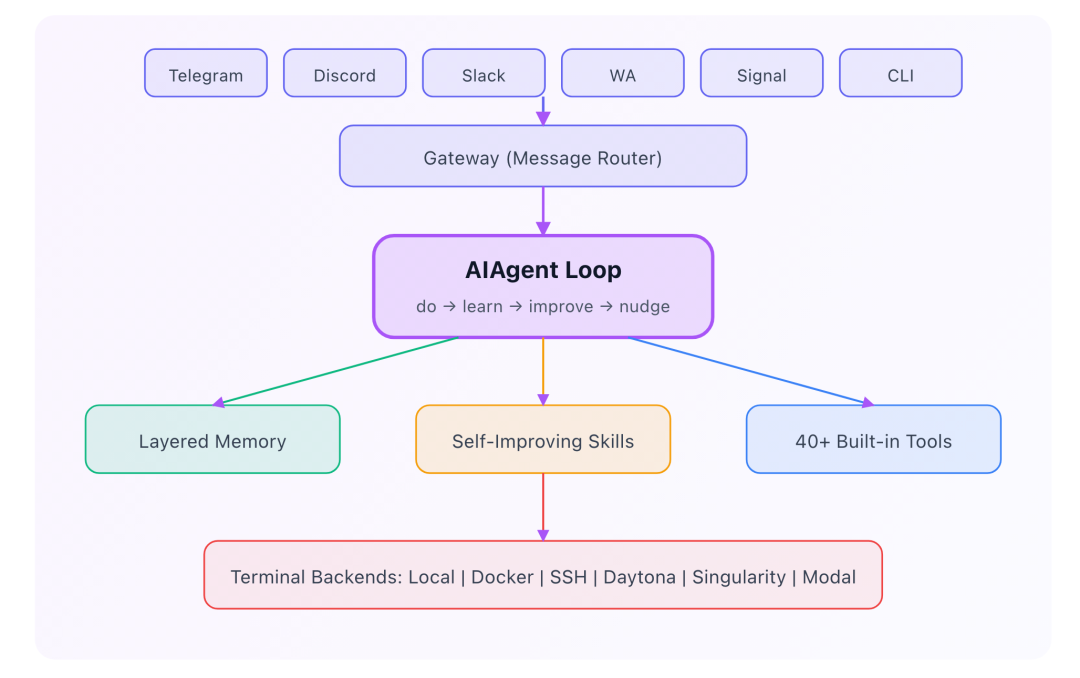

Hermes Agent 的架构以 AIAgent 循环 为中心,而非网关控制平面。这是一个经过深思熟虑的设计选择:学习循环被作为一等架构关切。

核心组件:

- AIAgent 循环:同步编排引擎。负责推理、工具执行、技能创建和自我评估。

- 网关:将来自消息平台的消息路由到 Agent 循环。支持单进程多渠道。

- Cron 调度器:在全新会话中运行周期性任务,自动交付输出。

- 工具运行时:跨六种终端后端执行工具(本地、Docker、SSH、Daytona、Singularity、Modal)。

- ACP 集成:Agent 通信协议,用于外部工具集成(代码编辑器、IDE)。

- SQLite 持久化:会话历史、内存和技能元数据存储在 SQLite 中,支持 FTS5 全文搜索。

- RL 环境:Atropos 集成,用于强化学习训练和轨迹导出。

4. 自我改进的学习循环

学习循环是 Hermes 与所有其他自托管 Agent 的根本区别。以下是它在实际中的工作原理:

- 任务完成:你要求 Hermes 完成某项复杂任务(例如:"研究竞争对手定价并创建对比电子表格")

- 模式提取:完成任务后,Hermes 分析它所采取的步骤,识别可复用的模式

- 技能创建:它编写一个 Markdown 技能文件,将工作流捕获为可复用的流程

- 技能完善:下次出现类似任务时,Hermes 使用该技能并根据结果进行完善

- 周期性提示:每完成 15 个任务,Hermes 会评估其整体表现,分析成功和失败

关键创新在于程序性记忆——Hermes 不仅记住事实,还记住方法。它将成功的工作流转换为可复用的程序,下次出现类似问题时加载使用。

缓存感知学习

内存架构是缓存感知的:它在会话初始化时冻结系统提示快照,因此高频模型调用可以高效使用缓存的上下文窗口。学习过程不会不断增加你的 Token 费用。

5. 内存架构

Hermes 使用分层内存系统,严格分离"热"提示内存和"冷"归档存储:

自 v0.7.0 起,内存完全可插拔。你可以通过以下命令切换后端:

hermes memory setup

# 可选项:内置、Honcho、向量存储、自定义数据库

6. 技能与工具

Hermes 技能遵循 agentskills.io 开放标准。技能是描述可复用流程的 Markdown 文件。与 OpenClaw 的静态技能不同,Hermes 技能可以:

- 自动生成:由 Agent 在完成复杂任务后创建

- 自我改进:在后续使用中根据结果自动完善

- 手动编写:你仍然可以手动编写技能

Hermes 还附带 40 多个内置工具,涵盖文件管理、浏览器自动化、终端执行、邮件、日历、网页搜索等。工具可在所有六种终端后端中使用。

子 Agent

Hermes 支持隔离子 Agent——每个子 Agent 都有自己的对话、终端和 Python RPC 脚本,实现零上下文成本的流水线。这适用于你不希望任务相互干扰的并行工作流。

7. 消息通道

Hermes 可从单个网关进程连接到你现有的消息应用。支持的通道:

Telegram

- 完整的 Bot API,支持内联键盘和媒体

Discord

- 支持线程和语音频道的 Bot

Slack

- 支持 OAuth、斜杠命令和线程的应用

- 支持媒体和模板的商业 API

Signal

- 隐私优先的消息应用(OpenClaw 不支持)

CLI

- 支持多行编辑、自动补全和历史记录的 TUI

在一个通道上开始,在另一个通道上继续——Hermes 跨平台保持上下文。CLI 包含文本用户界面(TUI),具有多行编辑、自动补全、对话历史记录功能,并能在 Agent 执行过程中中断或重定向。

8. LLM 提供商配置

Hermes 是模型无关的。通过一条命令切换模型,无需更改代码:

hermes model # 交互式模型选择器

支持的提供商:

- OpenRouter:200 多个模型,包括 Claude、GPT、Gemini、Llama、DeepSeek

- OpenAI:GPT-5.4、GPT-5.4 Thinking

- Nous Portal:针对 Agent 使用优化的 Hermes 模型

- Ollama:本地模型(Gemma 4、Llama 4、Qwen 3.5、DeepSeek)

- z.ai、Kimi Moonshot、MiniMax、GLM:其他提供商

- 自定义端点:任何兼容 OpenAI 的 API

9. MCP 集成

Hermes 在两个方向上支持 MCP(模型上下文协议):

- MCP 客户端:连接到外部 MCP 服务器以访问工具(数据库、API、文件系统)

- MCP 服务器模式(v0.6.0+):将 Hermes 本身暴露为 MCP 服务器,允许 IDE 和其他工具将 Hermes 用作后端

要深入了解 MCP,请参阅我们的 MCP 开发者指南。

10. 部署选项

Hermes 是可移植的——它不绑定于单个应用或单台机器。部署选项:

- 本地开发:直接在 macOS/Linux/WSL2 上运行

- VPS/云服务器:在 DigitalOcean、AWS、GCP、Azure 上运行

- Docker:使用官方镜像进行容器化部署

- Modal:无服务器部署,按需扩展

- Daytona:云开发环境集成

11. 安全最佳实践

Hermes 的安全默认设置比大多数 Agent 框架更安全,但你仍应遵循以下实践:

- 使用 Docker 后端进行生产部署,配置只读 root 和丢弃的 capabilities

- 启用提示词注入扫描(v0.7.0 中默认开启)

- 审查工具权限——限制 Agent 可在无人监督情况下使用的工具

- 使用凭证过滤防止 API 密钥出现在 Agent 上下文中

- 定期监控 Agent 日志:

hermes logs --follow - 保持 Hermes 更新——安全补丁频繁发布

对于敏感部署,考虑在具有受限网络访问的专用 VPC 中运行 Hermes。有关更多详情,请参阅我们的 Hermes 与 OpenClaw 安全对比。

12. Lushbinary 如何提供帮助

自 OpenClaw 早期以来,我们就在部署 AI Agent,并且是最早在客户项目中采用 Hermes Agent 的团队之一。我们可以帮助:

- 自定义 Agent 开发:针对你的特定工作流构建专用的 Hermes Agent

- MCP 服务器开发:将 Hermes 连接到你的数据库、API 和内部工具

- AWS 部署:具有监控和自动扩展功能的生产基础设施

- 技能开发:针对你的行业和用例的自定义技能

- 从 OpenClaw 迁移:零停机的平稳过渡

🚀 免费咨询

预约免费的 30 分钟通话,讨论你的 AI Agent 需求。我们将帮助你设计正确的架构并让 Hermes 在生产环境中运行。

❓ 常见问题

什么是 Hermes Agent?

来自 Nous Research 的开源自托管 AI Agent,具备内置学习循环。它持久运行,连接消息应用,并随时间改进技能。MIT 许可证,支持 200 多个模型。

如何安装 Hermes Agent?

macOS:brew install hermes-agent。Linux/WSL2:pip install hermes-agent。然后运行 hermes init 配置 LLM 提供商和通道。

自我改进循环如何工作?

完成复杂任务后,Hermes 提取可复用模式并将其编写为技能。技能在使用中自我改进。每完成 15 个任务,Agent 评估其表现。

费用是多少?

免费软件(MIT)。VPS 托管每月 起。成本从0(Ollama)到 $65/月(高级模型)不等。

Hermes 支持哪些模型?

通过 OpenRouter 支持 200 多个模型,加上 OpenAI、Nous Portal、z.ai、Kimi、MiniMax、GLM、Ollama 和自定义端点。

翻译:https://lushbinary.com/blog/hermes-agent-developer-guide-setup-skills-self-improving-ai/

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-18,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录