6行代码搞定AI Agent记忆!这个16K Star的开源项目打破了传统RAG痛点!

6行代码搞定AI Agent记忆!这个16K Star的开源项目打破了传统RAG痛点!

开源星探

发布于 2026-04-22 20:29:00

发布于 2026-04-22 20:29:00

最近在刷 AI Agent 有哪些优秀的记忆系统时,发现了一个让人眼前一亮的开源项目——Cognee。

传统的 RAG 方案虽然能实现检索增强,但经常面临上下文断裂、检索不精准等问题,开发者们为此头疼不已。

而 Cognee 只用了6行代码,就能给 AI Agent 构建一个完整的持久化记忆系统。

更妙的是,它创造性地把向量搜索和图数据库结合在一起,让文档既可以按语义检索,又能按关系相互连接,形成了一个真正的统一记忆层。

目前这个项目在GitHub上已经有 16K Star,支持 CLI 和本地 UI,还能兼容 Ollama 本地模型,对于想给 Agent 搭建记忆系统的开发者来说,简直是雪中送炭。

项目简介

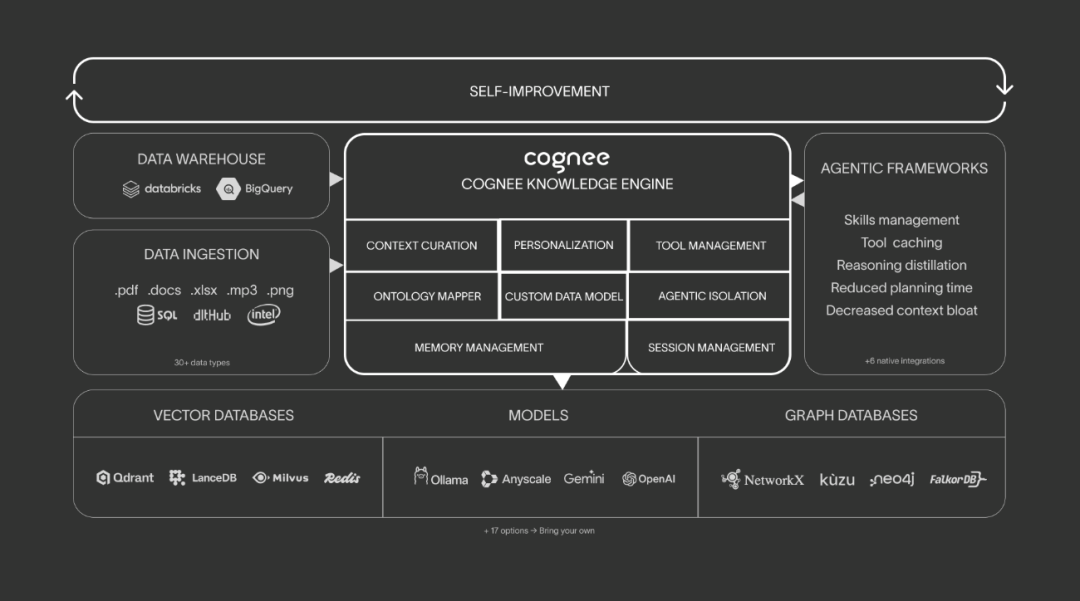

Cognee 是一个开源的知识引擎,它可以让你以任意格式和结构摄入数据,并通过持续学习为 AI Agent 提供正确的上下文。

项目由 topoteretes 团队开发,核心思路是结合向量搜索、图数据库和认知科学方法,让你的文档既可以通过含义搜索,又可以通过关系相互连接,而且这些关系还能随着文档的变化而动态演化。

它不再是简单的检索增强,而是一个可以学习、可以记忆、可以推理的完整知识系统。项目开发者甚至把它比喻为"AI的大脑补丁",足以看出其定位之高。

Cognee 的核心工作流被抽象成了 ECL(Extract、Cognify、Load)管道,这个设计巧妙地替代了传统 RAG 的同时,又保留了高度可定制的空间,可以根据自己的需求灵活调整。

核心亮点

- • 向量搜索与图数据库的完美结合:可自动选择最佳的检索策略,既可以按语义搜索,也可以按关系遍历,甚至可以两者结合,真正实现了"既懂意思,又懂关系"。

- • 双层次记忆架构:会话记忆和永久记忆。既保证了推理的效率,又确保了知识的持久性。

- • 支持30+数据源:提供了非常Pythonic的API,支持从30多种数据源接入数据,涵盖了过往对话、文件、图像、音频转写等多种类型。

- • 四大核心API:

remember()-永久存储到知识图谱;recall()-查询,自动选择最佳搜索策略;forget()-删除数据;improve()-从反馈中学习。

技术特点

ECL管道架构

Cognee的核心工作流是ECL(Extract、Cognify、Load)管道:

- • Extract:从各种数据源提取数据

- • Cognify:提取实体和关系,构建知识图谱

- • Load:加载到图数据库和向量数据库中

这个架构非常清晰,每个环节都可以单独定制和扩展。而且Cognee已经提供了丰富的内置组件,你可以直接使用,也可以根据需要自己开发。

自动路由检索

Cognee的recall()API支持自动路由,它会根据你的查询自动选择最佳的搜索策略。支持的策略包括:

- • TEMPORAL:时间感知的图搜索

- • FEEL:情感感知的检索

- • SEMANTIC:纯语义搜索

- • GRAPH:纯图遍历

- • HYBRID:混合模式

这种自动路由让开发者不需要关心底层的检索细节,只要把查询丢给Cognee,它就能给你最好的结果。

快速入手

目前可以使用pip、poetry、uv或你喜欢的任何Python包管理器来安装Cognee:

# 使用uv(推荐)

uv pip install cognee

# 或者使用pip

pip install cognee

# 或者使用poetry

poetry add cognee首先,你需要配置LLM API密钥:

import os

os.environ["LLM_API_KEY"] = "YOUR OPENAI_API_KEY"或者,你也可以创建一个.env文件(可以使用项目提供的模板)。如果你想集成其他LLM提供商,可以查看官方的LLM Provider文档。

6行代码体验核心功能

让我们用Cognee的四个核心API——remember、recall、forget、improve——来体验一下:

import cognee

import asyncio

async def main():

# 永久存储到知识图谱(同时执行add + cognify + improve)

await cognee.remember("Cognee turns documents into AI memory.")

# 存储到会话记忆(快速缓存,后台同步到图)

await cognee.remember("User prefers detailed explanations.", session_id="chat_1")

# 查询,自动选择最佳搜索策略

results = await cognee.recall("What does Cognee do?")

for result in results:

print(result)

# 先查会话记忆,如果需要则回退到图

results = await cognee.recall("What does the user prefer?", session_id="chat_1")

for result in results:

print(result)

# 完成后删除

await cognee.forget(dataset="main_dataset")

if __name__ == '__main__':

asyncio.run(main())是的,你没有看错,核心功能就是这么简单!

使用Cognee CLI

Cognee还提供了命令行工具,使用起来更加方便:

# 记住信息

cognee-cli remember "Cognee turns documents into AI memory."

# 回忆信息

cognee-cli recall "What does Cognee do?"

# 忘记所有信息

cognee-cli forget --all如果你想打开本地UI,只需要运行:

cognee-cli -uiCognee已经和多个流行的AI Agent框架集成好了,让我们看看几个例子。

你可以安装Cognee记忆插件,让Claude Code拥有跨会话的持久化记忆。插件会自动通过钩子捕获工具调用到会话记忆中,并在会话结束时同步到永久知识图谱。

设置步骤:

# 安装cognee

pip install cognee

# 配置

export LLM_API_KEY="your-openai-key"

# 克隆插件

git clone https://github.com/topoteretes/cognee-integrations.git

# 启用它(添加到~/.zshrc以永久使用)

claude --plugin-dir ./cognee-integrations/integrations/claude-code或者,你也可以连接到Cognee Cloud而不是本地运行:

export COGNEE_SERVICE_URL="https://your-instance.cognee.ai"

export COGNEE_API_KEY="ck_..."这个插件会挂钩到Claude Code的生命周期——SessionStart初始化记忆,PostToolUse捕获动作,UserPromptSubmit注入相关上下文,PreCompact在上下文重置前保留记忆,SessionEnd将会话数据桥接到永久图中。

Hermes Agent集成

你可以在Hermes Agent中启用Cognee作为记忆提供者,实现会话感知的知识图谱记忆和自动路由回忆。

设置步骤:

# ~/.hermes/config.yaml

memory:

provider: cogneeexport LLM_API_KEY="your-openai-key"

hermes # 开始聊天——会话记忆和图持久化都是自动的或者运行hermes memory setup并选择Cognee。对于Cognee Cloud,在~/.hermes/.env中设置COGNEE_SERVICE_URL和COGNEE_API_KEY。

连接到Cognee Cloud

你可以让任何Python Agent指向托管的Cognee实例——所有SDK调用都会路由到云端:

import cognee

await cognee.serve(url="https://your-instance.cognee.ai", api_key="ck_...")

await cognee.remember("important context")

results = await cognee.recall("what happened?")

await cognee.disconnect()写在最后

Cognee是一个非常有前景的开源项目,它用简洁的API和优雅的架构,很好的解决了AI Agent记忆系统的痛点。

6行代码就能构建持久化记忆,这种体验真的非常棒。

如果你正在开发AI Agent,或者对RAG的效果不满意,强烈推荐你试试Cognee。它的向量搜索+图数据库的组合、双层次记忆架构、30+数据源支持,都能让你的Agent变得更加智能和可靠。

GitHub:https://github.com/topoteretes/cognee

如果本文对您有帮助,也请帮忙点个 赞👍 哈!❤️

在看你就赞赞我!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-18,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录