零样本3D缺陷检测新突破:GS-CLIP技术全解读

零样本3D缺陷检测新突破:GS-CLIP技术全解读

OpenCV学堂

发布于 2026-04-21 20:52:59

发布于 2026-04-21 20:52:59

介绍

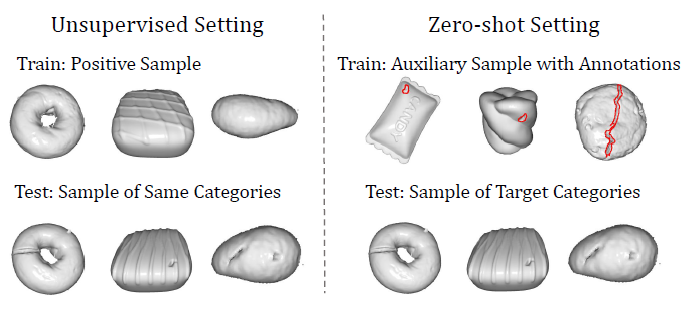

零样本3D异常检测(Zero-shot 3D Anomaly Detection, ZS3DAD)是工业制造领域一项新兴且关键的技术任务。与传统的无监督3D异常检测不同,ZS3DAD无需依赖目标类别的任何正常样本进行训练,这在样本稀缺、数据隐私受限的实际场景中具有显著优势。

目前主流的方法尝试将CLIP(Contrastive Language-Image Pre-training)模型适配到3D领域,其基本思路是将3D点云投影为多视角2D图像,利用CLIP进行2D异常检测,再将结果反投影回3D空间。然而,现有方法面临两大核心局限

缺乏3D几何结构感知能力

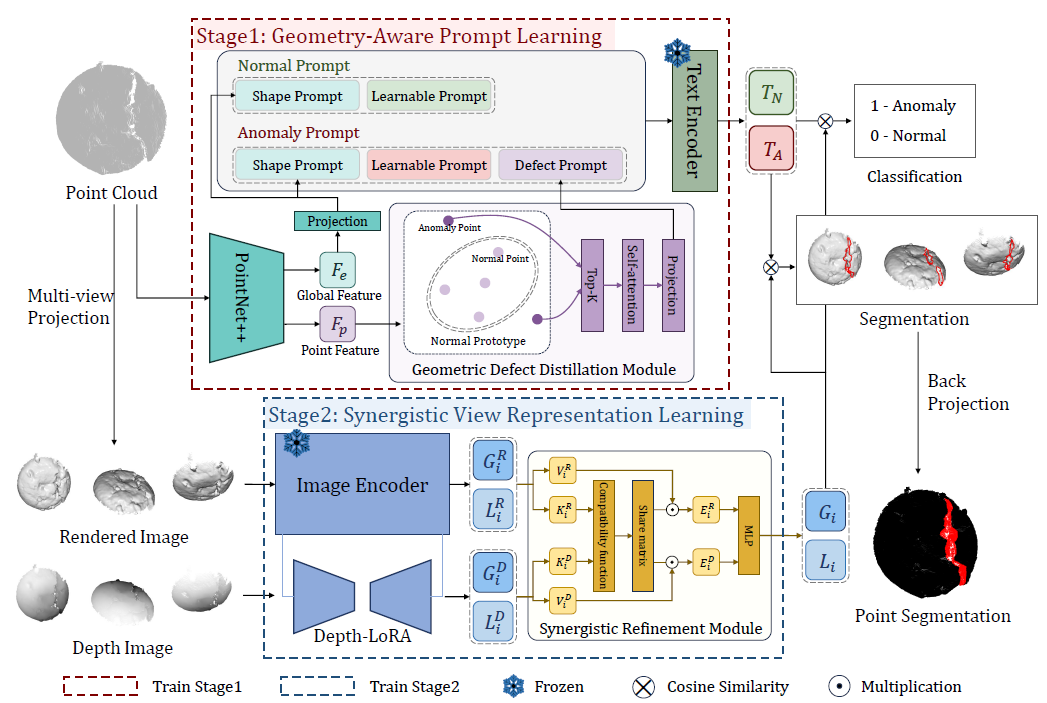

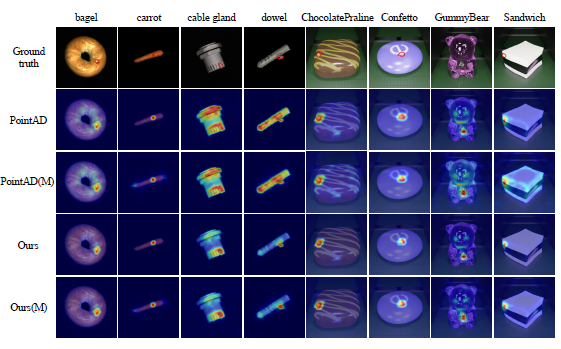

视觉信息利用不充分针对上述问题,研究者提出了GS-CLIP(Geometry-Aware Prompt and Synergistic View Representation Learning)框架。该框架采用两阶段学习策略,依次优化文本和视觉组件,使CLIP能够真正感知和理解3D结构异常。

第一阶段:几何感知提示学习(Geometry-Aware Prompt Learning)。在冻结视觉组件的情况下,训练一个文本提示生成器。该生成器通过提取3D点云的全局几何信息动态创建形状提示,并通过设计的几何缺陷蒸馏模块(Geometric Defect Distillation Module, GDDM)从局部几何特征中识别并合成缺陷信息。这些嵌入了3D结构先验的文本提示为从2D投影图像中检测和定位异常提供了关键线索。

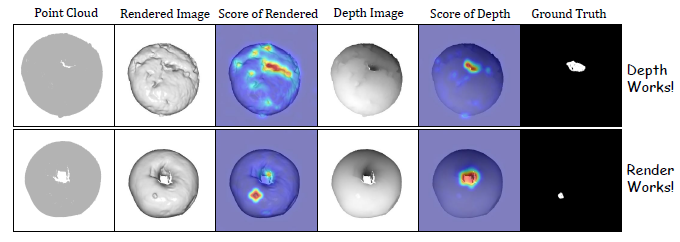

第二阶段:协同视图表征学习(Synergistic View Representation Learning)。冻结第一阶段训练好的文本提示生成器,转而训练视觉组件。该阶段采用双流架构:渲染图像由原始冻结的视觉编码器处理,而深度图则通过经LoRA微调的并行分支(Depth-LoRA)处理。两个分支提取的特征随后由协同细化模块(Synergistic Refinement Module, SRM)进行深度融合,充分利用两种视觉表征的互补优势

核心技术模块

GS-CLIP整体架构

3.1 几何缺陷蒸馏模块(GDDM)

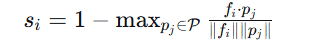

GDDM的核心创新在于基于“异常本质是偏离正常模式”这一原理设计。模块维护一个由可学习向量组成的正常原型记忆库,这些原型在训练过程中被隐式引导以拟合正常局部几何特征的分布,从而构建紧凑的正常特征流形。

对于每个点的局部几何特征,计算其与记忆库中最相似原型的距离作为几何离群分数:

基于计算的离群分数,选取分数最高的top-kk个点的特征。为了捕捉这些离群点之间的内在结构关系(例如它们是否共同构成一道划痕或一处凹陷),将这些特征输入基于自注意力的聚合网络,使不同离群特征相互交互,蒸馏出对整个缺陷区域的整体理解,最终通过投影获得缺陷提示。

3.2 协同细化模块(SRM)

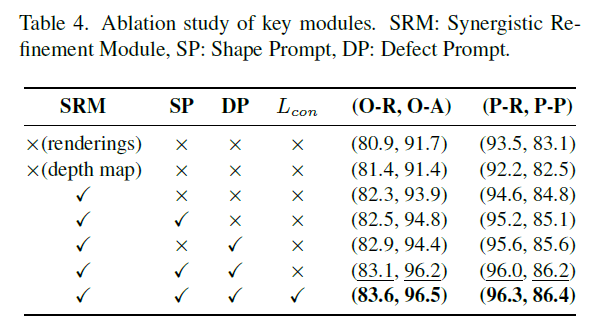

SRM负责有效融合渲染图像和深度图的特征。以全局特征为例,模块首先生成两个键值对,然后通过兼容性函数生成共享矩阵:

基于此共享矩阵,计算两组注意力权重并进行信息聚合,最后将增强后的特征拼接并通过一个小型MLP网络融合,得到两种模态的协同全局特征表示。

3.3 深度图适配(Depth-LoRA)

为了使CLIP适配深度图的特征分布,采用Low-Rank Adaptation(LoRA)技术对视觉编码器中的MLP层进行选择性微调。该方法在保持预训练模型多头自注意力块强大空间关系建模能力的同时,仅微调少量参数即可实现模态适配。

实验与结果

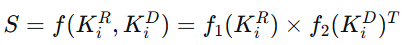

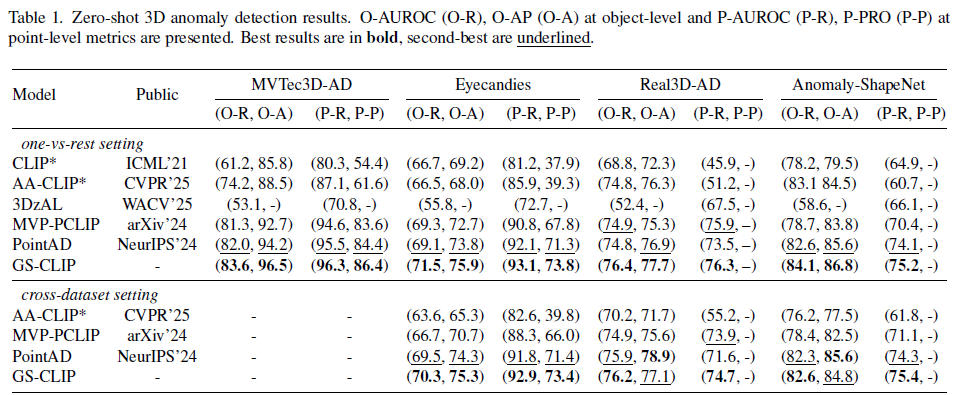

研究在四个大规模公开数据集上进行了评估:MVTec3D-AD(真实工业级)、Real3D-AD(真实工业级)、Eyecandies(合成)、Anomaly-ShapeNet(合成)。采用两种零样本设置:留一验证(在三个选定类别上独立训练)和跨数据集验证(使用单一类别作为辅助训练数据,在其他数据集上测试)。

消融实验与分析

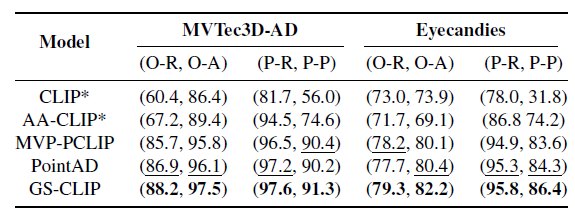

关键模块消融:

- 仅融合两种视觉表征(SRM)即可显著提升所有指标

- 添加形状提示后对象级指标进一步提升,证明宏观几何上下文有助于模型的整体判断

- 添加缺陷提示和GDDM后点级指标获得最大提升(P-PRO从84.8%升至85.6%),证明从离群点中提取特定缺陷描述极大地增强了精确定位能力

- 两种提示集成并加入跨视图一致性损失后达到最佳效果

GDDM参数分析:

- 候选离群点数量k=12k=12时达到最佳性能,过大则引入正常点特征噪声

- 原型数量l=32l=32时性能最优,足以构建有代表性且不过于复杂的正常特征流形

视角数量分析:

随着视角数量增加,性能整体上升,约9个视角时达到饱和。

结论

GS-CLIP的核心技术价值在于:通过几何感知提示学习和协同视图表征学习的双阶段策略,首次使CLIP能够真正从2D多视角图像中感知和理解3D结构异常。该方法在多个大规模公开数据集上的卓越表现,为数据受限场景下的工业3D异常检测提供了有效解决方案

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读