为什么 AI 写代码正在变成一个分布式系统问题

当多个 AI Agent 同时改你的代码,状态冲突、竞态条件、共识困难——这些分布式系统的经典噩梦全来了。

本文从分布式系统视角拆解多智能体编程的真实挑战。

上个月我用 Claude Code 的 Agent Teams 做了一次微服务重构。三个 Agent 分别负责用户服务、订单服务和支付服务的 API 改造,Team Lead 协调接口契约。前 20 分钟一切顺利——直到我发现用户服务的 Agent 把 userId 字段改成了 user_id(snake_case),而订单服务的 Agent 仍然在用 userId(camelCase)调用它。

两个 Agent 各自的代码都能通过编译。集成测试全挂。

这不是 AI 不够聪明的问题。这是一个经典的分布式系统问题:多个独立节点在没有强一致性保证的情况下并发修改共享状态,必然产生冲突。Leslie Lamport 在 1978 年就说过这件事,只不过他说的是进程和时钟,我们现在遇到的是 AI Agent 和代码仓库。

“一句话摘要:多智能体编程的核心挑战不是 AI 的推理能力,而是多个 AI 实例之间的协调、一致性和冲突解决——这正是分布式系统理论研究了 40 年的东西。

为什么要搞清楚这件事?

如果你只用一个 AI 对话窗口写代码,这篇文章跟你没关系,可以关掉了。

但如果你已经在用或者准备用以下任何一种方式:

- Claude Code 的 Sub-agents 或 Agent Teams 并行处理多个模块

- Devin 这类端到端 AI 工程师自动做跨文件变更

- CrewAI / AutoGen 编排多个 Agent 角色(PM、开发、测试)协作

- 在 CI/CD 里接入多个 AI 检查步骤并行跑

那你实际上已经在运行一个分布式系统了,只是这些「节点」恰好是 AI Agent 而不是微服务实例。

特征 | 传统分布式系统 | 多智能体编程 |

|---|---|---|

节点 | 服务实例 / 进程 | AI Agent 实例 |

共享状态 | 数据库 / 缓存 | 代码仓库 / 文件系统 |

通信方式 | RPC / 消息队列 | 自然语言 + 工具调用 |

一致性问题 | 数据不一致 | 代码风格冲突、接口契约不一致 |

脑裂 | 网络分区 | Context 隔离(每个 Agent 只看到部分信息) |

协调机制 | Raft / Paxos / 2PC | Team Lead / 主对话 / CLAUDE.md |

这个类比不是修辞——它是精确的。理解这一点,能帮你从「AI 好像不太行」的模糊判断,进化到「这是一个缺少共识协议的并发写入问题」的精确诊断。

三个 AI Agent 同时改代码时到底发生了什么?

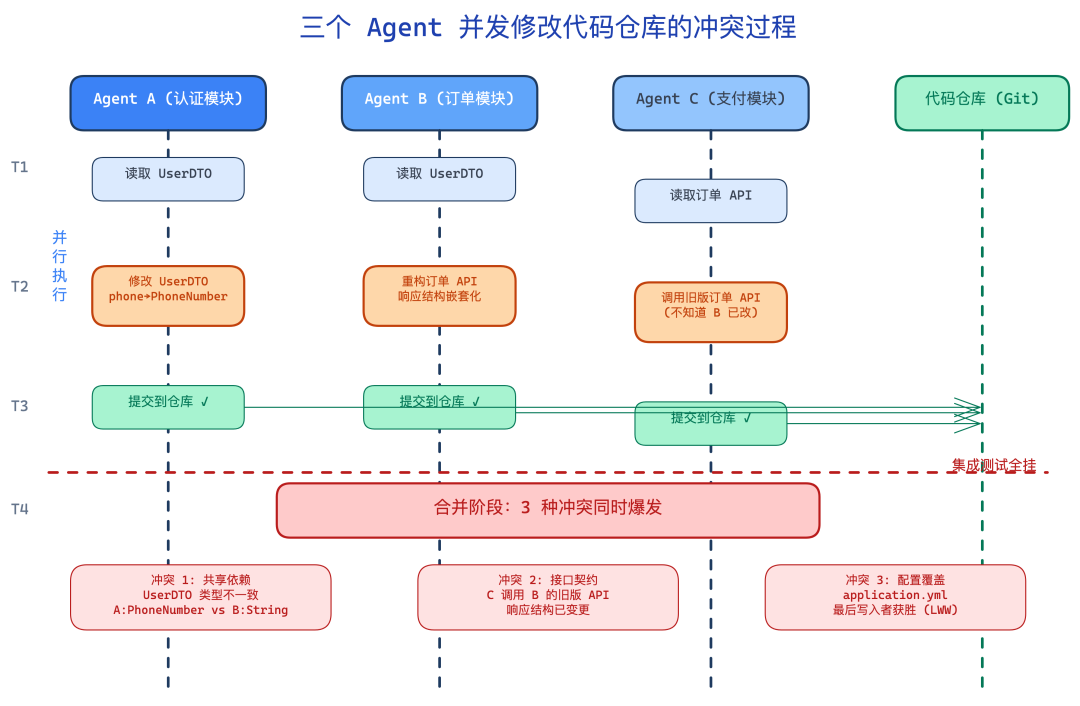

让我们从一个具体场景开始。假设你让三个 Agent 并行处理一个电商项目的不同模块:

- Agent A:重构用户认证模块

- Agent B:优化订单查询性能

- Agent C:添加支付退款功能

看起来很合理——三个模块,三个 Agent,互不干涉。但现实是:

agent-conflict-timeline

agent-conflict-timeline

冲突一:共享依赖的并发修改。 Agent A 在重构认证模块时,把 UserDTO 的 phone 字段从 String 改成了 PhoneNumber 值对象。Agent B 在优化订单查询时,查询结果里包含 UserDTO,它读到的还是旧版本的 String 类型。两个 Agent 独立完成后合并代码——编译失败。

冲突二:接口契约的隐式假设。 Agent C 在添加退款功能时,调用了 Agent B 维护的订单服务查询接口。但 Agent B 已经把 /api/orders/{id} 的响应结构从扁平 JSON 改成了嵌套结构(为了优化查询性能做了 denormalization)。Agent C 不知道这件事。

冲突三:配置文件的最后写入者获胜。 三个 Agent 都往 application.yml 里加了自己需要的配置项。如果没有适当的合并策略,最后一个写入的 Agent 会覆盖前面的修改。这和分布式系统里的 Last-Writer-Wins(LWW)问题一模一样。

这些不是假设场景。GitHub 上的 goose 项目(38.5k stars)和 Claude Code 的 issue tracker 里都有大量类似的 bug 报告。Lobsters 上有一个帖子标题直接叫「Multi-agent software development: the distributed systems hard problems」,引发了激烈讨论。

分布式系统理论怎么看这件事

如果把每个 AI Agent 看作一个独立节点,代码仓库看作共享状态存储,那分布式系统理论里至少有三个核心概念直接适用。

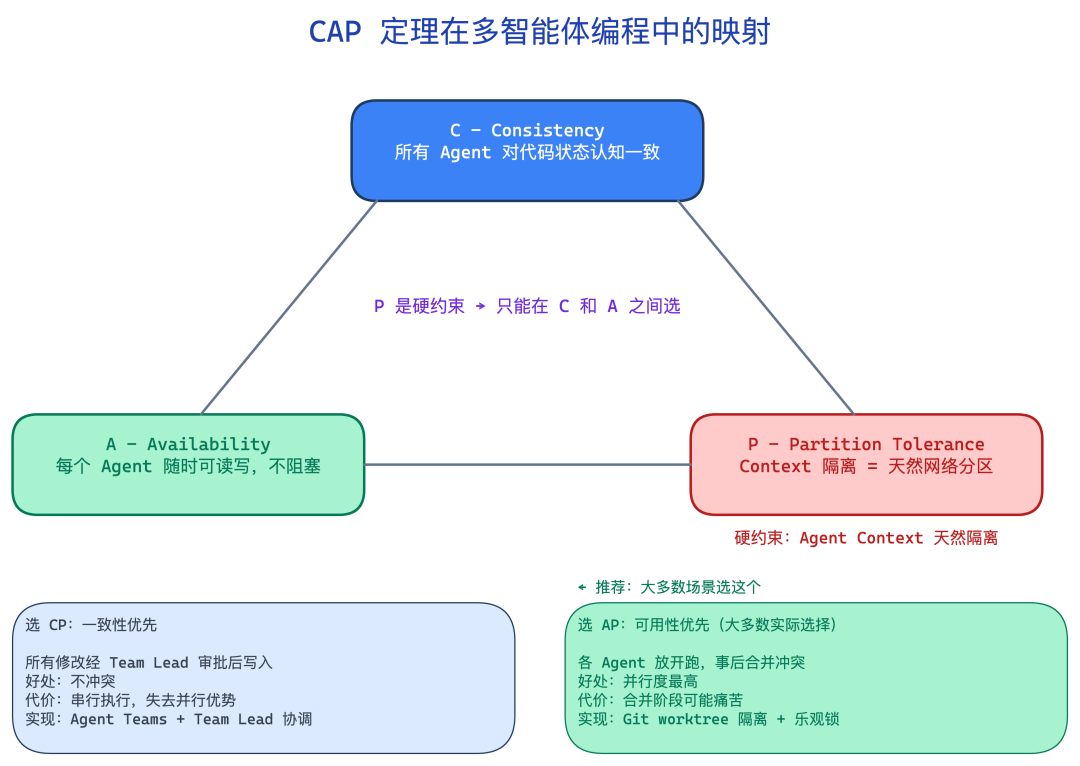

CAP 定理的 Agent 版本

Eric Brewer 的 CAP 定理说:一个分布式系统不可能同时满足一致性(Consistency)、可用性(Availability)和分区容错性(Partition tolerance),最多只能满足其中两个。

在多智能体编程中:

- 一致性:所有 Agent 对代码库当前状态的认知完全一致

- 可用性:每个 Agent 都能随时读写代码,不被阻塞

- 分区容错:Agent 之间的 context 天然隔离(每个 Agent 有独立的 context window,不共享内存)

分区容错是硬约束——Claude Code 的 Sub-agents 之间不能直接通信,每个 Agent 只能看到自己 context 里的内容,这本质上就是网络分区。所以你只能在一致性和可用性之间选一个。

选一致性(CP 模式):所有 Agent 对代码的修改必须经过主对话(中心协调者)审批后才能写入。好处是不会冲突,坏处是变成串行执行,失去了并行的意义。Claude Code 的 Agent Teams 里 Team Lead 就扮演这个角色——但它不是强制的 gatekeeper,更像一个建议性的协调者。

选可用性(AP 模式):所有 Agent 放开跑,各自修改代码,最后合并时处理冲突。好处是并行度最高,坏处是合并阶段可能很痛苦。Git worktree 隔离本质上就是这个策略——每个 Agent 在独立分支工作,最后 merge。

大多数实际场景是 AP + 事后冲突解决。这也是为什么 Claude Code 引入了 worktree 隔离机制——给每个 Agent 一个独立的 git worktree,相当于分布式数据库里的「乐观锁」:先让大家各自跑,冲突了再解决。

共识问题:谁说了算?

分布式系统里最难的问题之一是共识(Consensus):当多个节点对某个值的看法不一致时,如何达成一致?Raft 和 Paxos 算法就是为了解决这个问题。

多智能体编程的共识问题更棘手,因为 Agent 之间争议的不是一个数值,而是设计决策。比如:

- Agent A 认为应该用 JWT 做认证,Agent B 已经按 Session 模式写了代码

- Agent A 把错误码定义为

enum,Agent C 用的是String常量 - Agent A 觉得日志应该结构化输出 JSON,Agent B 直接

println

在传统分布式系统里,Leader Election 算法确保只有一个节点做决策。在多智能体编程里,CLAUDE.md 和 AGENTS.md 就是你的共识协议。它们定义了代码规范、技术选型约束、接口契约模板——所有 Agent 在启动时都会读取这些文件,相当于在「创世块」里写入了共识规则。

这也是为什么 Anthropic 强烈推荐在多智能体场景下维护一个详尽的 CLAUDE.md——它不是文档,它是分布式系统里的配置中心。

拜占庭容错:Agent 会「说谎」吗?

分布式系统里有一类极端问题叫拜占庭故障(Byzantine Fault):节点不只是宕机,还可能发送错误信息。

AI Agent 不会故意「说谎」,但它们会幻觉——自信地生成错误的代码、编造不存在的 API、或者错误地声称「已完成任务」。这在效果上和拜占庭故障一样:你收到了来自某个节点的消息,但不能完全信任它的正确性。

Devin 在 SWE-bench 上的准确率是 13.86%,这意味着 86% 的情况下它给出的答案是错的(当然这是 2024 年初的数据,现在进步了不少)。但即使准确率提升到 80%,在 5 个 Agent 并行的场景下,至少一个 Agent 出错的概率是 1 - 0.8^5 = 67%。

这就是为什么多智能体系统需要验证层——不能信任任何单个 Agent 的输出。CrewAI 框架里内置了「审查者」角色,Claude Code 的 Agent Teams 里 Team Lead 有验证职责,goose 项目则通过 MCP 协议让不同 Agent 的输出可以被第三方工具验证。

概率计算说明一切:Agent 越多,整体出错概率越高,对验证机制的要求也越高。这和分布式系统里「节点越多,故障越频繁」的规律完全一致。

现有工具是怎么解决这些问题的

理论讲够了。现在看看 2026 年的主流工具各自选了什么策略。

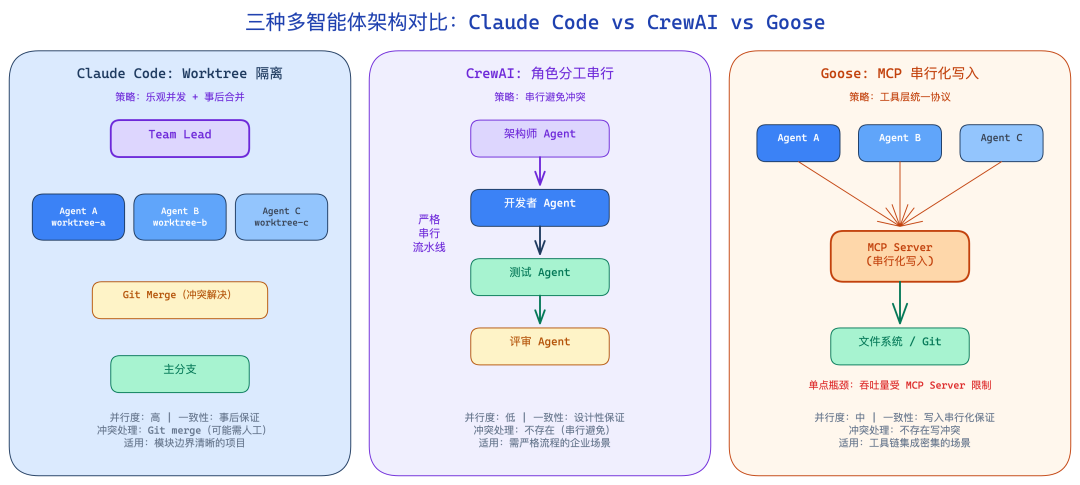

Claude Code:worktree 隔离 + Team Lead 协调

Claude Code 的多智能体方案选了一条务实的路:在文件系统层面隔离,在协调层面用弱一致性。

主对话 (Team Lead)

├── Agent A (worktree: /tmp/worktree-a) ← 独立 git 分支

├── Agent B (worktree: /tmp/worktree-b) ← 独立 git 分支

└── Agent C (worktree: /tmp/worktree-c) ← 独立 git 分支

↓ 完成后

合并到主分支(冲突在此解决)

每个 Sub-agent 可以在独立的 git worktree 里工作,相当于每人一个隔离沙箱。这解决了「最后写入者获胜」的问题——因为根本不会有并发写入,大家在各自的副本上工作。

但这个方案的代价是合并阶段的复杂性。如果三个 Agent 都修改了同一个共享模块(比如公共工具类),git merge 阶段就会出现冲突。Team Lead 负责解决这些冲突,但它的判断依赖于它能理解三个 Agent 各自修改的意图——这要求 Team Lead 的 context 里包含足够的信息,又回到了 context window 瓶颈的问题。

CrewAI / AutoGen:角色分工 + 消息传递

CrewAI(多 Agent 编排框架)选了另一条路:角色化分工 + 显式消息传递。

# CrewAI 的角色定义模式

crew = Crew(

agents=[

Agent(role="架构师", goal="设计系统架构和接口契约"),

Agent(role="开发者", goal="根据架构师的设计实现代码"),

Agent(role="测试工程师", goal="编写测试验证开发者的实现"),

Agent(role="评审员", goal="检查代码质量和设计一致性"),

],

process=Process.sequential # 或 Process.hierarchical

)

这个模式的灵感来自软件工程的分工实践——架构师先定方案,开发者照方案写码,测试工程师验证,评审员把关。Agent 之间通过结构化消息传递信息,而不是共享文件系统。

好处是冲突被设计性地避免了——因为同一时刻只有一个角色在修改代码。坏处是失去了并行能力,本质上是串行流水线,只是每个阶段由不同的专家来做。

CrewAI 也支持 Process.hierarchical 模式,允许一定程度的并行,但它的冲突解决机制还很原始——基本靠「管理者 Agent」的自然语言判断。

Goose:MCP 协议统一工具层

Block 公司(Square 母公司)开源的 goose(38.5k stars)走了第三条路:不在 Agent 层面解决一致性,而是在工具层面统一协议。

Goose 基于 Model Context Protocol(MCP)标准,所有 Agent 通过统一的工具接口操作外部系统。MCP 定义了 70+ 种标准化工具,Agent 不直接操作文件系统,而是通过 MCP Server 间接操作。

Agent A ──┐

Agent B ──┼──→ MCP Server ──→ 文件系统 / Git / 数据库

Agent C ──┘ (串行化写入)

tool-architecture-comparison

tool-architecture-comparison

这实际上把 MCP Server 变成了单点写入代理(类似数据库的 Write-Ahead Log),所有写操作经过同一个入口串行化。这完全避免了并发写冲突,但引入了性能瓶颈——MCP Server 成了单点,吞吐量受限于它的处理速度。

三种方案的对比:

方案 | 一致性策略 | 并行度 | 冲突处理 | 适用场景 |

|---|---|---|---|---|

Claude Code worktree | 乐观并发 + 事后合并 | 高 | Git merge(可能需要人工) | 模块边界清晰的项目 |

CrewAI 角色分工 | 串行避免冲突 | 低 | 设计性规避 | 需要严格流程的企业场景 |

Goose MCP 串行化 | 写入串行化 | 中 | 不存在写冲突 | 工具链集成密集的场景 |

注意,没有「最好」的方案。这和分布式数据库选型一样——你需要根据你的一致性需求、性能要求和容错级别来选。

「Post-Agentic Code Forge」:下一代代码基础设施

Lobsters 上最近有一个帖子叫「Post-Agentic Code Forges」,讨论当 AI Agent 成为主要代码生产者后,现有的代码管理基础设施(Git、GitHub、CI/CD)需要怎样演进。

这个讨论触及了多智能体编程最深层的问题:Git 是为人类设计的版本控制系统,它的核心假设是开发者会有意识地避免冲突、会读 diff、会写有意义的 commit message。AI Agent 不具备这些「社会性」能力。

几个正在浮现的方向:

语义级 merge 替代文本级 merge。 当前 Git 的合并是基于文本行的差异比较。两个 Agent 修改同一个函数的不同部分,即使语义上完全兼容,git 也可能报冲突。未来可能出现理解代码语义的 merge 工具——它知道 Agent A 加了一个参数、Agent B 改了返回值,两者可以自动合并。

接口契约的形式化验证。 不依赖 Agent 之间的自然语言沟通来保证接口一致性,而是用类似 Protocol Buffer 的形式化定义——修改接口时自动检查所有调用方是否兼容。OpenAPI Spec 已经走了一半路,但还需要和 Agent 的工作流深度集成。

Agent 级别的访问控制。 当前 Git 的权限控制是以人为单位的。多智能体场景需要以 Agent 为单位的细粒度权限——Agent A 只能修改 src/auth/,Agent B 只能修改 src/order/,任何越界操作自动拒绝。Claude Code 的 allowed_paths 配置已经开始做这件事了。

实战建议:怎么让多个 Agent 不打架

理论框架讲完了,给几条可以直接用的实战建议。

1. CLAUDE.md 是你的共识协议,花时间写好它

这不是建议,是必须。在多智能体场景下,CLAUDE.md 的作用等同于分布式系统的配置中心。它至少应该包含:

## 接口契约

- 所有 API 字段使用 camelCase

- 错误响应统一格式:{ code: number, message: string, data: null }

- 新增 API 必须先在 docs/api-contracts/ 下添加 OpenAPI 定义

## 代码规范

- 公共 DTO 定义在 shared/types/ 下,不允许各模块重复定义

- 配置文件修改必须追加,不允许覆盖已有配置项

- 日志格式:结构化 JSON,必须包含 traceId

## Agent 工作边界

- 用户服务 Agent 只能修改 src/user/ 和 src/shared/types/user\*

- 订单服务 Agent 只能修改 src/order/ 和 src/shared/types/order\*

- 修改 shared/ 下的公共文件需要在 PR 描述中说明理由

2. 用 worktree 隔离代替直接并发写入

如果你用 Claude Code,永远给并行 Agent 开启 worktree 隔离。在 Agent 配置或调用时指定 isolation: "worktree",让每个 Agent 在独立的 git 分支上工作。

这是成本最低的冲突预防手段。合并阶段的冲突处理远比运行时的随机覆盖容易定位和修复。

3. 把「验证」作为独立的 Agent 角色

不要让写代码的 Agent 自己验证自己的输出——这就像让被审计的人自己做审计一样。专门设一个 Verifier Agent,它只有读权限和运行测试的权限:

- 跑单元测试和集成测试

- 检查接口契约一致性(对比 OpenAPI Spec 和实际代码)

- 检查跨模块依赖是否一致

- 验证所有 Agent 的修改合并后是否能编译通过

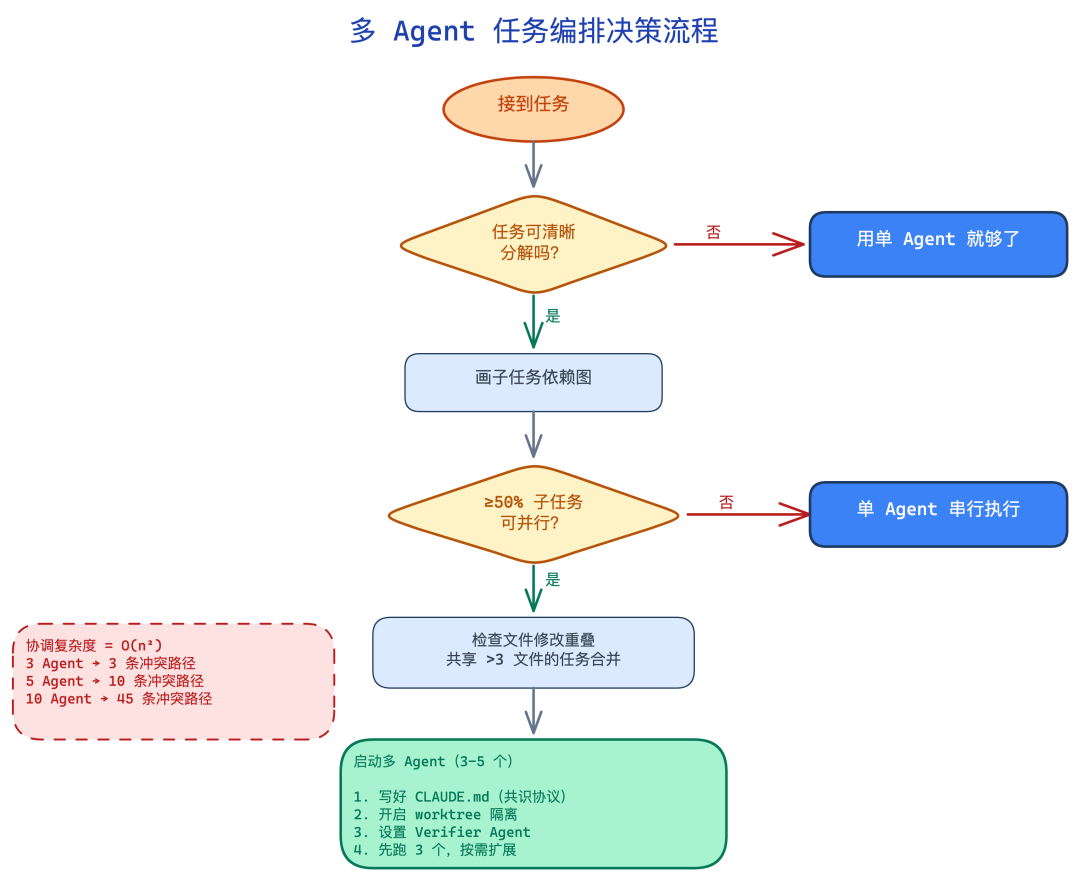

4. 控制 Agent 规模,3-5 个就够了

Anthropic 自己的建议是 3-5 个 Agent,每个 Agent 5-6 个任务。这个数字背后有一个朴素的道理:Agent 之间的协调复杂度是 O(n²) 的。

3 个 Agent 之间有 3 条潜在冲突路径,5 个 Agent 有 10 条,10 个 Agent 有 45 条。协调成本随 Agent 数量二次增长,而并行收益最多线性增长。超过 5 个 Agent,边际收益就开始为负了。

5. 先画依赖图,再决定并行度

拿到任务后,先画出子任务之间的依赖关系。只有真正独立的子任务才值得并行化。如果两个子任务共享超过 3 个文件的修改范围,把它们合并给同一个 Agent 做。

任务 A(用户模块)──→ 独立 Agent

任务 B(订单模块)──→ 独立 Agent

任务 C(支付模块,依赖 B 的接口)──→ 等 B 完成后再启动

任务 D(公共工具类)──→ 先于 A/B/C 完成,作为前置依赖

这种编排模式和微服务的部署依赖管理本质上是同一件事。

agent-orchestration-decision-flow

agent-orchestration-decision-flow

常见问题

Q:多智能体编程真的比单 Agent 效率高吗?

取决于任务结构。如果任务有清晰的并行分支,3 个 Agent 并行可以把 30 分钟的工作压缩到 12-15 分钟。但如果任务是线性依赖的,多 Agent 因为协调开销反而会更慢。我的经验法则:至少 50% 的子任务可以并行时,才值得上多 Agent。

Q:Git worktree 隔离能完全避免冲突吗?

不能完全避免,但能把「运行时随机覆盖」变成「合并时可控冲突」。运行时覆盖很难定位(你甚至不知道它发生了),合并冲突至少 git 会明确告诉你哪里有问题。两害相权取其轻。

Q:CLAUDE.md 写得再详细,Agent 也会违反规则吧?

会。这和分布式系统里的配置下发问题一样——配置到了不代表一定被执行。所以才需要独立的 Verifier Agent 做事后检查。CLAUDE.md 降低的是冲突概率,Verifier 兜住的是漏网之鱼。两层防线比一层强。

Q:CrewAI 这种角色分工模式是不是更适合企业场景?

如果你的团队有严格的流程要求(比如每次修改必须经过架构评审),CrewAI 的串行流水线模式确实更合适——它天然保证了流程顺序。但代价是速度。没有银弹,根据你对一致性和速度的优先级来选。

Q:这些问题未来会被解决吗?

部分会,但不会完全消失——因为它们是分布式系统的本质困难,不是工程优化能消除的。CAP 定理不会因为节点变成 AI 就失效。但工具层面的改善空间很大:语义级 merge、形式化接口验证、Agent 级权限控制,这些都是正在发展的方向。

我的判断

多智能体编程正在重演分布式系统的演化历史,只不过速度快了 10 倍。

2015 年左右,微服务从「酷炫新概念」变成了「分布式单体」的噩梦,大家才开始认真对待服务治理、链路追踪、配置中心这些「无聊」的基础设施。2026 年的多智能体编程正处于类似的阶段——大家还在兴奋于「5 个 Agent 并行跑」的速度感,还没被冲突、幻觉、一致性问题教训够。

未来 1-2 年会出现的东西:

- Agent 级别的可观测性——每个 Agent 做了什么修改、基于什么判断、和谁有冲突,像 Jaeger/Zipkin 追踪微服务调用链一样追踪 Agent 行为链

- 代码语义 merge 引擎——理解 AST 而不是文本行,让兼容的并发修改自动合并

- 形式化接口契约平台——Agent 修改接口时自动验证所有下游调用方,类似 Buf 对 Protobuf 做的事情

- Agent 编排 DSL——用声明式语言定义 Agent 之间的依赖关系和通信约束,像 Terraform 管理基础设施一样管理 Agent 拓扑

最让我感到既兴奋又谨慎的一点是:分布式系统理论 40 年积累的经验教训,几乎可以直接搬过来用。这意味着我们不需要从零摸索——但前提是你得先意识到,你面对的确实是一个分布式系统问题。

不要因为节点是 AI 就以为它们会自动协调。它们不会。Lamport 在 1978 年就告诉过我们了。

参考资料

- Claude Code 官方文档 - Sub-agents 与多实例协作

- Goose - 开源 AI Agent — 38.5k stars,基于 MCP 协议的多 Agent 架构

- CrewAI - 多智能体编排框架 — 角色化分工 + 消息传递模式

- Lobsters: Multi-agent software development discussion — 分布式系统视角的社区讨论

- Leslie Lamport, "Time, Clocks, and the Ordering of Events in a Distributed System" (1978) — 分布式系统的奠基论文

- Eric Brewer, "CAP Twelve Years Later" (2012) — CAP 定理的澄清与演化

- Anthropic Blog - Building effective agents

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-18,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录