云端赋能,本地智能:OpenClaw 集成 Gemma 模型实践

云端赋能,本地智能:OpenClaw 集成 Gemma 模型实践

云技术以及云存储

发布于 2026-04-21 10:52:27

发布于 2026-04-21 10:52:27

本文在服务器上搭建 OpenClaw 并使用本地 Gemma 模型,以及通过 SSH 链接远程 OpenClaw 的完整方案

1. 在服务器上搭建 OpenClaw 并配置本地 Gemma 模型

此步骤分为两部分:搭建 OpenClaw 网关服务,以及配置本地 Gemma 模型。

第一部分:安装并运行 OpenClaw 网关

这部分在服务器上执行。

安装 OpenClaw:

# 通过 npm 安装

npm install -g openclaw安装并启动网关服务:

# 将网关安装为 systemd 服务(推荐,以实现持久化运行)

sudo openclaw gateway install

# 启动服务

sudo systemctl start openclaw

# 设置开机自启

sudo systemctl enable openclaw注意:您也可以选择安装为用户服务(openclaw gateway install --user)。您可以根据实际需求和权限选择。

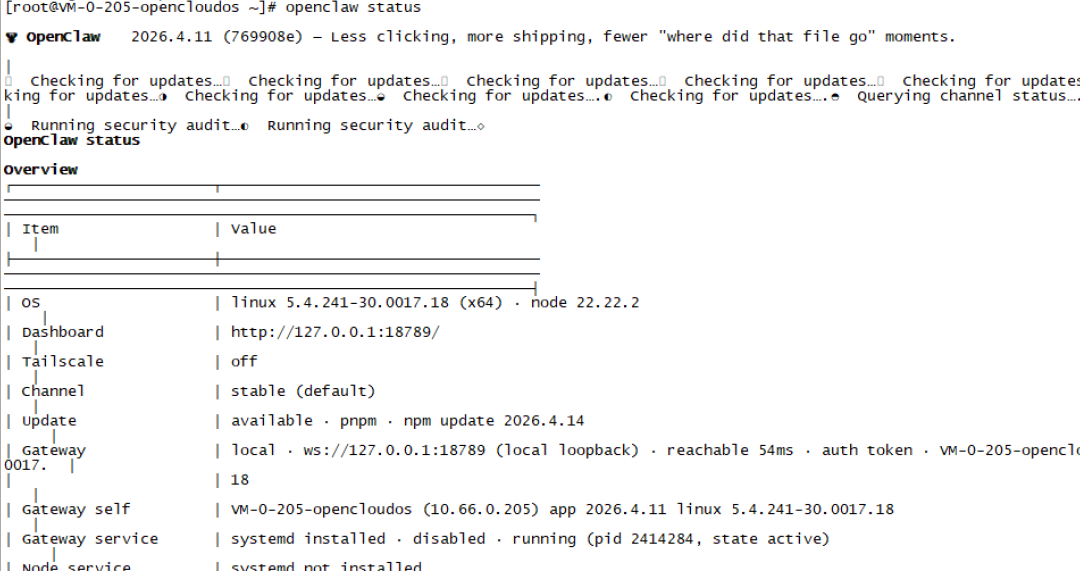

验证服务状态:

# 检查网关服务是否正在运行

sudo systemctl status openclaw

# 检查 OpenClaw 整体状态

openclaw status确保 Gateway状态显示为 reachable。

4.(可选但推荐)配置网关身份验证:

根据您文档中“安全审计”的警告,为网关设置认证令牌(token)是推荐的实践,尤其是在您计划通过 SSH 隧道公开访问时。

# 让工具自动生成令牌并配置

openclaw doctor --generate-gateway-token此命令会修改配置文件,并显示一个令牌。请妥善保存此令牌,远程连接时将需要它。

第二部分:在服务器上配置本地 Gemma 模型 (Ollama)

安装 Ollama:

curl -fsSL https://ollama.com/install.sh | sh拉取 Gemma 模型:

# 拉取您想要的 Gemma 版本,例如 4B

ollama pull gemma:4b配置 OpenClaw 以使用 Ollama 和 Gemma 模型:

- 方法A:通过

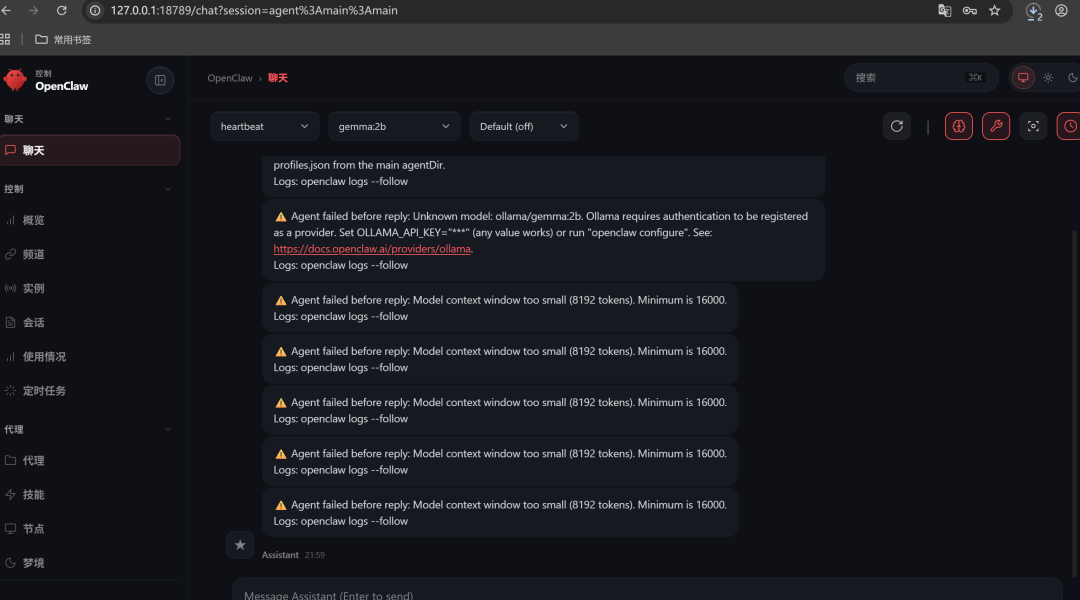

onboard向导(推荐):openclaw onboard在向导中选择“Ollama”作为模型提供商,然后选择您刚刚拉取的gemma:4b模型。向导会自动处理认证配置。 - 方法B:通过环境变量和 CLI 命令:

# 设置虚拟的 API Key 以“认证”Ollamaexport OLLAMA_API_KEY="ollama-local"# 将此变量持久化到您的 shell 配置文件echo'export OLLAMA_API_KEY="ollama-local"' >> ~/.bashrcsource ~/.bashrc# 重启 OpenClaw 网关以应用配置sudo systemctl restart openclaw之后,您可以手动设置模型:openclaw models set ollama/gemma:4b

验证模型配置:

openclaw models status

openclaw models list确认默认模型已被设置为 ollama/gemma:4b。

5. 本地通过 SSH 链接远端 OpenClaw

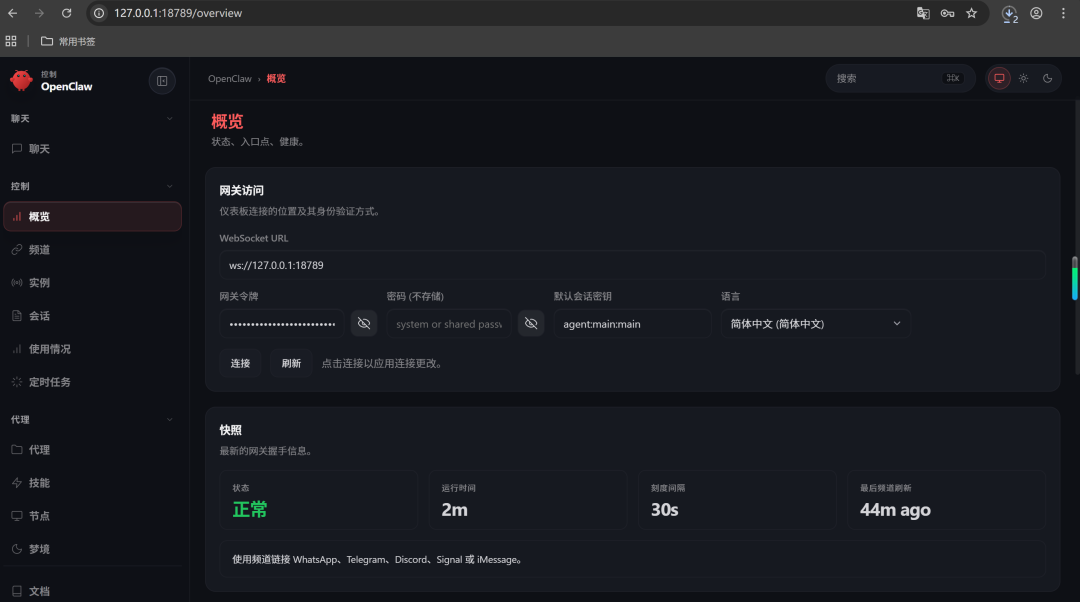

此步骤在您的本地电脑上执行,目的是建立一个加密通道,使您能像访问本地服务一样访问远程服务器上的 OpenClaw 控制面板。

5.1 建立 SSH 端口转发隧道:

在您的本地电脑终端中执行以下命令:

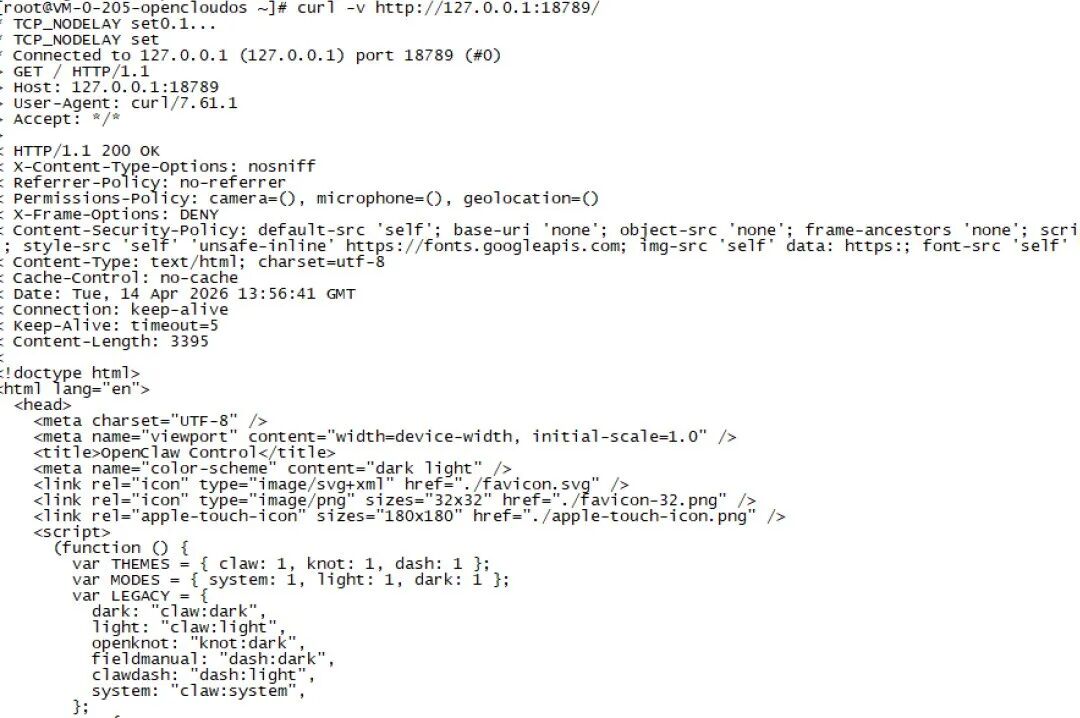

ssh -N -L 18789:127.0.0.1:18789 <用户名>@<服务器IP地址>5.2 访问控制面板:SSH 隧道建立成功后(命令会挂起,这是正常的):

- 在您的本地浏览器中访问:

http://127.0.0.1:18789 - 如果之前配置了网关令牌,您将被要求输入该令牌。

- 网关令牌获取命令

总结与验证流程

步骤 | 位置 | 操作 | 验证命令/预期结果 |

|---|---|---|---|

服务器端 | 服务器 | 1. 安装并运行 OpenClaw 网关 | sudo systemctl status openclaw(运行中) |

2. 安装 Ollama 并拉取模型 | ollama list(看到 gemma:4b) | ||

3. 配置 OpenClaw 使用 Gemma 模型 | openclaw models status(默认模型正确) | ||

4. 生成网关令牌(可选但推荐) | openclaw doctor --generate-gateway-token | ||

客户端 | 本地电脑 | 5. 建立 SSH 隧道 | ssh -N -L 18789:127.0.0.1:18789 user@server(挂起) |

6. 访问控制面板 | 浏览器访问 http://127.0.0.1:18789 |

注意:

1 此方案是文档中提到的“SSH 隧道”远程访问方法的具体实现。文档还提到,如果您希望 OpenClaw 网关能被多个客户端连接,或者希望客户端能作为远程计算节点被网关调用,您还需要在客户端上以“远程模式”配置 OpenClaw,并将其与网关配对。但针对您“本地通过 SSH 链接远端”的场景,上述方案(通过 SSH 隧道访问控制面板)是完全足够的。

2 如果使用默认模型是gemma:2b 上下文太小报错

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录