Gemma Gem:把大模型塞进浏览器之后,AI 的技术边界被重新划了一遍

Gemma Gem:把大模型塞进浏览器之后,AI 的技术边界被重新划了一遍

程序那些事儿

发布于 2026-04-17 16:38:02

发布于 2026-04-17 16:38:02

过去一年,大模型的技术叙事几乎被“更大、更强、更贵”占满。

但真正让我意识到“技术范式正在改变”的,是一个看似不起眼的项目:Gemma Gem。

它没有服务器,没有后端,没有 API Key。

它把一个完整的 Gemma 4 模型塞进浏览器,用 WebGPU 推理,用扩展权限操作网页,用本地算力跑 Agent Loop。

🚨 Tool of the Week: Google just dropped something BIG. Gemma 4 is here — and it might be the most exciting open-source AI release of 2026. A full thread on why

这不是“模型升级”,这是 运行时革命。

Gemma Gem 的意义不在于“能跑”,而在于它第一次让我们看到: AI 不必依赖云,它可以成为浏览器的一部分。

浏览器为什么能跑大模型?

要理解 Gemma Gem 的技术突破,必须先理解一个事实:

浏览器已经不是浏览器了,它是一个跨平台 GPU Runtime。

WebGPU 的出现,让浏览器第一次具备了“可控、可编程、可高性能”的 GPU 计算能力。

这意味着:

- 模型可以在浏览器里加载

- 权重可以在本地缓存

- 推理可以在 GPU 上执行

- 整个过程不需要网络

Gemma Gem 正是基于 WebGPU,把 Gemma 4 的 E2B / E4B 量化模型直接加载到浏览器内存中。

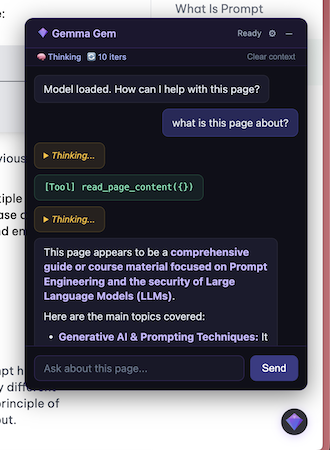

Gemma Gem in action

你可以把它理解为: 浏览器 = 轻量版 ONNX Runtime + 沙盒化的操作系统。

这也是为什么它能做到完全本地推理。

Gemma Gem 的三层架构:真正的技术亮点

Gemma Gem 的架构非常优雅,甚至可以说是“浏览器 Agent 的标准答案”。

第一层:Offscreen Document(模型运行层)

这是整个系统的“大脑”。 它负责:

- 加载模型

- 执行推理

- 维护 Agent Loop

- 调用工具(Tools)

它运行在一个不可见的文档环境中,避免阻塞 UI,同时保持独立的执行上下文。

第二层:Service Worker(中枢神经层)

它是整个系统的“消息路由器”,负责:

- 在扩展各部分之间传递消息

- 执行截图

- 执行 JS

- 管理工具调用

它让模型与网页之间的通信变得可控、可追踪、可扩展。

第三层:Content Script(网页操作层)

这是 Gemma Gem 的“手脚”。 它直接注入网页,负责:

- 读取 DOM

- 点击元素

- 输入文字

- 滚动页面

- 执行脚本

这让模型第一次拥有了“真实的网页操作能力”。

工具系统:让模型真正“能动手”

Gemma Gem 内置了一套完整的工具系统(全部本地执行),包括:

- read_page_content — 读取页面内容

- click_element — 点击元素

- type_text — 输入文字

- scroll_page — 滚动

- run_javascript — 执行 JS

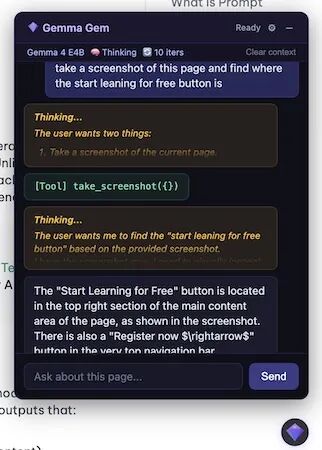

- take_screenshot — 截图

这套工具让模型具备了“浏览器自动化能力”,而不是只能“看不见网页地聊天”。

Gemma Gem in action

换句话说: Gemma Gem = 本地推理 + 浏览器自动化 + Agent Loop。

这是一个完整的“浏览器 AI Runtime”。

为什么它能做到完全本地?

核心原因有三个:

1. 模型足够小(E2B / E4B)

Gemma 4 的轻量模型:

- E2B:约 500MB

- E4B:约 1.5GB

首次加载后会缓存到浏览器,之后几乎秒开。

2. WebGPU 性能足够强

现代 GPU(包括集显)都能跑 4bit 量化模型。

3. 浏览器扩展权限足够强

Chrome 扩展可以:

- 注入脚本

- 操作 DOM

- 截图

- 执行 JS

- 读写本地缓存

这让浏览器第一次具备了“AI 运行环境”的全部条件。

为什么这是一个分水岭?

Gemma Gem 的出现,标志着一个关键趋势:

AI 正在从“云端时代”进入“本地时代”。

这意味着:

1. 隐私彻底改变

数据不再上传,所有推理都在本地完成。

2. 成本结构改变

不需要服务器,不需要 API Key,不需要付费。

3. 运行时改变

浏览器成为 AI Runtime,而不是网页渲染器。

4. Agent 能力改变

AI 不再是“语言模型”,而是“可操作网页的自动化系统”。

未来会发生什么?

Gemma Gem 只是开始,接下来你会看到:

- 更多模型进入浏览器

- 更多工具链本地化

- 更多自动化能力下沉到前端

- 浏览器成为 AI 的主战场

- 本地模型 + 浏览器 Agent 成为新范式

甚至可以预见: 未来的 AI 应用,不再需要服务器。 浏览器就是服务器。 用户就是算力。

结语

Gemma Gem 不是一个“好玩的项目”,它是一个“技术方向的信号”。

它告诉我们: AI 的未来,不一定在云端,也不一定在平台,而可能在每个人的浏览器里。

当模型足够小、推理足够快、浏览器足够强,

AI 的运行方式就会被彻底重写。

而 Gemma Gem,就是这场重写的开始。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录