母词驱动子词,在生成式方向的应用

母词驱动子词,在生成式方向的应用

JanYork_简昀

发布于 2026-04-17 14:45:51

发布于 2026-04-17 14:45:51

晚上好,

提示词这件事,可能比大多数人想象的要复杂得多。 通常人们会觉得,给一个 AI 模型写提示词,无非就是把需求说清楚。

但事实是,哪怕对于同一个需求,措辞稍微变一变,生成质量可能会天差地别。

模型对提示的微小改动往往极度敏感,语序或措辞的轻微调整就可能导致截然不同的结果,这也是为什么写出高质量的提示词需要相当程度的领域经验,并已经演变成一种专项技能。

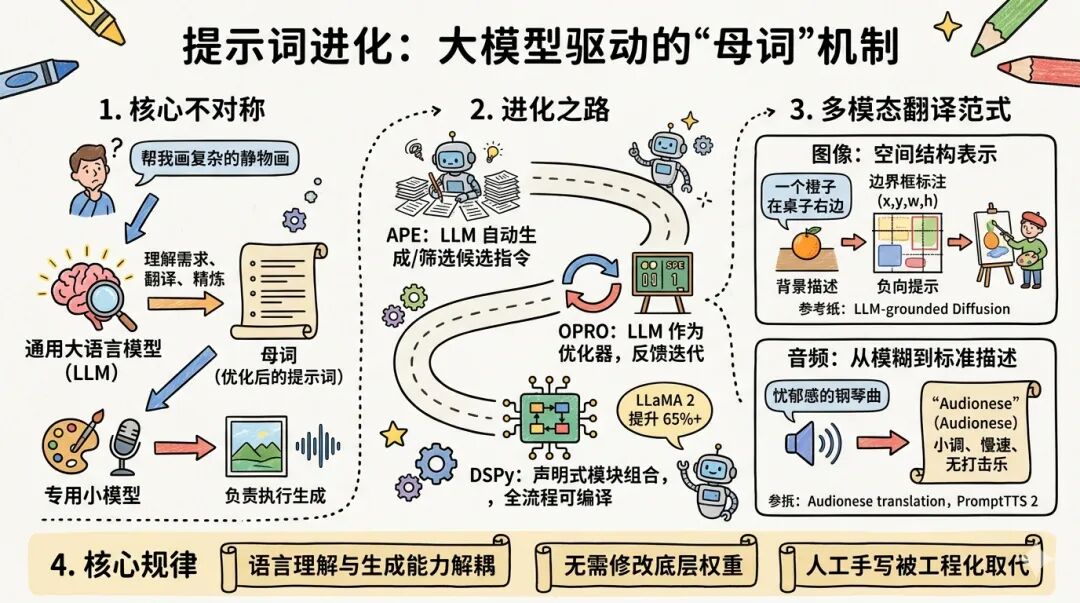

这个问题在文字生成类的通用大模型里就已经存在,到了 Stable Diffusion 这类生图模型、或者 TTS 语音合成模型身上,问题会更加尖锐——因为这些专用小模型的训练数据分布更窄,它们"读懂"提示词的能力远不如那些在海量文本上训练出来的大语言模型。 这里就有了一个天然的不对称性。

大语言模型拥有对自然语言极强的理解和改写能力,而专用小模型拥有某一领域的生成能力,但自身语言理解能力相对有限。

把这两者连接起来的中间件,就是我这里说的"母词"机制。

大语言模型不直接做生成,而是先理解人类的原始需求,再产出一套更符合下游专用模型"口味"的提示词,最后由小模型完成实际的生成任务。

这是一个分工明确的两阶段流程,大模型负责翻译和精炼,小模型负责执行。 这个思路并不只是一个工程上的土方法,背后已经有相当系统的学术研究在支撑。 最早把这件事做成系统研究的代表性工作是 APE,全称 Automatic Prompt Engineer。

它的思路是让大语言模型自动生成一批候选指令,再通过评估筛选出效果最好的那一条,从而替代人工反复试错的过程。

APE 之后,OPRO 走得更远,它直接把大语言模型当作优化器来使用,让模型在自然语言描述的性能反馈中迭代改进提示词,这种元优化方式在多种任务上超越了人工设计的提示词。

再往后是 Promptbreeder,它走的是进化算法的路线,把任务提示词和用于变异的提示词放在一起同步进化,让整个优化过程实现自举。 不过,OPRO 在较小规模的语言模型上效果有限,说明"母模型本身必须足够强"这个前提不能被忽视。

这一点非常关键,它意味着这套机制有一个门槛:你必须先有一个足够聪明的大模型,才能让它产出真正有价值的提示词。

这也从侧面解释了为什么这条技术路线是随着 GPT-4 这个级别的模型出现之后才开始大规模落地的。 微软在 2025 年推出了 PromptWizard,把这套优化逻辑推进了一步。

它引入了多智能体架构,让专门负责生成回应、负责评估、负责精炼提示词的不同角色协同工作,并融入专家知识和任务导向的意图作为先验。

同时维护提示词、反馈和评分的历史记录,这种结构化的优化方式在中小型语言模型上也展现出了显著的提升。 与此同时,斯坦福团队在 2023 年提出了 DSPy,它代表的是另一个角度的突破。

DSPy 把语言模型流水线抽象为文本变换计算图,通过声明式模块的组合来替代硬编码的提示模板。

它的编译器可以对任意 DSPy 流水线进行优化,实验结果显示,用少量代码描述的 DSPy 程序编译后,让 GPT-3.5 和 LLaMA 2 的性能相比标准 few-shot 提示分别提升了 25% 和 65% 以上。

DSPy 的意义不只是"更好地写提示词",而是把"如何让大模型为下游流水线产出最优指令"这件事变成了一个可以工程化、可以编译的系统问题。 上面这条线,主要是在纯语言任务的框架里展开的。但"母词"机制真正令人兴奋的场景,是在图像和音频这类多模态生成任务里。

在这里,问题的本质发生了一个重要的转变,从"如何优化提示词"变成了"如何把自然语言翻译成模型原生的表达语言"。 以文生图为例,Stable Diffusion 这类扩散模型的训练数据往往是带有非常具体描述标注的图像对,模型在推理时最擅长处理的是那种"标签化"的、充满视觉属性词汇的提示词,而不是人类日常说话时使用的那种自然语言。

当用户输入"帮我画一张三个苹果放在桌子左边、一个橙子放在右边的静物画",Stable Diffusion 往往会一塌糊涂,因为扩散模型在需要空间推理或常识性推理的场景下往往无法准确遵循提示词。 Berkeley 的研究团队在 2023 年提出了 LLM-grounded Diffusion,它的解法正是典型的两阶段母词架构。

第一阶段用一个冻结的大语言模型通过上下文学习充当文本驱动的布局生成器,当给定一个图像提示时,大语言模型输出场景布局,形式是带有描述的边界框;

第二阶段再用一个新颖的控制器引导扩散模型根据这个布局生成图像,两个阶段均使用冻结的预训练模型,无需任何参数优化。

这个流程的本质是让大模型充当一个语义解析器,把人类的自然语言意图编译成扩散模型真正能够执行的空间结构化表示。 进一步看,LMD 的布局表示由两部分构成:

一是对每个前景物体标注边界框,坐标用 x、y、宽度、高度的格式表示;

二是一段简洁描述图像背景的说明文字,以及可选的负向提示。

这看起来只是一个格式转换,但背后是大模型在做真正意义上的"理解与重写",而不是简单地把提示词润色一遍。 这个两阶段范式在 2024 年之后被广泛借鉴。

NeurIPS 2024 上发表了关于如何把解码器架构的大语言模型嵌入扩散模型的提示编码器的研究,研究发现直接把大语言模型用作提示编码器会显著降低图像生成时的提示遵循能力,根本原因是大语言模型的下一个 token 预测训练目标与扩散模型对判别性提示特征的需求之间存在根本性的不匹配。

这个发现很有价值——它说明母词机制中大模型的介入方式非常重要,直接替换不行,必须通过精心设计的中间接口。 同样的逻辑在音频方向上有几乎对称的演化路径,但细节上更有意思。

文生音频模型的训练数据通常是由专业人员精心撰写的描述性字幕,语言风格标准、规范。

而真实用户在使用时的提示词则往往欠规格化,说的是"来一段带点忧郁感的钢琴背景音乐",而不是"钢琴独奏,慢速,小调,低频共鸣,无打击乐"。

这类研究直接指出了音频生成中的提示欠规格化问题,提出用大语言模型把用户查询重写为更贴近训练分布的"audionese",以提升生成保真度和文本音频对齐质量。 ICLR 2024 上发表的 PromptTTS 2 则直接在 TTS 这个场景里验证了母词机制的可行性。

它设计了一个完全自动化的流水线,先用语音语言理解模型从已有语音中识别出声音属性(如性别、语速),再指导大语言模型基于这些属性撰写高质量的描述性文本提示,整个过程无需人工干预,从而为文本提示驱动的 TTS 系统构建了训练所需的数据。

这里的大语言模型不只是在生成提示词,它还在参与构建下游模型所需的训练数据集,两个角色叠加在一起。 从这些研究里可以抽出几条贯穿始终的结构性规律。 第一,专用模型的语言理解能力和生成能力是解耦的,前者通常远弱于后者。

这个不对称性是母词机制存在的根本原因,也是它能带来增益的来源。

专用模型不擅长处理模糊的、结构化程度低的自然语言输入,但在其擅长的生成任务上往往有远超通用大模型的专业能力。

母词的作用就是弥补这道鸿沟。 第二,提示优化可以在不修改底层模型权重的情况下显著提升模型性能,这使它成为一种灵活的替代知识蒸馏等需要改变模型架构方法的选择。

这对工程实践意义重大——使用母词机制,可以在不动模型参数的情况下让一个已经训练好的小模型发挥出更接近其上限的能力。 第三,研究界现在对这类系统已经有了清晰的两层划分:

一层是提示的生成与优化,本质是一个搜索或进化问题;

另一层是提示的理解与中间表示转换,本质更接近一个编译问题。

前者更像是在提示空间里做随机梯度下降,后者则更像是在为下游执行器构造一份语义更准确的"指令集"。

这两条路不是互斥的,在很多复杂的生成系统里,它们被串联在一起使用。 如果你正在考虑在自己的项目里引入类似机制,可以参考这几个坐标来定位自己的需求。

Automatic Prompt Engineer、OPRO、Promptbreeder 适合用来理解这条路线的理论来源和方法谱系;

DSPy 提供了目前最工程化的实现框架,适合直接上手;LLM-grounded Diffusion 的论文和代码是理解中间表示转换范式的最佳入门;

PromptTTS 2 以及关于音频"audionese"分布的相关工作,则是这套机制在音频方向最直接的参考文献。

整个领域的综述可以从 2024 年的 "A Systematic Survey of Prompt Engineering in Large Language Models" 和 2025 年的 "A Survey of Automatic Prompt Engineering: An Optimization Perspective" 两篇入手,前者建立框架,后者专注在优化视角。 这个领域目前还在快速演化中,但有一个判断应该已经相当稳固:人工手写提示词这件事,作为一个独立的劳动密集型工序,正在被系统性地工程化和自动化取代。

而驱动这个替代过程的核心引擎,正是更大、更聪明的语言模型本身。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读