揭秘 OpenClaw:3 个架构真相,决定你的 AI 能走多远

揭秘 OpenClaw:3 个架构真相,决定你的 AI 能走多远

智谷星瀚

发布于 2026-03-31 16:27:35

发布于 2026-03-31 16:27:35

当所有人都在卷“超级 App”时,OpenClaw 却反其道而行。接下来这 3 个底层逻辑,可能是 AI 应用落地的真正解法。

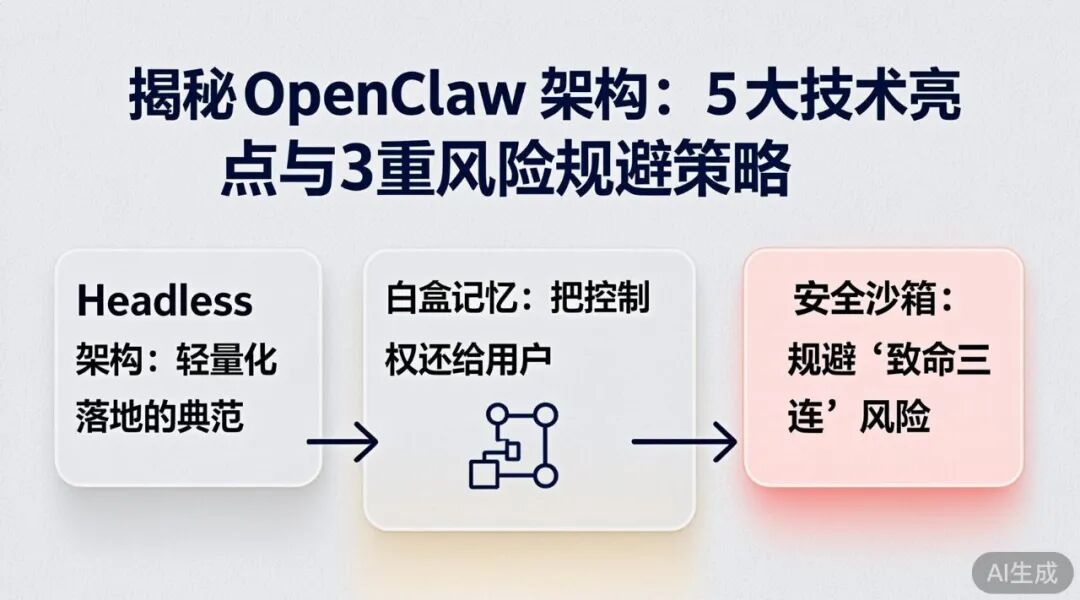

▼ 逻辑关系图

01Headless 架构:轻量化落地的典范

概况OpenClaw 摒弃传统“超级App”路线,采用 Headless 架构作为后台守护进程,通过 API 接入 WhatsApp 等现有平台,并在本地硬件托管控制面板,实现模型无关的编排。

点评这一设计实现了 I/O 层的解耦,避免了重复造轮子。其“本地优先”策略精准击中隐私痛点,极大降低了用户迁移成本,是个人 AI 助手轻量化落地的标杆。

应用开发者应聚焦核心逻辑编排,利用成熟协议实现跨平台接入;企业部署时采用本地化控制平面,确保敏感数据不出域,满足合规要求。

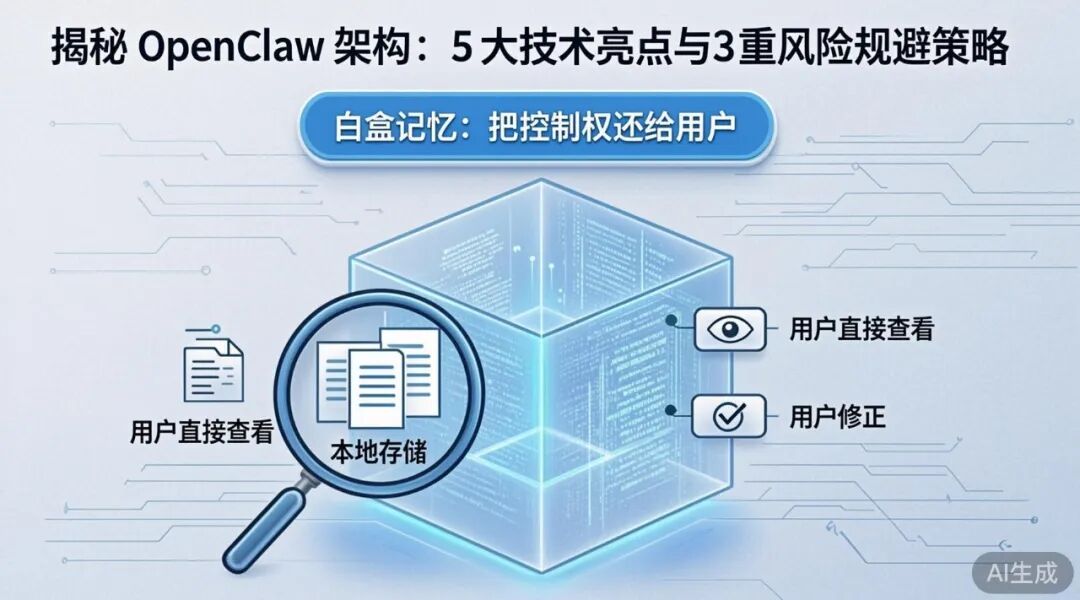

02白盒记忆:把控制权还给用户

概况OpenClaw 采用“反 RAG”策略,将长期记忆以 Markdown 文件形式存储于本地,用户可直接查看、修正这些记忆文件,实现记忆的白盒化管理。

点评这种设计解决了 RAG 技术黑盒检索不可解释的痛点,赋予了用户对 AI 认知的最终控制权,为人机协作提供了关键的信任基础,支持高效的自我演化。

应用构建个人知识库时,优先采用结构化文本存储记忆,并提供用户可编辑接口;避免过度依赖复杂的向量检索,通过透明度提升用户信任。

03安全沙箱:规避“致命三连”风险

概况OpenClaw 暴露了接触不可信输入、访问私有数据、具备对外副作用的“致命三连”风险,揭示了提示词注入和零认证漏洞的威胁。

点评本地 Agent 权限过大是双刃剑,单纯依赖模型自律极其危险。必须将安全判断从模型内部移交给确定性的系统层,构建不可绕过的物理隔离边界。

应用实施严格的沙箱隔离机制(如 VM 或 WASM)运行工具;建立统一 Gateway 管理工具生命周期,对敏感操作引入人工确认机制,杜绝安全后门。

✦ ✦ ✦

AI 的未来不在于模型有多强,而在于架构有多稳。转发这篇文章,让更多人看到 AI 落地的“安全底线”。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读