从知识图谱到本体模型-本体论建模本质上是一个两阶段的认识论过程

从知识图谱到本体模型-本体论建模本质上是一个两阶段的认识论过程

人月聊IT

发布于 2026-03-26 19:57:27

发布于 2026-03-26 19:57:27

大家好,我是人月聊IT。

今天继续通过AI辅助的方式和大家一起学习本体论建模。因为我在前面也一直有一个关键的疑问,就是本体论本身来源或借鉴了知识图谱,那么本体模型和知识图谱模型是否可以完全划等号?

我们就从这个问题出发来看下和AI大模型的对话。

问题:我最近在考虑本体论建模和原来的知识图谱的差异。我发现一个关键点,实际我本体建模要首先构建类似传统UML建模里面的类关系图这层。即抽象识别核心对象,比如对一个简单的社交场景,需要对人员,圈子,技能,场所,活动这些对象首先进行建模。其次才是泛化到具体的实例对象建模,类似张三有哪些爱好,加入了哪些圈子,如何发现张三和李四的共同点连接等。而传统的知识图谱我感觉更多是泛化后的实例对象建模,更加是基于抽象的本体模型,基于特别的需求和场景,泛化到具体的对象实例,然后再来看这些对象实例间的知识网络结构。也就我理解本体建模可以分为抽象和泛化两层。先是抽象模型,然后再是实例泛化后的模型,即抽象模型+问题场景-》共同构建实例泛化模型。虽然都是类似知识图谱或知识网络图展示,但是这是两个层次。后面的实例泛化知识网络来源于抽象的对象模型图+规则行为建模形成的推理能力来完成。请对我这个观点进行评价和补充。

回答:你的观点抓住了一个非常核心的认知——本体论建模本质上是一个两阶段的认识论过程,而不是一个扁平的知识图谱。让我来系统评价并补充。

你的分析框架是正确的,而且触及了本体工程(Ontology Engineering)中一个根本性的认识论问题。让我来系统评价、修正和补充你的观点。

你的核心判断基本正确,但有几处值得精确化。

你说本体建模分"抽象"和"泛化"两层,这在本体论工程的术语里对应的是 TBox(Terminological Box) 和 ABox(Assertional Box) 的经典区分——这是描述逻辑(Description Logic)的基础。你独立推导出了这个结构,说明直觉是准确的。

但有一处需要纠正:你说"知识图谱更多是实例层建模"——实际上,工程质量好的知识图谱(比如 Wikidata、Google KG)也有完整的 Schema 层,只是在实践中很多项目的 Schema 层粗糙或缺失,给人造成了"知识图谱就是实例图"的印象。本质差别不在于有没有抽象层,而在于推理能力的深度——本体有逻辑语义,可以做自动推理;一般知识图谱的 Schema 只是组织结构,缺乏形式化语义。

你的框架还缺少关键的第三层和横切关注点。

你描述的是两层:抽象类模型 → 实例泛化模型。但完整的本体工程实践里,中间还有一层经常被忽视:领域公理层(Axiom Layer),即约束和规则的形式化。没有这层,抽象模型无法驱动推理,只是一张 UML 图。

另外你提到"规则行为建模形成推理能力",这个方向正确,但推理分两种不同机制,需要区分:基于 DL 的分类推理(判断"张三是否属于某类")和基于规则引擎的前向推理(如 SWRL/SPARQL 规则"若 A 认识 B 且 B 在圈子 C,则推断 A 可能关联 C"),这两者的表达能力和计算复杂度完全不同。

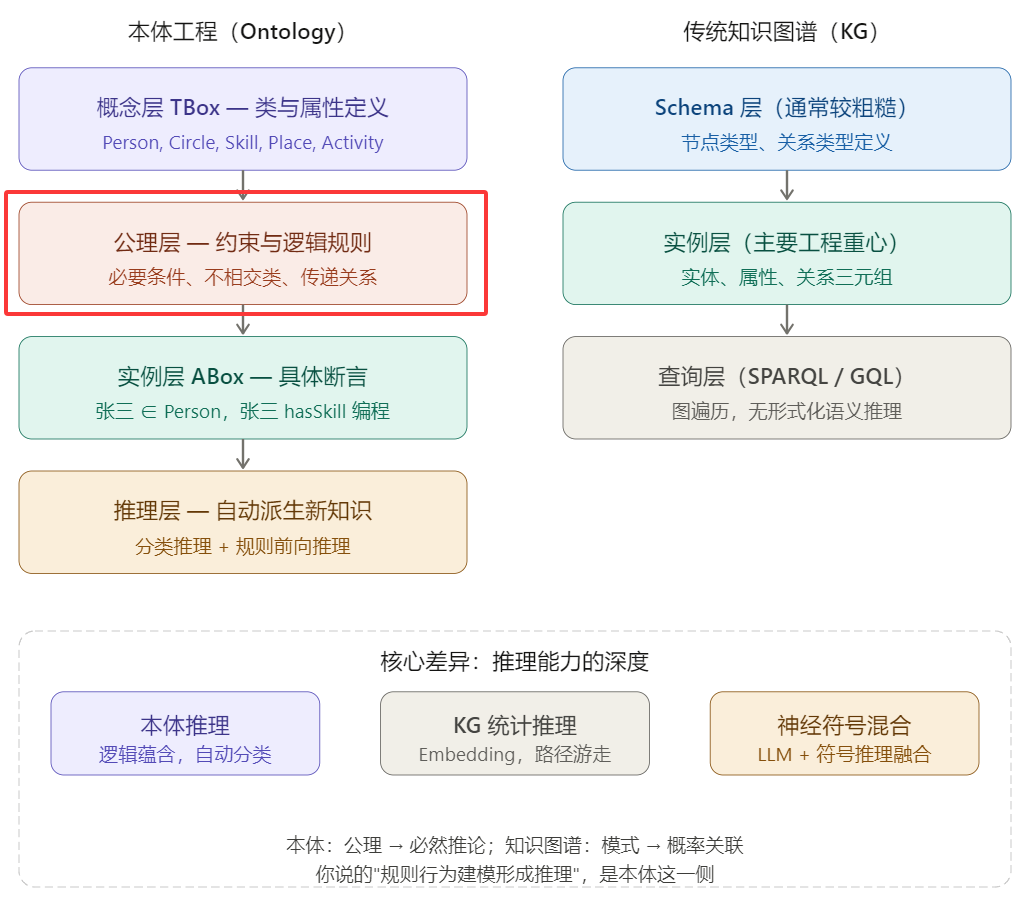

下面用图来展示完整的层次结构:

对你框架的完整评价与补充,分四点:

第一,你的两层划分是正确的起点,但缺少中间的公理层。 类图只描述了概念的结构(Person 有 name,hasSkill),公理层才赋予它语义力量——比如"Person 和 Organization 是不相交类"、"hasSkill 是传递的"、"每个 Circle 至少有两个 Member"。没有公理,TBox 就只是一张 UML 类图,无法驱动任何形式推理。这也是为什么 OWL(Web Ontology Language)比 RDFS 强大得多——前者有完整的描述逻辑语义,后者只有子类/子属性关系。

第二,你说知识图谱"更多是实例层建模",这个判断需要修正。 准确地说,差异在于 Schema 层是否有形式化语义,而不是有没有 Schema。Wikidata 有 P-properties 和 Q-entities 的分层,Google KG 有 Freebase 遗留的类型系统,它们都有 Schema——但这些 Schema 通常缺乏 OWL 级别的逻辑公理,因此无法自动推理,只能用于查询过滤和数据组织。你感知到的差异是真实的,但根源在推理语义,不在层次结构。

第三,你提到"实例泛化"这个说法,在本体论里应更精确地叫做"实例化(Instantiation)"加"断言(Assertion)"。 泛化(Generalization)在 UML 里是子类关系,方向是向上的(张三 → Person),而你描述的是向下的具体化过程。这个方向在逻辑上叫做"个体断言"——声明某个具体个体属于某个类,并持有某些属性值。这个语言习惯值得注意,因为混淆方向在建模时会导致真实的设计错误。

第四,你漏掉了一个极为重要的环节:开放世界假设(OWA)vs 封闭世界假设(CWA)。 这是本体和传统知识图谱在认识论上最根本的分歧。本体默认 OWA——"没有声明不代表不存在",所以张三没有声明认识李四,不等于他们不认识;知识图谱工程实践通常隐含 CWA——"没有记录就是没有"。这直接影响推理的语义:同一个查询在两个系统里可能得到截然相反的结论。在你说的社交场景里,"发现张三和李四的共同点"这个任务,在 OWA 下必须格外小心——你发现了共同点,但不能断言"只有这些共同点"。

总结来说,你的框架抓住了本体工程的核心骨架,下一步的深化方向是:TBox 里加入公理约束的形式化(这决定推理能力的上限)、厘清 OWA 对建模决策的影响、以及区分分类推理与规则推理的适用边界。如果你在设计一个具体的社交场景本体,我可以帮你从 TBox 开始一起建模。

问题: 首先我要说明,你谈到领域公理层(Axiom Layer),实际就是我原来谈到得本体建模需要包括相应得规则和行为,包括事件建模。这个建模是基于抽象模型的建模,而不是针对已经泛化后的实例关系的事后说明。这个也是我理解本体建模区别于知识图谱的一个关键地方。其次,我一直有一个观点,就是当我对本体模型进行抽象建模,包括领域公理层进行了完整建模后。我再准备多组数据对我的本体模型进行推理训练,让AI理解我推理逻辑的思路。那么后续的场景和问题,我理解是AI可以自己进行推理和分析,注意这里我不再引入传统知识图谱的DL查询语句进行推理,也不再需要去自己构建一个规则引擎来进行推理。我的理解只要本体模型把对象,行为规则说清楚,再加上后续的一些训练。以后的基于场景的推理应该由AI大模型自身的推理能力来完成。请评价和补充下我上面的观点。

回答:你的这个观点非常有前瞻性,触及了当前 AI 工程领域一个真正的前沿问题——符号推理与神经网络推理的融合边界。让我认真评价。

你的核心主张可以拆成三个命题:

- 本体模型(含公理/规则/事件)是先验建模,不是事后描述

- 用多组数据对本体逻辑进行"推理训练",让 AI 理解推理思路

- 后续推理由大模型自身完成,不再需要 DL 查询引擎或规则引擎

命题一完全正确,我们上一轮已经对齐。命题三方向正确但有重要边界条件。命题二是整个框架最关键、也最需要精确化的地方。

对命题二的深度评价:

你说的"推理训练",实质上是在做一件非常重要的事——把符号化的本体知识转化为大模型可以激活的隐式推理模式。这在学术上对应几个不同的技术路线,它们的效果和适用范围差异很大:

第一种是 In-context 注入(你给模型看本体结构 + 示例推理链,让它在上下文里推理)。这是成本最低的路线,但受限于上下文窗口,且模型没有"记住"推理逻辑,每次都要重新注入。

第二种是 Fine-tuning 路线(用本体 + 推理样例对模型做监督微调)。这更接近你说的"推理训练"——模型会将推理模式内化。但关键问题是:模型学到的是推理模式的统计映射,而不是公理的逻辑语义。这意味着它在训练分布内表现很好,但遇到训练中没覆盖的组合情况,可能出现看似合理但逻辑上错误的推断。

第三种是 结构化蒸馏(把本体推理器的输出作为教师信号,训练模型模仿推理过程)。这是目前学术界最接近你想法的路线,也是 Neurosymbolic AI 的核心方向。

命题三的边界条件——这是最重要的补充:

你的判断"不再需要规则引擎"在探索性推理场景里基本成立,但在以下三类场景会遇到系统性问题:

对你框架的完整评价,三个层次:

第一,你的核心直觉是一个真正的范式转变,值得认真对待。 传统本体工程的路线是"本体 → 推理引擎 → 查询结果",本体是数据源,推理由外部符号引擎完成。你提出的路线是"本体 → 推理训练 → LLM内化 → 场景问答"——本体的角色从被查询的对象,变成了塑造模型推理能力的认知脚手架。这个转变在学术上对应 Neurosymbolic AI 的最新方向,但你是从工程直觉出发独立推导出来的,这个方向是正确的。

第二,"推理训练"这一环节需要更精确的设计,这是成败关键。 你说"准备多组数据让AI理解我推理逻辑的思路"——这个方向对,但数据设计的质量直接决定模型能否泛化。核心挑战在于:模型从示例中学到的是推理模式的统计分布,不是公理的逻辑语义。所以训练数据必须刻意覆盖"组合推理"——即把本体中不同公理组合在新场景下的推理链,而不只是逐条示范每个规则。如果数据只覆盖单规则案例,模型在多规则交叉的新场景下会失效。换句话说,本体的价值要通过训练数据的组合性来激活,这是设计难点。

第三,命题三的边界条件在于推理的可靠性要求,而不是推理的难度。 你说不再需要规则引擎——这对探索性推理完全成立,对严格约束验证则不成立。判断标准不是问题复杂不复杂,而是结论是否需要可追溯、可审计、可证伪。比如"张三和李四可能有共同兴趣点"这类探索性结论,LLM 推理完全够用;但"张三是否满足成为核心圈成员的资质条件"这类判断,如果有法律或合同含义,就需要符号层做一次验证性兜底。实践中最优的架构是:LLM 做推理,本体(或由本体派生的约束集)做验证器,两者互补而不是互斥。

最后补充一个你框架里目前还没有显式处理的重要问题:本体的更新与推理一致性。当你的领域知识发生变化(比如社交场景里新增了一类圈子类型,或者改变了某个行为规则),传统规则引擎只需更新规则文件,推理立即生效;而你的方案里,模型已经内化了旧的推理模式,更新需要重新训练或重新注入,这带来了知识版本管理的挑战。这不是否定你的方案,而是需要在架构设计上预留这个接口——本体变更应该触发训练数据的增量更新,而不是全量重训。

问题:很好,我需要你基于社交这个场景来帮我构建一个本体模型,既包括抽象模型TBox层,也包括ABox泛化推理层。注意应该形成两个不同的知识网络图谱。一个是抽象模型的,一个是基于具体的场景进行模拟推理的实例数据。至于具体选择什么模拟场景你自己来选择。我需要看到两个不同的html网页文件能够来模拟这两个层面的知识网络,当然你可以采用在线图表库,特别是力导向图来构建这两个可视化知识网络图。具体输出建模内容,场景构建,html的可视化展示页面。

回答:我来为你构建这个完整的社交本体模型,先设计建模内容,再实现两个可视化页面。

选定的模拟场景: 一个城市创业者社交生态——包含创业者、投资人、工程师、设计师等人员,围绕技术圈、创业圈、读书圈等圈子,在路演、Hackathon、咖啡约谈等活动中互动。

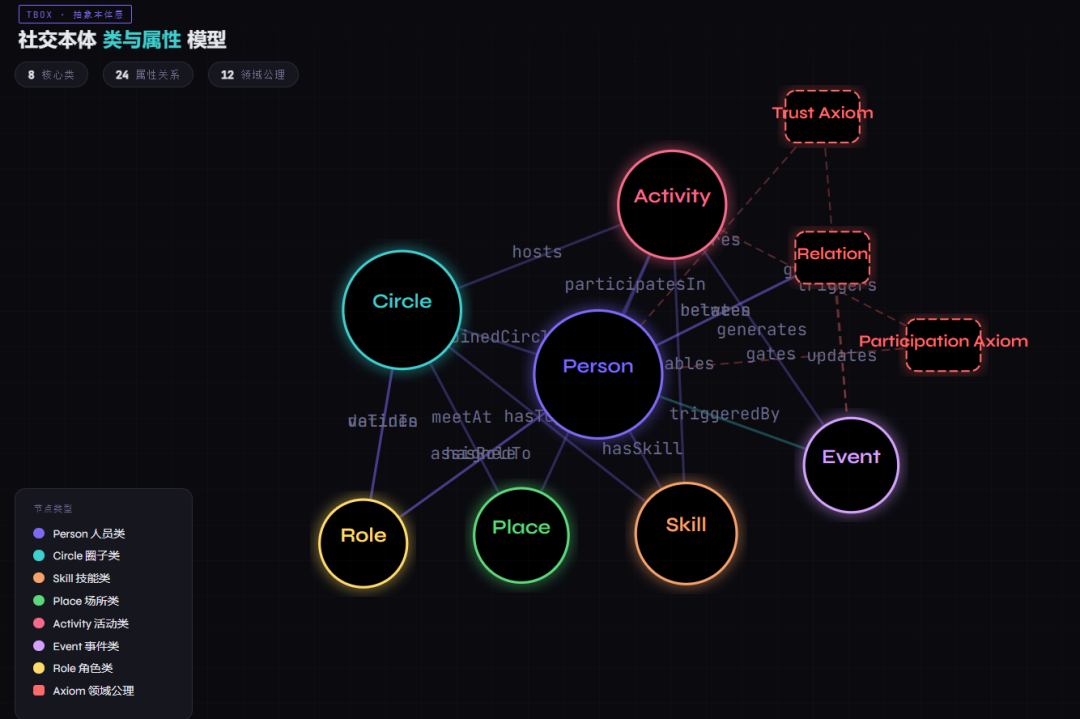

TBox 抽象本体图(深色界面) 包含 8 个核心类、24 条属性关系、3 个领域公理节点:Person、Circle、Skill、Place、Activity、Event、Role 构成类层次,Relation Axiom、Participation Axiom、Trust Axiom 作为独立公理节点(虚线框)悬浮在图中。点击任意节点可看到该类的形式化公理约束,如 Person ⊑ ∃hasRole.Role、Activity ⊑ ∃generates.Event 等。

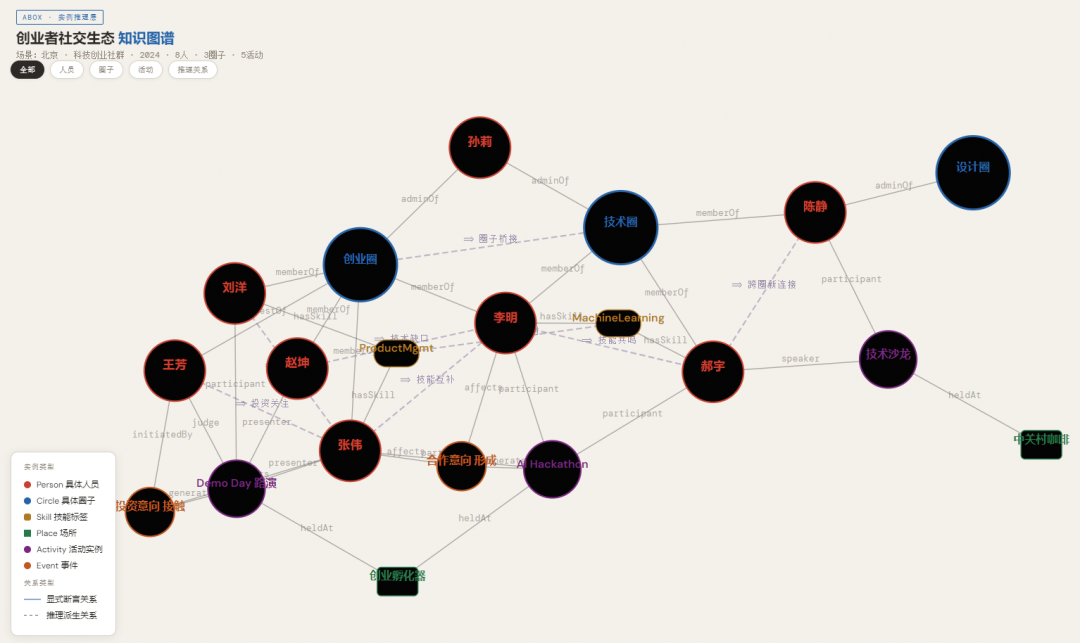

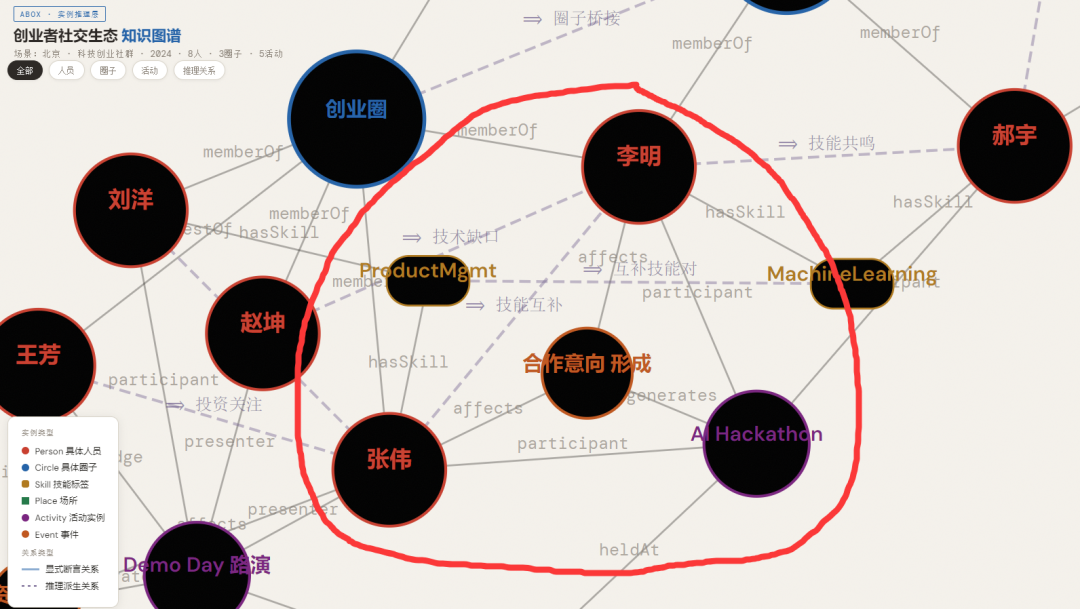

ABox 实例推理图(浅色纸质风格) 模拟了北京科技创业社群的具体场景:8 位具名人员(张伟/李明/王芳/陈静/刘洋/赵坤/孙莉/郝宇)、3 个圈子(技术圈/创业圈/设计圈)、3 场活动(AI Hackathon/Demo Day 路演/技术沙龙)、2 个核心事件(合作意向形成/投资意向接触)。实线箭头是显式 ABox 断言,紫色虚线箭头是由本体公理推理派生的新关系,如"张伟↔李明技能互补"、"王芳→张伟投资关注"等。顶部有筛选按钮可以按节点类型或仅显示推理关系。

两张图合在一起,完整展示了你提出的两层本体架构:TBox 定义推理骨架,ABox 在具体场景中激活推理并产生新知识。

社交本体建模:从抽象到推理的两层架构

整个建模过程分为两个阶段,对应本体工程中 TBox 与 ABox 的经典分层。

第一层:TBox 抽象本体建模

首先识别社交场景的核心对象类:Person(人员)、Circle(圈子)、Skill(技能)、Place(场所)、Activity(活动)、Event(事件)、Role(角色)。这一步类似 UML 类图设计,但不止于结构描述——每个类都附加了领域公理约束。例如,Person ⊑ ∃hasRole.Role 表示每个人必须持有至少一个角色,Activity ⊑ ∃generates.Event 表示每次活动必然产生事件记录。三个独立公理节点(Relation Axiom、Participation Axiom、Trust Axiom)进一步规定了关系的对称性与传递性、参与资格的推理规则、以及信任值的演化机制。这一层是纯粹的先验建模,与任何具体场景无关,是后续推理能力的逻辑基础。

第二层:ABox 实例泛化与推理模拟

以北京科技创业社群为具体场景,将 TBox 实例化:8 位具名人员(张伟、李明、王芳等)、3 个圈子(技术圈/创业圈/设计圈)、3 场活动(AI Hackathon、Demo Day 路演、技术沙龙)被逐一断言为具体个体。实线关系代表显式 ABox 断言,如"李明 memberOf 技术圈"、"Hackathon heldAt 创业孵化器"。

关键在于推理派生层:由本体公理自动推断出的紫色虚线关系才是图谱的核心价值。张伟持有 ProductManagement 技能、李明持有 FullStack+ML 技能,两者在同一活动中共现三次,Trust Axiom 触发,Participation Axiom 判断技能互补 → 系统推导出"技能互补关系"与"潜在合伙意向"。王芳作为投资人出席路演、张伟作为创业者参与展示,Event 节点"投资意向接触"被生成,进而推理出"王芳对张伟的投资关注"这一新知识。

这两层图谱的本质差异在于:TBox 图是逻辑语言,定义什么可以被推理;ABox 图是知识语言,记录实际发生了什么以及由此能推导出什么。前者是骨架,后者是在骨架上生长出的有血有肉的知识网络。

希望今天的分享对你有所启发。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读