系统解读:AI Agents 时代的 Memory 技术

系统解读:AI Agents 时代的 Memory 技术

架构精进之路

发布于 2026-03-25 14:20:48

发布于 2026-03-25 14:20:48

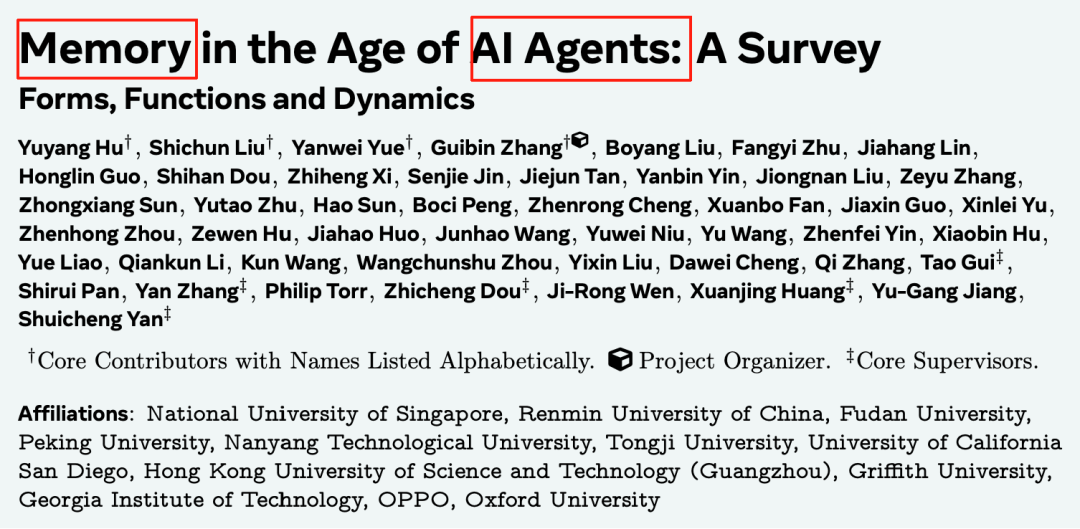

分享今年看到最系统&最新的 Agents Memory 综述,NUS&人大&复旦&北大&同济等联合出品:《Memory in the Age of AI Agents: A Survey》

- 用 “形态-功能-动力学”三维框架把 200+ 篇最新论文一次讲透。

- 提出 新三大记忆形态:Token-level / Parametric / Latent,取代传统“长-短期记忆”二分法。

- 展望 7 大前沿:生成式记忆、自动记忆管理、RL 驱动、多模态、多 Agent 共享、世界模型、可信记忆。

开源地址:https://github.com/Shichun-Liu/Agent-Memory-Paper-List

论文地址:https://arxiv.org/pdf/2512.13564

一、为什么需要“Agent 记忆”?

图 1 给出一张“地图”,把 200+ 方法按形态 & 功能 & 动态一次定位:

LLM 再强,也怕“金鱼脑”——上下文一断就失忆。

把 LLM 包装成能持续交互、自我进化的 Agent,必须外挂一块可读写、可增长、可遗忘的记忆体。

二、预备知识:Agent 与记忆的形式化

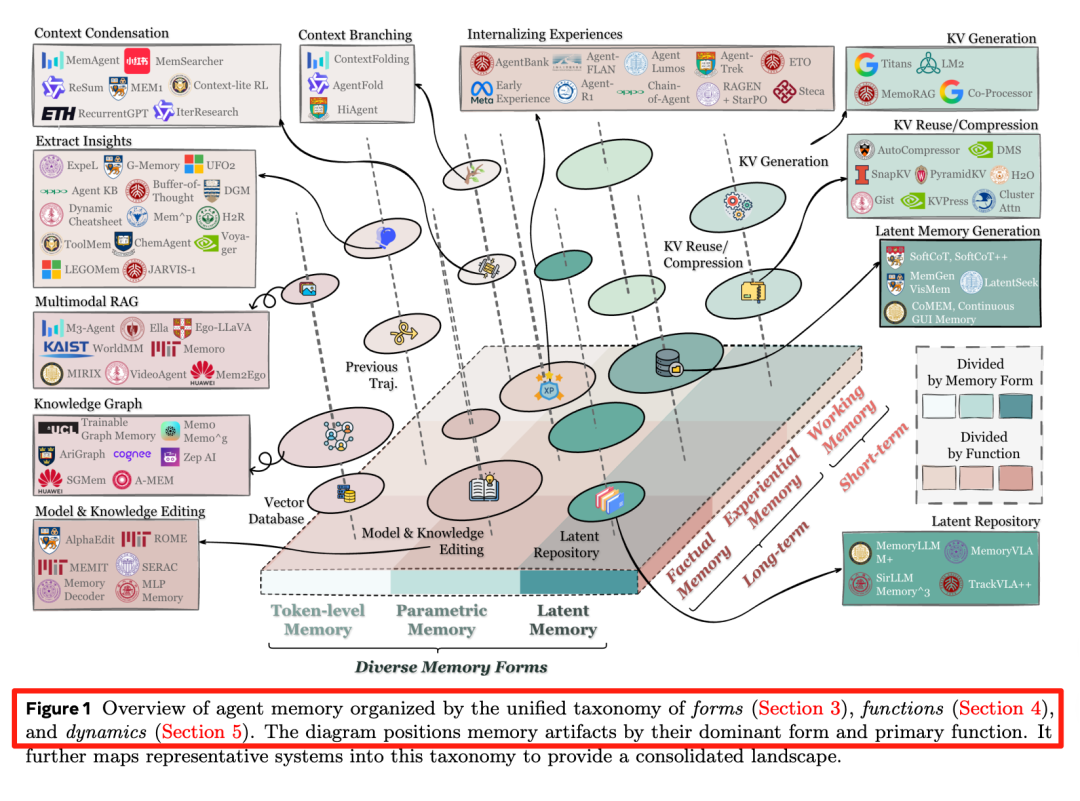

图 2 用韦恩图理清 Agent Memory vs LLM Memory vs RAG vs Context Engineering:

作者先把 Agent 抽象成部分可观测马尔可夫博弈,再把记忆定义为三元组运算符:

- Formation F:把原始交互 φ_t 提炼成记忆单元

- Evolution E:合并、去重、纠错、遗忘

- Retrieval R:按需查询

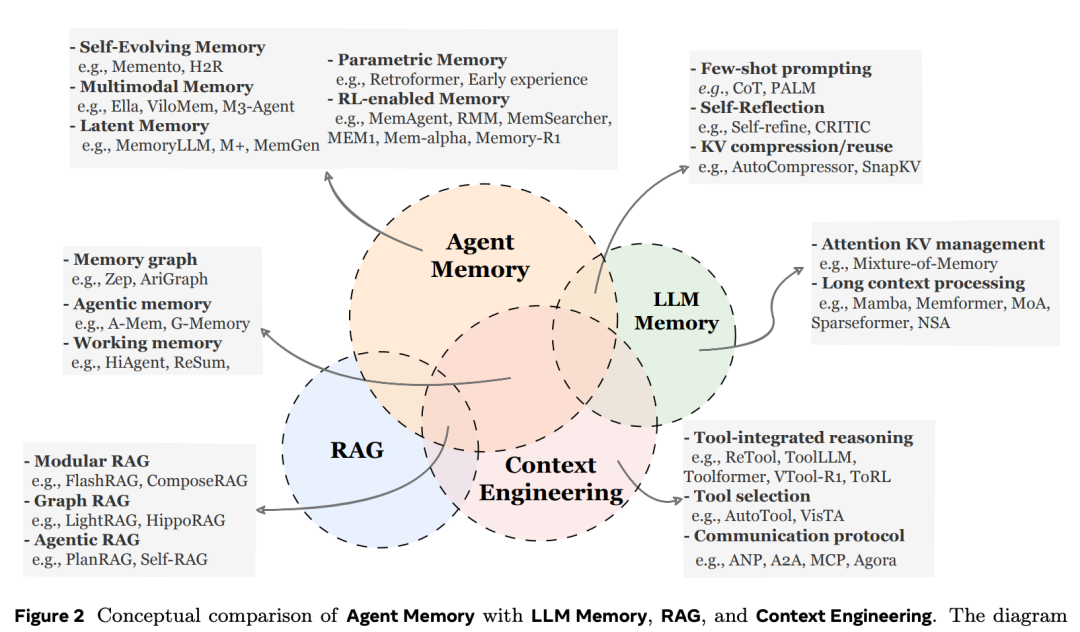

三、形态篇:记忆到底“长”什么样?

图 3 把 Token-level 再细拆成 1D-Flat / 2D-Planar / 3D-Hierarchical:

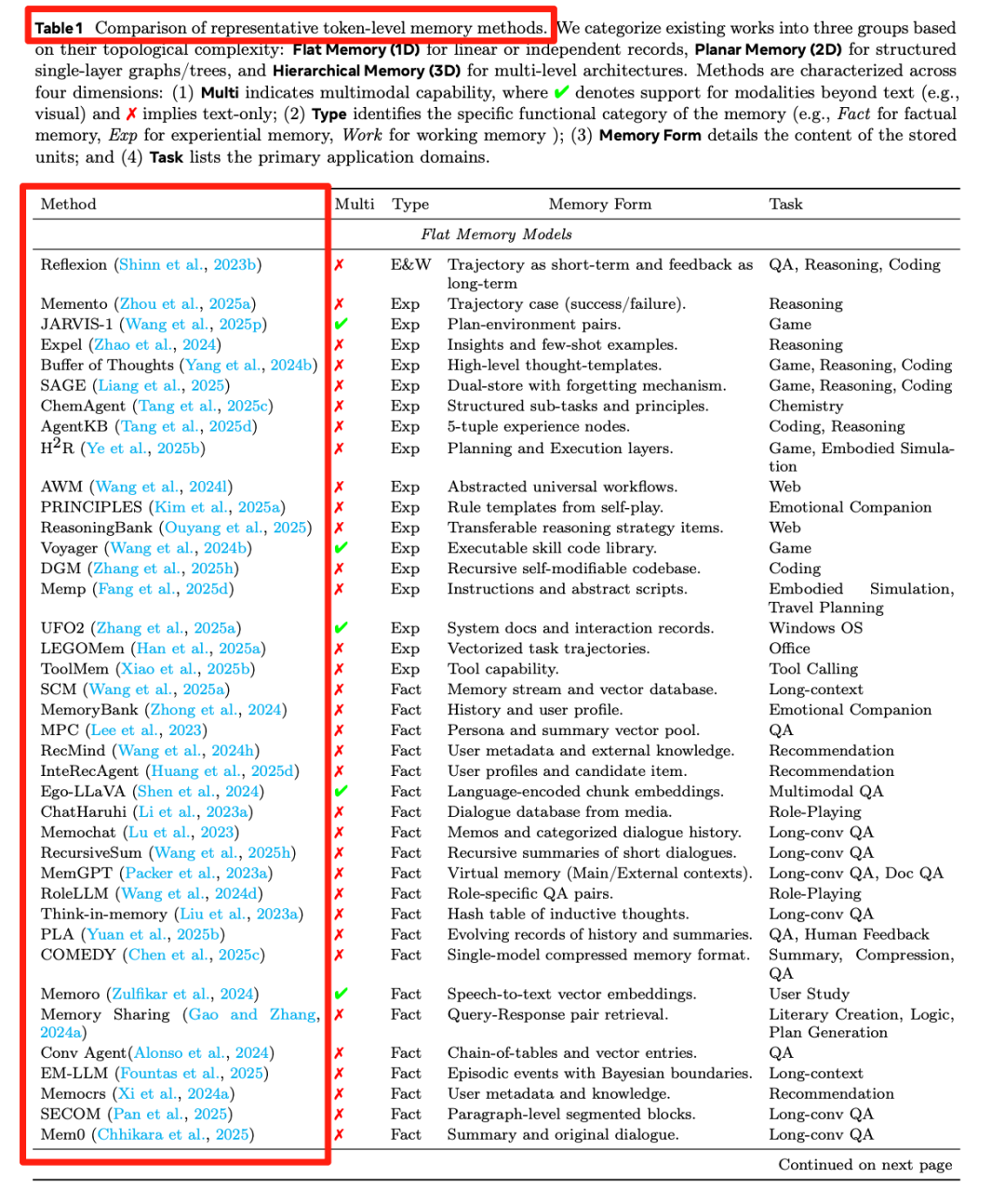

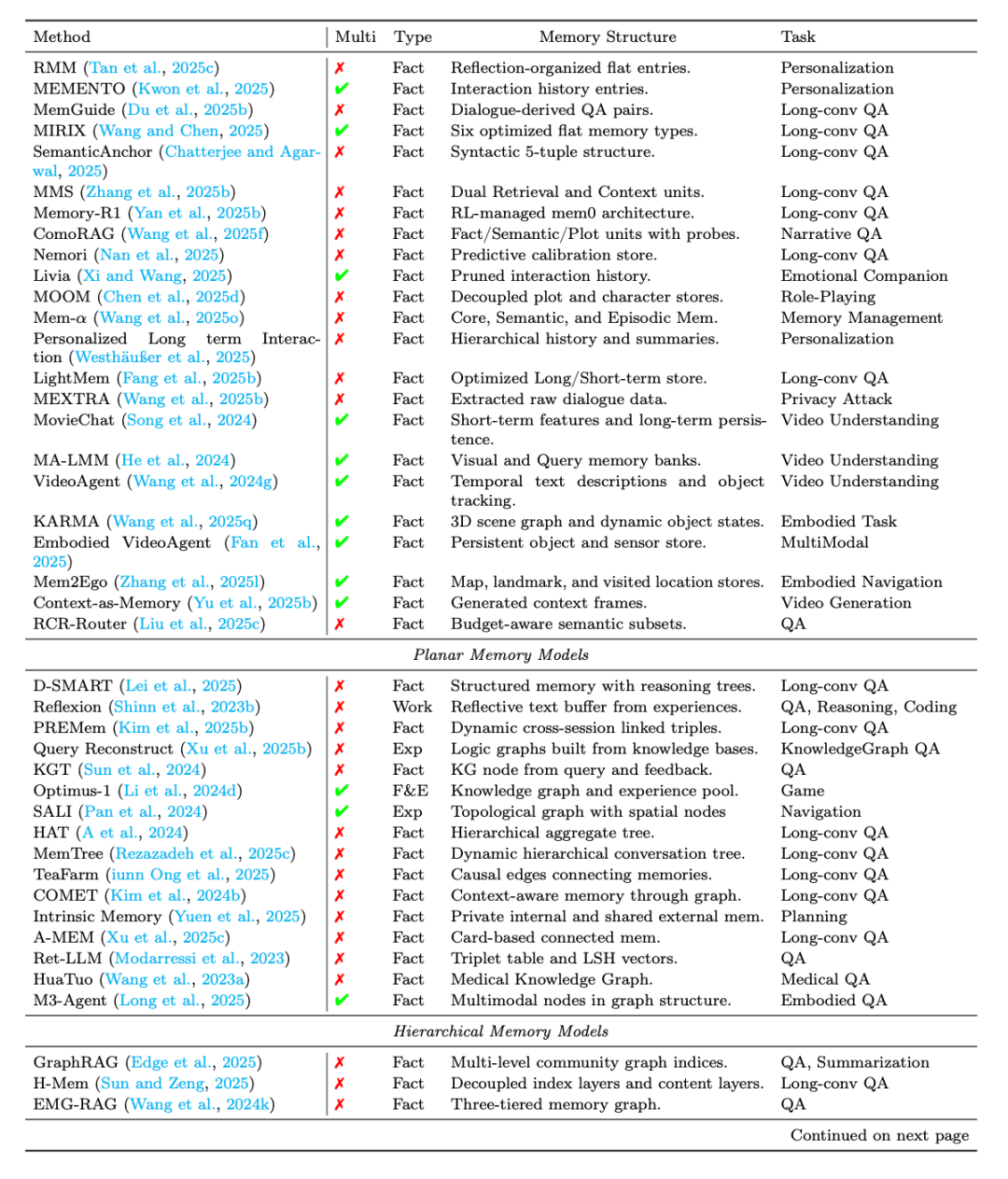

表 1 给出 60+ 代表性方法的横向对比(多模态、任务、结构):

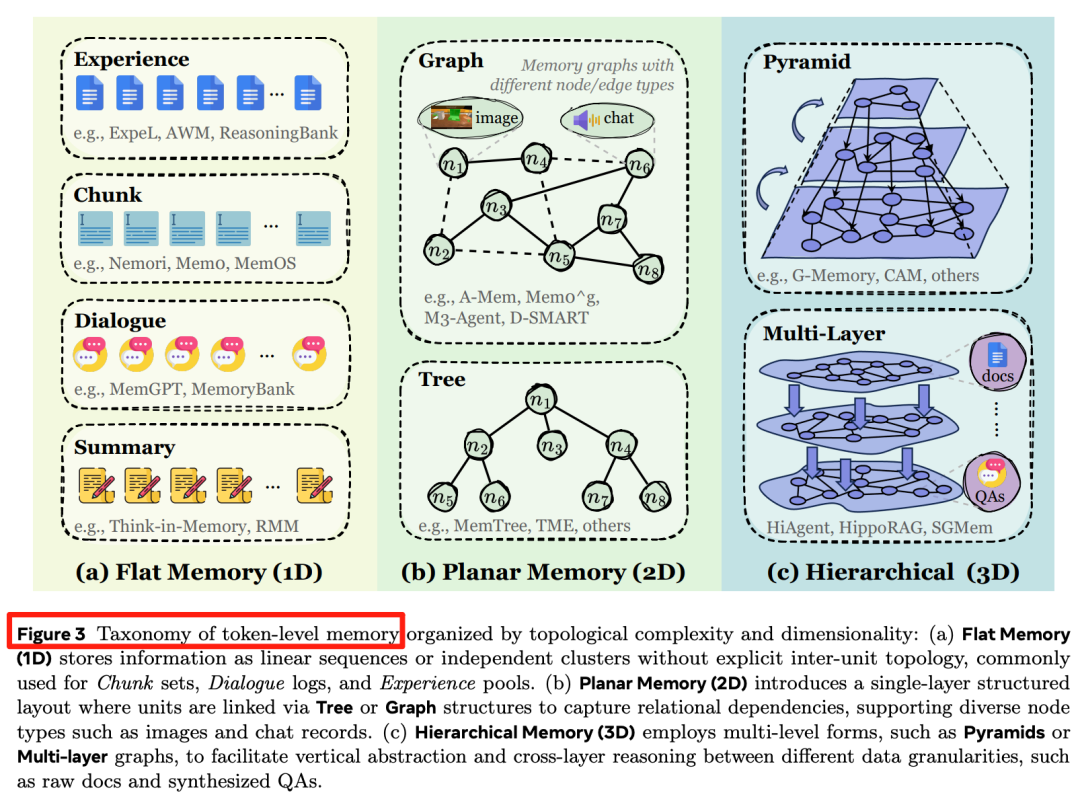

四、功能篇:Agent 到底“用”记忆做什么?

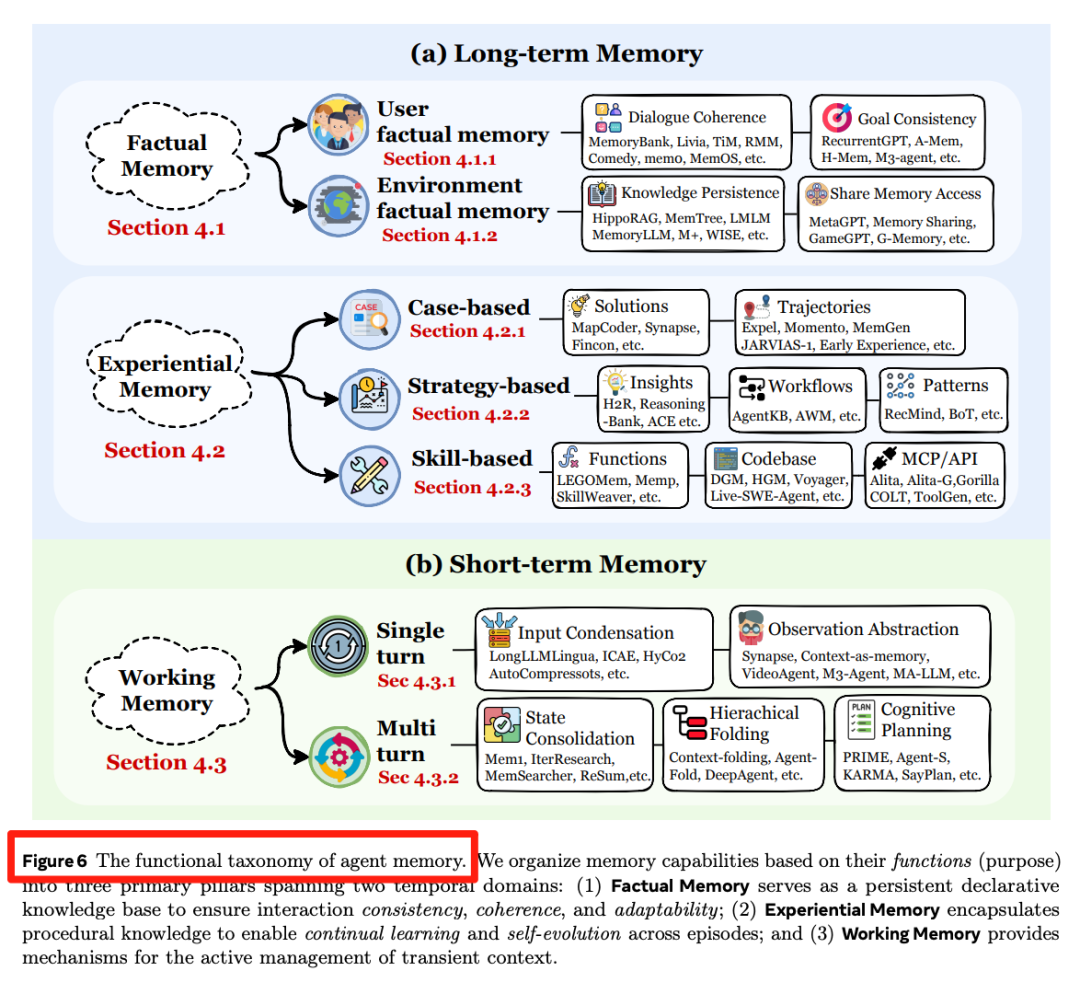

图 6 给出功能-时间双轴全景:

把“为什么记”拆成三大职能:

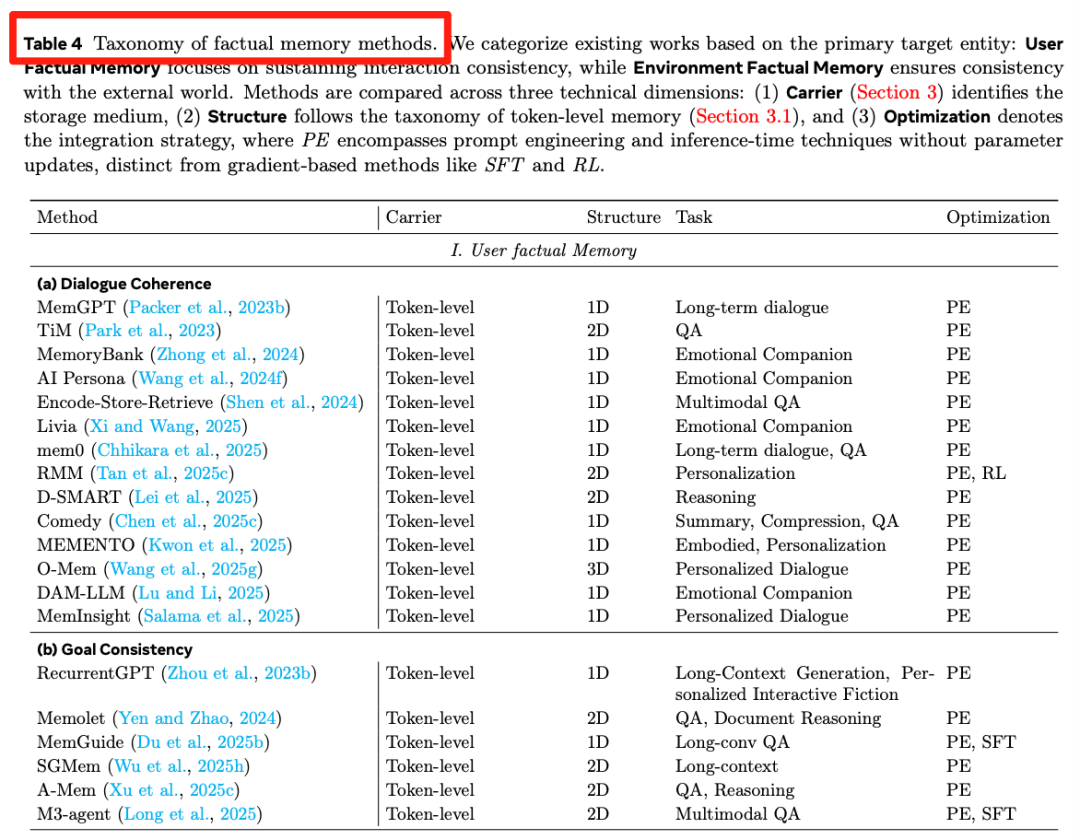

- Factual Memory——“我知道什么”:用户画像、文档状态、世界知识。

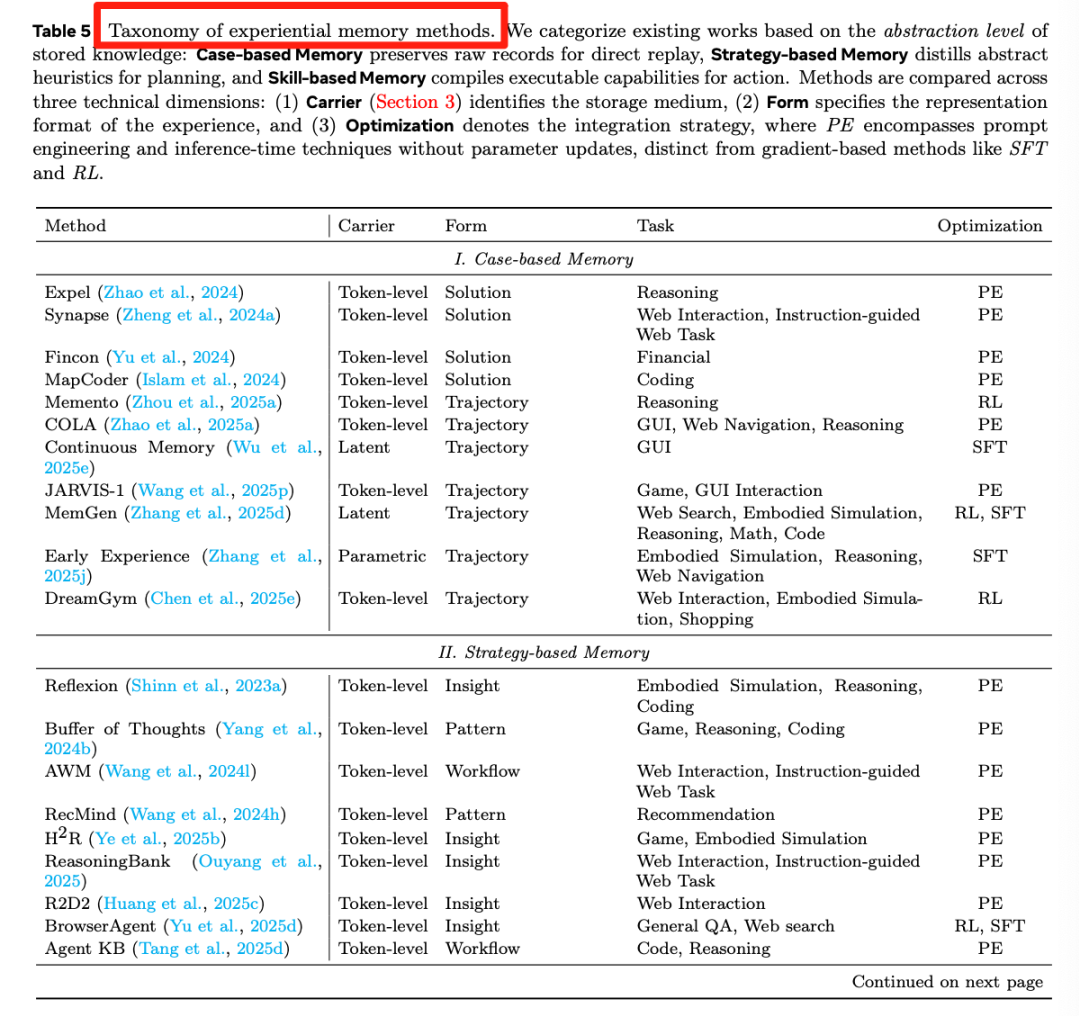

- Experiential Memory——“我学会什么”:成功/失败轨迹 → 策略 → 可执行技能。

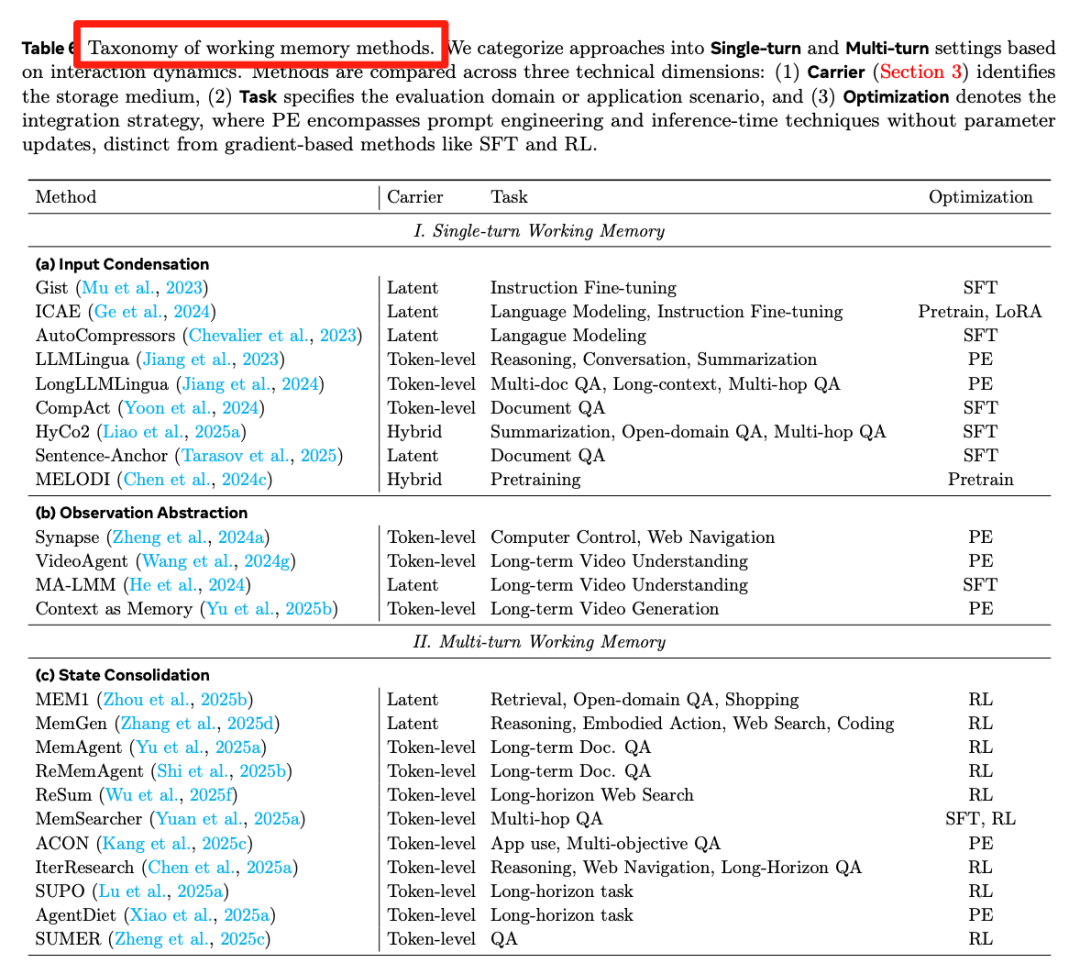

- Working Memory——“我现在想什么”:单轮压缩、多轮状态折叠、计划缓存。

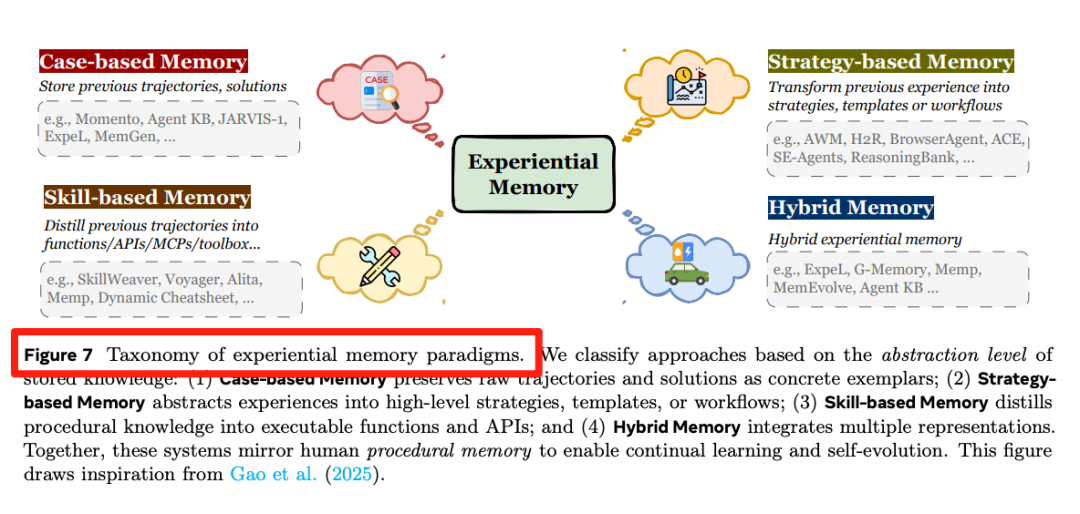

experiential memory范式

表 4-6 分别对应三大功能的 100+ 方法速查表:

五、动力学篇:记忆如何“动”起来?

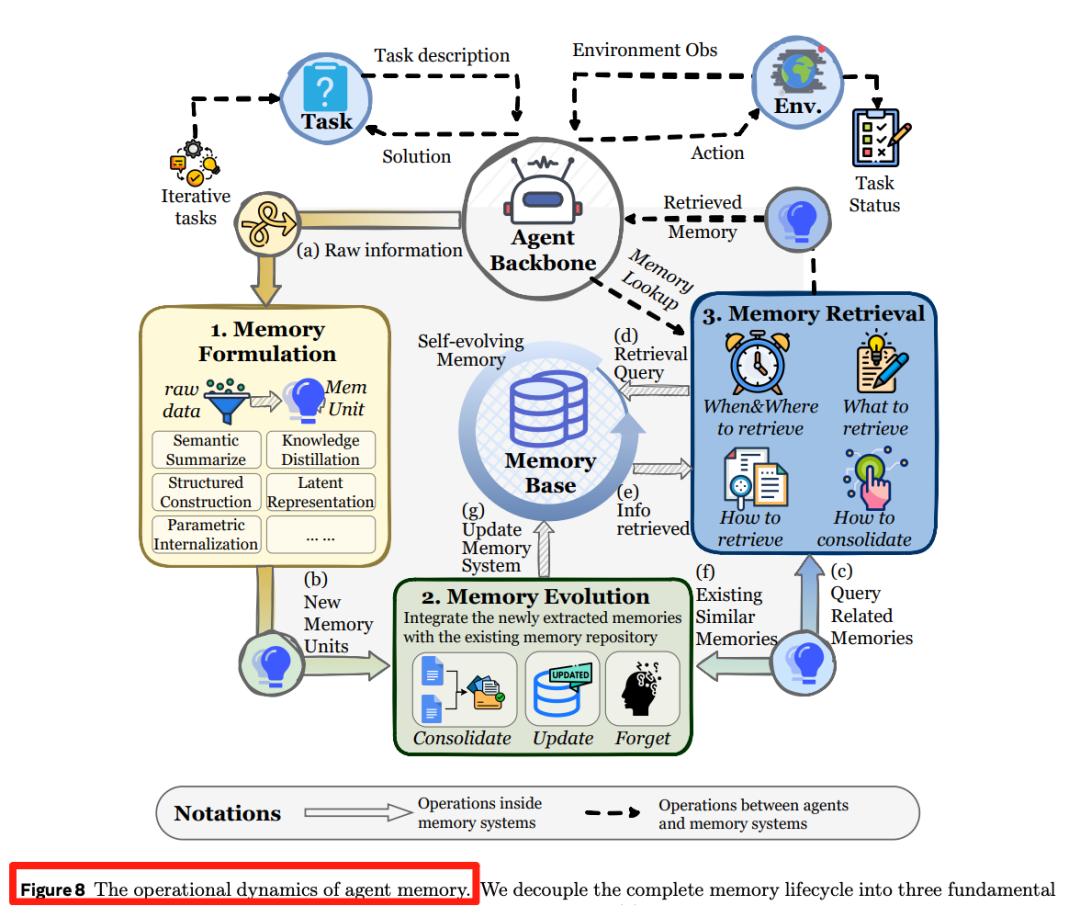

完整 生命周期 = 形成 → 演化 → 检索 闭环,用一张“地铁图”串起 30+ 操作符:

- Formation 五板斧:语义摘要、知识蒸馏、结构化、潜空间编码、参数内化。

- Evolution 三件套:合并(Consolidate)、更新(Update)、遗忘(Forget)。

- Retrieval 四步曲:触发时机 → 查询构造 → 检索策略 → 后处理。

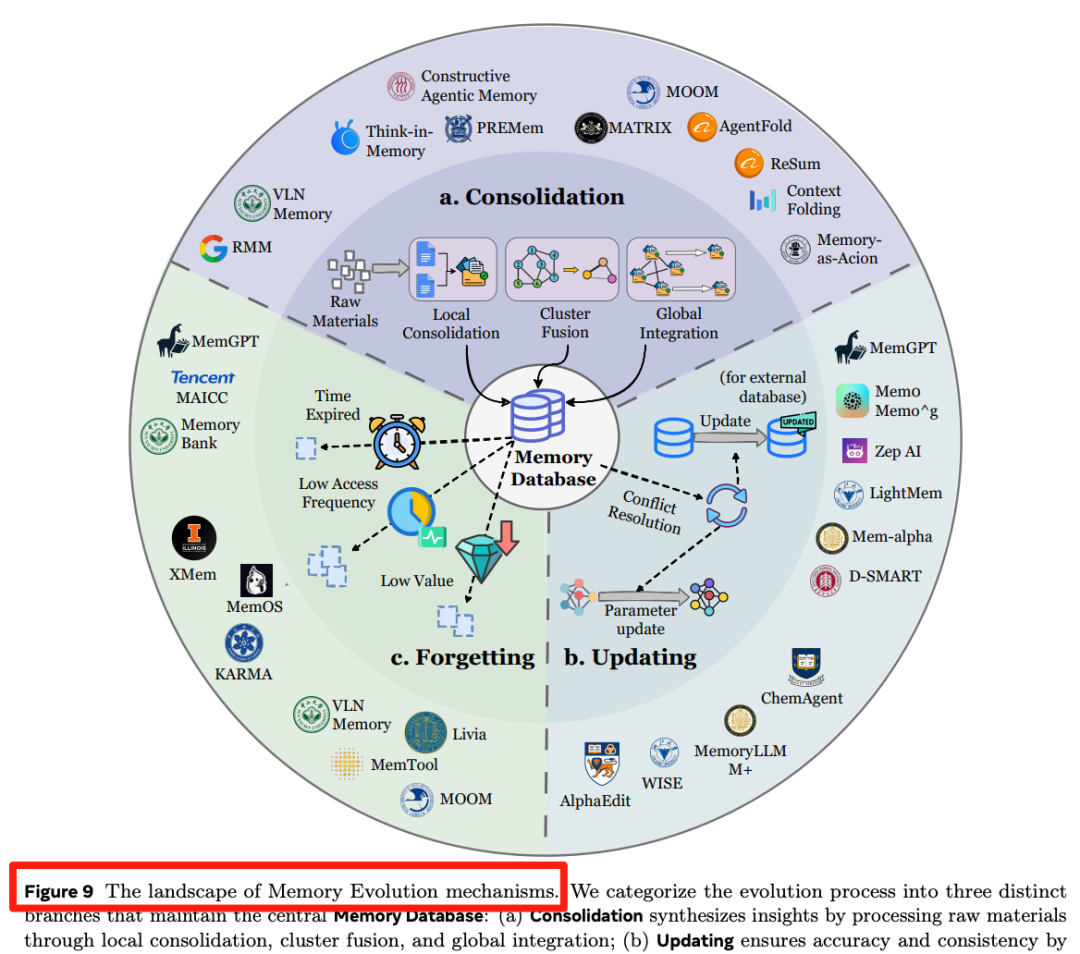

图 9 记忆演化机制蓝图

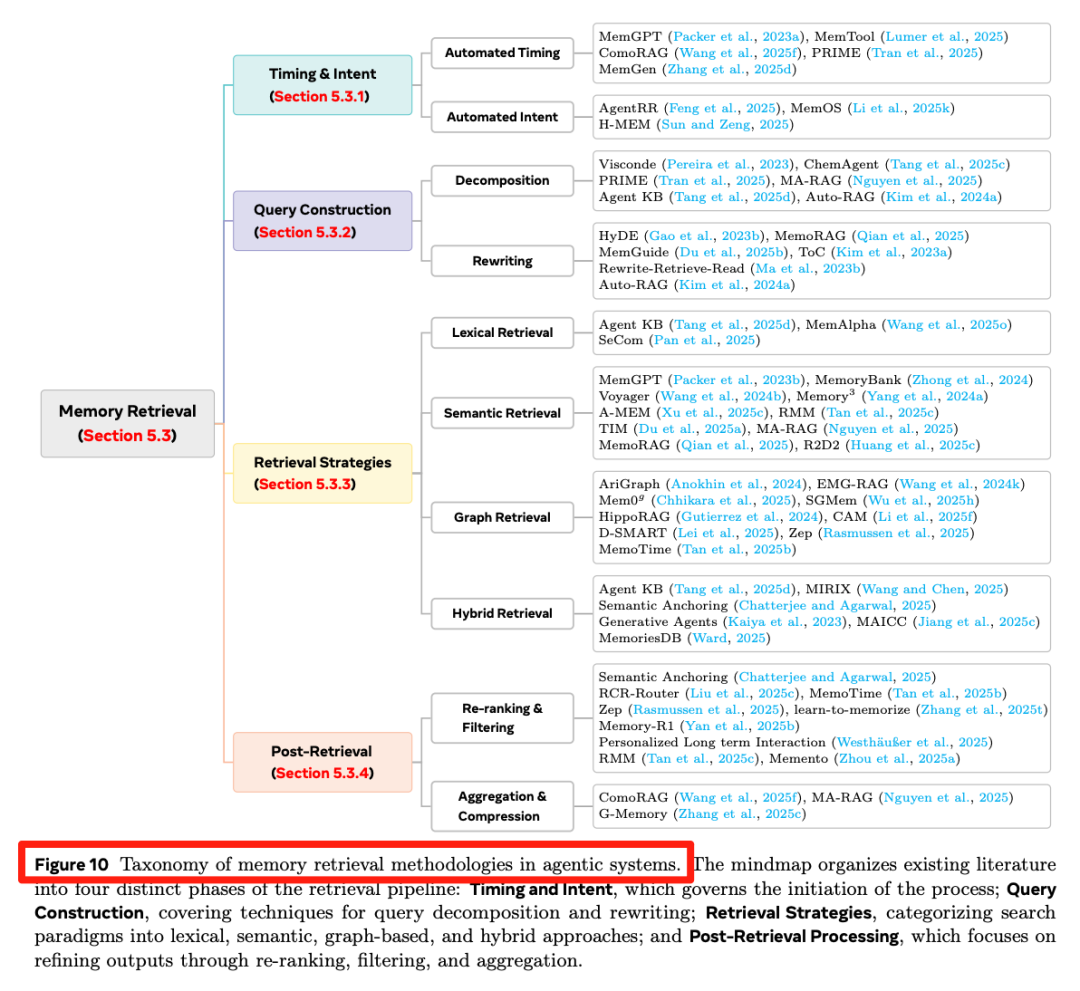

图 10 agentic系统中检索方法

六、资源篇:Benchmark & 开源框架速览

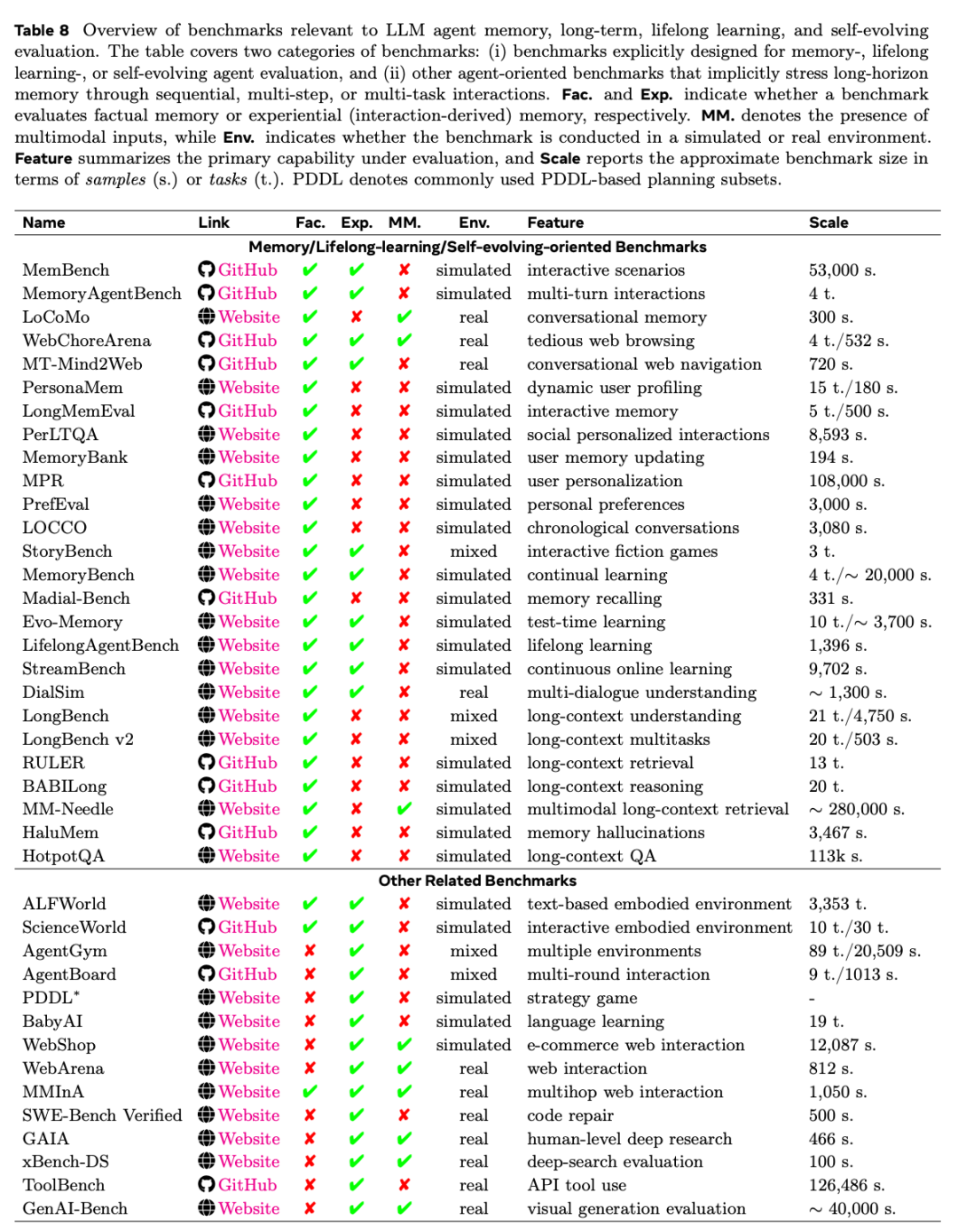

表 8 汇总 30 个记忆/终身学习/自演化评测集:

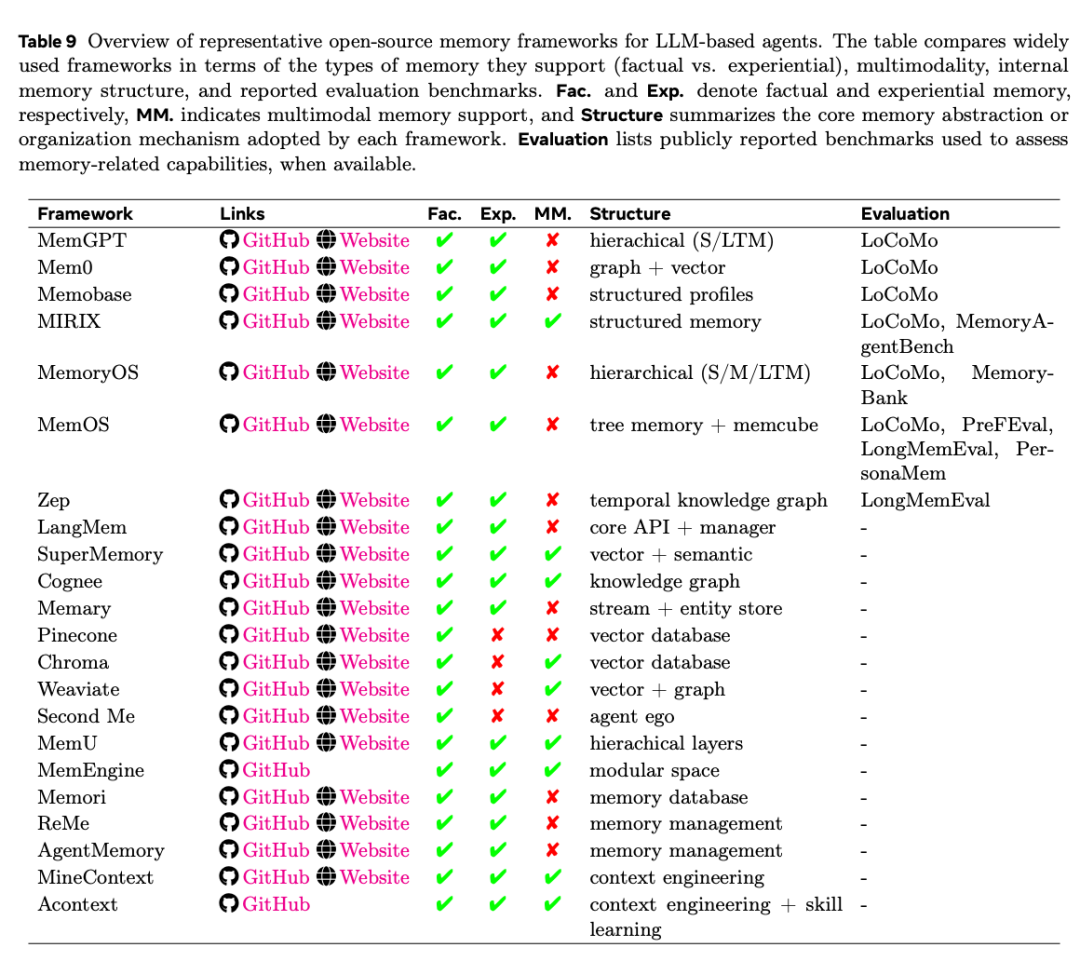

表 9 对比 20+ 开源框架(MemGPT / Mem0 / Zep / MemOS …):

七、前沿篇:7 大风向标

1. 生成式记忆 > 检索式记忆:不再“查什么用什么”,而是“缺什么生什么”。

2. 自动记忆管理:把“写/删/改”做成 Agent 可调用的 Tool,让 LLM 自己管自己。

3. RL 全面接管记忆策略:从“人工拍阈值”到“策略网络端到端优化”。

4. 多模态记忆:视频、音频、传感器流统一进 Embedding 空间。

5. 多 Agent 共享记忆:角色-权限-隐私三权分立,防止“集体幻觉”。

6. 世界模型内存:从“缓存帧”到“可查询状态模拟器”。

7. 可信记忆:差分隐私、可验证遗忘、审计日志、用户级 GDPR 擦除。

图片

END

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-05,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读