Mem0: 构建具有可扩展长期记忆的生产级 AI 智能体

Mem0: 构建具有可扩展长期记忆的生产级 AI 智能体

安全风信子

发布于 2026-03-22 08:18:50

发布于 2026-03-22 08:18:50

作者: HOS(安全风信子) 日期: 2026-03-21 主要来源平台: HuggingFace 摘要: Mem0 提出了一种以记忆为中心的可扩展架构,通过动态提取、整合和检索对话中的显著信息,解决了 LLM 固定上下文窗口的局限性。本文深入分析其核心机制、技术实现和实验结果,探讨其在生产环境中的应用价值和未来发展方向。

目录:

- 1. 背景动机与当前热点

- 2. 核心更新亮点与全新要素

- 3. 技术深度拆解与实现分析

- 4. 与主流方案深度对比

- 5. 工程实践意义、风险、局限性与缓解策略

- 6. 未来趋势与前瞻预测

1. 背景动机与当前热点

本节核心价值:理解 Mem0 诞生的背景和解决的核心问题,把握当前 LLM 智能体记忆管理的关键挑战。

大型语言模型(LLMs)在生成上下文连贯的响应方面表现出了非凡的能力,然而,它们固定的上下文窗口对维持长期多会话对话的一致性构成了根本性挑战。当对话超出模型的上下文窗口时,之前的信息会被遗忘,导致智能体无法保持长期的对话连贯性和一致性。

在实际应用中,这一限制严重影响了 AI 智能体的实用性,特别是在需要长期记忆和多会话交互的场景中,如个人助手、客服系统和教育工具等。传统的解决方案要么依赖于固定大小的上下文窗口,要么使用简单的检索机制,但这些方法都无法有效处理复杂的长期依赖关系。

Mem0 的出现正是为了解决这一核心问题,它提出了一种以记忆为中心的可扩展架构,通过动态提取、整合和检索对话中的显著信息,实现了 LLM 的长期记忆能力,为构建真正实用的生产级 AI 智能体奠定了基础。

2. 核心更新亮点与全新要素

本节核心价值:深入了解 Mem0 的三大核心创新点,及其如何实现智能体的可扩展长期记忆。

Mem0 引入了三个关键的全新要素,使其在 LLM 记忆管理领域脱颖而出:

- 以记忆为中心的架构:Mem0 采用了一种全新的以记忆为中心的架构,动态提取、整合和检索对话中的显著信息,而不是依赖于固定的上下文窗口。这使得智能体能够保持长期的对话连贯性和一致性。

- 基于图的记忆表示:Mem0 进一步提出了一种增强变体,利用基于图的记忆表示来捕获对话元素之间的复杂关系结构。这种表示方式能够更有效地组织和检索信息,提高记忆的利用率和准确性。

- 高效的记忆管理:Mem0 实现了高效的记忆管理机制,包括信息提取、整合和检索,显著减少了计算开销。与全上下文方法相比,Mem0 实现了 91% 的 p95 延迟降低和超过 90% 的 token 成本节省。

此外,Mem0 在 LOCOMO 基准测试上与六种基线类别进行了系统比较,包括已建立的记忆增强系统、具有不同块大小和 k 值的检索增强生成(RAG)、处理整个对话历史的全上下文方法、开源记忆解决方案、专有模型系统和专用记忆管理平台。

3. 技术深度拆解与实现分析

本节核心价值:深入剖析 Mem0 的技术实现细节,包括其架构设计、核心组件和工作流程。

3.1 架构设计

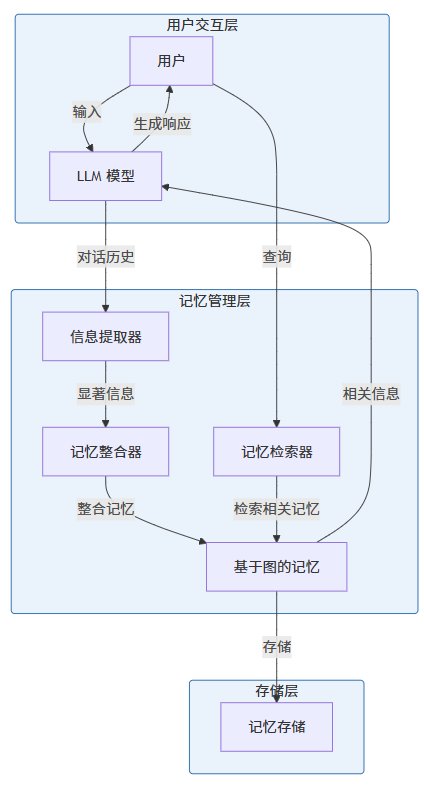

Mem0 采用了分层架构设计,主要包括以下组件:

3.2 核心组件详解

3.2.1 信息提取器

信息提取器负责从对话历史中动态提取显著信息,主要包括以下步骤:

- 分析对话历史,识别关键实体、事件和关系

- 提取需要长期记忆的重要信息

- 过滤掉冗余和无关信息

- 为提取的信息添加时间戳和上下文标签

3.2.2 记忆整合器

记忆整合器负责将提取的信息整合到记忆系统中,主要包括以下步骤:

- 接收来自信息提取器的显著信息

- 与现有记忆进行比较和融合

- 识别和解决记忆冲突

- 更新基于图的记忆表示

3.2.3 基于图的记忆表示

基于图的记忆表示是 Mem0 的核心创新之一,它通过以下方式组织信息:

- 将对话元素表示为图中的节点

- 将元素之间的关系表示为图中的边

- 为节点和边添加属性,如时间戳、重要性和上下文

- 利用图算法进行高效的信息检索和推理

3.2.4 记忆检索器

记忆检索器负责根据用户查询检索相关记忆,主要包括以下步骤:

- 分析用户查询,识别关键概念和意图

- 在基于图的记忆中执行高效检索

- 对检索到的记忆进行排序和过滤

- 将相关记忆注入到 LLM 的上下文窗口中

3.3 代码示例

以下是 Mem0 核心组件的实现示例:

# 信息提取器

class InfoExtractor:

def __init__(self, model):

self.model = model

def extract_salient_info(self, dialogue_history):

"""从对话历史中提取显著信息"""

# 分析对话历史

analysis = self.model.analyze_dialogue(dialogue_history)

# 提取关键实体、事件和关系

entities = self.extract_entities(analysis)

events = self.extract_events(analysis)

relationships = self.extract_relationships(analysis)

# 整合提取的信息

salient_info = {

'entities': entities,

'events': events,

'relationships': relationships,

'timestamp': time.time()

}

return salient_info

# 记忆整合器

class MemoryConsolidator:

def __init__(self, graph_memory):

self.graph_memory = graph_memory

def consolidate(self, salient_info):

"""将提取的信息整合到记忆系统中"""

# 处理实体

for entity in salient_info['entities']:

self.graph_memory.add_node('entity', entity)

# 处理事件

for event in salient_info['events']:

self.graph_memory.add_node('event', event)

# 处理关系

for relationship in salient_info['relationships']:

self.graph_memory.add_edge(

relationship['source'],

relationship['target'],

relationship['type']

)

# 更新记忆时间戳

self.graph_memory.update_timestamp()

# 基于图的记忆

class GraphMemory:

def __init__(self):

self.graph = {}

self.timestamp = time.time()

def add_node(self, node_type, node_data):

"""添加节点到图中"""

node_id = self.generate_node_id(node_type, node_data)

if node_id not in self.graph:

self.graph[node_id] = {

'type': node_type,

'data': node_data,

'edges': {},

'timestamp': time.time()

}

return node_id

def add_edge(self, source_id, target_id, edge_type):

"""添加边到图中"""

if source_id in self.graph and target_id in self.graph:

if target_id not in self.graph[source_id]['edges']:

self.graph[source_id]['edges'][target_id] = {

'type': edge_type,

'timestamp': time.time()

}

def retrieve(self, query, top_k=5):

"""根据查询检索相关记忆"""

# 分析查询

query_entities = self.extract_query_entities(query)

# 基于图进行检索

relevant_nodes = []

for entity in query_entities:

entity_nodes = self.find_entity_nodes(entity)

relevant_nodes.extend(entity_nodes)

# 排序和过滤

relevant_nodes = self.rank_nodes(relevant_nodes, query)

return relevant_nodes[:top_k]

# 记忆检索器

class MemoryRetriever:

def __init__(self, graph_memory):

self.graph_memory = graph_memory

def retrieve_relevant_memory(self, query):

"""检索与查询相关的记忆"""

# 在图记忆中检索

relevant_nodes = self.graph_memory.retrieve(query)

# 格式化检索到的记忆

formatted_memory = self.format_memory(relevant_nodes)

return formatted_memory

# Mem0 主类

class Mem0:

def __init__(self, llm, info_extractor, memory_consolidator, memory_retriever):

self.llm = llm

self.info_extractor = info_extractor

self.memory_consolidator = memory_consolidator

self.memory_retriever = memory_retriever

def process_dialogue(self, user_input, dialogue_history):

"""处理对话"""

# 检索相关记忆

relevant_memory = self.memory_retriever.retrieve_relevant_memory(user_input)

# 将记忆注入到上下文

enhanced_context = self.inject_memory(user_input, relevant_memory, dialogue_history)

# 生成响应

response = self.llm.generate(enhanced_context)

# 更新对话历史

new_history = dialogue_history + [(user_input, response)]

# 提取和整合新信息

salient_info = self.info_extractor.extract_salient_info(new_history)

self.memory_consolidator.consolidate(salient_info)

return response, new_history3.4 实验结果分析

Mem0 在 LOCOMO 基准测试上展示了显著的性能提升:

- 准确率提升:

- Mem0 在 LLM-as-a-Judge 指标上实现了比 OpenAI 高 26% 的相对改进

- Mem0 带图记忆的配置比基础配置实现了约 2% 的更高总体得分

- 计算效率提升:

- 与全上下文方法相比,Mem0 实现了 91% 的 p95 延迟降低

- 节省了超过 90% 的 token 成本

- 多维度性能:

- 在单跳、时间、多跳和开放域四个问题类别上,Mem0 始终优于所有现有的记忆系统

- 特别是在需要长期记忆和复杂推理的任务中,Mem0 的优势更加明显

4. 与主流方案深度对比

本节核心价值:通过多维度对比,清晰展示 Mem0 与其他记忆管理方案的优势和差异。

方案 | 记忆表示 | 检索效率 | 上下文窗口 | 计算开销 | 准确率 | 可扩展性 |

|---|---|---|---|---|---|---|

Mem0(带图记忆) | 基于图的结构化表示 | 高效 | 动态扩展 | 低(91% 延迟降低) | 高(26% 相对改进) | 高 |

Mem0(基础) | 结构化表示 | 高效 | 动态扩展 | 低 | 高 | 高 |

全上下文方法 | 无结构化 | 低 | 固定 | 高 | 中 | 低 |

传统 RAG | 向量存储 | 中 | 固定 | 中 | 中 | 中 |

开源记忆解决方案 | 简单结构化 | 中 | 固定 | 中 | 中 | 中 |

专有模型系统 | 专有表示 | 中 | 固定 | 高 | 高 | 低 |

专用记忆管理平台 | 结构化表示 | 中 | 固定 | 中 | 中 | 中 |

4.1 对比分析

- 记忆表示:Mem0 采用基于图的结构化表示,能够捕获对话元素之间的复杂关系,而传统方案要么使用无结构化表示,要么使用简单的向量存储。

- 检索效率:Mem0 的基于图的检索机制比传统的向量检索更高效,能够更准确地找到相关信息。

- 上下文窗口:Mem0 通过动态提取和检索相关信息,实际上扩展了 LLM 的有效上下文窗口,而传统方案受限于固定的上下文窗口大小。

- 计算开销:Mem0 实现了显著的计算开销降低,包括延迟和 token 成本,这使得它更适合生产环境。

- 准确率:实验结果表明,Mem0 在各种任务上的准确率都显著高于其他方案。

- 可扩展性:Mem0 的架构设计使其能够轻松扩展到更大的对话历史和更复杂的任务。

5. 工程实践意义、风险、局限性与缓解策略

本节核心价值:探讨 Mem0 在工程实践中的应用价值、潜在风险和局限性,以及相应的缓解策略。

5.1 工程实践意义

Mem0 为 LLM 智能体的工程实践带来了多方面的价值:

- 长期对话连贯性:通过有效的记忆管理,Mem0 使得智能体能够在长期多会话对话中保持连贯性和一致性,提高了用户体验。

- 计算资源优化:Mem0 显著降低了计算开销,包括延迟和 token 成本,使得在资源有限的环境中部署复杂的 LLM 智能体成为可能。

- 可扩展性:Mem0 的架构设计使其能够轻松扩展到更大的对话历史和更复杂的任务,为构建更强大的智能体系统奠定了基础。

- 多场景适用性:Mem0 适用于多种需要长期记忆的场景,如个人助手、客服系统、教育工具等。

- 易于集成:Mem0 可以与现有的 LLM 系统无缝集成,无需对基础模型进行修改。

5.2 风险与局限性

尽管 Mem0 展现了显著的优势,但也存在一些风险和局限性:

- 记忆提取质量:Mem0 的性能依赖于信息提取的质量,提取不准确可能导致记忆错误。

- 图表示复杂度:随着对话历史的增长,基于图的记忆表示可能变得复杂,需要有效的管理机制。

- 推理开销:虽然 Mem0 降低了整体计算开销,但基于图的推理仍然需要一定的计算资源。

- 领域适应性:Mem0 在不同领域的适应能力可能存在差异,需要针对特定领域进行优化。

- 隐私与安全:长期记忆可能存储敏感信息,需要适当的隐私保护机制。

5.3 缓解策略

针对上述风险和局限性,可以采取以下缓解策略:

- 提取质量优化:改进信息提取算法,提高提取的准确性和相关性。

- 记忆管理:实现记忆压缩和清理机制,定期整理和优化基于图的记忆表示。

- 推理优化:采用更高效的图算法和数据结构,减少推理开销。

- 领域适应:为不同领域开发专门的信息提取和记忆管理策略。

- 隐私保护:实现记忆加密、访问控制和数据最小化等隐私保护措施。

6. 未来趋势与前瞻预测

本节核心价值:展望 Mem0 技术的未来发展方向,以及其对 LLM 智能体领域的潜在影响。

6.1 技术演进趋势

Mem0 代表了 LLM 智能体记忆管理的一个重要方向,未来可能的演进趋势包括:

- 多模态记忆整合:将 Mem0 的记忆管理机制扩展到多模态领域,处理文本、图像、音频等多种输入形式的记忆。

- 自适应记忆容量:开发能够根据任务需求和可用资源自动调整记忆容量的机制。

- 记忆蒸馏:实现跨智能体的记忆蒸馏,使不同智能体能够共享和利用彼此的记忆。

- 主动记忆管理:开发智能体主动管理记忆的能力,包括记忆的优先级排序、压缩和清理。

- 记忆与推理的深度融合:将记忆管理与 LLM 的推理过程更紧密地集成,提高推理效率和准确性。

6.2 应用前景

Mem0 的技术理念和实现方法具有广泛的应用前景:

- 个人助手:能够记住用户的偏好、历史对话和重要信息,提供更加个性化的服务。

- 客服系统:能够保持长期的客户对话历史,提供一致的服务体验,提高客户满意度。

- 教育工具:能够跟踪学生的学习进度、偏好和弱点,提供个性化的学习建议。

- 医疗助手:能够记住患者的病史、症状和治疗方案,提供更准确的医疗建议。

- 企业助手:能够记住企业的业务流程、数据和决策历史,提供更有效的业务支持。

6.3 开放问题

Mem0 的发展也带来了一些值得深入研究的开放问题:

- 记忆泛化:如何使智能体从特定记忆中泛化出通用知识,提高记忆的利用效率?

- 长期记忆稳定性:如何确保长期记忆的稳定性和一致性,避免记忆退化或冲突?

- 记忆可解释性:如何提高记忆管理的可解释性,使用户能够理解和控制智能体的记忆?

- 多智能体记忆共享:如何实现多智能体之间的记忆共享和协作,提高整体系统性能?

- 记忆与创造力:如何平衡记忆的准确性和创造性,使智能体既能够记住重要信息,又能够产生新颖的想法?

参考链接:

- 主要来源:Mem0: Building Production-Ready AI Agents with Scalable Long-Term Memory - 可扩展长期记忆架构

- 辅助:GitHub 仓库 - Mem0 的代码实现

附录(Appendix):

- 实验环境:LOCOMO 基准测试,包括单跳、时间、多跳和开放域四个问题类别

- 模型配置:与六种基线类别进行比较,包括记忆增强系统、RAG、全上下文方法等

- 关键超参数:信息提取阈值、记忆整合策略、图记忆构建参数

关键词: Mem0, 长期记忆, 图基记忆, LLM 智能体, 可扩展性, 生产级, 记忆管理

在这里插入图片描述

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录