"数字员工" OpenClaw 能值多少钱?百万美元级别的评测告诉你

"数字员工" OpenClaw 能值多少钱?百万美元级别的评测告诉你

技术人生黄勇

发布于 2026-03-18 10:54:32

发布于 2026-03-18 10:54:32

很多原本需要人反复操作的事情,现在都可以尝试让 Agent 去完成:整理资料、信息搜集、分析报告、直至执行自动化流程。

Agent 已经 真正参与到工作流程中。

最近实践用 Skill 组合成工作流来完成各种日常工作,朋友们可以参考这下面这些实战经验分享:

给 OpenClaw 装了一套“学习系统”:Self-Improving + AutoSkill,Agent 开始自己进化了

让 OpenClaw 替你打工(三):我不止给它装了 30+ Skills 还创建了技能

给 OpenClaw 接入10000+工具和数据,为你盯盘,给出独家策略

让OpenClaw替你打工:每日摘要、获取社交网站信息、量化模拟回测(实战教程&踩坑)

如果把 AI 真的当成一个“数字员工”,一个问题就会变得非常关键:

它现在到底能创造多少真实价值?

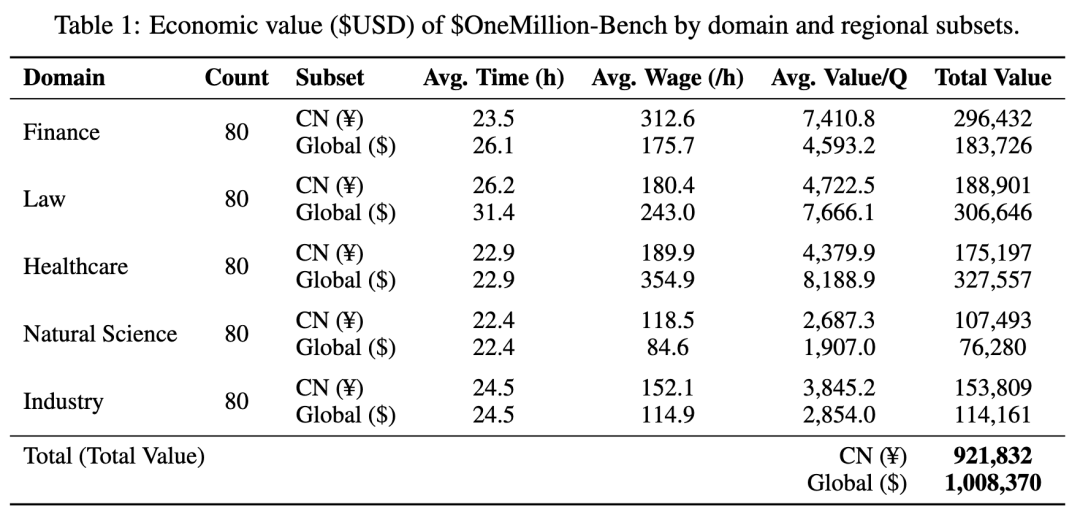

Humanlaya Data Lab联合北京通用人工智能研究院(BIGAI)、xbench、M-A-P推出的 $OneMillion-Bench。

这个评测目的很明确:用钱来衡量AI。

通过构建真实且高经济价值的任务,来推动大模型能力向现实世界落地。

评测结果:目前最强的一批 AI 模型,大约可以完成 价值 48 万美元的专家级任务,

而完成这些任务所需要的 Token 成本,大约只有 100 美元。

换句话说,目前最强的一批模型,在高难度专业任务中,已经能够稳定交付接近一半的专家级价值。

为什么需要这样一个评测?

从2025年Agent元年开始,AI逐渐从答题机推进到“数字员工“,越来越多的人开始真正把AI用于工作。

但随之而来的问题是:业界现有评测集往往缺乏对实际经济价值的衡量,区分度不足、难以自动化,而且几乎清一色只有英文语境。

以前的大模型评测,大多数是参考现实中的各类考试,给模型出一些题,看它答对多少,最后给个分数排个名。

例如 MMLU、BIG-bench、SWE-Bench 等。这些 benchmark 通常用于衡量模型在知识理解、逻辑推理或者编程任务上的表现。

分数高,就说“这个模型更强“。

但是现实世界里,进入到大模型开始落地使用的场景,用户使用的感觉却不如榜单的分数。

一道高中数学题答对,和一份价值几万块的法律合同审查意见答对,在传统评分里是同等权重——但对真实工作的意义完全不同。

因此 $OneMillion-Bench 引入了一个非常直观的指标:

用经济价值来标记任务。

具体来说:用“人类专家的时间与成本“给任务定价,再用“是否满足专家要求“来衡量模型交付质量。

任务经济价值 = 资深专家完成该任务的耗时 × 专家时薪。

时薪锚定权威数据源,比如中国各城市人社局公布的薪资数据、美国劳动统计局数据,任务耗时由多个领域专家共同评估。

把所有任务的经济价值加总,超过了100万美元。

这意味着,如果在现实世界中把这些任务交给一支资深专家团队完成,你需要支付的成本就是百万美元量级。

这样一来,模型评测不再停留在分数上,而是更直观地回答:

AI现在到底能稳定交付多少“可兑现价值”,以及距离真正上岗还差什么。

400道题,背后是2000小时的专家工作

这个评测的构建,本身就是一个大工程。

Humanlaya Data Lab招募了来自摩根士丹利、世达律所(Skadden)、协和医院、中国电网、清华大学等顶级机构的100多位资深专家,历时2000多小时,才完成了这套基准的搭建。

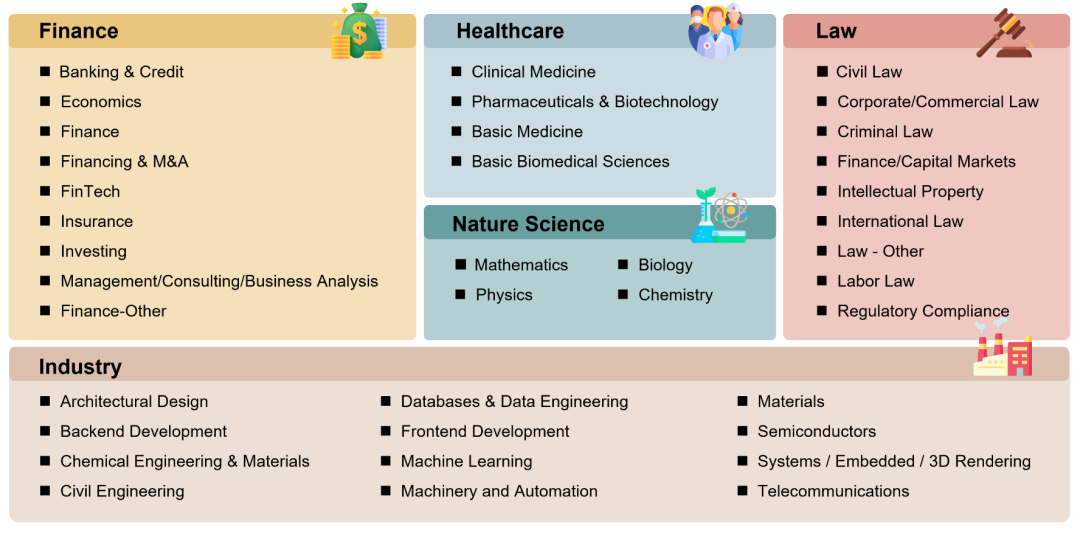

最终成品包含:

- • 400道高难度题目(200道英文 + 200道中文)

- • 覆盖金融、法律、医疗、自然科学、工业五大领域,细分到37个二级和92个三级领域

- • 每道题设计15到35个考点,累计7000多个考点

- • 题目对应的是拥有5到15年经验从业者在真实场景中面对的典型任务,专家来自各类头部机构

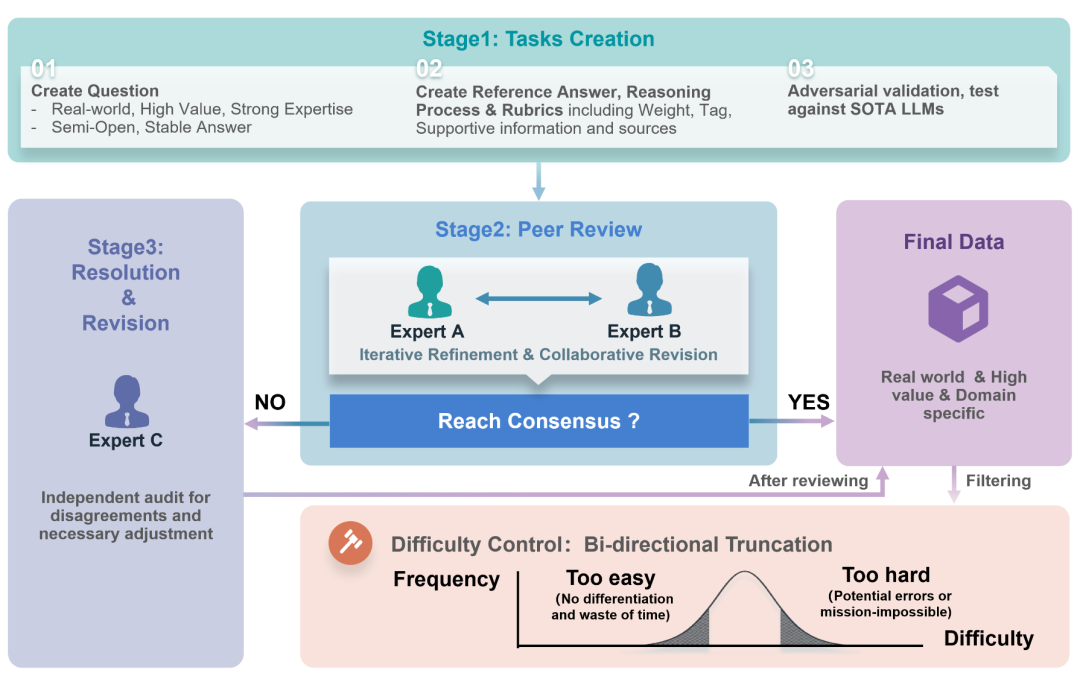

$OneMillion-Bench 的数据整理流程。

该流程包括领域专家设计具有评分标准的专门任务,然后进行同行评审,与最先进的智能体进行验证以确保区分能力,并通过达成共识进一步完善。

$OneMillion-Bench 包含 5 个宏观领域、37 个子领域和 92 个三级类别,涵盖了各种各样的实际应用和专业场景。

换句话说,这个评测真正测试的是:

AI在真实行业场景中的决策能力。

一:不考“知识点”,考“专家决策”

普通考试题问“是什么”,这套评测要求模型给出可落地的实操方案与判断链路。

不只回答”是什么”,更要说明”怎么做、按什么顺序做、为什么这么做”。

举个例子:

医疗场景下,需要的不是泛泛地说”应当监测生命体征”,而是列出可执行的临床要素:什么指标、什么频率、哪些异常触发什么处置。

法律场景里,不是背诵条款,而是给出针对具体情境的操作判断链路。

这种设计,才是真正接近”数字员工”实际工作要求的考核方式。

二:引入“负分项”,防止模型靠堆砌内容蒙分

AI有个坏习惯:回答越长、看起来越专业,也许就能碰到一两个考点得分。

这种”Reward Hacking”行为,在开放式任务里尤其容易发生。

为了对付这个,评测加入了行文逻辑和结构的扣分项考点。

如果回答没有合理逻辑展开,不光不得分,还会被扣分。

计分规则是 +10到-20的非对称设计:正向能力得分克制,但出现明显或致命错误,惩罚要重得多。

这套结构的效果更接近真实使用体感——做对不一定加分很多,但做错往往会带来更大代价。

三:CN + Global 双语子集,还原真实地域业务语境

全部400道题分为中文题(CN)和英文题(Global)两部分,各200道。

这不只是语言翻译,而是收集本地化、真实的题目,尽量还原真实的法规、流程与业务语境,从而更精准刻画不同模型在特定地域业务场景中的能力差异。

比如中国金融合规题目里,监管条款、报送流程、本土机构惯例,和美国的完全不同。

这种区分,对于真正在中文业务场景里使用AI的人来说,比一个笼统的英文评测有用得多。

四:像生产线一样的专家Pipeline,质量控制极其严格

专家整体通过率低于5%,题目最终质检通过率只有38.1%。

每道题由3到4名专家协作完成,包含对抗性评审与仲裁机制。

在难度控制上,采取双向截断策略:剔除过易样本,对于过难样本进行二次复审,确保数据质量。

这不是普通问卷,是工业级别的数据生产流程。

成绩单:48万美元,只需100美元Token

测试结果出来了,数字很有意思。

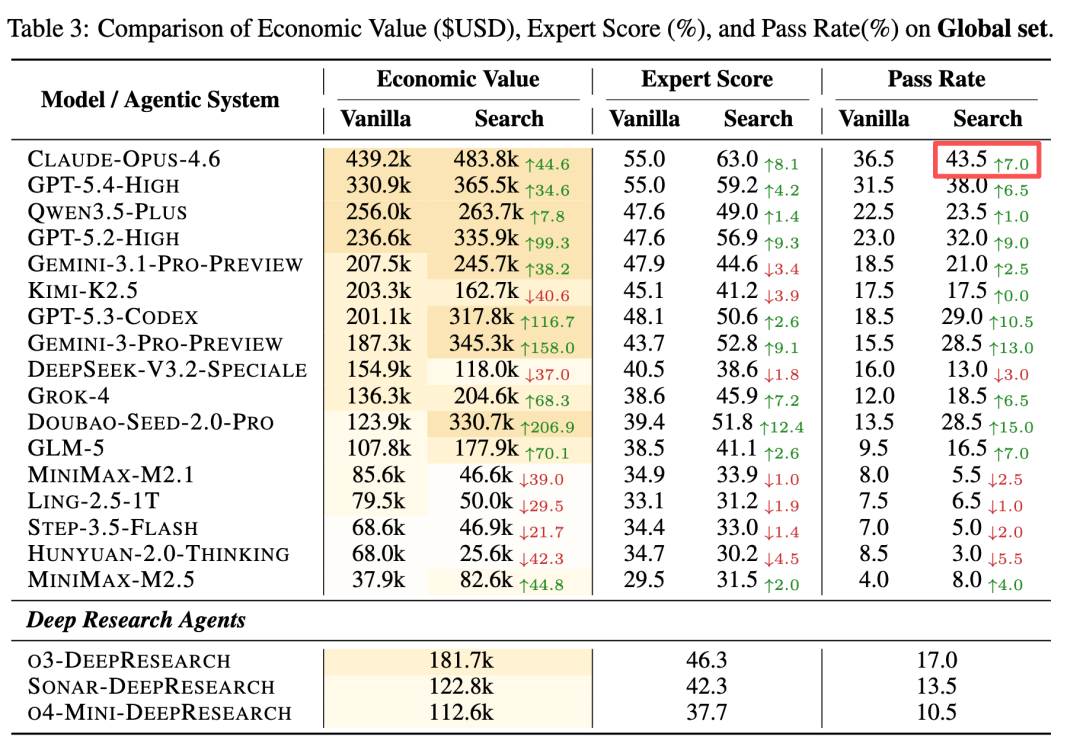

目前表现最强的模型,通过率大约43.5%。

全球数据集的经济价值(美元)、专家评分(%)和通过率(%)对比。

在总价值100万美元的任务里,大约可以产出接近50万美元的价值。

而完成这些任务消耗的API费用,也就100美元左右!

AI不但已经能”干活”;,而且在极高难度、极高单价的专业任务里,已经能交付相当可观的美元级别的价值。

不过评测也非常诚实地给出了另一面的解读。

平均分像考试成绩,通过率才是“上岗证”

如果只看平均分,头部模型已经进入合格区间(60%+),第二梯队也普遍在50%以上,看起来挺能用的。

但评测引入了更贴近落地的指标——通过率(Pass Rate):

单题得分达到70%及以上,才算“通过”,才能被计入“可交付价值”。

经济价值的计算也不是按平均分线性折算,而是严格按“可交付”口径计算。

只有通过的任务才计入“能赚到的钱”。

从通过率的视角看,即使是排名第一的Claude Opus 4.6(带Web Search),通过率也骤降到43.5%。

即只有不到45%的任务可以通过验收,第二梯队多在25%到30%区间徘徊。

换句话说:能在一半以上任务里稳定达到可交付标准的模型,目前还不存在。

目前,AI已经能稳定交付一部分题目、并且能赚到很可观的价值,

但榜单也清楚告诉我们另一半真相:距离可交付的专业任务,仍有相当一段路程。

Web Search是一把双刃剑

接入搜索工具通常能显著补齐时效性信息——在金融、法律、医疗等领域,很多规范和数据在持续迭代,搜索能力很有价值。

但它也会引入噪声与“看似权威的错误来源”,从而出现波动甚至回退。

评测给出了一个很清醒的判断:下一阶段的竞争,不只是“有没有搜索”,

而是”会不会搜索“——会不会选源、会不会交叉验证、会不会把证据链写进推理、会不会在噪声下保持一致性。

搜索工具的效果好坏,本身就是模型能力的一部分。

刚刚过去的央视3.15消费者权益晚会,曝光了GEO搜索引擎优化的黑色产业链。

不良商家通过购买这种服务,将自己的商品排在了AI大模型推荐的前列位置,因为有大模型的背书,从而让用户觉得可信。

复杂推理仍是通用瓶颈,方向正确但缺乏可执行细节

模型很擅长写一段看起来连贯、方向正确的解释,但一旦任务需要深层理解、多步演绎、或在巨大可能空间里探索,就仍会出现深度不足与准确性波动。

典型例子包括软件工程、机器学习相关任务中的探索式问题。

这类任务必须先建立结构,再做推导,再做反证,再回溯修正。

模型往往会在中途跳步,或者用看似合理的叙述替代真正的推理,也就是幻觉。

此外,模型容易给出方向正确但缺乏可执行细节的回复。

比如在医疗场景下,需要的是可执行的临床要素,但模型容易泛泛而谈,遗漏关键点。

自然科学任务里存在类似的问题:对实验条件的预期不足、对约束描述不够细、机制链条理解浅。

这种失败在真实落地里”杀伤力很大”,因为它看起来”很对“,但没有可实践的信息量。

这才是现阶段AI最隐蔽、也最危险的短板。

从技术评测到经济生产力

如果只把 $OneMillion-Bench 看成一个 AI 榜单,其实意义并不大。

真正重要的是,它开始把 AI 的能力与 经济价值联系起来。

无独有偶,王捷——摩尔线程天使投资人——在他近期的文章里提出了一个框架:

从经济生产力的角度评估AI模型。

用“单位 token 可以稳定转化为多少经济价值”来衡量模型能力。

在这个框架中,模型能力不仅取决于技术正确率,还同时取决于任务的经济价值、任务成功概率以及完成任务所消耗的 token 成本。

换句话说,AI能力不再只是技术指标,而是一种新的生产力指标。

如果用经济学语言来表达,工业时代的生产率通常用 GDP / 工时 来表示,也就是单位劳动时间可以创造多少产出。

而在 AI 时代,一个可能的新指标是:GDP / Token。

他所提出的评测模型,和$OneMillion-Bench在底层逻辑上是相互呼应的:

一个AI模型每消耗一个Token,能创造多少经济价值?—— 即GDP/Token的问题。

现有评测的根本局限

王捷在文章中系统梳理了现有主流评测基准(MMLU、BIG-bench、SWE-Bench、WebArena、AgentBench等)的共同局限:

- • 任务同质性假设:所有任务对总评分的贡献相同,未区分任务价值差异;

- • 未含人类和组织的接受度:技术答对了,但人类是否愿意在真实经济环境中采纳这个输出,没有被纳入衡量;

- • 忽略推理成本:Token消耗未纳入能力衡量,仅作为附加指标;

- • 不能反映经济产出:宏观统计(GDP、TFP)也因此无法分辨AI的真实边际贡献。

他总结了一个关键缺口:缺乏一个连接”AI模型→生产能力→生产率→宏观经济”的表达函数。

AI生产能力函数 C(M)

为此,王捷提出了AI生产能力函数 C(M):把任务经济价值、任务异质性、成功概率、资源消耗(Token)统一在一个框架里——是从技术能力到经济生产力的度量映射。

模型能力在这个框架里被定义为:

模型在其可被经济接受的任务集合上,单位Token所能稳定地产生任务成果的期望经济价值。

这个框架里有几个核心概念:

经济图灵测试(Economic Turing Test, ETT)

传统图灵测试问的是“机器能否让人分不清它是机器”;

经济图灵测试问的是:

如果模型完成任务的输出,在真实经济环境中被人类接受,则视为成功;否则视为失败。

这个测试的取值只有0或1——“不通过”为0,“通过”为1。

在生产函数中,它等价于一个制度与偏好约束,决定哪些AI产出可以被计入GDP。

这和$OneMillion-Bench设置“通过率”的逻辑完全一致——平均分反映技术能力,通过率才反映“经济图灵测试”是否过关。

任务经济价值(V_j)

三种统计方式:

- • 人类工作成本:人类完成同一任务所需的工作成本/工资;

- • 市场交易价格:如果该任务是可在市场上交易的,市场交易价格是多少;

- • 影子价格:对没有市场价格但会影响社会福利、风险或长期产出的任务,估计其隐含边际价值。

$OneMillion-Bench采用的正是第一种——专家时薪×耗时——这是目前最可操作、最直观的方式。

Token投入的双重含义

分母里的Token消耗,不是简单地记录用了多少Token,而是内生地反映了模型的成本效率和能力水平——成功率越高,完成同样任务的平均Token消耗越低;模型越稳定,成本越可控。这让C(M)成为一个真正综合的能力指标。

三个维度看AI进步

AI能力的进步,在这个框架里可以分解为三个方向:

- • 成本下降:完成同样任务消耗的Token减少,即推理效率改善、工具调用更有效或策略更紧凑;

- • 质量提升:单位任务的成功概率提升,即模型在既有任务上的能力水平、稳定性或复现性增强;

- • 能力边界扩张:任务集合 (J_m) 扩张,即模型能够覆盖更多任务,尤其是更高价值或更复杂的任务。

把$OneMillion-Bench的结果放进这个框架来读,就很清晰了:

当前模型在前两个维度已经有相当进展(100美元成本交付48万美元价值,这个成本效率已经非常惊人);

但第三个维度——能否稳定覆盖更高难度、更需要深度推理的任务——仍然是当前最大的瓶颈,直接体现为通过率只有43.5%。

框架的应用价值

对企业用户而言,模型选择不应仅依据公开评测名次,而应基于目标任务集合下的C(M)进行比较,从而将采购决策与业务价值创造能力对齐。

换句话说:你的工作任务在哪个领域、什么复杂度,就应该找在那个具体任务集上C(M)最高的模型,而不是找总榜第一的模型。

对产业政策而言,政策制定者可利用这个框架识别:哪些产业的任务结构更适合AI先行渗透,哪些制度约束正在限制高价值任务进入可执行集合,以及哪些基础设施瓶颈(能源、算力、数据中心、组织数字化)正在制约AI生产能力转化为实际产出。

对宏观经济分析而言:随着AI能力函数的逐步完善,传统生产函数中的全要素生产率(TFP)可能从“残差”变为“可解释”。

AI生产力将成为可解释的TFP分量。这意味着我们也许将第一次能够真正量化AI对经济增长的贡献,而不是把它模糊地归入“技术进步”这个黑箱。

站在2026年看这件事

如果是两年前,大多数人还觉得AI是个“大玩具”。

现在,OpenClaw 把 Agent 交到用户手里,$OneMillion-Bench 用数字告诉我们:

AI已经能稳定交付百万专家任务里接近一半的价值,而成本几乎可以忽略不计。

这是2026年正在发生的事。

当然,评测也非常清醒地告诉了我们另一半真相:通过率43.5%,意味着超过一半的任务还无法稳定达到可交付标准。

AI已经是一个能力可观的“实习生”,但还不是一个可以完全托付的”资深专家“。

而C(M)框架,则提供了一种理解这件事的更底层语言:

AI不是在和人类比考试分数,而是在成为一种新的生产要素。

以Token表达的任务执行能力,是可以精确计量的,可以嵌入经济增长模型的,可以和GDP、TFP建立直接联系的。

与其在理论上等待一个完美的AI经济指标,不如先建立一个可迭代、可扩展、可实证化的能力度量框架。

这也是$OneMillion-Bench这类评测真正的价值所在:不是”再做一个排行榜“,

而是把”数字员工“的能力边界量化出来,让你今天和未来可以放心地知道,哪些工作可以交给它。

对我们这些日常使用者来说,结论其实很实用:

Agent不是全能的,但它在特定任务上已经足够好。

关键是搞清楚,你的工作里哪些任务属于“可交付”的那43%,哪些还需要你自己压阵。

你怎么看现在这个43.5%的通过率?

对你来说,AI要到多少才算“可以放心交活”,欢迎评论区留言。

<完>

参考:

论文链接:https://github.com/humanlaya/OneMillion-Bench/blob/main/tech_report.pdf

GitHub:https://github.com/humanlaya/OneMillion-Bench

AI模型烧掉的Token,对应多少GDP?AI的经济贡献现在有数了

推荐阅读:

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录