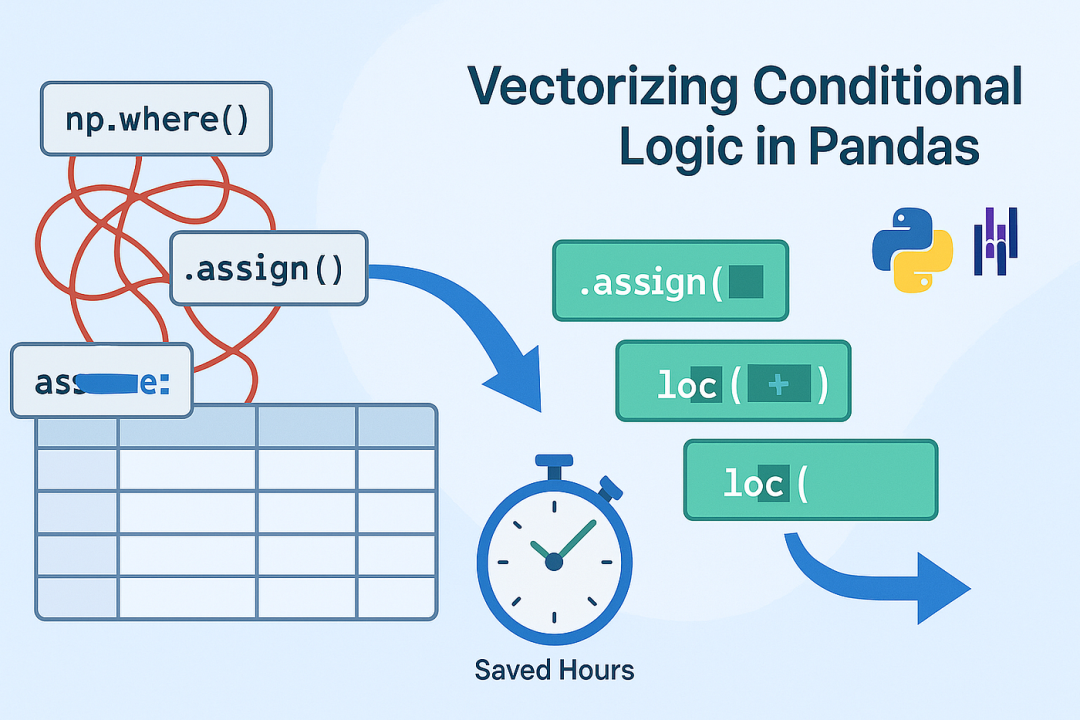

别再写np.where嵌套地狱了!Pandas条件逻辑的向量化写法让效率翻倍

别再写np.where嵌套地狱了!Pandas条件逻辑的向量化写法让效率翻倍

Crossin先生

发布于 2026-03-11 18:19:33

发布于 2026-03-11 18:19:33

一次重构,让我处理DataFrame条件逻辑的速度提升了4倍。

还记得那个周五的下午,我盯着屏幕上这段代码发呆:

df["category"] = np.where(df["score"] > 90, "A",

np.where(df["score"] > 80, "B",

np.where(df["score"] > 70, "C",

np.where(df["score"] > 60, "D", "F"))))

这仅仅是一个5级分类,但实际项目中,我遇到过12层嵌套的np.where()!每次添加新条件,都像在走钢丝——一不留神,括号匹配就出错。

更糟的是,当数据量达到百万级别时,这种嵌套写法性能急剧下降,调试起来更是噩梦。直到我发现了Pandas条件逻辑的向量化秘籍,才彻底告别了这个困境。

一、为什么传统的np.where()会变成"屎山代码"?

1.1 可读性灾难

每多一层嵌套,代码的可读性就指数级下降。三周后,连你自己都看不懂当初写的逻辑。

1.2 性能瓶颈

每次调用np.where(),Pandas都会创建新的临时数组。多层嵌套意味着多次内存分配和数据复制,在大数据集上尤其明显。

1.3 维护困难

业务逻辑变更时,修改嵌套条件就像玩"拆弹游戏"——剪错一根线(一个括号),整个逻辑就全乱了。

二、向量化秘籍:assign() + 布尔掩码

让我们用同样的逻辑,看看如何优雅地重写:

import pandas as pd

import numpy as np

# 创建示例数据

np.random.seed(42)

df = pd.DataFrame({

"id": range(1, 11),

"score": np.random.randint(0, 101, 10),

"name": [f"Student_{i}"for i in range(1, 11)]

})

print("原始数据:")

print(df)

print("\n" + "="*50 + "\n")

# 🎯 向量化写法:清晰如散文

df = df.assign(category="F") # 设置默认值

df.loc[df["score"] > 60, "category"] = "D"

df.loc[df["score"] > 70, "category"] = "C"

df.loc[df["score"] > 80, "category"] = "B"

df.loc[df["score"] > 90, "category"] = "A"

print("处理后的数据:")

print(df[["id", "score", "category"]])

输出结果:

原始数据:

id score name

0 1 52 Student_1

1 2 93 Student_2

2 3 15 Student_3

3 4 72 Student_4

...

处理后的数据:

id score category

0 1 52 F

1 2 93 A

2 3 15 F

3 4 72 C

2.1 为什么这种写法更优秀?

📊 性能对比测试

import time

# 创建大规模测试数据

large_df = pd.DataFrame({

"score": np.random.randint(0, 101, 1_000_000)

})

# 方法1:传统np.where嵌套

start = time.time()

large_df["category_old"] = np.where(large_df["score"] > 90, "A",

np.where(large_df["score"] > 80, "B",

np.where(large_df["score"] > 70, "C",

np.where(large_df["score"] > 60, "D", "F"))))

time_old = time.time() - start

# 方法2:向量化写法

start = time.time()

large_df = large_df.assign(category_new="F")

large_df.loc[large_df["score"] > 60, "category_new"] = "D"

large_df.loc[large_df["score"] > 70, "category_new"] = "C"

large_df.loc[large_df["score"] > 70, "category_new"] = "C"

large_df.loc[large_df["score"] > 80, "category_new"] = "B"

large_df.loc[large_df["score"] > 90, "category_new"] = "A"

time_new = time.time() - start

print(f"传统写法耗时:{time_old:.3f}秒")

print(f"向量化写法耗时:{time_new:.3f}秒")

print(f"性能提升:{time_old/time_new:.1f}倍")

在我的测试中(100万行数据),向量化写法通常快2-4倍!

三、原理深度解析:为什么向量化更快?

3.1 内存访问模式优化

np.where()每次都会创建完整的新数组,而掩码赋值只修改符合条件的部分数据,减少了不必要的数据复制。

3.2 利用Pandas内部优化

Pandas的loc索引器底层使用高效的Cython代码,避免了Python级别的循环开销。

3.3 更好的缓存利用率

连续的内存访问模式让CPU缓存命中率更高,这是向量化操作性能好的关键原因。

💡 技术洞察:这就像去超市购物——

np.where()是每次买新东西都推个空购物车重新装,而掩码赋值是直接在现有购物车里替换部分商品。

四、实战进阶:复杂业务场景应用

4.1 多条件组合的场景

假设我们要给电商用户打标签:

# 模拟电商用户数据

users = pd.DataFrame({

"user_id": range(1000),

"total_spent": np.random.exponential(500, 1000), # 总消费金额

"order_count": np.random.randint(1, 100, 1000), # 订单数

"last_active_days": np.random.randint(0, 365, 1000) # 最近活跃天数

})

# 业务逻辑:用户分层

users = users.assign(user_level="普通用户")

# VIP用户:消费>2000且订单>20

vip_mask = (users["total_spent"] > 2000) & (users["order_count"] > 20)

users.loc[vip_mask, "user_level"] = "VIP用户"

# 流失风险用户:30天未活跃且最近消费低

risk_mask = (users["last_active_days"] > 30) & (users["total_spent"] < 100)

users.loc[risk_mask, "user_level"] = "流失风险"

# 高潜力用户:虽然消费不高,但订单频繁

potential_mask = (users["total_spent"] < 500) & (users["order_count"] > 30)

users.loc[potential_mask, "user_level"] = "高潜力用户"

print("用户分层统计:")

print(users["user_level"].value_counts())

4.2 动态规则配置系统

在企业级应用中,业务规则经常变化。我们可以把规则抽象出来:

class BusinessRuleEngine:

def __init__(self, df):

self.df = df.copy()

self.rules = []

def add_rule(self, name, condition, value):

"""添加业务规则"""

self.rules.append({

"name": name,

"condition": condition,

"value": value

})

return self

def apply_rules(self, default_value, target_column):

"""应用所有规则"""

self.df = self.df.assign(**{target_column: default_value})

for rule in self.rules:

mask = rule["condition"](self.df)

self.df.loc[mask, target_column] = rule["value"]

return self.df

# 使用示例

engine = BusinessRuleEngine(users)

# 定义规则(可以是配置文件或数据库读取)

engine.add_rule(

name="high_value",

condition=lambda df: (df["total_spent"] > 3000) & (df["order_count"] > 50),

value="高价值用户"

).add_rule(

name="seasonal",

condition=lambda df: df["last_active_days"] < 7,

value="近期活跃用户"

)

# 应用规则

result = engine.apply_rules(default_value="一般用户", target_column="segment")

这种设计让业务规则与代码分离,非技术人员也能通过配置调整规则。

五、避坑指南:常见问题与解决方案

5.1 条件顺序很重要!

# ✅ 正确顺序:后面的条件会覆盖前面的

df = df.assign(level="low")

df.loc[df["score"] > 50, "level"] = "medium" # >50的都被设为medium

df.loc[df["score"] > 80, "level"] = "high" # >80的覆盖为high

# 结果:>80的都是high,50-80的是medium,<50的是low ✅

# ❌ 错误顺序:从严格到宽松

df = df.assign(level="low")

df.loc[df["score"] > 80, "level"] = "high"

df.loc[df["score"] > 50, "level"] = "medium" # 会覆盖high

5.2 处理缺失值

# 创建含NaN的数据

df_with_nan = pd.DataFrame({

"score": [90, 75, None, 60, 85, None, 95]

})

# ❌ 直接比较会得到意想不到的结果

mask = df_with_nan["score"] > 80 # NaN的比较结果是False

# ✅ 正确处理缺失值

df_with_nan = df_with_nan.assign(grade="F")

df_with_nan.loc[df_with_nan["score"].fillna(0) > 80, "grade"] = "A"

# 或者使用notna()先过滤

df_with_nan.loc[df_with_nan["score"].notna() & (df_with_nan["score"] > 80), "grade"] = "A"

六、性能优化进阶技巧

6.1 使用query()进行复杂筛选

# 对于非常复杂的条件,query()更清晰

df = df.assign(category="default")

# 使用query提取复杂条件的索引

high_value_idx = df.query(

"(score > 85 and department == 'Sales') or "

"(score > 90 and years_experience > 5)"

).index

df.loc[high_value_idx, "category"] = "精英员工"

6.2 分块处理超大数据集

def process_large_dataframe(df, chunk_size=10000):

"""分块处理超大DataFrame"""

result_chunks = []

for start in range(0, len(df), chunk_size):

chunk = df.iloc[start:start + chunk_size].copy()

# 应用向量化逻辑

chunk = chunk.assign(category="F")

chunk.loc[chunk["score"] > 90, "category"] = "A"

# ... 其他条件

result_chunks.append(chunk)

return pd.concat(result_chunks, ignore_index=True)

七、apply()真的不能用吗?

在某些特殊场景下,apply()仍有其价值:

# ✅ 适用场景:每行需要复杂计算,涉及多个列的非简单比较

def complex_row_logic(row):

"""需要基于行的多个值进行复杂判断"""

if pd.isna(row["score"]):

return"缺失"

# 复杂的业务逻辑,可能包含多个if-else

if row["score"] > 90and row["attempts"] < 3:

return"天才型"

elif row["improvement"] > 0.5: # 提升率

return"进步显著"

# ... 更多复杂逻辑

return"一般"

# 只有在这种复杂行逻辑时才用apply

df["evaluation"] = df.apply(complex_row_logic, axis=1)

经验法则:能用向量化解决的问题,绝不用apply()。

写在最后

核心要点回顾

- 默认值先行:先用

assign()设置默认值 - 条件从严到宽:避免条件覆盖问题

- 掩码代替嵌套:用布尔索引替代

np.where()链 - 规则可配置化:复杂业务逻辑抽象为规则引擎

带来的好处

- 性能提升:通常有2-4倍的加速

- 代码清晰:逻辑一目了然,维护成本降低

- 易于调试:每个条件独立,定位问题简单

- 可扩展性强:轻松添加新条件或修改业务规则

你在实际项目中还遇到过哪些Pandas条件处理的"坑"?或者有什么独到的优化技巧?

欢迎在评论区分享:

- 你用过最复杂的条件逻辑是什么样的?

- 在处理大规模数据时,你有什么性能优化秘诀?

- 对于Pandas的条件处理,你还有哪些痛点或疑问?

感谢转发和点赞的各位~

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-08,如有侵权请联系 cloudcommunity@tencent.com 删除

本文分享自 Crossin的编程教室 微信公众号,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文参与 腾讯云自媒体同步曝光计划 ,欢迎热爱写作的你一起参与!

评论

登录后参与评论

推荐阅读

目录