具身人工智能全面综述

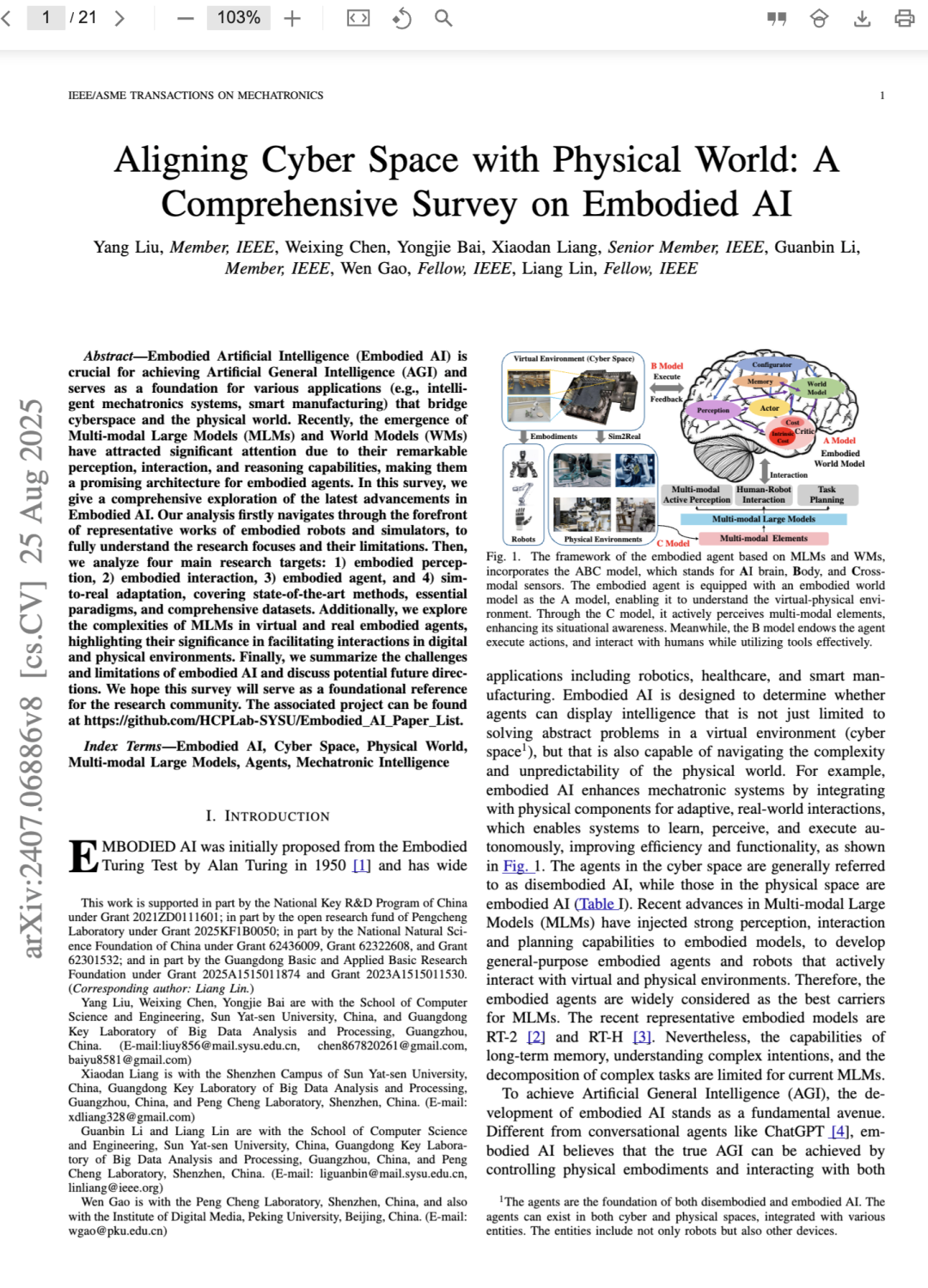

Aligning Cyber Space with Physical World: A Comprehensive Survey on Embodied AI

将网络空间与现实世界对齐:具身人工智能全面综述

https://arxiv.org/pdf/2407.06886

摘要

—具身人工智能(Embodied AI)对于实现通用人工智能(AGI)至关重要,并作为连接网络空间与物理世界各类应用(如智能机电系统、智能制造)的基础。近年来,多模态大模型(MLMs)和世界模型(WMs)因其卓越的感知、交互与推理能力而备受关注,成为具身智能体极具前景的架构。本综述全面探讨了具身人工智能领域的最新进展。我们的分析首先梳理了具身机器人与仿真平台的代表性前沿工作,以充分理解当前研究重点及其局限性。随后,我们深入分析四大核心研究方向:1)具身感知,2)具身交互,3)具身智能体,4)仿真到现实的迁移,涵盖最先进方法、关键范式及综合性数据集。此外,我们探讨了多模态大模型在虚拟与现实具身智能体中的复杂性,强调其在促进数字与物理环境交互中的重要意义。最后,我们总结了具身人工智能当前面临的挑战与局限,并探讨了潜在的未来发展方向。我们希望本综述能为研究社区提供基础性参考。相关项目资源请访问:https://github.com/HCPLab-SYSU/Embodied AI Paper List。

关键词—具身人工智能,网络空间,物理世界,多模态大模型,智能体,机电智能

I、引言

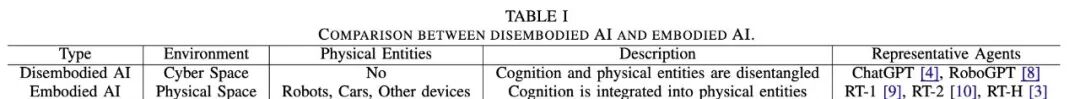

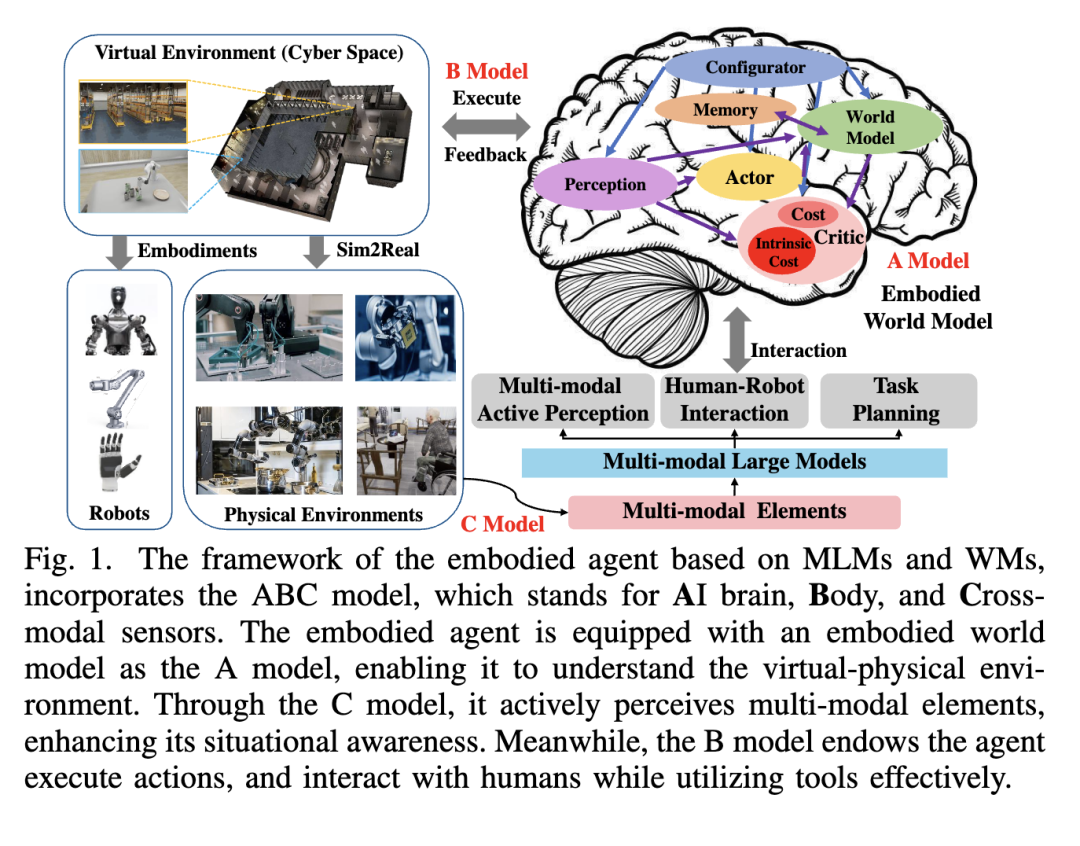

具身人工智能(Embodied AI)最初源于艾伦·图灵于1950年提出的“具身图灵测试”[1],其应用广泛,涵盖机器人、医疗健康和智能制造等领域。具身人工智能旨在判断智能体是否具备的智能不仅限于在虚拟环境(网络空间¹)中解决抽象问题,更能应对物理世界中的复杂性与不确定性。例如,具身人工智能通过与物理部件集成,增强机电系统在现实世界中的自适应交互能力,使系统能够自主学习、感知与执行,从而提升效率与功能性,如图1所示。网络空间中的智能体通常被称为“非具身AI”,而物理空间中的智能体则称为“具身AI”(见表I)。近年来,多模态大模型(MLMs)的进展为具身模型注入了强大的感知、交互与规划能力,推动了通用型具身智能体和机器人在虚拟与物理环境中主动交互的发展。因此,具身智能体被广泛视为多模态大模型的最佳载体。当前具有代表性的具身模型包括RT-2 [2] 和 RT-H [3]。然而,现有MLMs在长期记忆、复杂意图理解以及复杂任务分解等方面的能力仍显不足。

要实现通用人工智能(AGI),发展具身人工智能是一条根本路径。与ChatGPT等对话式智能体不同[4],具身人工智能认为,真正的AGI必须通过控制物理实体并与仿真及物理环境交互才能实现[5][6]。站在AGI驱动创新的前沿,我们迫切需要深入探索具身人工智能领域,剖析其复杂性,评估其当前发展阶段,并思考其未来可能的发展轨迹。当前,具身人工智能涵盖计算机视觉(CV)、自然语言处理(NLP)和机器人学等多个关键技术领域,最具代表性的方向包括:具身感知、具身交互、具身智能体和仿真到现实的机器人控制[7]。因此,有必要通过全面综述,把握具身人工智能在通向AGI道路上不断演进的发展图景。

具身智能体是具身人工智能最核心的基础。对于一项具身任务,智能体必须完全理解人类语言指令中的意图,主动探索周围环境,全面感知来自虚拟和物理环境的多模态信息,并执行复杂任务所需的适当动作[11][12],如图1所示。相比传统的深度强化学习方法,多模态模型在复杂环境中的适应性、灵活性和泛化能力表现更优。最先进的视觉编码器[13][14]提供的预训练视觉表征,可精确估计物体类别、姿态和几何结构,使具身模型能深入感知复杂动态环境。强大的大语言模型(LLMs)使机器人能更好地理解人类语言指令。前景广阔的多模态大模型(MLMs)为对齐具身机器人的视觉与语言表征提供了可行路径。世界模型[15][16]展现出卓越的仿真能力与对物理规律的深刻理解,使具身模型能够全面理解物理世界与真实环境。这些创新赋予具身智能体全面感知复杂环境、自然与人类交互、可靠执行任务的能力。

尽管学界对从多模态大模型中挖掘强大感知与推理能力兴趣浓厚,但目前仍缺乏一份全面综述,帮助梳理现有具身人工智能研究、面临的挑战以及未来研究方向。在多模态大模型时代,我们旨在通过系统性综述,填补从网络空间到物理世界的具身人工智能研究空白。本综述从多个维度展开,包括具身机器人、仿真平台、四类代表性具身任务(视觉主动感知、具身交互、多模态智能体、仿真到现实迁移)以及未来研究方向。我们相信,本综述将清晰呈现当前已取得的成果,并指明这一新兴且极具前景研究方向未来可能实现的突破。

与以往工作的区别:尽管此前已有多篇关于具身人工智能的综述论文[5]、[6]、[17]、[18],但它们大多已过时,因为均发表于多模态大模型(MLMs)时代(约始于2023年)之前。据我们所知,2023年后仅出现两篇相关综述[6]、[18],分别聚焦于视觉-语言-动作模型和面向智能制造的具身人工智能系统。具身人工智能(包含AI大脑、身体与跨模态传感器)的概念首次在[18]中提出,该文也是首个在基础模型时代为未来智能制造提出具身AI系统技术架构的研究。然而,先前的综述并未充分涵盖MLMs、世界模型(WMs)和具身智能体。此外,近期在具身机器人和仿真平台方面的进展也未被纳入考虑。

为弥补这一快速演进领域中综合性综述文献的匮乏,我们提出了本篇全面综述,涵盖具身机器人代表工作、仿真平台,以及四大核心研究任务:具身感知、具身交互、具身智能体和仿真到现实迁移。总而言之,本工作的主要贡献有三点:

• 据我们所知,这是首个从网络空间与物理空间对齐视角出发,基于MLMs和WMs的具身人工智能全面综述,提供了关于方法、基准、挑战与应用的新颖见解。

• 我们将具身人工智能系统性地划分为若干核心组成部分,包括机器人、仿真平台,以及四大研究任务:具身感知、具身交互、具身智能体和仿真到现实迁移,从而构建了具身人工智能的详细分类体系。

• 为促进鲁棒、通用型具身智能体的发展,我们提出了一种新的数据集标准——ARIO(All Robots In One),并构建了一个统一的大规模ARIO数据集,涵盖约300万条片段,来自258个系列、321,064项任务。

本综述其余部分结构如下:第2节介绍具身机器人;第3节描述通用与真实场景仿真平台;第4节介绍具身感知,包括主动视觉感知与视觉语言导航;第5节介绍具身交互;第6节介绍具身智能体,包括具身多模态基础模型与具身任务规划;第7节介绍仿真到现实迁移,涵盖具身世界模型、数据采集与训练方法;第8节讨论有前景的未来研究方向。

II 、具身机器人

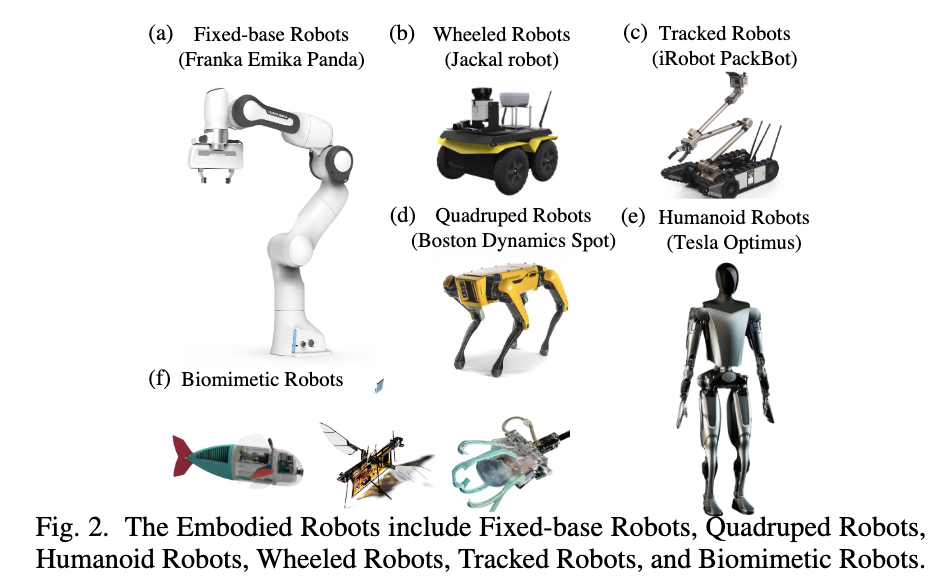

具身智能体与物理环境进行交互,包括机器人、智能家电、自动驾驶车辆等。如图2(a)所示,固定基座机器人因其高精度,广泛应用于实验室自动化和工业领域,例如Franka Emika Panda [19]、[20]、Kuka iiwa [21]、[22] 和 Sawyer [23]、[24]。如图2(b)所示,轮式机器人结构简单、成本低廉,在物流与仓储领域效率较高,例如Kiva和Jackal机器人[25],但其在不平坦地形上面临挑战。如图2(c)所示,履带式机器人适用于农业和灾后救援等越野任务,其履带系统在松软地形上提供良好的稳定性[26]。如图2(d)所示,四足机器人在复杂地形探索和救援任务中表现优异,代表性产品包括宇树科技的A1和Go1,以及波士顿动力的Spot。如图2(e)所示,人形机器人模仿人类动作与行为,可提供个性化服务,其灵巧的双手使其能够执行精细复杂任务[27]、[28]。结合大语言模型(LLM),这些机器人有望在制造、医疗和服务领域进一步提升效率与安全性[29]。如图2(f)所示,仿生机器人模仿自然界生物的运动方式与功能,这种仿生设计有助于其在复杂环境中作业,并通过模拟生物机制提高能效[30]、[31],例如仿鱼机器人[32]、仿昆虫机器人[33]和软体机器人[34]。

III、具身仿真器

具身仿真器对具身人工智能至关重要,因其具备成本效益高、安全性好、可扩展性强、支持快速原型开发以及便于科研使用等优势。它们支持受控实验、生成用于训练与评估的数据,并提供标准化的基准测试。为促进智能体与环境的交互,构建逼真仿真环境至关重要,需综合考虑物理特性、物体属性及其相互作用。本节将从两部分介绍当前常用的仿真平台:基于底层物理引擎的通用仿真器,以及基于真实场景的仿真器。

A. 通用仿真器

现实环境中存在的物理交互与动态变化是不可替代的。然而,在物理世界中部署具身模型通常成本高昂,且面临诸多挑战。通用仿真器提供了一个高度逼近物理世界的虚拟环境,支持算法开发与模型训练,在成本、时间与安全性方面具有显著优势。

Isaac Sim [36] 是一个面向机器人与人工智能研究的先进仿真平台,具备高保真物理仿真、实时光线追踪、丰富的机器人模型库以及对深度学习的支持,主要应用于自动驾驶、工业自动化和人机交互等场景。

Gazebo [47] 是一个开源的机器人研究仿真器,拥有广泛的机器人模型库,并与ROS(机器人操作系统)深度集成。它支持多种传感器仿真,提供大量预建机器人模型与环境,主要用于机器人导航与控制、多机器人系统等领域。

PyBullet [39] 是Bullet物理引擎的Python接口,易于使用,支持多样化的传感器仿真和深度学习集成。PyBullet支持实时物理仿真,包括刚体动力学、碰撞检测和约束求解。此外,新推出的Genesis [35] 具备可微分物理引擎和出色的生成能力。

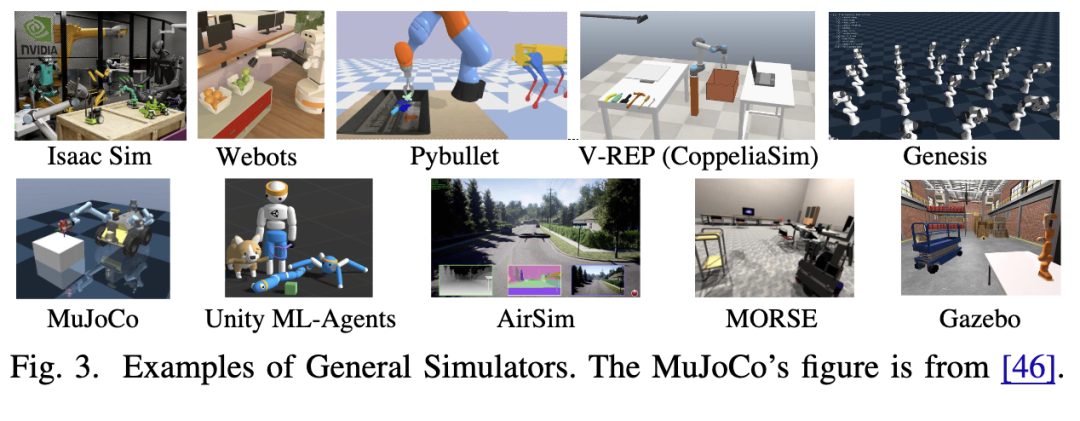

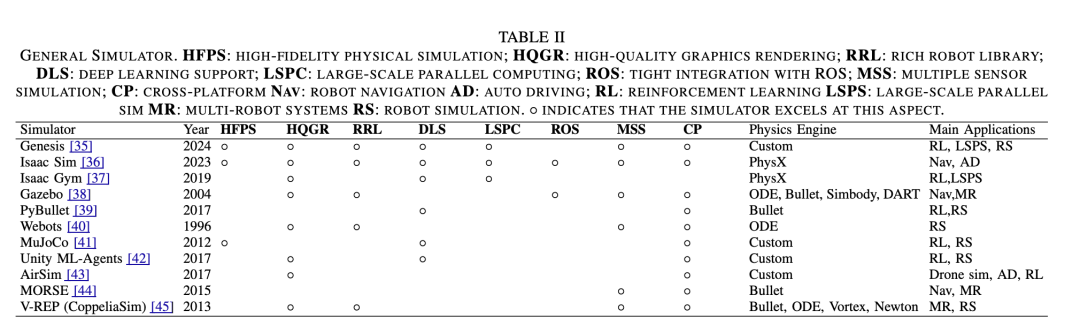

表II列出了11种通用仿真器的关键特性与主要应用场景。图3展示了这些通用仿真器的可视化效果。

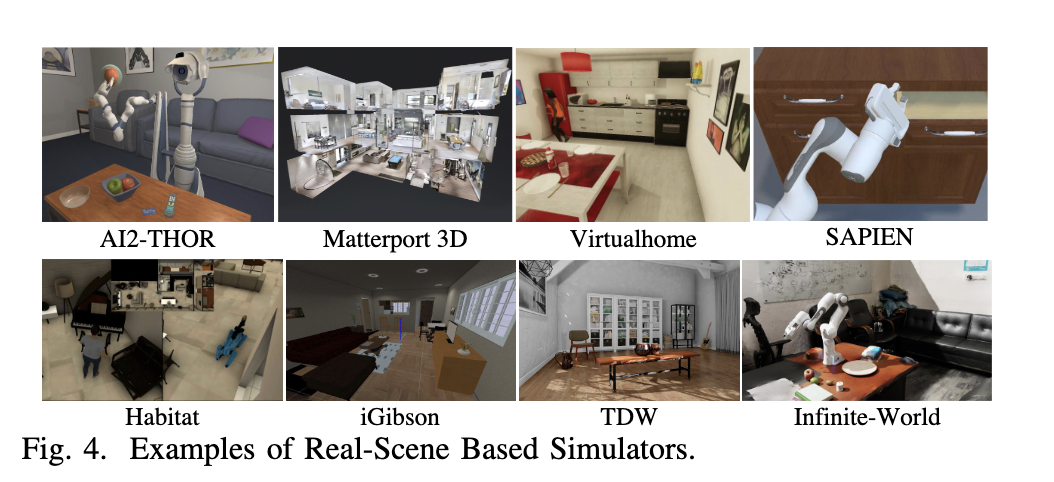

B. 基于真实场景的仿真器

在家庭日常活动中实现通用型具身智能体是具身人工智能的核心研究方向之一。这类智能体需深入理解人类日常生活,并在室内环境中完成导航、交互等复杂具身任务。为满足这些复杂任务的需求,仿真环境必须高度贴近现实世界,这对仿真器的复杂度与真实感提出了更高要求。此类仿真器大多从现实世界采集数据,构建逼真的3D资产,并利用UE5、Unity等3D游戏引擎搭建场景。丰富且逼真的场景使基于真实环境的仿真器成为家庭活动任务的首选。

SAPIEN [48] 以其专为模拟门、柜子、抽屉等带关节物体交互而设计的特性脱颖而出。

VirtualHome [49] 的独特之处在于其环境图结构,支持基于自然语言描述进行高层次具身任务规划。

AI2-ThOR [50] 虽然提供了大量交互场景,但其交互方式(与VirtualHome类似)基于脚本,缺乏真实的物理交互。这种设计足以满足无需精细交互的具身任务。

iGibson [51] 和 TDW [52] 均提供精细的具身控制和高度仿真的物理交互。iGibson 在提供丰富、逼真的大规模场景方面表现优异,适合复杂、长期的移动操作任务;而TDW在场景扩展上给予用户更大自由度,并具备独特的音频支持与灵活的流体仿真能力,使其在相关仿真场景中不可或缺。

Matterport3D [53] 作为基础性的2D-3D视觉数据集,被广泛应用于具身人工智能基准测试并不断扩展。尽管Habitat中的具身智能体缺乏交互能力,但其丰富的室内场景、用户友好的接口和开放框架使其在具身导航领域备受推崇。

InfiniteWorld [54] 聚焦于统一且可扩展的仿真框架,实现了多项改进,包括最新的隐式资产重建、自然语言驱动的场景生成与编辑。它通过分布式协作、AI辅助和人在环(Human-in-the-Loop)机制,为复杂机器人交互提供强大支持。

此外,自动化仿真场景构建对获取高质量具身数据大有裨益:

RoboGen [55] 利用大语言模型(LLMs)从随机采样的3D资产中定制任务,从而自动生成场景并训练智能体;

HOLODECK [56] 可根据人类指令在AI2-THOR中自动定制高质量仿真场景;

PhyScene [57] 基于条件扩散模型生成具有交互性与物理一致性的高质量3D场景;

艾伦人工智能研究所扩展了AI2-THOR并提出了ProcTHOR [58],可自动生成具备充分交互性、多样性与合理性的仿真场景。

IV、具身感知

未来视觉感知的“北极星”方向是具身中心的视觉推理与社会智能[59]。与仅在图像中识别物体不同,具备具身感知能力的智能体必须在物理世界中移动并与环境交互。这要求其对三维空间和动态环境有更深层次的理解。具身感知需要视觉感知与推理能力、对场景内三维关系的理解,以及基于视觉信息预测并执行复杂任务的能力。

A. 主动视觉感知

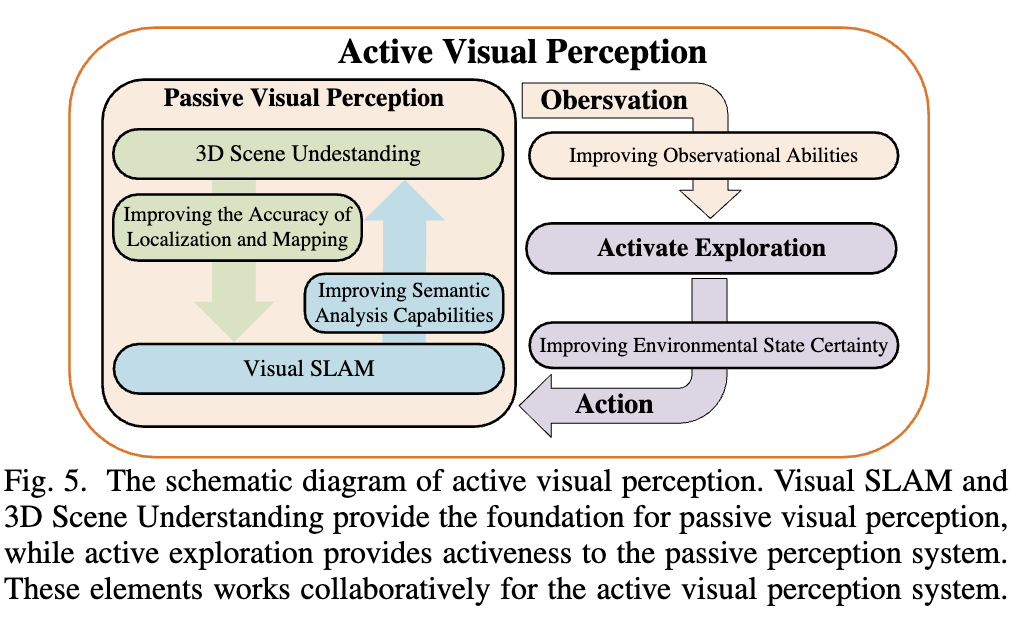

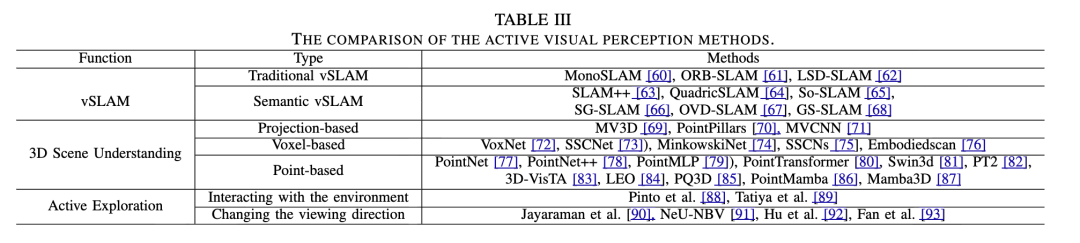

主动视觉感知系统需具备基础能力,如状态估计、场景感知和环境探索。如图5所示,这些能力已在视觉同步定位与建图(vSLAM)[94]、[95]、三维场景理解[96]和主动探索[11]等领域得到广泛研究。这些研究方向共同推动了鲁棒主动视觉感知系统的构建,助力智能体在复杂动态环境中实现更优的环境交互与导航。我们简要介绍这三个组成部分,并在表III中总结各部分提及的方法。

1)视觉同步定位与建图(Visual Simultaneous Localization and Mapping):

同步定位与建图(SLAM)旨在确定机器人在未知环境中的位置,同时构建该环境的地图[97]。基于测距的SLAM[98]、[99]依赖激光扫描仪、雷达、声纳等测距设备生成点云表示,但成本较高且环境信息有限。相比之下,视觉SLAM(vSLAM)[94]、[95]利用机载摄像头捕获图像帧并构建环境表示,优势包括硬件成本低、小规模场景精度高、可捕捉丰富的环境细节。

经典vSLAM可大致分为传统vSLAM和语义vSLAM[95]。传统vSLAM利用图像数据和多视角几何,通过滤波方法(如MonoSLAM[60])、关键帧方法(如ORB-SLAM[61])或直接跟踪技术(如LSD-SLAM[62])估计机器人位姿并构建低层级地图(如稀疏、半稠密或稠密点云)。但低层级地图与物体无直接对应关系,机器人难以解读和利用。语义vSLAM通过融合语义信息弥补这一缺陷,增强机器人在未知环境中感知与导航的能力。

2)三维场景理解:

三维场景理解[100]旨在从三维场景数据中识别物体语义、定位其空间位置并推断几何属性[101],是自动驾驶[102]、机器人导航[103]、人机交互[104]等领域的基础。场景数据可通过LiDAR或RGB-D传感器等三维扫描工具采集为点云。与图像不同,点云具有稀疏性、无序性和不规则性。当前深度学习在三维场景理解中的进展可分为三类:基于投影、基于体素和基于点的方法。

具体而言,基于投影的方法(如MV3D[69]、PointPillars[70]、MVCNN[71])将三维点投影到不同图像平面,使用2D CNN骨干网络提取特征;基于体素的方法将点云转换为规则体素网格,便于进行三维卷积运算(如VoxNet[72]、SSCNet[73]),部分工作通过稀疏卷积提升效率(如MinkowskiNet[74]、SSCNs[75]、Embodiedscan[76]);基于点的方法则直接处理点云数据(如PointNet[77]、PointNet++[78]、PointMLP[79])。

近期,为提升模型可扩展性,基于Transformer的架构(如PointTransformer[80]、Swin3d[81]、PT2[82]、3D-VisTA[83]、LEO[84]、PQ3D[85])和基于Mamba的架构(如PointMamba[86]、Mamba3D[87])相继涌现。其中,PQ3D[85]通过无缝融合点云、多视角图像和体素特征,显著提升场景理解能力。

3)主动探索:

三维场景理解方法使机器人能够被动感知环境,其信息获取和决策过程是静态的,不随场景变化而调整。因此,尽管被动感知必不可少,仍需通过主动探索加以补充,使机器人能够动态地与环境交互并感知周围世界。二者关系如图5所示。

当前主动感知方法主要聚焦于与环境交互[88]、[89],或通过改变视角获取更多视觉信息[90]–[93]。

例如,Pinto等人[88]提出了一种“好奇机器人”,通过与环境的物理交互学习视觉表征,而非仅依赖数据集的类别标签。为解决不同形态机器人间交互式物体感知的挑战,Tatiya等人[89]提出一个多阶段投影框架,通过已学习的探索性交互传递隐式知识。针对自主获取信息性观测的难题,Jayaraman等人[90]提出一种强化学习方法,智能体通过降低对未观测环境区域的不确定性,主动获取信息丰富的视觉观测。NeU-NBV[91]引入一种无地图规划框架,迭代调整RGB相机位置,以捕获未知场景中信息量最大的图像。Hu等人[92]开发了一种机器人探索算法,利用状态价值函数预测未来状态的价值。为应对开放世界环境中偶然输入的问题,Fan等人[93]将主动识别视为一个循序渐进的证据收集过程,在证据组合理论下提供逐步不确定性量化与可靠预测。

B. 视觉语言导航

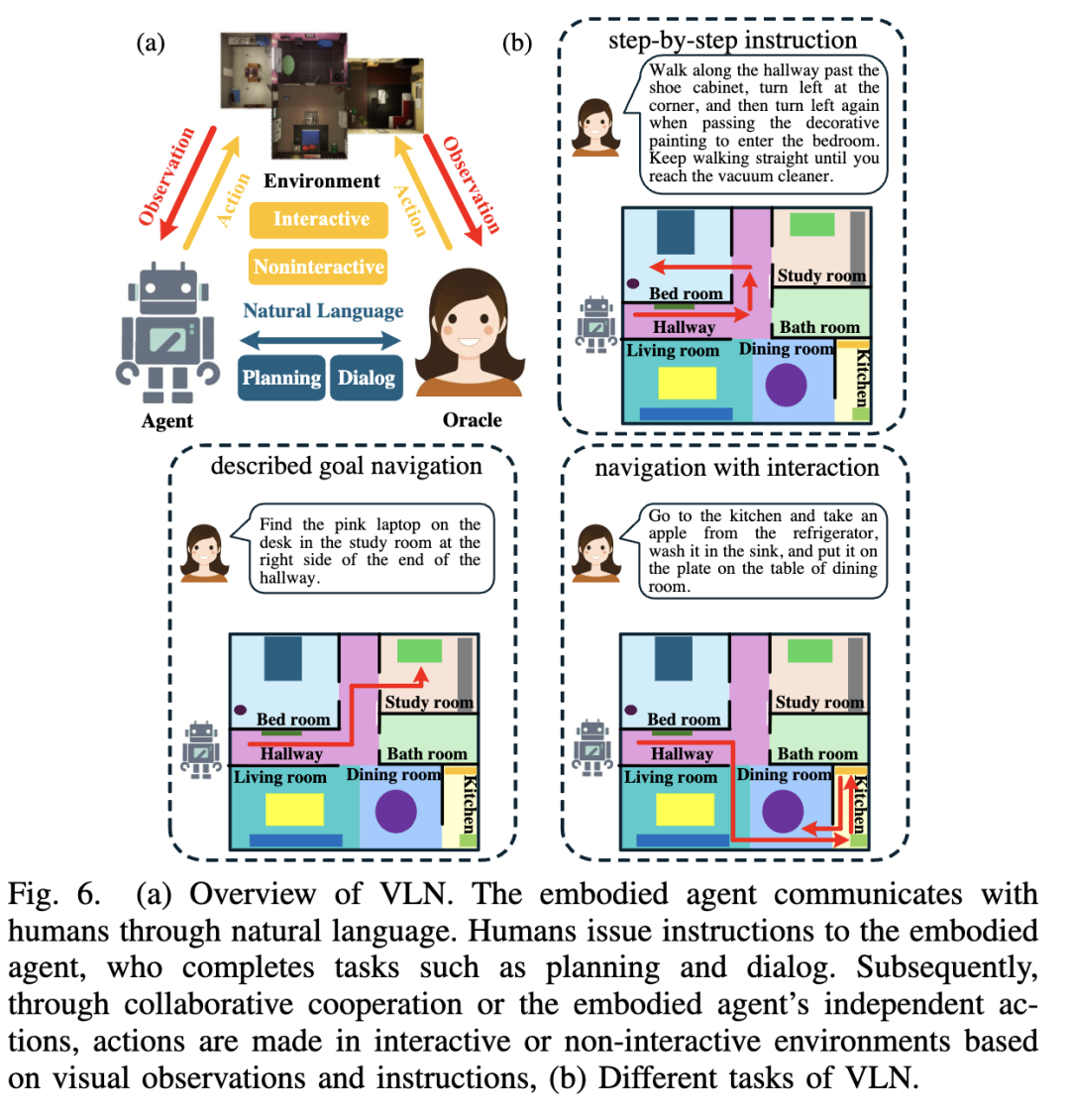

视觉语言导航(Visual Language Navigation, VLN)是一项关键任务,旨在根据语言指令在未知环境中进行导航。VLN要求机器人既能理解复杂多样的视觉观测,又能解析不同粒度的语言指令。输入通常包含两部分:视觉信息和自然语言指令。视觉信息可以是过去轨迹的视频,或一系列历史与当前观测图像;自然语言指令则包括智能体需到达的目标或需完成的任务。智能体必须利用上述信息,从候选动作列表中选择一个或一系列动作,以满足语言指令的要求。该过程可表示为:Action = M(O, H, I),其中 Action 是所选动作或候选动作列表,O 是当前观测,H 是历史信息,I 是自然语言指令。

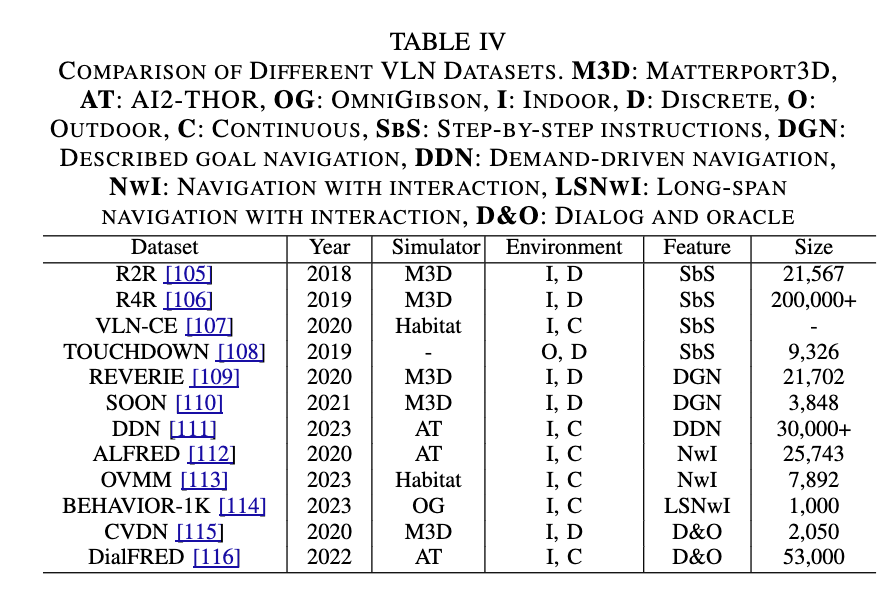

1)数据集:

在VLN任务中,自然语言指令可以是一系列详细的动作描述、完整描述的目标,或仅粗略描述的任务,甚至仅表达人类需求。具身智能体需要完成的任务可能仅为单次导航、带交互的导航,或需按顺序完成的多个导航任务。这些差异给VLN带来了不同挑战,因此构建了多种不同的数据集。基于这些差异,我们介绍一些重要的VLN数据集:

Room-to-Room(R2R)[105] 是基于Matterport3D的VLN数据集。在R2R中,具身智能体根据逐步指令,基于视觉观测选择下一个相邻导航图节点,直至抵达目标位置。

Room-for-Room(R4R)[106] 将R2R中的路径扩展为更长轨迹,要求具身智能体具备更强的长距离指令与历史对齐能力。

VLN-CE [107] 将R2R和R4R扩展至连续环境,具身智能体可在场景中自由移动。

与上述基于室内场景的数据集不同,TOUCHDOWN数据集[108] 基于Google街景构建。在TOUCHDOWN中,具身智能体需根据指令在纽约市街景渲染仿真环境中导航,寻找指定物体。

与R2R类似,REVERIE数据集[109] 也基于Matterport3D仿真器构建。REVERIE要求具身智能体根据简洁、人工标注的高层自然语言指令,准确定位远处不可见的目标物体。

在SOON [110] 中,智能体接收一条从粗到细的长而复杂的指令,在3D环境中寻找目标物体。导航过程中,智能体首先搜索较大区域,再根据视觉场景和指令逐步缩小搜索范围。

DDN [111] 更进一步,仅提供人类需求,不指定具体物体。智能体需在场景中导航,自主寻找符合需求的物体。

ALFRED数据集 [112] 基于AI2-THOR仿真器。在ALFRED中,具身智能体需理解环境观测,并根据粗粒度与细粒度指令在交互环境中完成家庭任务。

OVMM数据集 [113] 的任务是在任何未见过的环境中拾取任意物体并放置到指定位置。OVMM提供了基于Habitat的仿真环境及真实世界部署框架。

Behavior-1K数据集 [114] 基于人类需求构建,包含1000个长序列、复杂、依赖技能的日常任务。智能体需基于视觉信息和语言指令,完成包含数千个底层动作步骤的长跨度导航-交互任务,这对理解与记忆能力要求极高。

CVDN [115] 要求具身智能体基于对话历史导航至目标,并在不确定时主动提问以决定下一步动作。

DialFRED [116] 是ALFRED的扩展,允许智能体在导航与交互过程中提问以获得帮助。这些数据集引入了“问答先知”机制,要求具身智能体通过提问获取更多有助于导航的信息。

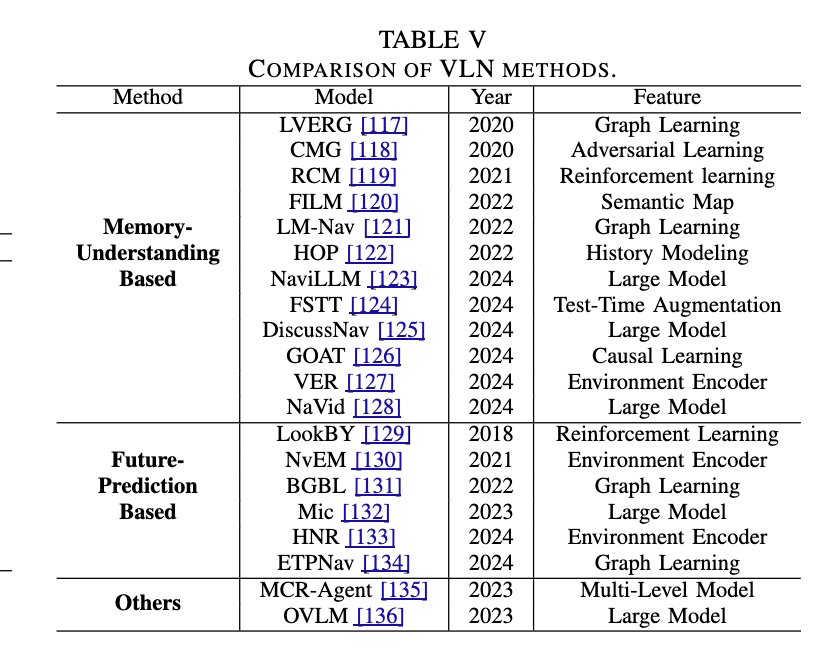

2)方法:

随着大语言模型(LLMs)性能的惊人提升,VLN领域近期取得巨大进展,其研究方向与重点也深受影响。尽管如此,当前VLN方法大致可分为两个方向:基于记忆理解的方法和基于未来预测的方法。

基于记忆理解的方法侧重于对环境的感知与理解,以及基于历史观测或轨迹的模型设计,属于“从过去学习”的方法。

基于未来预测的方法则更关注对未来状态的建模、预测与理解,属于“为未来学习”的方法。

由于VLN可被视为部分可观测马尔可夫决策过程(POMDP),未来观测依赖于当前环境与智能体的动作,因此历史信息对导航决策(尤其是长跨度导航)具有重要意义,故基于记忆理解的方法一直是VLN主流。然而,基于未来预测的方法仍具重要价值,其对环境本质的理解在连续环境中尤为关键。特别是随着“世界模型”概念的兴起,基于未来预测的方法正受到研究者越来越多的关注。

基于记忆理解的方法:

基于图的学习是记忆理解方法的重要组成部分。

它通常以图的形式表示导航过程,其中智能体在每个时间步获取的信息被编码为图中的节点。智能体通过获取全局或局部导航图信息,作为对历史轨迹的表征。LVERG [117] 分别对每个节点的语言信息和视觉信息进行编码,设计了一种新的语言与视觉实体关系图,用于建模文本与视觉之间的跨模态关系,以及视觉实体之间的模态内关系。LM-Nav [121] 利用目标条件距离函数推断原始观测集合之间的连接关系,构建导航图,并通过大语言模型(LLM)从指令中提取地标。尽管HOP [122] 并非基于图学习,但它要求在不同粒度上建模时序信息,从而实现对历史轨迹与记忆的深度理解。

导航图将环境离散化,但同时对环境进行同步理解与编码也至关重要。FILM [120] 利用RGB-D观测与语义分割,在导航过程中逐步从三维体素构建语义地图。VER [127] 通过二维-三维采样将物理世界量化为结构化的三维单元,提供细粒度的几何细节与语义信息。

不同的学习方案探索如何更有效地利用历史轨迹与记忆。通过对抗学习,CMG [118] 在模仿学习与探索激励策略之间交替进行,有效增强了对指令与历史轨迹的理解,缩小了训练与推理之间的差距。GOAT [126] 通过“后门调整因果学习”(BACL)与“前门调整因果学习”(FACL)直接训练无偏模型,并结合视觉、导航历史及其与指令的对比学习,使智能体能更充分地利用信息。RCM [119] 提出的增强跨模态匹配方法,利用面向目标的外部奖励与面向指令的内部奖励,在全局与局部层面执行跨模态对齐,并通过自监督模仿学习从自身历史优质决策中学习。FSTT [124] 将测试时自适应(TTA)引入VLN,在时间步与任务两个尺度上对梯度与模型参数进行优化,有效提升模型性能。

大模型在基于记忆理解方法中的具体应用,是理解历史记忆的表征,并基于其丰富的世界知识理解环境与任务。NaviLLM [123] 通过视觉编码器将历史观测序列整合到嵌入空间,将融合编码后的多模态信息输入大语言模型并进行微调,在多个基准测试中达到最先进水平。NaVid [128] 改进了历史信息的编码方式,通过对历史观测与当前观测采用不同程度的池化操作,实现不同程度的信息保留。LH-VLN [137] 提出了NavGen平台、长视野导航基准测试与多粒度动态记忆(MGDM)模块,以增强在动态环境中的任务评估与模型适应能力。

基于未来预测的方法:

图学习在基于未来预测的方法中也被广泛使用。BGBL [131] 与 ETPNav [134] 采用了类似方法,设计了一个路径点预测器,可根据当前导航图节点的观测,在连续环境中预测可移动路径点。其目标是将连续环境中的复杂导航迁移为离散环境中的节点到节点导航,从而弥合离散环境与连续环境之间的性能差距。

通过环境编码提升对未来环境的理解与感知,也是预测与探索未来的研究方向之一。NvEM [130] 使用主题模块与参考模块,从全局与局部视角对邻近视图进行融合编码,这实际上是对未来观测的理解与学习。HNR [133] 使用大规模预训练的分层神经辐射表征模型,直接通过三维特征空间编码预测未来环境的视觉表征(而非像素级图像),并基于未来环境表征构建可导航的未来路径树。它们从不同层次预测未来环境,为导航决策提供有效参考。

部分强化学习方法也被用于预测与探索未来状态。LookBY [129] 采用强化预测,使预测模块能够模仿世界并预测未来状态与奖励,从而使智能体能直接将“当前观测”与“未来观测预测”映射为动作,在当时达到最先进性能。大模型丰富的世界知识与零样本能力,为基于未来预测的方法提供了诸多可能性。MiC [132] 要求大语言模型直接从指令中预测目标及其可能位置,并通过场景感知描述提供导航指令。该方法要求大语言模型充分发挥其“想象力”,通过提示构建想象场景。

此外,还有一些方法兼顾从过去学习与为未来学习。MCR-Agent [135] 设计了三层动作策略,要求模型从指令中预测目标、为目标交互预测像素级掩码,并从先前导航决策中学习;OVLM [136] 要求大语言模型为指令预测对应的操作与地标序列。在导航过程中,视觉语言地图将持续更新与维护,操作将与地图上的路径点相关联。

V、具身交互

具身交互是指智能体在物理或仿真空间中与人类及环境进行交互的场景。典型的具身交互任务包括具身问答(Embodied Question Answering, EQA)和具身抓取。

A. 具身问答

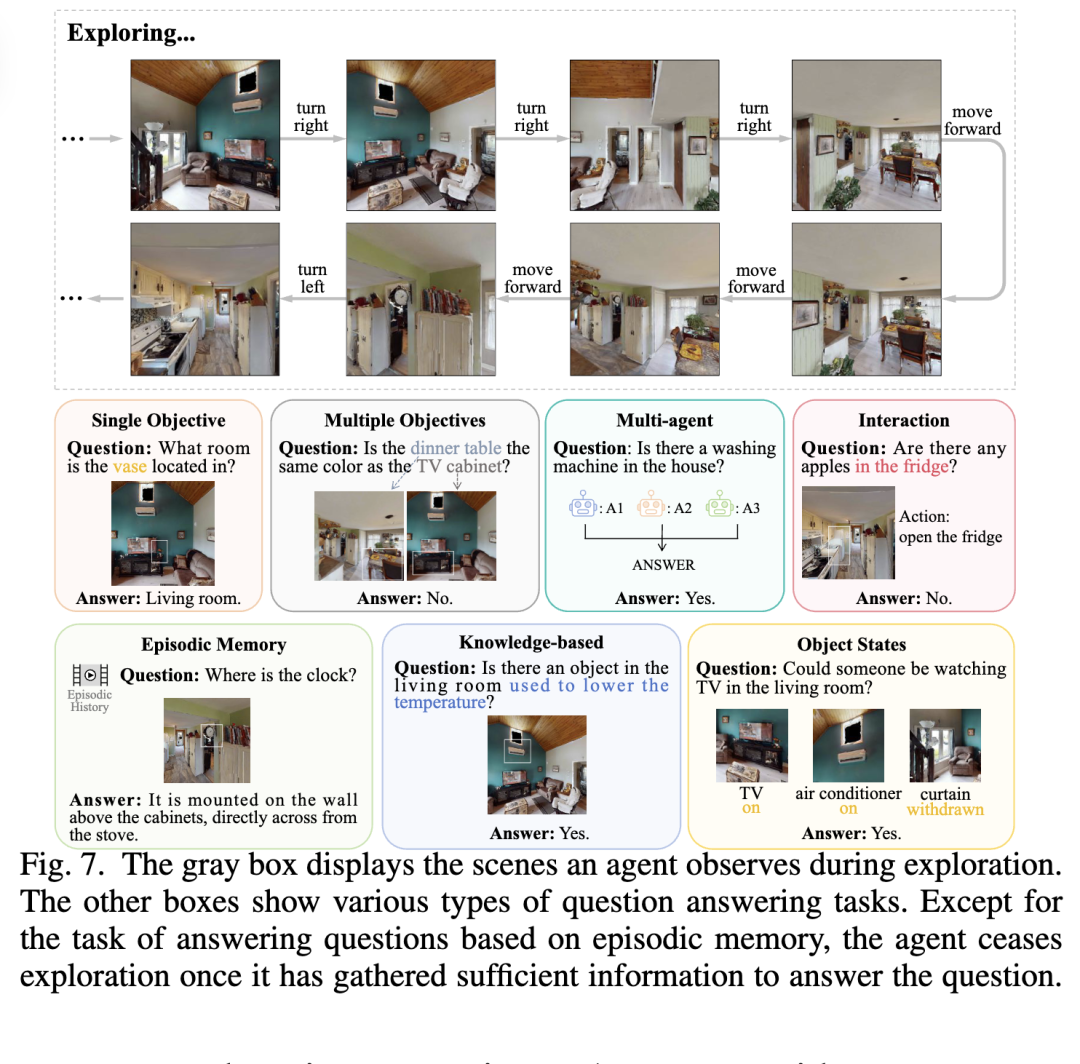

在EQA任务中,智能体需以第一人称视角探索环境,收集回答给定问题所需的信息。具备自主探索与决策能力的智能体不仅需考虑采取哪些动作以探索环境,还需判断何时停止探索并回答问题。现有研究聚焦于不同类型的问题,部分问题示例如图7所示。本节将介绍现有数据集,讨论相关方法,描述用于评估模型性能的指标,并指出该任务仍存在的局限性。

1)数据集:

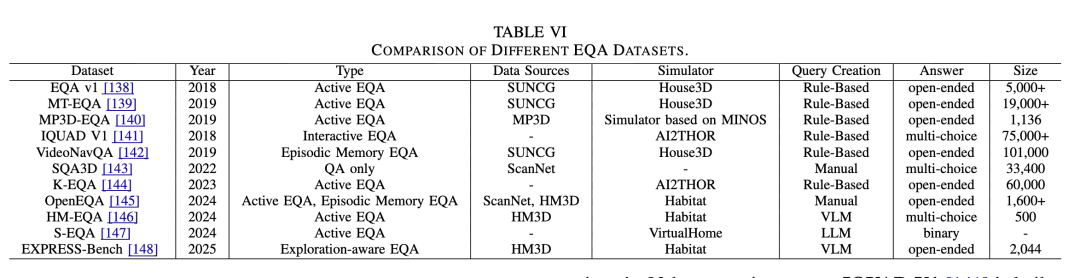

我们简要介绍若干具身问答数据集,汇总见表VI。

EQA v1 [138] 是首个专为EQA设计的数据集,基于House3D [149] 仿真器中的SUNCG数据集 [73] 合成3D室内场景构建,包含四类问题:位置、颜色、颜色房间、介词关系。类似地,MT-EQA [139] 同样在House3D中基于SUNCG构建,通过执行由基础操作组成的函数程序生成,但进一步将单目标问答任务扩展至多目标场景,设计了六类问题,涉及多个物体间颜色、距离与尺寸的比较。

MP3D-EQA [140] 基于MINOS [150] 仿真器开发,使用Matterport3D数据集 [151],将问答任务扩展至真实感3D环境。参考EQA v1,MP3D-EQA采用三类模板:位置、颜色、颜色房间,在83个家居环境中生成共1,136个问题。

IQUAD V1 [141] 基于AI2-THOR构建,包含三类问题:存在性、计数、空间关系。与其他数据集不同,回答IQUAD V1的问题要求智能体具备良好的功能理解能力,并能与动态环境交互。

VideoNavQA [142] 将视觉推理与EQA任务中的导航部分解耦。在该任务中,智能体访问与探索轨迹对应的视频,这些视频包含足以回答问题的信息。

SQA3D [143] 简化了协议(仅保留问答),但仍保留了评估具身场景理解能力的功能,支持更复杂、知识密集型的问题,并实现更大规模的数据收集。

与以往明确在问题中指定目标物体的数据集不同,K-EQA [144] 包含带有逻辑从句和知识相关短语的复杂问题,需依赖先验知识才能作答。

OpenEQA [145] 是首个支持开放词汇的EQA数据集,同时支持情景记忆型与主动探索型任务。情景记忆EQA(EM-EQA)任务中,智能体需基于其情景记忆理解环境以回答问题;主动EQA(A-EQA)任务中,智能体通过执行探索动作收集必要信息以回答问题。

利用GPT-4V,HM-EQA [146] 在Habitat仿真器中基于HM3D构建,包含267个不同场景中的500个问题,大致可分为识别、计数、存在性、状态和位置五类。

S-EQA [147] 利用GPT-4在VirtualHome中生成数据,并通过余弦相似度计算决定是否保留生成数据,从而增强数据集多样性。在S-EQA中,回答问题需评估一组共识对象与状态,最终得出“是/否”类存在性答案。

EXPRESS-Bench [148] 是目前最大的探索感知型EQA数据集,包含777条探索轨迹和2,044个样本,并引入新颖评估指标以确保评估结果真实可靠。

2)方法:

具身问答任务主要涉及导航与问答两个子任务,实现方法大致可分为两类:基于神经网络的方法和基于大语言模型/视觉语言模型(LLMs/VLMs)的方法。

神经网络方法:

早期研究主要通过构建深度神经网络解决具身问答任务,采用模仿学习、强化学习等技术对模型进行训练与微调以提升性能。

EQA任务最早由Das等人[138]提出。其工作中,智能体包含四个主要模块:视觉、语言、导航与问答,这些模块主要由传统神经网络构件(如CNN和RNN)构建。后续部分研究[152]保留了Das等人[138]提出的问答模块并加以改进。此外,Wu等人[152]提出将导航与问答模块整合到统一的SGD训练流程中进行联合训练,从而避免使用深度强化学习分别训练两个模块。从任务单一性角度出发,部分研究[153]分别将任务扩展至多目标与多智能体场景,要求模型通过特征提取、场景重建等方法存储并整合智能体探索获得的信息。考虑到智能体与动态环境的交互,Gordon等人[141]引入了分层交互记忆网络。早期工作还存在一个局限:智能体无法利用外部知识回答复杂问题,且缺乏对已探索场景部分的知识。为此,Tan等人[144]采用神经程序合成方法,结合从知识与3D场景图转换而来的表格,使动作规划器可访问物体相关信息,并采用基于蒙特卡洛树搜索(MCTS)的方法确定智能体下一步应前往的位置。

LLMs/VLMs方法: Majumdar等人[145] 在情景记忆EQA(EM-EQA)和主动EQA(A-EQA)任务中应用了LLMs和VLMs。在EM-EQA任务中,他们分别测试了“盲LLM”、带情景记忆语言描述的“苏格拉底式LLM”、带构建场景图描述的“苏格拉底式LLM”,以及处理多帧场景图像的VLM。A-EQA任务在EM-EQA方法基础上,引入前沿探索(Frontier-Based Exploration, FBE)[154] 进行与问题无关的环境探索。部分研究[146]、[155] 采用前沿探索方法识别后续探索区域并构建语义地图,同时利用保形预测或图像-文本匹配提前终止探索,避免过度探索。

Patel等人[156] 更侧重任务中的问答部分,利用多个基于LLM的智能体探索环境,并使它们独立回答“是/否”类问题,再利用这些个体响应训练一个“中央答案模型”,聚合响应并生成鲁棒答案。

3)局限性:

a) 数据集:构建数据集需耗费大量人力与资源,目前大规模数据集仍较少,且不同数据集评估模型性能的指标不一,导致性能测试与比较困难。

b) 模型:尽管LLMs带来了显著进步,当前模型性能仍远落后于人类水平。未来研究可更关注如何有效存储智能体探索获得的环境信息,并引导其基于环境记忆与问题规划动作,同时提升其动作的可解释性。

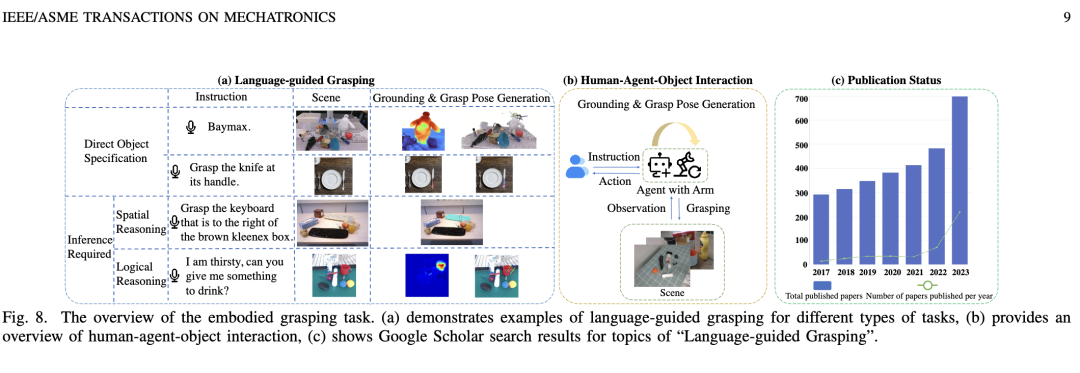

B. 具身抓取

具身交互不仅包括问答,还包括根据人类指令执行如抓取和放置物体等任务。具身抓取将传统运动学方法[157]、[158]与大模型(如大语言模型和视觉语言模型)相结合,实现多感官感知与推理,以完成任务执行。图8(b)展示了人-智能体-物体交互的概览,其中包含具身抓取操作。

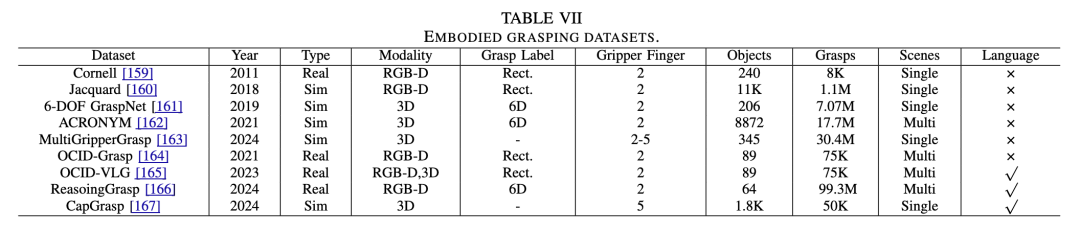

1)数据集:近年来,大量抓取数据集[159]–[163]被构建出来。这些数据集通常包含基于图像(RGB、深度图)、点云或3D场景标注的抓取数据。随着多模态大模型(MLMs)的发展以及基础语言模型在机器人抓取中的应用,迫切需要包含语言文本的数据集。因此,现有数据集被扩展或重构,形成了语义抓取数据集[165]–[167]。这些数据集对研究语言接地的抓取模型至关重要,使智能体能够建立对语义的广泛理解。

传统抓取数据集涵盖单物体[159]和杂乱场景[164]的数据,为每个物体提供符合运动学约束的稳定抓取标注(4自由度或6自由度)。这些数据可从真实桌面环境采集[159],通常包括RGB图像、深度图和点云数据;或从虚拟环境采集[162],包括图像数据、点云或场景模型。尽管这些数据集对抓取模型有用,但缺乏语义信息。为弥补这一空白,这些数据集通过添加语义表达进行了增强或扩展[165]、[168],从而将语言、视觉与抓取关联起来。通过引入语义信息,智能体能更好地理解和执行抓取任务。这一增强使得开发更复杂、具备语义感知能力的抓取模型成为可能,从而实现与环境更直观、高效的交互。表VII列出了上述数据集,包括传统抓取数据集和基于语言的抓取数据集。

2)语言引导抓取:由上述融合演化而来的“语言引导抓取”概念[165]、[166]、[168],结合多模态大模型,赋予智能体语义场景推理能力,使其能根据显式或隐式人类指令执行抓取操作。图8(c)展示了近年来语言引导抓取领域的论文发表趋势。随着大语言模型(LLMs)的发展,研究者对该主题的兴趣日益增长。当前,抓取研究越来越关注开放世界场景,强调开放集泛化方法[169]。通过利用MLMs的泛化能力,机器人可在开放世界环境中更智能、高效地执行抓取任务。

在语言引导抓取中,语义信息可来源于显式指令[169]、[170]或隐式指令[166]、[167]。显式指令明确指定需抓取物体的类别,如“香蕉”或“苹果”。而隐式指令则需通过推理识别待抓取的物体或其部分,涉及空间推理与逻辑推理。

空间推理[165]指指令中可能包含待抓取物体或其部分的空间关系,需根据场景内物体的空间布局推断抓取姿态。例如,“抓取棕色纸巾盒右侧的键盘”,要求理解并推断物体的空间排列关系。

逻辑推理[166]则指指令中可能包含需推理才能理解人类意图的逻辑关系,进而抓取目标物。例如,“我口渴了,你能给我点喝的吗?”,智能体需推断并递上一杯水或一瓶饮料,并确保在递送过程中液体不洒出,从而生成合理的抓取姿态。

在这两种情况下,语义理解与空间/逻辑推理的结合,使智能体能够高效、准确地执行复杂的抓取任务。图8(a)展示了多种语言引导抓取任务类型。

3)端到端方法:CLIPORT [168] 是一种语言条件模仿学习智能体,结合视觉语言预训练模型CLIP与Transporter Net,构建端到端双流架构,实现语义理解与抓取生成。它利用从虚拟环境中采集的大量专家演示数据进行训练,使智能体能够执行语义引导的抓取。

基于OCID数据集,CROG [165] 提出了一个视觉-语言-抓取数据集,并引入了一个具有竞争力的端到端基线模型。该方法利用CLIP的视觉基础能力,直接从图像-文本对中学习抓取合成。

Reasoning Grasping [166] 提出了首个基于GraspNet-1Billion数据集的推理抓取基准数据集,并构建了一个端到端推理抓取模型。该模型将多模态大语言模型与基于视觉的机器人抓取框架结合,根据语义与视觉信息生成抓取动作。

SemGrasp [167] 是一种基于语义的抓取生成方法,将语义信息融入抓取表征中,以生成灵巧的手部抓取姿态。它引入了一种离散表征,将抓取空间与语义空间对齐,从而根据语言指令生成抓取姿态。

4)模块化方法:F3RM [169] 旨在将CLIP的文本-图像先验知识提升至3D空间,利用提取的特征进行语言定位,随后生成抓取动作。该方法结合了2D基础模型提供的丰富语义与精确的3D几何信息,利用CLIP提取的特征,通过自由文本自然语言指定待操作物体,展现出对未见表达和新物体类别的泛化能力。

GaussianGrasper [170] 利用3D高斯场实现语言引导抓取任务。其方法首先构建3D高斯场,然后进行特征蒸馏;接着基于提取的特征执行语言定位;最后基于当前最先进的预训练抓取网络[171]生成抓取姿态。该方法融合了开放词汇语义与精确几何信息,实现基于语言指令的抓取。

这些方法通过端到端或模块化框架推进了语言引导抓取的发展,提升了机器人智能体根据自然语言指令执行复杂抓取任务的能力。具身抓取增强了机器人在家庭服务与工业制造中的智能性与实用性。然而,当前方法仍存在局限,如依赖大量数据、泛化能力差等。未来研究旨在提升智能体的通用性,使其能理解复杂语义、抓取各种未见物体,并应对更复杂的任务。

VI 、具身智能体

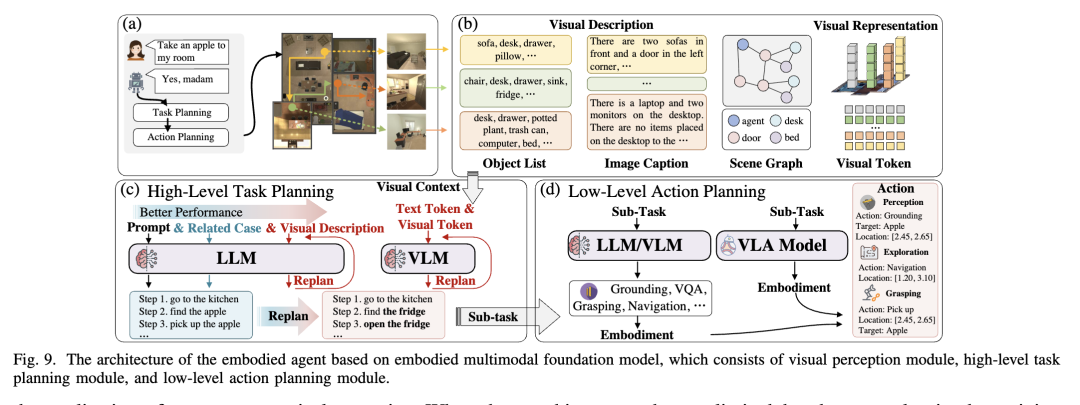

智能体被定义为一种能够感知环境并采取行动以实现特定目标的自主实体。随着多模态大模型(MLMs)的最新进展,智能体的应用已进一步拓展至实际场景。当这些基于MLM的智能体被赋予物理实体(即“具身化”),它们便能将其能力从虚拟空间有效迁移至物理世界,从而成为具身智能体[172]。为使具身智能体能在信息丰富且复杂的现实世界中运作,其已被发展出强大的多模态感知、交互与规划能力,如图9所示。要完成一项任务,具身智能体通常需经历以下过程:1)将抽象复杂的任务分解为具体子任务,称为高层具身任务规划;2)通过有效利用具身感知与具身交互模型,或借助基础模型的策略功能,逐步执行这些子任务,称为低层具身动作规划。值得注意的是,任务规划强调“先思考再行动”,因此通常在虚拟空间(网络空间)中进行;而动作规划则必须考虑与环境的有效交互,并将交互反馈信息回传给任务规划器以调整任务规划。因此,具身智能体能否将其能力从网络空间对齐并泛化至物理世界至关重要。

A. 具身任务规划

传统的具身任务规划方法通常基于显式规则与逻辑推理。例如,使用PDDL[173]等符号规划算法,或MCTS[174]、A*[175]等搜索算法生成规划。然而,这些方法往往依赖预定义的规则、约束与启发式策略,结构僵化,难以适应动态或未预见的变化。随着大语言模型(LLMs)的普及,许多研究尝试利用LLMs进行规划,或将传统方法与LLMs结合,借助其丰富的内嵌世界知识进行推理与规划,无需人工定义规则,极大增强了模型的泛化能力。

1)利用LLMs的涌现能力进行规划:在自然语言模型规模扩大之前,任务规划器通常通过在具身指令数据集(如Alfred[176]和Alfworld[177])上训练BERT等模型实现,如FILM[178]所示。但该方法受限于训练集样本,难以有效对齐物理世界。如今,得益于LLMs的涌现能力,它们可利用其内部世界知识与思维链推理,将抽象任务分解为步骤,类似于人类在行动前推理任务完成流程。例如,Translated LM[179]和Inner Monologue[180]无需额外训练,即可利用其内在逻辑与知识系统将复杂任务分解为可管理步骤并制定解决方案。类似地,多智能体协作框架ReAd[181]通过不同提示词高效自我优化规划。另有研究将过去成功案例抽象为一系列技能,存储于记忆库中,在推理时调用以提高规划成功率[182]–[184]。部分工作使用代码而非自然语言作为推理媒介,根据可用API库将任务规划生成为代码[185]、[186]。此外,多轮推理可有效纠正任务规划中潜在的幻觉。例如,Socratic Models[187]和Socratic Planner[188]通过苏格拉底式提问推导出可靠的规划。

然而,在任务规划过程中,执行阶段可能出现潜在失败,通常源于规划器未能充分考虑现实环境的复杂性与任务执行难度[180]、[189]。由于缺乏视觉信息,规划的子任务可能偏离实际场景,导致任务失败。因此,有必要在规划或执行过程中融入视觉信息进行重规划。该方法可显著提升任务规划的准确性与可行性,更好地应对现实环境挑战。

2)利用具身感知模型提供的视觉信息进行规划:基于上述讨论,在任务规划(或重规划)中融入视觉信息至关重要。在此过程中,视觉输入提供的物体标签、位置或描述可为LLMs的任务分解与执行提供关键参考。通过视觉信息,LLMs能更准确识别当前环境中的目标物体与障碍物,从而优化任务步骤或调整子任务目标。部分研究在任务执行过程中使用物体检测器查询环境中存在的物体,并将该信息反馈给LLM,使其修正当前规划中不合理的步骤[187]、[189]、[190]。RoboGPT[8]考虑了同一任务中相似物体的不同名称,进一步提升了重规划的可行性。然而,仅靠标签提供的信息仍过于有限——能否提供更丰富的场景信息?SayPlan[191]提出使用分层3D场景图表示环境,有效缓解了在大型、多楼层、多房间场景中任务规划的挑战。类似地,ConceptGraphs[192]也采用3D场景图向LLMs提供环境信息。相比SayPlan,它提供更细致的开放世界物体检测,并以代码格式呈现任务规划,效率更高,更适配复杂任务需求。

然而,有限的视觉信息可能导致智能体对环境理解不足。尽管LLMs获得视觉线索,它们仍常无法捕捉环境的复杂性与动态变化,从而产生误解并导致任务失败。例如,若毛巾被锁在浴室柜中,智能体可能反复搜索浴室而未考虑这种可能性[8]。为此,必须开发更鲁棒的算法,融合多感官数据以增强智能体对环境的理解。此外,即使视觉信息有限,利用历史数据与上下文推理也能辅助智能体做出合理判断与决策。这种多模态融合与上下文推理方法不仅能提高任务执行成功率,也为具身人工智能的发展提供了新视角。

3)利用视觉语言模型(VLMs)进行规划:相比通过外部视觉模型将环境信息转化为文本,VLM模型可在潜在空间中捕捉视觉细节,特别是那些难以用物体标签表达的上下文信息。VLM能够识别视觉现象背后的规律;例如,即使环境中未直接看到毛巾,也可推断毛巾可能存放在柜子中。这一过程本质上体现了抽象视觉特征与结构化文本特征在潜在空间中更有效的对齐。在EmbodiedGPT[193]中,Embodied-Former模块对齐具身、视觉与文本信息,在任务规划中有效考虑智能体状态与环境信息。与EmbodiedGPT直接使用第三人称视角图像不同,LEO[194]将2D第一人称图像与3D场景编码为视觉令牌,有效感知3D世界信息并据此执行任务。类似地,EIF-Unknow模型利用从体素特征提取的语义特征图作为视觉令牌,与文本令牌一同输入训练好的LLaVA模型进行任务规划[195]。此外,如RT系列[2]、[9]、PaLM-E[196]、Matcha[197]等研究中,具身多模态基础模型(或称VLA模型)通过大规模数据集训练,实现了在具身场景中视觉与文本特征的对齐。

然而,任务规划仅是智能体完成指令任务的第一步,后续的动作规划才决定任务能否真正完成。在RoboGPT[8]的实验中,任务规划准确率达96%,但整体任务完成率仅为60%,受限于低层规划器性能。因此,具身智能体能否从“想象如何完成任务”的网络空间,过渡到“与环境交互并完成任务”的物理世界,关键在于有效的动作规划。

B. 具身动作规划

任务规划与动作规划的区别在于,动作规划必须应对现实世界的不确定性,因为任务规划的子任务粒度往往不足[198]。动作规划可通过以下方式实现:1)使用预训练具身模型通过API完成子任务;或2)利用VLA模型的能力。动作规划的结果将反馈以优化任务规划。

1)利用API执行动作:常见方法是为LLMs提供经过良好训练的策略模型定义,使其理解并有效调用这些模型完成特定任务[189]、[199]。通过生成代码,LLMs可将工具抽象为函数库,更好地处理子任务[186]。Reflexion[200]在执行过程中动态调整这些工具以提升泛化能力。DEPS[201]使LLMs通过零样本学习掌握并组合多种技能。分层规划范式通过将高层任务规划与具体动作执行(通过策略模型)分离,简化了开发流程。这种模块化设计允许各部分独立开发、测试与优化,提高系统灵活性与可维护性。虽然该方法支持适应多种任务与环境,但对外部策略模型的依赖可能引入延迟并影响性能,因此这些模型的质量对整体智能体效能至关重要。

2)利用VLA模型执行动作:与前述“任务规划与动作执行在同一系统内完成”的方法不同,该范式利用具身多模态基础模型的能力进行规划与执行,减少通信延迟,提高系统响应速度与效率。在VLA模型中,感知、决策与执行模块的紧密集成使系统能更高效处理复杂任务并适应动态环境变化。这种集成还支持实时反馈,使智能体可自我调整策略,从而增强任务执行的鲁棒性与适应性[10]、[193]、[202]。然而,该范式无疑更复杂且成本更高,尤其在处理复杂或长期任务时。此外,一个关键问题是:若无具身世界模型,仅靠LLM的内部知识,动作规划器无法模拟物理规律,这限制了智能体在物理世界中准确高效完成各类任务的能力,阻碍了从网络空间到物理世界的无缝迁移。

3)在多样化环境中的可扩展性:具身智能体的可扩展性指其通过鲁棒感知、高效决策与资源优化,适应更大、更多样化环境中复杂性提升的能力。相关策略包括:用于建图的分层SLAM、多模态感知、能效优化的边缘计算。通过多智能体系统与去中心化通信可增强协作可扩展性,而泛化能力则依赖领域自适应技术,使其能在新环境中运行。

VII、仿真到现实迁移

具身人工智能中的“仿真到现实迁移”(Sim-to-Real Adaptation)是指将在仿真环境(网络空间)中学习到的能力或行为迁移到现实世界场景(物理世界)的过程。它涉及对在仿真中开发的算法、模型和控制策略进行验证与改进,以确保其在物理环境中具备鲁棒性和可靠性。为实现仿真到现实迁移,具身世界模型、数据采集与训练方法、以及具身控制算法是三个核心组成部分。

A. 具身世界模型

仿真到现实迁移需要构建高度逼近真实世界环境的基于仿真的世界模型。这些模型通过预测下一状态来辅助决策,且通常从零开始在物理世界数据上训练,与VLA模型(在大规模数据集上预训练后再用现实数据微调)不同。世界模型在结构化任务(如自动驾驶、物体分拣)中表现良好,但在非结构化、复杂任务中适用性较弱。

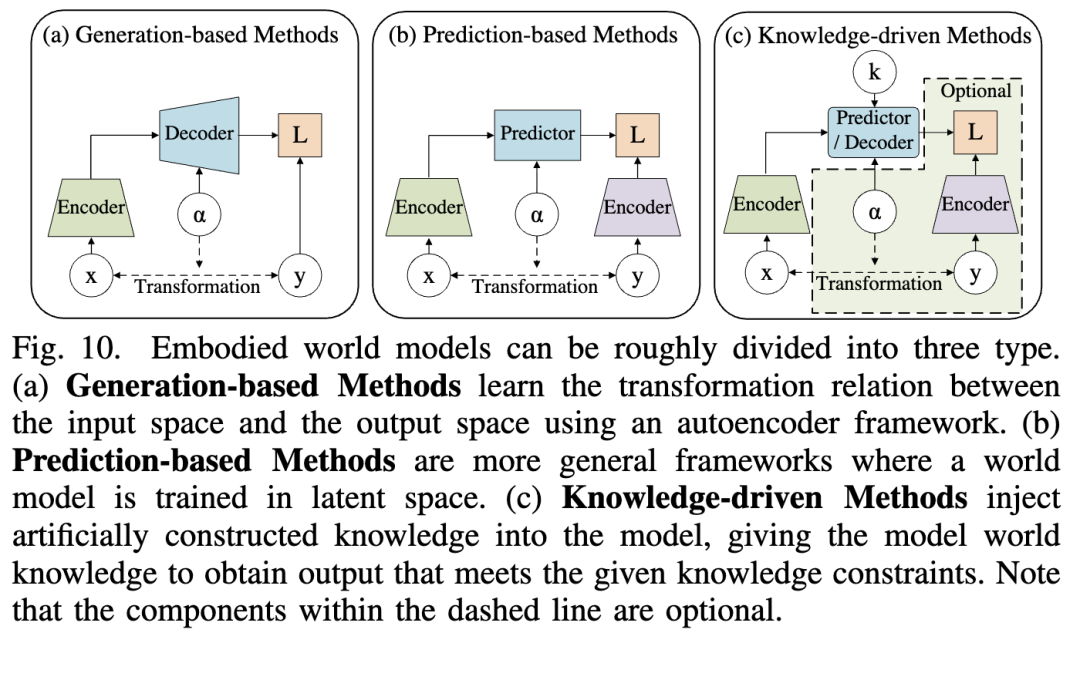

学习世界模型在物理仿真领域展现出巨大前景。相比传统仿真方法,它具有显著优势,例如:能够在信息不完整时推理交互关系、满足实时计算需求、并随时间推移不断提高预测精度。此类世界模型的预测能力至关重要,使机器人能够发展出在人类世界中运作所需的物理直觉。如图10所示,根据世界环境的学习流程,世界模型可分为三类:基于生成的方法、基于预测的方法和知识驱动的方法。

1)基于生成的方法:随着模型规模和数据量的增长,生成模型已展现出理解并生成符合物理规律的图像(如World Models [203])、视频(如Sora [16]、Pandora [204])、点云(如3D-VLA [205])或其他格式数据(如DWM [206])的能力。这表明生成模型能够内化世界知识。具体而言,在接触大规模数据后,这些模型不仅能捕捉统计特性,还能通过其内在结构模拟物理与因果关系。因此,生成模型不仅是模式识别工具,更展现出世界模型的特征。

这些模型中内嵌的世界知识可用于增强其他模型的性能。利用该知识,我们可以提升模型的泛化能力、鲁棒性、对新环境的适应性,以及在未见数据上的预测准确性[204]、[205]。然而,生成模型也存在一定局限与缺陷。例如,在面对数据分布偏差或训练数据不足时,可能生成不准确或失真的输出。此外,这些模型训练需耗费大量计算资源与时间,且常缺乏可解释性,阻碍实际应用。尽管生成模型在生成符合物理规律的内容方面已展现潜力,但要实现更广泛应用,仍需解决效率提升、可解释性增强和数据偏差缓解等挑战。持续研究有望进一步释放这些模型的价值与潜力。

2)基于预测的方法:基于预测的世界模型通过构建并利用内部表征来预测和理解环境。它根据给定条件在潜在空间中重建相应特征,从而捕捉更深层的语义与关联的世界知识。该模型将输入信息映射到潜在空间,并在该空间内操作以提取和利用高层语义信息,从而使机器人能够感知世界环境的本质表征(如I-JEPA [15]、MC-JEPA [207]、A-JEPA [208]、Point-JEPA [209]、IWM [210]),并更准确地执行具身下游任务(如iVideoGPT [211]、IRASim [212]、STP [213]、MuDreamer [214])。与像素级信息不同,潜在特征可抽象并解耦各类知识,使模型更有效地处理复杂任务与场景,同时增强泛化能力[215]。

例如在时空建模中,世界模型通过整合物体当前状态、交互性质及内部知识,预测其交互后的状态。具体而言,具身世界模型通过结合感知信息与先验知识生成动态环境预测,依赖感官数据与固有世界知识准确推断并预测环境变化[211]、[213]、[214]。该过程同时考虑物体的当前状态及其历史与上下文信息。

类似地,利用其表征中内嵌的世界知识,可进一步增强模型的感知能力与鲁棒性[15]、[207]、[210]、[216]。通过在潜在空间中操作,预期机器人能以更低的成本在不同环境中保持高性能[214]。该方法的关键在于抽象处理与知识解耦,从而高效适应复杂情境。然而,此类模型在面对前所未见的环境与条件时,可能表现出局限性与不稳定性。此外,潜在空间中解耦的世界知识可能存在可解释性问题。

3)知识驱动的方法:知识驱动的世界模型通过向模型注入人工构建的知识,赋予其世界知识。该方法在具身人工智能领域展现出广泛的应用潜力。例如,在real2sim2real方法[217]中,利用现实世界知识构建符合物理规律的仿真器,再用于训练机器人,从而增强模型的鲁棒性与泛化能力。此外,人工构建常识或符合物理规律的知识并将其应用于生成模型或仿真器,是一种常见策略(如ElastoGen [218]、One-2-3-45 [219]、PLoT [220])。该方法对模型施加更精确的物理约束,提升其在生成任务中的可靠性与可解释性。这些约束确保模型知识既准确又一致,减少训练与应用过程中的不确定性。

部分方法将人工构建的物理规则与LLMs或MLMs结合。通过利用LLMs和MLMs的常识能力,这些方法(如Holodeck [56]、LEGENT [221]、GRUtopia [222])通过自动空间布局优化生成多样且语义丰富的场景,极大推动了通用具身智能体的发展——使其能在新颖多样的环境中训练。

4)局限性:当前世界模型的局限性包括:难以应对现实世界环境的复杂性与多样性,如高维感官输入、动态与随机元素、长期依赖关系等。许多模型在面对未见场景时泛化能力不足,往往需要大量训练数据与计算资源。此外,仿真到现实迁移仍存在问题,因为仿真环境无法完全捕捉现实世界的物理规律与噪声。

这些局限可通过以下方式缓解:整合更逼真的仿真器、引入多模态感官输入、采用分层或模块化架构。提高数据效率、增强迁移学习技术、引入现实世界先验知识,也有助于实现更精确的预测与自适应决策。

近期,NVIDIA提出了Cosmos平台[223],该平台包含用于“文本到世界”和“视频到世界”生成的自回归模型与扩散模型,旨在加速物理AI系统的开发。这或许能为我们构建具身世界模型提供一些启发。

B. 数据采集与训练

对于仿真到现实迁移,高质量数据至关重要。传统数据采集方法依赖昂贵设备和精确操作,耗时且劳动密集。近年来,已提出一些高效且低成本的方法用于采集高质量演示数据并进行训练。我们分别讨论在现实世界与仿真环境中的数据采集方法。

1)现实世界数据:使用丰富数据集训练大容量模型已取得巨大成功,这一方法在机器人领域同样前景广阔——大规模、多样化的数据集可增强模型的泛化能力与适应性。Open X-Embodiment [202] 提供了来自22台机器人、涵盖527种技能、160,266项家庭场景任务的数据。UMI [224] 提供了一个使用手持夹爪采集动态双手操作数据的框架。Mobile ALOHA [225] 支持全身移动操作任务的数据采集。人机协作方法 [226] 通过结合人类输入与智能体优化过程,提升数据质量与采集效率。

2)仿真数据:现实世界中的数据采集资源密集、耗时费力,因此基于仿真的数据采集成为极具吸引力的替代方案。仿真环境支持自动化、高效率的数据采集。例如,CLIPORT [168] 和 Transporter Networks [227] 利用PyBullet仿真器数据进行训练,并成功将模型迁移至现实世界应用。GAPartNet [228] 构建了一个大规模数据集,包含详细的部件级标注,以提升仿真与现实中的物体交互能力。SemGrasp [167] 创建了CapGrasp数据集,用于在虚拟环境中实现语义丰富的手部抓取。

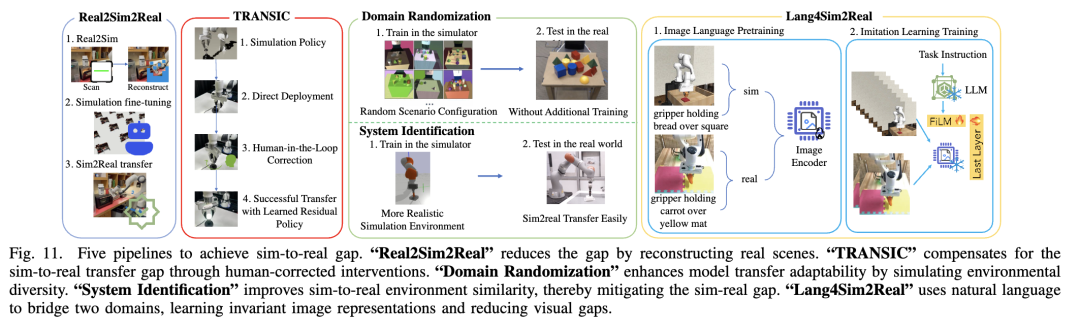

3)仿真到现实范式:近期,为减少对昂贵且大规模现实世界演示数据的依赖,研究人员提出了多种仿真到现实迁移范式:即先在仿真环境中进行大量学习,再迁移至现实世界。本节概述五种仿真到现实迁移范式,如图11所示。

Real2Sim2Real [229] 通过在“数字孪生”仿真中使用强化学习开发策略,再迁移至现实世界,从而改进模仿学习效果。

TRANSIC [230] 通过实时人工干预与基于修正行为的残差策略训练,缩小仿真与现实之间的差距。

域随机化(Domain Randomization)[231]–[233] 通过变化仿真参数以覆盖现实世界条件,从而提升模型泛化能力。

系统辨识(System Identification)[234]、[235] 通过构建真实场景的精确仿真,确保从仿真到现实的平滑过渡。

Lang4Sim2Real [236] 利用自然语言描述弥合仿真与现实差距,通过跨域图像表征提升模型泛化能力。

4)ARIO(All Robots In One):尽管像Open X-Embodiment这样的预训练数据集结构看似统一,但仍存在若干关键未解决问题:首先,缺乏全面的多模态感知——目前尚无数据集能同时整合图像、3D视觉、文本、触觉与听觉输入;其次,多机器人数据集缺乏统一格式,导致数据处理与加载困难;此外,不同机器人平台对多样化控制对象的表征方式不兼容、数据量不足难以支撑大规模预训练、以及缺乏同时包含仿真与真实数据的数据集(这对解决仿真到现实差距至关重要)。

为应对这些挑战,我们提出 ARIO(All Robots In One)——一种新的数据集标准,旨在优化现有数据集,促进开发更通用、更强大的具身智能体。ARIO 标准 [237] 以统一格式记录不同形态机器人的控制与运动数据。该标准支持来自各类机器人平台的可变数据,并确保精确的时间戳。这一标准使用户能够高效训练高性能、强泛化能力的具身AI模型,使ARIO成为具身AI数据集的理想格式。

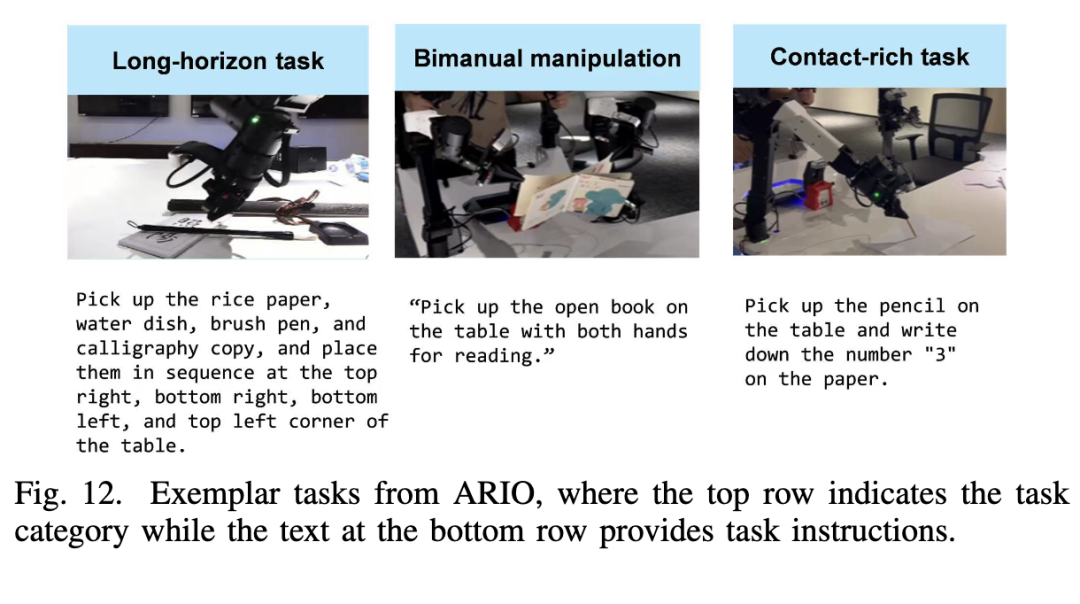

基于 ARIO 标准,我们进一步构建了一个统一的大规模 ARIO 数据集,包含约300万条片段,采集自258个系列、321,064项任务。图12展示了ARIO中的示例任务。

ARIO 数据集解决了当前数据集的局限性,推动开发鲁棒、通用型具身智能体。通过提供统一的数据采集与表征框架,ARIO 为构建更强大、更灵活的具身智能体铺平道路,使其能够以复杂多样的方式在物理世界中导航与交互。

5)具身AI系统的现实部署:具身AI系统已在多个场景取得显著进展。在医疗领域,如达芬奇手术系统和Moxi机器人,可自动化完成高精度手术或物资配送任务。在物流领域,亚马逊机器人和波士顿动力的Stretch机器人提升了仓储与运输效率。在制造业,发那科(Fanuc)和ABB等AI驱动机器人增强了生产精度与协作能力。

然而,仿真到现实迁移仍面临重大挑战,包括:仿真与现实数据分布之间的域差距、现实世界动态交互的复杂性、训练数据多样性不足。模型常在仿真环境中过拟合,难以应对现实传感器噪声,且无法处理意外事件。

VIII、挑战与未来方向

尽管具身人工智能发展迅速,但仍面临诸多挑战,并展现出令人振奋的未来方向。

高质量机器人数据集:获取充足的现实世界机器人数据仍是一大挑战。此类数据采集既耗时又耗费资源。仅依赖仿真数据会加剧“仿真到现实”的差距问题。构建多样化的现实世界机器人数据集,需要各机构之间紧密且广泛的合作。此外,开发更逼真、更高效的仿真器,对提升仿真数据质量至关重要。为构建能在跨场景、跨任务中通用的具身模型,必须构建大规模数据集,并利用高质量仿真环境数据辅助现实世界数据。

长视野任务执行:对机器人而言,即使执行单一指令也可能涉及长视野任务,例如“打扫厨房”这样的命令,包含整理物品、扫地、擦桌子等多个活动。成功完成此类任务,要求机器人具备在长时间跨度内规划并执行一系列底层动作的能力。尽管当前高层任务规划器已取得初步成功,但由于缺乏针对具身任务的优化,其在多样化场景中往往表现不足。应对这一挑战,需开发具备强大感知能力与丰富常识知识的高效规划器。为平衡规划复杂性与实时适应性,可结合轻量级监控模块进行高频监测,并设置两个适配器,在低频下分别进行子任务与路径适应推理。

因果推理:当前基于数据驱动的具身智能体依据数据内在相关性进行决策。然而,这种方法无法使模型真正理解知识、行为与环境之间的因果关系,导致策略存在偏差,难以在现实世界中实现鲁棒可靠的运行。因此,具身智能体应由世界知识驱动,具备自主因果推理能力。通过交互理解世界,并借助溯因推理学习其运行机制,可进一步提升具身智能体在复杂现实环境中的适应性、决策可靠性与泛化能力。对于具身任务,需通过交互式指令与状态预测,建立跨模态的时空因果关系。此外,智能体还需理解物体的功能属性(affordances),以在动态场景中实现自适应任务规划。

统一评估基准:尽管已有大量用于评估底层控制策略的基准,但它们在所评估技能方面差异显著。此外,这些基准中的物体与场景通常受限于仿真器能力。为全面评估具身模型,基准应使用逼真仿真器涵盖多样化的技能。当前许多高层任务规划器的基准主要通过问答任务评估规划能力。然而,更理想的方式是联合评估高层任务规划器与底层控制策略在执行长视野任务中的表现,并测量整体成功率,而非仅对规划器进行孤立评估。

安全与隐私:具身智能体在敏感或私密空间部署时面临重大安全挑战。这些智能体常依赖大语言模型(LLMs)进行决策,这引入了新的漏洞。例如,LLMs易受后门攻击,如词注入、场景操控、知识注入等,可能导致危险后果,如自动驾驶车辆加速冲向障碍物,或机器人执行高风险动作。为缓解这些风险,我们可评估潜在攻击路径并开发更鲁棒的防御机制。此外,可采用安全提示工程、状态管理机制与安全验证机制,以增强系统的安全性与鲁棒性。

IX、结论

具身人工智能使智能体能够从网络空间与物理世界中感知、理解并交互各类物体,展现出其在实现通用人工智能(AGI)道路上的关键意义。本综述全面回顾了具身机器人、仿真平台、四大代表性具身任务(视觉主动感知、具身交互、具身智能体、仿真到现实迁移)及未来研究方向。通过对具身机器人、仿真器、数据集与方法的对比总结,清晰呈现了具身人工智能领域的最新进展,将极大推动这一新兴且极具前景研究方向的未来发展。

原文链接:https://arxiv.org/pdf/2407.06886

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-09-09,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录