打破思考大模型“不可能三角”,蚂蚁集团更新了百灵万亿模型 Ling-2.5-1T、Ring-2.5-1T

打破思考大模型“不可能三角”,蚂蚁集团更新了百灵万亿模型 Ling-2.5-1T、Ring-2.5-1T

技术人生黄勇

发布于 2026-03-11 17:30:25

发布于 2026-03-11 17:30:25

春节真是大模型密集发布更新的时刻,Deepseek 灰度更新,其他模型厂商也不甘落后:

春节前这波“偷袭”!DeepSeek 没官宣,但偷偷点了什么技能?

Gemini 3 定位博士,Codex 专注代码,GLM-5 主打全能,三大巨头密集更新

前两天蚂蚁集团在其开源大模型生态中发布了两款全新万亿级别的模型:Ling-2.5-1T 与 Ring-2.5-1T。

它们分别代表了即时推理(Instant)与深度思考(Deep Thinking)两个不同的技术路线和应用侧重。

01

—

Ling-2.5-1T

Ling-2.5-1T 属于即时推理模型(Instant Model),其核心目标是极致压缩 Token 消耗,通过更少的 Token 输入输出实现与大模型相近的效果,主要服务于高频交互、对话式问答以及 Agent(智能体)场景。

这次更新在模型架构、token 效率、偏好对齐等维度全面升级。

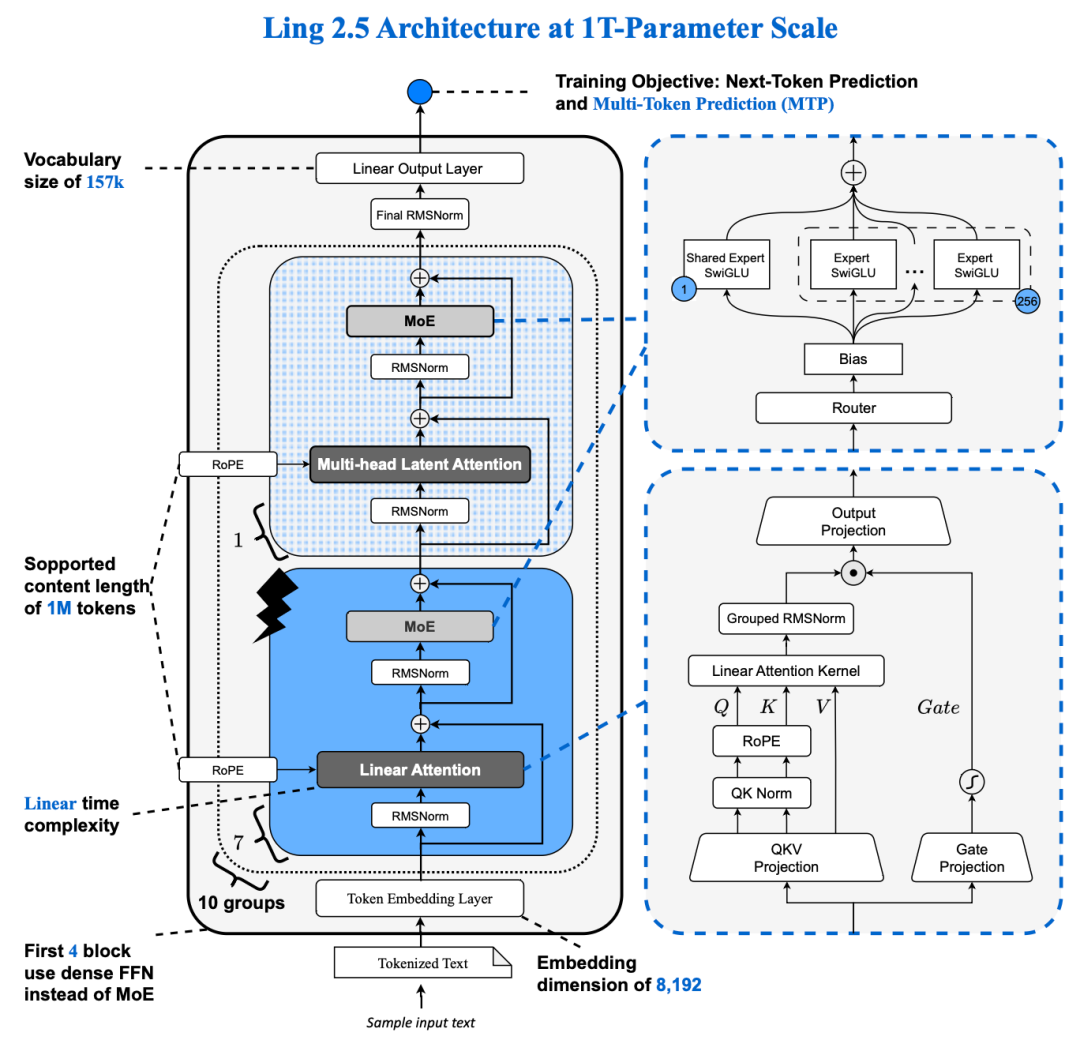

- 万亿参数与百万上下文:Ling-2.5-1T 具有 1T 总参数(激活 63B),预训练语料从前代的 20T 扩展至 29T,凭借高效的混合线性注意力架构与精细的数据策略优化,模型能够以高吞吐处理长达 1M token 的上下文。 (注:看来没有1M的上下文,都不好意思出来打招呼了)

- 更高的 token 效率:引入“正确性 + 过程冗余”复合奖励机制,进一步拓展了即时模型效率与效果的平衡边界。在相同 token 效率条件下,Ling-2.5-1T 的推理能力显著超越前代,接近需消耗约 4 倍输出 token 的前沿思考模型水平。

- 精细化偏好对齐:通过引入双向强化学习反馈、Agent-based 指令约束校验等精细化对齐策略,使 Ling-2.5-1T 在创意写作、指令遵循等偏好对齐类任务上相比前代模型实现大幅提升。

- 高效的原生智能体交互:基于大规模高保真交互环境进行 Agentic RL 训练,Ling-2.5-1T 可适配 Claude Code、OpenCode、OpenClaw 等主流智能体产品。在通用工具调用基准 BFCL-V4 上达到开源领先水平。 (注:智能体Agent 是发展方向,大模型的更新都朝着这个方向进化)

- 架构升级:2.0 架构基础上引入了混合线性注意力(Hybrid Linear Attention)架构,通过增量训练将部分 GQA 层改造为 Lightning Linear Attention,显著提升长程推理场景下的吞吐能力。为压缩 KV Cache,团队对其余 GQA 层近似转换为 MLA,并对 QK Norm、Partial RoPE 等特性进行适配,以增强混合注意力架构下的表达能力

更具体的细节可以看蚂蚁官方这篇:Ling-2.5-1T,普惠智能,即时响应。

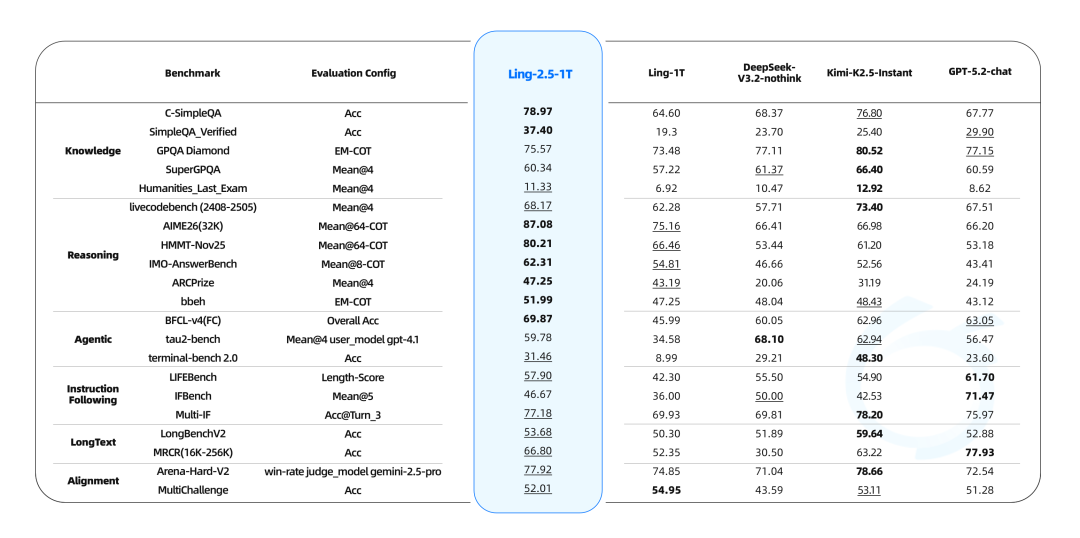

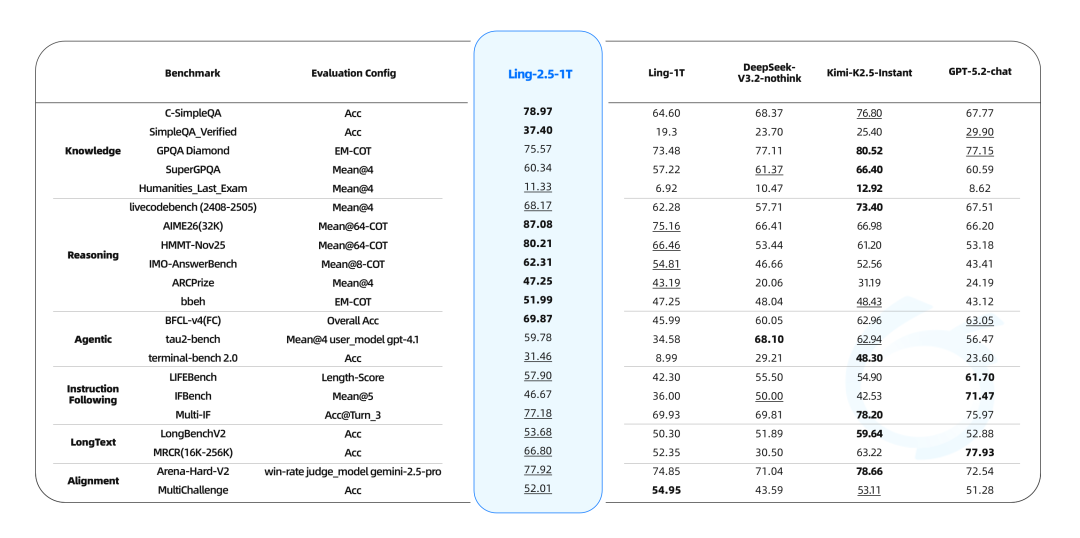

评测的结论:主流的大尺寸即时模型(DeepSeek V3.2、Kimi K2.5、GPT 5.2)对比中,Ling-2.5-1T 在复杂推理、 指令遵循能力具有明显优势。

02

—

Ring-2.5-1T

深度思考模型一直面临一个尴尬的“不可能三角”:想要推理逻辑严密,就得忍受龟速的解码速度和爆炸式的显存开销。

为了绕开这个难题,目前业界主流路径多采用 MoE(混合专家模型)架构,通过只激活部分参数来节省算力,诸多头部模型如以DeepSeek、Kimi、MiniMax均采用了这种架构。

基于混合线性架构的万亿参数思考模型Ring-2.5-1T,同时做到了三件过去被认为难以兼得的事:推理速度快、深度思考强、长程任务执行能力突出。

- 高效生成:得益于高比例的线性注意力机制,在超过 32K 生成长度下,访存规模降低 10 倍以上,生成吞吐提升 3 倍以上,尤其适合深度思考和长程执行的任务。

- 深度思考:在 RLVR 基础上引入 dense reward 来反馈思考过程的严谨性,使得 Ring-2.5-1T 同时实现 IMO 2025 和 CMO 2025 的金牌水平(自测)。

- 长程执行:通过大规模 fully-async agentic RL 训练,显著提升针对复杂任务的长程自主执行能力,使得 Ring-2.5-1T 可以轻松适配 Claude Code 等智能体编程框架和 OpenClaw 个人 AI 助理。

Ring-2.5-1T 属于思考模型家族(Thinking Model),被称为“万亿参数思考模型”,其核心优势在于长序列推理和逻辑严谨性。按上图评测的结果, 达到了开源领先水平。

- 混合线性架构(Hybrid Linear Architecture)

Ring-2.5-1T 基于 Ling-2.5 架构,采用了混合线性注意力机制,将注意力层以 1:7 的比例 混搭 MLA(多头潜在注意力)和 Lightning Linear Attention。

这种设计源自蚂蚁此前发布的 Ring-flash-linear-2.0 技术路线,显著提升了长文本生成场景的效率。

- 效率与性能突破

相较于前代模型,Ring-2.5-1T 在超过 32K Token 的长文本生成场景中,访存规模降低了 10倍以上,生成吞吐提升了 3倍以上。

虽然激活参数量从 51B 提升至 63B,但凭借线性时间复杂度的特性,其推理效率反而大幅提升,且随着生成长度增加,效率优势持续扩大。

- 逻辑严谨性(Proof Rigor)

引入了密集奖励机制(Dense Reward Mechanism),强调在评估模型输出时不只看最终答案,还要死抠解题步骤里的每一个推导环节,重点考察思考过程的严谨性。

在数学推理方面,其在 IMO(国际数学奥林匹克)和 CMO(中国数学奥林匹克)自测中均达到了金牌水平。

更具体的细节可以看蚂蚁官方这篇:Ring-2.5-1T,思更深,行更远。

03

—

这次发布的模型用的“百灵大模型”的名义,跟Qwen(通义千问) 系列明显是两个团队的产品。

好奇之下,简单对对比了一下,虽然两家都采用了 MoE(Mixture-of-Experts)稀疏激活技术,但在设计理念和侧重点上存在显著差异。

从特性和任务场景:

百灵大模型(Ling/Ring)

- 微观调优与智能体:百灵模型设计更侧重于微观层面的 Prompt 优化、逻辑推理过程控制以及与外部工具(Tool)的无缝对接。

- 思考 vs 实用:Ring 系列强调“深思考”(Deep Thinking)模型,专注于逻辑推理、数学证明和长链条任务;而 Ling 系列则强调即时交互和智能体适配性。

通义千问(Qwen)

- 宏观统一与多模态:Qwen 系列(特别是 Qwen2-VL)在语音、音频、图像等多模态能力上表现突出,强调统一的跨模态理解。

- 企业级落地:Qwen 在多模态文档解析、企业知识库等商业场景有更深的部署案例,强调通用性和企业级安全性。

从架构和效率方面:

百灵大模型(Ling/Ring)

- 混合线性注意力:最新的 Ring-2.5-1T 采用了 MLA + Lightning Linear Attention 的混合架构,特别针对长序列推理进行了优化,极大降低了 KV Cache 的访存成本。

- Token 效率:Ling-2.5-1T 通过“过程冗余”奖励机制,显著提升了 Token 使用效率,这对于部署在资源受限的 Agent 环境中至关重要。

通义千问(Qwen)

- LogN-Scaling 与 NTK 插值:Qwen 在注意力机制上引入了 LogN-Scaling 和 NTK-aware 插值技术,这些技术主要用于延长上下文窗口(Context Length),确保在上下文长度增长时模型的熵保持稳定。

- 参数规模与版本:Qwen 的参数规模覆盖面更广,从 5B 到 720B 不等,且最新的 Qwen2.5 系列在编码器效率上也做了大量优化,但整体上更倾向于统一的 Transformer 架构。

04

—

使用百灵大模型

官网聊天对话体验地址:https://ling.tbox.cn/chat。

Hugging Face:https://huggingface.co/inclusionAI/Ring-2.5-1T

ModelScope:https://modelscope.cn/models/inclusionAI/Ring-2.5-1T

接入API使用有限时免费福利:

每个账号每天赠送 50 万免费计算单元,包含输入和输出,免费额度每天 02:00 前完成刷新,当日未使用完的不会进行转结。

超过部分的价格: 输入:4 元/百万 token,输出: 16 元/百万 token。

看了一下官方发布的自测案例,居然看到丧心病狂让大模型开发一个微型版操作系统(TinyOS),模型在 Claude Code 中运行了 2 小时 8 分钟,最终完成了开发任务。

还有让大模型分析Berkeley Lights 公司 2019H2 与 2020H1 财报,并对这篇数值密集型的金融财报进行信息抽取汇总,对比,模型可以对重点财务衍生指标进行复杂计算,并得到财报的深度分析结论。

这么高强度的任务,也不知道 Ring-2.5 能不能通过这篇文章里的评测:使用 OpenClaw小心:为了完成给它的任务,它们居然学会了这招......。

<完>

文章推荐:

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-18,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读