相似性驱动加权的终身强化学习模型

相似性驱动加权的终身强化学习模型

CreateAMind

发布于 2026-03-11 17:27:35

发布于 2026-03-11 17:27:35

相似性驱动加权的终身强化学习模型

Lifelong Reinforcement Learning with Similarity-Driven Weighting by Large Models

https://arxiv.org/pdf/2503.12923

摘要

终身强化学习(LRL)在解决序列任务方面具有显著潜力,但仍面临相当大的挑战。一个关键的难点在于,如何在动态环境中有效防止灾难性遗忘并促进知识转移,同时在后续任务中保持可靠的决策性能。为了解决这一问题,我们提出了一种新颖的框架,即SDW(相似性驱动加权框架),该框架利用大型语言模型生成的动态函数来精确控制训练过程。SDW的核心在于两个由大型模型预先生成的函数:任务相似性函数和权重计算函数。任务相似性函数从任务描述中提取多维特征,以量化任务在状态、动作和奖励方面的差异和相似性。权重计算函数基于相似性信息动态生成关键的训练参数,包括存储在回放缓冲区中的旧任务数据的比例以及损失函数中的策略一致性权重,从而在学习新任务和从先前任务转移知识之间实现自适应平衡。通过在训练前离线生成函数代码,而不是在训练过程中依赖大型模型推理,SDW框架减少了计算开销,同时在序列任务场景中保持了效率。在Atari和MiniHack序列任务上的实验结果表明,SDW显著优于现有的终身强化学习方法。

1 引言

强化学习(RL)在解决单一任务方面取得了显著的成功,例如游戏控制、机器人操作和决策优化。然而,在现实世界的场景中,智能系统经常遇到一系列任务,这些任务需要在保留先前获得的知识的同时进行持续学习和适应。为了应对这些挑战,研究人员提出了一类称为终身强化学习(LRL)的算法,旨在使智能体能够在动态环境中解决顺序决策问题。由于其在自动驾驶机器人[Li等,2019]、游戏[Sur等,2022]和自适应控制[Lu等,2019]等应用中的重要性,LRL在最近的研究中获得了越来越多的关注,其中智能体不仅要获取新技能,还要在先前学习的任务上保持强大的性能。然而,设计有效的LRL算法,以平衡学习新任务和保留过去知识,仍然是一个重大挑战。

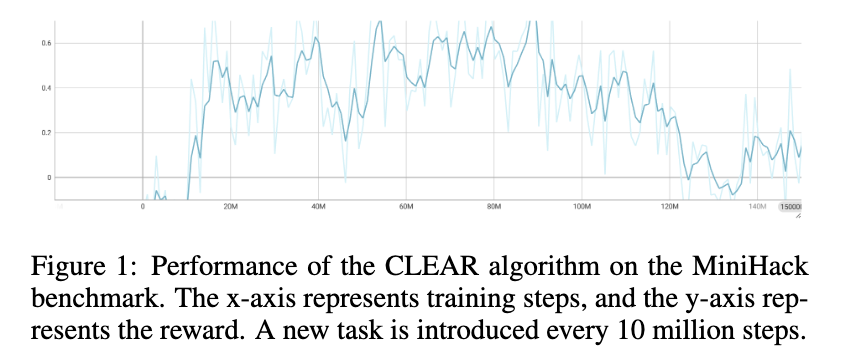

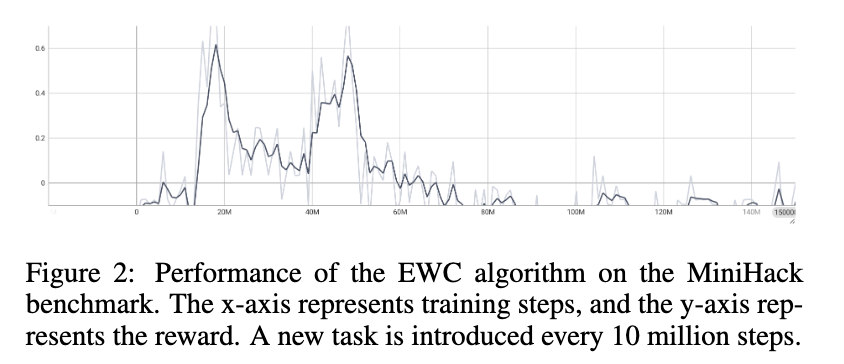

现有LRL方法的实际挑战,如CLEAR[Rolnick等,2019]和弹性权重巩固(EWC)[Kirkpatrick等,2017],在应用于任务差异显著时变得明显。我们在MiniHack环境中验证了CLEAR算法,如图1所示。结果显示,在后续任务上的性能显著下降。这种行为可以归因于其在训练期间将早期任务的数据与新任务数据结合的策略。当任务之间的差距较大时,这种方法难以调和相互冲突的任务目标,使得算法难以有效优化新任务。共享的训练过程引入了干扰,因为智能体被迫平衡跨任务不完全对齐的学习目标。

在EWC中也观察到了类似的现象,如图2所示。EWC试图通过在新任务训练期间限制参数更新来保留早期任务的性能。然而,这种对早期知识的僵化保留并没有考虑到任务之间的关系,反而对后续任务的决策空间施加了严格的限制。当早期任务与后期任务根本不同的时候,这些限制会阻碍智能体完全适应新任务,导致次优性能。

这些观察结果突显了现有方法的一个根本局限性:CLEAR和EWC都未能有效地建模和利用任务关系。通过将任务视为独立的并实施严格的约束或重放机制,它们无法动态适应任务序列的演变特性。这强调了需要更先进的方法,这些方法可以明确地建模任务间的依赖关系,自适应地平衡知识保留和新任务学习,并解决多样化和复杂任务序列带来的独特挑战。

最近,大型语言模型(LLMs)在自然语言处理[Achiam等人,2023]以及其他领域如法律[Cheong等人,2024]、医疗[Wang等人,2024]和通信[Kan等人,2024]中取得了突破性的成功,展示了它们提取和利用数据中复杂关系的能力[Honget等人,2024]。这些能力使LLMs成为解决LRL挑战的有前途的工具,特别是在分析任务关系和指导多任务学习序列方面。

受这些进展的启发,我们提出了一种新的LRL框架,该框架利用LLMs来提高任务性能,减轻遗忘,并增强可转移性。该框架引入了两个关键功能:一个用于定量分析任务关系并衡量其相关性,另一个用于动态地将任务相关性映射到关键训练参数,如损失计算和缓冲区更新。这种方法使智能体能够自适应地控制其训练过程,在加速新任务学习的同时提高任务保留。

与之前需要深度参与LLMs的方法不同,我们的框架仅在函数生成阶段使用LLMs,确保了轻量级集成。通过有效地捕捉任务关系并动态调整训练过程,我们的框架在任务性能、遗忘缓解和知识转移方面显著优于现有方法。此外,它为将大型模型整合到LRL中提供了一个新的视角,推动了能够进行终身学习的AI系统的发展。

这项工作的主要贡献如下:

- 我们提出了一种新的终身强化学习框架SDW,它利用LLMs的任务关系推理能力来动态优化多任务学习过程。与传统方法相比,SDW在有效缓解遗忘的同时显著提高了学习新任务的效率,为终身学习提供了新的解决方案。

- 我们引导大型语言模型生成两个关键函数:一个任务相似性计算函数,该函数基于任务描述、状态分布和奖励结构定量评估任务之间的关系;以及一个权重计算函数,该函数确定平衡新旧任务的最佳训练权重。通过将这些函数整合到训练过程中,我们实现了学习新任务和保留旧任务之间更合理的平衡。

- 我们实现了一种轻量级LLM集成策略,该策略仅在预训练阶段用于任务关系推理,使训练过程完全独立于LLMs。这种设计使我们能够显著减少计算开销,同时避免依赖高性能LLMs,确保我们的框架在处理大规模任务序列时保持高效和可扩展。

- 我们在MiniHack和Atari上的实验结果表明,SDW在缓解灾难性遗忘和提高新任务学习方面显著优于现有算法,突出了其在终身强化学习场景中的有效性。

2 相关工作

2.1 终身强化学习

终身强化学习旨在赋予智能体在连续任务中积累知识的能力,同时减轻灾难性遗忘。先前在终身强化学习领域的研究大致可以分为三种方法:

- 基于正则化的知识保留:这些方法使用正则化项来保留知识并减少与早期任务的干扰。著名的例子包括弹性权重巩固(EWC)[Kirkpatrick等人,2017]和在线EWC[Huszár,2018],它们通过允许新任务的次优解来减轻遗忘。虽然有效,但这些方法在可扩展性和适应高度动态任务环境方面常常面临限制。

- 基于经验回放的方法:经验回放方法存储过去任务的经验,并在训练期间重放它们,使智能体能够避免灾难性遗忘,同时提高新任务的学习性能。CLEAR[Rolnick等人,2019]和PnC[Schwarz等人,2018]等算法属于这一类。尽管这些方法在某种程度上提高了任务性能,但由于缺乏任务特异性和在优先考虑相关经验方面的低效,它们在任务空间较大的情况下表现挣扎。

- 基于网络结构的方法:这些方法动态调整网络架构,例如冻结特定参数或添加新模块,使智能体能够灵活适应新任务。一个例子是SANE[Powers等人,2022a],它有效地隔离了任务特定的知识。然而,这些方法往往会显著增加网络复杂性,限制了它们在大规模任务部署中的实用性。

2.2 LLMs和终身学习的进步

为了克服传统终身强化学习方法在动态任务环境中的局限性,研究人员开始探索将拥有强大推理和知识转移能力的LLMs整合到终身强化学习框架中。同时,关于LLMs终身学习能力的研究也出现了。

例如,[Sun等人,2019]提出了LAMOL,这是一种基于语言建模的终身语言学习(LLL)的简单而有效的方法。LAMOL通过解决当前任务的同时生成先前任务的伪样本进行联合训练,来解决灾难性遗忘问题。然而,它仅限于语言任务,并且不善于泛化到其他领域,如机器人或游戏。

此外,LLMs和RL的结合研究也取得了进展。研究还探讨了将LLMs与强化学习相结合,专注于任务探索和目标生成。[Pourcel等人,2024]提出了一个自动目标代理框架,该框架结合了LLMs和目标条件RL来解决开放式目标生成和学习。LLM基于上下文估计目标难度和可学习性,生成奖励函数代码和目标描述,以优化目标生成和学习过程。这种方法在目标生成效率和适应速度方面优于传统方法。然而,它没有解决多任务场景中的灾难性遗忘问题,这在终身强化学习中仍然是一个关键限制。

2.3 将LLMs与LRL结合

尽管先前的研究分别探讨了LLMs在终身学习和强化学习中的潜力,但最近的研究集中在将LLMs整合到终身强化学习框架中,以解决动态多任务环境的独特挑战。将大型语言模型与终身强化学习相结合已成为一个有前景的方向,利用LLMs的推理能力和丰富的先验知识来增强LRL框架的适应性和可扩展性。当前的研究主要分为两类:

- 使用LLMs作为规划器构建技能图:这种方法利用LLMs构建技能图,使智能体能够识别复杂任务的动作。[Mao,2024]提出了一个框架,其中LLMs被用来为智能体选择技能,并确定是否需要新技能。同样,[Yuan等人,2023]利用LLMs的先验知识发现技能之间的关系,构建技能图来探索像Minecraft这样的开放世界环境。 Li等人[Li等人,2024]引入了LEAGUE框架,该框架将LLMs与任务和运动规划以及深度强化学习相结合。LLMs分解任务,创建技能操作符,并生成密集奖励,以加速策略学习,同时为新问题场景维护一个技能库。Tziafas和Kasaei[Tziafas和Kasaei,2024]提出了一种不断扩展机器人技能库的方法。他们的方法在“唤醒”阶段交替进行,LLM在模拟器中生成和验证任务,在“睡眠”阶段,LLM将经验抽象为新技能,并通过记忆回放优化知识。

- 使用LLMs作为观察的语义生成器:另一条研究线将LLMs视为类似环境的实体,其中由LLM生成的与任务相关的语言被编码并嵌入到状态空间中,以促进知识转移和任务学习。 [Meng等人,2024]提出了一个框架,将LLMs生成的语义信息嵌入到任务状态中,实现有效的知识转移。该系统使用SAC算法通过将任务描述编码为语言嵌入来学习任务动作,这些嵌入在训练期间被纳入状态空间。 [Chen等人,]利用预训练的LLMs(例如GPT-3.5)从文本描述中生成任务提示和内容。这些与任务相关的嵌入与观察信息结合,输入到变换器模型中,并用于生成语言引导的奖励。这种方法有助于策略更好地适应任务。

尽管这一领域的研究仍处于早期阶段,但这些方法在增强任务理解和实现终身学习场景中的高效知识转移方面显示出巨大的潜力。然而,扩展状态空间增加了复杂性,需要更多的迭代和计算资源。此外,在训练期间与大型模型的持续交互显著增加了计算需求,导致训练时间更长,并需要高性能硬件来有效地处理扩展的状态空间。

3 方法

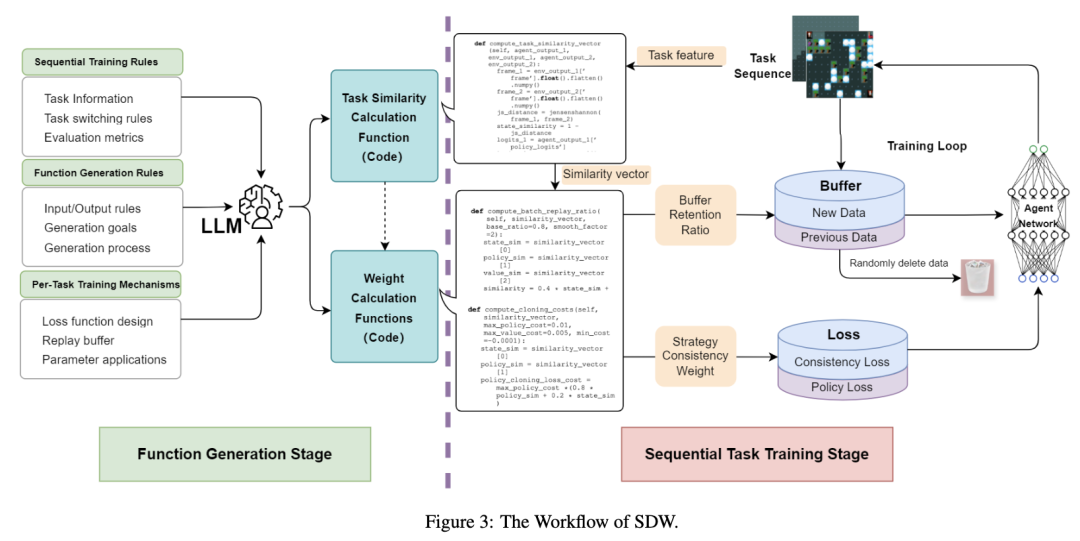

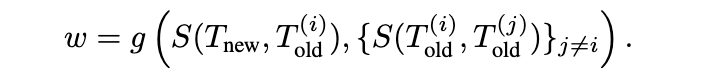

我们提出了一个名为相似性驱动加权(SDW)的框架,这是一个终身强化学习算法,旨在解决顺序任务学习中灾难性遗忘的挑战。SDW的核心思想是根据任务之间的关系自适应地确定持续训练过程中的关键参数设置。SDW不依赖于固定或手动调整的参数,而是利用大型模型的推理能力来分析任务相似性,并生成两个基本函数:任务相似性计算函数和权重计算函数。这些函数动态量化任务之间的相似程度,并调整从先前学习的任务中保留的知识——无论是数据还是策略。通过根据任务之间的特定关系定制知识转移和保留的程度,SDW确保了跨任务序列的更灵活和高效的学习过程,在终身强化学习场景中显著提高了性能。我们在附录中提供了关于SDW设计的更深入见解。

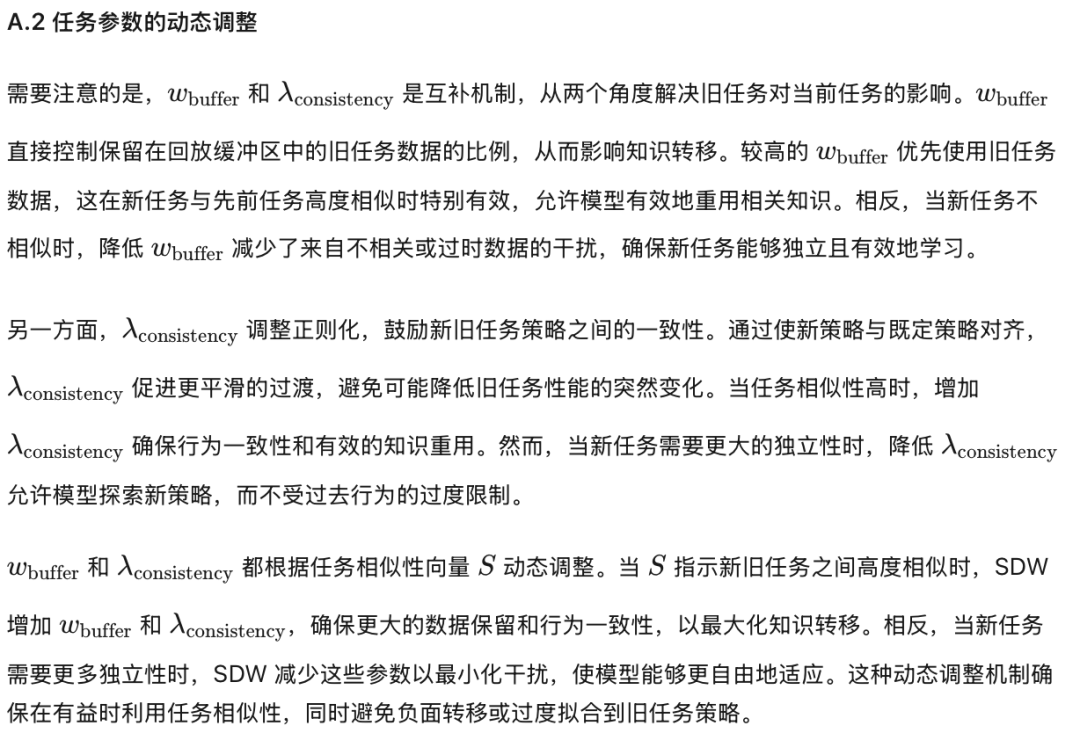

3.1 框架工作流程

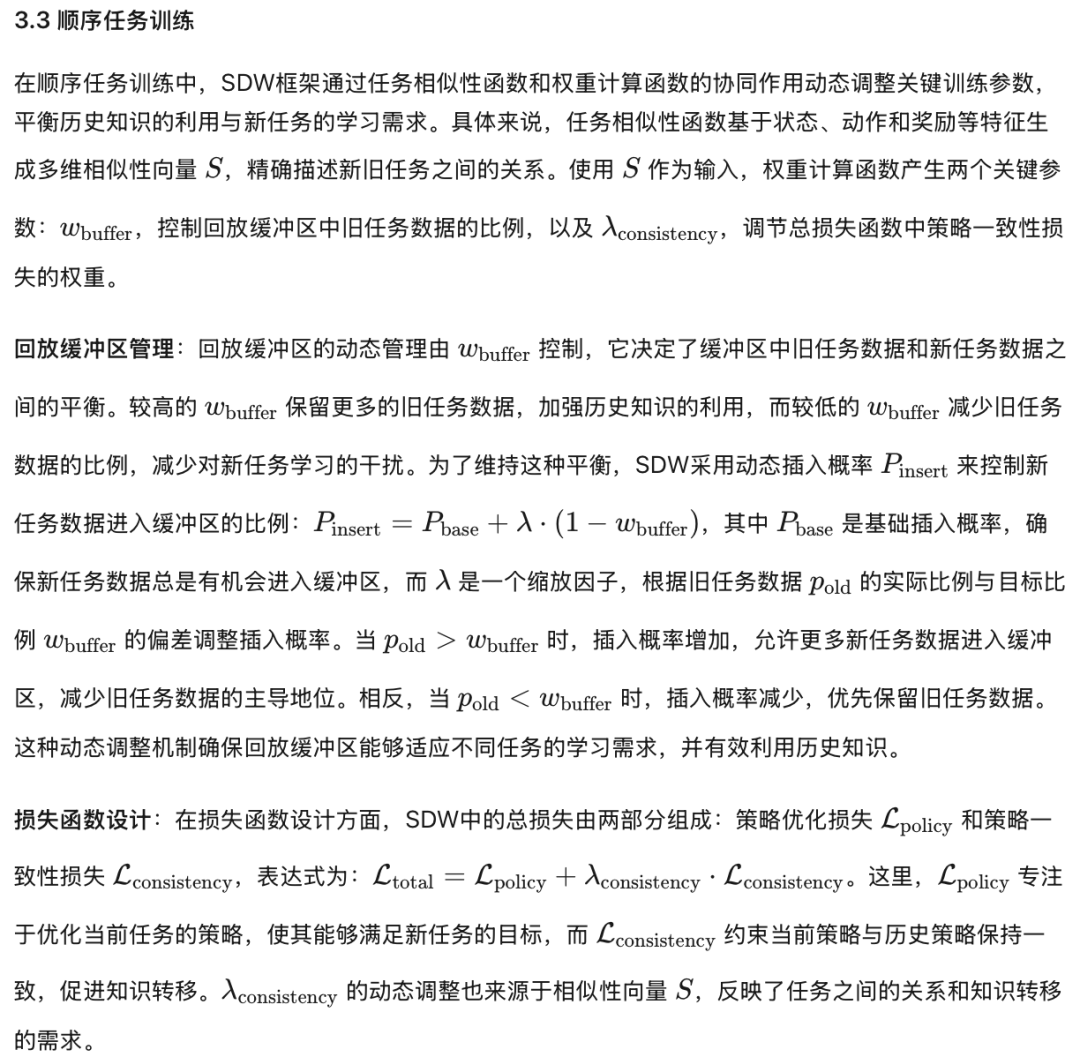

SDW框架分为两个主要阶段:函数生成阶段和顺序任务训练阶段,如图3所示。在函数生成阶段,SDW利用LLMs生成两个关键函数:任务相似性计算函数和权重计算函数。LLM的提示是基于任务信息(例如,任务特征、持续学习过程、回放缓冲区使用情况)和设计要求构建的,这些要求指定了这些函数的期望输出。这些信息提供了关于终身学习环境中任务之间关系的基本信息。任务相似性计算函数基于它们的环境编码计算连续任务之间的相似性向量,这代表了当前任务与紧接其前的任务之间的关系。这个向量捕捉了任务相似性的各个方面,并作为后续调整的基础。权重计算函数使用相似性向量在训练过程中动态调整关键参数,确保框架在任务间有效平衡知识保留和转移。

在顺序任务训练阶段,框架应用LLM生成的函数来处理和优化持续学习过程。具体来说,任务相似性计算函数计算的相似性向量通知权重计算函数调整回放缓冲区的采样权重和损失函数中的关键权重。这些调整使框架能够在减轻灾难性遗忘的同时增量训练新任务。

需要强调的是,SDW将LLMs的使用限制在函数生成阶段的一次性推理,之后生成的函数在整个顺序任务训练阶段应用,以计算特定任务的权重和调整,而不需要进一步的LLM推理。这种设计避免了将LLM推理嵌入到训练过程中,显著减少了计算开销,并确保了高效和可扩展的训练。

与之前的作品(例如,[Meng等人,2024],[Chen等人,])不同,这些作品在训练期间依赖频繁的LLM推理,SDW将LLM使用与训练循环解耦,使我们能够在不牺牲效率的情况下利用高参数LLM。

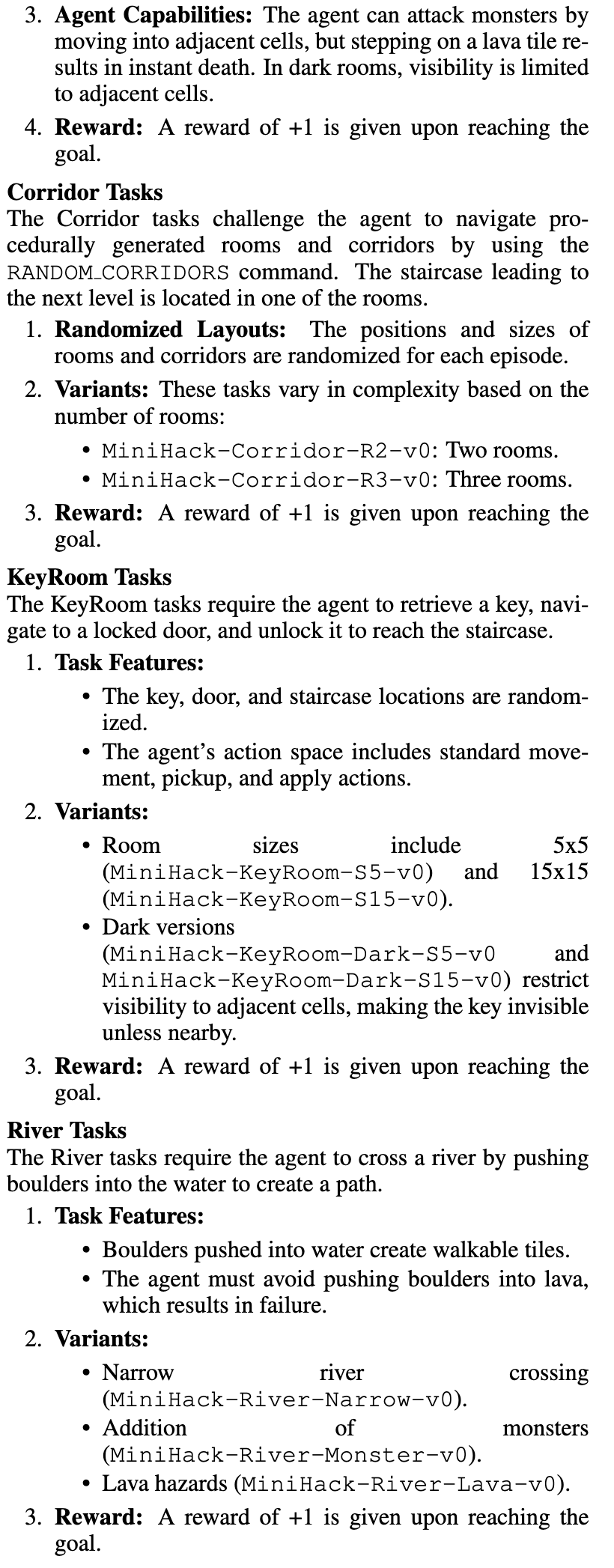

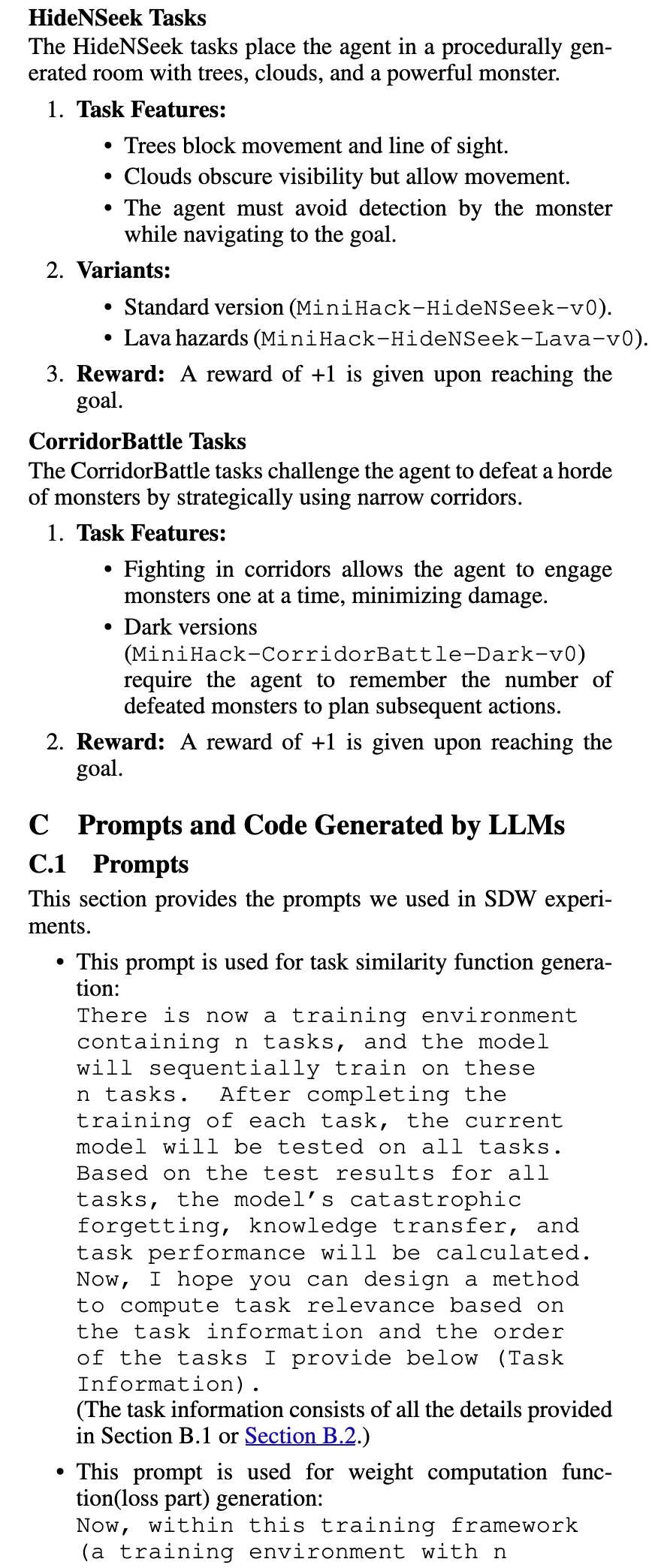

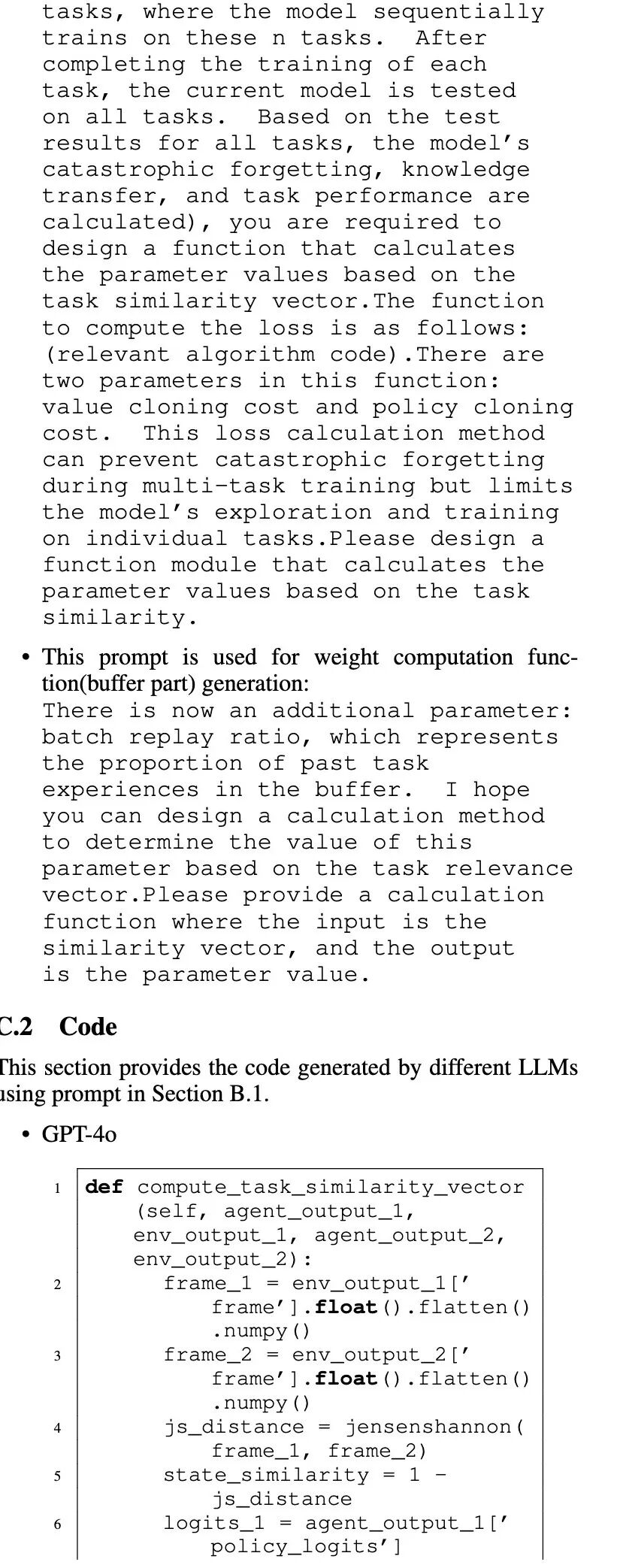

3.2 函数生成

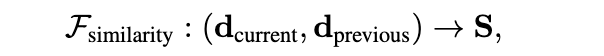

在函数生成阶段,SDW利用LLMs自动生成两个核心函数:任务相似性函数和权重计算函数。这两个函数用于量化任务之间的多维相似性,并根据计算出的相似性动态生成训练参数。任务相似性函数的输入是从任务描述中生成的。任务描述可能包括目标、状态空间、动作空间和奖励函数等信息。基于这些描述,LLM提取任务特征并生成一个表征任务的特征表示。

4 实验

4.1 实验设置

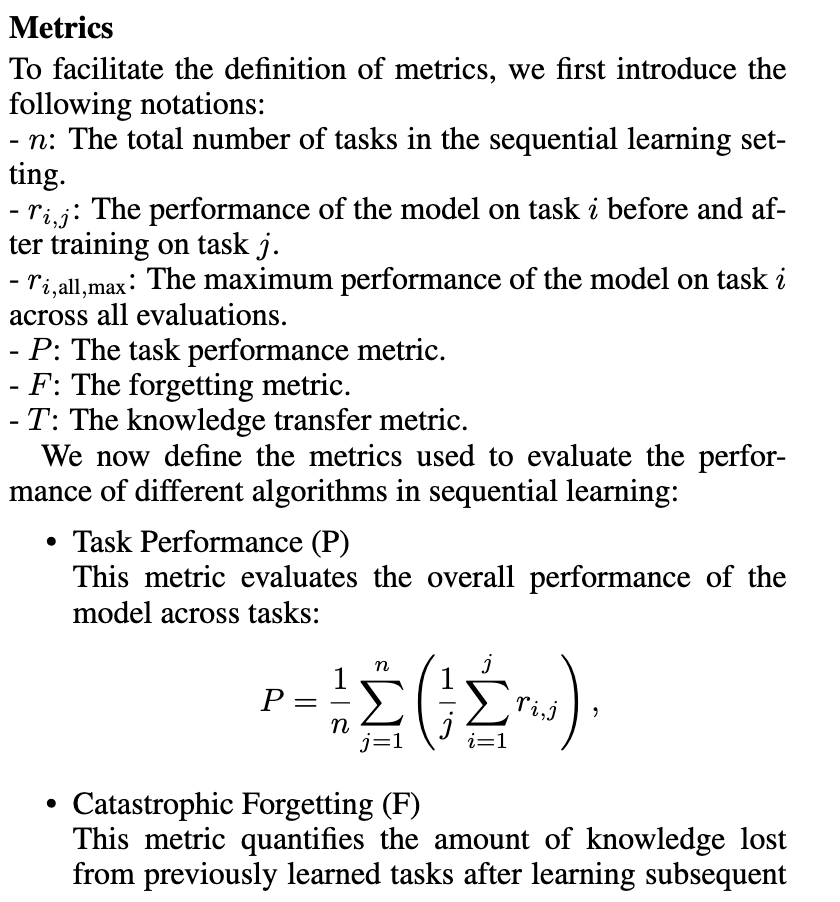

为了评估我们提出方法的有效性,我们在一系列持续学习问题上进行了实验。具体来说,我们采用了一个多轮训练框架,其中环境中的任务被分成多批进行训练。在每一批中,所有任务都按顺序进行训练,并在训练期间的固定间隔对当前模型在所有任务上进行评估。这个框架被广泛用于评估终身学习方法,例如Cora基准测试中的那些方法[Powers等人,2022b]。我们使用以下指标来评估算法的性能:

4.2 在Minihack环境中的评估

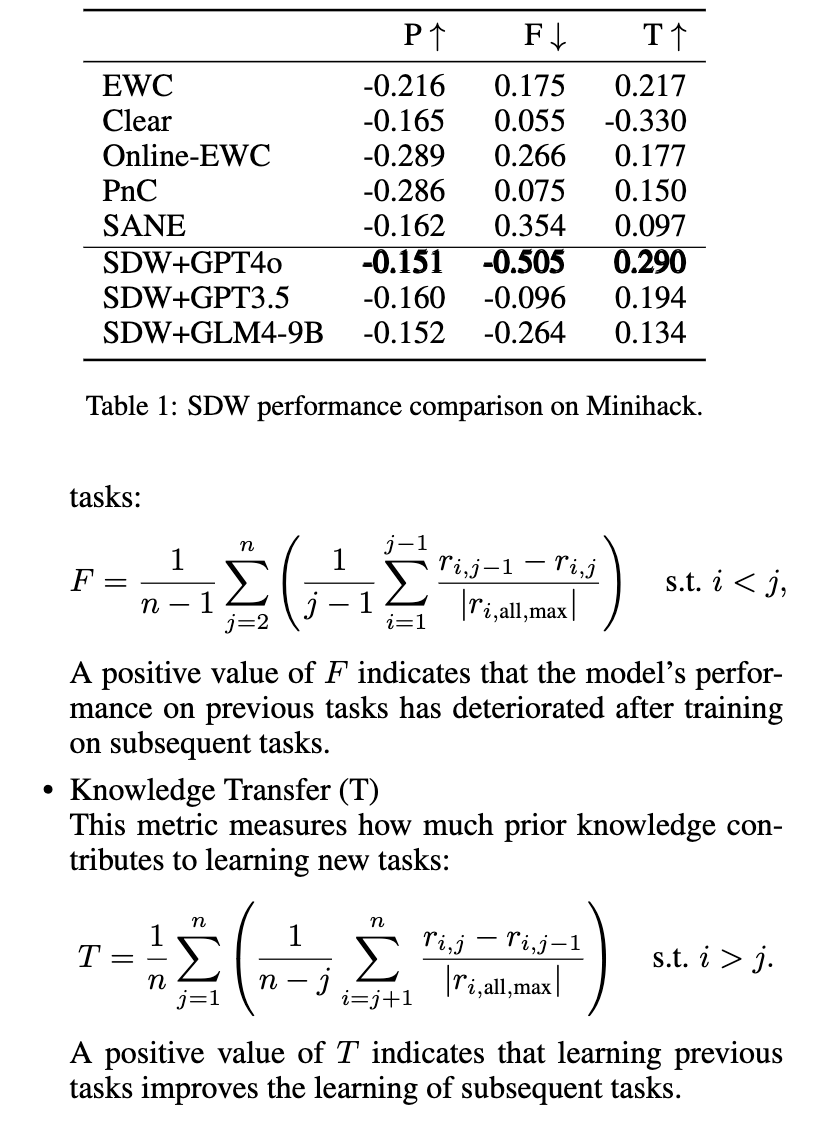

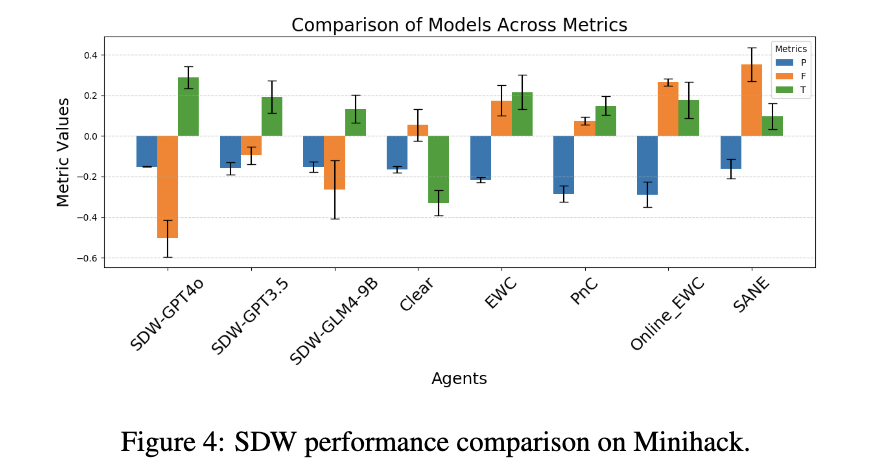

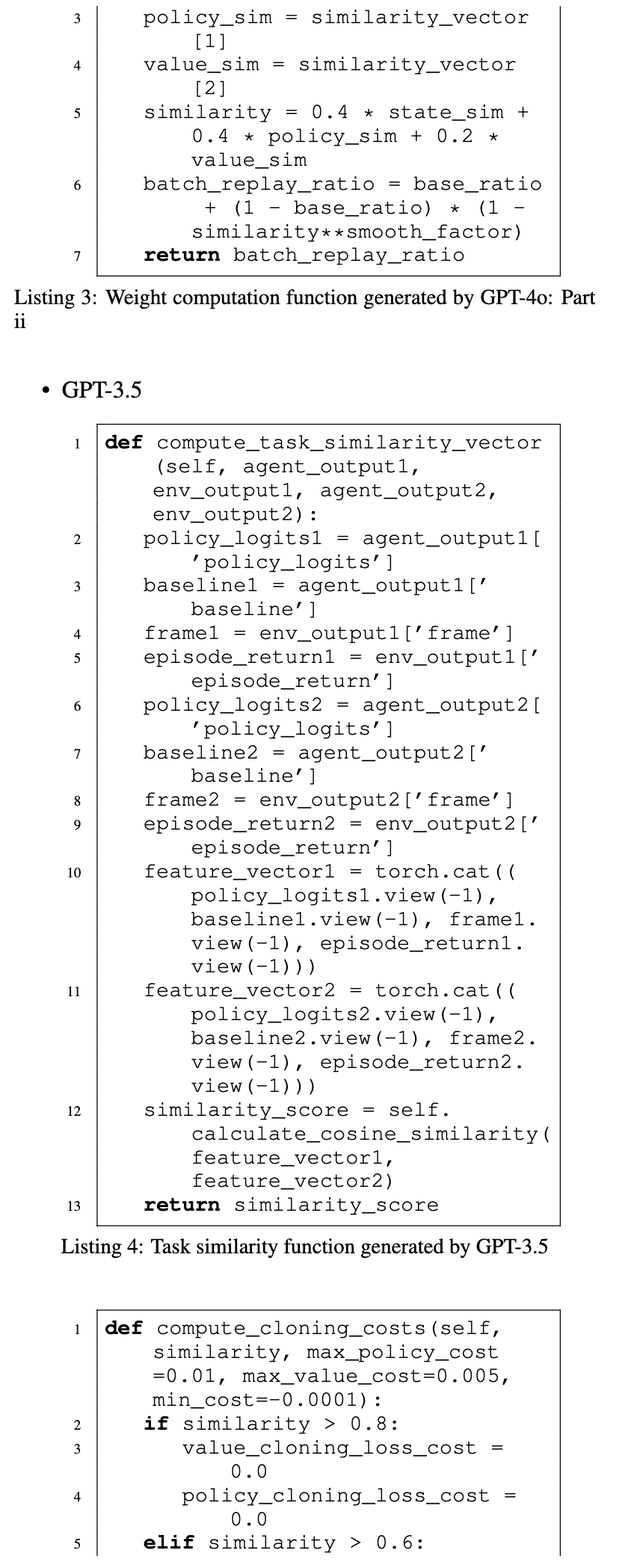

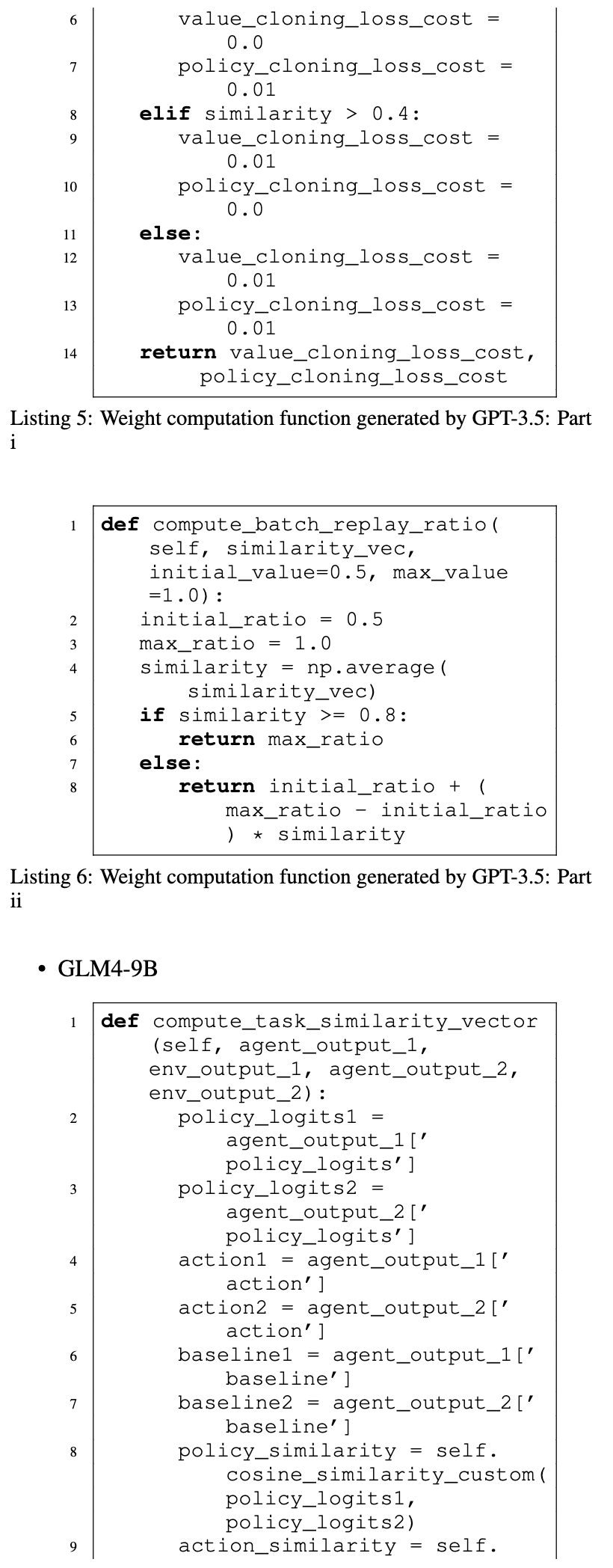

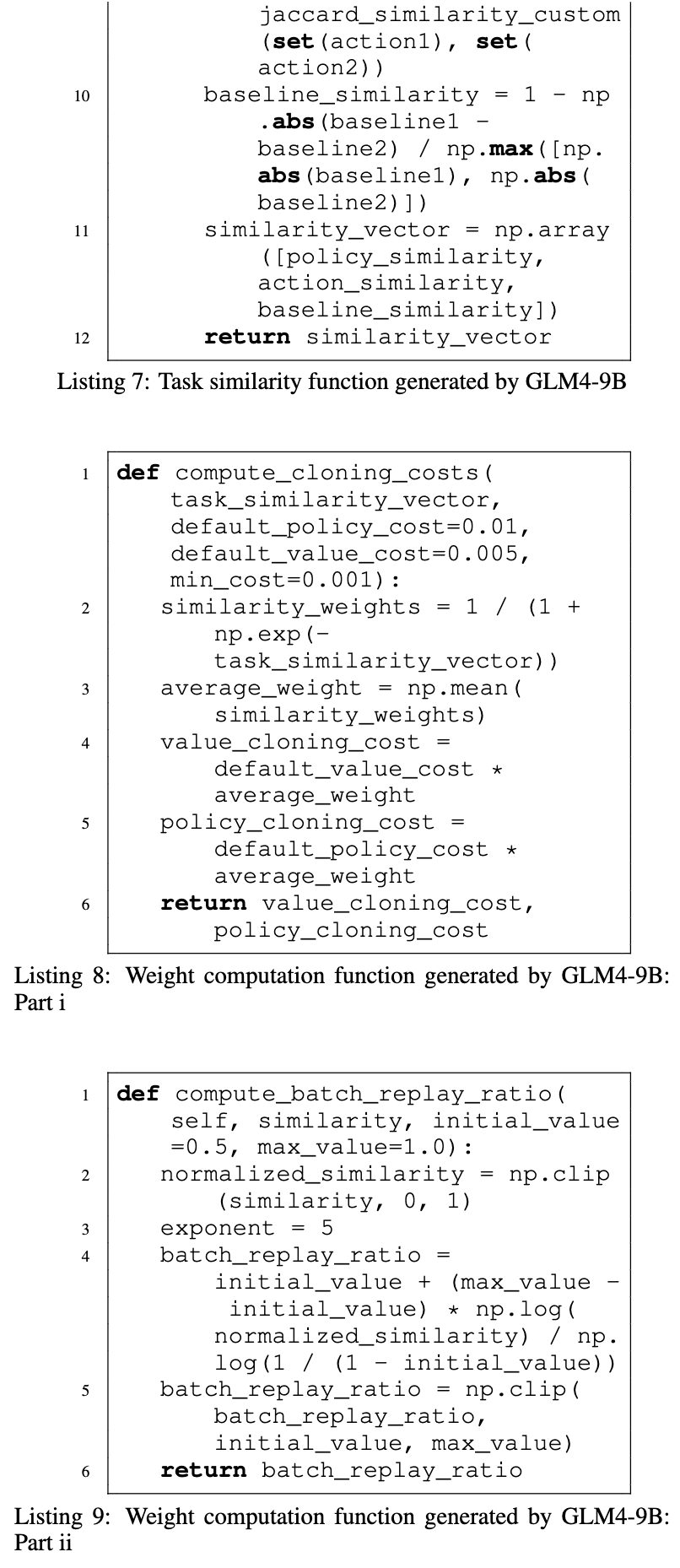

Minihack是由[Samvelyan等人,2021]基于Nethack游戏创建的一个沙盒环境。它使用NLE接口与游戏通信,并提供丰富的多样化任务环境。在我们的实验中,我们从Minihack环境中选择了15个任务,分为七个组。详细的任务描述和完整的任务列表在附录中提供。我们将训练框架配置为两轮,每轮每个任务训练1e7步,总共3e8步。为了验证我们方法的普遍性,我们使用三个LLMs——GPT-4o、GPT-3.5和GLM4-9B——进行了实验,并将我们的方法与五种终身强化学习(LRL)方法进行了比较。对于所有基线算法,除非另有说明,否则我们使用它们官方实现中提供的默认超参数设置。

表1中的实验结果突出了SDW在解决Minihack环境中终身学习挑战方面的有效性。当与GLM4-9B和GPT-4o等LLMs配对时,SDW显示出比传统方法更大的性能提升。具体来说,SDW+GPT-4o实现了最佳的整体任务性能(-0.151),并在减轻灾难性遗忘方面表现出色(-0.505),强调了它在跨任务保留知识方面的鲁棒性。此外,它还实现了最高的知识转移得分(0.290),展示了它有效泛化和适应新任务的能力。与EWC和SANE等基线方法相比,SDW在所有指标上始终表现优异,展示了它在推进终身学习框架方面的强大潜力。

4.3 在Atari环境中的评估

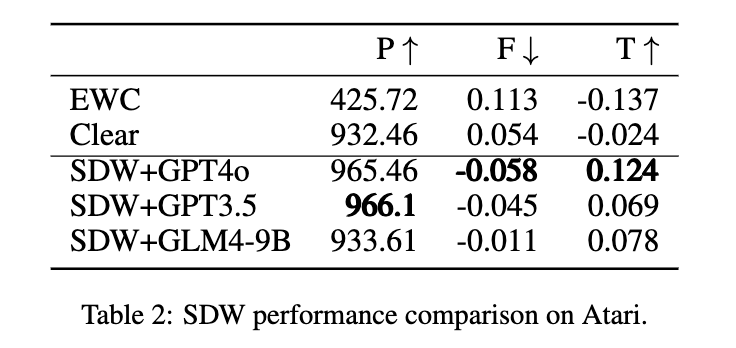

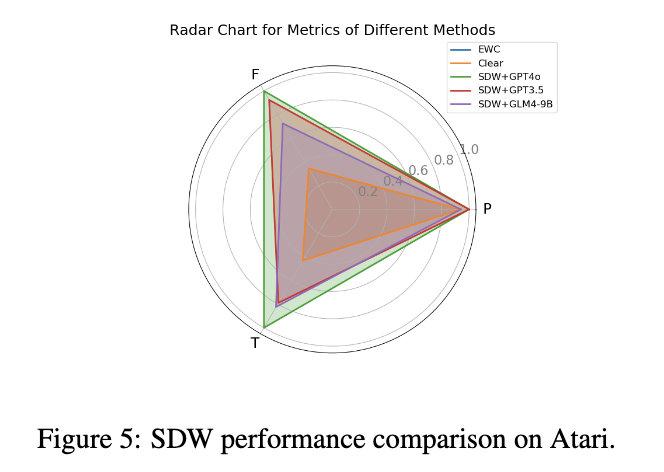

基于街机学习环境(ALE)的Atari环境提供了一组经典的游戏和任务,作为强化学习方法的标准基准。[Mnih,2013]在我们的实验中,我们选择了三个代表性任务:SpaceInvadersNoFrameskip-v4、BeamRiderNoFrameskipv4和MsPacmanNoFrameskip-v4。每个任务经过三轮训练,每轮5百万步,总共4500万训练步。

我们评估了三个大规模模型——GPT-4o、GPT-3.5和GLM4-9B——并与相同的终身强化学习基线进行了比较,确保所有实验的一致性。对于所有基线算法,我们使用它们官方实现中提供的默认超参数设置。

表2中的实验结果表明,SDW变体在所有指标上始终优于基线。在任务性能(P)方面,SDW+GPT3.5取得了最高分(966.1),紧随其后的是SDW+GPT4o(965.46),而基线EWC(425.72)和Clear(932.46)则明显落后。对于灾难性遗忘(F),SDW方法有效减轻遗忘,负率为(SDW+GPT4o:-0.058,SDW+GPT3.5:-0.045),与EWC(0.113)和Clear(0.054)的正率形成对比。最值得注意的是,SDW+GPT4o在知识转移(T)方面表现出色,取得了最高分(0.124),超过了其对应物(SDW+GPT3.5:0.069,SDW+GLM4-9B:0.078)和基线(EWC:-0.137,Clear:-0.024)。这些发现突出了SDW+GPT4o在持续学习场景中的优越适应性和可扩展性,这可能是由于其增强的推理和先验知识整合。然而,需要进一步的研究来理解SDW+GLM4-9B相对较低的转移性能,并探索SDW方法在更多样化任务中的可扩展性。

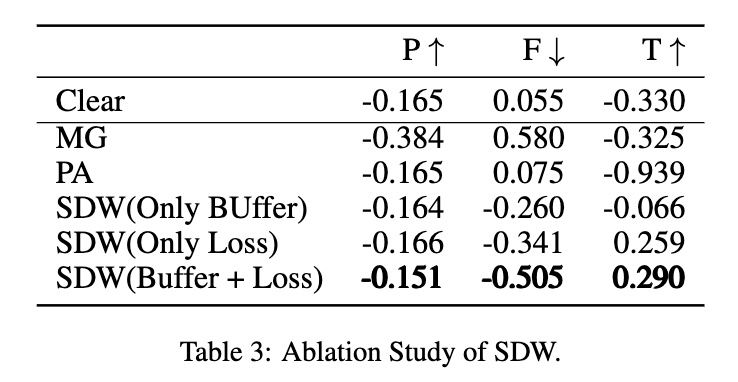

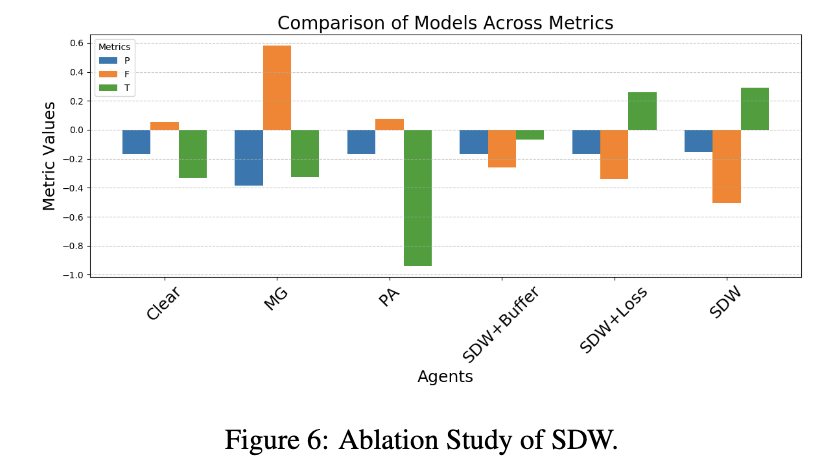

4.4 消融实验

为了进一步研究我们提出的SDW(选择性动态加权)框架的有效性,我们设计并测试了几种SDW的变体,以分离其贡献:

- 基于LLM的损失和缓冲模块生成(MG):通过提供相关的代码和特定任务的信息作为输入,大型语言模型(LLMs)自主生成定制的损失计算函数和缓冲模块。

- 基于LLM的参数分配(PA):利用特定任务的信息、任务顺序和奖励函数作为输入,大型模型动态配置损失计算和缓冲管理的参数,使智能体能够高效地适应并训练每个特定任务。

- 仅含损失函数的SDW(L)

- 仅含缓冲函数的SDW(B)

通过对这些变体进行系统比较,我们旨在明确SDW框架中关键组件的具体贡献。实验在MiniHack沙盒中进行,遵循第4.3节中详细说明的相同设置。在这次评估中,使用ChatGPT-4o作为基础LLM。

表3的结果表明,基线方法(Clear、MG和PA)在各个指标之间的平衡表现不佳。由于完全缺乏链式思考(CoT)推理,MG在灾难性遗忘方面表现最差(指标2:0.580对比Clear的0.055),而PA显示出最弱的知识转移能力(指标3:-0.939对比Clear的-0.330)。添加缓冲组件(SDW+Buffer)改善了知识转移(指标3:-0.066),但加剧了遗忘(指标2:-0.260)。修改损失函数(SDW+Loss)增强了知识转移(指标3:0.259)并减少了遗忘(指标2:-0.341),但未能提高性能(指标1:-0.166)。完整的SDW框架实现了最佳平衡,具有最高的知识转移(指标3:0.290)和性能(指标1:-0.151)得分,以及最低的遗忘(指标2:-0.505)。这表明缓冲和损失组件之间的协同作用对于优化结果至关重要。

5 结论和未来工作

在本文中,我们提出了SDW,这是一种新颖的终身强化学习框架,它基于任务相似性动态调整学习策略。SDW的一个关键特性是使用大型预训练模型来分析任务关系,实现了一个任务相似性驱动的权重计算机制,有效地平衡了知识保留和转移。这种设计使SDW能够减轻灾难性遗忘,同时促进连续任务之间的有效知识共享。实验结果验证了SDW的有效性,展示了提高的任务性能、减少的遗忘和增强的知识转移。

对于未来的工作,我们旨在进一步利用大规模预训练模型的能力来替代手动设计的成分,例如奖励函数设计和动作辅助生成。通过自动化这些过程,SDW可以变得更加通用,并适应复杂的开放式终身强化学习场景。

A SDW设计与机制的洞察

A.1 SDW的模块化设计

空间 S 受到任务特征依赖性的约束,而 G 仅依赖于结构化的相似性分数,这两个都比 F 显著更小。这种复杂性的降低确保了生成过程更加高效和可靠,同时保持了灵活性和可解释性。

B 实验环境与评估

B.1 Atari

本节提供了我们在实验中使用的三个Atari环境的简要概述:SpaceInvadersNoFrameskip-v4、BeamRiderNoFrameskip-v4 和 MsPacmanNoFrameskip-v4。这些环境是街机学习环境(ALE)的一部分,使用Gym库进行实例化,并设计有独特的目标、动作空间和观察格式。以下对Atari游戏的描述基于https://www.gymlibrary.dev/environments/atari/complete_list中的官方文档。

在SpaceInvadersNoFrameskip-v4中,玩家控制激光炮在太空入侵者到达地球之前将其摧毁。消灭入侵者会获得分数,后排的入侵者分数更高。当所有生命丧失或入侵者到达地球时游戏结束。在BeamRiderNoFrameskip-v4中,玩家驾驶太空船,目标是摧毁敌舰、躲避攻击并避免太空碎片,成功消灭敌人会获得分数。同时,MsPacmanNoFrameskip-v4要求玩家在迷宫中导航以收集药丸,同时避免幽灵。

所有三个环境都共享一个离散的动作空间,包含18个动作,游戏特定的简化动作集可用于更有意义的游戏玩法(例如,移动、射击或组合动作)。观察默认以尺寸为(210, 160, 3)的RGB图像提供,但也支持128字节RAM表示和灰度图像等其他观察格式。此外,每个环境允许多种模式和难度级别,为各种实验设置提供了灵活的配置。

版本历史:这些环境经历了多次迭代。v0代表初始版本,v4移除了动作粘滞性,v5重新引入了动作粘滞性,同时去除了随机跳帧。这些更新通过确保复杂性和可重复性之间的平衡,提高了环境对强化学习研究的适用性。

有关这些环境及其配置的更多详细信息,请参阅街机学习环境提供的官方文档。此处总结的信息基于该来源提供的文档。

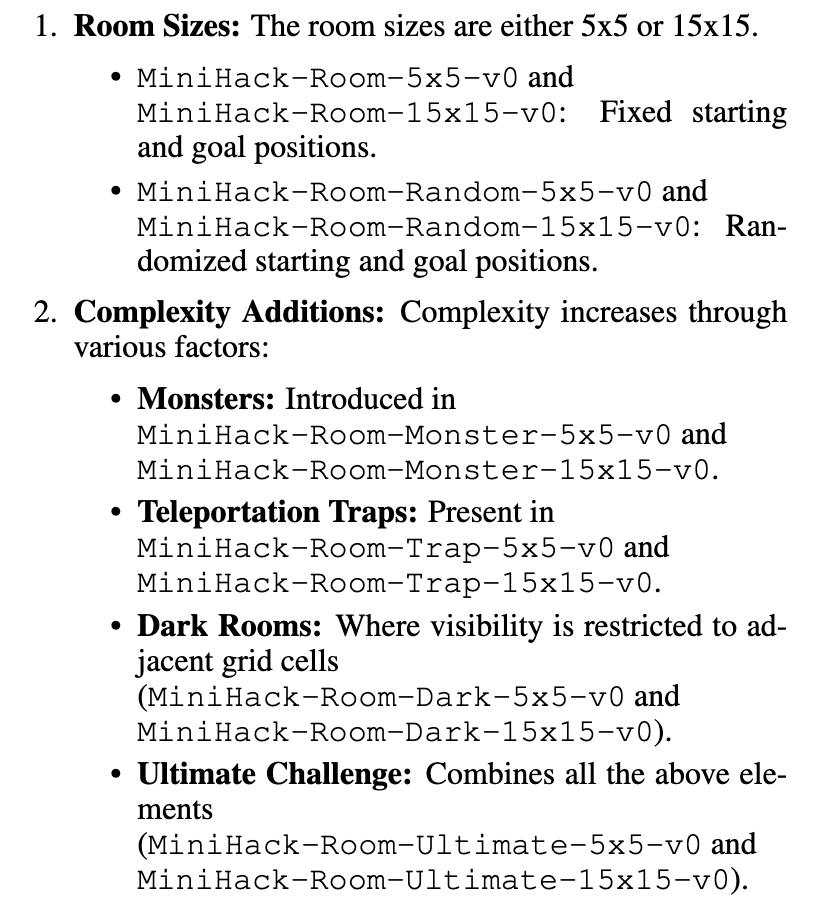

B.2 MiniHack

本节提供了我们在实验中使用的MiniHack环境的概述。每个任务都有独特的特征和挑战,包括程序生成的地图、随机化和不同复杂性级别。以下对MiniHack环境的描述基于Mikayel Samvelyan等人提供的官方文档。完整文档可在https://github.com/facebookresearch/minihack获得。

房间:房间任务发生在一个单一的方形房间中,智能体的目标是导航至通往下一层的楼梯。该环境有多种变体:

https://arxiv.org/pdf/2503.12923

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-08-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录