OpenClaw 入门指南、使用技巧和常见错误排查及解决

OpenClaw 入门指南、使用技巧和常见错误排查及解决

技术人生黄勇

发布于 2026-03-11 17:19:07

发布于 2026-03-11 17:19:07

在 AI 助手工具如此之多局面,为什么 Openclaw 会火爆出圈?它的独到之处在哪里?

我觉得是它的产品定位:以用户为视角,它并不是一个需要用户专门打开的新APP或网站去聊天,而是成为用户手中的智能助手,帮助打通主流通讯工具,完成大部分日常工作,充分利用已有的消息入口。

在架构上,为实现这种灵活的消息互通需求,采用了网关 Gateway 化设计。

启动 Gateway 作为会话、路由、渠道、大模型、工具连接的中转站。

统一对接 WhatsApp、Telegram、Discord、iMessage、QQ、飞书 等消息平台。

其次,对于一款AI产品来说,上下文是一个非常棘手处理的问题。

OpenClaw 用了一个巧妙的记忆解决方案,记忆以 Markdown 的形式保存起来,然后将 MEMORY.md 这类记忆文件注入到系统上下文,使得助手能记住使用者重要的信息,使得在使用体验上,更加智能。

相对于大模型只能聊天对话框中只会回答,编写代码,OpenClaw 采用了智能体的设计,引入了 Skill 能力,扩展出了在电脑、现实世界中的可执行能力。

第三,Skill 能力是类型化 Schema + 策略控制(allow/deny/profile),支持沙箱、会话工具、子智能体并在本地运行。

最后,在可靠性上做了很多避免中断之后的恢复机制: 每会话串行队列、Agent.wait 生命周期事件、模型故障转移——先 Profile 轮换,再 Model Fallback)。

架构设计

围绕“Gateway 为核心控制平面”的思想展开,形成了一个模块化、插件化、去中心化的多层架构体系。

详细架构分层与组件

(1) 顶层:入口层 (Entry Layer)

这一层负责接收用户指令和外部事件,是用户与系统交互的入口。

多平台接入:

Message Channels:支持 WhatsApp、Telegram、Slack、Discord、Google Chat、Signal、iMessage、QQ 等多种即时通讯平台。 Web UI:提供基于浏览器的图形化操作面板(Dashboard),用于监控系统状态和手动触发任务。 CLI & App:提供命令行接口(openclaw CLI)和 macOS 桌面应用,适合高级用户和开发者使用。 功能:负责将各种格式的用户输入标准化为系统内部的统一事件流。

(2) 核心层:控制平面 (Control Plane)

这是系统的大脑,所有的调度、路由和核心逻辑都在这里处理。

Gateway (网关):

单实例守门人:Gateway 是运行时的中枢,通常监听在 ws://127.0.0.1:18789(或可配置)。 会话与路由:负责管理会话上下文,决定用户的指令应该路由到哪个 Agent 或者哪个 Workspace 执行。

统一接口:提供 WebSocket API,供 CLI、Web UI、macOS App 等前端通过统一的方式进行通信。 Scheduler (调度器):

Cron & Heartbeat:支持定时任务(Cron)和周期巡检(Heartbeat),可自动化执行如“每天早上 9 点推送天气”或“每 5 分钟检查系统状态”的任务。 Function Runtime (函数运行时):

Agent (智能体):核心的 AI 处理单元,负责调用模型进行推理。 Tools (工具集):内置了浏览器、画布、终端、文件系统等工具,Agent 可以通过调用这些工具来执行实际操作。

Gateway 的设计是 OpenClaw 架构的核心,负责统一管理所有资源和连接。

(3) 底层:节点层 (Node Layer)

这一层负责具体的执行和资源交付。

Node Clients (节点客户端):

macOS / iOS / Android / Linux:支持跨平台运行,用户可以在不同的设备上部署 Node。 功能:提供摄像头(camera)、屏幕(screen)、画布(canvas)、定位(location)等硬件能力的适配。 Plugin SDK (插件开发套件):

扩展性:开发者可以编写插件来接入新的消息平台(如新增飞书或自定义的内部系统)或扩展新的功能。

OpenClaw 支持通过节点客户端提供硬件能力,如摄像头、屏幕等,并支持通过插件机制扩展功能。

数据/请求流

一个典型的指令处理流程如下:

输入:用户通过 WhatsApp 发送指令 "生成今天的天气报告"。

接收:WhatsApp Channel 收到消息,将其转换为标准化的事件。

路由:Gateway 接收到事件后,判断该指令属于哪个 Workspace。

处理:Gateway 将任务分配给对应的 Agent。

执行:Agent 调用 AI 模型生成文本,并通过浏览器工具抓取天气信息。

返回:生成的报告通过 WhatsApp Channel 发送回用户。

通过文件系统模拟大脑的运行

OpenClaw 另外一个鲜明的特点试图让 AI 具备“人格”与“记忆”的系统,目标是打破传统 AI “每次都是白纸”的限制,使 AI 能够:

拥有身份认知:理解自己是谁,有什么身份。

具备“三观”:拥有世界观、人生观、价值观。

具有记忆:能记住过去的对话、事件,并在未来调用。

会成长:通过错误学习,随着时间推移变得越来越“聪明”。

核心机制解析

OpenClaw 的底层逻辑基于“动态的上下文(Live Context)”,它通过一种独特的文件系统结构来模拟大脑的功能。

1. 动态上下文拼装(Live Context)

传统 AI 的提示词(Prompt)是静态的,而 OpenClaw 的提示词是动态拼装的。

拼装逻辑:每次对话开始时,系统会读取一系列 Markdown 文件(如 AGENTS.md, SOUL.md, memory/2026-02-05.md),并将它们拼接成一段完整的提示词喂给模型。

U型注意力分布:模型对提示词的开头和结尾最敏感,OpenClaw 利用了这一点,将最关键的文件放在前后(例如 AGENTS.md 放头部,memory/ 放尾部),确保模型优先关注重要信息。

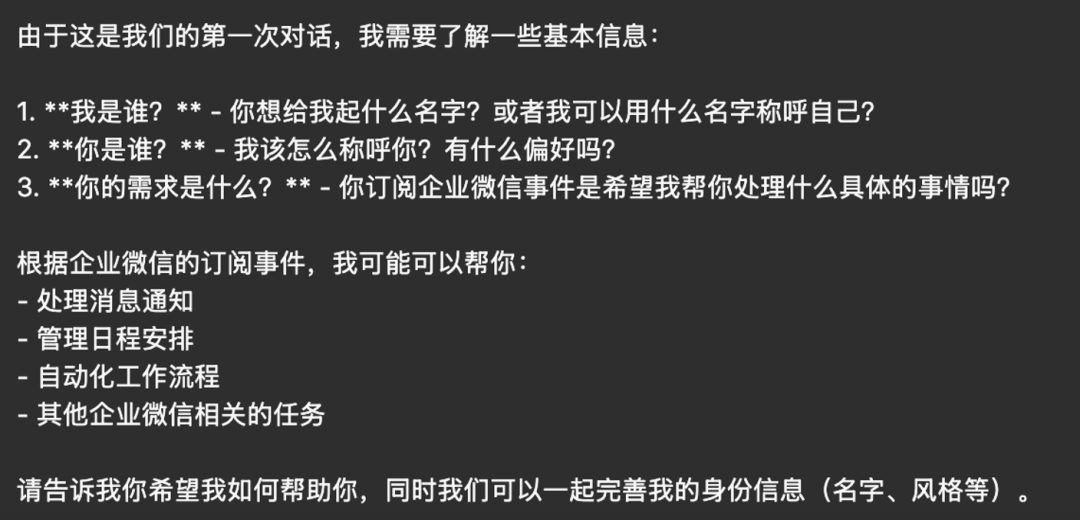

新生儿逻辑:第一次运行时,会有一个 BOOTSTRAP.md 文件,系统会主动引导用户为 AI 设定名字和性格。完成后,这个文件会被删除。

2. 文件系统分区(Memory Partition)

OpenClaw 通过文件系统模拟了记忆的层级结构:

AGENTS.md(宪法):极高权限,仅用户能添加。存放“绝对不能违反”的规则(如“不可撒谎”)。

SOUL.md(灵魂):极高权限,AI 自己可以修改。存放三观(世界观、人生观、价值观)。

IDENTITY.md / USER.md / TOOLS.md:高权限,AI 可以修改。分别存放身份认知(如“我叫小爪”)、用户偏好(如“讨厌啰嗦”)和环境配置(如 IP 地址)。

MEMORY.md:中权限,长期记忆的蒸馏结果。 memory/YYYY-MM-DD.md:低权限,每日日志,记录原始对话。

3. 心跳机制(Heartbeat)

心跳机制是能让 AI 主动进化的关键。

定时唤醒:后台服务每隔固定时间(默认 30 分钟)会“戳”一下 AI。

主动执行:如果 HEARTBEAT.md 中有任务(如“整理本周日志”),AI 会在无人值守时自动执行,而不是等用户纠正。

异步任务:当用户部署脚本等需要耗时的任务时,AI 可以通过心跳机制在任务完成后被唤醒,主动向用户报告结果。

4. 记忆检索与学习

混合搜索:当日志文件过多(几百个)时,AI 不会一次性读完。它会调用 memory_search 工具,结合向量检索(语义相似)和关键字搜索,返回最相关的几条日志。

写入记忆:AI 学到新技巧或发现错误时,会直接写入相应的文件(如 TOOLS.md),确保下次即使是新会话也能直接调用。

这一套工程化的实践方案,弥补了 LLM(大型语言模型)短期记忆有限和缺乏自我意识的缺陷,使 AI 助手能够表现出类似人类的“记忆力”和“成长性”。

使用技巧

- 常用的后台命令(在命令行执行)

openclaw status # 查看整体状态

openclaw gateway status # 查看 Gateway 运行状态

openclaw health # 健康检查

openclaw configure # 重新配置(修改模型、频道等)

openclaw daemon restart # 重启后台服务

openclaw daemon logs # 查看运行日志- 精准控制

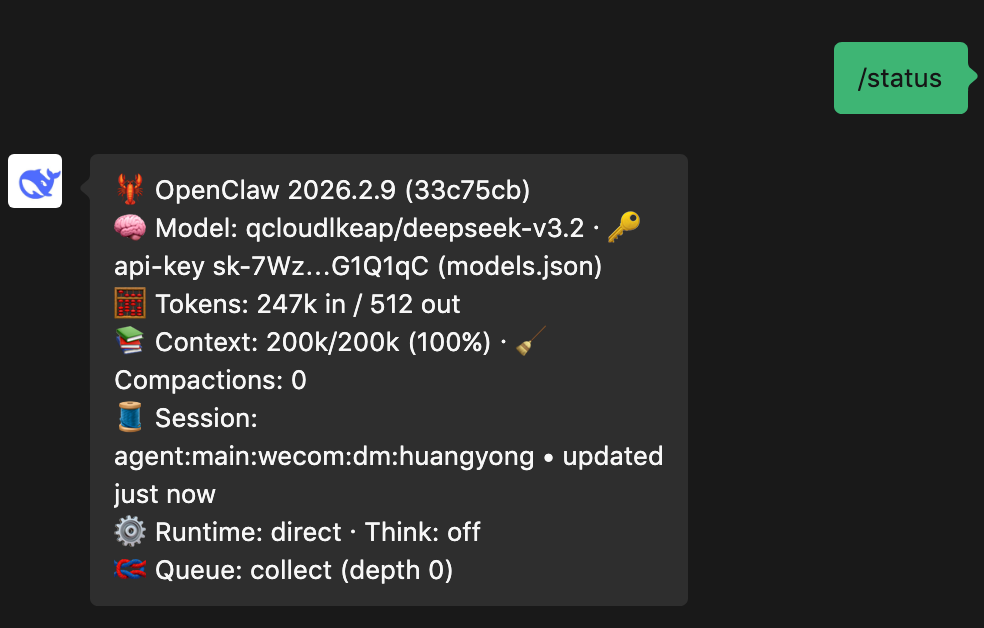

/status显示当前会话状态信息

/context detail查看模型看到的上下文

/model查看或切换当前模型

/think调整模型的思考深度

/stop立即中止当前任务用法:直接从对话框发送给OpenClaw即可,不消耗Token。看不懂的,可以让它帮你解释输出内容。

- 配置多个模型,执行不同的任务

第一步:配置多个模型;

第二步:告诉OpenClaw按照模型特点分别设置别名:cheap、smart、 code;

第三步:告诉OpenClaw在分配子Agent时按如下规则分配模型:

整理/提醒/改写/简单查询 - cheap

调研/方案/权衡/复杂分析 - smart

写代码/改bug/PR/测试/排查日志 - code

- 分身术

让你的龙虾化身"龙虾团"

如何触发子Agent处理任务?

场景一、你明确要求例如:"帮我开一个子Agent来分析问题"

场景二、适合后台并行的任务例如:资料调研、日志分析、代码扫描

场景三、能够拆解为多个子任务,OpenClaw 可能会自行开启子Agent执行

说明:

1、主Agent和子Agent之间记忆共享,上下文隔离。

2、可以限制最多运行的子Agent 数量,防止API限频或Token 消耗加剧。

- 限频导致 Skills 技能安装失败?

让OpenClaw自己安!

第一步:在本地访问Clawhub,找到想下载的Skill;

第二步:将Skill下载至本地;

第三步:将Skill压缩包通过对话发给OpenClaw,或者手动把Skill文件上传到/workspace/skills目录下。

第四步:同时告诉它"帮我安装这个Skill";

第五步:等待安装完成。

- 遇到 OpenClaw 没有响应

逐一输入下面命令查看小龙虾的运行情况,可以帮助排查问题所在。

openclaw status --all 频道、Agent、网关等信息

openclawgateway probe 探测网关的连通性

openclaw gateway status 检查网关服务状态

openclaw doctor 诊断龙虾配置和服务状态

openclaw logs --follow 实时日志输出一般情况下,遇到里面有错误信息,执行 openclaw doctor --fix 能解决大部分问题。

不带 fix 参数会进行健康检查:检查 Gateway、认证、沙箱、配置文件等各方面的健康状态,带 fix 参数则自动修复。

context_length_exceeded 解决方案

"400 input length too long",这个错误我经常遇到,而且困扰了很长时间。

核心原因:该错误由 LLM 上下文窗口 限制触发。

触发机制:当 系统提示 + 对话历史 + 当前消息 的总 Token 数量 超过模型的最大上下文容量 时(如 200K tokens),OpenClaw 将返回 context_length_exceeded 错误。

根本根源:对话进行时间过长(如持续数小时)或消息累积过多,导致早期的详细对话记录被压缩或截断,超出了模型一次性处理的能力。

解决方案

调小历史管理阈值:降低 maxHistoryMessages 参数(如设置为 50 或 30),显著减少历史记录占用的 Token 数量。

自动摘要与存储:当上下文快满时,OpenClaw 会自动触发摘要压缩。在此之前,系统会提醒 Agent 将关键结论写入 memory/ 目录进行落盘,确保关键信息不会丢失。

用 /status 跟 OpenClaw 对话可以查看上下文窗口到底有多满。如果显示使用率超过 80%,自动压缩应该会自动触发——但如果还没有触发,手动执行 /compact 就能解决问题。

监控与预警:实现上下文利用率监控,在占用率达到 80% 时提前发出警告,或在达到阈值前自动进行摘要或截断。

使用长上下文模型:如果业务场景必须保留大量历史记录,考虑切换到支持更长上下文窗口的模型(如 Claude 200K tokens)

最后,推荐一个在线 OpenClaw 的AI 小助手:https://s.ddnsip.cn/openclaw。

是集成了各类教程文档的 OpenClaw(Clawdbot) 小客服,专门帮忙搞定 OpenClaw 的部署难题,有报错信息,它还会去源码里去找出处,精准定位问题。

推荐阅读

- 还不知道用OpenClaw做什么,看看这些实际案例和教程:提升效率、研究学习、新闻摘要、金融交易

- OpenClaw 又慢还费钱,你需要给它安装这个 Skill 技能:本地语义搜索引擎 QMD

- Anthropic 发布 2026 Agentic Coding 趋势报告 | 开发者的核心竞争力是问题定义和价值判断

- 谷歌提示工程白皮书|Google Prompt Engineering White-paper

- 你的 OpenClaw 该「进化」了,全球使用者贡献好用、实用的基因「Gene 」|Agent 神器

- 使用 OpenClaw小心:为了完成给它的任务,它们居然学会了这招......

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-28,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录