YOLO26-Pose 深度解读:端到端架构重新设计,姿态估计凭什么跨代领先?

原创YOLO26-Pose 深度解读:端到端架构重新设计,姿态估计凭什么跨代领先?

原创

CoovallyAIHub

发布于 2026-03-11 10:25:37

发布于 2026-03-11 10:25:37

2026年1月14日,Ultralytics 正式发布 YOLO26 模型家族。3月9日,官方博客发布对比解析文章,全面拆解其姿态估计能力。本文基于该文,带你看懂 YOLO26-Pose 的核心升级。

什么是姿态估计?为什么它越来越重要?

姿态估计(Pose Estimation)是一种用于检测和追踪图像或视频帧中特定关键点的技术。这些关键点代表着结构性地标——人体关节、动物肢体、机械部件、甚至场景中的参考点。

与分类或基础目标检测不同,姿态估计能提供关于结构和运动的精细空间信息,是智能健身、自动驾驶、工业安全等领域不可或缺的底层能力。

今年1月14日发布的 YOLO26-Pose,正在让这项能力变得更快、更准、更易部署。

图片

YOLO26-Pose:四大核心升级

1. 端到端架构,彻底告别 NMS

这是 YOLO26 最具颠覆性的改变。

以往的 YOLOv8-Pose、YOLO11-Pose 在推理时都依赖外部的非极大值抑制(NMS)后处理步骤。而 YOLO26 采用端到端设计,推理时无需 NMS,直接输出最终结果。

这意味着什么?

- 部署更简单:减少了外部依赖和工程复杂度

- 延迟更稳定:尤其在 CPU 和边缘设备上表现突出

- 流水线更干净:从训练到部署,一条龙无缝衔接

2. 突破"人体假设",非人类关键点全面优化

前代模型在设计时带有较强的"人体特定假设",导致在非人体场景(如机械零件角点、运动场标记点、基础设施节点)中表现受限。

YOLO26 主动移除了这些假设,使得模型在自定义数据集上的微调效果显著提升。无论你要检测的是人体关节还是工业设备的关键部位,YOLO26 都能从容应对。

3. 训练效率飞跃:更快收敛,更少 Epoch

YOLO26 在训练层面带来了多项改进:

- 改进的损失函数设计:学习过程更高效

- 残差对数似然估计(Residual Log-Likelihood Estimation):为关键点引入不确定性建模,模型"知道自己不确定什么"

- MuSGD 优化器:全新引入的优化器,配合更新的损失策略,训练更稳定

- 更快收敛:所需训练轮数显著减少,节省算力和时间

4. 遮挡处理能力大幅增强

在实际场景中,目标被部分遮挡或尺度极小是家常便饭。YOLO26 在关键点定位上针对这两个痛点做了专项优化:

- 部分遮挡场景下的关键点预测更准确

- 无人机视角、小目标场景表现提升明显

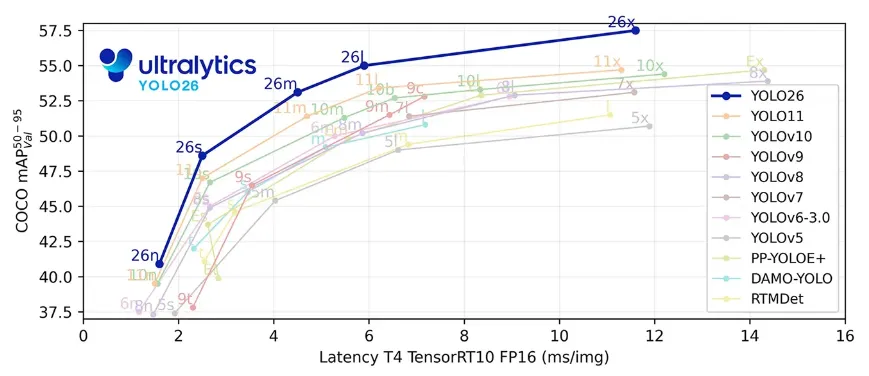

横向对比:YOLO26 vs 前代模型

图片

对比维度 | YOLOv5 | YOLOv8 | YOLO11 | YOLO26 |

|---|---|---|---|---|

原生姿态估计支持 | 不支持 | 支持 | 支持 | 支持 |

架构定位 | 纯检测 | 统一框架引入原生 Pose | 骨干网络效率优化 | 端到端重新设计 |

是否需要 NMS | — | 需要 | 沿用传统流程 | 无需 |

非人类关键点适配 | 有限 | 一般 | 一般 | 专项优化 |

训练收敛速度 | — | 基线 | 改进 | 最快 |

一句话总结各代差异:

- YOLOv5:为目标检测而生,没有专门的姿态估计头,想做 Pose 只能"曲线救国"

- YOLOv8-Pose:建立了强大且通用的基线,姿态估计正式成为 YOLO 原生任务

- YOLO11-Pose:在 YOLOv8 基础上优化了骨干网络和特征提取层,降低了 FLOPs、提升了参数效率,在保持实时性能的同时获得了更高的 mAP

- YOLO26-Pose:不是增量式修补,而是架构层面的重新设计——更快的收敛、更稳的推理、更强的泛化

四大落地场景,YOLO26-Pose 大有可为

医疗康复

临床医生通过运动分析评估患者姿态,监控康复进度。YOLO26 的遮挡处理能力让病房环境中的关键点检测更可靠。

自动驾驶与无人机

在动态场景中理解目标的朝向和姿态,是智能体决策的关键输入。无需 NMS 的端到端推理让边缘部署更高效。

工作场所安全

监测工人的身体姿态和重复性动作,识别潜在的安全风险。实时反馈有助于预防工伤事故。

图片

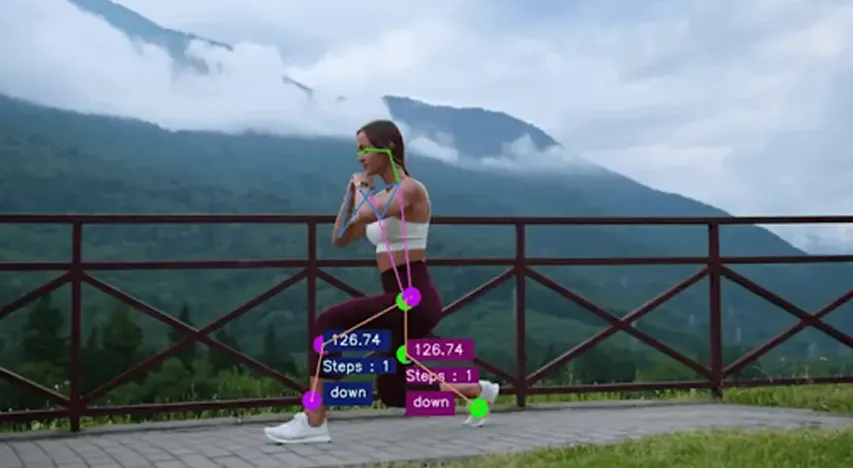

智能健身与个人训练

追踪运动姿态、计数训练次数、实时纠正动作——YOLO26 更快的推理速度让体验更流畅。

图片

迁移成本几乎为零

如果你已经在用 YOLOv8-Pose 或 YOLO11-Pose,切换到 YOLO26-Pose 通常只需要改一个模型版本号,不需要重建整个流水线。

# 从 YOLO11 升级到 YOLO26,就是这么简单from ultralytics import YOLO# model = YOLO("yolo11n-pose.pt") # 旧版本model = YOLO("yolo26n-pose.pt") # 新版本,其余代码不变YOLO26 同样支持导出为 ONNX、TensorRT、OpenVINO、CoreML、TFLite 等格式,跨平台部署无忧。

模型变体选择指南

YOLO26-Pose 提供了从轻到重的完整产品线:

变体 | 适用场景 |

|---|---|

YOLO26n | 边缘设备、移动端、实时性优先 |

YOLO26m | 速度与精度的平衡之选 |

YOLO26l | 精度优先的服务端部署 |

YOLO26x | 追求极致精度,算力充足的场景 |

所有变体均支持在 COCO-Pose 等数据集上预训练,并可快速微调到你的自定义任务。

写在最后

YOLO26-Pose 不是一次简单的版本迭代,而是姿态估计框架在架构层面的一次"代际升级":

- 端到端设计让部署从"能用"变成"好用"

- 非人类关键点优化让应用从"人体专用"走向"万物皆可 Pose"

- 训练效率的提升让每一块 GPU 的投入都更有价值

- 遮挡处理的进步让模型在真实世界中更抗打

YOLO26-Pose 发布已近两个月,生态和社区支持正在快速完善。如果你正在做姿态估计相关的项目,现在是上手体验的好时机——迁移成本几乎为零,性能提升却是实打实的。

参考来源:Ultralytics 官方博客《Ultralytics YOLO26 vs. other Ultralytics YOLO models for pose estimation》,2026年3月9日发布。

YOLO26 模型发布日期:2026年1月14日 | 原文作者:Abirami Vina

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录