NeurIPS 2025 | 时空基础模型新范式FactoST:从"联合苦训"到"先通后专"

NeurIPS 2025 | 时空基础模型新范式FactoST:从"联合苦训"到"先通后专"

时空探索之旅

发布于 2026-03-10 15:57:35

发布于 2026-03-10 15:57:35

📝 论文信息速览

- FactoST v1: "Learning to Factorize Spatio-Temporal Foundation Models" NeurIPS 2025 | 📄 https://openreview.net/forum?id=d4CZoiaXeC

- FactoST v2: "Learning to Factorize and Adapt: A Versatile Approach Toward Universal Spatio-Temporal Foundation Models" Arxiv 2026 | 📄 https://arxiv.org/abs/2601.12083

- 💻 开源代码: https://github.com/CityMind-Lab/FactoST

TL;DR: 港科广&华为提出 FactoST 系列,首创"先练时间、再补空间"的因子化时空基础模型范式,破解传统联合预训练的"负迁移"困局。v2版本彻底升级为 Encoder-Only 架构,实现100%预训练权重全转移与任意长度预测,并引入概率分位数预测量化不确定性。在少样本场景下,相比SOTA模型最高降低46.4% 误差,推理速度提升68% ,相关技术已在电力、航空、能源等业务场景落地验证,首次让时空大模型真正"快准稳"。

本文由香港科技大学(广州)、华为2012实验室、华东师范大学、北京大学联合出品

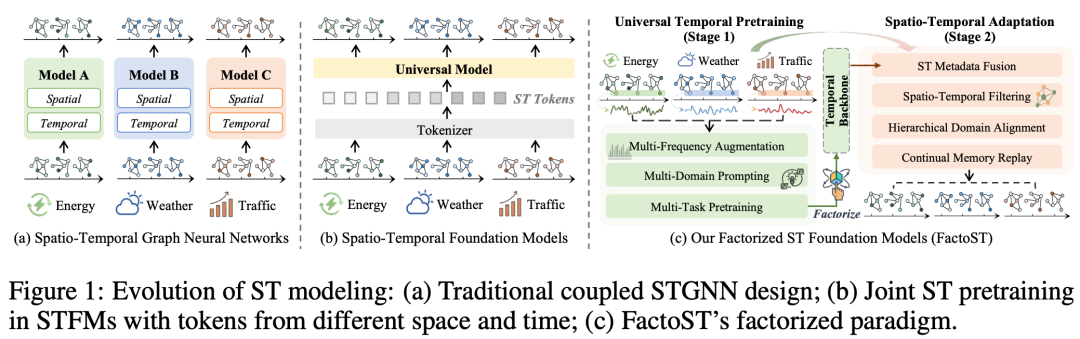

🌍 背景:时空数据的"万物互联"困境

交通流量、气象变化、电网负荷、空气质量……这些时空(Spatio-Temporal, ST)数据不仅记录着"何时"的变化,更蕴含着"何地"的关联。传统方法(STGNN)针对每个特定数据集单独训练,就像"一个师傅只教一本书",难以应对跨城市、跨领域的泛化需求。

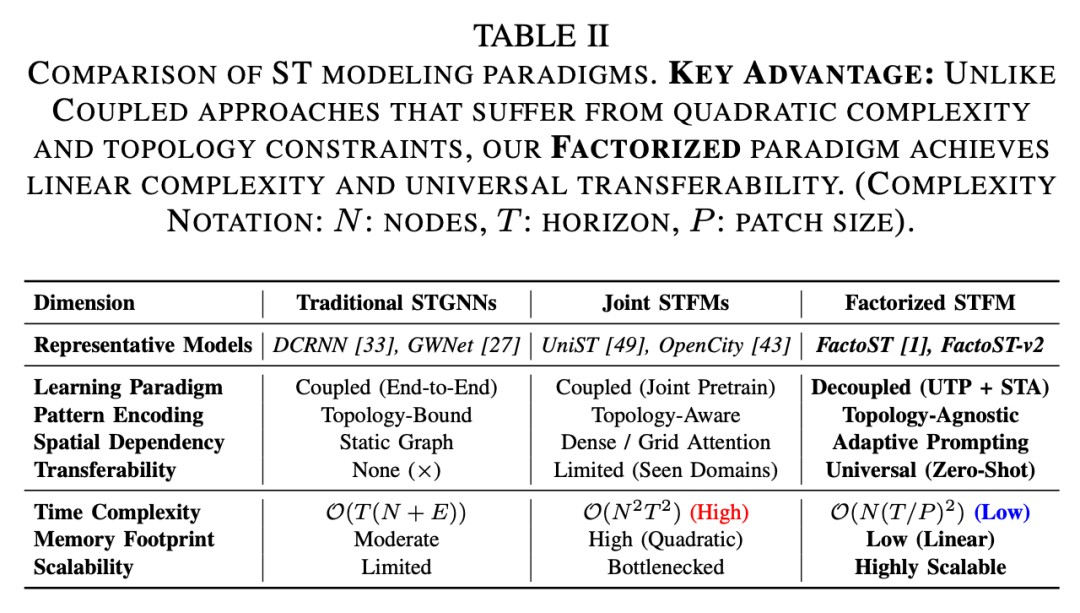

近年来,时空基础模型(STFMs)应运而生,试图通过海量数据预训练实现"一次学习,到处可用"。然而,现有方案大多采用联合时空预训练(Joint ST Pretraining)——同时建模空间图结构和时间序列。这种"眉毛胡子一把抓"的做法带来了严峻挑战:

🚧 核心挑战:时空模式的"天然矛盾"

- 时间模式是通用的:周期性、趋势性等1D时间结构在交通、能源、气象等不同域中共享相似的物理规律。

- 空间模式是域特定的:道路网络的拓扑结构与电网完全不同,相邻气象站的扩散动态与太平洋气候指数的遥相关效应更是天差地别。

- 计算成本爆炸:联合建模导致复杂度高达 ,在大型图网络上显存激增,甚至引发"过压缩(over-squashing)"问题。

关键洞察:强行让模型在预训练阶段"记住"所有可能的空间结构,不仅计算昂贵,反而会因拓扑冲突导致负迁移(Negative Transfer)。

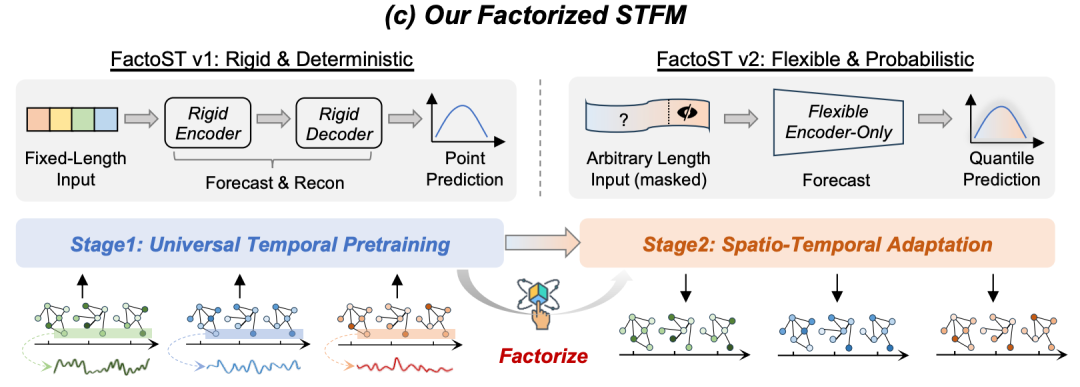

💡 FactoST 核心方案:因子化解耦(Factorize & Adapt)

针对上述矛盾,团队提出 "先时间、后空间"的两阶段因子化范式 FactoST系列通过 "时间预训练+空间适配"的因子化思想 ,成功破解了时空基础模型"大而全却不好用"的困局:

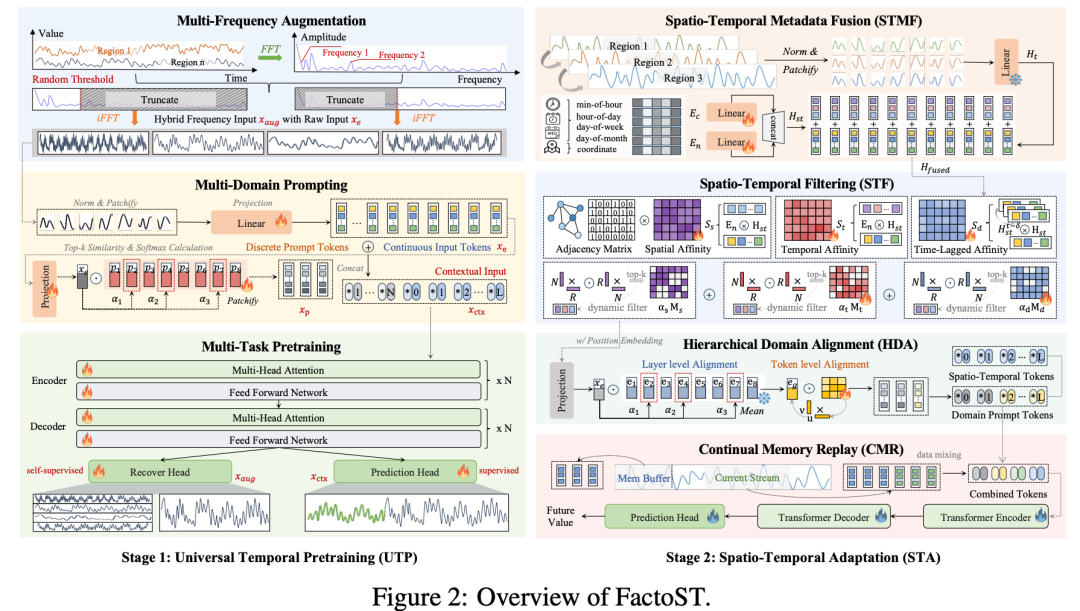

Stage 1: Universal Temporal Pretraining (UTP)

目标:学习跨域通用的"时间常识"(周期、趋势、多频波动)

- 空间无关:预训练时完全摒弃图结构,仅对节点级时间序列进行建模,避免被特定拓扑"污染"

- 多频率增强:通过FFT频域截断生成多视图,让模型掌握不同时间尺度的规律

- 多域提示学习:用可学习的Prompt向量编码域上下文,实现跨域知识共享

Stage 2: Spatio-Temporal Adaptation (STA)

目标:轻量级注入域特定的空间感知

- ST元数据融合(STMF):结合节点ID、日历信息(小时/星期/月份)生成时空标识符

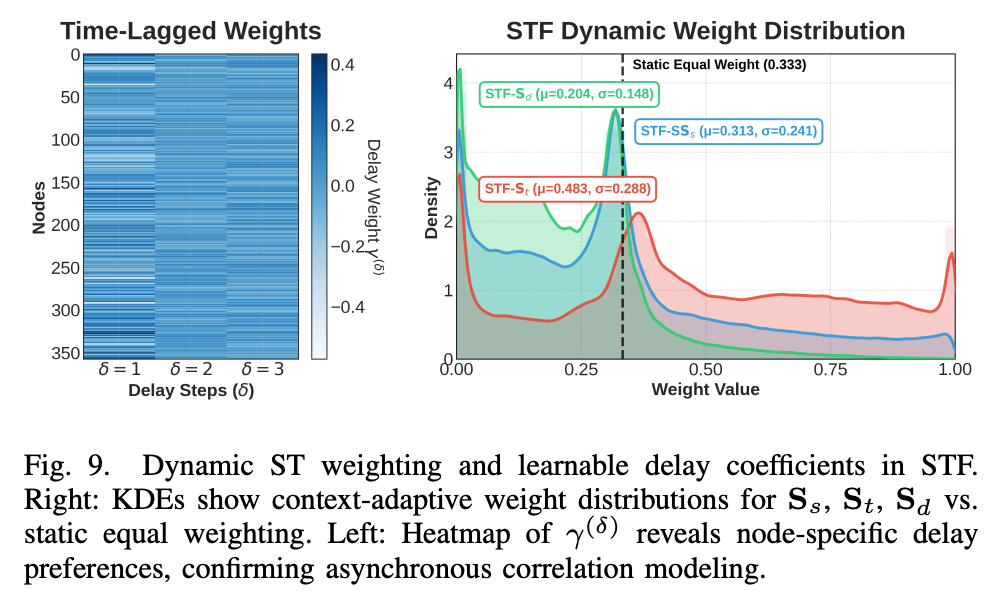

- ST过滤(STF):动态计算三种亲和力(空间、时间、时滞),自适应地重新加权特征

- 域对齐与记忆回放:通过层次化对齐(HDA/DSPA)bridged 预训练与目标域的分布差异,并用记忆库(CMR)防止灾难性遗忘

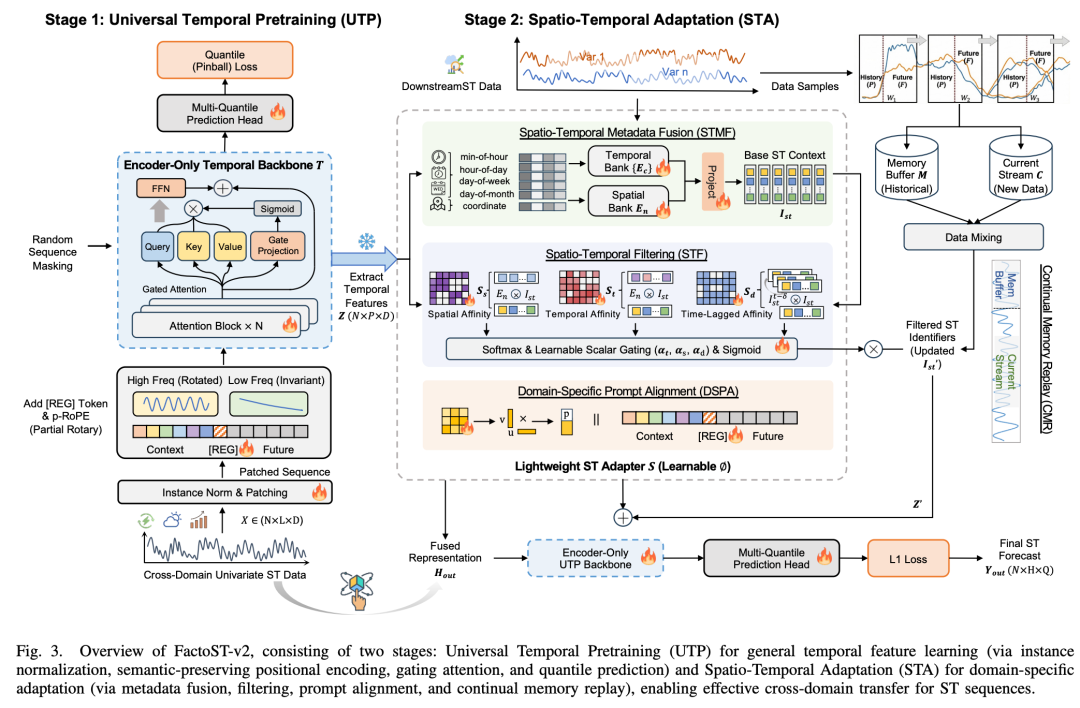

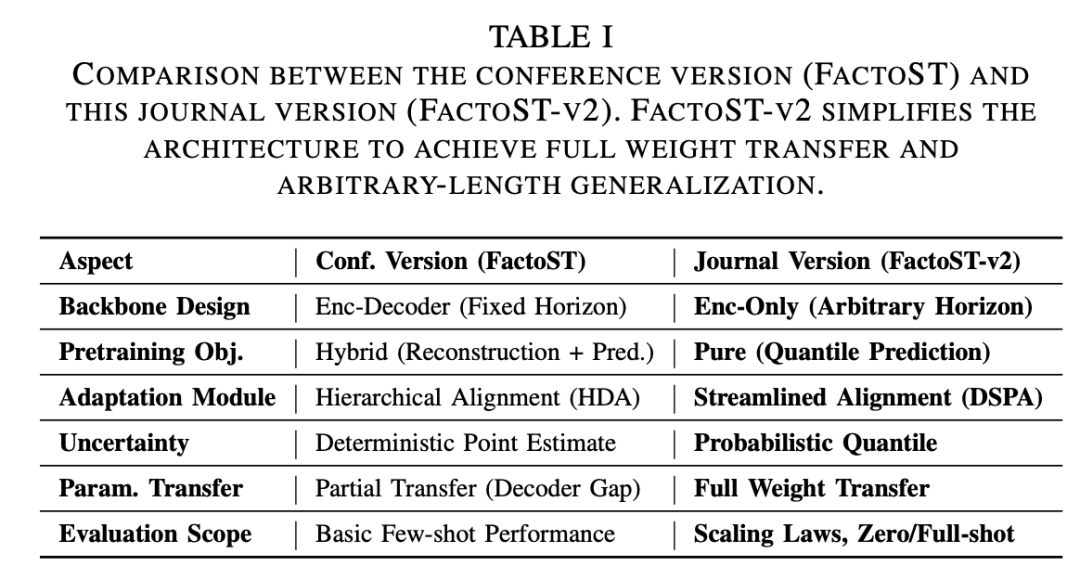

🚀 从 v1 到 v2:从"能用"到"好用"的质变

在NeurIPS 2025(v1)的基础上,团队于Arxiv 2026推出FactoST-v2,实现了架构层面的关键跃迁:

维度 | FactoST v1 (NeurIPS) | FactoST v2 (Arxiv) | 升级意义 |

|---|---|---|---|

架构 | Encoder-Decoder(固定长度) | Encoder-Only(任意长度) | 支持可变输入输出,100%权重迁移 |

预测 | 确定性点估计 | 概率分位数预测 | 输出置信区间,支持不确定性量化 |

适配器 | 层次域对齐(HDA) | 域特定提示对齐(DSPA) | 更轻量、更直接的域适应 |

预训练任务 | 混合(重建+预测) | 纯预测(Pinball Loss) | 消除任务冗余,优化目标更纯粹 |

位置编码 | 正余弦位置编码 | p-RoPE(部分旋转) | 高频部分建模顺序,低频保留语义 |

关键创新详解:

- 随机序列掩码:在预训练时随机遮盖历史序列的初始片段,迫使模型适应不同有效上下文长度,实现"任意长度泛化"

- 全权重转移:v1中解码器常被丢弃,预测头长度不匹配参数会失效,v2的纯编码器设计确保预训练权重100%复用,通过最大化预测头长度截断和滚动预测实现预测头参数全量转移,下游只需训练轻量级适配器(<5%参数)

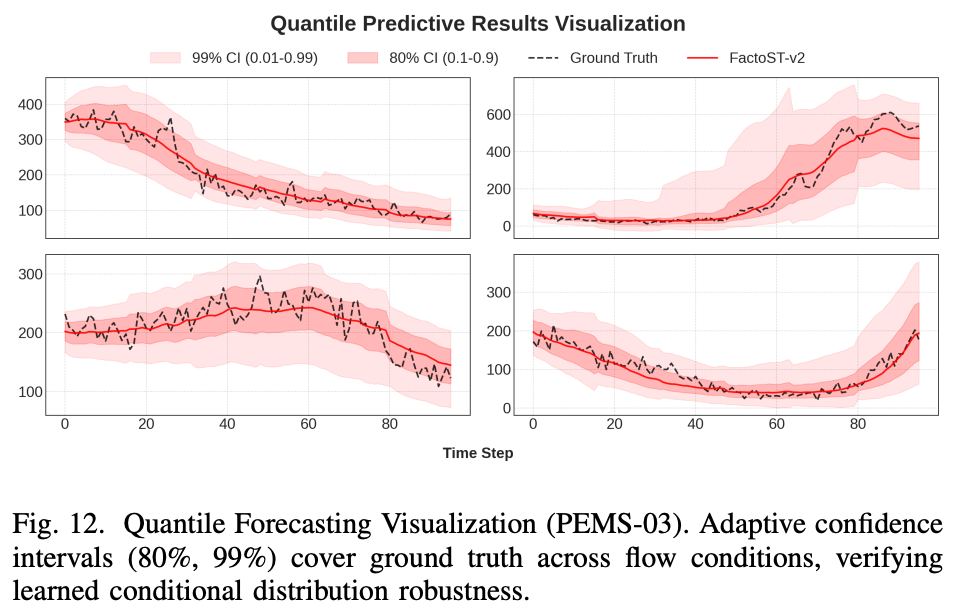

- 分位数概率预测(Quantile Loss):v1采用MSE进行确定性点估计,无法评估预测可信度;v2引入Pinball Loss同时建模多个分位数(如10%、50%、90%),输出概率区间预测,让模型在交通预警、电网调度等高风险场景中提供"置信度参考",从"猜一个数"升级为"给出一个范围及把握"

- 线性复杂度:因子化设计将复杂度从 降至 ,轻松应对883+节点的大型网络

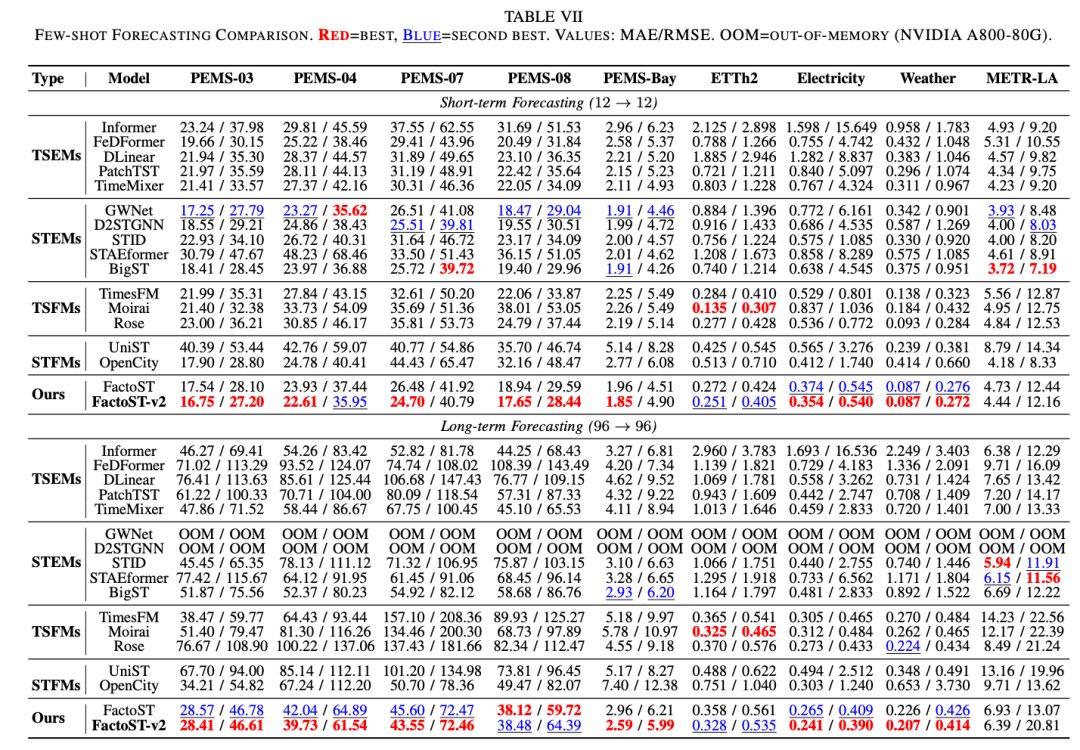

📊 实验验证:又快又准的"SOTA"表现

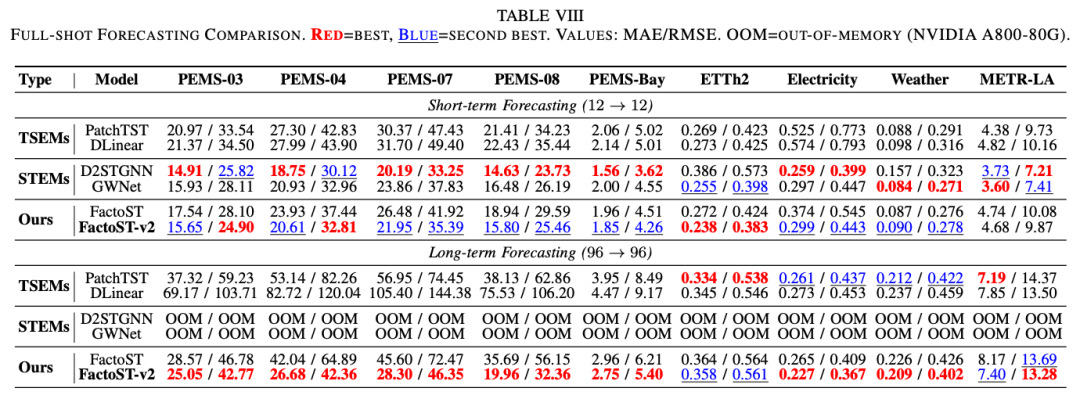

在8个标准时空数据集(PEMS、METR-LA、ETTh2等)上,FactoST系列展现出卓越性能:

1. 少样本学习(Few-shot, 10%数据)

- 相比现有STFMs(UniST、OpenCity),MAE最高降低46.4%

- 相比纯时间序列基础模型(TimesFM),利用轻量级空间适配即可显著降低误差

- 参数减少46.2%,推理速度提升68% (相比OpenCity)

image.png

image.png

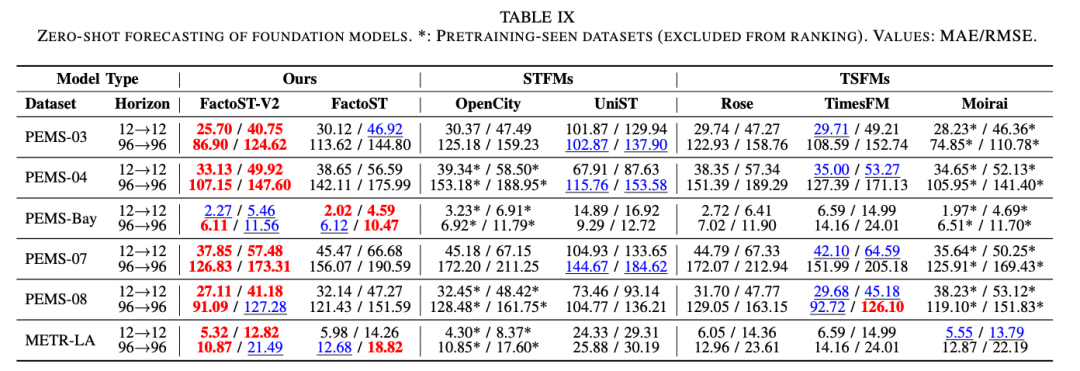

2. 零样本与全样本

- Zero-shot:即使不微调,仅依靠预训练的时间编码也能超越多数联合预训练模型,证明"空间解耦"的有效性

- Full-shot:线性复杂度使其在长程预测(96→96)中避免OOM(显存溢出),而传统STGNN(如D2STGNN、GWNet)已无法运行

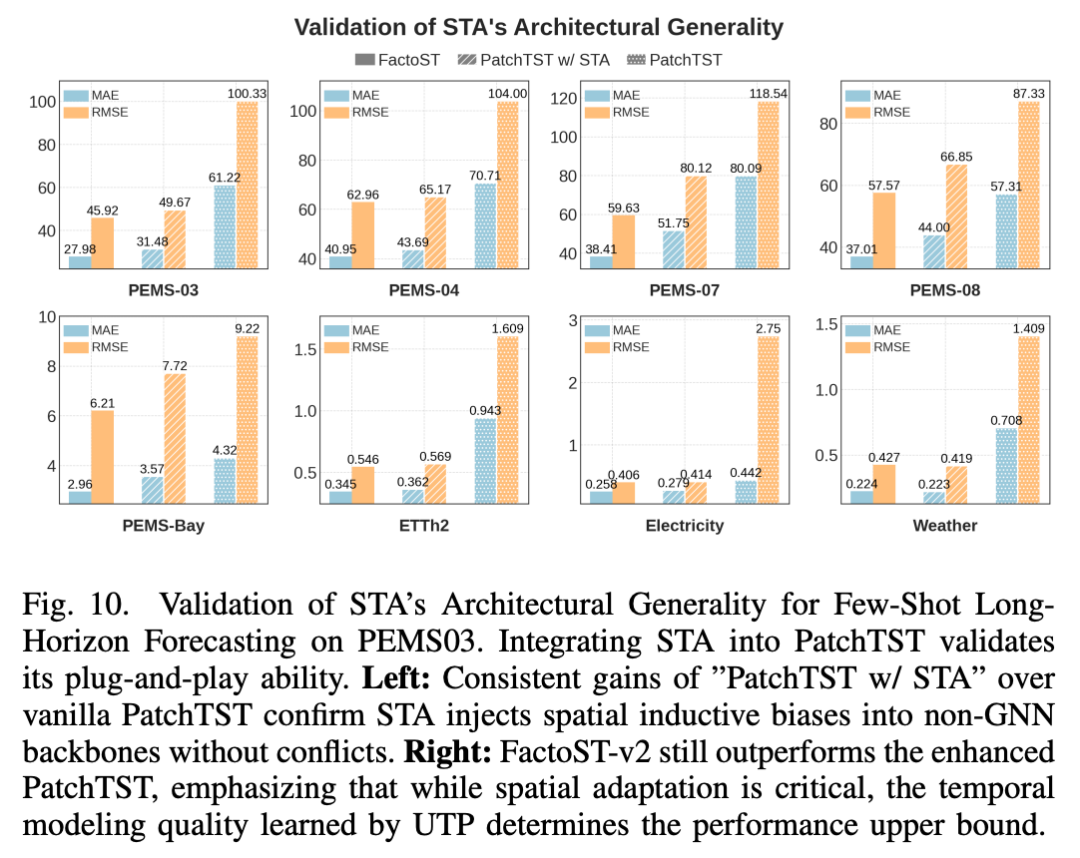

3. 架构通用性验证

将STA适配器"即插即用"到PatchTST(纯时间模型)上,显著提升其空间建模能力,证明该适配器与具体骨干网络无关,具有广泛适用性。

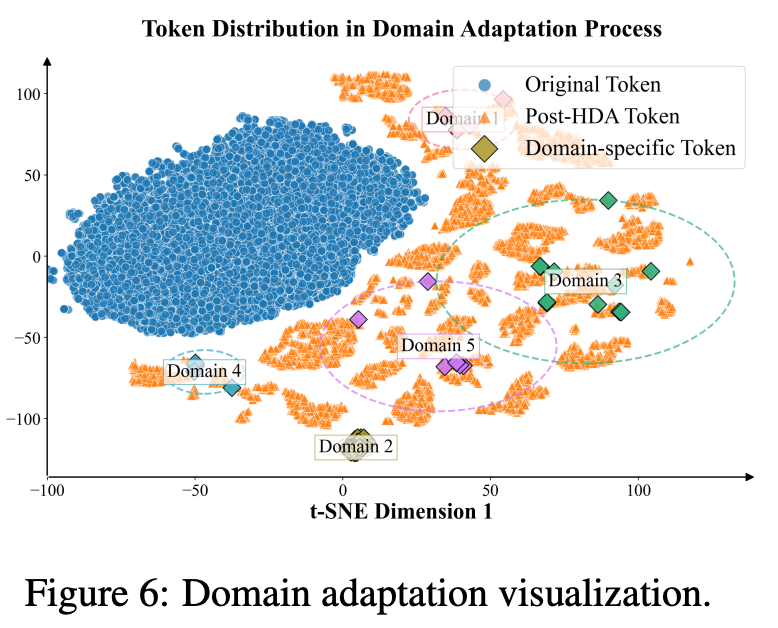

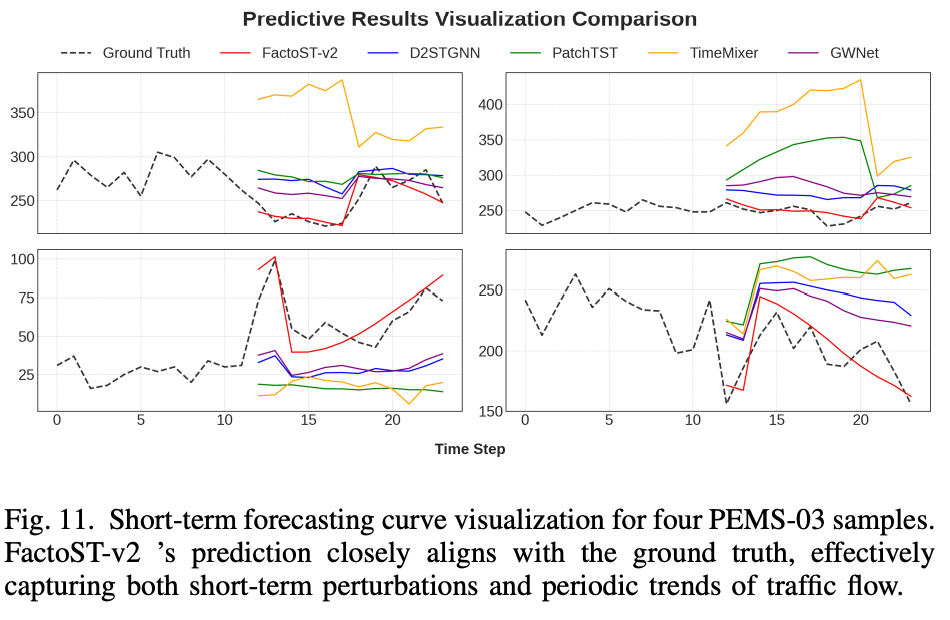

4. 可视化分析

- 域适应过程:t-SNE显示经过HDA/DSPA后,目标域嵌入明显向预训练域靠近,同时保持结构稳定

- 动态权重:STF模块自动学习到时滞(Time-Lagged)在交通预测中的重要性,无需人工先验

- 预测曲线可视化:相比时空专家模型更能捕捉周期性和趋势性,概率区间预测动态适应波动性(99%和80%置信区间)

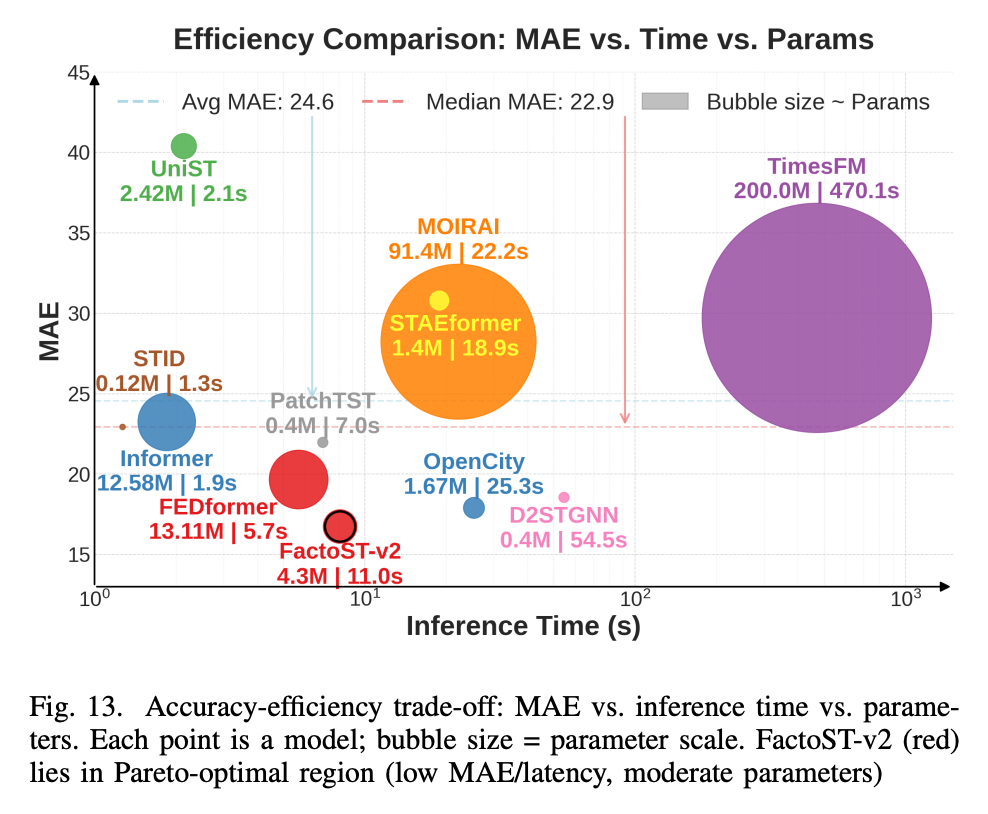

5. 效率分析

FactoST-v2实现了高精度、低参数、低延迟的帕累托最优:

- 在PEMS-03数据集上,4.3M参数即可达到MAE 16.65

- 相比OpenCity(25.3s推理时间)和Moirai(91.4M参数),11.0s推理时间与极小参数量使其更适合边缘部署

🎯 总结与展望

FactoST系列通过"时间预训练+空间适配"的因子化思想,成功破解了时空基础模型"大而全却不好用"的困局:

✅ 理论价值:揭示时空模式的不对称性规律——通用性蕴含于时间维度,特异性根植于空间维度,为时空智能领域提供全新设计范式 ✅ 实用价值:通过阶段级解耦设计实现跨域泛化,模型轻量可插拔、资源消耗低,具备极强的二次开发与拓展性

未来方向:团队正探索如何融入大语言模型(LLM)进行开放世界的空间泛化,以及如何处理动态变化的城市拓扑结构。FactoST-v2的代码已开源,期待与社区共同推动时空AI的民主化!

📌 引用格式:

@inproceedings{zhonglearning,

title={Learning to Factorize Spatio-Temporal Foundation Models},

author={Zhong, Siru and Qiu, Junjie and Wu, Yangyu and Zou, Xingchen and Rao, Zhongwen and Yang, Bin and Guo, Chenjuan and Xu, Hao and Liang, Yuxuan},

booktitle={The Thirty-ninth Annual Conference on Neural Information Processing Systems}

}

@article{zhong2026learning,

title={Learning to Factorize and Adapt: A Versatile Approach Toward Universal Spatio-Temporal Foundation Models},

author={Zhong, Siru and Qiu, Junjie and Wu, Yangyu and Liu, Yiqiu and He, Yuanpeng and Rao, Zhongwen and Yang, Bin and Guo, Chenjuan and Xu, Hao and Liang, Yuxuan},

journal={arXiv preprint arXiv:2601.12083},

year={2026}

}

推荐阅读

NeurIPS 2025 | ST-SSDL:我们如何让时空预测模型学会“偏差建模”?

NeurIPS 2025 | 时空数据(Spatial-temporal)论文总结[上]

NeurIPS 2025 | 时空数据(Spatial-temporal)论文总结[下]

如果觉得有帮助还请分享,在看,点赞

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-01,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录