AI论文速读 | 深度时序预测什么才是关键?四大设计维度拆解虚假进步,重塑评估标准

AI论文速读 | 深度时序预测什么才是关键?四大设计维度拆解虚假进步,重塑评估标准

时空探索之旅

发布于 2026-03-10 15:45:05

发布于 2026-03-10 15:45:05

论文标题:What Matters in Deep Learning for Time Series Forecasting?

作者: Valentina Moretti, Andrea Cini, Ivan Marisca, Cesare Alippi

机构:IDSIA(意大利瑞士大学),米兰理工大学

论文链接:https://arxiv.org/abs/2512.22702

Cool Paper:https://papers.cool/arxiv/2512.22702

TL;DR:本文指出当前深度学习时间序列预测领域存在架构复杂、实验结果矛盾、基准测试不合理等问题。通过分析模型配置、预处理与外部变量、时间处理、空间处理四大设计维度,发现简单架构(如 MLP)经合理设计可匹配最先进模型性能,被忽视的实现细节对结果影响显著,而部分复杂组件(如空间注意力)作用有限。文章呼吁优化基准测试流程,并提出预测模型卡片模板,以提升研究透明度与可比性,推动领域聚焦核心设计问题。

关键词:时间序列预测、Benchmark,模块化设计,预测模型卡片

点击文末阅读原文跳转本文arXiv链接

摘要

深度学习模型在时间序列应用中越来越受欢迎。然而,大量新提出的架构,加上往往相互矛盾的实证结果,使得很难评估哪些组件对最终性能有显著贡献。本文旨在通过讨论能够解释(往往是出乎意料的)观测结果的设计维度和权衡,来理解当前用于时间序列预测的深度学习架构的设计空间。本文探讨了将模型设计建立在时间序列组预测原则之上的必要性,以及这些原则如何应用于当前模型。特别是,本文评估了诸如局部性和全局性等概念如何应用于近期的预测架构。实验结果分析表明,考虑这些方面对于获得准确结果而言,可能比采用特定的序列建模层更为重要,而且设计良好的简单预测架构往往能达到最先进水平。本文也讨论了现有架构中被忽视的实现细节如何(1)从根本上改变最终预测方法的类别,以及(2)极大地影响观测到的实证结果。本文研究结果呼吁重新思考当前有缺陷的基准测试实践,并强调在设计架构时需要关注预测问题的基础方面。作为朝着这个方向迈出的一步,综上,本文提出了一个辅助预测模型卡片,其各个字段用于基于关键设计选择来描述现有的和新的预测架构。

Q: 这篇论文试图解决什么问题?

A: 该论文旨在厘清当前深度学习时间序列预测研究中的混乱局面,指出并纠正以下核心问题:

- 设计维度混淆 现有文献将“通道独立”“空间注意力”等实现细节包装为新颖架构,却未意识到这些选择本质上对应于预测理论中早已明确的全局/局部/混合建模范式(D1)。结果是把不同类别的模型(如全局与局部)混为一谈,导致性能差异被错误归因。

- 基准测试失效 主流基准在预处理、协变量、模型配置等维度上缺乏统一规范,使得“新架构优于旧架构”的结论往往源于未被控制的实现差异(D2-D4),而非真正的算法创新。

- 组件贡献不明 通过系统消融实验,作者发现移除所谓核心组件(如空间注意力)反而提升性能,说明当前评估流程无法量化各模块的真实贡献。

- 简单模型被低估 在统一控制设计维度后,极简架构(如带修补的MLP)即可匹配SOTA,表明预测增益主要来自合理的设计原则,而非复杂算子。

综上,论文并非提出又一种“更强”架构,而是建立一套可复现、可解释、可追溯的评估框架,迫使后续研究在比较方法时必须明确四大设计维度,从而把时间序列预测从“玄学堆砌”拉回“科学实证”。

Q: 有哪些相关研究?

A:与本文论点直接相关、可被归入同一对话脉络的研究,按主题分组如下。

研究主题 | 代表性研究 | 核心贡献(与本文论点强相关) |

|---|---|---|

全局 vs. 局部建模范式 | Montero-Manso & Hyndman, 2021 | 系统阐述“global–local–hybrid”三大建模范式,为本文设计维度D1提供理论基础 |

Salinas et al., 2020 (DeepAR) | 提出工业级全局模型,验证共享参数在多序列预测中的有效性 | |

Smyl, 2020 | M4竞赛冠军方案,融合指数平滑与RNN,开创混合模型先河 | |

Sen et al., 2019 | 提出“Think Globally, Act Locally”框架,探索深度网络中全局与局部参数的协同作用 | |

Cini et al., 2023 | 从图视角出发,实现全局-局部参数共享的显式控制,补充混合模型设计细节 | |

对Transformer类架构的质疑与简化 | Zeng et al., 2023 (DLinear) | 用线性模型+时间序列分解,击败多款复杂Transformer,佐证本文“简单架构可匹配SOTA”的结论 |

Toner & Darlow, 2024 | 重新检验线性基准模型性能,指出复杂架构的性能优势可能源于评估偏差 | |

Shao et al., 2024 | 构建大规模异质性基准,发现多数“SOTA”结果不可复现,呼应本文对基准测试缺陷的批判 | |

Tan et al., 2024 | 分析语言模型在时间序列预测中的边际收益,进一步质疑复杂架构的必要性 | |

通道独立 / 空间注意力再审视 | Nie et al., 2023 (PatchTST) | 提出“通道独立+修补”机制,被本文重新诠释为“全局模型”,为D1维度分析提供典型案例 |

Liu et al., 2023b (iTransformer) | 设计“倒置注意力”,聚焦空间维度建模,成为本文D4维度(空间处理)的核心消融对象 | |

Zhang & Yan, 2023 (Crossformer) | 提出跨维度注意力机制,探索时空协同建模,补充空间处理模块的多样性 | |

Ma et al., 2019; Grigsby et al., 2021 | 早期时空注意力研究,证明该机制在图时空领域的应用早于时间序列预测,质疑“创新组件”的新颖性 | |

评估流程与可复现性批判 | Brigato et al., 2025 | 指出“长期预测无绝对冠军”,超参数、数据集选择主导排行榜,强化本文对基准测试缺陷的论证 |

Herrmann et al., 2024 | 全面批判机器学习实证研究的不规范问题,为本文呼吁优化基准流程提供跨领域支撑 | |

Raichuk et al., 2021 | 以RL领域为例,开展“什么才重要”的大规模消融,为本文四维度分析提供研究方法论参考 | |

Errica et al., 2020; Dwivedi et al., 2023 | 推动图神经网络标准化评估,为时间序列预测领域的评估规范提供借鉴 | |

模型卡片与报告规范 | Mitchell et al., 2019 | 提出通用模型卡片框架,为本文“预测模型卡片”提供基础模板 |

Wang et al., 2024b | 时间序列领域综述,明确呼吁标准化模型报告,与本文卡片设计初衷一致 | |

Qiu et al., 2024 (TFB) | 提出公平基准测试流水线,与本文模型卡片互补,共同解决评估透明度问题 |

核心研究共识总结

- 建模范式(全局/局部/混合)的选择,对预测精度的影响远大于具体网络算子的选择。

- 线性或极简架构的性能常被低估,其表现可媲美甚至超越复杂Transformer类模型。

- 预处理方式、协变量使用、参数共享模式等“隐性细节”,足以颠覆基准测试排行榜结果。

- 领域内已形成共识:需通过标准化评估流程、规范化模型报告(如模型卡片),解决可复现性危机。

Q: 论文如何解决这个问题?

论文核心解决方案:从“比高低”到“析因果”的三步优化流程

针对前文共识中提及的“归因混乱、评估不规范”核心问题,论文未追求新的SOTA架构,而是通过“诊断-控制-标准化”三步流程,将评估焦点从“谁的性能更高”转向“性能为何高”,从根源上解决虚假进步与混乱归因问题,具体实施路径如下:

- 诊断:定位四大核心混淆源 论文统一复现7个代表性预测模型,通过实验发现:同一算法在“局部嵌入/全局共享”“有/无协变量”“有/无空间注意力”三种关键配置切换下,性能排名可完全颠倒(对应原文Tab.1–Tab.4)。基于此,论文将以往被包装为“新算子创新”的本质差异,提出了D1(模型配置)、D2(预处理与协变量)、D3(时间处理)、D4(空间处理)四大设计维度的选择差异,明确了归因混乱的核心根源。

- 控制:开展维度固定对照实验 为精准定位各维度的真实影响,实验设计严格遵循“单一变量原则”:每一组对比仅允许变动一个设计维度,其余条件(预处理方式、超参数、随机种子等)保持完全一致。同时,引入“模块化参考架构”,整合MLP、TCN、Transformer、Pyraformer等可插拔单元,确保不同模型的对比基准统一,彻底排除无关变量干扰。

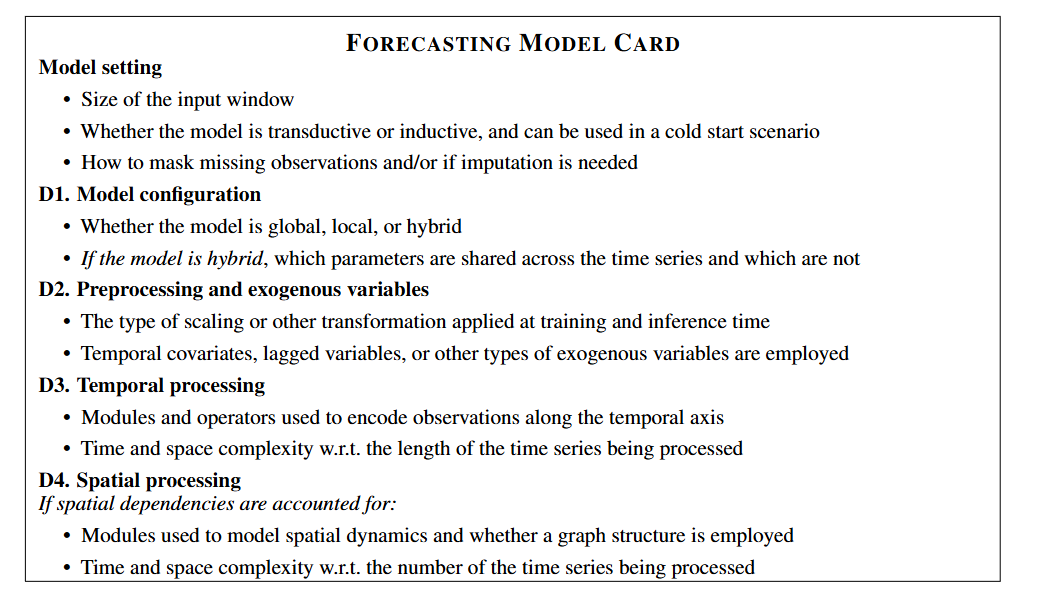

- 标准化:提出Forecasting Model Card(预测模型卡片) 为固化实验控制成果、保障后续研究可复现性,论文设计并提出预测模型卡片,强制要求记录12项核心字段,包括窗口长度、建模范式(全局/局部/混合)、参数共享方案、数据缩放方式、协变量列表、时空模块复杂度等关键信息。通过提供示例卡片(原文Tab.19),为后续研究搭建统一的对比框架,确保所有设计细节透明化,消除隐藏偏差。

通过上述三步流程,论文得出关键验证结论,进一步佐证了核心共识:① 简单MLP结合patching策略,在四大公开数据集上即可匹配甚至超越PatchTST、iTransformer等主流“SOTA”模型;② 移除iTransformer的空间注意力模块后性能反而提升,证明其性能增益源于设计维度选择而非算子本身;③ 当四大设计维度被显式控制后,不同序列建模层(如MLP与Transformer)的性能差异大幅缩小。

预测模型卡片

基于上述分析,可以设计预测模型卡片:

预测模型卡片

预测模型卡片

模型设置

- 输入窗口大小

- 模型是直推式还是归纳式,以及是否可用于冷启动场景

- 如何掩蔽缺失观测值和/或是否需要插补

D1. 模型配置

- 模型是全局模型、局部模型还是混合模型

- 如果是混合模型,哪些参数在时间序列中共享,哪些不共享

D2. 预处理和协变量

- 在训练和推理时应用的缩放或其他变换类型

- 是否使用时间协变量、滞后变量或其他类型的协变量 D3. 时间处理 用于沿时间轴编码观测值的模块和运算符

- 相对于所处理时间序列长度的时间和空间复杂度

D4. 空间处理

- 如果考虑了空间依赖性: 用于对空间动态进行建模的模块以及是否采用图结构

- 相对于所处理时间序列数量的时间和空间复杂度

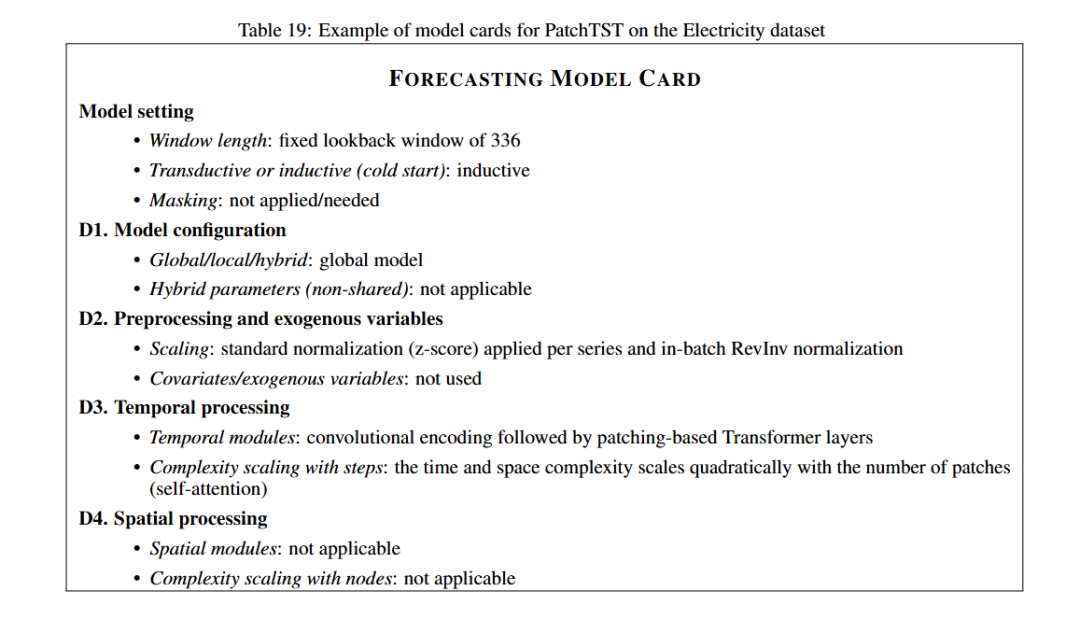

下面是PatchTST的模型卡片介绍

PatchTST在Electricity的卡片

PatchTST在Electricity的卡片

模型设置

- 输入窗口长度:固定为336

- 模型是否需要适配 “训练时未见过的新时间序列”:归纳式

- inductive(归纳):模型在训练阶段仅接触部分时间序列,训练目标是学习一套 “通用规律”,能够泛化到训练时未见过的全新时间序列(即支持 “冷启动” 场景)。

- Transductive(直推):模型在训练阶段已经接触到所有需要预测的时间序列(包括测试集对应的序列),训练目标是仅适配这部分已知序列,不具备泛化到全新序列的能力。

- 掩码设置:不需要

模型配置

- 全局/局部/混合:全局

- 混合参数(不共享):不适用

预处理和协变量

- 扩展性:标准归一化(z-score)和batch内部采用RevInv归一化

- 协变量:不利用

时间处理

- 时间模块:基于Patch的Transformer层卷积编码

- 复杂度随步数增长的变化:间和空间复杂度与补丁数量呈二次方关系(自注意力机制)

空间处理

- 空间模块:不适用

- 复杂度随着节点扩展变化:不适用

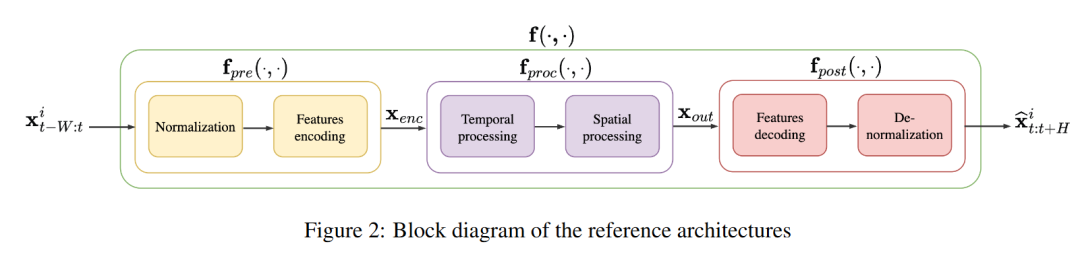

模块范式的参考架构

参考架构由预处理(preprocessing)模块、时空动态处理模块(processing of the temporal and spatial dynamics)和后处理(postprocessing )模块组成。其模块化结构便于理解架构,并促进公平比较,因为每个模块都可以独立修改。

模块范式的参考架构

模块范式的参考架构

Q: 论文做了哪些实验?

A:论文围绕“四大设计维度”共执行了 4 组核心对照实验 + 3 组扩展实验,所有结果均在 4 个公开数据集(Electricity、Weather、Traffic、Solar)上、3 次独立运行取平均,统一使用 70 %/10 %/20 % 训练/验证/测试划分。以下实验均控制“仅变动目标维度,其余完全一致”。

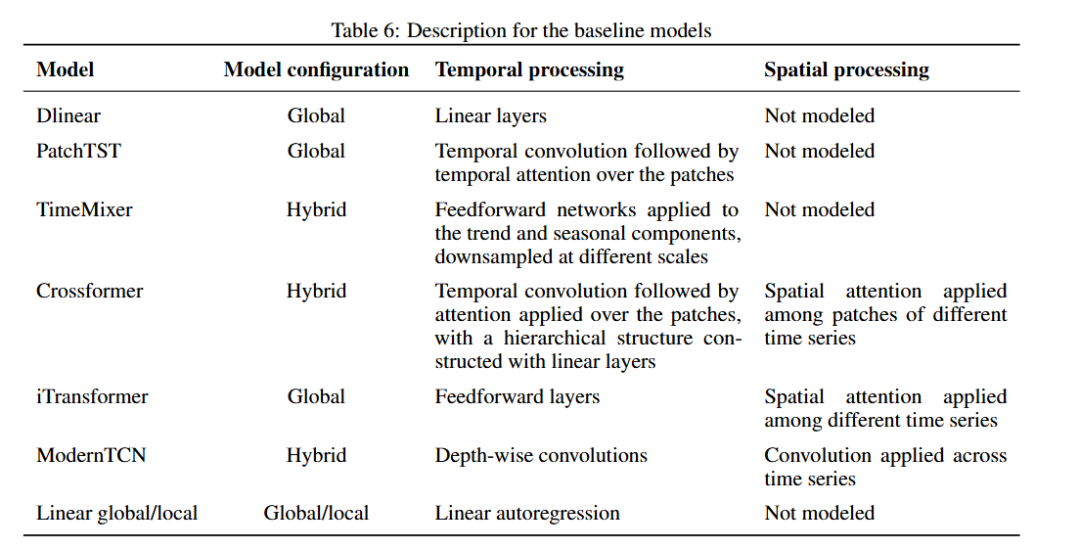

本文选取的baseline

本文选取的baseline

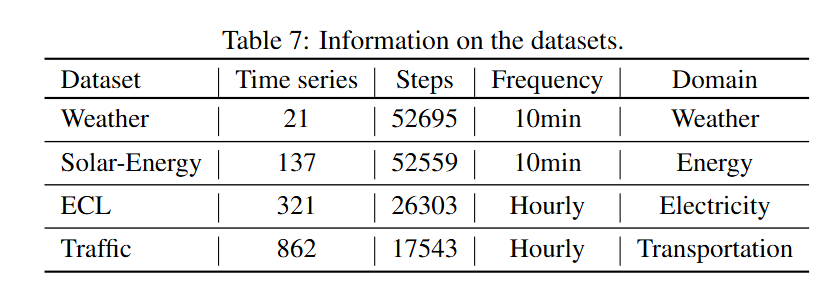

数据集描述

数据集描述

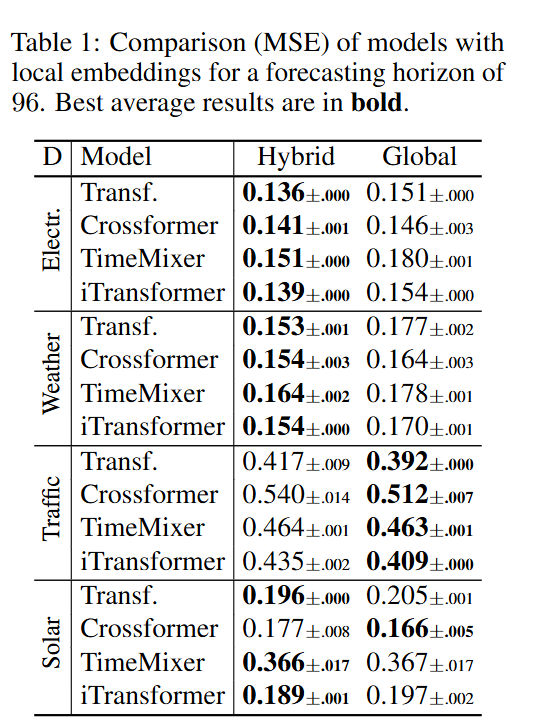

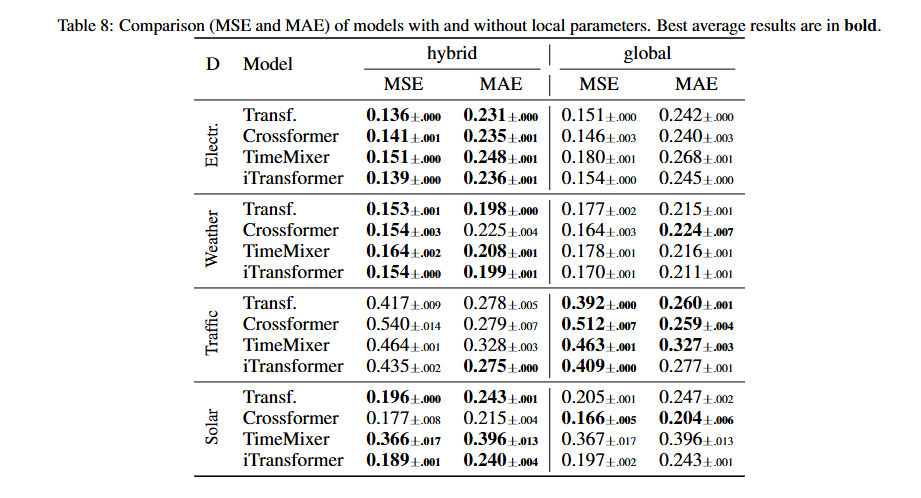

诊断:定位四大核心混淆源** 论文统一复现7个代表性预测模型,通过实验发现:同一算法在“局部嵌入/全局共享”“有/无协变量”“有/无空间注意力”三种关键配置切换下,性能排名可完全颠倒(对应原文Tab.1–Tab.4)。基于此,论文将以往被包装为“新算子创新”的本质差异,还原为前文提及的D1(模型配置)、D2(预处理与协变量)、D3(时间处理)、D4(空间处理)四大设计维度的选择差异,明确了归因混乱的核心根源。四大设计维度的具体内涵如下:

1. D1 模型配置(Model Configuration)(全局 vs 局部 vs 混合)

核心是确定模型参数的共享模式,即如何在多个时间序列间分配模型参数,是影响预测性能的基础维度。关键选择分为三类:① 全局型(Global):所有时间序列共用一套模型参数,适合捕捉多序列共性,典型如Salinas et al., 2020提出的DeepAR;② 局部型(Local):为每个时间序列单独训练一套参数,能精准适配单序列特异性,但数据需求量大、泛化性较弱;③ 混合型(Hybrid):融合全局与局部优势,部分参数全局共享(提取共性),部分参数局部专属(适配个性),典型如Smyl, 2020的混合指数平滑+RNN方案、Sen et al., 2019的“Think Globally, Act Locally”框架。

- 对象:Transformer、Crossformer、TimeMixer、iTransformer

- 操作: – 删除原局部嵌入/归一化参数 → 纯全局版本 – 给纯全局 iTransformer 追加可学习序列 ID → 混合版本

- 指标:MSE、MAE( horizon=96 )

- 结论:同一算法切换配置后排名可完全反转(Tab.1、Tab.8)。

MSE的混合型vs全局型

MSE的混合型vs全局型

MSE和MAE的混合型vs全局型

MSE和MAE的混合型vs全局型

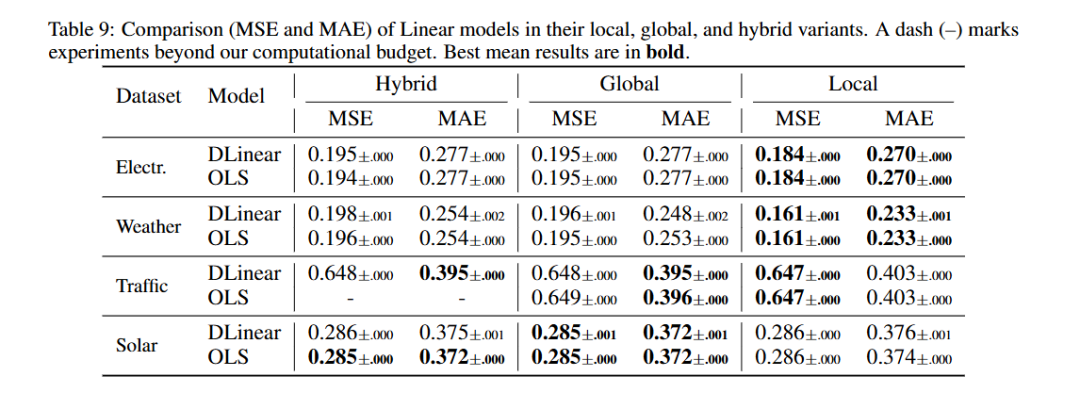

MSE和MAE的混合vs全局vs局部

MSE和MAE的混合vs全局vs局部

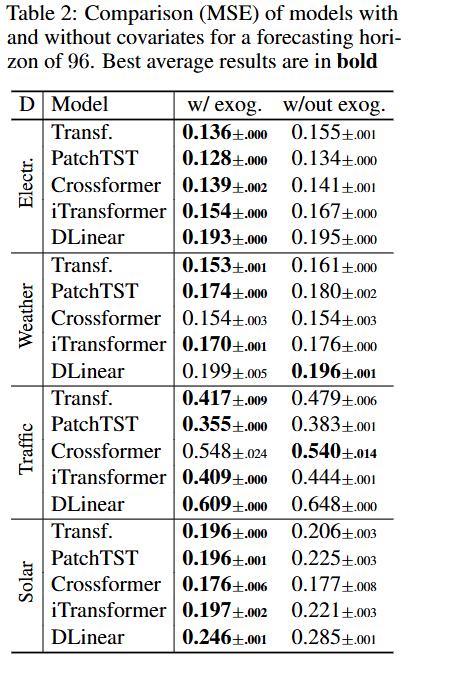

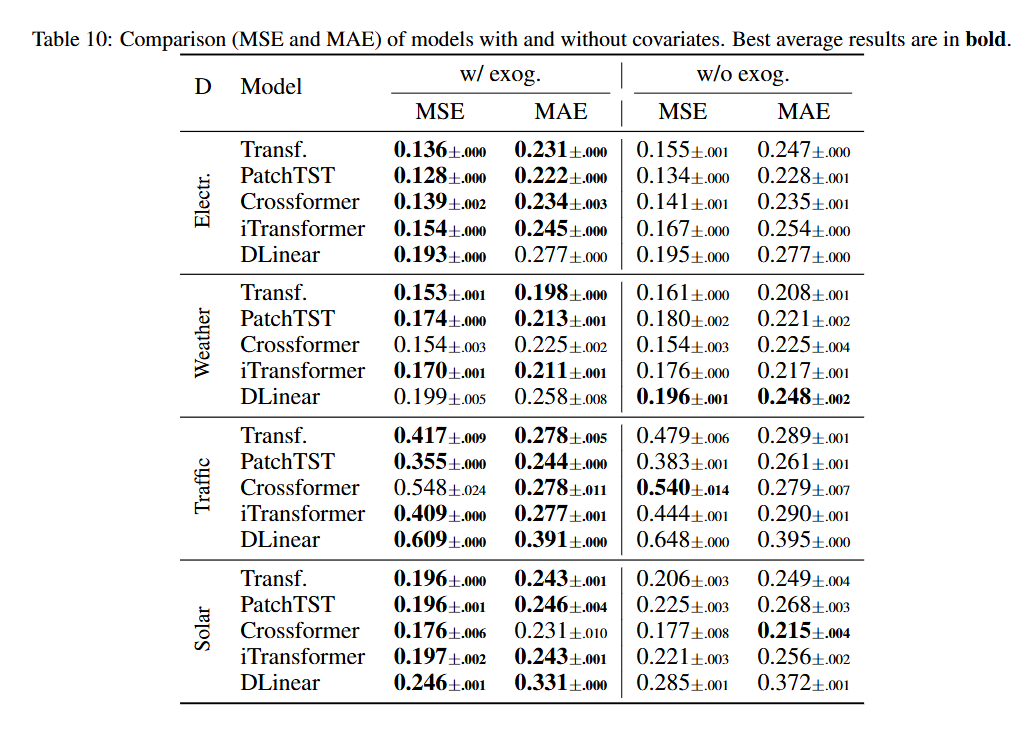

2. D2 预处理与协变量(Preprocessing and Exogenous Variables)(有 vs 无)

涵盖数据预处理策略与外部辅助信息的使用,是易被忽视但影响显著的维度。具体包括两部分:① 预处理方式:如数据是否进行标准化/归一化、是否去除趋势项/季节性成分、缺失值如何处理(插补/掩码)等;② 协变量使用:是否引入外部辅助变量,以及变量类型(如时间特征:小时、星期、节假日;环境特征:天气、温度;业务特征:销量、客流量等)。

- 对象:PatchTST、DLinear、Crossformer(原无协变量) vs Transformer、iTransformer(原有协变量)

- 操作:统一加入/删除日历特征(小时、星期、节假日)

- 结论:协变量带来的绝对 MSE 差异最高达 25 %(Traffic 上 DLinear 0.609→0.648),足以改变胜负(Tab.2、Tab.10)。

有无协变量的MSE

有无协变量的MSE

有无协变量的MSE和MAE

有无协变量的MSE和MAE

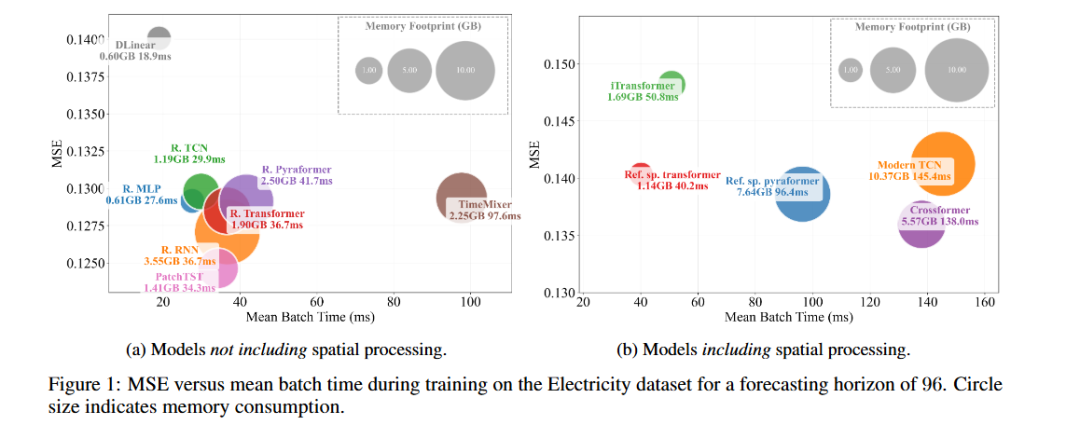

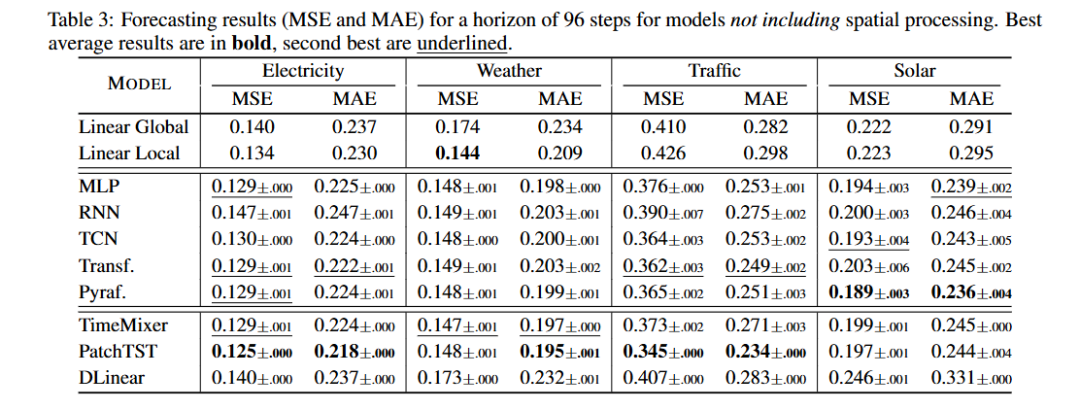

3. D3 时序处理算子(Temporal Processing)(仅时序、无空间)

聚焦单个时间序列内部时间依赖关系的捕捉,核心是选择合适的模块提取序列的时间规律。常见模块选择包括:简单模型(如MLP、线性模型)、经典时序模型(如RNN、LSTM)、深度学习模块(如TCN、Transformer、分块注意力机制)等。该维度需同时关注模块的时间复杂度,即性能随序列长度增长的变化趋势。

- 对象:参考架构 MLP、TCN、RNN、Transformer、Pyraformer

- 对照:PatchTST、DLinear、TimeMixer

- 操作:

- 全部改为“混合-全局+协变量+局部嵌入”统一配置

- ;

- 结论:

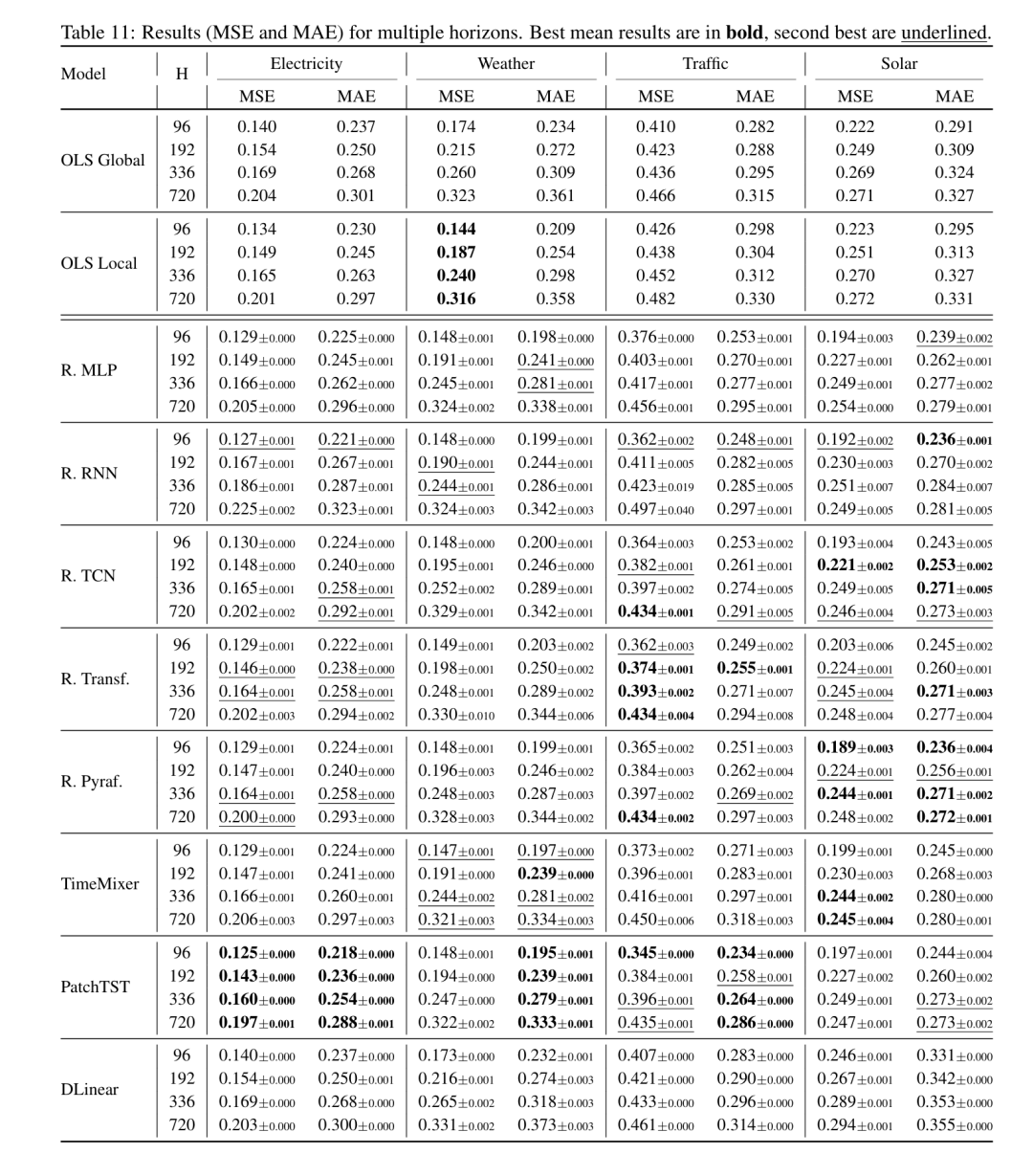

- 极简 MLP/TCN 与 PatchTST 误差差异 < 1 %(Tab.3、Tab.11)。

- 图 1 / 图 3 显示 MLP、TCN、PatchTST 在 GPU 内存与训练时间上效率最高。

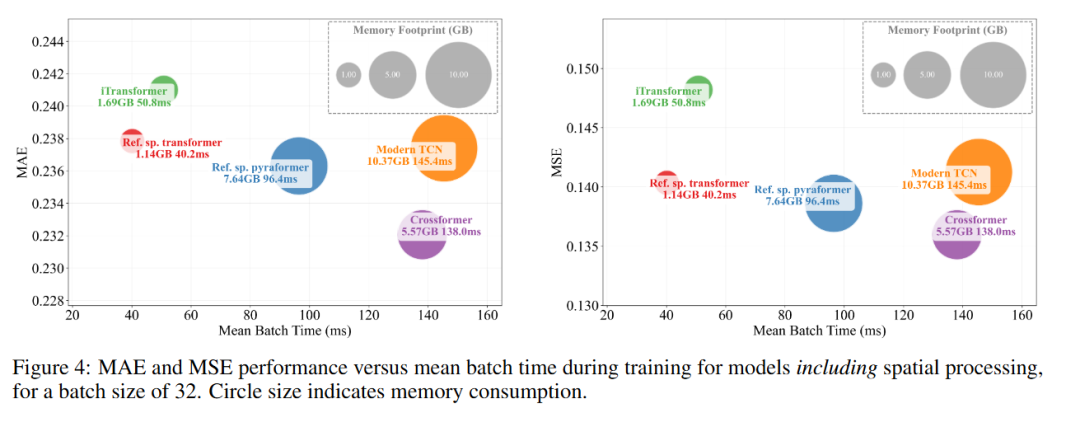

Electricity数据集上有无空间处理的效率衡量

Electricity数据集上有无空间处理的效率衡量

多步预测MAE和MSE结果

多步预测MAE和MSE结果

无空间处理的96步预测

无空间处理的96步预测

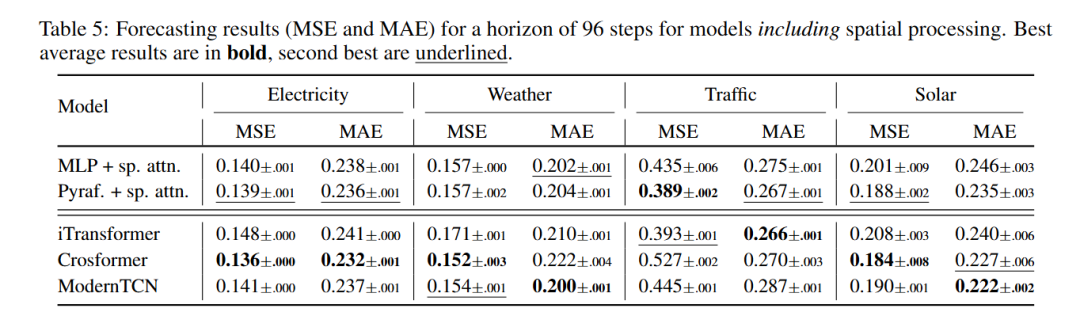

有空间处理的96步预测

有空间处理的96步预测

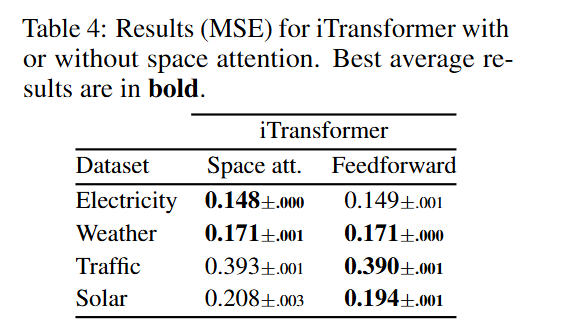

4. D4 空间处理(Spatial Processing)(有 vs 无空间注意力)

针对多序列预测场景,核心是捕捉不同时间序列之间的关联关系(即“空间依赖”)。关键选择包括:是否引入空间关联建模模块(如空间注意力、卷积层、图神经网络)、是否依赖先验图结构(如传感器位置关系、区域关联关系)等。实验表明,部分空间模块(如iTransformer的倒置注意力)并非必要,移除后性能反而提升,印证其增益可能源于其他设计维度。

- 对象:参考架构 MLP+sp.attn、Pyraformer+sp.attn

- 对照:iTransformer、Crossformer、ModernTCN

- 操作:

- 统一 window=96,减少计算开销

- 额外做 iTransformer 自身消融:把空间注意力替换为前馈层

- 结论:

- 参考架构继续与 SOTA 打平(Tab.5、Tab.13)。

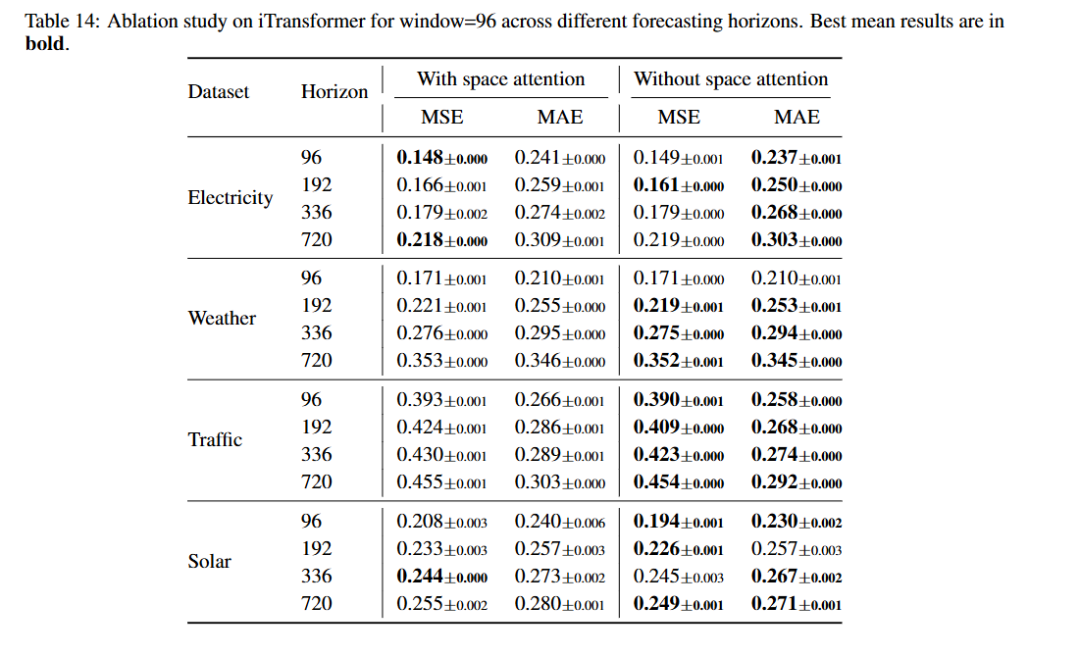

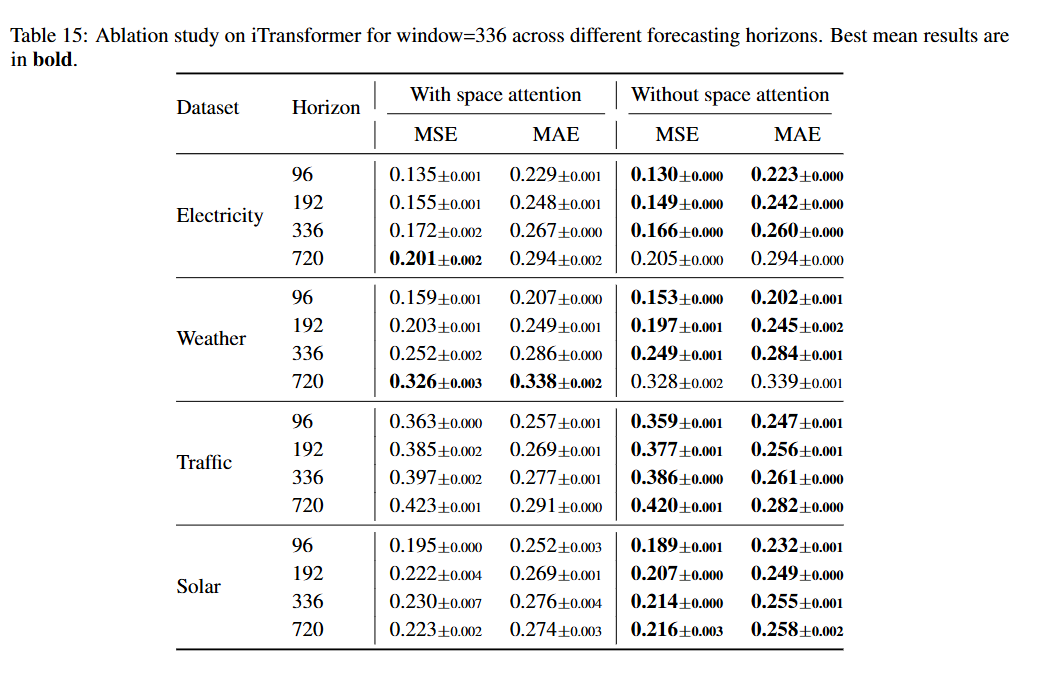

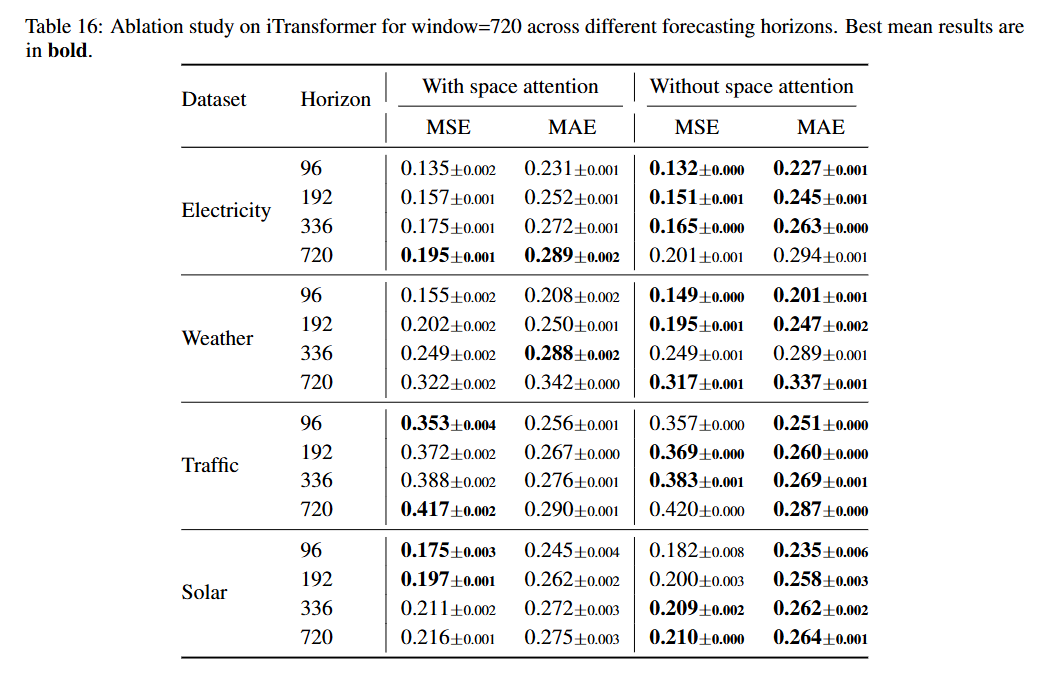

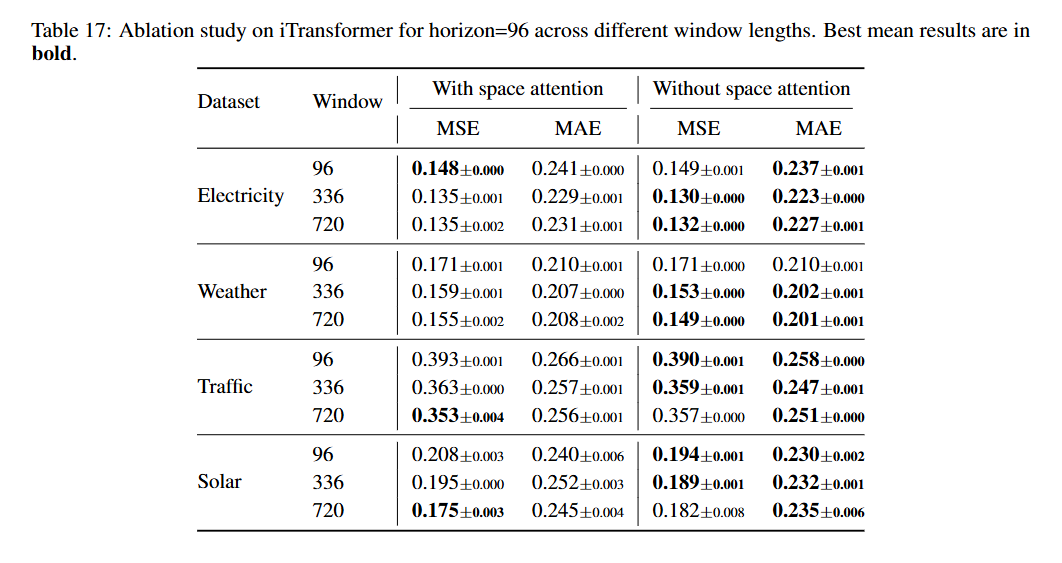

- iTransformer 去掉空间注意力后 4 个数据集有部分结果不降反升,在sloar数据集上最大改进 6.7 %(Tab.4、Tab.14–Tab.17)。

iTransformer在不同数据集上有无空间注意力的MSE

iTransformer在不同数据集上有无空间注意力的MSE

iTransformer输入长度96的在不同数据集上有无空间注意力的MSE和MAE

iTransformer输入长度96的在不同数据集上有无空间注意力的MSE和MAE

iTransformer输入长度336的在不同数据集上有无空间注意力的MSE和MAE

iTransformer输入长度336的在不同数据集上有无空间注意力的MSE和MAE

iTransformer输入长度720的在不同数据集上有无空间注意力的MSE和MAE

iTransformer输入长度720的在不同数据集上有无空间注意力的MSE和MAE

iTransformer预测长度为96的在不同数据集上有无空间注意力的MSE和MAE

iTransformer预测长度为96的在不同数据集上有无空间注意力的MSE和MAE

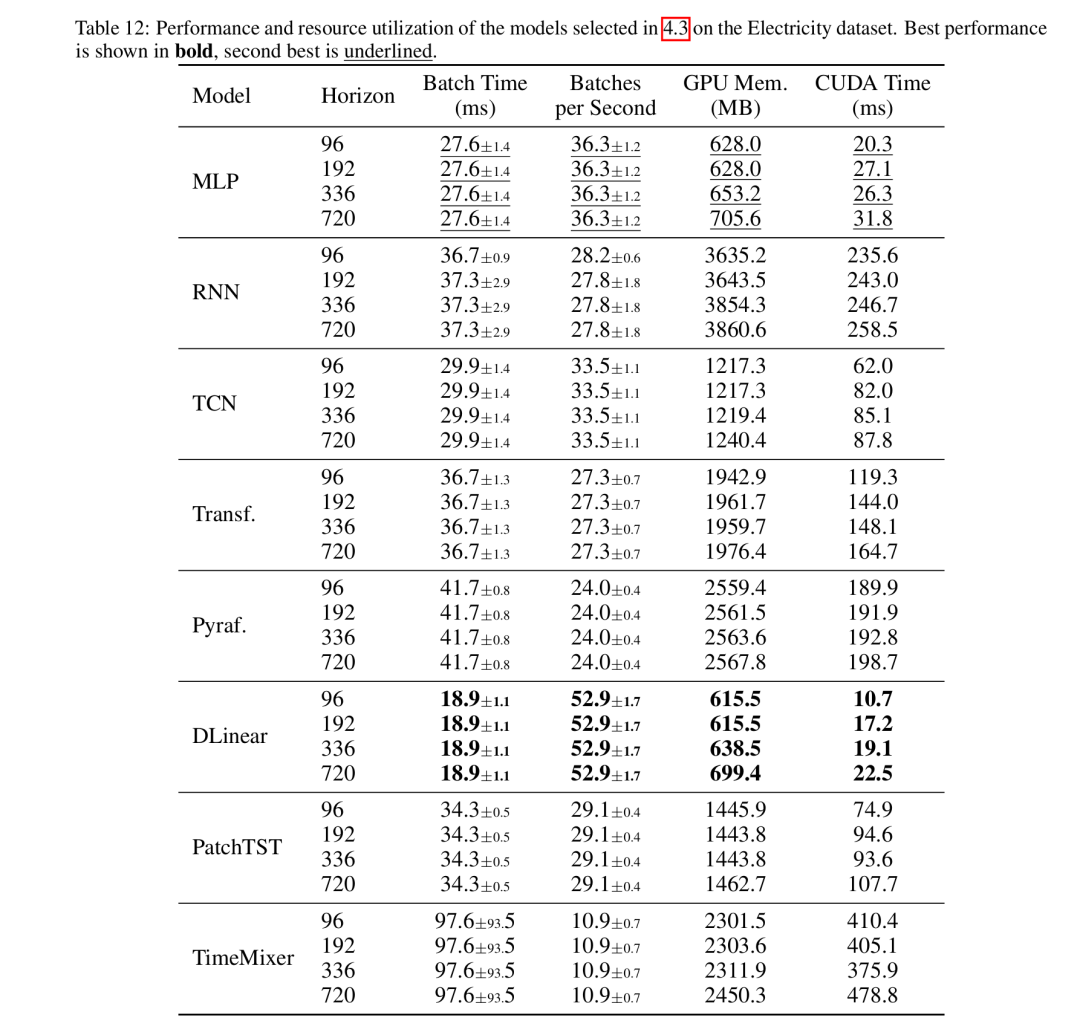

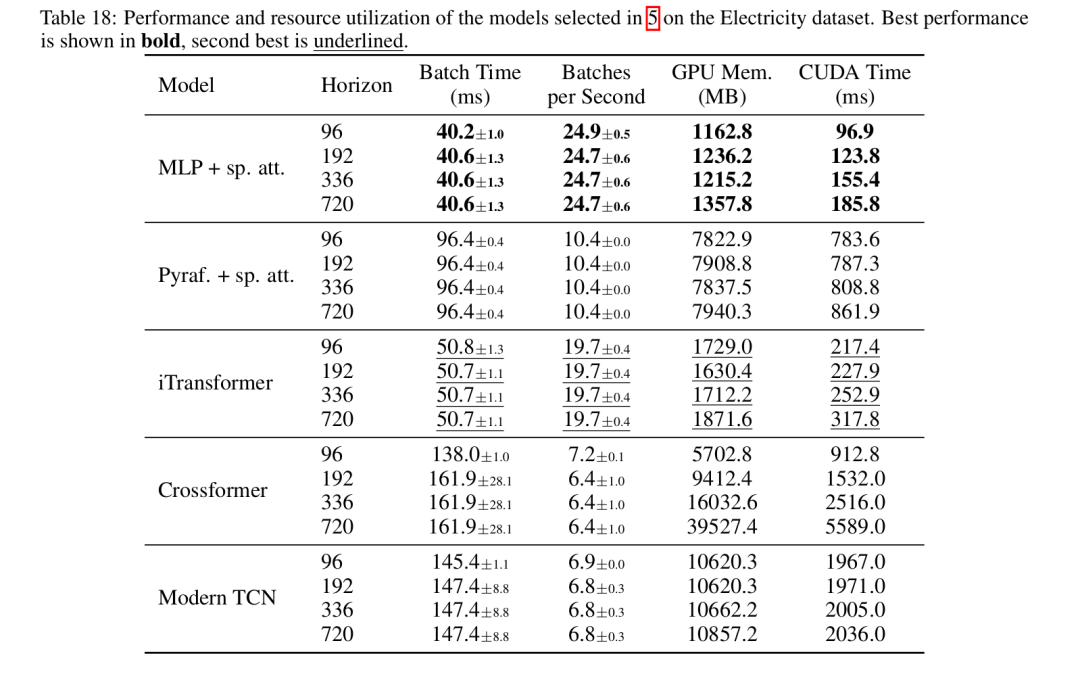

5. 计算效率对比

- 平台:单张 A100-PCIe 40 GB,Oracle Linux

- 记录:PyTorch Profiler CUDA 时间、batch 时间、GPU 内存

- 结果:

- 无空间模块:MLP 最快(27.6 ms/batch, 628 MB),Transformer 慢 33 %,TimeMixer 慢 3×(Tab.12)。

- 含空间模块:Crossformer 显存最高 39 GB,batch 时间 162 ms;MLP+sp.attn. 仅 40 ms、1.2 GB(Tab.18、Fig.4)。

MAE和MSE在有空间处理的模型上效率对比

MAE和MSE在有空间处理的模型上效率对比

时间处理层面的Electricity数据集的性能和资源利用对比

时间处理层面的Electricity数据集的性能和资源利用对比

空间处理层面的Electricity数据集的性能和资源利用对比

空间处理层面的Electricity数据集的性能和资源利用对比

6. 线性模型完整配置矩阵

- 对象:OLS、DLinear

- 配置:Local / Global / Hybrid(逐序列 one-hot 向量)

- 结论:Weather 数据集上 Local-OLS 0.161 击败所有深度学习模型,验证“异构多变量序列用局部模型更优”的先验知识(Tab.9)。

通过上述实验,论文用“维度固定-对照-量化”方式证明:

- 性能差异主要来自四大设计选择,而非特定算子;

- 简单架构在受控条件下即可匹配或超越现有 SOTA;

- 空间注意力等“创新”在长期预测任务上常呈负收益。

推荐阅读

AI论文速读 | 深度时间序列预测的未来走向:精度定律的发现与应用

此公众号的文章皆系本人原创,辛苦码字不易!如需转载,引用请注明出处。如商用联系作者。

如果觉得有帮助还请分享,在看,点赞

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录