ollama v0.17.7 最新发布:思考层级正确解析、上下文压缩强化,核心模块全面优化!

ollama v0.17.7 最新发布:思考层级正确解析、上下文压缩强化,核心模块全面优化!

福大大架构师每日一题

发布于 2026-03-09 14:44:40

发布于 2026-03-09 14:44:40

在这里插入图片描述

在这里插入图片描述

在这里插入图片描述

2026 年 3 月 6 日,Ollama 正式推出了 v0.17.7 最新版本。这一版本相较于此前版本在“思考(thinking)模型”的解析逻辑、上下文压缩机制、云模型上下文限制、以及集成接口的兼容性层面都有了实质性的优化。

本文将带你完整拆解 Ollama v0.17.7 的详细更新内容,逐个模块分析这次版本的变更点,帮助开发者快速理解每一次调整背后的逻辑与意义。

一、版本总览与更新主题

🟩 发版日期

版本号:v0.17.7 发布时间:2026 年 3 月 6 日

🟩 本次更新主题概要:

- 1. 增强思考层级(Thinking Level)的解析能力: “medium”、“high”等字符串思考层级可正确被 Ollama API 解析,不再受限于单个模型类型。

- 2. 新增上下文长度(Context Length)支持:

当使用

ollama launch启动时,系统支持自动压缩适配上下文,提升长文本推理能力。 - 3. 完善云模型上下文配置映射: 多个知名模型(如 qwen3.5、glm-5、kimi 系列)获得标准化的上下文与输出长度定义。

- 4. Pi、OpenCode、OpenClaw 等指令模块全面修正: API 接口、云模型判断逻辑、旧配置刷新策略,均获得优化。

- 5. 冗余验证逻辑移除:

对

think参数的冗余校验规则移除,使思考参数在多模型中的适配更加灵活。

从整体方向来看,v0.17.7 是一次功能稳定性和上下文智能处理能力的加强版更新,尤其对基于多模型集成的项目环境非常友好。

二、主要改动总览

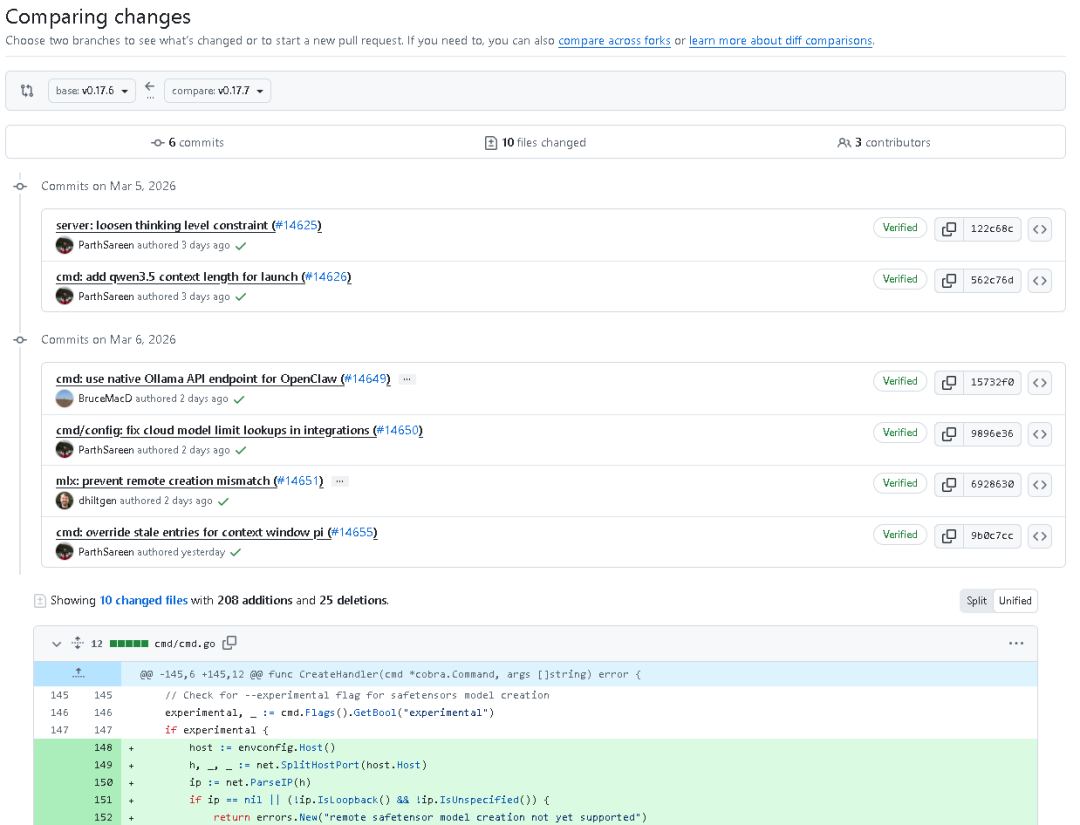

根据官方变更记录,本次版本累计:

- • 6 次核心提交

- • 修改文件 10 个

- • 208 行新增代码

- • 25 行删除代码

- • 涉及模块 3 个核心组件:Server、cmd、mlx

从提交顺序上看:

- • 3 月 5 日两次提交集中在命令行配置与思考层级调整;

- • 3 月 6 日四次提交则完成了上下文窗口修复与云模型限制逻辑优化。

三、核心更新详解

(一)思考层级解析能力全面开放

此前版本中,Ollama 的 API 在处理 Think 参数时,字符串类型(如 "medium", "deep")仅能在“harmony”或“gptoss”模型中合法使用,其他模型将返回:

think value “xxx” is not supported for this modelv0.17.7 版本正式移除了该逻辑限制。在 server/routes.go 文件中,

原先的校验条件代码片段已被完全删除:

if req.Think != nil && req.Think.IsString() && m.Config.Parser != "harmony" {

c.JSON(http.StatusBadRequest, gin.H{...})

return

}删除后,Think 参数的字符串值不再受到模型解析器类型的约束,

意味着——所有启用了“思考模式(thinking models)”的模型现在都能正确解析这种层级类型参数。

✅ 影响意义:这为多样化模型的统一 API 接入带来了极大便利,使开发者可以在同一指令集下设定思考深度,无需区分模型类别。

(二)新的上下文长度支持与压缩机制

1. 新增 qwen3.5 模型上下文长度定义

在 cmd/config/integrations.go 文件中,cloudModelLimits 新增了如下条目:

"qwen3.5": {Context: 262_144, Output: 32_768},表明 qwen3.5 云模型的上下文长度被设定为 262,144 tokens, 输出上限为 32,768 tokens。

这与同系列模型(如 qwen3-coder-next、qwen3-next:80b)的规格保持一致,构建了更标准化的上下文配额体系。

2. 支持上下文压缩(compaction)

命令行工具 ollama launch 现在可以根据模型定义的上下文长度进行压缩计算。

这一机制允许系统在长上下文对话中动态压缩历史轮次,将上下文保持在最佳 token 范围内,确保推理完整性与响应速度。

✅ 价值点:上下文自动压缩让大型推理模型具备长记忆但不溢出的特性,尤其在多回合对话或 code completion 场景中有显著优化。

(三)云模型上下文限制与重建机制优化

1. 加强 cloudModelLimit 映射逻辑

在 cmd/config/opencode.go 文件中,新增逻辑允许系统自动识别 “-cloud” 或 “:cloud” 后缀:

for _, suffix := range []string{"-cloud", ":cloud"} {

name = strings.TrimSuffix(name, suffix)

}这意味着模型名无论写作:

glm-5:cloud

glm-5-cloud系统都能正确识别并加载对应上下文设定 {Context: 202_752, Output: 131_072}。

自动化后缀标准化,解决了过往因命名差异导致的配置无法识别问题。

2. 创建与重建逻辑修复

在 cmd/config/pi.go 与 cmd/config/pi_test.go 中补充了云模型配置的重建机制:

- • 自动检测

contextWindow字段是否存在; - • 若字段缺失且该模型可在

cloudModelLimit中查到,则重建该条配置; - • 同时移除过期字段(如

legacyField)以确保结构一致性。

测试验证中明确指出:

若 glm-5:cloud 没有上下文窗口值,系统将重新创建条目并附加 contextWindow = 202_752。

if !hasContextWindow(modelObj) {

if _, ok := lookupCloudModelLimit(id); ok {

continue

}

}✅ 作用总结:

- • 修复云模型上下文缺失问题;

- • 自动清理冗余旧字段;

- • 提升配置文件的一致性与可靠性。

(四)OpenClaw 模块改进

OpenClaw 负责模型调用 API 链接,此前默认 baseUrl 结尾强制添加 /v1,导致部分 API 出现路径叠加(例如 …/v1/v1)问题。

本次在 cmd/config/openclaw.go 中修正:

ollama["baseUrl"] = envconfig.Host().String()测试文件 cmd/config/openclaw_test.go 同步更新,去除旧路径结尾的 /v1,确保一致性。

✅ 效果提升:

- • 避免 API endpoint 重复;

- • 简化调用路径;

- • 与新版 native Ollama API 端点保持一致。

(五)Pi 模块的大幅改进

Pi 模块负责编排模型配置生成,v0.17.7 针对云模型上下文自动识别逻辑进行了完善。

1. 新增 hasContextWindow 函数

新增函数用于判断是否已有上下文长度字段:

func hasContextWindow(cfg map[string]any) bool {

switch v := cfg["contextWindow"].(type) {

case float64, int, int64:

return v > 0

default:

return false

}

}2. 引入云上下文窗口回退逻辑

当执行 createConfig 时,如果从 API /api/show 未获取到 ModelInfo, 将自动根据云模型限制填入默认上下文:

if l, ok := lookupCloudModelLimit(modelID); ok {

cfg["contextWindow"] = l.Context

}测试文件确认:

- • 当 Show API 返回 404 或空信息时,依旧能回退正确上下文;

- • 示例中

kimi-k2.5:cloud的上下文被自动设置为262_144。

✅ 改进意义:模型初始化更加健壮,在远程信息缺失时仍能运行; 减少了人工介入,确保集成系统完整可用。

(六)OpenCode 修复与测试扩展

OpenCode 模块是代码 AI 一体化配置接口。v0.17.7 针对已有模型配置文件进行了回填逻辑优化。

新增测试验证,当系统重新编辑已存在的云模型时,会补全缺失的上下文限制信息。例如:

"glm-5:cloud": {

"name": "glm-5:cloud",

"_launch": true

}执行更新操作后将自动附加:

"limit": {

"context": 202752,

"output": 131072

}✅ 成果: 老版本

opencode.json的兼容性提高,保证历史配置文件可连贯升级。

(七)mlx 模块修正远程创建匹配问题

在 mlx: prevent remote creation mismatch 提交中,系统修正了在远程 Safetensor 模型创建时的 IP 校验逻辑。若发现主机非回环(loopback)或非空 IP,将直接拒绝远端模型创建:

if ip == nil || (!ip.IsLoopback() && !ip.IsUnspecified()) {

return errors.New("remote safetensor model creation not yet supported")

}✅ 影响:防止因错误网络地址导致模型同步冲突,提升安全性。

四、代码逻辑层细节变化汇总

模块文件 | 修改点 | 功能概述 |

|---|---|---|

server/routes.go | 删除 think 参数约束 | 思考层级开放支持全部模型 |

cmd/config/integrations.go | 增加 qwen3.5 定义 | 新增上下文压缩支持 |

cmd/config/openclaw.go | 修正 baseUrl | 原生端点路径对齐 |

cmd/config/pi.go | 引入 hasContextWindow / createConfig 优化 | 云模型上下文自动重建 |

cmd/config/opencode.go | 添加后缀规范识别 | 统一识别 -cloud 与 :cloud |

cmd/config/opencode_test.go | 新增多模型测试 | 全覆盖 gpt-oss, glm, kimi |

cmd/config/pi_test.go | 扩展回退逻辑验证 | 确保云上下文自动填充 |

cmd/config/droid_test.go | 增加统一输出验证 | 确认多后缀模型一致性能 |

五、综合影响分析

1. 对开发者的实际影响

- • API 可直接传入

"medium"、"deep"等思考参数; - • 模型配置自动维护上下文窗口,无需手工更新;

- • 云端与本地接口路径标准化,减少出错;

- • 历史配置自动修复兼容。

2. 对模型推理性能的影响

- • 加强上下文压缩与回退机制,使长文本处理稳定;

- • 云模型上下文定义统一,减少显存溢出风险;

- • models.json 文件更加简洁、自动化管理程度提高。

3. 对生态的意义

这一版本的细节改动虽然微小,但一起构筑了 Ollama 进一步兼容多模型生态的重要基础框架。 更灵活的 “thinking levels”、更稳健的上下文窗口回退机制,让 Ollama 在多模态与思维推理方向上迈出了关键一步。

六、总结

代码地址:github.com/ollama/ollama

Ollama v0.17.7 是一次 “稳中有升” 的版本升级。

它的所有更新都围绕两个关键词 —— “智能解析” 与 “上下文稳定性”:

重点领域 | 改进要点 |

|---|---|

思考层级系统 | 全面解析支持,移除模型限定 |

上下文系统 | 压缩、回退、标准化齐备 |

云模型映射 | 统一后缀、多文件自校正 |

命令行接口 | launch 上下文智能初始化 |

API Path | baseUrl 修正为标准格式 |

整体上,Ollama 通过这次更新显著优化了基础逻辑层,为后续版本铺设了更强的兼容性和稳定性保证。

·

我们相信人工智能为普通人提供了一种“增强工具”,并致力于分享全方位的AI知识。在这里,您可以找到最新的AI科普文章、工具评测、提升效率的秘籍以及行业洞察。 欢迎关注“福大大架构师每日一题”,发消息可获得面试资料,让AI助力您的未来发展。

·

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-07,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录